סיכום קצר: מסגרות סוכני בינה מלאכותית מספקות את התשתית הבסיסית לבניית מערכות בינה מלאכותית אוטונומיות המסוגלות לתפוס, להסיק מסקנות ולפעול. מסגרות מובילות כגון LangGraph, CrewAI ו-Microsoft Agent Framework מציעות ארכיטקטורות שונות — החל מתזמור מבוסס גרפים עם מצב (stateful) ועד למערכות שיתוף פעולה בין סוכנים מרובים — כאשר כל אחת מהן מתאימה למקרי שימוש ספציפיים, החל מאוטומציה של משימות פשוטות ועד לתהליכי עבודה ארגוניים מורכבים.

המעבר ממודלים לשוניים גדולים מסורתיים לסוכני בינה מלאכותית אוטונומיים מהווה את אחד השינויים המשמעותיים ביותר בתחום הבינה המלאכותית. אך הנה העניין: פיתוח סוכנים שבאמת פועלים בסביבת ייצור דורש יותר מאשר רק חיבור של כמה קריאות API.

מסגרות הסוכנים נוצרו כדי לפתור בדיוק את הבעיה הזו. הן מספקות את תבניות הארכיטקטורה, כלי התיאום ויכולות האינטגרציה הדרושים כדי להפוך אבטיפוסים ניסיוניים למערכות אמינות. על פי מחקר שפורסם ב-arXiv, מסגרות אלה מתפקדות כ“מערכת הפעלה” עבור הסוכנים, ומצמצמות את שיעורי ההזיות על ידי הפיכת צ'אט לא מובנה לתהליכי עבודה מובנים.

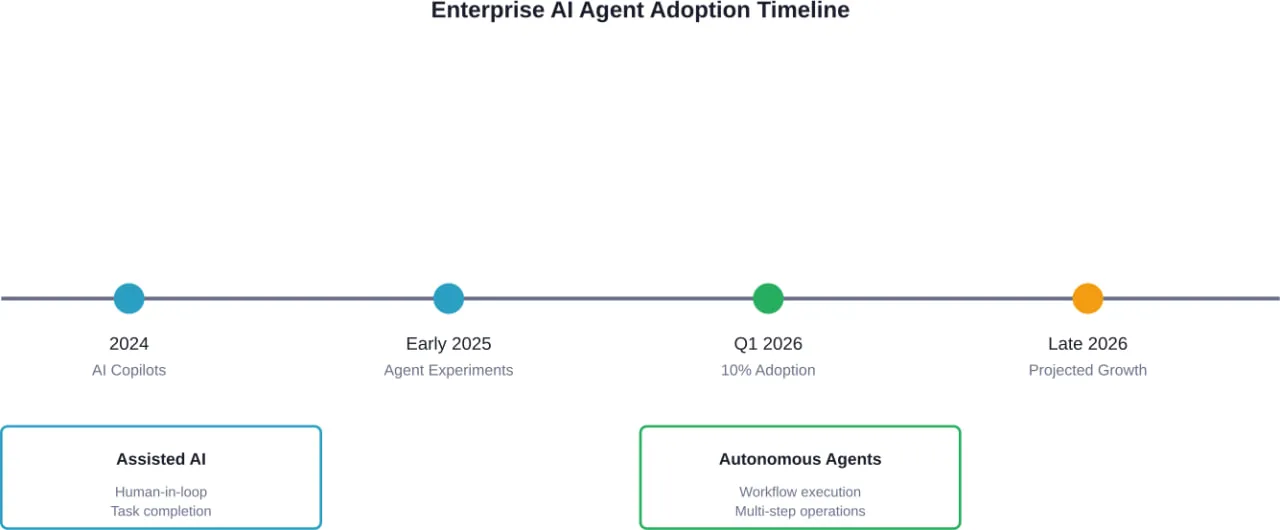

הנוף השתנה באופן דרמטי. מה שהתחיל בפרויקטים ניסיוניים כמו AutoGPT התפתח לפלטפורמות ברמה ארגונית התומכות בכל דבר, החל מאוטומציה של שירות לקוחות ועד למערכות מורכבות של שרשרת אספקה הכוללות מספר גורמים. וההבדלים בין המסגרות חשובים יותר ממה שרוב המפתחים מבינים בתחילה.

המדריך הזה חותך את כל ההייפ. בלי תוספות מיותרות, בלי מדדי ביצועים מומצאים — רק ניתוח מעשי המבוסס על מה שבאמת נכנס לשימוש בפועל.

מה מייחד את מסגרות הסוכנים המבוססות על בינה מלאכותית

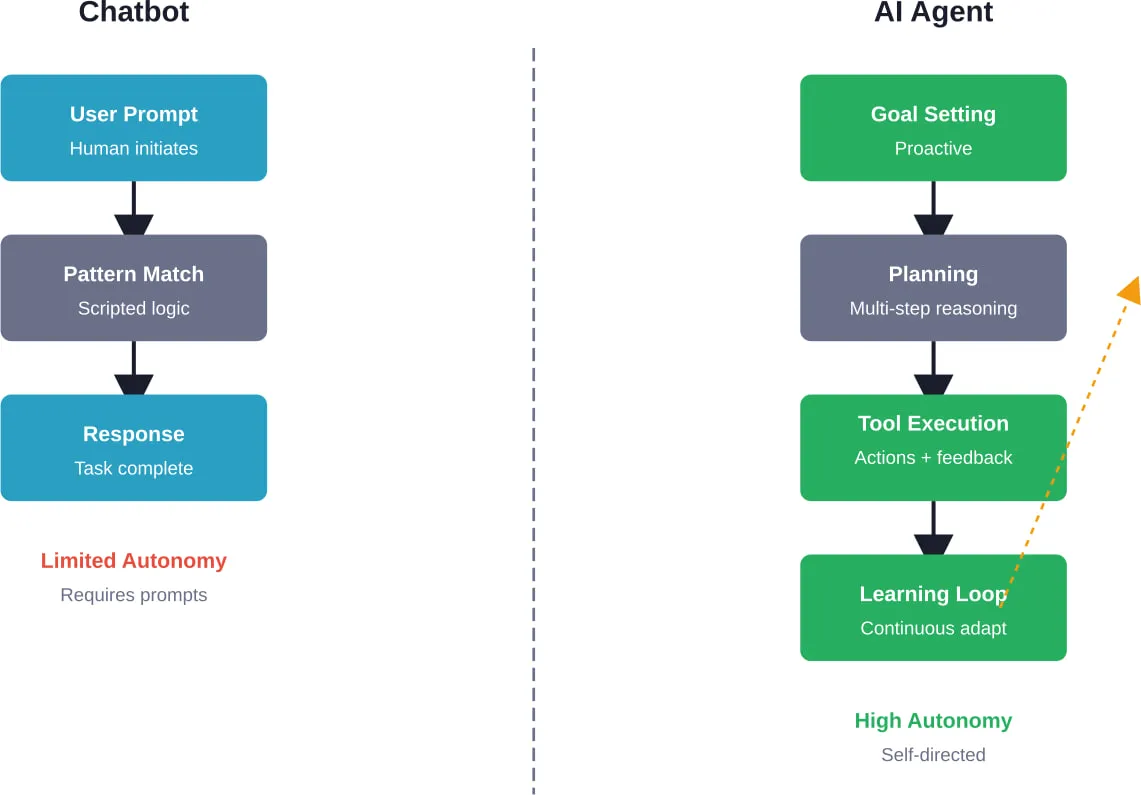

יישומים מסורתיים של LLM פועלים על פי דפוס פשוט: הקלט נכנס, התגובה יוצאת. הסוכנים שוברים את המודל הזה לחלוטין.

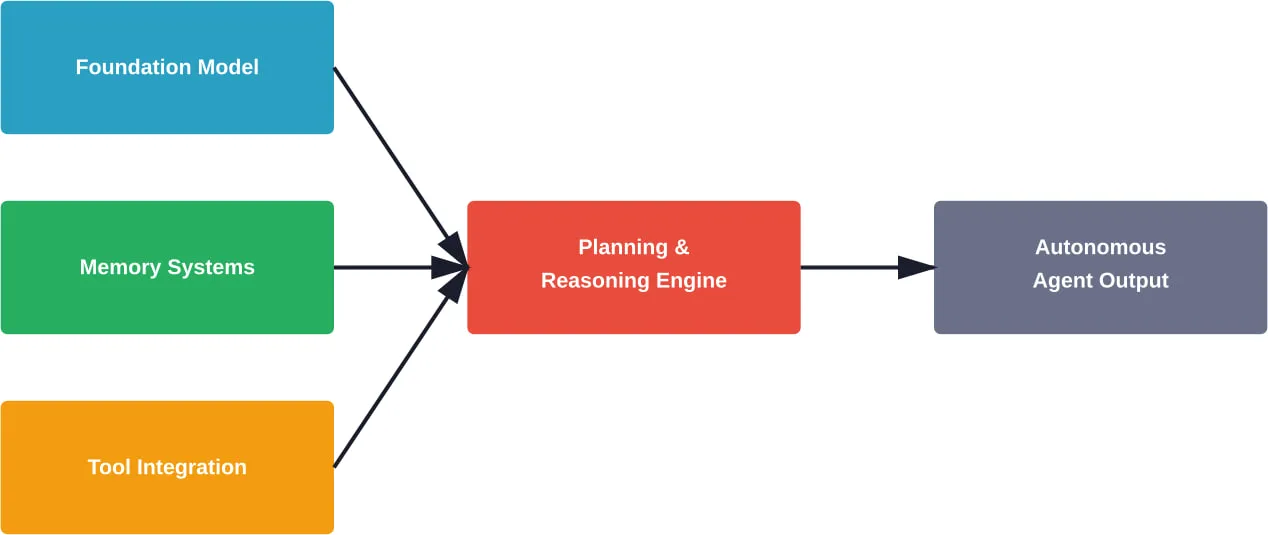

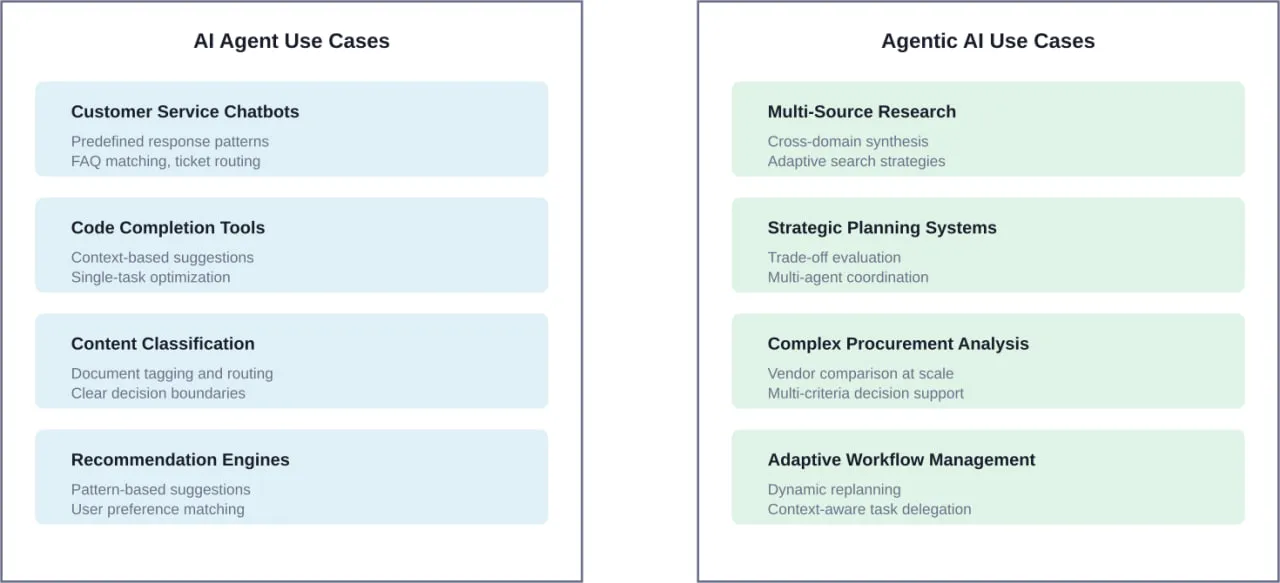

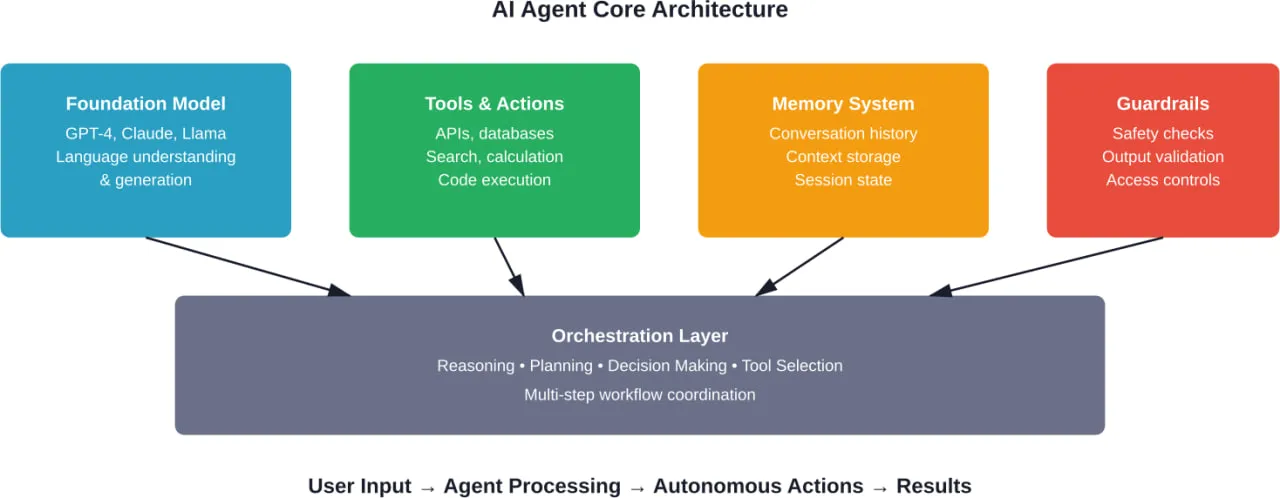

מסגרת סוכני בינה מלאכותית מספקת את התשתית למערכות המסוגלות לתפוס את סביבתן, לקבל החלטות באופן אוטונומי, להשתמש בכלים, לשמור על מצב לאורך אינטראקציות ולבצע תהליכי עבודה רב-שלביים. על פי מחקר שפורסם ב-arXiv, המבחין בין סוכני בינה מלאכותית (AI Agents) לבין בינה מלאכותית סוכנתית (Agentic AI), מסגרות אלה הן “מערכות מודולריות המונעות על ידי מודלים לשוניים גדולים (LLMs)”, אשר פילוסופיות התכנון שלהן שונות באופן מהותי מאלה של צ'אטבוטים פשוטים.

הרכיבים העיקריים כוללים בדרך כלל:

- מנועי תזמור המנהלים את מחזור החיים של הסוכנים ואת ביצוע המשימות

- מערכות זיכרון לשמירת מצב לטווח קצר ולטווח ארוך

- שכבות אינטגרציה של כלים המאפשרות לסוכנים לתקשר עם מערכות חיצוניות

- מעגלי חשיבה המאפשרים תכנון ותיקון עצמי

- פרוטוקולי תיאום בין סוכנים מרובים עבור תהליכי עבודה משותפים

אך לא כל המסגרות מיישמות רכיבים אלה באותו אופן. חלקן מעדיפות ניהול מצב מבוסס גרף, אחרות מתמקדות בזרימות שיחה, ויש המתמחות בתיאום בין סוכנים מרובים.

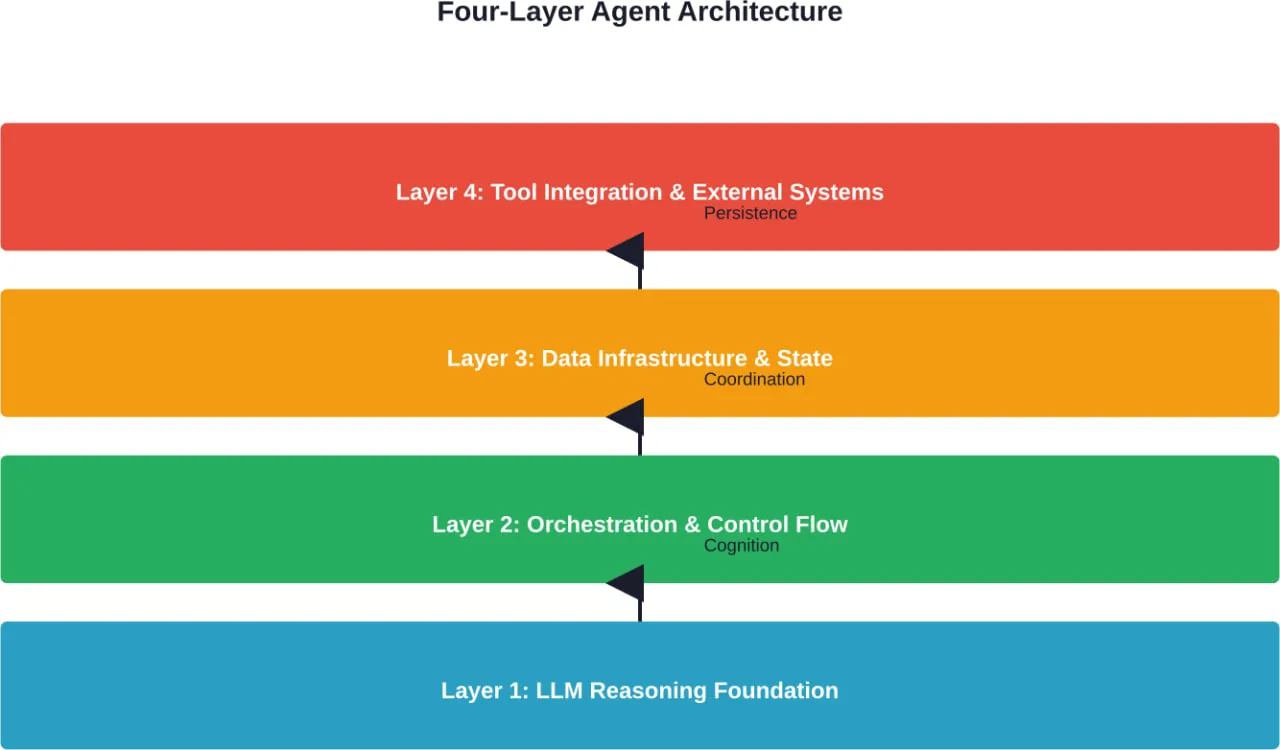

שאלת האדריכלות שמגדירה הכל

על פי סיווג אפשרויות הארכיטקטורה של arXiv עבור סוכנים המבוססים על מודלים בסיסיים, הבחירה הארכיטקטונית הבסיסית קובעת את כל השלבים הבאים. המסגרות מתחלקות בדרך כלל לשלוש קטגוריות:

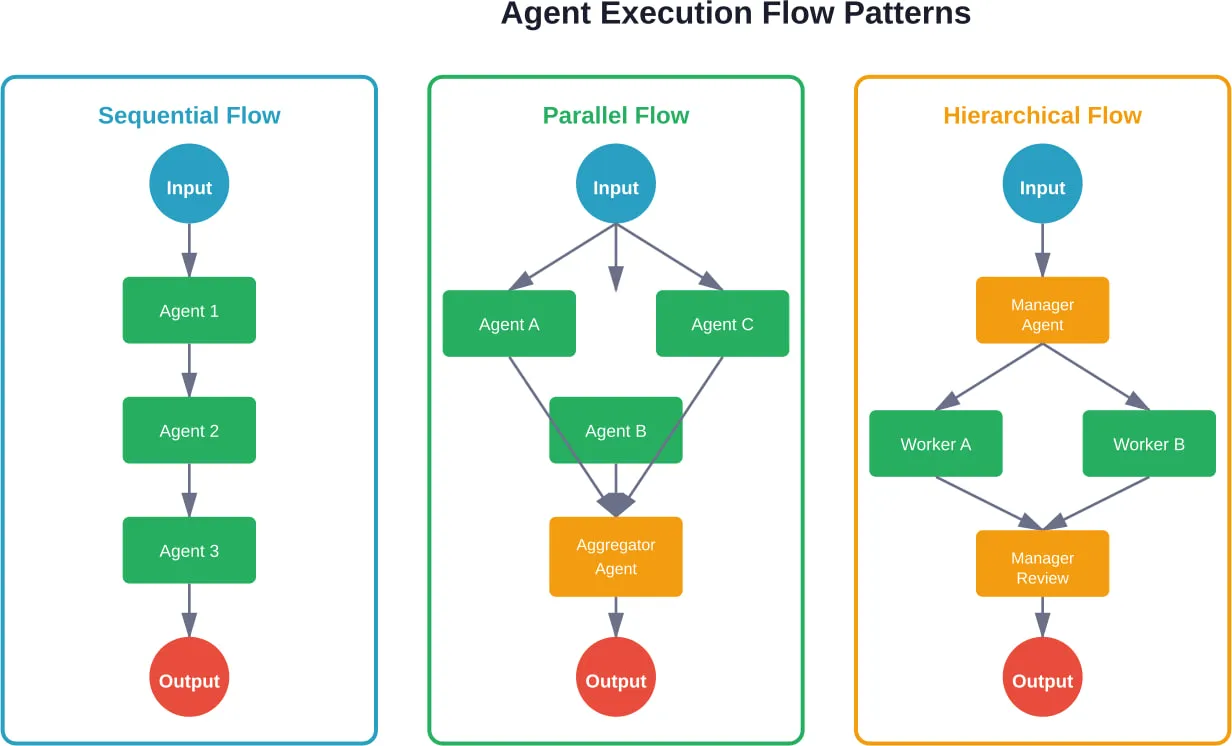

- מערכות מבוססות גרפים עם מצבים מתייחסות לביצוע פעולות הסוכנים כאל גרף מכוון, שבו הצמתים מייצגים מצבים או פעולות. גישה זו מתאימה במיוחד לתהליכי עבודה מורכבים הכוללים הסתעפות מותנית, ביצוע מקביל וניהול מצבים מפורש.

- מסגרות שיחה מציגות את הסוכנים כבוטים משופרים בעלי גישה לכלים. הן מתאימות במיוחד ליישומים הפונים ללקוחות, שבהם לדיאלוג טבעי יש חשיבות רבה יותר מאשר לתזמור מורכב.

- מערכות רב-סוכניות מחלקות משימות בין סוכנים מתמחים המקיימים ביניהם תקשורת ושיתוף פעולה. מחקרים מראים שדפוס זה יעיל במיוחד בסימולציה של מבנים ארגוניים — כמו ChatDev, המדמה חברת תוכנה שלמה שבה הסוכנים מארגנים את עצמם לתפקידי עיצוב, תכנות ובדיקה.

הבחירה בארכיטקטורה אינה רק עניין של העדפה טכנית. היא מגבילה באופן מהותי אילו סוגי יישומים יהיו קלים לבנייה ואילו יהיו קשים.

מסגרות ברמה תעשייתית שכדאי לשקול

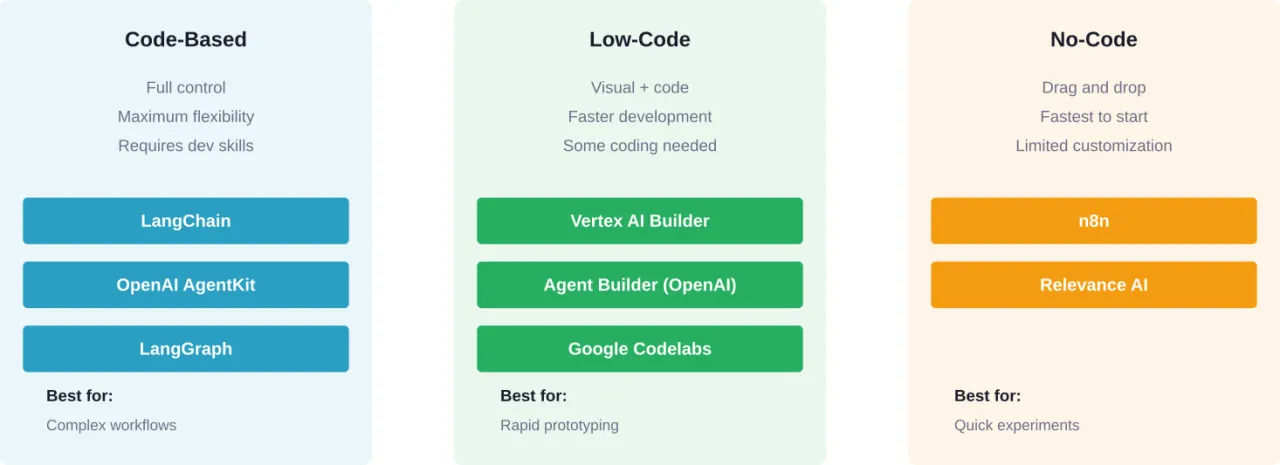

ישנן מסגרות סוכנים רבות. רובן לא עומדות בדרישות הסביבה התפעולית. להלן המסגרות שכן עומדות בדרישות, בהתבסס על ניסיון פריסה אמיתי שתועד ברחבי האקוסיסטם.

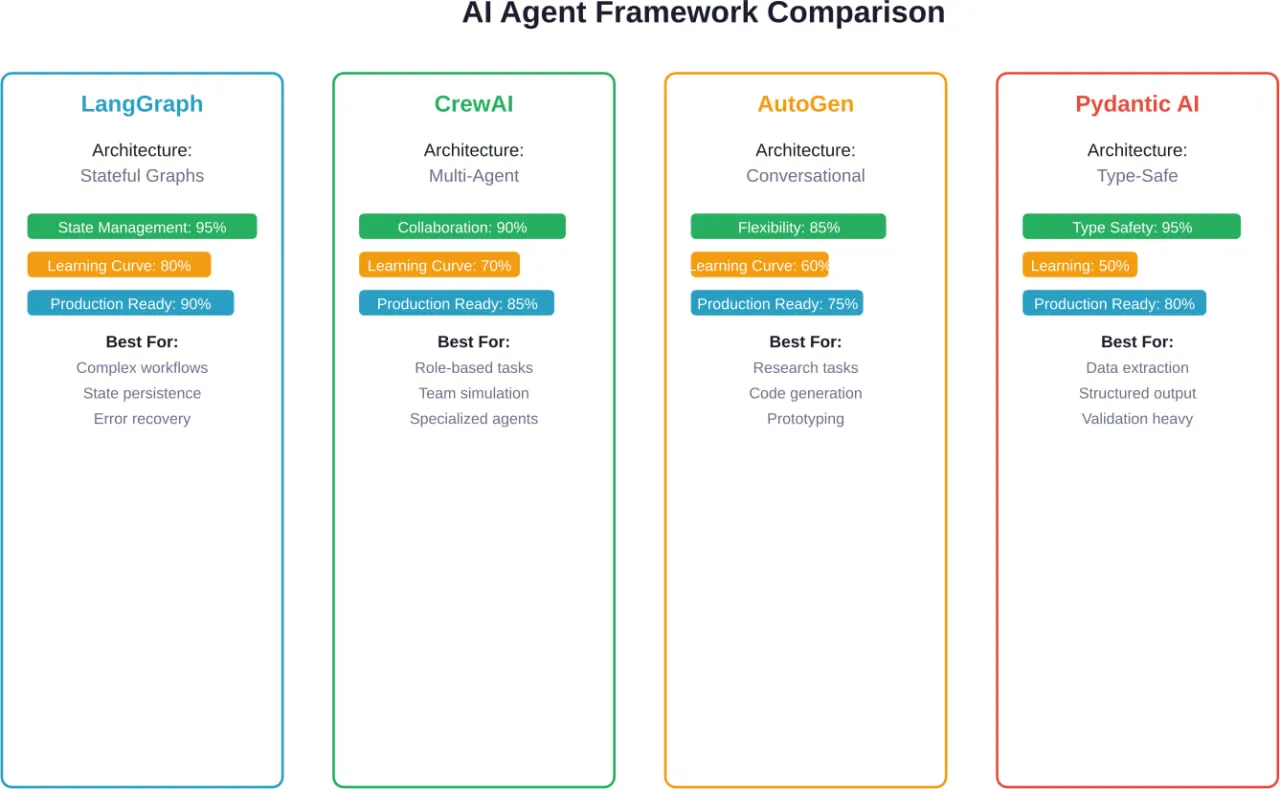

LangGraph: כאשר לניהול מצבים יש חשיבות

LangGraph מתמודדת עם תיאום סוכנים באמצעות גרפים בעלי מצב. כל צומת מייצג פונקציה, הקצוות מגדירים מעברים, והמצב זורם בגרף תוך שמירה מפורשת על המשכיות.

למסגרת יש 24.8 אלף כוכבים ב-GitHub והיא זוכה ל-34.5 מיליון הורדות בחודש — נתונים המשקפים אימוץ אמיתי בסביבות ייצור, ולא רק עניין ניסיוני. על פי ניתוח של אנשי מקצוע שהטמיעו מסגרות שונות, LangGraph נמצאת בשורה הראשונה של המערכות שמחזיקות מעמד בסביבות ייצור.

היכולות העיקריות כוללות:

- ניהול מצב מפורש עם מערכות אחסון קבועות הניתנות להגדרה

- תהליכי עבודה הכוללים מעורבות אנושית עם שלבי אישור

- תמיכה בארכיטקטורות של סוכן יחיד ושל סוכנים מרובים

- איתור באגים במסע בזמן באמצעות תמונות מצב

- תמיכה מובנית בסטרימינג לעדכונים בזמן אמת

מה המחיר? LangGraph דורש חשיבה ארכיטקטונית מעמיקה יותר מראש. על המפתחים למדל באופן מפורש את מעברי המצב, במקום להסתמך על זרימת שיחה מרומזת. עבור זרימות עבודה ארגוניות מורכבות, הכוללות לוגיקת הסתעפות ודרישות לשחזור לאחר שגיאה, המפורשות הזו הופכת ליתרון.

בואו נהיה כנים: LangGraph פועל במיטבו כאשר לתחום הבעיה יש מצבים ומעברים ברורים. תהליכי הסלמה בתמיכת לקוחות, תהליכי אישור רב-שלביים וצינורות מחקר עם הסתעפויות מותנות – כולם משתלבים באופן טבעי בפרדיגמת הגרפים שלו.

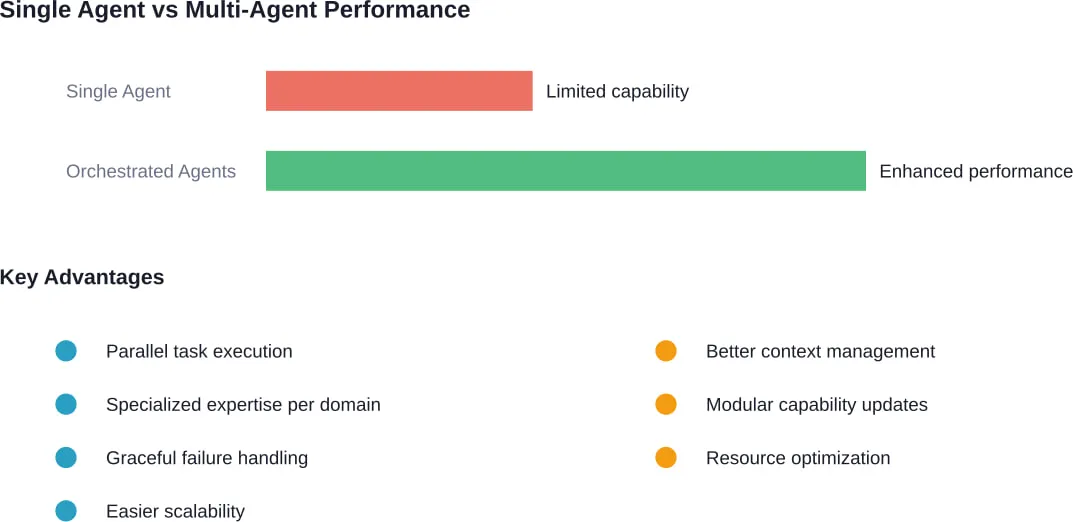

CrewAI: שיתוף פעולה בין סוכנים מרובים הופך למציאות

CrewAI מתמחה בתיאום בין סוכנים רבים הפועלים להשגת מטרות משותפות. המסגרת מציגה את הסוכנים כחברי צוות בעלי תפקידים, אחריות ודפוסי תקשורת מוגדרים.

הרעיון המרכזי מתמקד ב“צוותים” — קבוצות של סוכנים הפועלים בשיתוף פעולה לביצוע משימות. לכל סוכן יש תפקיד, מטרה, כלים העומדים לרשותו, וכן רקע אישי המשפיע על התנהגותו. המשימות מוקצות לסוכנים בהתאם ליכולותיהם, והמסגרת מטפלת בתקשורת בין הסוכנים.

גישה זו מתאימה במיוחד לבעיות שניתן לחלק באופן טבעי לתפקידים ייעודיים. בתהליכי עבודה של יצירת תוכן עשויים להיות סוכן מחקר, סוכן כתיבה וסוכן עריכה. ניתוח פיננסי עשוי לכלול סוכני איסוף נתונים, סוכני ניתוח וסוכני דיווח.

CrewAI תומכת במגוון דפוסי שיתוף פעולה:

- ביצוע רציף שבו הסוכנים פועלים בזה אחר זה

- מבנים היררכיים שבהם מנהלים מעבירים סמכויות למומחים

- מנגנוני קונצנזוס שבהם גורמים רבים מצביעים על החלטות

המסגרת מופיעה לעתים קרובות בדירוגי מסגרות הסוכנים המובילות לשנת 2026, במיוחד עבור מקרי שימוש המחייבים הפרדה בין תחומי התמחות. עם זאת, היא כרוכה בעומס תפעולי רב יותר מאשר מערכות בעלות סוכן יחיד — מה שהופך אותה למתאימה לתהליכי עבודה מורכבים, אך מוגזמת עבור אוטומציה פשוטה.

Microsoft Agent Framework: אינטגרציה ארגונית בראש סדר העדיפויות

מסגרת הסוכנים של מיקרוסופט נוקטת בגישה שונה, ומעניקה עדיפות לדרישות ארגוניות כגון אבטחה, תאימות ואינטגרציה עם מערכות מיקרוסופט קיימות.

על פי התיעוד הרשמי, Microsoft Agent Framework תומך בפיתוח סוכנים ובתהליכי עבודה מרובי-סוכנים הן ב-.NET והן ב-Python. הוא כולל שילוב מובנה עם Azure OpenAI, OpenAI, Anthropic ו-Ollama, וכן תמיכה מובנית בשרתים של Model Context Protocol (MCP).

התכונות העיקריות של הפתרון הארגוני כוללות:

| תכונה | תֵאוּר |

|---|

| סוכנים | סוכנים בודדים המשתמשים במודלים לשוניים גדולים (LLM) לעיבוד קלט, פנייה לכלים ולשרתי MCP, ויצירת תגובות |

| תהליכי עבודה | תיאום בין סוכנים מרובים עם תלות מוגדרת בין משימות |

| תמיכה ב-MCP | שילוב מובנה עם Model Context Protocol לצורך גישה אחידה לכלים |

| בִּטָחוֹן | אימות, הרשאה ורישום ביקורת ברמה ארגונית |

המסגרת מיועדת לארגונים שכבר משקיעים במערכת האקולוגית של מיקרוסופט. עבור צוותים המפעילים תשתית Azure ומשתמשים בשירותי ה-AI של מיקרוסופט, החיכוך הכרוך באינטגרציה פוחת באופן משמעותי. עבור כל השאר, החששות מפני תלות בספק מחייבים הערכה מדוקדקת.

AutoGen: המפגש בין מחקר לייצור

AutoGen, שמקורה ב-Microsoft Research, מתמקדת במערכות רב-סוכניות שיחתיות. המסגרת מאפשרת לסוכנים לנהל שיחות ביניהם כדי לפתור משימות בשיתוף פעולה.

המאפיין הבולט של AutoGen הוא הפרדיגמה השיחתית שלה. במקום למדל במפורש זרימות עבודה או מעברי מצב, מפתחים מגדירים סוכנים בעלי יכולות ומאפשרים להם לתאם את ביצוע המשימות באמצעות דיאלוג. גישה זו יעילה במיוחד בטיפול בבעיות פתוחות, שבהן נתיב הפתרון אינו קבוע מראש.

המסגרת תומכת ב:

- יצירת קוד וביצועו באופן אוטומטי

- שימוש בכלי באמצעות קריאה לפונקציות

- דפוסי אינטראקציה עם מעורבות אנושית

- דפוסי שיחה ותנאי סיום הניתנים להגדרה

לדברי מפתחים בעלי ניסיון בפיתוח באמצעות מספר מסגרות עבודה, AutoGen מתאימה היטב ליצירת אב טיפוס. הגישה השיחתית עלולה להקשות על איתור באגים בתהליכי עבודה מורכבים, כאשר הסוכנים מקבלים החלטות בלתי צפויות.

Pydantic AI: בטיחות טיפוסים בפיתוח סוכנים

Pydantic AI מביא את יכולות אבטחת הטיפוסים והאימות של Pydantic לתחום פיתוח הסוכנים. עבור צוותים שכבר משתמשים ב-Pydantic לאימות נתונים ביישומים ב-Python, מסגרת זו מספקת דפוסים מוכרים.

הערך המרכזי של הפתרון מתמקד בתפוקות מובנות. מפתחים מגדירים סכמות Pydantic המתארות את התגובות הצפויות של הסוכנים, והמסגרת מטפלת באימות ובכפיית טיפוסים. הדבר מצמצם את בעיית ההזיות על ידי אילוץ התפוקות להתאים למבנים הצפויים.

מתאים במיוחד ל:

- משימות חילוץ נתונים עם סכמות פלט מוגדרות

- תהליכי עבודה של סיווג וקיטלוג

- הפקת דוחות מובנים

- כל מקרה שבו לפורמט הפלט יש חשיבות זהה לזו של התוכן

מה המגבלה? Pydantic AI ממשיכה להתמקד בעיקר בתרחישים של סוכן יחיד עם תוצאות מובנות. תיאום מורכב בין מספר סוכנים או תהליכי עבודה הדורשים ניהול מצב מתוחכם מצריכים כלים נוספים.

Firecrawl: איסוף נתוני אינטרנט באמצעות סוכן

Firecrawl נוקט בגישה ייחודית, המתמקדת באופן ספציפי באיסוף נתונים מהאינטרנט באמצעות ממשק מבוסס סוכנים. במקום לבנות סוכנים לשימוש כללי, הוא מותאם במיוחד לדפוס הנפוץ של חיפוש, ניווט וחילוץ נתונים מובנים מאתרי אינטרנט.

על פי תיעוד הפרויקט, מפתחים מתארים את דרישותיהם בטקסט רגיל, יכולים להעביר סכימת Pydantic (אם רוצים), והסוכן מבצע חיפוש, מנווט ומחזיר תוצאות מובנות. Firecrawl מציעה מספר מודלים עם יחסי עלות-ביצועים שונים עבור פעולות חילוץ פשוטות לעומת מורכבות.

התמקדות ייעודית זו פירושה ש-Firecrawl מצטיינת בדבר אחד – איסוף נתונים מהאינטרנט – במקום לנסות לתמוך בכל תרחיש אפשרי של שימוש בסוכנים. עבור צוותים המפתחים סוכני מחקר, מערכות מודיעין תחרותי או כלי ניטור שוק, התמחות זו מספקת ערך משמעותי.

קריטריונים לבחירת מסגרת עבודה שבאמת חשובים

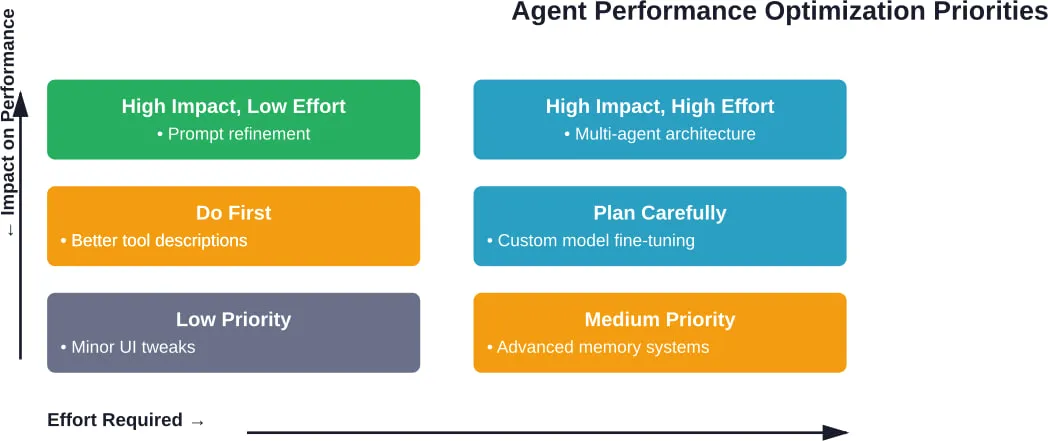

בחירת מסגרת סוכנים על סמך כוכבים ב-GitHub או מחזורי הייפ מובילה לכתיבה מחדש יקרה. המסגרות שעובדות בסביבת הפקה נבחרות על סמך קריטריונים אחרים.

התאמת הארכיטקטורה לתחום הבעיה

השאלה הראשונה אינה “איזו מסגרת היא הטובה ביותר?”, אלא “האם הארכיטקטורה של מסגרת זו תואמת את האופן שבו הבעיה מתפרקת באופן טבעי?”

בעיות הקשורות למעברי מצב ברורים, הסתעפות מותנית ודרישות לשחזור לאחר שגיאה מתאימות באופן טבעי למסגרות מבוססות גרפים כמו LangGraph. ניהול המצב המפורש תואם למבנה הבעיה.

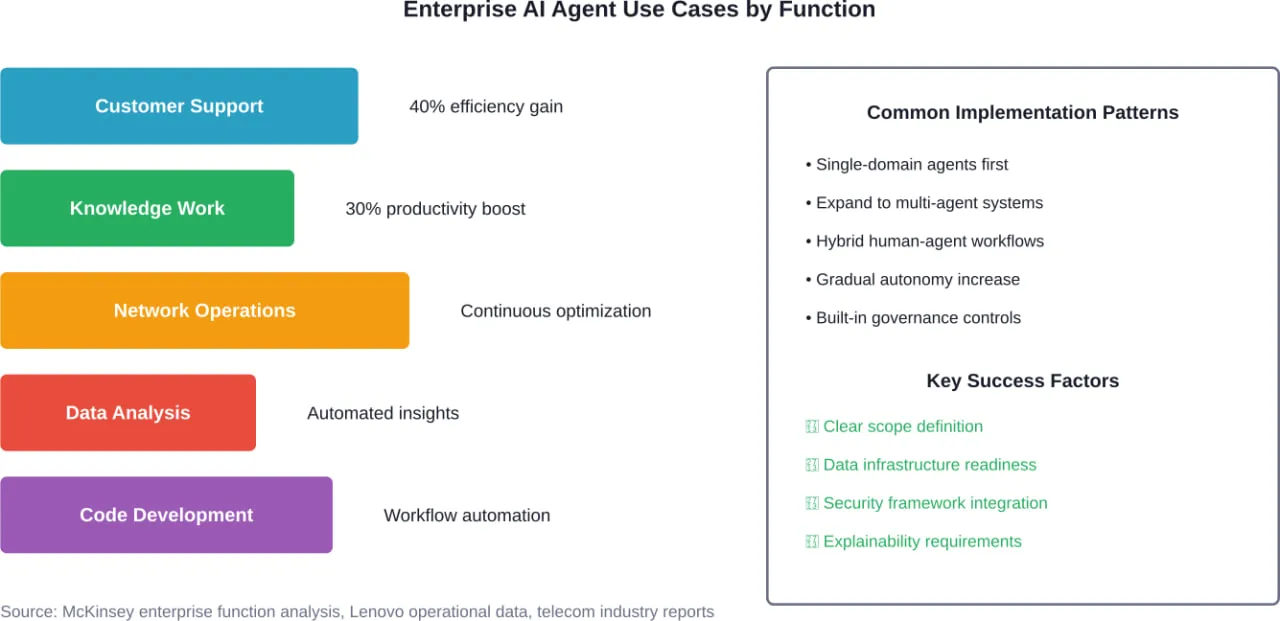

משימות הדורשות מומחיות מיוחדת בתחומים שונים — יצירת תוכן, ניתוח פיננסי, מחקר לקוחות — מתאימות היטב למסגרות רב-סוכניות כמו CrewAI. מודל הסוכנים המבוסס על תפקידים משקף את האופן שבו צוותים אנושיים מתמודדים עם בעיות אלה.

משימות מחקר פתוחות או תהליכי עבודה ליצירת קוד מתאימים לעתים קרובות יותר למסגרות שיחתיות כמו AutoGen. הדרך לפתרון מתבהרת באמצעות דיאלוג ולא באמצעות תהליכי עבודה קבועים מראש.

חילוץ נתונים ויצירת פלט מובנה תואמים למסגרות בעלות בטיחות טיפוסית, כגון Pydantic AI. הגישה של "סכימה תחילה" מצמצמת את תופעת ה"הזיות" במשימות שבהן לפורמט יש חשיבות.

על פי מחקר שפורסם ב-arXiv בנושא אפשרויות ארכיטקטורה עבור סוכנים המבוססים על מודלים בסיסיים, התאמה זו בין תחום הבעיה לפרדיגמת הארכיטקטורה מהווה את הגורם המשמעותי ביותר להצלחה בטווח הארוך.

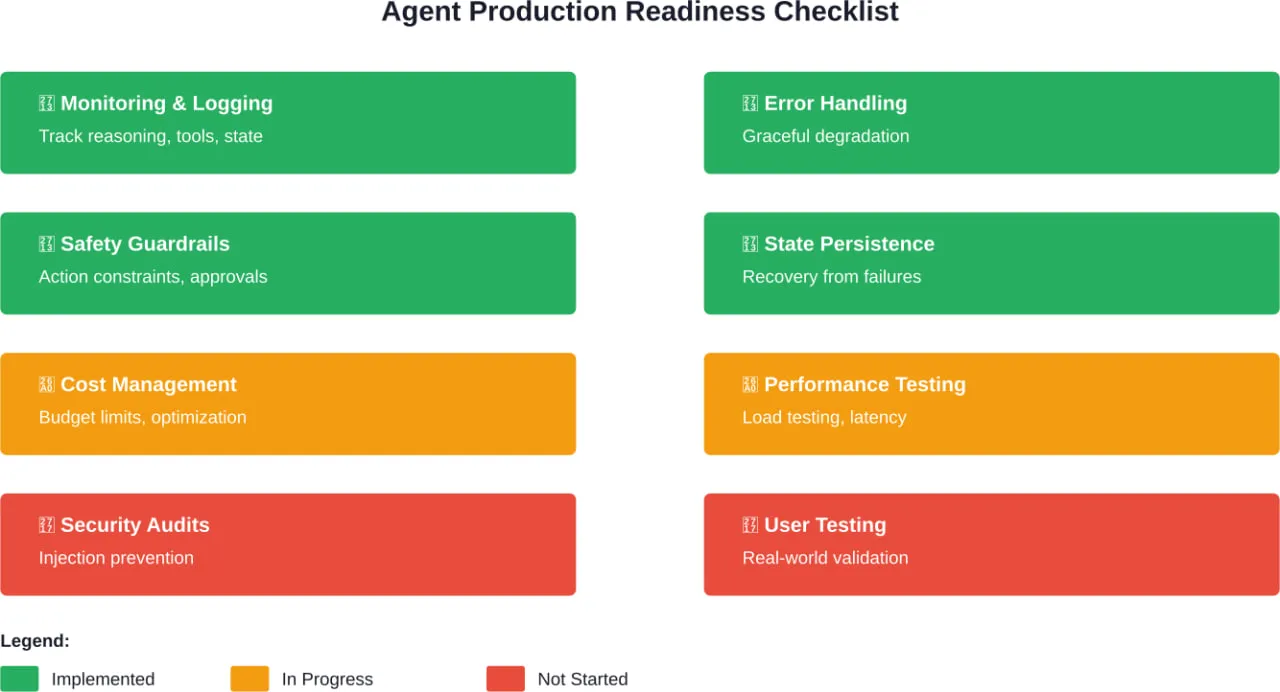

דרישות ייצור מעבר לפונקציונליות בסיסית

לאבות טיפוס ניסיוניים ולמערכות ייצור יש דרישות שונות בתכלית. מסגרות העבודה צריכות לתמוך ב:

- נראות: האם מפתחים יכולים לראות מה הסוכנים עושים, מדוע הם קיבלו החלטות מסוימות, והיכן מתרחשות תקלות? מערכות ייצור דורשות יכולות רישום, מעקב וניפוי באגים מפורטות.

- טיפול בשגיאות: כיצד המסגרת מתמודדת עם כשלים ב-API, הגבלות קצב, פקיעת זמן ותוצאות לא חוקיות של הכלים? יכולת התאוששות חזקה משגיאות היא זו שמבדילה בין צעצועים לכלים.

- שמירת מצב: האם מצב הסוכן נשמר גם לאחר הפעלה מחדש של התהליך? האם השיחות נשמרות בין הפעלות? מערכות ייצור זקוקות לניהול מצב עמיד.

- בקרת עלויות: האם המסגרת מספקת מנגנונים להגבלת השימוש באסימונים, להגבלת קריאות ה-API ולמניעת ביצוע בלתי נשלט? סוכנים בלתי מבוקרים עלולים להתייקר במהירות.

- גבולות אבטחה: כיצד המסגרת מטפלת באימות, בהרשאות ובסביבת בדיקה מבודדת? סוכנים בעלי גישה לכלים זקוקים לאמצעי אבטחה.

דרישות אלה אינן באות לידי ביטוי בהשוואות בין מסגרות המתמקדות בתכונות. אך הן הקובעות אם הסוכנים ישרדו בסביבת הייצור.

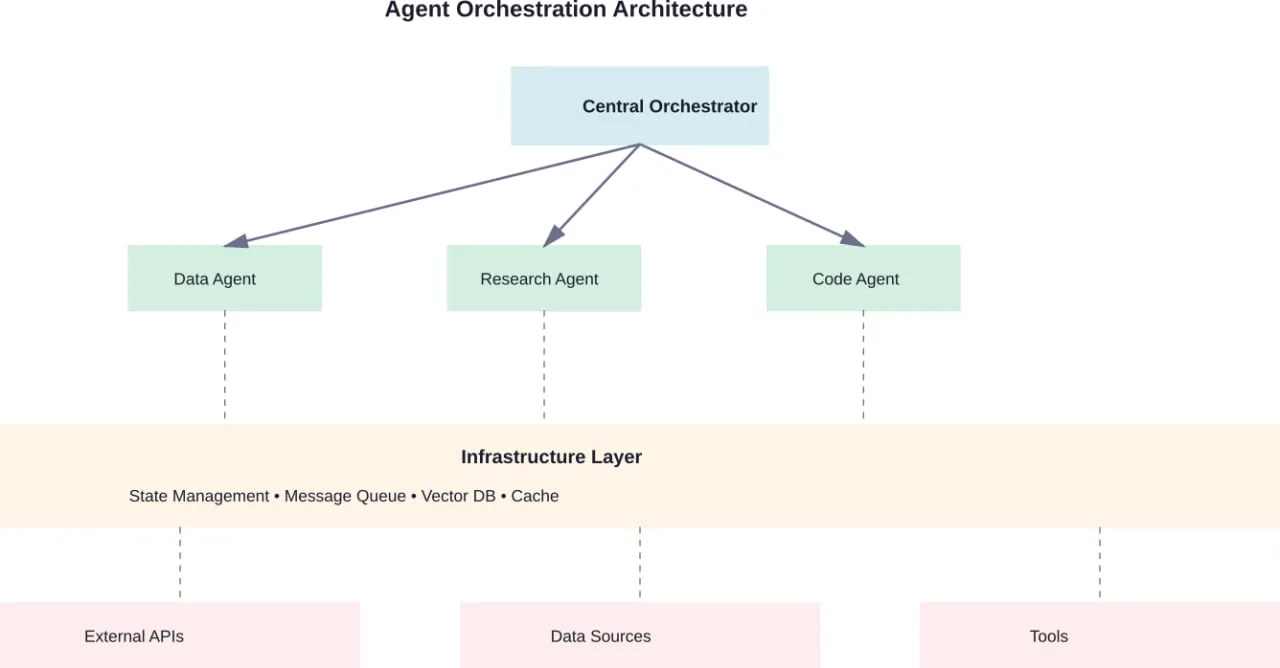

מערכת אקולוגית של אינטגרציה ותמיכה בכלים

סוכנים מפיקים ערך מגישתם לכלים. על המסגרת להשתלב עם הכלים והשירותים הספציפיים שהיישום דורש.

ישנן מסגרות שמציעות אינטגרציות מוכנות מראש בהיקף נרחב. אחרות מציעות מנגנונים גמישים להגדרת כלים, אך דורשות כתיבת קוד אינטגרציה מותאם אישית. האיזון בין נוחות לגמישות תלוי בשאלה האם האינטגרציות הדרושות כבר קיימות.

על פי מחקר שפורסם ב-arXiv בנושא מסגרות בינה מלאכותית סוכנתית, פרוטוקול Model Context Protocol (MCP) מתבלט כשכבת תקינה לגישה לכלים. מסגרות התומכות ב-MCP באופן מובנה זוכות לגישה לאקוסיסטמה הולכת וגדלה של כלים תואמים, ללא צורך בעבודת אינטגרציה מותאמת אישית.

מיומנויות צוות ועקומת למידה

מסגרות שונות דורשות מודלים מנטליים שונים. מערכות מבוססות גרפים מחייבות חשיבה על מכונות מצבים ומעברים. מערכות מרובות סוכנים מצריכות הבנה של פרוטוקולי תקשורת ודפוסי תיאום. מסגרות שיחתיות דורשות גישות שונות לאיתור באגים.

עקומת הלמידה חשובה פחות בפרויקטים חדשים מאשר בצוותים המטפלים במערכות קיימות. מעבר למסגרת אחרת באמצע הפרויקט הוא צעד שכמעט אף פעם אינו מוצדק, ללא קשר לאיזו מסגרת נראית עדיפה. עלות המעבר בדרך כלל עולה על התועלת.

עבור צוותים שכבר השקיעו במערכות אקולוגיות ספציפיות — Microsoft Azure, LangChain, אימות נתונים ב-Pydantic — מסגרות התואמות את הכישורים הקיימים מקלות משמעותית על העבודה.

מאמצי התקינה המשנים את פני הדברים

הריבוי של מסגרות סוכנים שאינן תואמות זו לזו יוצר בעיות של פיצול. המאמצים לקביעת תקנים נועדו לתת מענה לבעיה זו.

יוזמת תקני סוכני בינה מלאכותית של NIST

ב-17 בפברואר 2026 הכריז המכון הלאומי לתקנים וטכנולוגיה (NIST) על “יוזמת התקנים לסוכני בינה מלאכותית” (AI Agent Standards Initiative), שמטרתה להבטיח מערכות בינה מלאכותית סוכניות אמינות, תואמות ומאובטחות. על פי ההודעה הרשמית, היוזמה "תבטיח שהדור הבא של הבינה המלאכותית יאומץ בהיקף נרחב ובביטחון, יוכל לפעול בצורה מאובטחת מטעם המשתמשים, ויתפקד בצורה חלקה בכל רחבי המערכת האקולוגית הדיגיטלית".”

זוהי היוזמה הממשלתית המשמעותית הראשונה שנועדה לקבוע תקנים לארכיטקטורות סוכנים, לפרוטוקולי אבטחה ולמנגנוני תאימות. היוזמה נועדה לתת מענה לחששות בנוגע למערכות סוכנים הפועלות ללא מסגרות בטיחות עקביות או תקני תאימות.

תקני IEEE למדידת ביצועים של סוכנים

תקן IEEE P3777 קובע מסגרת אחידה לביצוע מבחני ביצועים של סוכני בינה מלאכותית, לרבות סוכנים אוטונומיים, שיתופיים וסוכנים המיועדים למשימות ספציפיות. הוא מגדיר מדדי ביצועים מרכזיים, פרוטוקולי הערכה ודרישות דיווח, כדי לאפשר הערכה שקופה, ניתנת לשחזור וניתנת להשוואה של יכולותיהם של הסוכנים.

בנפרד, תקן IEEE P3154.1 מספק הנחיות מומלצות למסגרת עבודה ליישום סוכני בינה מלאכותית (AI) בשירותי איתור כישרונות, ומתאר מסגרות ארכיטקטוניות ותחומי יישום הכוללים פרוטוקולים למנגנוני אינטראקציה ותקשורת.

מאמצים אלה לתקינה נמצאים עדיין בשלבי פיתוח פעילים. אך הם מעידים על הכרה מצד התעשייה בכך שהפיצול במבנים יוצר בעיות בהטמעת הפיתוח ובאימוץ הארגוני.

הבנת ארכיטקטורות סוכנים ותבניות תכנון

מעבר למסגרות ספציפיות, דפוסים אדריכליים חוזרים ונשנים מופיעים ביישומים מוצלחים של סוכנים. הבנת דפוסים אלה מסייעת בהערכת מסגרות ובעיצוב פתרונות מותאמים אישית.

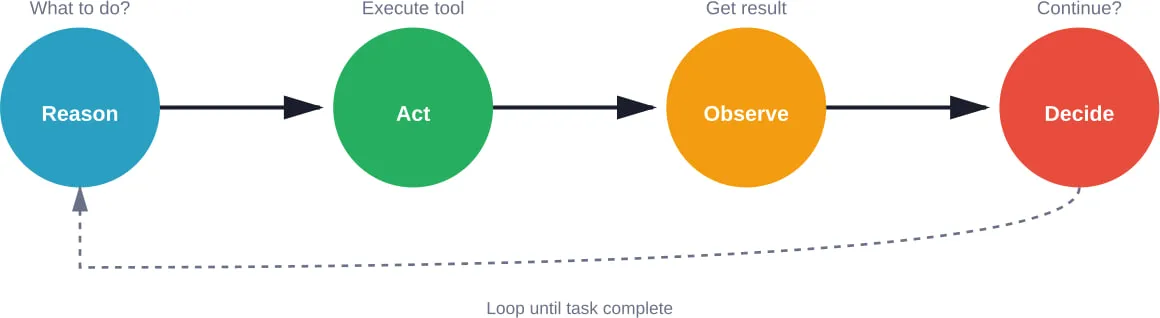

מעגל התפיסה-הקוגניציה-הפעולה

על פי מחקר שפורסם ב-arXiv, המבחין בין סוכני בינה מלאכותית (AI Agents) לבין בינה מלאכותית סוכנתית (Agentic AI), סוכנים פועלים באופן מהותי באמצעות מחזורי תפיסה-קוגניציה-פעולה. התפיסה כוללת איסוף מידע מהסביבה. הקוגניציה כוללת חשיבה, תכנון וקבלת החלטות. הפעולה מבצעת את ההחלטות באמצעות שימוש בכלים או תקשורת.

מסגרות שונות מיישמות את הלולאה הזו בדרכים שונות:

- מסגרות מבוססות גרפים מבטאות את הלולאה באופן מפורש באמצעות מעברי מצב

- מסגרות שיח משלבות את הלולאה בתורות הדיבור

- מערכות רב-סוכניות מחלקות את הלולאה בין סוכנים מתמחים

הבחירה באשר לאופן היישום משפיעה על יכולת האיתור והתיקון של באגים, על מאפייני הביצועים ועל דפוסי הכשל. לולאות מפורשות קלות יותר לאיתור באגים, אך דורשות תכנון מקדים רב יותר. לולאות מרומזות מצמצמות את כמות הקוד הסטנדרטי, אך מקשות על מעקב אחר זרימת הבקרה.

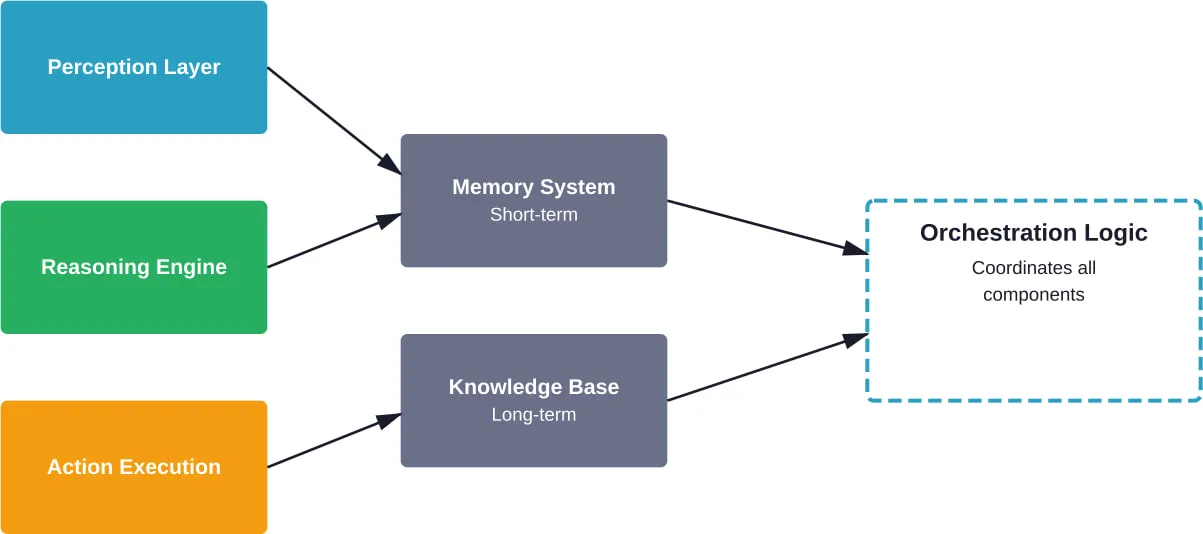

ארכיטקטורות זיכרון למצב הסוכן

סוכנים זקוקים לזיכרון כדי לשמור על הקשר בין אינטראקציות שונות. ארכיטקטורות זיכרון כוללות בדרך כלל:

- זיכרון עבודה: הקשר קצר הטווח של המשימה או השיחה הנוכחית

- זיכרון אפיזודי: תיעוד של אינטראקציות קודמות ותוצאותיהן

- זיכרון סמנטי: ידע כללי ועובדות שנלמדו

- זיכרון פרוצדורלי: כיצד לבצע משימות ולהשתמש בכלים

מסגרות הפקה צריכות לשמור על הזיכרון בין הפעלות ולטפל במגבלות הזיכרון בצורה חלקה. ככל שהשיחות מתארכות, על הנציגים לסכם את הדברים, לשכוח פרטים לא רלוונטיים או לשלוף הקשר היסטורי רלוונטי.

ישנן מסגרות שמציעות ניהול זיכרון מובנה. אחרות משאירות למפתחים את האחריות ליישום מנגנוני שמירה ואחזור.

שימוש בכלים ודפוסי קריאה לפונקציות

הגישה לכלים הופכת את הסוכנים מצ'אטבוטים למערכות שמבצעות פעולות. דפוסים נפוצים כוללים:

- קריאה ישירה לפונקציה: שפת ה-LLM מייצרת קריאות פונקציות מובנות עם פרמטרים, המסגרת מבצעת אותן, והתוצאות מוחזרות לסוכן. שיטה זו מתאימה היטב לכלים דטרמיניסטיים בעלי סכמות ברורות.

- תיאורי כלים בשפה טבעית: הכלים מציגים תיאורים בשפה טבעית של היכולות. הסוכן מחליט מתי וכיצד להשתמש בהם על סמך התיאורים, ולא על סמך סכמות נוקשות. גמיש יותר, אך פחות אמין.

- הפעלת כלי בשרשרת: סוכנים יכולים להשתמש בתוצאות של כלים כקלט לכלים הבאים בתור. מאפשר זרימות עבודה מורכבות כמו “חפש את X, קרא את התוצאה הראשונה, סכם אותה, ואז תרגם לצרפתית”.”

- הפעלת כלי במקביל: הפעל מספר כלים עצמאיים במקביל. מפחית את זמן ההשהיה במשימות הדורשות מידע ממקורות שונים.

מסגרות שונות תומכות בתבניות אלה ברמות שונות של תמיכה מובנית לעומת יישום מותאם אישית.

פרוטוקולי תקשורת בין סוכנים מרובים

כאשר מספר סוכנים פועלים בשיתוף פעולה, פרוטוקולי התקשורת הם הקובעים את היעילות והאמינות. על פי מחקר שפורסם ב-arXiv בנושא מסגרות בינה מלאכותית סוכנתית, הפרוטוקולים הנפוצים כוללים:

- העברת הודעות: הסוכנים מתקשרים באמצעות הודעות מפורשות בעלות מבנה מוגדר. שיטה זו מספקת תיעוד ביקורת ברור, אך מחייבת תכנון מראש של הפרוטוקול.

- מצב משותף: סוכנים קוראים וכותבים לזיכרון משותף או למסדי נתונים. קל ליישום, אך עלול ליצור מצבי תחרות וקונפליקטים.

- מונע אירועים: סוכנים מפרסמים אירועים ומנויים לאירועים של סוכנים אחרים. הדבר מפריד בין הסוכנים, אך מקשה על חיזוי ההתנהגות הכוללת.

- העברת סמכויות היררכית: סוכני הניהול מקצים משימות לסוכני העבודה ומרכזים את התוצאות. זרימת בקרה ברורה, אך נוצרים צווארי בקבוק בצמתים הניהוליים.

בחירת הפרוטוקול משפיעה על מורכבות האיתור והתיקון של תקלות, על יכולת ההתאוששות מתקלות ועל מאפייני המדרגיות. מערכות ייצור זקוקות לעתים קרובות למספר פרוטוקולים עבור דפוסי אינטראקציה שונים.

שיקולים ארגוניים ופריסה בסביבת ייצור

המעבר של סוכנים משלב האב-טיפוס לשלב הייצור כרוך באתגרים החורגים מעבר לבחירת המסגרת. פריסה ארגונית מחייבת התייחסות לסוגיות תפעוליות, אבטחה וניהול.

ניהול עלויות וכלכלת אסימונים

נציגי שירות בעלי גישה לכלים ויכולת חשיבה רב-שלבית צורכים כמות גדולה בהרבה של טוקנים בהשוואה לצ'אטבוטים פשוטים. נציג שירות לקוחות עשוי להשתמש ביותר מ-10,000 טוקנים לכל אינטראקציה בעת חיפוש במאגרי ידע, בדיקת סטטוס הזמנות והפקת תשובות.

מערכות ייצור זקוקות ל:

- תקציבים סמליים לכל אינטראקציה כדי למנוע חריגה מהתקציב

- אסטרטגיות אחסון במטמון עבור שאילתות חוזרות או תהליכי עבודה נפוצים

- לוגיקת בחירת מודלים המשתמשת במודלים זולים יותר למשימות פשוטות

- ניטור והתראה כאשר העלויות חורגות מהסף

ישנן מסגרות שמציעות בקרות עלויות מובנות. אחרות דורשות יישום מותאם אישית של אכיפת תקציב וניתוב מודלים.

גבולות אבטחה ובקרת גישה

סוכנים בעלי גישה לכלים פועלים בשם המשתמשים. כשלים באבטחה עלולים לחשוף מידע רגיש או לאפשר ביצוע פעולות בלתי מורשות.

דרישות האבטחה החיוניות כוללות:

- אימות לצורך אימות זהות הסוכן והסמכת המשתמש

- הרשאה להגביל את הגישה של נציגים לכלים מסוימים עבור משתמשים ספציפיים

- אימות קלט למניעת התקפות הזרקת שורת פקודה

- סינון פלט למניעת דליפת מידע רגיש

- תיעוד ביקורת של כל פעולות הסוכן והפעלת הכלים

- שימוש בסביבת בידוד (sandbox) כדי לבודד את פעולת הסוכן ממערכות קריטיות

על פי יוזמת תקני הסוכנים המונעים על ידי בינה מלאכותית של NIST, פרוטוקולי אבטחה סטנדרטיים עבור סוכנים נמצאים עדיין בפיתוח. המסגרות הקיימות מיישמות אבטחה ברמות מורכבות שונות.

נראות ואיתור באגים

כאשר סוכנים נכשלים, כדי להבין מדוע יש צורך ביכולת ניטור מפורטת. בניגוד לתוכנה מסורתית, שבה עקבות הערימה חושפות את הבעיות, כשלים של סוכנים כרוכים לעתים קרובות בבעיות סמנטיות — הסוכן פירש לא נכון את הכוונה, אסף מידע שגוי או בחר בכלים לא מתאימים.

ניטור התפעול מחייב:

- תיעוד מפורט של תהליכי החשיבה ונקודות ההחלטה של הסוכן

- מעקב אחר קריאות לפונקציות עם קלט, פלט וזמני השהיה

- יכולות השמעת הפעלה חוזרת לשם שחזור תקלות

- מדדים לגבי שיעורי הצלחה, זמני תגובה ועלות לכל אינטראקציה

- שילוב עם תשתית הניטור הקיימת

מסגרות שונות נבדלות זו מזו באופן משמעותי בתמיכתן בניתנות לניטור. חלקן מספקות כלים עשירים לאיתור באגים ושילוב עם פלטפורמות לניתנות לניטור. אחרות מותירות את הניתוב בידי המפתחים.

הערכה והבטחת איכות

בדיקות תוכנה מסורתיות אינן ניתנות ליישום ישיר על סוכנים. בדיקות יחידה דטרמיניסטיות אינן יכולות לאמת מערכות המשתמשות במודלים לשוניים גדולים (LLM) לצורך הסקת מסקנות.

על פי מחקר שנערך במסגרת AutoChain, תהליך ההערכה מחייב שימוש במסגרות בדיקה אוטומטיות הבוחנות את יכולות הסוכנים בתרחישי משתמש שונים. הדבר כרוך ב:

- בדיקות מבוססות תרחישים עם קלט משתמש מציאותי

- מודלים לשוניים גדולים (LLM) המשמשים להערכת איכות התפוקה

- בדיקות רגרסיה לאיתור ירידה בביצועים

- בדיקות A/B להשוואת תצורות סוכנים

- הערכה אנושית לצורך הערכת איכות סובייקטיבית

מעט מסגרות מציעות כלי הערכה מקיפים. ברוב מערכות הייצור נדרשים מערכי בדיקה מותאמים אישית.

מגמות מתהוות וכיוונים עתידיים

תחום מסגרות הסוכנים ממשיך להתפתח בקצב מהיר. מספר מגמות מעצבות את הכיוון שאליו צועדת המערכת האקולוגית.

אימוץ פרוטוקול Model Context

פרוטוקול Model Context Protocol (MCP) נועד לתקנן את האופן שבו סוכנים ניגשים לכלים ולמערכות חיצוניות. במקום שכל מסגרת תיישם שילוב כלים מותאם אישית, ה-MCP מספק פרוטוקול משותף.

מסגרות התומכות ב-MCP באופן מובנה זוכות לגישה לאקוסיסטם הולך וגדל של כלים תואמים, ללא צורך בעבודת אינטגרציה ספציפית למסגרת. הדבר מצמצם גורם מרכזי אחד לנעילת מסגרת — המעבר בין מסגרות הופך לקל יותר כאשר אינטגרציות הכלים מבוססות על פרוטוקולים ולא ספציפיות למסגרת.

מסגרות ייעודיות לתחומים אנכיים

מסגרות לשימוש כללי כמו LangGraph ו-CrewAI פועלות במגוון תחומים. עם זאת, מתחילות לצוץ מסגרות ייעודיות המכוונות לתחומים ספציפיים.

ההתמקדות של Firecrawl באיסוף נתוני אינטרנט משקפת מגמה זו. במקום לתמוך בכל תרחיש אפשרי של שימוש בסוכנים, היא מתמקדת בתחום אחד ומבצעת זאת היטב.

צפו להופעתן של מסגרות נוספות המיועדות לתחומים ספציפיים, כגון תמיכת לקוחות, ניתוח נתונים, יצירת תוכן ופיתוח תוכנה. מסגרות ייעודיות יכולות לבצע בחירות ארכיטקטוניות מכוונות, המשפרות את חוויית המפתחים בתחום היעד שלהן.

הערכה והשוואה טובות יותר

על פי יוזמת התקן IEEE P3777, התעשייה מכירה בצורך בביצוע השוואות ביצועים סטנדרטיות של סוכנים. גישות ההערכה הקיימות כיום נותרות אד-הוק וחסרות עקביות.

שיפור בשיטות ההערכה יאפשר:

- השוואה אובייקטיבית בין מסגרות

- זיהוי רגרסיה כאשר עדכוני המסגרת משפיעים על היכולות

- אופטימיזציה של ביצועים בהתבסס על מדדים מדידים

- אימות תאימות עבור ענפים המפוקחים

מסגרות המשלבות כלי הערכה סטנדרטיים צפויות לזכות באימוץ מהיר יותר בקרב ארגונים.

שילוב עם הנדסת תוכנה מסורתית

כיום, פיתוח סוכנים נתפס לעתים קרובות כנפרד מהנדסת תוכנה מסורתית. כלים שונים, גישות בדיקה שונות, דפוסי פריסה שונים.

המגמה היא לכיוון אינטגרציה. סוכנים משמשים כרכיבים בתוך מערכות גדולות יותר, ולא כיישומים עצמאיים. הדבר מצריך:

- מסגרות סוכנים המשתלבות בצינורות CI/CD קיימים

- מסגרות בדיקה התואמות למפעילים סטנדרטיים של בדיקות

- דפוסי פריסה המתאימים לפלטפורמות תזמור מכולות

- ניטור המשתלב עם מערכי הנראות הקיימים

מסגרות שמצמצמות את חוסר ההתאמה בין פיתוח סוכנים להנדסת תוכנה מסורתית יזכו לפופולריות בסביבות ארגוניות.

אסטרטגיית בחירת מסגרת מעשית

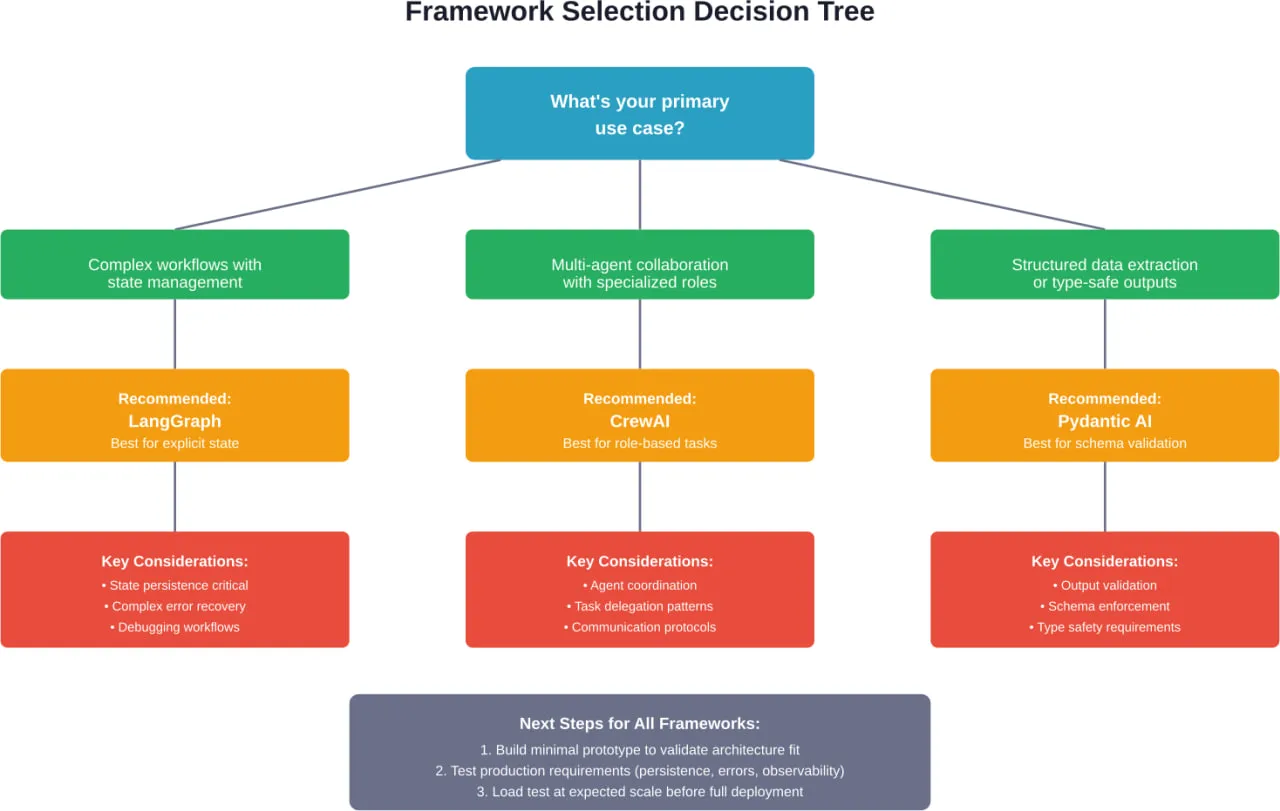

לאור המורכבות וההתפתחות המהירה, כיצד על צוותים לבחור מסגרות עבודה בפועל? להלן תהליך קבלת החלטות מעשי.

התחילו בניתוח ארכיטקטורת תרחישי השימוש

לפני שתערכו הערכה של מסגרות, התאימו את תרחיש השימוש לדפוסים ארכיטקטוניים:

- האם הבעיה כרוכה בניהול מצבים מורכב עם הסתעפויות מותנות? שקול שימוש במסגרות מבוססות גרפים.

- האם נדרשת שיתוף פעולה בין מספר סוכנים מתמחים? שקול שימוש במבני ריבוי סוכנים.

- האם מדובר בעיקר בשיח עם גישה לכלים? שקול שימוש במבני שיח.

- האם למבנה הפלט יש חשיבות זהה לזו של התוכן? קחו לדוגמה מסגרות עבודה בעלות בטיחות טיפוס.

- האם המטרה היא איסוף נתונים מהאינטרנט? שקול שימוש במסגרות ייעודיות.

דבר זה מצמצם את האפשרויות באופן משמעותי לפני שמבצעים הערכה של מסגרות ספציפיות.

אב טיפוס בעל מורכבות מינימלית

בנו את הגרסה הפשוטה ביותר האפשרית, שתבדוק את הנחת היסוד הארכיטקטונית. אל תוסיפו תכונות, אינטגרציות או ליטושים. רק ודאו שהארכיטקטורה של המסגרת מתאימה לבעיה.

במקרה של נציג שירות לקוחות, צרו אב טיפוס של האינטראקציה הפשוטה ביותר: שאלה של המשתמש, חיפוש במאגר הידע, יצירת תשובה. דלגו על אימות, רישום, טיפול בשגיאות ומקרים קיצוניים.

כך ניתן לבדוק אם המודל המנטלי של הפלטפורמה תואם את הבעיה, עוד לפני ההשקעה בפיתוח תכונות ייצור.

הערכת מוכנות הייצור

לאחר אימות התאמת הארכיטקטורה, יש לבחון את דרישות הייצור:

| דרישה | מדוע זה חשוב | כיצד לבצע הערכה |

|---|

| שמירת מצב | הסוכנים חייבים לשרוד את ההפעלה מחדש | חידוש הפעלת הבדיקה לאחר הפעלה מחדש של התהליך |

| שחזור לאחר תקלה | תקלות בכלים מתרחשות כל הזמן | הזן תקלות ופקעות זמן ב-API, ודא שהמערכת מטפלת בהן בצורה חלקה |

| נראות | איתור באגים מחייב נראות | לבדוק את יומני המערכת לאיתור אינטראקציות שנכשלו, ולהעריך את יכולת האיתור והתיקון של באגים |

| בקרת עלויות | שימוש מוגזם באסימונים עולה ביוקר | יש לוודא את יישום התקציב ואת מנגנוני האחסון במטמון |

| בִּטָחוֹן | סוכנים ניגשים למערכות רגישות | סקירת אימות, הרשאה וסביבת בדיקה מבודדת |

מסגרות שאינן עומדות במבחנים אלה יוצרות חוב טכני, שתיקונו בעתיד כרוך בעלות גבוהה.

יש לקחת בחשבון את תופעת ה"נעילת המערכת האקולוגית"

יש מסגרות שיוצרות תלות רבה יותר מאחרות. יש לבחון:

- האם המסגרת משתמשת בפרוטוקולים סטנדרטיים (MCP) או בשילובים מותאמים אישית?

- האם ניתן לחלץ את לוגיקת הסוכן ולהעביר אותה למסגרות אחרות?

- האם המסגרת קשורה לספקי LLM או לפלטפורמות ענן ספציפיים?

- האם המסגרת היא קוד פתוח עם קהילת מפתחים פעילה?

נעילה אינה בהכרח דבר שלילי, אם המסגרת מספקת ערך מספיק. אך ההחלטה צריכה להיות מודעת ולא מקרית.

בדיקה בקנה מידה הצפוי

מאפייני הביצועים משתנים באופן דרמטי ככל שהיקף הפעילות גדל. מסגרת סוכנים שמתפקדת היטב עם 10 בקשות בדקה עלולה להיכשל עם 100 בקשות.

בצעו בדיקת עומסים עם דפוסי תעבורה מציאותיים לפני שתעברו לפריסה בסביבת הייצור. מדדו:

- אחוזוני זמן ההשהיה (p50, p95, p99)

- מגבלות תפוקה ונקודות צוואר בקבוק

- שימוש בזיכרון ודרישות משאבים

- עלות לאינטראקציה בהיקף נרחב

- שיעורי השגיאות תחת עומס

בדיקות בקנה מידה גדול חושפות בעיות שאינן מתגלות בשלב הפיתוח.

מלכודות נפוצות וכיצד להימנע מהן

סוכני פיתוח בצוותים נוטים לעשות טעויות צפויות. זיהוי דפוסים אלה מסייע להימנע משינויים יקרים בקוד.

תכנון יתר ביישומים ראשוניים

הפיתוי לבנות מערכות רב-סוכניות מתוחכמות עם תזמור מורכב כבר מהיום הראשון מביא לכישלון הפרויקטים. התחילו בפשטות: סוכן יחיד, כלים בסיסיים וניהול מצב מינימלי.

יש להוסיף מורכבות רק כאשר גישות פשוטות יותר נכשלות. סוכן יחיד שתוכנן היטב משיג לעתים קרובות תוצאות טובות יותר משלושה סוכנים מתמחים שאינם מתואמים כראוי.

התעלמות מכלכלת האסימונים עד לשלב הייצור

סביבות פיתוח עם תקציבי API בלתי מוגבלים מסתירות את בעיות העלויות. סביבות ייצור עם תעבורה אמיתית חושפות אותן באופן כואב.

יש ליישם תקציבי אסימונים וניטור כבר מההתחלה. יש להציג את העלויות כבר במהלך הפיתוח, ולא רק לאחר הפריסה.

התייחסות לסוכנים כאל תוכנה מסורתית

דפוסי הבדיקה, איתור הבאגים והפריסה המסורתיים אינם ניתנים ליישום ישיר. צוותים המנסים לכפות על הסוכנים תהליכים קיימים יוצרים חיכוכים.

השקיעו בכלים ייעודיים לסוכנים לצורך הערכה, ניטור ופריסה. ההשקעה הראשונית תשתלם בזכות קיצור זמן איתור התקלות והאיץ את קצב האיטרציות.

בחירת מסגרות עבודה על סמך באזז

מספר הכוכבים ב-GitHub והאזכורים בניוזלטר אינם מנבאים הצלחה בסביבת הפקה. למסגרות שמחזיקות מעמד בסביבת הפקה יש מאפיינים שונים מאלה של מסגרות שזוכות להייפ.

יש לבצע הערכה על סמך התאמה אדריכלית ומוכנות לייצור, ולא על סמך מדדי פופולריות.

הערכת חסר של מורכבות איתור באגים

כאשר סוכנים נכשלים, לרוב הכשל נובע מאי-הבנה סמנטית ולא מבאגים בקוד. שיטות האיתור והתיקון המסורתיות אינן יעילות.

יש לתכנן השקעה משמעותית בכלים לניטור, רישום יומנים ויכולות השמעת הפעלה חוזרת. איתור באגים בסוכנים מצריך כלים שונים מאלה המשמשים לאיתור באגים בתוכנה מסורתית.

הפכו את מסגרת הסוכנים המונעת על ידי בינה מלאכותית שלכם למערכת פעילה

בחירת מסגרת העבודה היא החלק הקל. רוב האתגרים נובעים מהאינטגרציה – ממשקי API, זרימת נתונים, לוגיקת ה-backend, והבטחת פעולה אמינה של כל המערכת בסביבת הייצור.

A-listware מספקת צוותי פיתוח המטפלים בשכבה זו. החברה תומכת ב-backend, באינטגרציות ובתשתית סביב מערכות בינה מלאכותית, ומסייעת לצוותים לעבור ממסגרות נבחרות לפריסות יציבות. אם בחרתם במסגרת אך היא טרם יושמה, צרו קשר רשימת מוצרים א' כדי לתמוך בהטמעה ובהשקה.

שאלות נפוצות

- מה ההבדל בין מסגרת סוכני בינה מלאכותית (AI) לבין ממשק API רגיל של מודל שפה גדול (LLM)?

ממשקי ה-API של מודלים לשוניים גדולים (LLM) מספקים יכולות ליצירת טקסט — הטקסט הנכנס מוזן פנימה, והטקסט היוצא מופק. מסגרות סוכני בינה מלאכותית (AI) מוסיפות על גבי ה-LLM יכולות תיאום, ניהול מצב, שילוב כלים והסקת מסקנות רב-שלבית. הן מאפשרות לסוכנים לתפוס את הסביבה, לקבל החלטות, להשתמש בכלים ולבצע תהליכי עבודה באופן אוטונומי, ולא רק לייצר תגובות טקסטואליות.

- איזו מסגרת ליצירת סוכני בינה מלאכותית היא הטובה ביותר למתחילים?

Pydantic AI מציעה את עקומת הלמידה הקלה ביותר למפתחים שכבר מכירים את Python ו-Pydantic. היא מספקת בטיחות טיפוסים ותפוקות מובנות, מבלי לדרוש הבנה מעמיקה של דפוסי תזמור סוכנים. עבור צוותים שטרם התנסו בסוכנים וב-Python, מסגרות שיחה כמו AutoGen מציעות תהליך היכרות קל יותר מאשר מערכות מבוססות גרפים כמו LangGraph.

- האם אני זקוק למסגרת רב-סוכנתית, או שמספיק סוכן יחיד?

התחילו בארכיטקטורות של סוכן יחיד, אלא אם כן הבעיה דורשת בבירור מומחיות מיוחדת במספר תחומים. מערכות מרובות-סוכנים כרוכות בעומס תיאום, במורכבות באיתור באגים ובעלויות נוספות. הן מתאימות כאשר המשימות מתחלקות באופן טבעי לתפקידים נפרדים עם דרישות ידע שונות — כגון מחקר, ניתוח ודיווח — אך ברוב המקרים מספיק סוכן יחיד שתוכנן היטב.

- כיצד להתמודד עם החששות מפני תלות במסגרת?

יש לתת עדיפות למסגרות התומכות בפרוטוקולים סטנדרטיים, כגון Model Context Protocol (MCP), לצורך שילוב כלים. יש להפריד בין הלוגיקה העסקית לבין קוד התזמור הספציפי למסגרת. יש להשתמש בשכבות הפשטה לגישה לספקי LLM, כך שהחלפת ספקים לא תדרוש שינויים במסגרת. יש לבחון אם היתרונות של המסגרת מצדיקים את עלויות הנעילה לפני ההתחייבות — לעתים נעילה היא מקובלת אם המסגרת מספקת ערך מספיק.

- מהן העלויות האופייניות להפעלת סוכני בינה מלאכותית בסביבת ייצור?

העלויות משתנות באופן משמעותי בהתאם למורכבות הסוכן, לשימוש באסימונים לכל אינטראקציה, לנפח התעבורה ולבחירת המודל. סוכן תמיכת לקוחות פשוט עשוי להשתמש ב-5,000-15,000 אסימונים לכל שיחה. לפי מחירי GPT-4, מדובר ב-$0.15-$0.45 לכל אינטראקציה. סוכני מחקר מורכבים עם שימוש נרחב בכלים עשויים לחרוג מ-50,000 אסימונים לכל משימה. עלויות הייצור מצריכות ניטור קפדני, אסטרטגיות אחסון במטמון וניתוב מודלים כדי לייעל את האיזון בין עלות לאיכות.

- כיצד משפיעים תקני NIST על בחירת מסגרת הסוכנים של הבינה המלאכותית?

על פי "יוזמת התקנים לסוכני בינה מלאכותית" (AI Agent Standards Initiative) שהוכרזה בפברואר 2026, ה-NIST מפתח תקנים בנושאי אבטחת סוכנים, יכולת פעולה הדדית ואמינות. כל עוד תקנים אלה נמצאים בשלבי פיתוח, מסגרות התואמות את התקנים המתהווים בתחום פרוטוקולי אימות, רישום ביקורת ומנגנוני יכולת פעולה הדדית יזכו ככל הנראה לתהליכי אימוץ קלים יותר בארגונים. בענפים הכפופים לרגולציה, עמידת המסגרות בתקני ה-NIST העתידיים עשויה להפוך לדרישה מחייבת.

- האם ניתן להחליף מסגרת עבודה לאחר בניית סוכן ייצור?

מבחינה טכנית כן, אך עלויות המעבר הן משמעותיות. דפוסי תזמור ספציפיים למסגרת, גישות לניהול מצב ושילוב כלים אינם ניתנים להעברה ישירה. צפו לשכתב חלקים נרחבים מהלוגיקה של הסוכן במהלך המעבר. ההחלטה לעבור צריכה להתבסס על מגבלות טכניות ברורות המצדיקות את עלות המעבר, ולא על הבדלים קלים בתכונות או על הייפ סביב מסגרות חדשות יותר.

קביעת החלטת המסגרת

אין מסגרת אחת השולטת בכל תרחישי השימוש. LangGraph מצטיינת בתהליכי עבודה מורכבים הכוללים ניהול מצב מפורש. CrewAI מצטיינת בשיתוף פעולה בין סוכנים מרובים עם התמחות בתפקידים. Microsoft Agent Framework מותאמת לשילוב בארגונים. Pydantic AI מספקת בטיחות טיפוסית לתפוקות מובנות. מסגרות ייעודיות כמו Firecrawl מותאמות לתחומים ספציפיים.

הבחירה הנכונה תלויה בהתאמה הארכיטקטונית בין תחום הבעיה לפרדיגמת המסגרת, בדרישות הייצור בנוגע לשמירת מצב ושיקום שגיאות, בצרכי תמיכה במערכת האינטגרציה ובכלים, וכן בשיקולים הנוגעים לכישורי הצוות ולעקומת הלמידה.

על פי מחקר שפורסם ב-arXiv בנושא מסגרות בינה מלאכותית סוכנתית, התאמה ארכיטקטונית זו מהווה את גורם ההצלחה המשמעותי ביותר. מסגרות המתאימות לאופן שבו בעיות מתפרקות באופן טבעי מובילות ליישומים נקיים יותר, לאיתור באגים קל יותר ולמערכות שקל יותר לתחזק.

התחילו בפשטות. בדקו את התאמת הארכיטקטורה באמצעות אבטיפוסים מינימליים לפני שתפתחו תכונות ייצור. בצעו בדיקות בקנה מידה הצפוי לפני שתתחייבו לפריסה. השקיעו בכלים לניטור והערכה כבר מההתחלה.

תחום מסגרות הסוכנים ממשיך להתפתח. המאמצים לקביעת תקנים מצד NIST ו-IEEE מעידים על התבגרות הענף. אימוץ פרוטוקול Model Context Protocol מצמצם את התלות במסגרות מסוימות. מסגרות אנכיות ייעודיות צצות עבור תחומים ספציפיים.

אך העקרונות הבסיסיים נותרים קבועים: יש להבין את ארכיטקטורת הבעיה, לבחור מסגרות המתאימות לארכיטקטורה זו, ולבדוק את מוכנות המערכת לייצור לפני הפריסה. צוותים הפועלים לפי גישה זו משיקים סוכנים שמחזיקים מעמד בסביבת הייצור. אלה שרודפים אחרי מחזורי הטרנדים נאלצים בסופו של דבר לכתוב מחדש.

מוכנים לבנות את הסוכן הראשון שלכם בסביבת הפקה? התחילו עם המסגרת שמתאימה לארכיטקטורה הטבעית של הבעיה שלכם. בנו את הגרסה הפשוטה ביותר שתוכיח את היתכנות הרעיון. לאחר מכן, בצעו איטרציות על סמך הלקחים שתפיקו מסביבת ההפקה.