Die Echtzeit-Datenverarbeitung hat den Ruf, teuer zu sein, und manchmal ist dieser Ruf auch berechtigt. Aber bei den Kosten geht es nicht nur um schnellere Pipelines oder höhere Cloud-Rechnungen. Es geht um die laufende Arbeit, die erforderlich ist, um die Daten zuverlässig, korrekt und pünktlich weiterzuleiten.

Viele Teams budgetieren Infrastruktur und Tools und stellen dann später fest, dass Entwicklungszeit, Betriebskosten und Designentscheidungen die tatsächlichen Ausgaben bestimmen. Andere stürzen sich auf das Streaming, nur um dann festzustellen, dass nicht jeder Datenfluss tatsächlich in Echtzeit erfolgen muss.

In diesem Artikel wird ein praktischer Blick darauf geworfen, was Echtzeit-Datenverarbeitung wirklich kostet, warum Schätzungen oft am Ziel vorbeigehen und wie man die Ausgaben in einer Art und Weise betrachtet, die widerspiegelt, wie sich diese Systeme in der realen Welt und nicht nur auf Architekturdiagrammen verhalten.

Wie viel kostet die Datenverarbeitung in Echtzeit tatsächlich?

Für die meisten Teams ist die Datenverarbeitung in Echtzeit kein einzelnes Preisschild, sondern eine monatliche Spanne, die von Umfang, Dringlichkeit und Komplexität geprägt ist. Im Zeitraum 2025-2026 liegen die realistischen End-to-End-Kosten in der Regel in den folgenden Bereichen:

- Kleine, konzentrierte Aufbauten (1-2 kritische Streams, verwaltete Dienste): $3.000 bis $8.000 pro Monat

- Mittelgroße Produktionssysteme (mehrere Pipelines, SLAs, Bereitschaftsdienst): $10.000 bis $30.000 pro Monat

- Große oder geschäftskritische Plattformen (hohes Volumen, strenge Latenz, Governance): $40.000 bis $80.000+ pro Monat

Es kommt nicht auf die genaue Zahl an, sondern darauf, ob die Kosten in einem angemessenen Verhältnis zum Wert des Handelns in Echtzeit stehen. Wenn Geschwindigkeit Verluste verhindert, Risiken reduziert oder Einnahmen freisetzt, sind diese Zahlen oft sinnvoll. Wenn dies nicht der Fall ist, fühlen sich die gleichen Ausgaben schnell übertrieben an.

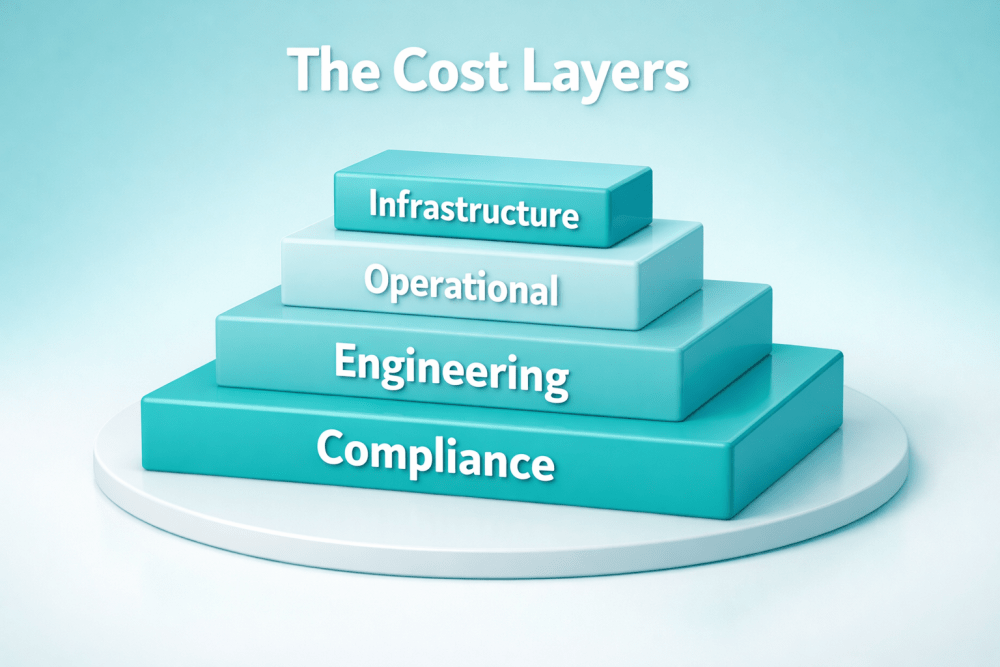

Die fünf Kostenschichten der Echtzeit-Datenverarbeitung (mit realen Preisspannen)

Ein nützlicher Weg, die Kosten der Echtzeit-Datenverarbeitung zu verstehen, besteht darin, sie in verschiedene Ebenen zu unterteilen. Die Infrastruktur ist die sichtbarste, aber sie ist selten der größte langfristige Treiber. Die tatsächlichen Ausgaben zeigen sich, wenn alle fünf Ebenen zusammen betrachtet werden.

Infrastrukturkosten

Die meisten Teams beginnen mit diesem Teil, da er leicht zu messen ist.

Zu den Infrastrukturkosten gehören Rechenleistung, Speicherplatz, Netzwerkverkehr und Datenübertragung. Bei selbstverwalteten Systemen bedeutet dies in der Regel virtuelle Maschinen, Festplatten, Load Balancer, Backups und Replikation. Bei verwalteten Plattformen werden die gleichen Kosten in nutzungsbasierten Einheiten, Durchsatzpreisen oder Abonnementstufen gebündelt.

Typische monatliche Spannen (grober Richtwert)

- Kleine Workloads (bis zu 100 GB pro Tag): $300 bis $1.500 pro Monat

- Mittelgroße Arbeitslasten (500 GB bis 1 TB pro Tag): $2.000 bis $8.000 pro Monat

- Große oder sporadische Arbeitslasten (mehrere TB pro Tag): $10.000 bis $40.000+ pro Monat

Der schwierige Teil ist die Dimensionierung. Echtzeitsysteme sind in der Regel für Spitzenwerte ausgelegt, nicht für Durchschnittswerte. Wenn sich der Datenverkehr für ein paar Stunden verdreifacht, muss das System trotzdem mithalten können. Teams, die für Worst-Case-Szenarien vorsorgen, zahlen die meiste Zeit für ungenutzte Kapazitäten. Teams, die nicht genügend Kapazitäten bereitstellen, zahlen später durch Ausfälle, Drosselung oder Notfallskalierung.

Verwaltete Plattformen verringern die Überversorgung, aber ein ineffizientes Pipeline-Design kann die Infrastrukturkosten dennoch schnell in die Höhe treiben.

Operative Kosten

Der Betrieb von Echtzeitsystemen ist keine passive Arbeit, selbst wenn die Plattform verwaltet wird.

Cluster brauchen Upgrades. Pipelines müssen überwacht werden. Alarme müssen abgestimmt werden. Skalierungsereignisse müssen beaufsichtigt werden. Jemand muss reagieren, wenn die Latenzzeiten in die Höhe schnellen oder die Verbraucher in Verzug geraten.

Zu den Betriebskosten gehören Beobachtungstools, Reaktion auf Zwischenfälle, Bereitschaftsdienste und die laufenden Bemühungen, die Systeme stabil zu halten.

Typische monatliche Spannen

- Leichtgewichtige Installationen mit verwalteten Plattformen: $1.000 bis $3.000

- Mittelgroße Produktionssysteme: $4.000 bis $12.000

- Geschäftskritische oder multiregionale Systeme: $15.000 bis $30.000+

In selbstverwalteten Umgebungen bedeutet dies oft mindestens einen dedizierten DevOps- oder Plattform-Ingenieur. In verwalteten Umgebungen wird die Verantwortung in der Regel auf mehrere Teams verteilt.

Ein häufiger Fehler ist die Annahme, dass verwaltete Plattformen die Betriebskosten vollständig beseitigen. Sie reduzieren sie, aber sie beseitigen sie nicht. Beobachtbarkeit, Zuverlässigkeit und Integrationsprobleme erfordern immer noch echte menschliche Zeit.

Technische Kosten

Dies ist der Punkt, an dem viele Haushalte schleichend in die Brüche gehen.

Echtzeit-Pipelines sind keine Systeme, die man einstellen und vergessen kann. Schemata entwickeln sich weiter. Erzeuger ändern ihr Verhalten. Verbraucher fügen neue Erwartungen hinzu. Verbindungen brechen ab. Grenzfälle treten nur bei echtem Verkehr auf.

Die Ingenieure verbringen viel Zeit mit dem Aufbau von Pipelines, deren Wartung, der Fehlersuche und der Leistungsoptimierung. Streaming-Fachwissen ist spezialisiert und teuer.

Typische monatliche Spanne (nur technische Zeit)

- Einfache Anwendungsfälle mit begrenztem Umfang: $3.000 bis $8.000

- Wachsende Systeme mit mehreren Pipelines: $10.000 bis $25.000

- Komplexe Plattformen mit vielen Kunden und SLAs: $30.000 bis $60.000+

In vielen Unternehmen unterstützt eine kleine Gruppe von Spezialisten am Ende Dutzende von Pipelines. Diese Konzentration von Wissen wird sowohl zu einem Lieferrisiko als auch zu einem langfristigen Kostentreiber. Selbst wenn die Infrastruktur billig ist, ist es die Entwicklungszeit selten.

Kosten für Governance und Compliance

Streaming-Daten enthalten oft sensible oder regulierte Informationen: personenbezogene Daten, Finanzereignisse, Betriebsprotokolle oder Telemetriedaten, die an Benutzer oder Geräte gebunden sind.

Die Sicherstellung einer ordnungsgemäßen Zugriffskontrolle, Verschlüsselung, Prüfung, Aufbewahrungsrichtlinien und Einhaltung von Vorschriften führt zu einem zusätzlichen Aufwand bei den Tools und Prozessen. Überprüfungen verlangsamen Änderungen. Sicherheitsvorfälle lösen Audits, Dokumentationsarbeit und Abhilfemaßnahmen aus.

Typische monatliche Spannen

- Grundlegende Sicherheits- und Zugangskontrollen: $500 bis $2.000

- Regulierte Umgebungen (Finanzwesen, Gesundheitswesen, SaaS für Unternehmen): $3.000 bis $10.000

- Stark regulierte oder geprüfte Systeme: $15,000+

Diese Kosten tauchen in den ersten Schätzungen selten auf, weil sie allmählich ansteigen. Sobald ein System jedoch geschäftskritisch wird, ist die Verwaltung nicht mehr optional. Sie wird zu einem Teil der konstanten Basiskosten.

Opportunitätskosten

Dies ist die am wenigsten sichtbare Schicht und oft auch die teuerste.

Wenn Echtzeit-Pipelines versagen, geraten Produkte ins Stocken. Wenn die Latenzzeit in die Höhe schießt, merken das die Benutzer. Wenn Ingenieure tagelang mit der Behebung von Streaming-Problemen beschäftigt sind, können sie keine Funktionen entwickeln oder Produkte verbessern.

Es gibt auch Opportunitätskosten beim Over-streaming. Teams, die alles in Echtzeit-Pipelines einspeisen, stellen später oft fest, dass viele dieser Daten nicht sofort verarbeitet werden mussten. Sie zahlen laufende Kosten für eine Geschwindigkeit, die keinen zusätzlichen Geschäftswert liefert.

Typische Auswirkungen

- Verpasste Einführungen oder verzögerte Funktionen im Wert von Zehntausenden pro Monat

- Ausfälle oder Datenqualitätsprobleme, die zu Umsatzverlusten oder Kundenabwanderung führen

- Ingenieurkapazitäten werden durch Wartung statt durch Innovation gebunden

Opportunitätskosten tauchen nicht auf Cloud-Rechnungen auf, aber sie zeigen sich in Roadmaps, Liefergeschwindigkeit und Wettbewerbsposition.

Wie wir Teams helfen, kosteneffiziente Echtzeit-Datensysteme aufzubauen

Unter A-listware, Wir arbeiten mit Teams zusammen, die Echtzeitdaten benötigen, ohne die Kontrolle über Kosten oder Komplexität zu verlieren. Wir haben aus erster Hand erfahren, wie sich Streaming-Systeme im Stillen zu etwas Schwerem entwickeln können, nicht weil die Technologie falsch ist, sondern weil die Einrichtung überstürzt oder überkonstruiert wurde. Unsere Aufgabe ist es, unseren Kunden bei der Entwicklung von Echtzeit-Pipelines zu helfen, die der tatsächlichen geschäftlichen Dringlichkeit entsprechen, nicht den abstrakten technischen Ambitionen.

Wir agieren als Erweiterung Ihres Teams und bringen erfahrene Ingenieure mit, die sich mit Streaming, Datenplattformen und Cloud-Infrastrukturen auskennen, aber auch wissen, wann Echtzeit nicht die richtige Antwort ist. Dieses Gleichgewicht ist wichtig. Wir helfen dabei, den Umfang frühzeitig zu definieren, Architekturen zu wählen, die vorhersehbar skalieren, und die üblichen Fallen zu vermeiden, die den technischen und betrieblichen Aufwand mit der Zeit in die Höhe treiben.

Da wir branchenübergreifend und systemübergreifend arbeiten, konzentrieren wir uns auf die praktische Umsetzung. Vom Aufbau und der Unterstützung von Echtzeit-Pipelines bis zur Integration in bestehende Plattformen bleiben wir nah an der Arbeit und den Ergebnissen. Das Ziel ist einfach: Systeme, die dann funktionieren, wenn sie gebraucht werden, die auch unter Druck zuverlässig bleiben und die sich bei ihrem Wachstum finanziell lohnen.

Echte Kostentreiber, die Teams häufig übersehen

Bei der Prüfung vieler Echtzeitsysteme zeigen sich immer wieder einige Muster.

Over-Streaming

Nicht jedes Ereignis muss sofort verarbeitet werden. Teams streamen oft alles, weil es ihnen zukunftssicher erscheint. Später stellen sie fest, dass nur eine kleine Teilmenge der Daten für zeitkritische Entscheidungen ausschlaggebend ist.

Das Filtern zu einem früheren Zeitpunkt in der Pipeline spart Rechen-, Speicher- und Betriebsaufwand.

Zurückhaltung ohne Zweck

Die monatelange Speicherung von Daten in einem Hot Storage ist teuer. Wenn auf ältere Daten nur selten zugegriffen wird, lassen sich durch die Verlagerung auf billigeren Speicher die Kosten senken, ohne dass der Wert der Daten verloren geht.

Die Vorratsdatenspeicherung sollte eine geschäftliche Entscheidung sein, keine Standardeinstellung.

Technische Belastung ignorieren

Streaming-Pipelines lassen sich nicht selbst warten. Jede neue Integration verursacht langfristige Wartungskosten. Die Entwicklung weniger, hochwertigerer Pipelines ist oft kostengünstiger als die Verwaltung vieler anfälliger Pipelines.

Behandlung der Kosten als statisch

Echtzeitsysteme entwickeln sich weiter. Neue Verbraucher tauchen auf. Das Datenvolumen wächst. Preismodelle ändern sich. Kostenvoranschläge müssen regelmäßig überprüft und nicht nur einmalig genehmigt werden.

Ein praktischer Weg zur Schätzung der Kosten für Echtzeitdaten

Beginnen Sie nicht mit Tools oder Anbietern, sondern mit Fragen, die die Datengeschwindigkeit direkt mit den Auswirkungen auf das Geschäft verbinden. Ziel ist es, zu verstehen, wo Echtzeit tatsächlich wichtig ist, bevor Zahlen zur Infrastruktur oder zu Plattformen genannt werden.

Verwenden Sie diese Checkliste als Ausgangspunkt:

- Welche Entscheidungen hängen wirklich von Echtzeitdaten ab? Ermitteln Sie Aktionen, die an Wert verlieren, wenn sie um Minuten oder Stunden verzögert werden, und nicht nur solche, die sich gut anfühlen, wenn sie live sind.

- Was ist der Preis für verspätetes Handeln? Schätzen Sie den finanziellen Verlust, das Risiko, die Auswirkungen auf die Benutzer oder die Betriebsunterbrechung, die durch verzögerte Einblicke entstehen.

- Wie viele Daten müssen wirklich sofort verarbeitet werden? Trennen Sie kritische Ereignisströme von Daten, die stapelweise verarbeitet werden können, ohne die Ergebnisse zu beeinträchtigen.

- Wie hoch sind das erwartete Datenvolumen und der Spitzendurchsatz? Modellieren Sie nicht nur die durchschnittliche Belastung, sondern auch realistische Spitzen, die das System bewältigen muss, ohne umzufallen.

- Wie lange müssen die Daten leicht zugänglich bleiben? Definieren Sie die Aufbewahrung im heißen, warmen und kalten Speicher auf der Grundlage der tatsächlichen Nutzung, nicht der Standardeinstellungen.

- Wie viel technischer und betrieblicher Aufwand ist dafür erforderlich? Dazu gehören Aufbauzeit, laufende Wartung, Bereitschaftsdienst, Überwachung und Reaktion auf Störungen.

Sobald diese Teile vorhanden sind, addieren Sie die Infrastruktur-, Technik- und Betriebskosten, um eine realistische Basis zu erhalten. Wenn sich diese Summe unangenehm anfühlt, ist das eine wertvolle Erkenntnis. Dies kann ein Hinweis auf einen kleineren anfänglichen Umfang, geringere Latenzanforderungen oder eine Architektur sein, die Echtzeit- und Stapelverarbeitung bewusster mischt.

Wann sich die Echtzeitverarbeitung lohnt

Datenverarbeitung in Echtzeit lohnt sich, wenn Verzögerungen einen messbaren Preis haben. Wenn ein Handeln Minuten oder sogar Sekunden später zu Umsatzeinbußen, höheren Risiken oder sichtbaren Auswirkungen auf die Benutzer führt, rechtfertigt das Streaming schnell seine Kosten. Das offensichtliche Beispiel ist die Betrugserkennung, aber es gilt auch für die Systemüberwachung, Betriebswarnungen, dynamische Preisgestaltung und personalisierte Benutzererfahrungen, die von dem abhängen, was in diesem Moment geschieht. In diesen Fällen reduzieren Echtzeitsysteme Verluste, verhindern Ausfälle oder erschließen Umsätze, die mit der Batch-Verarbeitung einfach nicht rechtzeitig erreicht werden können.

Die Gleichung ändert sich, wenn die Geschwindigkeit keinen wesentlichen Einfluss auf die Ergebnisse hat. Regelmäßige Berichte, Compliance-Workflows, historische Analysen und Metriken mit geringer Dringlichkeit profitieren selten von sekundengenauen Aktualisierungen. Das Streaming dieser Workloads erhöht oft die Komplexität und die laufenden Kosten, ohne einen zusätzlichen Nutzen zu bringen. Für diese Szenarien bleibt die Stapelverarbeitung einfacher, billiger und leichter zu warten. Die praktische Regel ist einfach: Wenn eine spätere Reaktion auf die Daten die Entscheidung nicht ändert, lohnt sich die Echtzeitverarbeitung in der Regel nicht.

Schlussfolgerung: Kosten als Design-Zwang, nicht als Überraschung

Die erfolgreichsten Teams betrachten die Kosten als Teil des Systementwurfs und nicht als ein später zu lösendes Rechnungsproblem.

Sie wählen die Latenzzeit absichtlich. Sie überwachen die Nutzung. Sie vereinfachen Pipelines. Sie überprüfen die Annahmen, wenn die Systeme wachsen.

Datenverarbeitung in Echtzeit ist nicht billig, aber sie ist selten so teuer wie schlecht geplante Echtzeitverarbeitung. Der Unterschied liegt darin, dass man versteht, woher die echten Zahlen kommen, und sie mit dem tatsächlichen Geschäftswert in Einklang bringt.

Letztendlich ist die Frage nicht, ob Echtzeitdaten teuer sind. Es geht darum, ob die Kosten in einem angemessenen Verhältnis zu den Vorteilen stehen, die sich aus dem schnelleren Handeln ergeben.

Häufig gestellte Fragen

- Ist die Echtzeit-Datenverarbeitung immer teurer als die Stapelverarbeitung?

Nicht immer, aber in der Regel kostet der Betrieb auf monatlicher Basis mehr. Der entscheidende Unterschied liegt darin, wo sich der Wert zeigt. Stapelverarbeitung ist billiger und einfacher für Arbeitslasten mit geringer Dringlichkeit. Echtzeitverarbeitung wird kosteneffektiv, wenn verspätetes Handeln zu Umsatzverlusten, höheren Risiken oder Betriebsstörungen führt. In diesen Fällen übersteigen die geschäftlichen Kosten einer Verzögerung oft die technischen Kosten des Streaming.

- Was ist der größte Kostentreiber bei Echtzeit-Datensystemen?

Für die meisten Teams überwiegt der technische und betriebliche Aufwand mit der Zeit die reinen Infrastrukturkosten. Cloud-Rechnungen sind sichtbar und vorhersehbar, aber die laufende Wartung, Fehlersuche, Überwachung und der Support auf Abruf prägen die langfristigen Ausgaben, insbesondere wenn die Anzahl der Pipelines wächst.

- Können verwaltete Streaming-Plattformen die Kosten erheblich senken?

Verwaltete Plattformen verringern in der Regel den betrieblichen Aufwand und machen die Kosten vorhersehbarer, aber sie beseitigen die Kosten nicht vollständig. Schlecht konzipierte Pipelines, übermäßige Speicherung oder Streaming von Daten mit geringem Wert können die Kosten immer noch in die Höhe treiben. Der größte Vorteil von Managed Services liegt in der Klarheit und dem geringeren Betriebsrisiko, nicht in den Nullkosten.

- Woher weiß ich, welche Daten tatsächlich in Echtzeit verarbeitet werden müssen?

Ein einfacher Test ist die Frage, ob eine spätere Reaktion auf die Daten die Entscheidung ändern würde. Wenn die Antwort nein lautet, ist die Echtzeitverarbeitung wahrscheinlich unnötig. Daten, die sich auf Betrugsprävention, Ausfälle, Kundeninteraktionen oder sich schnell bewegende Bestände beziehen, profitieren in der Regel von der Unmittelbarkeit. Regelmäßige Berichte und historische Analysen sind in der Regel nicht von Vorteil.

- Ist Micro-Batching eine billigere Alternative zum Echtzeit-Streaming?

Manchmal, aber es bringt oft eigene Kosten mit sich. Micro-Batching verringert den Druck auf die Infrastruktur im Vergleich zum kontinuierlichen Streaming, erhöht aber die Komplexität bei der Planung, der Statusverwaltung und der Fehlerbehandlung. In der Praxis kann es schwieriger zu betreiben sein als Batch und langsamer als echtes Streaming.