Kurze Zusammenfassung: Digital transformation for government involves modernizing IT infrastructure, digitizing services, and leveraging emerging technologies like AI and cloud computing to improve public service delivery. Federal initiatives like the OneGov Strategy and Technology Modernization Fund are driving this shift, while state and local governments are adopting mobile-first strategies, automation, and data-driven decision-making to meet rising citizen expectations for seamless digital experiences.

Government agencies face mounting pressure to deliver services that match the seamless digital experiences citizens get from private sector companies. But transforming legacy systems, navigating procurement complexities, and managing change across sprawling bureaucracies isn’t simple.

The public sector is finally catching up. Federal initiatives are pumping resources into IT modernization, while state and local governments are discovering that digital transformation isn’t just about technology—it’s about reimagining how government works.

Here’s what’s actually happening in government digital transformation right now.

What Digital Transformation for Government Actually Means

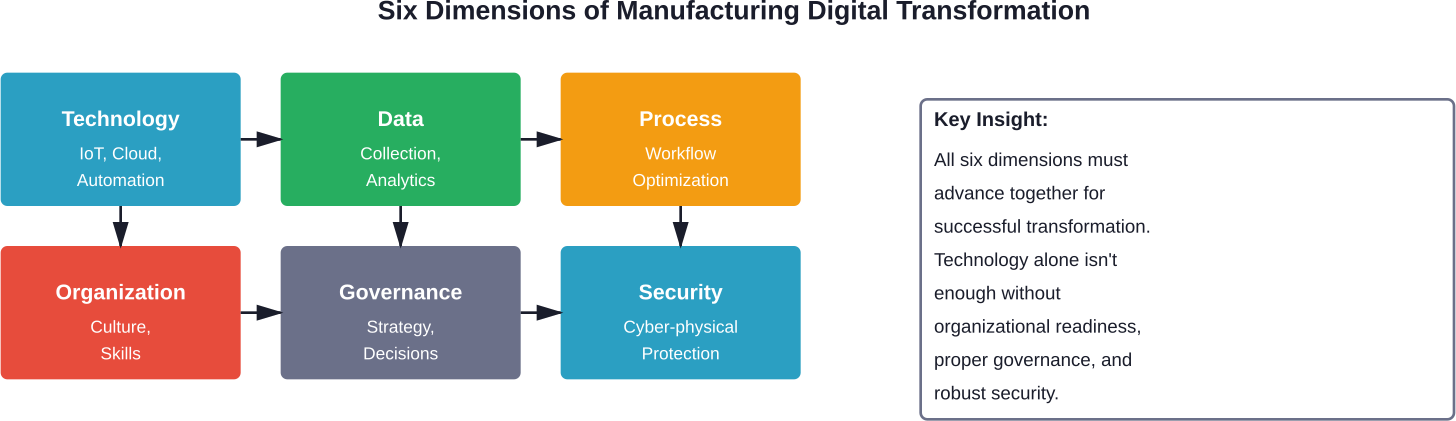

Digital transformation in government goes beyond slapping a website on an existing service. It’s a fundamental shift in how public sector organizations operate, deliver services, and engage with constituents.

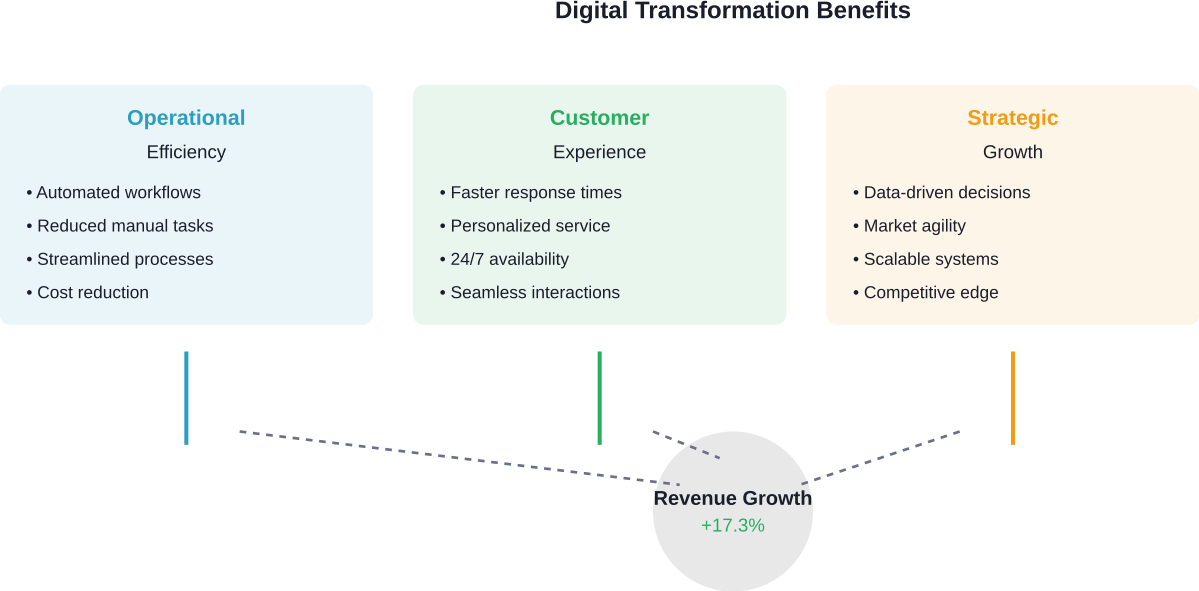

At its core, government digital transformation involves replacing outdated manual processes with digital workflows, migrating legacy systems to modern cloud infrastructure, and using data analytics to make smarter decisions. It touches everything from how employees collaborate internally to how citizens access vital services.

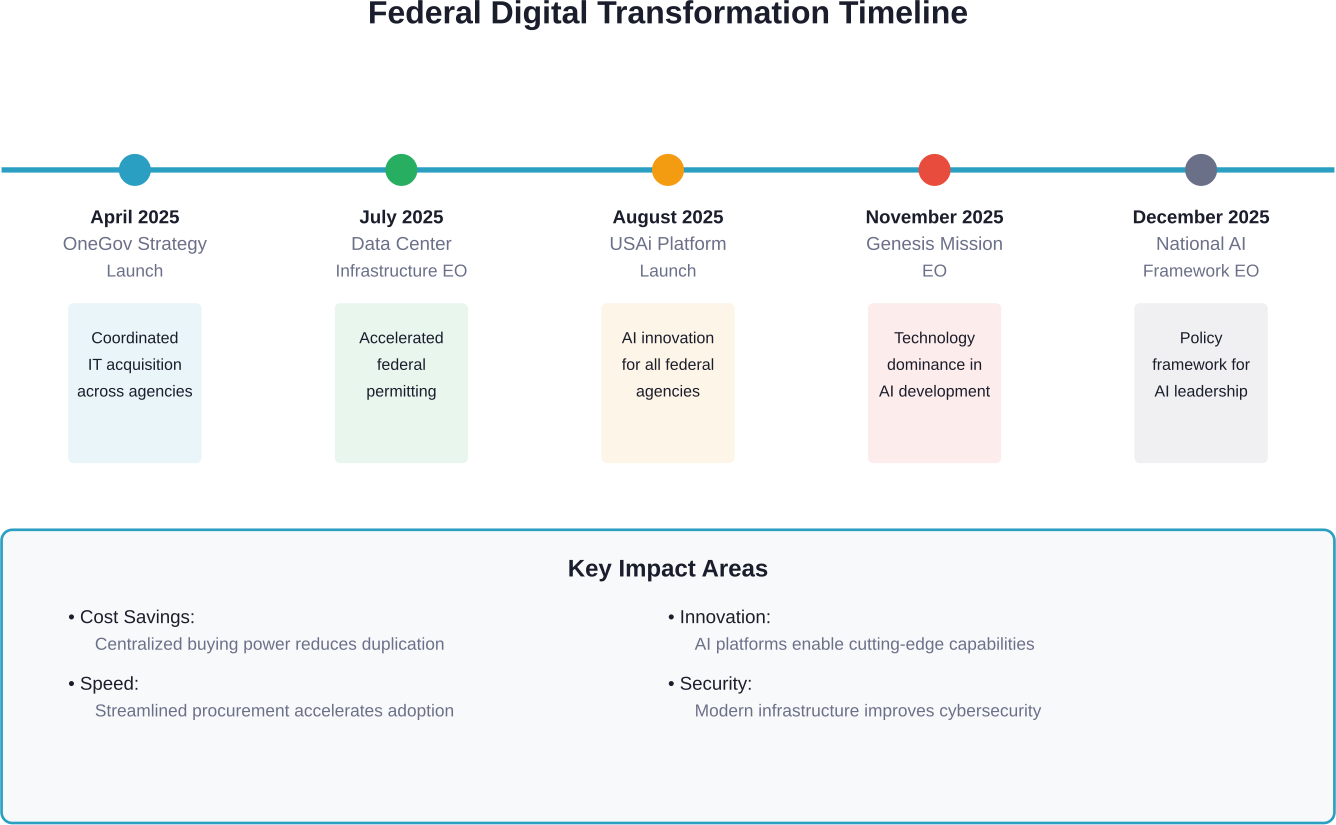

The goal? Reduce operational costs while improving service quality. According to the U.S. General Services Administration, their OneGov Strategy launched on April 30, 2025 represents a coordinated approach to federal IT buying, building on successes like the Governmentwide Microsoft Acquisition Strategy (GMAS) that delivered stronger terms and consistent pricing across agencies.

Real talk: this isn’t about flashy technology for its own sake. It’s about making government more efficient, transparent, and responsive to the people it serves.

Federal Initiatives Driving Government Digital Transformation

The federal government is pushing digital transformation through several strategic initiatives that set the tone for agencies nationwide.

The Technology Modernization Fund

The Technology Modernization Fund (TMF) represents a significant change in how the federal government funds IT projects. Instead of agencies struggling with outdated budget cycles that don’t match technology timelines, the TMF Board provides capital for modernization initiatives that demonstrate clear return on investment.

This paradigm shift lets agencies tackle critical infrastructure upgrades without waiting years for traditional appropriations.

OneGov Strategy for IT Acquisition

Launched on April 30, 2025, the OneGov Strategy takes a governmentwide approach to acquiring and managing IT resources. The strategy streamlines cloud acquisition and centralizes engagement with major technology vendors.

The IT Vendor Management Office (ITVMO) negotiates universal contract improvements that ensure agencies get better terms without duplicating procurement efforts across departments. This coordinated buying power saves taxpayer money while accelerating technology adoption.

USAi Platform and AI Integration

On August 14, 2025, GSA launched USAi to advance the White House “America’s AI Action Plan.” The platform delivers mission-ready AI innovation to every federal agency, positioning the United States to maintain leadership in artificial intelligence development.

According to White House Executive Orders from December 2025, U.S. leadership in AI will promote national and economic security across multiple domains. The administration is pursuing policies that remove barriers to American AI development while ensuring government agencies can leverage these capabilities.

Data Center and Cloud Infrastructure

In partnership with the Office of Management and Budget, GSA’s IT Modernization Division provides resources helping agencies identify best practices for managing cloud operations and modernizing IT infrastructure. This includes guidance on leveraging colocation data centers through new organizational structures.

A July 2025 Executive Order accelerated federal permitting of data center infrastructure, recognizing that physical infrastructure underpins digital transformation goals.

Key Trends Shaping Government Digital Transformation

Several trends are defining how government agencies approach digital transformation in 2026. These aren’t abstract concepts—they’re practical strategies with measurable impact.

Mobile-First Service Design

Citizens expect to access government services on their smartphones just like they do everything else. Mobile-first design means building services that work seamlessly on small screens from the start, not as an afterthought.

This shift changes how forms are structured, how authentication works, and how agencies think about user experience. Services that require citizens to print forms or visit offices during business hours are becoming relics of the past.

Automation of Manual Processes

Repetitive manual tasks drain government resources and create bottlenecks. Automation frees employees to focus on complex work that requires human judgment.

Robotic process automation (RPA) handles routine data entry, document processing, and workflow routing. Some agencies report identifying over $308,000 in annual savings by shifting citizen requests from phone calls to online channels—and those savings grow as adoption increases.

Datengestützte Entscheidungsfindung

Government agencies collect massive amounts of data, but historically struggled to extract actionable insights. Modern analytics platforms change that equation.

Real-time dashboards let administrators spot trends, allocate resources efficiently, and measure program effectiveness. Open data initiatives increase transparency while letting researchers and civic technologists build innovative applications on government data foundations.

Cloud Migration and Hybrid Infrastructure

Legacy on-premises infrastructure creates maintenance headaches and limits agility. Cloud computing offers scalability, security, and cost predictability that traditional data centers can’t match.

GSA analysis shows that medium-sized agencies can achieve 42% cost avoidance by implementing Software-Defined Wide Area Networking (SD-WAN). The shift to cloud also enables remote work capabilities that became critical during recent public health challenges.

Künstliche Intelligenz und maschinelles Lernen

AI applications in government range from chatbots handling routine constituent questions to predictive analytics identifying fraud patterns in benefits programs. The November 2025 Genesis Mission Executive Order emphasized that scientific discovery and technological innovation drive American progress, positioning AI as critical to global technology dominance.

But wait. Agencies must balance innovation with responsible AI governance, ensuring algorithms don’t perpetuate bias or undermine privacy protections.

Unified Citizen Experience Platforms

Citizens don’t think in terms of organizational charts. They want a single portal where they can access services regardless of which agency provides them.

Unified platforms break down silos, letting citizens authenticate once and access multiple services. This approach mirrors successful private sector models where companies create seamless customer journeys across touchpoints.

| Trend | Hauptnutzen | Implementation Challenge | Zeitleiste |

|---|---|---|---|

| Mobile-First Design | Improved accessibility for citizens | Redesigning legacy forms and workflows | 6-12 Monate |

| Prozessautomatisierung | Cost reduction and efficiency gains | Identifying high-value automation targets | 3-9 months per process |

| Cloud-Migration | Scalability and reduced maintenance | Security compliance and data sovereignty | 12-24 Monate |

| KI-Integration | Enhanced decision-making capabilities | Governance frameworks and bias prevention | 9-18 months |

| Unified Platforms | Seamless citizen experience | Cross-agency coordination | 18-36 months |

Modernize Government Digital Services

Governments around the world are transforming public services through technology. From digital portals to automated workflows, modern platforms help improve efficiency and accessibility for citizens.

- Build scalable digital government platforms

- Improve public service accessibility through web and mobile solutions

- Implement secure data management and automation systems

Partner mit A-listware to develop reliable technology solutions that support modern government services.

Building a Government Digital Transformation Strategy

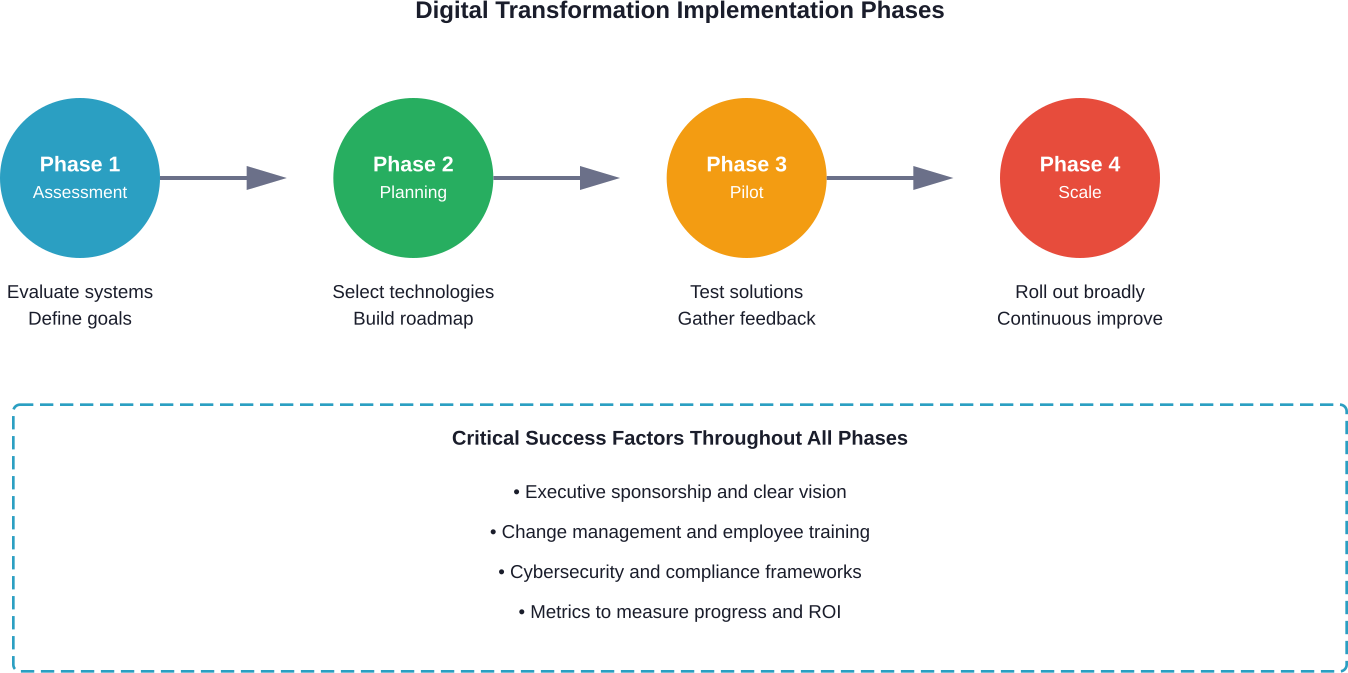

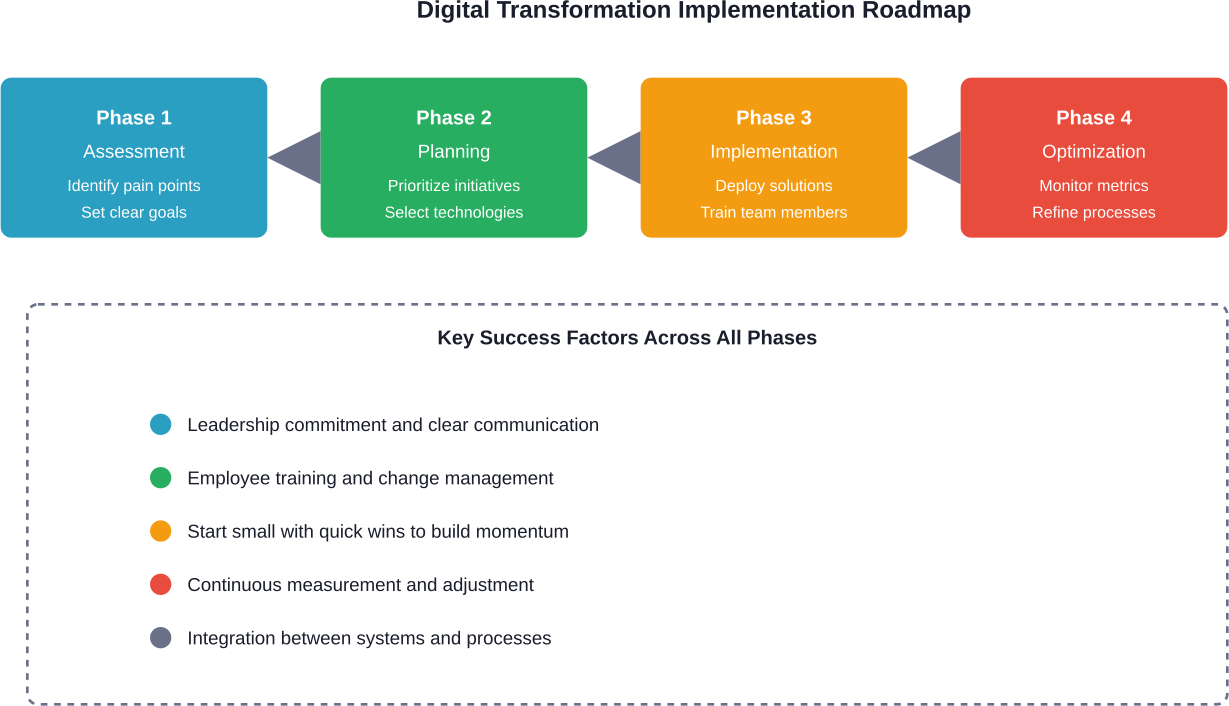

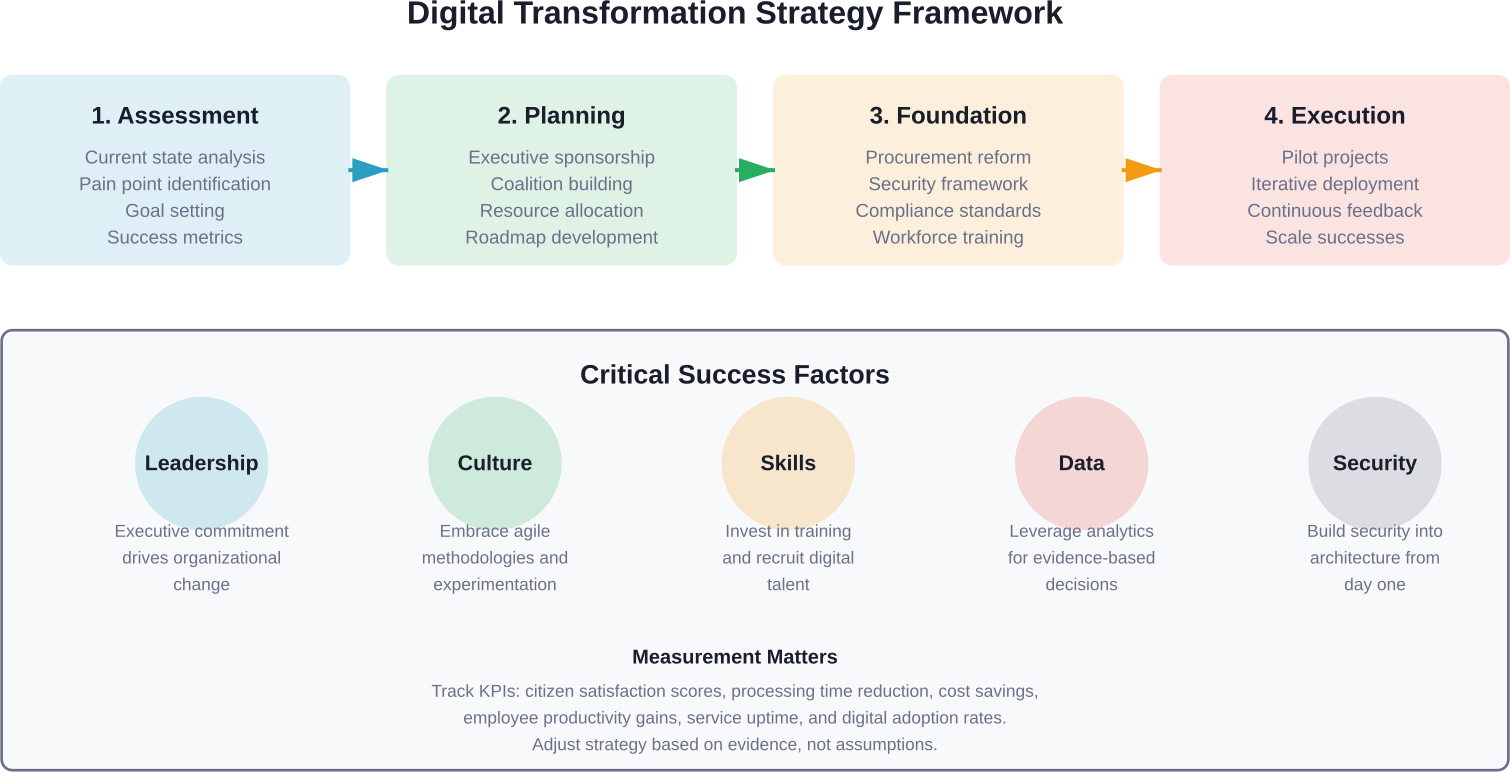

Strategy matters more than technology. Agencies that succeed in digital transformation start with clear objectives tied to mission outcomes, not vendor solutions looking for problems.

Bewertung des aktuellen Zustands und Definition von Zielen

Honest assessment of existing capabilities forms the foundation. What systems are in place? Where are the pain points? Which processes frustrate citizens and employees alike?

According to a Wakefield survey cited in the source material, 91% of American government agency representatives recognize the urgency of digital transformation. That’s good. But urgency without direction leads to wasted investments in technology that doesn’t align with strategic goals.

Define specific, measurable objectives. “Improve citizen satisfaction” is too vague. “Reduce permit processing time from 45 days to 10 days” gives teams a clear target.

Secure Executive Sponsorship and Build Coalitions

Digital transformation dies without leadership support. Executives must champion change, allocate resources, and remove organizational barriers.

But top-down mandates aren’t enough. Build coalitions across departments, involving IT teams, program managers, and frontline employees who understand day-to-day operations. Change management is as critical as technical implementation.

Modernize Procurement and Budgeting

Traditional government procurement cycles don’t match technology timelines. By the time an 18-month RFP process concludes, the proposed solution may already be outdated.

Agile procurement methods like modular contracting break large projects into smaller components with shorter delivery cycles. This reduces risk while allowing course corrections based on feedback.

Budget flexibility matters too. The Technology Modernization Fund model demonstrates how alternative funding mechanisms can accelerate modernization.

Prioritize Security and Compliance

Government agencies handle sensitive data that makes them prime targets for cyberattacks. Security can’t be bolted on after implementation—it must be built into architecture from the beginning.

The NIST Cybersecurity Framework provides structured guidance for managing cybersecurity risk. FedRAMP certification ensures cloud services meet federal security requirements. These frameworks help agencies adopt modern technology without compromising security posture.

Invest in Workforce Development

Technology is only as effective as the people using it. Successful transformation requires training programs that build digital literacy across the organization.

This includes technical skills for IT staff and functional training for program employees who’ll use new systems daily. It also means recruiting talent with skills in emerging areas like data science, user experience design, and cloud architecture.

Implement Iteratively and Measure Progress

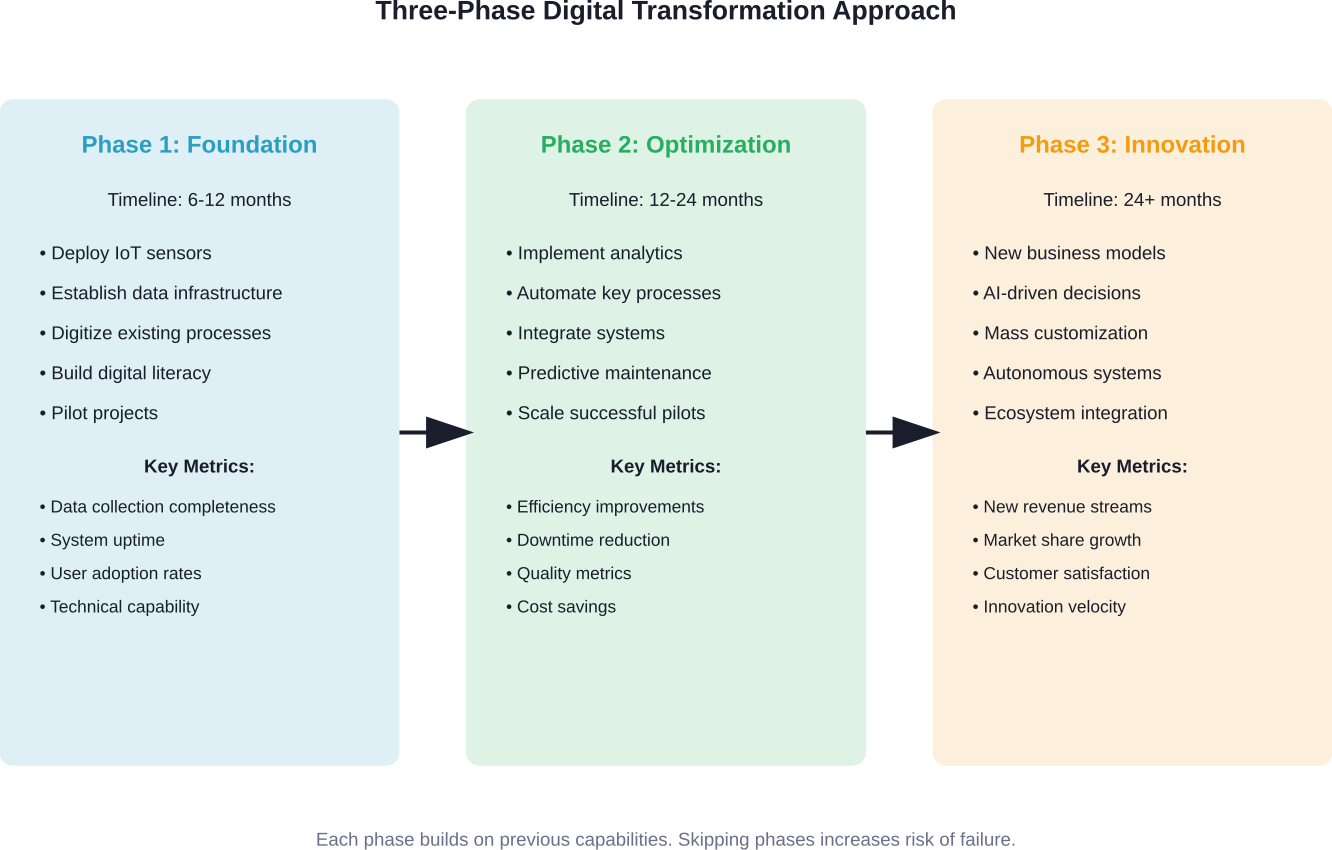

Big-bang transformations rarely work. Iterative approaches deliver value faster while limiting risk exposure.

Start with pilot projects in limited scope. Measure results against defined objectives. Learn from failures and scale what works. This agile mindset feels foreign in government culture that often demands comprehensive plans upfront, but it produces better outcomes.

Overcoming Common Barriers to Digital Transformation

Understanding obstacles helps agencies plan around them rather than being blindsided.

Legacy System Dependencies

Decades-old mainframe systems still run critical government functions. These systems work, but they’re expensive to maintain and nearly impossible to integrate with modern applications.

Strangler fig pattern offers one solution: gradually replace legacy functionality with new services while maintaining the old system until fully deprecated. This reduces risk compared to wholesale replacement.

Budget Constraints and Funding Cycles

Multi-year appropriations don’t align with technology lifecycles. Agencies struggle to commit to subscriptions or ongoing maintenance when budgets reset annually.

Alternative funding models like the Technology Modernization Fund help, but broader budget reform remains necessary. Some agencies find success with cost-avoidance arguments—demonstrating how modernization reduces future expenses even if upfront costs are significant.

Organizational Silos

Government agencies operate in silos by design, with clear lines of authority and responsibility. Digital transformation demands cross-functional collaboration that organizational structure actively resists.

Breaking down silos requires executive mandate plus practical incentives. Shared KPIs that measure outcomes across departments encourage cooperation. Communities of practice let professionals share knowledge even when formal reporting structures don’t connect them.

Widerstand gegen Veränderungen

People fear what they don’t understand. Employees worry new systems will eliminate jobs or make their skills obsolete. This creates passive resistance that undermines implementation.

Effective change management addresses these concerns through transparent communication, meaningful training, and involving employees in design decisions. When people understand how transformation makes their work easier rather than threatening their livelihood, adoption accelerates.

Bedenken in Bezug auf die Cybersicherheit

Government data sensitivity makes security paramount. But security concerns sometimes become excuses for avoiding modernization entirely.

Here’s the thing though—legacy systems are often less secure than modern alternatives. Outdated operating systems don’t receive security patches. Monolithic architectures lack defense-in-depth capabilities. Modern cloud platforms with proper configuration often provide stronger security posture than aging on-premises infrastructure.

The Role of Cybersecurity in Government Transformation

Security isn’t separate from digital transformation—it’s foundational to it.

The NIST Cybersecurity Framework provides structured guidance helping organizations understand and improve cybersecurity risk management. The framework’s five functions—Identify, Protect, Detect, Respond, and Recover—create a comprehensive approach applicable across government levels.

FedRAMP (Federal Risk and Authorization Management Program) standardizes security assessment for cloud services used by federal agencies. Rather than each agency conducting separate security reviews, FedRAMP creates reusable authorizations that accelerate cloud adoption while maintaining security standards.

Zero trust architecture represents a paradigm shift from perimeter-based security. Traditional models assumed everything inside the network was trustworthy. Zero trust assumes breach and verifies every access request regardless of location. This model better supports remote work and cloud services that don’t fit neat perimeters.

State and Local Government Transformation

Federal initiatives set the tone, but state and local governments face unique challenges in digital transformation.

Smaller agencies often lack dedicated IT staff with expertise in emerging technologies. Tight budgets make expensive consulting engagements prohibitive. Yet citizens expect the same digital experience from local permit offices as they get from federal agencies.

Regional partnerships help bridge these gaps. Multiple municipalities can share platforms, splitting costs while accessing capabilities none could afford individually. State governments increasingly provide shared services—identity management, payment processing, data analytics—that local agencies can leverage.

Commercial off-the-shelf solutions tailored for government reduce custom development costs. Rather than building bespoke systems from scratch, agencies configure proven platforms to their specific needs.

| Government Level | Primary Transformation Drivers | Key Challenges | Success Strategies |

|---|---|---|---|

| Federal | National security, cross-agency coordination, policy mandates | Scale, legacy infrastructure, procurement complexity | Centralized platforms (OneGov, TMF), standardized frameworks |

| State | Service delivery efficiency, transparency requirements, compliance | Budget constraints, varying county capabilities, political cycles | Shared services, regional partnerships, phased rollouts |

| Local | Constituent expectations, operational costs, competitive pressure | Limited IT resources, small budgets, staff capacity | COTS solutions, inter-municipal collaboration, state support |

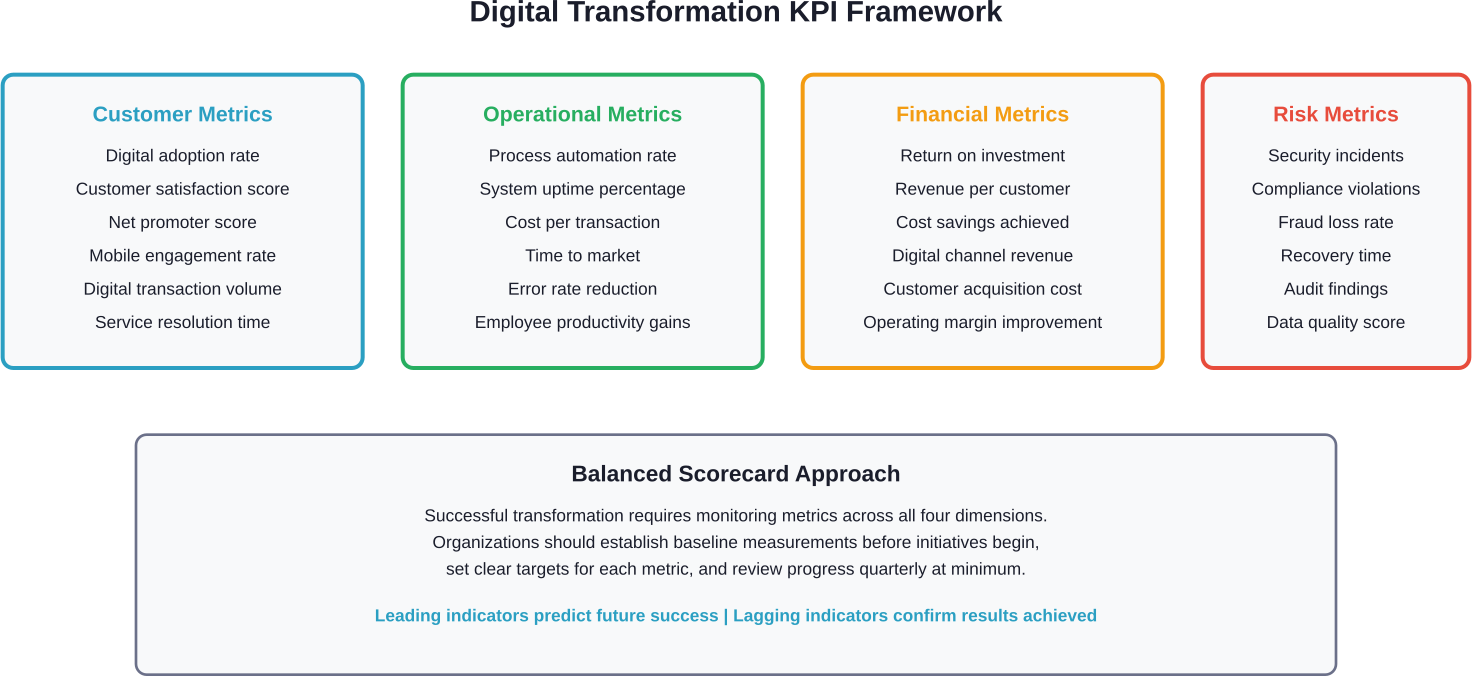

Messung des Erfolgs der digitalen Transformation

What gets measured gets managed. Agencies need clear metrics to track progress and justify continued investment.

Citizen satisfaction scores provide direct feedback on service quality. Online surveys, user testing, and complaint tracking reveal how well digital services meet constituent needs.

Operational efficiency metrics include processing time reductions, cost per transaction, and staff productivity gains. One analysis found agencies identifying over $308,000 in annual savings by shifting citizen requests online—concrete numbers that demonstrate ROI.

Digital adoption rates show whether citizens actually use new services. High adoption validates user-centered design. Low adoption signals problems requiring attention.

System uptime and performance metrics ensure reliability. Digital services must match or exceed the availability of legacy channels they replace.

Security incident tracking monitors whether modernization improves or degrades security posture. Reduced incidents validate security investments.

Future Directions for Government Digital Transformation

Looking ahead, several emerging technologies and approaches will shape government digital transformation beyond 2026.

Generative AI applications will expand beyond chatbots to automate complex tasks like document analysis, regulation interpretation, and policy research. The challenge lies in ensuring accuracy and accountability when AI systems make recommendations affecting citizens’ lives.

Blockchain and distributed ledger technologies may improve transparency in areas like supply chain tracking, credentialing, and grant management. Government experiments with these technologies continue, though widespread adoption remains years away.

Quantum computing could revolutionize cryptography, optimization problems, and complex simulations relevant to defense and research agencies. The National Quantum Initiative positions the United States to lead this emerging field.

Internet of Things (IoT) sensors enable smart city applications from traffic management to environmental monitoring. Managing security and privacy across millions of connected devices presents new challenges.

Citizen identity and authentication systems will need to balance security with user experience. Digital wallets and decentralized identity frameworks offer alternatives to today’s fragmented authentication landscape.

Häufig gestellte Fragen

- What is digital transformation in government?

Digital transformation in government involves modernizing IT systems, digitizing services, and leveraging technology to improve how agencies operate and serve citizens. This includes cloud migration, automation, data analytics, and creating seamless digital experiences that match private sector standards.

- How much does government digital transformation cost?

Costs vary dramatically based on agency size, existing infrastructure, and transformation scope. The Technology Modernization Fund provides alternative funding for federal projects. GSA analysis shows medium agencies can achieve 42% cost avoidance through technologies like SD-WAN. Many agencies report six-figure annual savings from digitizing specific processes, though upfront investments may run into millions for comprehensive transformations.

- What are the biggest barriers to digital transformation in government?

Legacy system dependencies, rigid procurement processes, budget constraints, organizational silos, and resistance to change represent the most common barriers. Cybersecurity concerns and workforce skill gaps also challenge agencies. Successful transformations address these through executive sponsorship, iterative implementation, change management, and workforce development programs.

- How long does government digital transformation take?

Transformation is ongoing rather than a one-time project. Specific initiatives range from 3-9 months for process automation to 18-36 months for unified citizen platforms. Cloud migrations typically require 12-24 months. Agencies should expect 3-5 years for comprehensive transformation, implemented iteratively with measurable milestones rather than big-bang deployments.

- What role does cybersecurity play in government digital transformation?

Cybersecurity is foundational to successful transformation. The NIST Cybersecurity Framework provides structured risk management guidance, while FedRAMP standardizes cloud security assessments. Modern approaches like zero trust architecture verify every access request, better supporting cloud and remote work environments. Security must be built into architecture from the start, not added afterward.

- How can state and local governments with limited budgets pursue digital transformation?

Smaller agencies can leverage commercial off-the-shelf solutions designed for government, participate in regional partnerships to share costs, and access shared services provided by state governments. Prioritizing high-impact, lower-cost initiatives first builds momentum and generates savings that fund additional transformation. Focusing on cloud solutions reduces upfront infrastructure investment while providing scalability.

- What federal programs support government digital transformation?

The Technology Modernization Fund provides alternative funding for federal IT projects. The OneGov Strategy launched on April 30, 2025 coordinates governmentwide IT acquisition. The USAi platform delivers AI capabilities to federal agencies. GSA’s IT Modernization Division offers guidance on cloud operations and infrastructure modernization. These programs provide resources, funding, and expertise agencies can leverage.

Schlussfolgerung

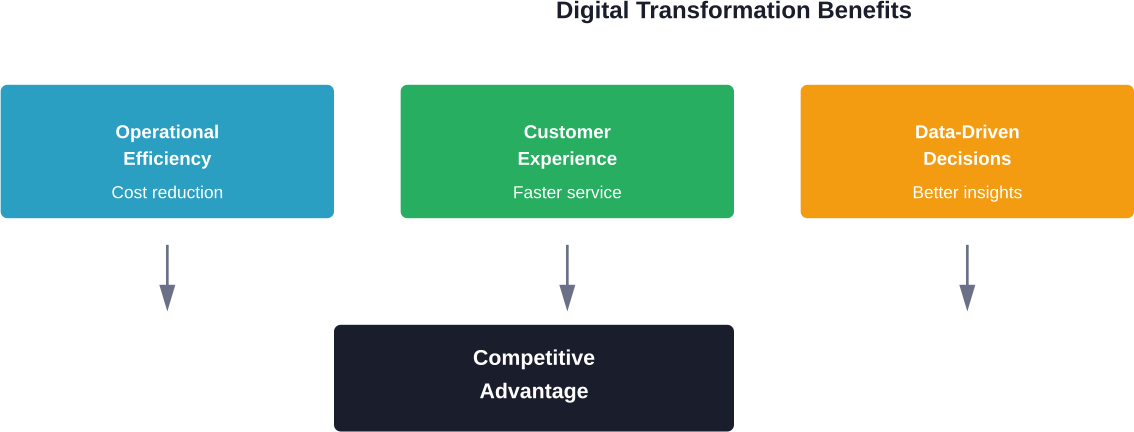

Government digital transformation represents one of the most significant shifts in public sector operations in decades. The combination of citizen expectations, technological capabilities, and federal initiatives like the OneGov Strategy create momentum that’s accelerating change across all government levels.

Success requires more than implementing new technology. It demands strategic planning aligned with mission objectives, executive leadership that champions change, modernized procurement processes, comprehensive security frameworks, and workforce development that builds digital capabilities.

The agencies making real progress share common characteristics: they start with clear goals tied to citizen outcomes, implement iteratively rather than attempting wholesale transformation overnight, measure results against defined metrics, and adapt based on evidence.

Challenges remain—legacy systems, budget constraints, organizational silos, and change resistance won’t disappear overnight. But the path forward is clearer than ever, supported by proven frameworks, successful case studies, and government-wide initiatives that provide resources and coordination.

Digital transformation isn’t about technology for its own sake. It’s about building government that serves citizens more effectively, operates more efficiently, and adapts to changing needs with agility that legacy approaches never achieved.

The transformation is happening now. Agencies that engage strategically will deliver better outcomes for the citizens they serve while those that delay will find themselves increasingly unable to meet basic expectations.

Ready to advance your agency’s digital transformation? Visit GSA.gov to access IT modernization resources, join communities of practice, and explore federal programs supporting government technology modernization. The tools, frameworks, and funding mechanisms exist—the question is how quickly your organization will leverage them.