Data Warehousing hat den Ruf, teuer zu sein, und in vielen Fällen ist dieser Ruf auch berechtigt. Aber die wirklichen Kosten entstehen selten durch einen einzelnen Posten oder ein einzelnes Tool. Sie ergeben sich aus der Wahl des Designs, dem Datenvolumen, den Leistungserwartungen und dem kontinuierlichen Aufwand, der erforderlich ist, um alles reibungslos laufen zu lassen, während das Unternehmen wächst.

Viele Unternehmen betrachten Data Warehousing als ein einmaliges Projekt mit einem festen Preisschild. In Wirklichkeit handelt es sich um eine Betriebskapazität. Die Kosten ändern sich im Laufe der Zeit, je nachdem, wie die Daten genutzt werden, wie oft sie aktualisiert werden und wie viel Disziplin in Bezug auf Architektur und Governance besteht. Zwei Unternehmen mit ähnlichen Datenmengen können sehr unterschiedliche Rechnungen erhalten.

In diesem Artikel wird aufgeschlüsselt, was Data Warehousing in der Praxis tatsächlich kostet, warum die Preise so stark variieren und wo Teams die tatsächlichen Investitionen am häufigsten falsch einschätzen, bevor sie sich festlegen.

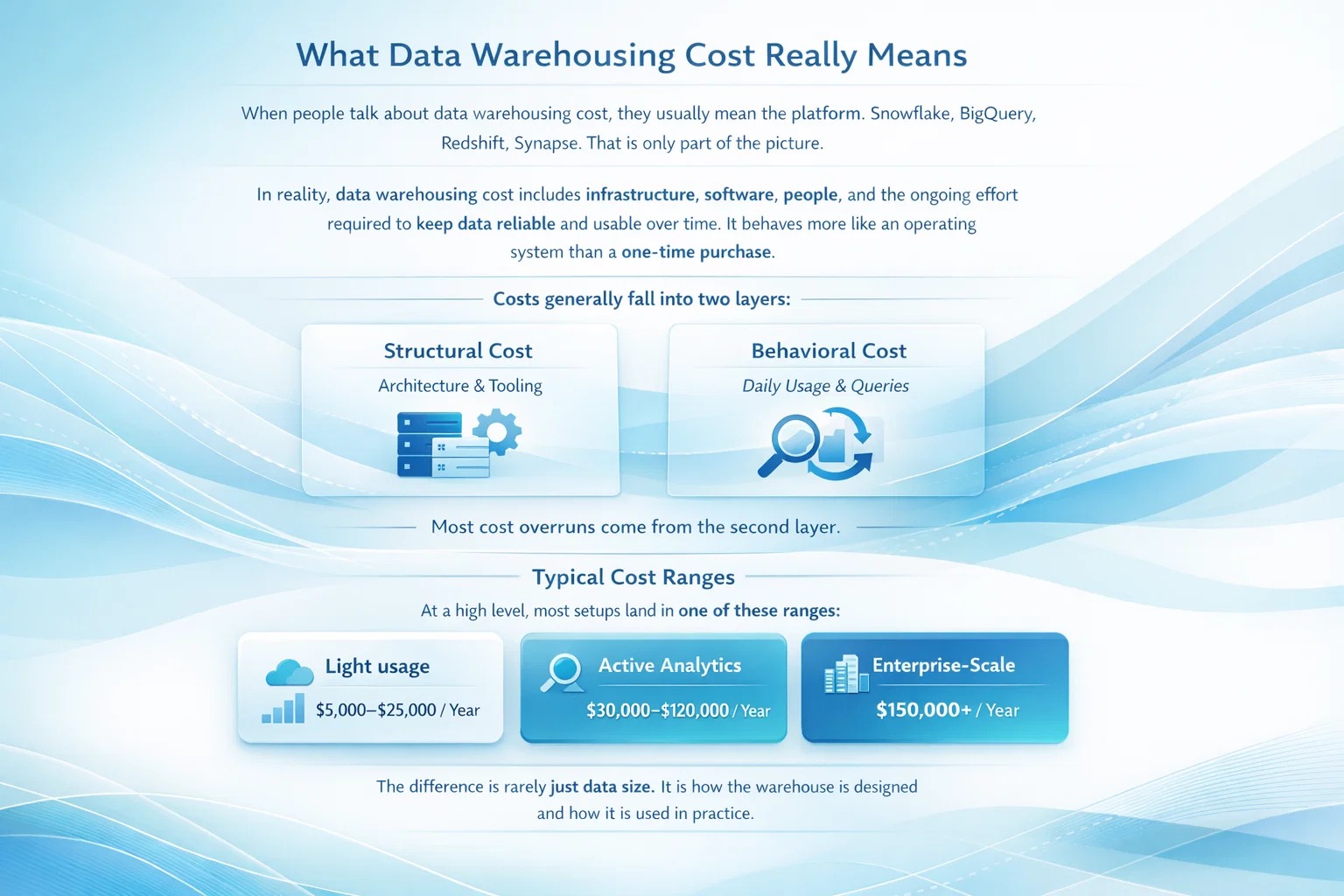

Was die Kosten für Data Warehousing wirklich bedeuten

Wenn man von Data-Warehousing-Kosten spricht, meint man in der Regel die Plattform. Snowflake, BigQuery, Redshift, Synapse. Das ist aber nur ein Teil des Bildes.

In Wirklichkeit umfassen die Kosten für das Data Warehousing die Infrastruktur, die Software, die Mitarbeiter und den laufenden Aufwand, der erforderlich ist, um die Daten zuverlässig und langfristig nutzbar zu halten. Es verhält sich eher wie ein Betriebssystem als eine einmalige Anschaffung.

Die Kosten lassen sich im Allgemeinen in zwei Bereiche unterteilen:

- Strukturelle Kosten, die von der Architektur, der Werkzeugausstattung und der Basiskapazität bestimmt werden

- Verhaltenskosten, die davon abhängen, wie Teams täglich Daten abfragen, aktualisieren und nutzen

Die meisten Kostenüberschreitungen sind auf die zweite Ebene zurückzuführen.

Typische Kostenspannen

Auf hohem Niveau liegen die meisten Aufstellungen in einem dieser Bereiche:

- Leichte Nutzungetwa $5.000-$25.000 pro Jahr

- Aktive Analytik: etwa $30.000-$120.000 pro Jahr

- Unternehmensweit: $150.000+ pro Jahr

Der Unterschied liegt selten nur in der Größe der Daten. Es geht darum, wie das Lager konzipiert ist und wie es in der Praxis genutzt wird.

Anfängliche Kosten: Was Sie zahlen, bevor sich der Wert zeigt

Einrichtung von Infrastruktur und Plattform

Die ersten spürbaren Kosten entstehen bei der Einrichtung. Dazu gehören die Auswahl einer Lagerplattform, die Konfiguration von Umgebungen und die Einrichtung der zentralen Datenarchitektur.

Bei Cloud-basierten Lagern sind die anfänglichen Infrastrukturkosten im Vergleich zu On-Premise-Systemen in der Regel bescheiden. Es muss keine Hardware gekauft werden, und die Umgebungen können schnell bereitgestellt werden.

Typischer Kostenbereich

Die anfängliche Einrichtung der Plattform und der Umgebung liegt normalerweise zwischen $1.000 und $10.000, je nach Umfang und Komplexität.

Die wirklichen Einrichtungskosten sind jedoch nicht der Speicher oder die Rechenleistung. Es ist das Design. Die Wahl des Schemas, die Datenpartitionierung, die Aktualisierungshäufigkeit und die Transformationslogik beeinflussen alle die langfristigen Kosten. Eine überstürzte Einrichtung kann anfangs kostengünstig erscheinen und bei zunehmender Nutzung teuer werden.

Datenintegration und ETL-Entwicklung

Daten kommen selten fertig zur Analyse. Sie müssen aus den Quellsystemen extrahiert, in brauchbare Formate umgewandelt und in das Warehouse geladen werden.

Dieser Schritt wird oft unterschätzt. Selbst mit modernen ETL- und ELT-Tools braucht die Integrationsarbeit Zeit. Quellsysteme ändern sich, Probleme mit der Datenqualität tauchen auf, und es gibt Grenzfälle.

Typischer Kostenbereich

Die anfängliche Datenintegration und ETL-Entwicklung liegt in der Regel zwischen $5.000 und $30.000, abhängig von der Anzahl der Quellen und der Komplexität der Transformation.

Unabhängig davon, ob Sie verwaltete Tools oder benutzerdefinierte Pipelines verwenden, schlagen sich diese Kosten entweder in Form von Tooling-Lizenzen oder in Form von Entwicklungsstunden nieder.

Implementierung und Beratung

Viele Unternehmen ziehen in der Anfangsphase externe Hilfe hinzu. Dazu können Berater, Implementierungspartner oder spezialisierte Dateningenieure gehören.

Diese Kosten sind nicht per se negativ. In vielen Fällen verringern sie das langfristige Risiko, indem sie architektonische Fehler verhindern.

Typischer Kostenbereich

Die Implementierungs- und Beratungskosten liegen in der Regel zwischen $10.000 und $50.000+, je nach Umfang, Zeitplan und Liefermodell.

Laufende Kosten: Wo Budgets abdriften

Compute-Nutzung

Die Rechenleistung ist in der Regel der volatilste Kostentreiber in modernen Data Warehouses.

Abfragen kosten Geld. Komplexe Abfragen kosten mehr. Abfragen, die zur falschen Zeit laufen oder unnötige Daten abfragen, können weit mehr kosten als erwartet.

Typischer Kostenbereich

Die laufenden Ausgaben für Rechenleistung liegen in der Regel zwischen einigen hundert und mehreren tausend Dollar pro Monat, je nach Intensität der Arbeitslast, Gleichzeitigkeit und Governance.

Verbrauchsabhängige und serverlose Preismodelle machen diese Volatilität schnell sichtbar. Eine kleine Anzahl ineffizienter Dashboards oder schlecht geschriebener Ad-hoc-Abfragen kann die monatlichen Ausgaben spürbar in die Höhe treiben.

Speicherung Wachstum

Speicherplatz ist pro Terabyte relativ günstig, aber er wächst unauffällig.

Rohdaten, umgewandelte Tabellen, historische Snapshots, Sicherungskopien und temporäre Datensätze sammeln sich an.

Typischer Kostenbereich

Die Speicherkosten beginnen oft bei $20 bis $50 pro TB pro Monat und steigen dann stetig an, wenn das Datenvolumen und die Aufbewahrungsanforderungen zunehmen.

Ohne aktives Management sinken die Lagerkosten selten von allein.

Wartung und Überwachung

Moderne Lagerhäuser reduzieren den Wartungsaufwand im Vergleich zu älteren Systemen, aber sie machen ihn nicht überflüssig.

Die Nutzung muss überwacht, der Zugriff verwaltet, Pipelines gewartet und Fehler behoben werden. Dateningenieure und -analysten verbringen Zeit damit, die Leistung zu optimieren, Datenprobleme zu lösen und Benutzer zu unterstützen.

Kostenbetrachtung

Diese Arbeit ist in der Regel kein direkter Posten, aber sie entspricht oft einem Teil einer Vollzeitstelle oder mehr, wenn das Lager geschäftskritisch wird.

Cloud vs. On-Premise Data Warehousing Kosten

Cloud-basierte Lagerhäuser

Cloud Warehouses dominieren die moderne Analytik, da sie Flexibilität, Skalierbarkeit und eine schnellere Wertschöpfung bieten.

Unter Kostengesichtspunkten ersetzen sie große Vorabinvestitionen durch laufende Betriebskosten. Die Einstiegskosten sind niedriger, aber es ist eine disziplinierte Überwachung erforderlich, um die Ausgaben unter Kontrolle zu halten.

Kostenmerkmale

- Niedrige Anfangskosten

- Variable monatliche Ausgaben

- Starke Skalierbarkeit, höheres Risiko einer Kostenabweichung ohne Governance

Vor-Ort-Lagerhäuser

On-Premise-Lösungen gibt es immer noch, vor allem in stark regulierten Branchen oder in Unternehmen mit stabilen, vorhersehbaren Arbeitslasten.

Sie erfordern erhebliche Vorabinvestitionen in Hardware, Lizenzierung und Infrastruktur.

Typischer Kostenbereich

Die Anfangsinvestitionen für On-Premises beginnen oft bei $50.000 und können mehrere hunderttausend Dollar erreichen, bevor die Nutzung beginnt.

Die laufenden Kosten sind besser vorhersehbar, aber die Flexibilität ist begrenzt.

Umwandlung von Data Warehousing in ein zuverlässiges Geschäftssystem bei A-listware

Unter A-listware, Wir unterstützen Unternehmen bei der Entwicklung, Erstellung und Wartung von Data-Warehousing-Lösungen, die unter realen Bedingungen und nicht nur auf dem Papier funktionieren. Unser Fokus geht über die Einführung hinaus. Wir sorgen dafür, dass das Warehouse zuverlässig und skalierbar bleibt und sich an die tatsächliche Datennutzung der Teams anpasst, wenn das Unternehmen wächst.

Wir arbeiten eng mit unseren Kunden zusammen, um ihre Datenlandschaft, ihre Geschäftsziele und ihre technischen Beschränkungen zu verstehen, bevor wir Architekturentscheidungen treffen. Auf dieser Grundlage implementieren wir Data Warehouses, die Analysen und Berichte ohne unnötige Komplexität unterstützen. Wir schenken der Datenmodellierung, den Integrationsabläufen und der Leistung von Anfang an große Aufmerksamkeit, damit das System auch bei steigenden Anforderungen nutzbar bleibt.

Unsere Teams werden direkt in die Arbeitsabläufe des Kunden integriert und fungieren als Erweiterung der internen Technik- oder Analyseteams. Das bedeutet klare Kommunikation, gemeinsame Verantwortung und langfristige Einbindung anstelle einer einmaligen Lieferung. Mit mehr als 25 Jahren Erfahrung und Teams, die innerhalb von 2 bis 4 Wochen mit der Arbeit beginnen können, helfen wir Unternehmen, Data Warehousing zu einer zuverlässigen Grundlage für die Entscheidungsfindung zu machen und nicht nur ein weiteres technisches Projekt.

Die Faktoren, die die Kosten für Data Warehousing beeinflussen

1. Datenvolumen und Wachstumsrate

Volumen ist wichtig, aber Wachstum ist noch wichtiger.

Viele Teams planen für den aktuellen Datenumfang und unterschätzen, wie schnell er sich vergrößert. Ereignisdaten, Protokolle und Verhaltensanalysen neigen dazu, schneller zu wachsen als erwartet.

Mit steigendem Volumen werden die Abfragen umfangreicher, die Aktualisierungsaufträge dauern länger, und die Optimierung wird immer wichtiger.

2. Datenkomplexität

Nicht alle Daten verhalten sich gleich.

Strukturierte Finanzdaten sind relativ vorhersehbar. Halbstrukturierte Ereignisse und verschachteltes JSON erfordern mehr Transformation, mehr Berechnungen und eine sorgfältigere Modellierung.

Diese Komplexität wirkt sich sowohl auf die anfänglichen Herstellungskosten als auch auf die laufende Nutzung aus.

3. Aktualisierungsfrequenz

Die Daten einmal am Tag zu aktualisieren ist etwas ganz anderes als sie jede Stunde oder alle paar Minuten zu aktualisieren.

Eine höhere Aktualisierungshäufigkeit erhöht die Rechennutzung und die Komplexität der Pipeline und verringert die Möglichkeiten für eine effiziente Stapelverarbeitung.

In vielen Fällen bringen Beinahe-Echtzeitdaten nur einen begrenzten geschäftlichen Mehrwert und erhöhen gleichzeitig die Kosten erheblich.

4. Verwendungsmuster

Die Art und Weise, wie Menschen das Lager abfragen, ist ebenso wichtig wie die Art der Datenspeicherung.

Hohe Gleichzeitigkeit, wiederholte vollständige Tabellenscans und uneingeschränkte Ad-hoc-Erkundungen treiben die Kosten in die Höhe.

Kostenprobleme treten häufig auf, wenn Analysesysteme für die Betriebsüberwachung oder für Echtzeitanwendungen eingesetzt werden, für die sie nicht konzipiert wurden.

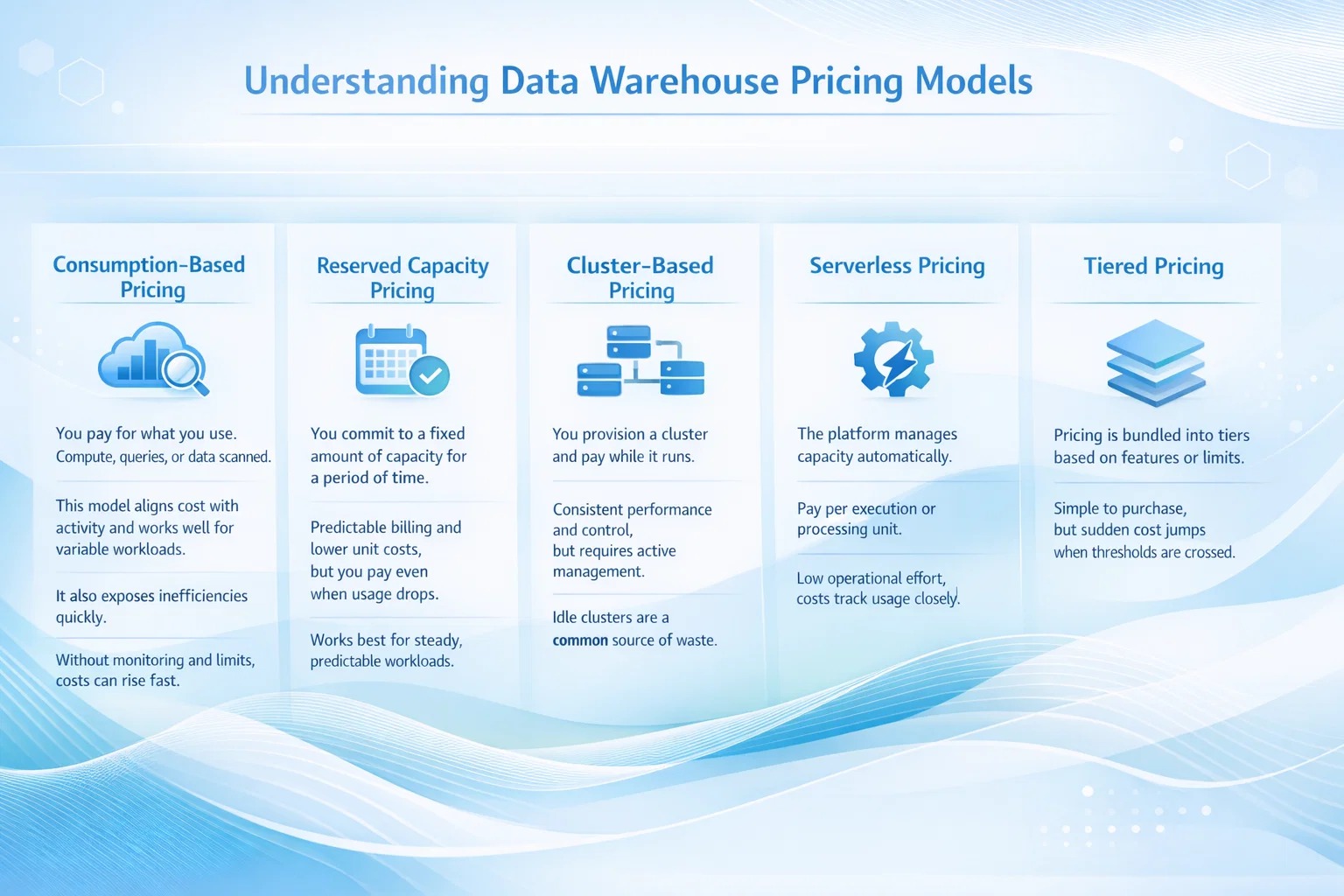

Verständnis von Data Warehouse-Preismodellen

Verbrauchsabhängige Preisgestaltung

Sie zahlen für das, was Sie nutzen. Compute, Abfragen oder gescannte Daten.

Dieses Modell richtet die Kosten an der Aktivität aus und eignet sich gut für variable Arbeitslasten. Es deckt auch Ineffizienzen schnell auf.

Ohne Überwachung und Begrenzung können die Kosten schnell steigen.

Preisgestaltung für reservierte Kapazität

Sie binden sich für einen bestimmten Zeitraum an eine bestimmte Menge an Kapazität.

Dies bietet eine vorhersehbare Abrechnung und niedrigere Stückkosten, aber Sie zahlen auch, wenn der Verbrauch sinkt. Es eignet sich am besten für gleichmäßige, vorhersehbare Arbeitslasten.

Cluster-basierte Preisgestaltung

Sie stellen einen Cluster bereit und zahlen, während er läuft.

Dies sorgt für gleichbleibende Leistung und Kontrolle, erfordert aber eine aktive Verwaltung. Untätige Cluster sind eine häufige Quelle von Verschwendung.

Serverlose Preisgestaltung

Die Plattform verwaltet die Kapazität automatisch. Sie zahlen pro Ausführung oder Verarbeitungseinheit.

Der betriebliche Aufwand ist gering, aber die Kosten verfolgen die Nutzung sehr genau. Ineffiziente Auslastungen machen sich direkt auf der Rechnung bemerkbar.

Gestaffelte Preisgestaltung

Die Preise sind nach Funktionen oder Einschränkungen gestaffelt.

Dies vereinfacht die Beschaffung, kann aber zu plötzlichen Kostensprüngen führen, wenn Schwellenwerte überschritten werden.

Planung eines realistischen Data Warehousing-Budgets

Ein realistisches Data-Warehousing-Budget geht über den Preis des Tools hinaus und berücksichtigt, wie sich das System entwickeln wird, sobald die Mitarbeiter es nutzen. Die genauesten Pläne berücksichtigen sowohl die technischen als auch die betrieblichen Realitäten.

Ein solides Budget sollte Folgendes beinhalten:

- Plattform- und Infrastrukturkosten. Basispreise für das Lager, Computernutzung, Speicherwachstum und alle unterstützenden Cloud-Dienste, von denen das Lager abhängt.

- Aufwand für die Datenintegration und -umwandlung. Anfängliche Pipeline-Entwicklung, laufende Änderungen an Quellsystemen, Korrekturen der Datenqualität und die Kosten für die Pflege von ETL- oder ELT-Workflows im Laufe der Zeit.

- Zeit für Ingenieure und Analysten. Zeit, die von Dateningenieuren, Analysetechnikern und Analysten für Modellierung, Leistungsoptimierung, Fehlerbehebung und Benutzersupport aufgewendet wird, nicht nur für die anfängliche Aufbauarbeit.

- Wachstum des Datenvolumens und der Nutzung. Erwartete Zunahme der Datenquellen, der Aufbewahrungszeiträume, der Benutzerzahl, der Abfragehäufigkeit und der Gleichzeitigkeit mit dem Wachstum des Unternehmens.

- Optimierungs- und Verwaltungsaufwand. Laufende Arbeiten zur Kostenüberwachung, Optimierung von Abfragen, Zugangsverwaltung, Durchsetzung von Nutzungsrichtlinien und Verhinderung ineffizienter Muster, die die Ausgaben in die Höhe treiben.

Das Ziel besteht nicht darin, die Kosten zu jeder Zeit zu minimieren. Es geht darum, bewusst auszugeben, zu verstehen, wohin das Geld fließt, und Überraschungen zu vermeiden, da das Data Warehouse für die tägliche Entscheidungsfindung immer wichtiger wird.

Abschließende Überlegungen

Die Kosten für Data Warehousing sind kein Geheimnis, aber sie sind selten einfach.

Die größten Fehler entstehen, wenn man sie als feste Anschaffung betrachtet, anstatt sie als lebendiges System zu betrachten. Die Kosten entwickeln sich, wenn die Daten wachsen, die Teams sich vergrößern und die Nutzungsmuster sich ändern.

Moderne Unternehmen, die mit Data Warehousing Erfolg haben, sind nicht diejenigen, die am wenigsten ausgeben. Sie sind diejenigen, die wissen, wohin ihr Geld fließt, warum es dorthin fließt und wie sie sich anpassen, wenn die Realität vom Plan abweicht.

Mehr als jedes Preismodell oder jede Plattformauswahl ist es dieses Verständnis, das die Kosten für Data Warehousing unter Kontrolle hält.

Häufig gestellte Fragen

- Wie hoch sind die Kosten für Data Warehousing in der Regel?

Die Kosten für Data Warehousing sind je nach Umfang und Nutzung sehr unterschiedlich. Kleine Teams geben vielleicht $5.000-$25.000 pro Jahr aus, wachsende Unternehmen fallen oft in den Bereich von $30.000-$120.000 und Unternehmensumgebungen können $150.000 pro Jahr übersteigen. Diese Zahlen umfassen mehr als nur die Plattform und spiegeln die laufende Nutzung, den technischen Aufwand und die Governance wider.

- Was ist der größte Kostentreiber in einem Data Warehouse?

Für die meisten modernen Lagerhäuser ist die Rechennutzung der größte und unvorhersehbarste Kostentreiber. Abfragevolumen, Abfrageeffizienz, Aktualisierungshäufigkeit und Gleichzeitigkeit wirken sich alle direkt auf die Rechenausgaben aus. Schlecht optimierte Abfragen oder übermäßig aggressive Aktualisierungspläne verursachen oft unerwartete Kostenspitzen.

- Ist Cloud Data Warehousing billiger als On-Premise-Lösungen?

Cloud-Data-Warehousing hat in der Regel geringere Vorlaufkosten und eine schnellere Amortisationszeit. Sie verlagert die Ausgaben auf die monatlichen Betriebskosten statt auf große Kapitalinvestitionen. Obwohl die Cloud für die meisten Unternehmen oft kostengünstiger ist, erfordert sie eine aktive Überwachung, um eine Kostenabweichung zu verhindern. On-Premise-Lösungen können in stabilen, stark regulierten Umgebungen sinnvoll sein, sind aber nicht flexibel genug.

- Warum steigen die Kosten für Data Warehouses mit der Zeit?

Die Kosten steigen tendenziell, wenn das Datenvolumen wächst, sich mehr Teams auf Analysen verlassen und die Nutzungsmuster zunehmen. Zusätzliche Dashboards, höhere Aktualisierungshäufigkeit, längere Aufbewahrungszeiträume und erhöhte Gleichzeitigkeit tragen alle dazu bei. Ohne Governance und regelmäßige Optimierung steigen die Kosten, selbst wenn sich die zugrunde liegende Architektur nicht ändert.

- Sind die Kosten für ETL und Datenintegration eine einmalige Ausgabe?

Nein. Während die anfängliche Entwicklung der Pipeline einen erheblichen Kostenfaktor darstellt, erfordert die Datenintegration eine kontinuierliche Pflege. Quellsysteme ändern sich, neue Daten kommen hinzu, und es treten Probleme mit der Datenqualität auf. Diese laufenden Anpassungen sind ein normaler Bestandteil des Betriebs eines Data Warehouse und sollten in die langfristige Budgetplanung einbezogen werden.