Kurze Zusammenfassung: Die digitale Transformation zur Kosteneinsparung umfasst den strategischen Einsatz von Technologien wie Cloud Computing, Automatisierung und KI, um die Betriebskosten zu senken und gleichzeitig die Effizienz zu steigern. Früheren Daten zufolge investierten Großunternehmen rund $27,5 Millionen in digitale Projekte, aber nur 25% der KI-Initiativen liefern den erwarteten ROI. Um erfolgreich zu sein, muss man sich auf messbare Kostensenkungsziele konzentrieren, Prozesse von Grund auf umgestalten und häufige Fallstricke wie unterschätzte Integrationskosten vermeiden.

Bei der digitalen Transformation geht es nicht mehr nur darum, relevant zu bleiben. Sie ist zu einem der mächtigsten Hebel geworden, um Kosten zu senken und gleichzeitig die Arbeitsweise von Unternehmen zu verbessern.

Doch hier liegt die Herausforderung: Die Kosten der Transformation variieren je nach Umfang und Zielsetzung erheblich. Nach Angaben der International Data Corporation (IDC) werden die weltweiten Ausgaben für die digitale Transformation bis 2027 voraussichtlich $3,9 Billionen erreichen, wobei das durchschnittliche Budget großer Unternehmen für DX-Initiativen $40 Millionen übersteigt.

Für mittlere bis große Unternehmen können die Kosten für die Umstellung zwischen $250.000 und fünf Millionen Dollar liegen. Das ist eine enorme Investition, und es stellt sich die Frage: Wie können Unternehmen sicherstellen, dass sie tatsächlich Geld sparen, anstatt es nur auszugeben?

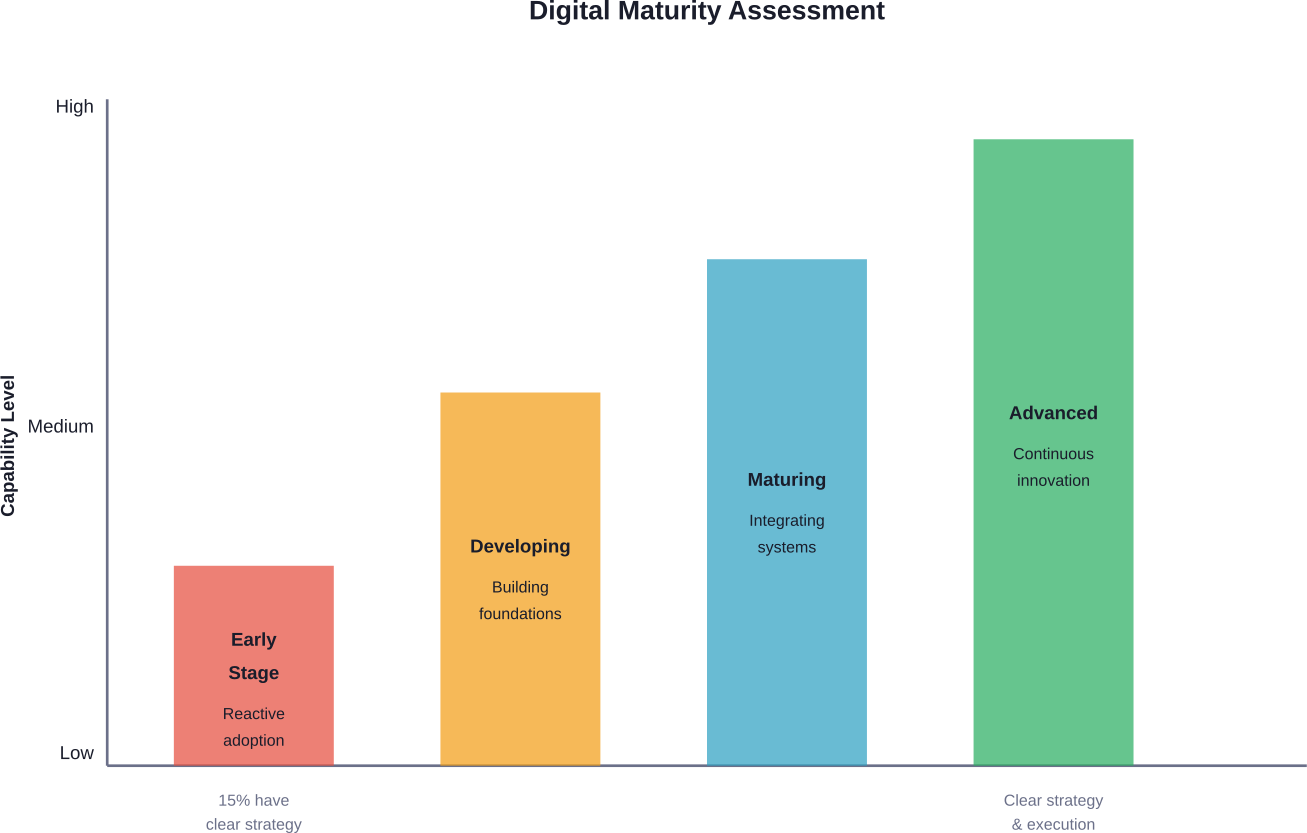

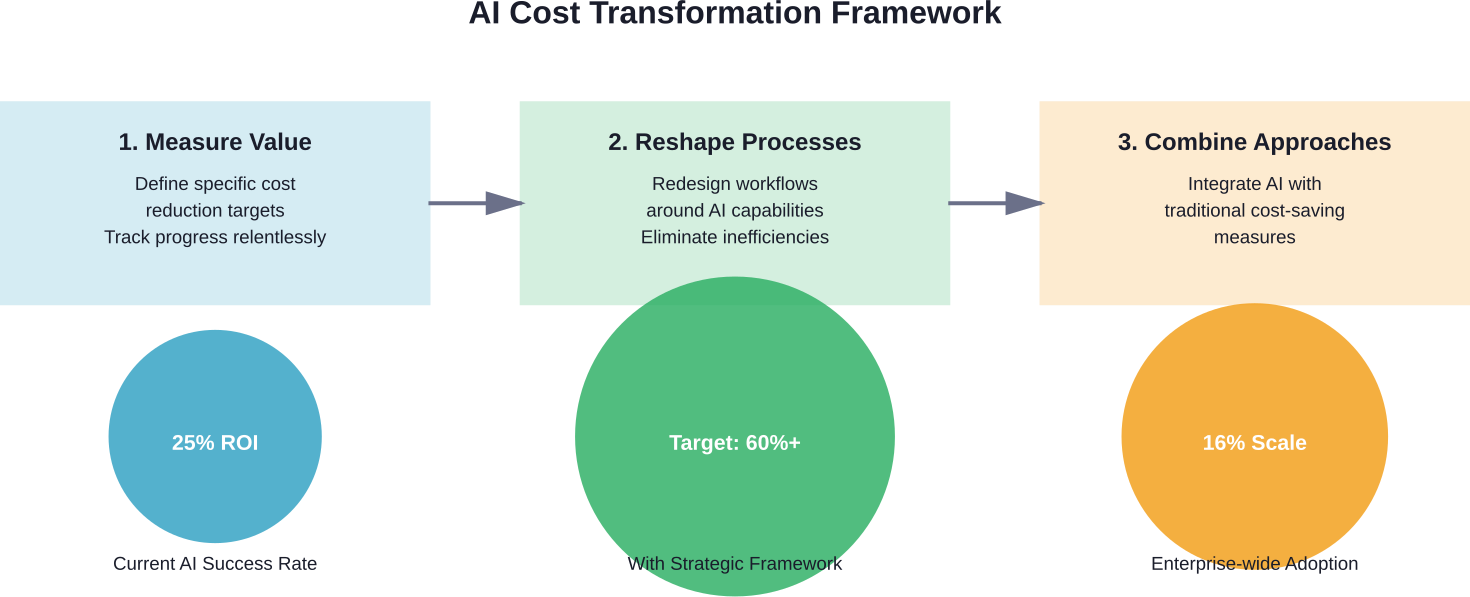

Die Daten zeigen eine ernüchternde Realität. Eine aktuelle IBM-Studie ergab, dass nur 25% der KI-Initiativen in den letzten Jahren den erwarteten ROI erbracht haben, und nur 16% konnten unternehmensweit skaliert werden. Ähnliche düstere Statistiken finden sich auch an anderer Stelle in der Studie.

Was also unterscheidet erfolgreiche kostensparende Umstellungen von teuren Misserfolgen? Genau das wird in diesem Leitfaden beleuchtet.

Die Kosten der digitalen Transformation verstehen

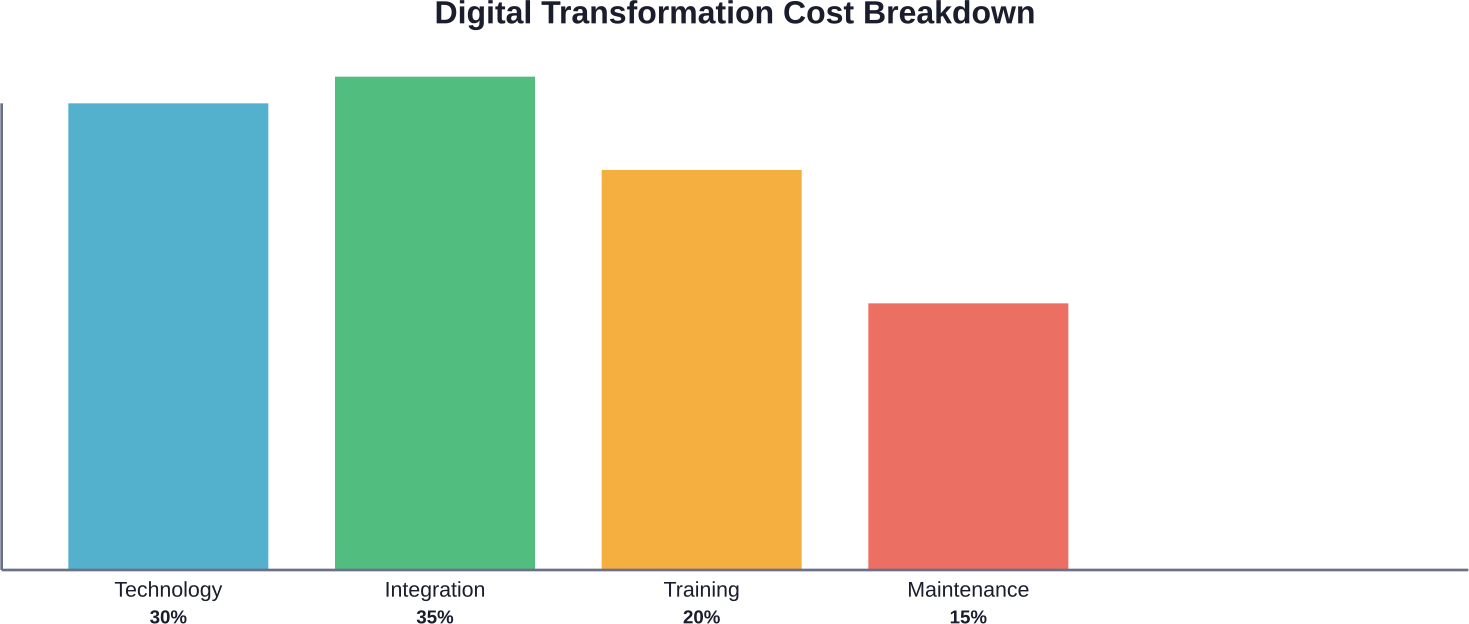

Bevor man sich mit Strategien zur Kosteneinsparung befasst, ist es wichtig zu verstehen, was die Ausgaben für die Umwandlung überhaupt verursacht.

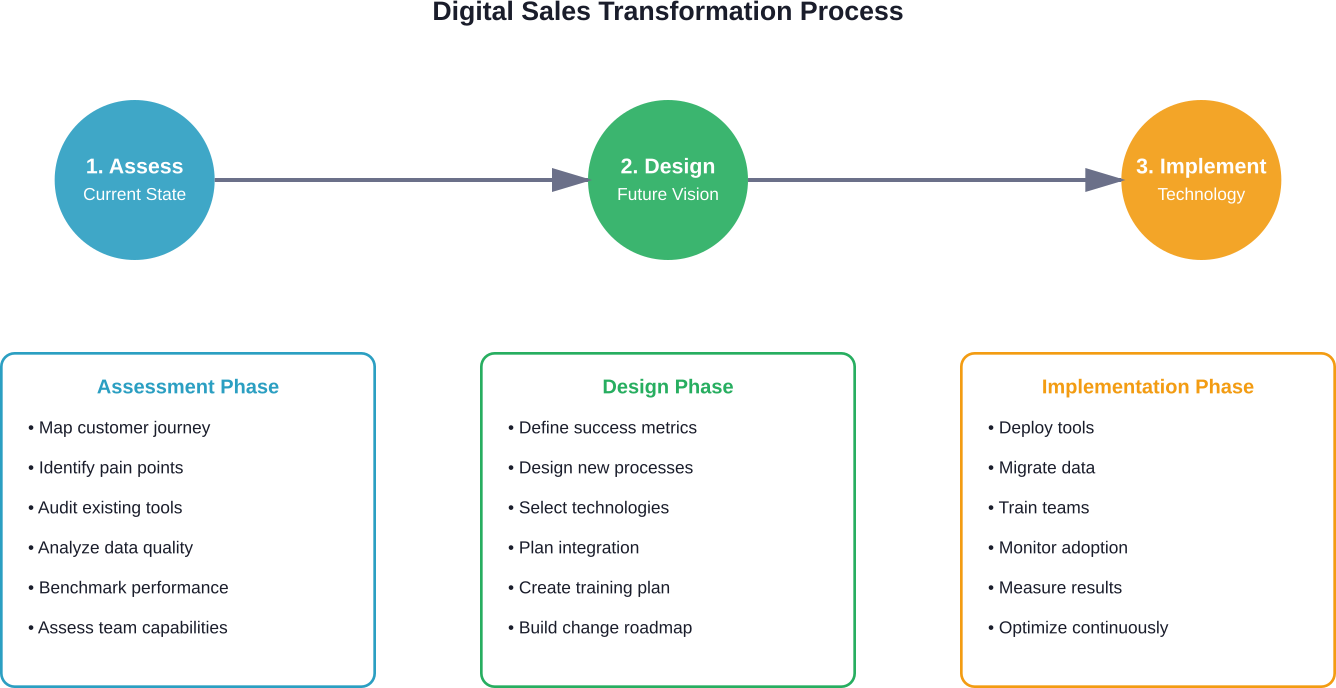

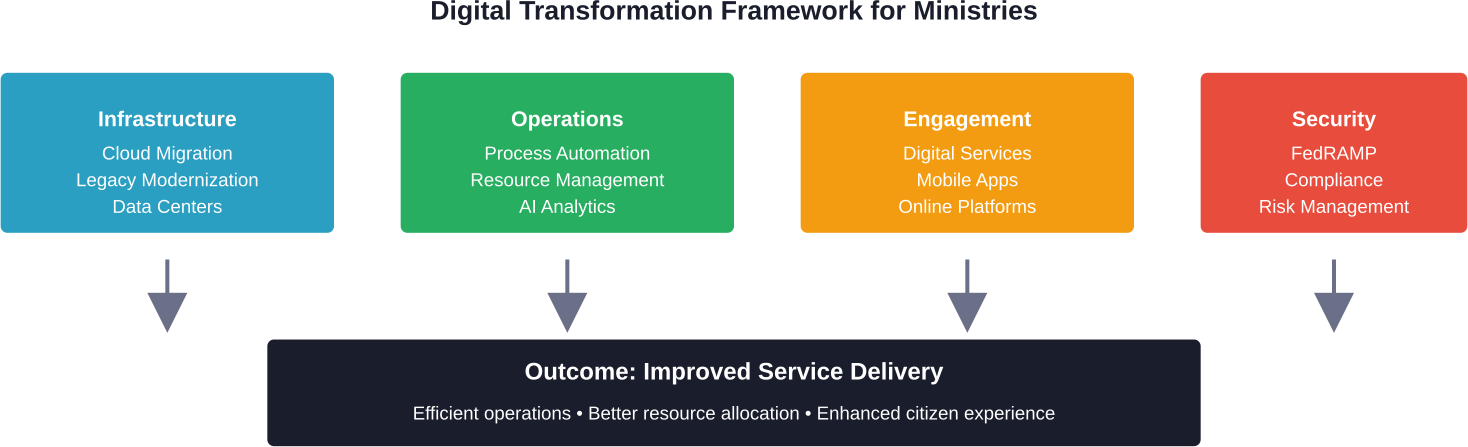

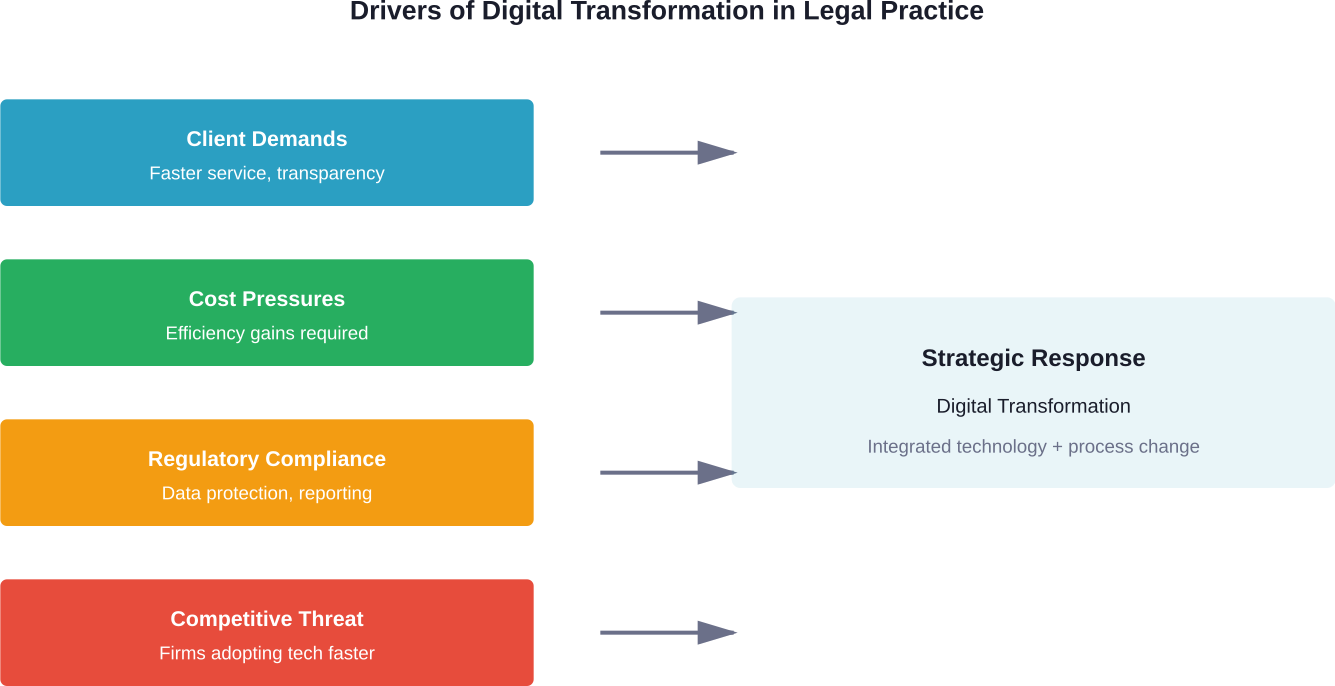

Bei der digitalen Transformation geht es um die Integration digitaler Technologien in alle Aspekte eines Unternehmens, wodurch sich die Art und Weise, wie das Unternehmen arbeitet und seinen Kunden einen Mehrwert bietet, grundlegend ändert. Dabei geht es nicht nur um den Kauf neuer Software, sondern darum, ganze Funktionen und Prozesse von Grund auf neu zu gestalten.

Was treibt die Ausgaben für Transformation an?

Der Erwerb von Technologie ist nur ein Teil des Puzzles. Die wirklichen Kosten entstehen durch Integration, Datenmigration, Talentakquise, Schulung und laufende Wartung.

Lösungen, die für 100 Benutzer konzipiert sind, versagen oft bei 1.000 Benutzern. Die Leistung nimmt ab, während die Kosten eskalieren. Was in der Pilotphase wie ein Schnäppchen aussah, wird im großen Maßstab unerschwinglich.

Viele Unternehmen unterschätzen, was für eine erfolgreiche Implementierung erforderlich ist. KI kann zwar den Erkenntnisgewinn beschleunigen, die Entscheidungsfindung verbessern und die Effizienz steigern, doch dazu sind erhebliche Investitionen in Technologie, Daten, Integration und Talent erforderlich.

| Kategorie Transformation | Haushaltsvoranschlag | Einzelheiten |

|---|---|---|

| Digitalisierung in kleinem Umfang | $50.000 - $250.000 | Einführung digitaler Lösungen in bestimmten Geschäftsbereichen oder Verbesserung der bestehenden Systeme |

| Transformation auf mittlerer Ebene | $250.000 - $2 Millionen | Mehrere Abteilungen, integrierte Systeme, moderate Umgestaltung von Prozessen |

| Unternehmensweite Transformation | $2 Millionen - $27,5 Millionen+ | Umfassende digitale Projekte über alle Unternehmensfunktionen hinweg |

Versteckte Kosten, die die meisten Teams vergessen

Die offensichtlichen Ausgaben werden budgetiert. Es sind die versteckten Kosten, die Transformationsinitiativen zum Scheitern bringen.

Die Komplexität der Integration überrascht Unternehmen oft unvorbereitet. Altsysteme vertragen sich nicht gut mit modernen Plattformen. Die Datenmigration erfordert Bereinigung, Mapping und Validierung - Prozesse, die weit mehr Zeit und Ressourcen in Anspruch nehmen, als zunächst angenommen.

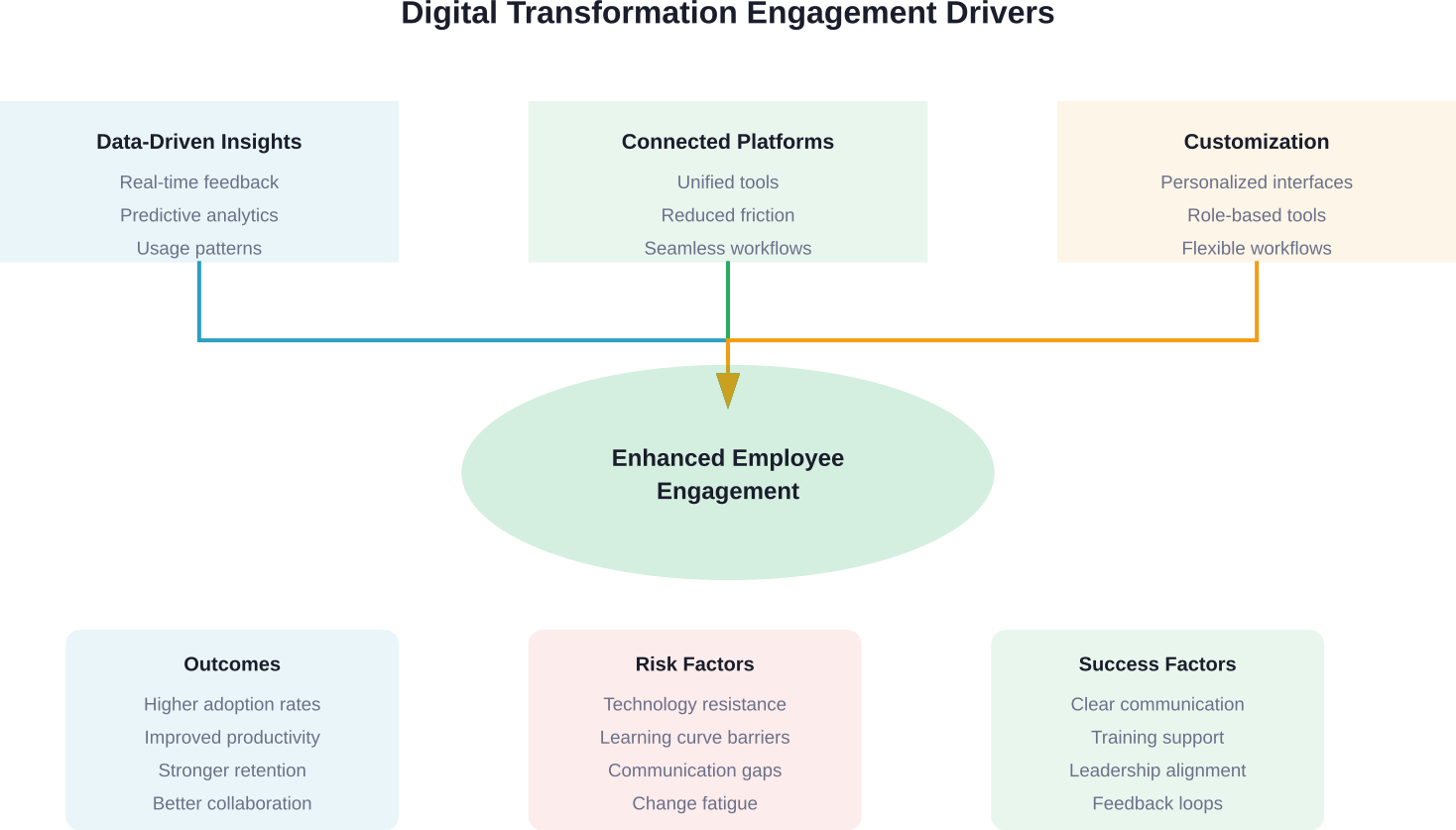

Ein weiterer häufig unterschätzter Kostenfaktor ist das Veränderungsmanagement. Mitarbeiter müssen geschult werden. Arbeitsabläufe müssen neu gestaltet werden. Widerstände müssen überwunden werden. Ohne angemessene Investitionen in die menschliche Seite der Umgestaltung kann auch die beste Technologie keinen Wert schaffen.

Bedenken hinsichtlich der Cybersicherheit verstärken diese Herausforderungen. Laut einer Gartner-Umfrage sind 61% der CEOs besorgt über Cybersecurity-Bedrohungen und 85% glauben, dass Cybersecurity für das Unternehmenswachstum entscheidend ist. Ohne eine angemessene Cybersicherheitsstrategie sind Unternehmen erheblichen Risiken ausgesetzt.

Kostensparende Strategien, die tatsächlich funktionieren

Mehr als 90% der Führungskräfte erkennen die entscheidende Rolle der KI bei der Kostensenkung in den nächsten 18 Monaten. Doch die Umsetzung von Produktivitätsgewinnen in einen dauerhaften finanziellen Wert kann schwierig sein.

Hand aufs Herz: Nicht alle Transformationsinitiativen führen zu Einsparungen. Erfolg erfordert eine durchdachte Strategie, nicht nur den Einsatz von Technologie.

Automatisierung für Prozesseffizienz nutzen

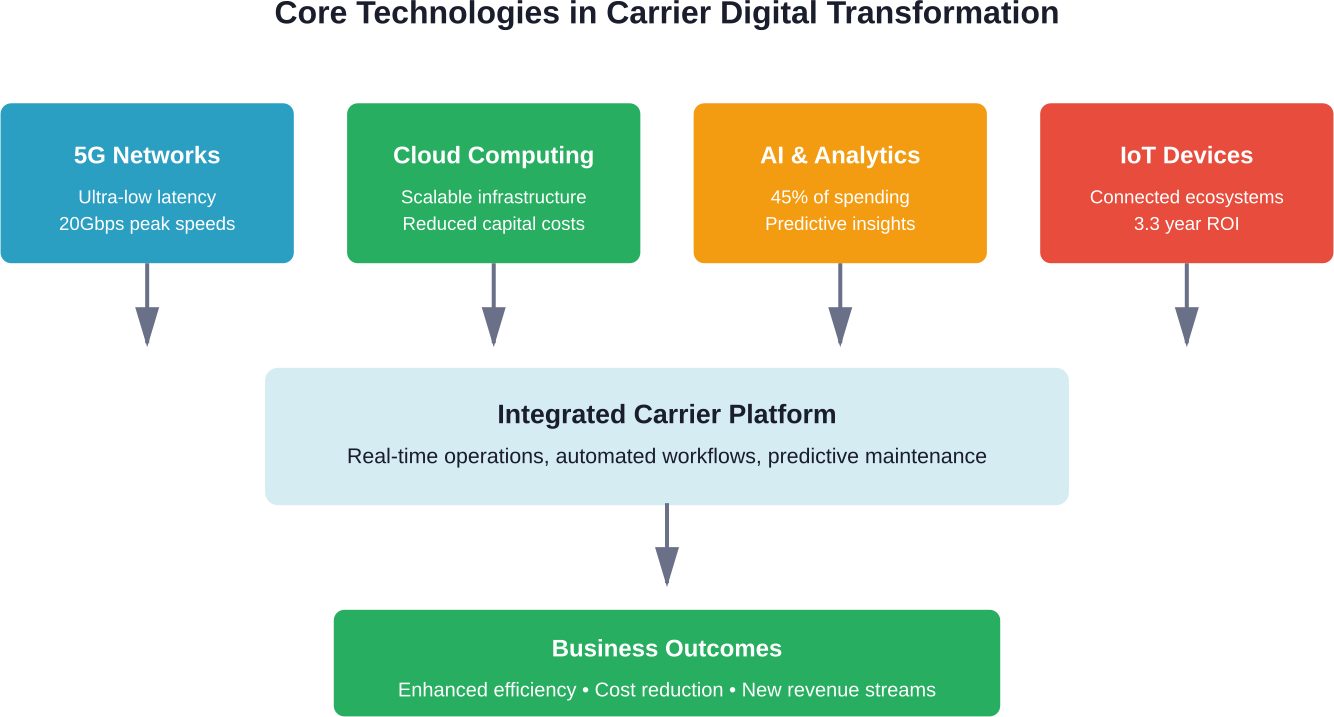

Die Automatisierung ist einer der zuverlässigsten Mechanismen zur Kostenreduzierung. Wenn sie richtig umgesetzt wird, eliminiert sie sich wiederholende manuelle Aufgaben, reduziert Fehler und setzt Mitarbeiter für höherwertige Arbeiten frei.

Betrachten Sie die Marketingfunktionen. Unternehmen haben GenAI für die Entwicklung von Marketing-Inhalten - in erster Linie Texte und Bilder - für bestehende Kampagnen eingesetzt, wodurch die Kosten für die Produktion von Inhalten erheblich gesenkt und gleichzeitig die Qualitätsstandards beibehalten wurden.

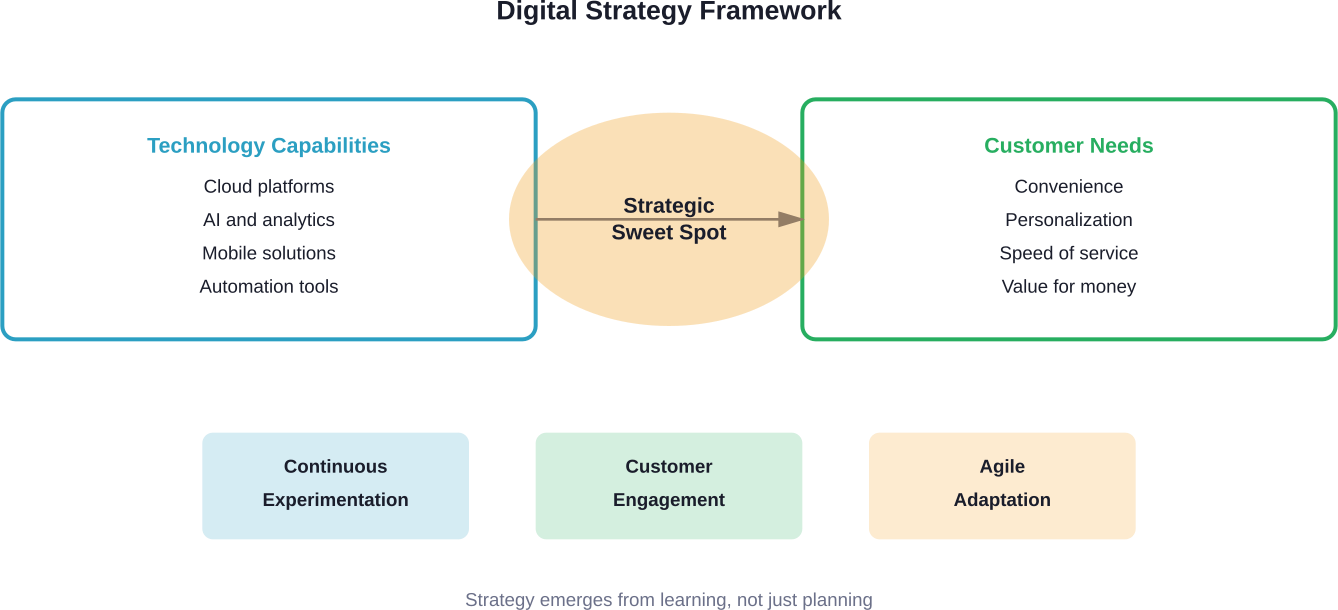

Der Schlüssel liegt nicht nur im Einsatz von Automatisierungstools. Es geht darum, herauszufinden, welche Prozesse das größte Volumen an sich wiederholender Arbeit und die meisten Fehler verursachen. Diese stellen den Sweet Spot für den ROI der Automatisierung dar.

Cloud-Migration zur Senkung der Infrastrukturkosten

Cloud Computing ermöglicht weiterhin erhebliche betriebliche Einsparungen, da die Kosten für die Infrastruktur vor Ort entfallen, der Wartungsaufwand reduziert wird und eine flexiblere Skalierung möglich ist.

Unternehmen können ihre Infrastrukturkosten senken, indem sie auf teure Rechenzentren, Hardwareverpflichtungen und einen hohen Personalbedarf im IT-Bereich verzichten. Cloud-Anbieter kümmern sich um Wartung, Sicherheitsaktualisierungen und Kapazitätsplanung.

Allerdings können die Cloud-Kosten ohne eine angemessene Governance in die Höhe schnellen. Erfolgreiche Unternehmen führen eine strenge Überwachung durch, optimieren die Ressourcenzuweisung und legen klare Richtlinien für Nutzung und Ausgaben fest.

AI-Implementierung richtig gemacht

Hier wird es interessant. KI bietet ein enormes Kosteneinsparungspotenzial, aber die Entwicklung zu einem KI-fähigen Unternehmen ist ein langfristiges Engagement, das alle Unternehmensbereiche betrifft.

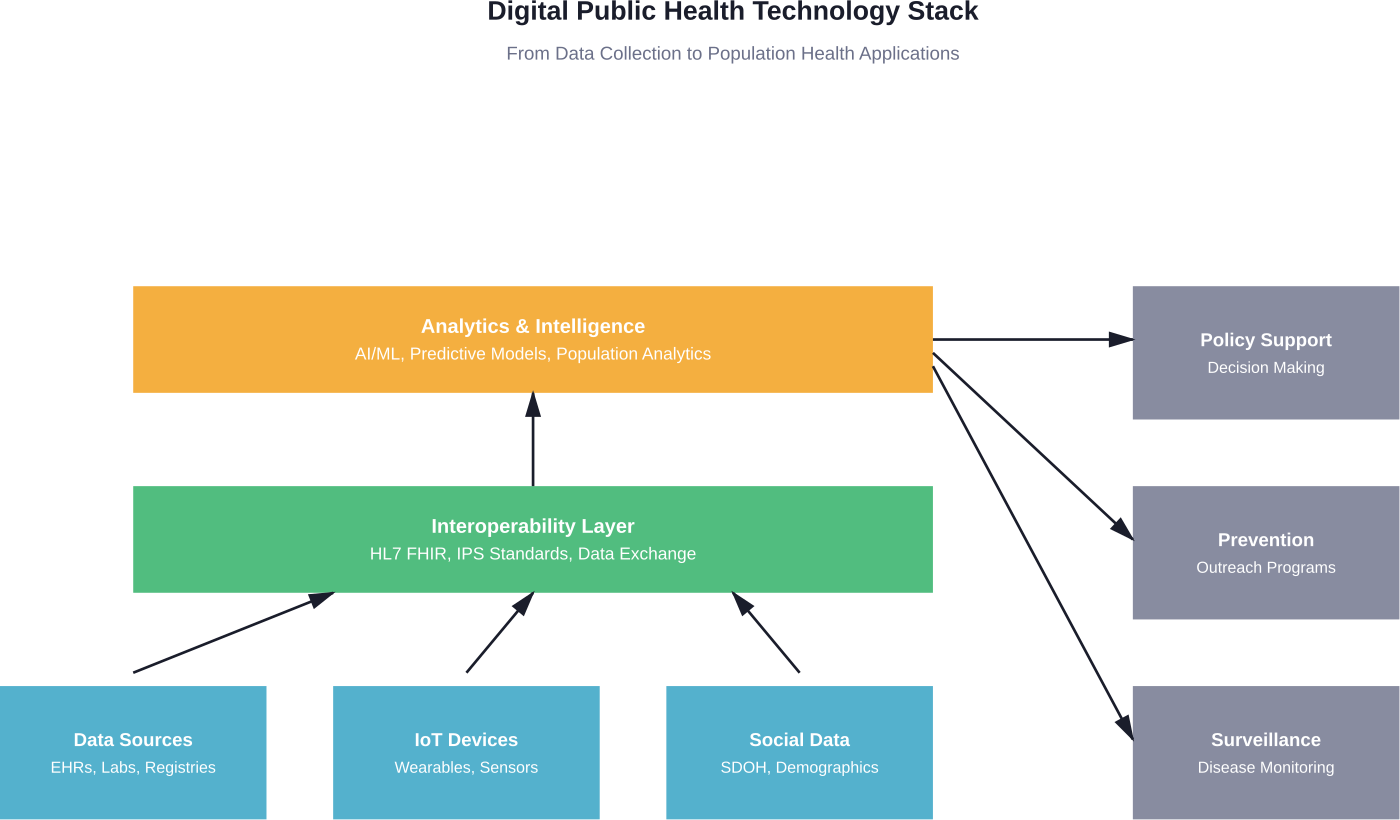

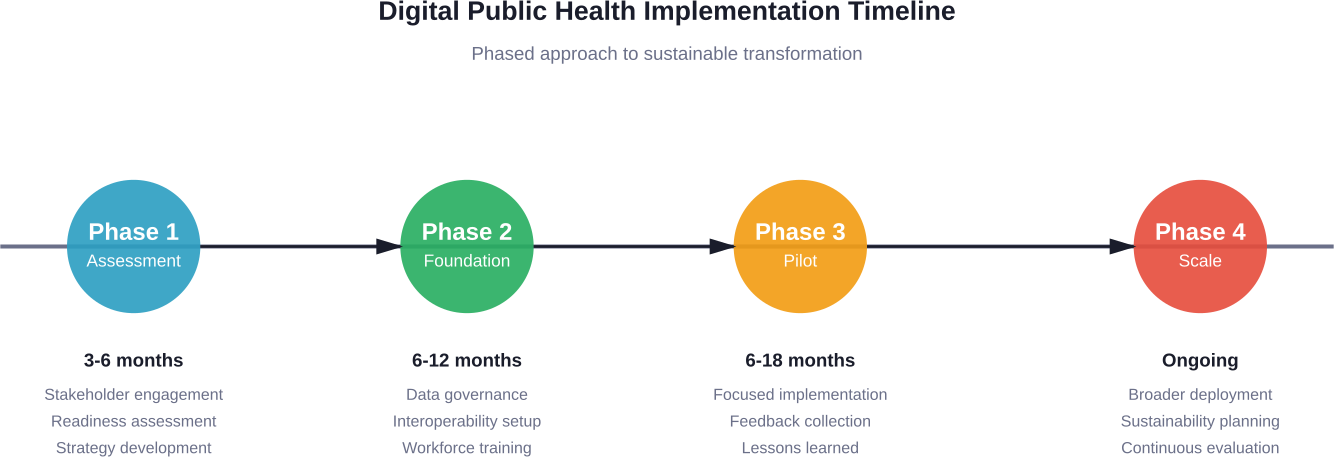

Der Gesundheitssektor hinkt bei der Entwicklung der robusten digitalen Gesundheitsinfrastruktur, die für die vollständige Umsetzung von Innovationen erforderlich ist, weiterhin hinterher, wodurch potenzielle Gewinne in den Bereichen Effizienz, Zugang, Prävention, Diagnose, Behandlung, Entdeckung und öffentliche Gesundheit eingeschränkt werden.

Unternehmen, die KI erfolgreich zur Kostentransformation einsetzen, konzentrieren sich auf drei entscheidende Faktoren:

- Erstens messen sie rigoros den Wert und die Kostensenkungsziele. Vage Versprechungen von “verbesserter Effizienz” reichen nicht aus. Erfolgreiche Initiativen legen vor der Einführung spezifische, messbare Ziele fest und verfolgen die Fortschritte unerbittlich.

- Zweitens werden Funktionen und Prozesse von Grund auf umgestaltet. KI einfach über bestehende ineffiziente Prozesse zu legen, funktioniert nicht. Unternehmen müssen ihre Arbeitsabläufe völlig neu überdenken und sie so gestalten, dass sie sich an dem orientieren, was KI am besten kann.

- Drittens setzen sie KI in Verbindung mit traditionellen Kostensenkungsmaßnahmen ein. Mit Technologie allein lassen sich keine Kosten senken. Sie muss mit Prozessoptimierung, organisatorischer Umstrukturierung und kulturellem Wandel einhergehen.

Beispiele für Kostensenkungen in der Praxis

Die Theorie zählt weniger als die Praxis. Was funktioniert in der realen Welt?

Erstellung von Marketing-Inhalten

Ein Unternehmen konzentrierte sich auf die Verwendung von GenAI zur Entwicklung von Marketinginhalten für bestehende Kampagnen. Nachdem das Unternehmen überprüft hatte, dass die Ergebnisse zuverlässig waren, ging es dazu über, erfolgreiche Programme zu skalieren.

Mit diesem Ansatz konnten die Kosten für die Produktion von Inhalten erheblich gesenkt und gleichzeitig die Markenstandards und Qualitätsanforderungen beibehalten werden. Der Schlüssel? Erst die Überprüfung, dann die Skalierung. Zu viele Unternehmen überstürzen die Skalierung, bevor sie die Qualität bestätigt haben.

Automatisierung von Betriebsabläufen

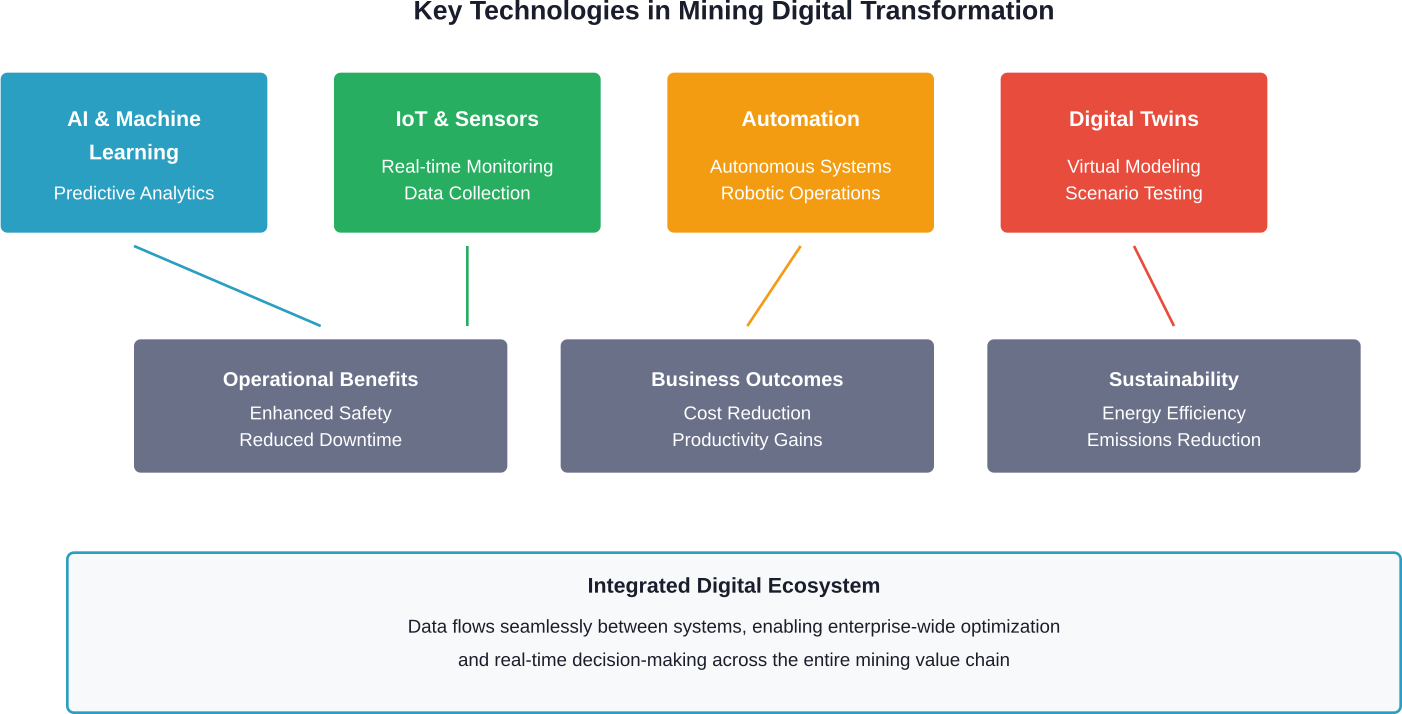

In den Bereichen Produktion und Logistik lassen sich durch die Digitalisierung besonders starke Kostensenkungen erzielen. Eine automatisierte Bestandsverwaltung senkt die Lagerkosten. Vorausschauende Wartung verhindert teure Anlagenausfälle. Routenoptimierung senkt die Transportkosten.

Dies sind keine glamourösen Anwendungsfälle, aber sie führen zu messbaren, nachhaltigen Kosteneinsparungen, die sich direkt auf das Endergebnis auswirken.

Straffung der Verwaltungsfunktionen

Back-Office-Funktionen wie Personal-, Finanz- und Beschaffungswesen bergen oft erhebliche Möglichkeiten zur Kostenreduzierung. Durch die Automatisierung entfällt die manuelle Dateneingabe, die Bearbeitungszeit wird verkürzt und Fehler, die teure Folgeprobleme verursachen, werden minimiert.

Wo die digitale Transformation scheitert

Das Verständnis von Misserfolgsmustern ist ebenso wichtig wie das Wissen um Erfolgsmuster.

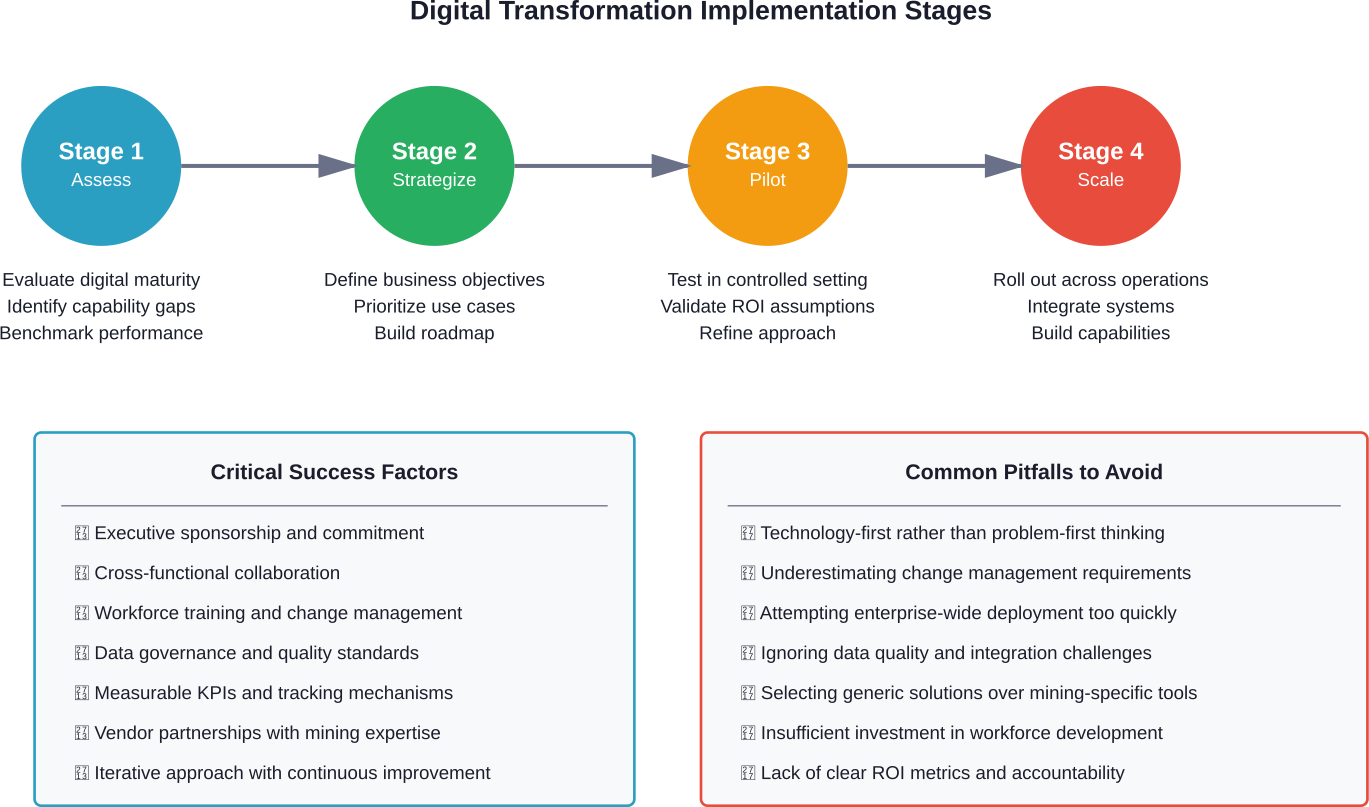

Skalierung ohne Validierung

Der häufigste Fehler? Die Skalierung von Initiativen, bevor überprüft wurde, ob sie tatsächlich funktionieren und einen Nutzen bringen.

Pilotprojekte sind in kontrollierten Umgebungen mit entsprechenden Ressourcen und Aufmerksamkeit erfolgreich. Doch bei der Skalierung treten versteckte Probleme zutage: Integrationsprobleme, Leistungseinbußen, Widerstand der Benutzer und Kosteneskalation.

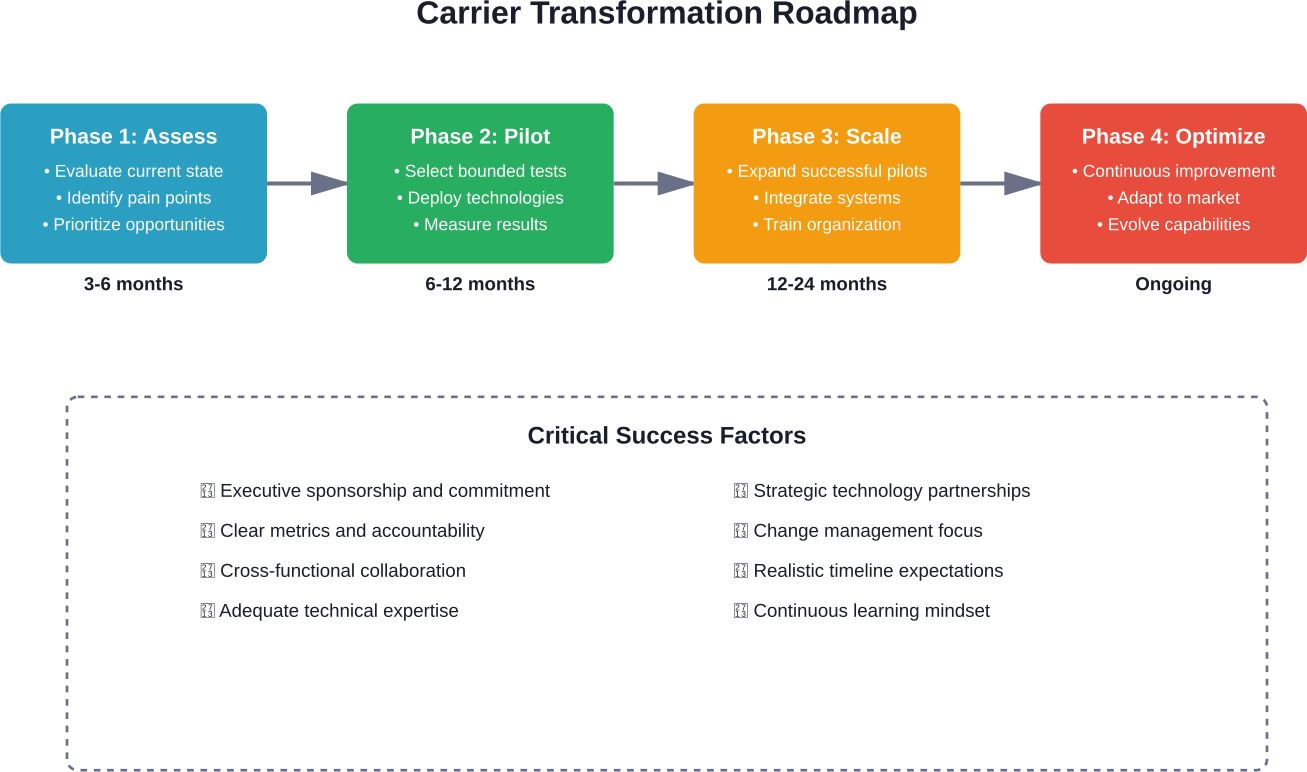

Intelligente Organisationen führen ein aggressives Pilotprojekt durch, skalieren aber vorsichtig und validieren die Ergebnisse in jeder Phase, bevor sie weiter expandieren.

Management von Veränderungen ignorieren

Die Einführung von Technologien ohne Änderungsmanagement scheitert immer wieder. Die Mitarbeiter kehren zu alten Verfahren zurück. Neue Systeme bleiben ungenutzt. Investitionen bringen keinen Nutzen.

Erfolgreiche Umstellungen investieren viel in Schulung, Kommunikation und Unterstützung. Sie beziehen die betroffenen Mitarbeiter frühzeitig ein, gehen proaktiv auf Bedenken ein und bieten während der Umstellung kontinuierliche Unterstützung.

Unterschätzung der Integrationskomplexität

Moderne Unternehmen arbeiten mit Dutzenden oder Hunderten von miteinander verbundenen Systemen. Das Hinzufügen neuer Technologien bedeutet die Integration in die bestehende Infrastruktur - und genau hier explodiert die Komplexität.

Die Datenformate stimmen nicht überein. Es gibt keine APIs. Sicherheitsanforderungen widersprechen sich. Leistungsengpässe tauchen auf. Was in Demos einfach erschien, wird zu einem monatelangen Integrationsalbtraum.

Unternehmen, die erfolgreich sind, planen die Kosten, den Zeitaufwand und die Komplexität der Integration von Anfang an mit ein, anstatt sie mitten im Projekt zu entdecken.

| Häufiger Fehlermodus | Auswirkungen auf die Kosten | Strategie der Prävention |

|---|---|---|

| Vorzeitige Skalierung | 2-3fache Kostenüberschreitung | Vor der Erweiterung gründlich validieren |

| Schlechtes Änderungsmanagement | 50-70% Wertverlust | Investitionen in Ausbildung und Unterstützung |

| Unterschätzung der Integration | 40-60% Verzögerungen in der Zeitachse | Budget 30-40% für Integration |

| Unzureichende Cybersicherheit | Risiko von katastrophalen Verlusten | Sicherheit vom ersten Tag an aufbauen |

Messung des ROI der digitalen Transformation

Die Kosten sind nach wie vor eine wichtige strategische Priorität für Unternehmen, die neue Technologien einsetzen. Die Messung der tatsächlichen Investitionsrendite erfordert jedoch Disziplin und Klarheit.

Klare Metriken definieren

Vage Ziele wie “Effizienzsteigerung” funktionieren nicht. Erfolgreiche Unternehmen legen konkrete, messbare Ziele fest: Verkürzung der Bearbeitungszeit um 40%, Senkung der Fehlerquote um 60%, Senkung der Betriebskosten um $2 Millionen jährlich.

Diese konkreten Ziele ermöglichen die Nachverfolgung, Rechenschaftspflicht und Kurskorrektur, wenn die Ergebnisse nicht eintreten.

Verfolgung von harten und weichen Einsparungen

Harte Einsparungen - direkte Kostensenkungen - lassen sich leicht nachverfolgen. Weiche Einsparungen - verbesserte Produktivität, bessere Entscheidungsfindung, höhere Kundenzufriedenheit - sind schwieriger zu quantifizieren, aber genauso wichtig.

Unternehmen brauchen Rahmenbedingungen, um beides zu erfassen. Die durch Automatisierung gewonnene Zeit ist nur dann wertvoll, wenn sie für höherwertige Aktivitäten genutzt wird. Bessere Daten verbessern die Ergebnisse nur, wenn sich Entscheidungen tatsächlich ändern.

Langfristiger Wert vs. kurzfristige Kosten

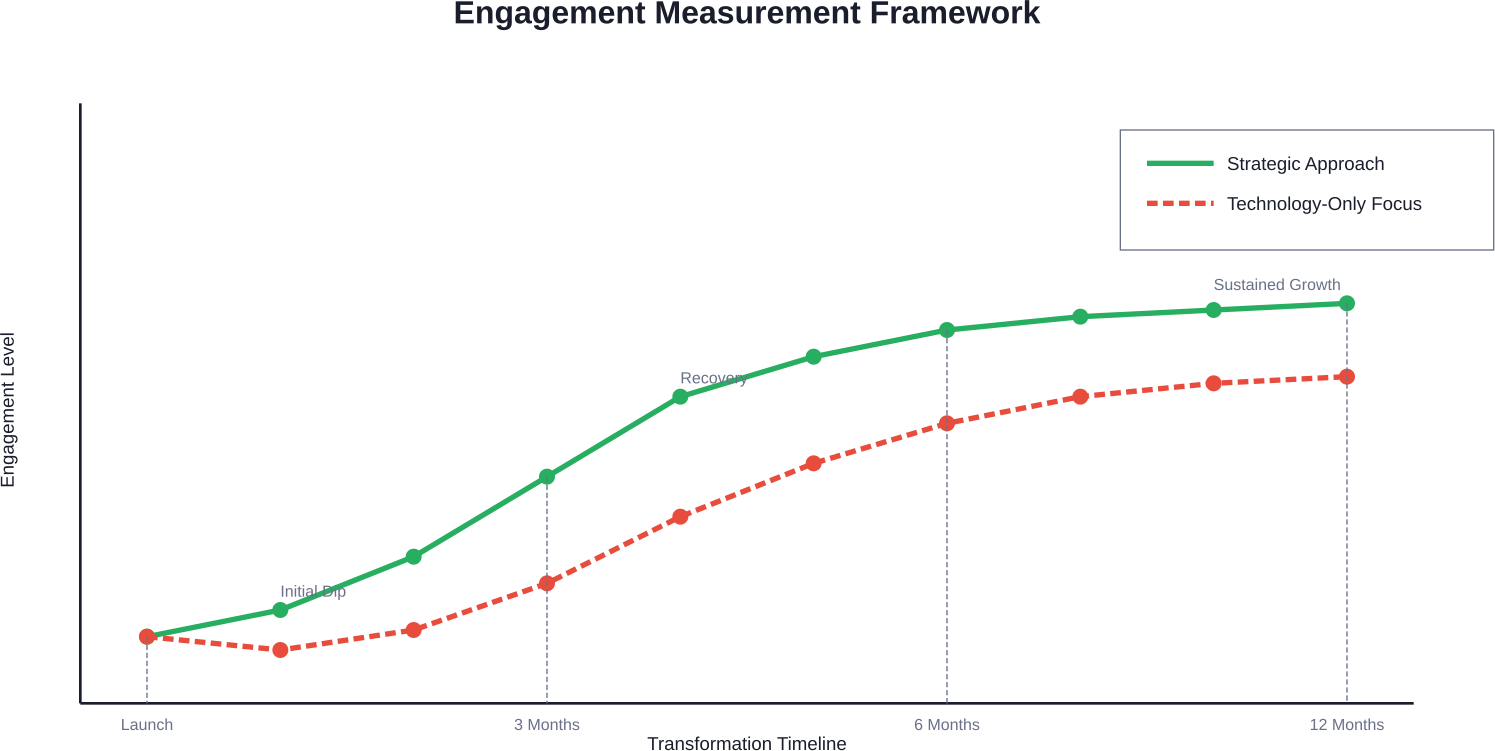

Investitionen in die digitale Transformation zeigen anfangs oft einen negativen ROI. Die Implementierungskosten schlagen sofort zu Buche, während sich die Vorteile erst mit der Zeit einstellen.

Unternehmen brauchen Geduld und das Engagement der Führungskräfte, um die anfängliche Investitionsphase zu überstehen. Ein zu früher Rückzug bedeutet, dass man die Kosten für die Umstellung zahlt, ohne die Vorteile zu nutzen.

Allerdings leiden Initiativen, die nach 12-18 Monaten keine Fortschritte zeigen, wahrscheinlich an grundlegenden Problemen, die eine Neubewertung erfordern.

Aufbau einer kostenbewussten Transformationsstrategie

Wie sollten Unternehmen also an die digitale Transformation herangehen, um die Kosteneinsparungen zu maximieren und gleichzeitig die Risiken zu minimieren?

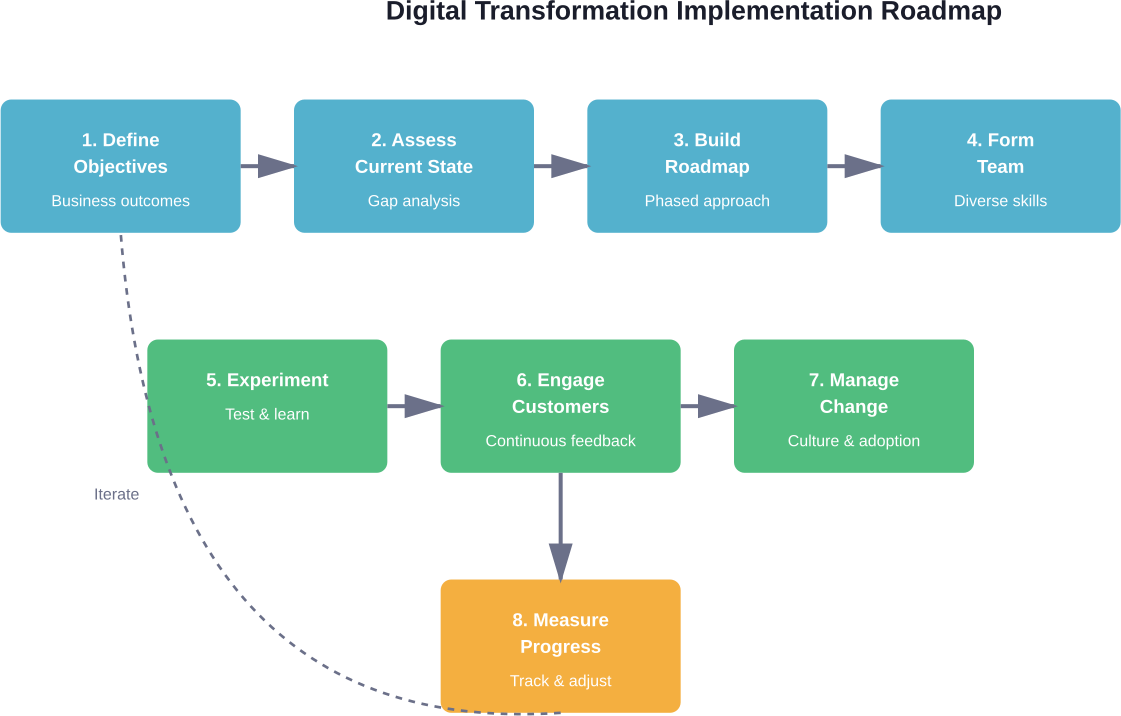

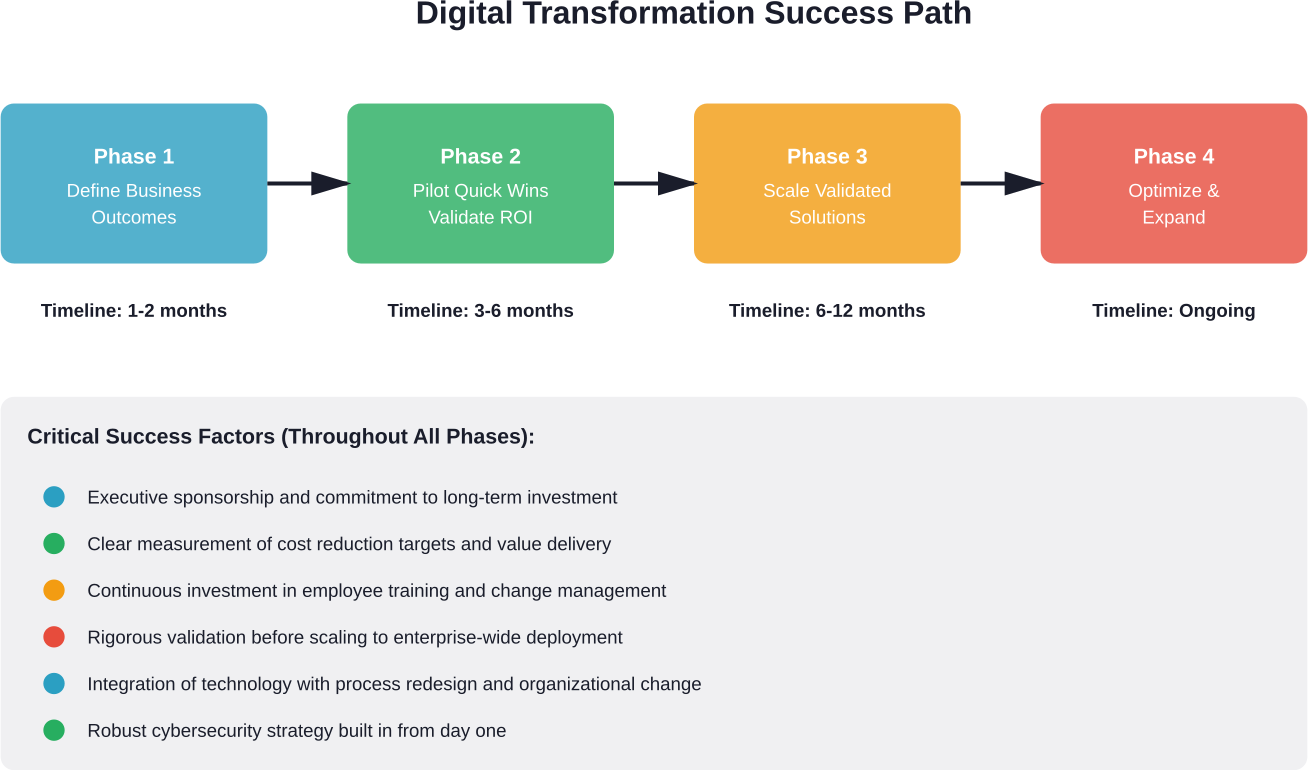

Beginnen Sie mit Geschäftsergebnissen

Technologie sollte den Geschäftszielen dienen, nicht umgekehrt. Unternehmen, die mit “wir brauchen KI” oder “wir sollten in die Cloud wechseln” beginnen, scheitern oft.

Bessere Herangehensweise: Bestimmen Sie spezifische Unternehmensprobleme oder -chancen und bewerten Sie dann, welche Technologien diese effektiv lösen könnten. So wird sichergestellt, dass Technologieinvestitionen direkt mit der Wertschöpfung verbunden sind.

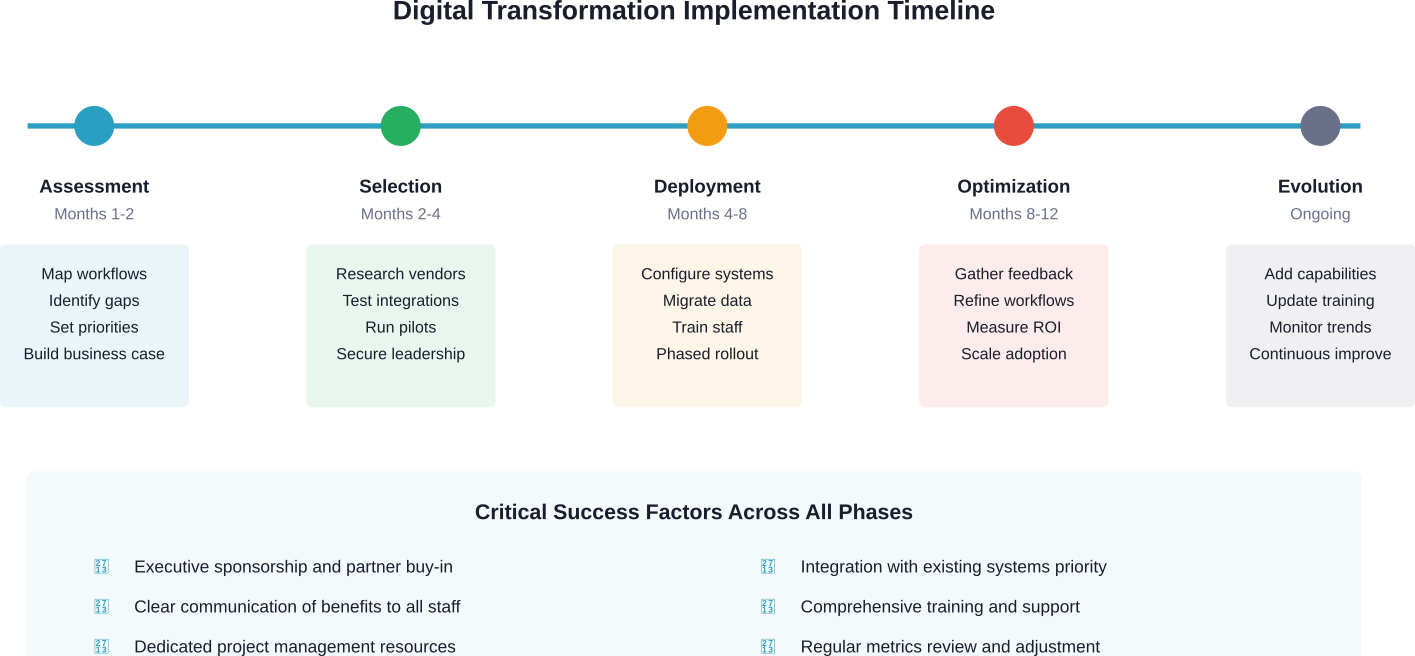

Priorisieren Sie Quick Wins

Der Aufbau einer Dynamik ist wichtig. Frühe Erfolge führen zu einer stärkeren Akzeptanz in der Organisation, zeigen den Wert des Projekts und generieren Mittel für größere Initiativen.

Intelligente Organisationen ermitteln Möglichkeiten für erste Projekte mit großer Wirkung und geringer Komplexität. Der Erfolg schafft Glaubwürdigkeit und Unterstützung für spätere ehrgeizigere Umgestaltungen.

Strategisch bauen oder kaufen

Nicht alles erfordert eine individuelle Entwicklung. Kommerzielle Lösungen eignen sich gut für Standardgeschäftsprozesse. Eine kundenspezifische Entwicklung ist sinnvoll für einzigartige Wettbewerbsvorteile oder hochspezialisierte Anforderungen.

Der Kostenunterschied ist erheblich. Kommerzielle Software kostet in der Regel $50.000-$250.000 für die Bereitstellung, während die kundenspezifische Entwicklung in der Regel Investitionen von mehreren hunderttausend Dollar und mehr erfordert.

Investitionen in Talent und Ausbildung

Technologie ohne qualifizierte Mitarbeiter liefert keinen Wert. Unternehmen brauchen Mitarbeiter, die neue Tools verstehen, ihre Nutzung optimieren und Prozesse kontinuierlich verbessern können.

Schulungen gehören zu den Investitionen mit dem höchsten ROI bei Transformationsinitiativen. Mitarbeiter, die Systeme vollständig verstehen, schaffen weitaus mehr Wert als diejenigen, die gerade genug lernen, um zurechtzukommen.

Betriebskosten senken mit einem klaren Plan für die digitale Transformation

Viele Unternehmen beginnen mit der digitalen Transformation, weil die Kosten schneller steigen, als sich das Unternehmen anpassen kann. Veraltete Systeme müssen ständig gewartet werden, manuelle Prozesse verlangsamen die Teams, und unverbundene Tools verursachen unnötigen Aufwand. Anstatt einfach nur neue Software hinzuzufügen, sollte das Ziel darin bestehen, Abläufe zu vereinfachen, sich wiederholende Arbeiten zu automatisieren und Systeme zu modernisieren, die Ressourcen binden.

An dieser Stelle hilft A-listware den Unternehmen oft weiter. Ihr Team überprüft die bestehende Infrastruktur, identifiziert ineffiziente Arbeitsabläufe und entwickelt praktische Lösungen wie Systemintegrationen, Cloud-Migrationen oder kundenspezifische Software, die betriebliche Reibungsverluste reduziert. Der Schwerpunkt liegt dabei nicht auf dem Hinzufügen weiterer Tools, sondern auf der Beseitigung von Systemen, die in den einzelnen Abteilungen die Kosten in die Höhe treiben.

Wenn Ihr Ziel für die digitale Transformation klar ist - niedrigere Betriebskosten und ein schlankeres Unternehmen - kann die Zusammenarbeit mit einem erfahrenen Ingenieurteam den Weg verkürzen. Kontakt A-listware um Systeme zu modernisieren, Routinearbeiten zu automatisieren und technische Engpässe zu beseitigen, die die Kosten in die Höhe treiben.

Cybersecurity als Kostenschutz

Die digitale Transformation erweitert die Angriffsflächen. Mehr vernetzte Systeme bedeuten mehr Angriffspunkte. Mehr Cloud-Dienste bedeuten mehr potenzielle Sicherheitslücken.

Unternehmen weiten ihre Bemühungen um digitale Transformation, Cloud Computing, hybrides Arbeiten und KI-Technologien aus - doch dieselben Technologien schaffen auch neue Risiken.

Bei der Cybersicherheit geht es nicht nur darum, Sicherheitsverletzungen zu verhindern. Es geht auch darum, die Kosteneinsparungen zu schützen, die die Transformation mit sich bringt. Ein einziger signifikanter Verstoß kann jahrelange Effizienzgewinne zunichte machen.

Laut einer Studie sind 85% der CEOs der Meinung, dass die Cybersicherheit für das Unternehmenswachstum entscheidend ist. Ohne eine angemessene Cybersicherheitsstrategie, die von Anfang an in Transformationsinitiativen integriert ist, sind Unternehmen Risiken ausgesetzt, die die potenziellen Einsparungen in den Schatten stellen.

Branchenspezifische Überlegungen

Strategien für die digitale Transformation müssen auf den jeweiligen Branchenkontext zugeschnitten werden.

Gesundheitswesen

Der Gesundheitssektor hinkt bei der Entwicklung einer robusten digitalen Gesundheitsinfrastruktur, die für die vollständige Umsetzung von Innovationen erforderlich ist, weiterhin hinterher. Dies schränkt die potenziellen Vorteile in Bezug auf Effizienz, Zugang, Prävention, Diagnose, Behandlung, Entdeckung und Ergebnisse für die öffentliche Gesundheit ein.

Organisationen des Gesundheitswesens stehen vor besonderen Herausforderungen: Einhaltung von Vorschriften, Schutz der Privatsphäre von Patienten, Altsysteme und fragmentierte Daten. Transformationsinitiativen müssen diese Beschränkungen überwinden und gleichzeitig Kosteneinsparungen erzielen.

Herstellung

In der Fertigung ist der ROI durch die Digitalisierung besonders hoch. IoT-Sensoren, vorausschauende Wartung, automatisierte Qualitätskontrolle und optimierte Produktionsplanung bringen messbare Kosteneinsparungen.

Die digitale Transformation der Lieferkette bietet zusätzliche Chancen. Bessere Bedarfsprognosen senken die Lagerkosten. Eine optimierte Logistik senkt die Transportkosten. Transparenz in Echtzeit verhindert kostspielige Unterbrechungen.

Finanzdienstleistungen

Finanzinstitute sind bei der digitalen Transformation oft führend. Automatisiertes Underwriting, algorithmischer Handel, Betrugserkennung und die Automatisierung des Kundendienstes senken die Betriebskosten erheblich.

Die Integration von Altsystemen bleibt jedoch eine große Herausforderung. Banken und Versicherer arbeiten mit jahrzehntealten Kernsystemen, die sich einer Modernisierung widersetzen.

Häufige Fragen zu Kosteneinsparungen bei der digitalen Transformation

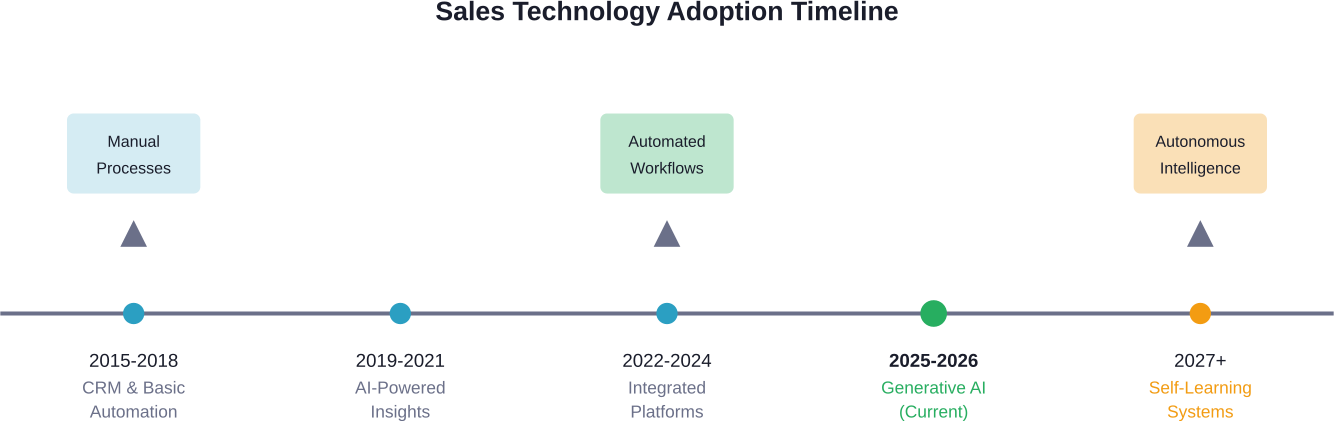

- Wie sieht der typische ROI-Zeitplan für die digitale Transformation aus?

Die meisten Unternehmen sehen die ersten Gewinne innerhalb von 12 bis 18 Monaten, wobei der volle ROI in 3 bis 5 Jahren erreicht wird. Quick Wins bei der Automatisierung und der Cloud-Migration können schneller Wert schaffen, während umfassende Unternehmensumwandlungen einen längeren Zeitrahmen benötigen. Die 25% der KI-Initiativen, die den erwarteten ROI liefern, zeigen in der Regel innerhalb des ersten Jahres messbare Ergebnisse, aber die Skalierung zu einer unternehmensweiten Übernahme dauert wesentlich länger.

- Wie viel sollten Unternehmen für die digitale Transformation einplanen?

Mittelständische Unternehmen sollten je nach Umfang mit Kosten zwischen $250.000 und $5 Millionen rechnen. Kleinere Digitalisierungsprojekte, die auf bestimmte Geschäftsbereiche abzielen, kosten $50.000 bis $250.000. Für Integration, Schulung und unerwartete Komplikationen sollten Unternehmen zusätzlich 30-40% über die ursprünglichen Schätzungen hinaus einplanen.

- In welchen Bereichen lassen sich die schnellsten Kosteneinsparungen erzielen?

Die Automatisierung von sich wiederholenden manuellen Prozessen bringt in der Regel die schnellsten Ergebnisse. Bei der Rechnungsverarbeitung, der Kostenberichterstattung, der Dateneingabe und der Automatisierung des Kundendienstes lassen sich innerhalb von 3-6 Monaten messbare Einsparungen erzielen. Die Cloud-Migration für die Infrastruktur liefert ebenfalls relativ schnelle Gewinne, da Hardwarekosten entfallen und der IT-Overhead reduziert wird. Die Erstellung von Marketing-Inhalten mithilfe von KI hat bei den jüngsten Implementierungen eine rasche Kostenreduzierung gezeigt.

- Warum gelingt es so vielen Initiativen zur digitalen Transformation nicht, einen ROI zu erzielen?

Nach Untersuchungen von IBM erreichen nur 25% der KI-Initiativen den erwarteten ROI und nur 16% lassen sich unternehmensweit skalieren. Zu den häufigen Fehlern gehören die Skalierung vor der Validierung der Ergebnisse, die Unterschätzung der Integrationskomplexität, ein unzureichendes Änderungsmanagement und die Konzentration auf die Technologiebereitstellung statt auf die Prozessumstellung. Unternehmen, die scheitern, behandeln die Transformation in der Regel als IT-Projekt und nicht als Geschäftsumwandlung, die organisatorische Veränderungen erfordert.

- Wie können Unternehmen Kostenüberschreitungen vermeiden?

Beginnen Sie mit klaren, messbaren Zielen und einer rigorosen Kostenverfolgung vom ersten Tag an. Planen Sie die Integrationskosten in die anfänglichen Budgets ein - behandeln Sie sie nicht als unerwartete Zusatzkosten. Führen Sie vor der Skalierung ein gründliches Pilotprojekt durch. Investieren Sie in das Änderungsmanagement, um die Akzeptanz und Wertrealisierung sicherzustellen. Planen Sie 30-40% an Kosten ein, die über die ursprünglichen Schätzungen hinausgehen. Am wichtigsten ist, dass jede Phase den versprochenen Nutzen erbringt, bevor Sie zur nächsten Phase übergehen.

- Sollten Unternehmen individuelle Lösungen entwickeln oder kommerzielle Software kaufen?

Kommerzielle Software eignet sich gut für Standardgeschäftsprozesse und kostet wesentlich weniger - in der Regel $50.000 bis $250.000 für die Bereitstellung. Die kundenspezifische Entwicklung ist für einzigartige Wettbewerbsvorteile oder hochspezialisierte Anforderungen sinnvoll, erfordert aber in der Regel Investitionen von mehreren hunderttausend Dollar und mehr. Die meisten erfolgreichen Transformationen verwenden einen hybriden Ansatz: kommerzielle Lösungen für Standardfunktionen, kundenspezifische Entwicklung nur dort, wo es auf Differenzierung ankommt.

- Wie wichtig ist die Cybersicherheit bei Initiativen zur Kosteneinsparung?

Kritisch. Eine Gartner-Umfrage ergab, dass 61% der CEOs über Cybersecurity-Bedrohungen besorgt sind und 85% glauben, dass sie für das Unternehmenswachstum unerlässlich ist. Die digitale Transformation vergrößert die Angriffsflächen und schafft neue Schwachstellen. Ein einziger signifikanter Verstoß kann jahrelange Kosteneinsparungen zunichte machen. Unternehmen müssen die Cybersicherheit von Anfang an in ihre Transformationsinitiativen einbeziehen und dürfen sie nicht als nachträgliche Maßnahme hinzufügen. Die Kosten für eine angemessene Sicherheit sind weitaus geringer als die potenziellen Kosten einer Sicherheitsverletzung.

Der Weg nach vorn

Die digitale Transformation bietet ein erhebliches Kosteneinsparungspotenzial. Durch strategische Automatisierung, Cloud-Migration und den Einsatz von KI können Unternehmen ihre Betriebskosten um 20-40% senken.

Aber der Erfolg ist nicht garantiert. Die Daten zeigen, dass nur 25% der KI-Initiativen den erwarteten ROI liefern. Viele Unternehmen investieren Millionen, ohne einen nennenswerten Ertrag zu erzielen.

Was unterscheidet die Gewinner von den Verlierern? Drei kritische Faktoren tauchen immer wieder auf.

Erstens: Erfolgreiche Unternehmen messen unerbittlich. Sie legen vor der Einführung spezifische Kostensenkungsziele fest und verfolgen die Fortschritte rigoros. Vage Effizienzziele funktionieren nicht.

Zweitens werden die Prozesse grundlegend umgestaltet. Das einfache Hinzufügen von Technologie zu bestehenden ineffizienten Arbeitsabläufen bringt keinen Mehrwert. Unternehmen müssen die Art und Weise, wie Arbeit erledigt wird, neu gestalten.

Drittens verbinden sie Technologie mit organisatorischem Wandel. KI und Automatisierung funktionieren am besten zusammen mit Prozessoptimierung, Talententwicklung und kulturellem Wandel.

Die Unternehmen, die die größten Kosteneinsparungen erzielen, fangen klein an, validieren gründlich und skalieren vorsichtig. Sie investieren in Integration, Schulung und Änderungsmanagement. Sie bauen die Cybersicherheit vom ersten Tag an auf. Und sie halten das Engagement der Führungskräfte während des anfänglichen Investitionszeitraums aufrecht, bevor die Vorteile voll zum Tragen kommen.

Die digitale Transformation ist nicht billig. Aber für Unternehmen, die strategisch vorgehen, können die Kosteneinsparungen beträchtlich und über Jahre hinweg anhaltend sein.

Sind Sie bereit, eine Transformationsstrategie für Ihr Unternehmen zu entwickeln? Beginnen Sie mit der Identifizierung von Möglichkeiten mit hoher Wirkung und geringer Komplexität, bei denen Technologie sich wiederholende Arbeiten eliminieren oder Fehler reduzieren kann. Führen Sie eine Initiative mit klaren Kostensenkungszielen und strengen Messungen durch. Validieren Sie die Ergebnisse gründlich, bevor Sie die Initiative ausweiten. So beginnen nachhaltige Kosteneinsparungen.