Big-Data-Analytik hat den Ruf, teuer zu sein, und manchmal ist dieser Ruf auch berechtigt. Aber die wirklichen Kosten beziehen sich selten nur auf Tools, Cloud-Plattformen oder Dashboards. Es geht um alles, was sich dahinter verbirgt: Datenpipelines, Mitarbeiter, Infrastrukturentscheidungen und die ständigen Bemühungen, die Erkenntnisse mit den Veränderungen im Unternehmen in Einklang zu bringen.

Viele Unternehmen unterschätzen die Big-Data-Analytik, weil sie sie für eine einmalige Einrichtung halten. In Wirklichkeit handelt es sich um eine Betriebskapazität. Die Kosten wachsen oder schrumpfen, je nachdem, wie viele Daten Sie verarbeiten, wie schnell Sie Antworten benötigen und wie diszipliniert Sie mit dem Umfang umgehen.

In diesem Artikel wird aufgeschlüsselt, was Big Data Analytics tatsächlich kostet, warum die Preise so stark variieren und was Unternehmen bei der Planung ihrer Budgets häufig übersehen.

Wie hoch sind die Kosten für Big Data Analytics?

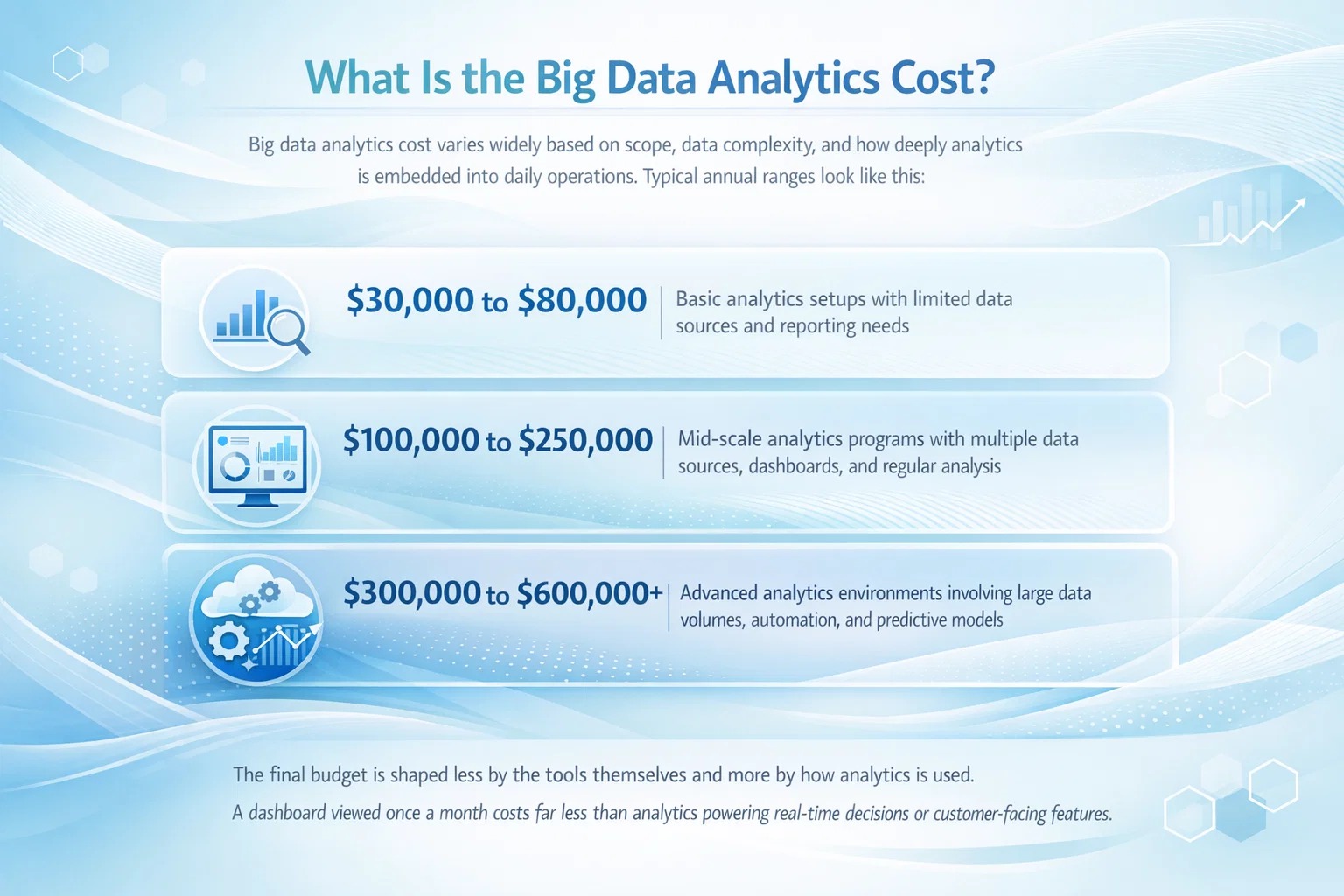

Die Kosten für Big-Data-Analysen variieren stark, je nach Umfang, Datenkomplexität und Einbettung der Analysen in die täglichen Abläufe. Typische jährliche Spannen sehen wie folgt aus:

- $30.000 bis $80.000 für einfache Analyseeinrichtungen mit begrenzten Datenquellen und Berichtsanforderungen

- $100.000 bis $250.000 für mittelgroße Analyseprogramme mit mehreren Datenquellen, Dashboards und regelmäßigen Analysen

- $300.000 bis $600.000+ für fortgeschrittene Analyseumgebungen mit großen Datenmengen, Automatisierung und Vorhersagemodellen

Das endgültige Budget wird weniger durch die Tools selbst als vielmehr durch die Art und Weise bestimmt, wie die Analysen eingesetzt werden. Ein Dashboard, das einmal im Monat betrachtet wird, kostet weit weniger als Analysen, die Echtzeitentscheidungen oder kundenorientierte Funktionen unterstützen.

Kostenspannen nach Analyseumfang

Anstatt die Analyse als einen einzigen Posten zu betrachten, ist es hilfreich, die Kosten nach Umfang und Verantwortung aufzuschlüsseln.

Grundlagen der Analytik

Bei diesen Konfigurationen liegt der Schwerpunkt eher auf der Transparenz als auf der Vorhersage. Sie werden häufig verwendet, um verstreute Daten an einem Ort zusammenzuführen und eine einheitliche Berichterstattung zu erstellen.

Typische Anwendungsfälle sind z. B. Dashboards für die Geschäftsleitung, betriebliche Berichte oder grundlegende Leistungsverfolgung.

Kostenbereich

$30.000 bis $80.000 pro Jahr

Diese Projekte umfassen in der Regel:

- Eine kleine Anzahl von Datenquellen

- Geplante Datenaktualisierungen

- Grundlegende Transformationen

- Standard-Dashboards und Berichte

Sie sind oft der erste Schritt zu einer ausgereifteren Analytik.

Mittelgroße Analyseprogramme

An diesem Punkt landen viele wachsende Unternehmen. Die Analytik wird stärker in den Betrieb integriert, und die Stakeholder erwarten Antworten und nicht nur Zahlen.

Kostenbereich

$100.000 bis $250.000 pro Jahr

Das sieht man oft:

- Mehrere interne und externe Datenquellen

- Benutzerdefinierte Metriken und KPIs

- Rollenbasierte Dashboards

- Regelmäßige Analysen und Einblicke

- Engagierte Mitarbeiter oder Partner für die Analyse

Die Kosten steigen, weil Zuverlässigkeit, Genauigkeit und Geschwindigkeit immer wichtiger werden.

Erweiterte und prädiktive Analytik

Auf dieser Ebene geht die Analytik über die Beschreibung des Geschehens hinaus und nimmt Einfluss auf das, was als nächstes geschehen soll.

Kostenbereich

$250.000 bis $600.000+ pro Jahr

Diese Programme umfassen in der Regel:

- Große oder schnell wachsende Datensätze

- Automatisierte Pipelines

- Maschinelles Lernen oder prädiktive Modelle

- Überwachung und Kontrolle der Datenqualität

- Integration in Produkte oder Kundenerlebnisse

Hier haben Architekturentscheidungen langfristige Auswirkungen auf Kosten und Flexibilität.

Geschäftskritische Analyseplattformen

Diese Umgebungen unterstützen den Umsatz, die Einhaltung von Vorschriften oder zentrale Geschäftsprozesse. Ausfallzeiten oder fehlerhafte Daten haben reale Konsequenzen.

Kostenbereich

$600.000 bis $1M+ jährlich

Sie erfordern in der Regel:

- Hohe Verfügbarkeit und Redundanz

- Strenge Zugangskontrolle und Auditing

- Datenaktualität nahezu in Echtzeit

- Ausgeprägte Governance und Dokumentation

- Kontinuierliche Optimierung

An diesem Punkt ist die Analytik eine Infrastruktur und kein Nebenprojekt.

A-listware: Aufbau von analytischen und technischen Teams, die tatsächlich funktionieren

Unter A-listware, helfen wir Unternehmen, Analysen und Software in etwas Praktisches und Nachhaltiges zu verwandeln. Wir haben gesehen, wie leicht die Kosten steigen, wenn die Teams nicht aufeinander abgestimmt sind, sich die Tools überschneiden oder die Analytik isoliert aufgebaut ist. Wir konzentrieren uns darauf, Teams und Systeme zu schaffen, die der tatsächlichen Arbeitsweise von Unternehmen entsprechen.

Wir binden erfahrene Ingenieure, Datenspezialisten und technische Leiter direkt in die Arbeitsabläufe unserer Kunden ein und fungieren so als Erweiterung des internen Teams. Ob es sich um einen einzelnen Experten oder eine funktionsübergreifende Einheit handelt, wir legen Wert auf eine reibungslose Zusammenarbeit, klare Verantwortlichkeiten und eine zuverlässige Lieferung vom ersten Tag an.

Schnelligkeit ist wichtig, aber auch Stabilität. In der Regel stellen wir innerhalb von 2 bis 4 Wochen produktionsbereite Teams zusammen, die aus einem geprüften Pool von über 100.000 Fachleuten stammen. Jeder Spezialist wird sowohl nach technischem Fachwissen als auch nach Kommunikationsfähigkeiten ausgewählt, denn Analytik liefert nur dann einen Mehrwert, wenn die Teams ihr vertrauen und sie nutzen können.

Wir helfen unseren Kunden auch, die langfristigen Kosten zu kontrollieren, indem wir die Architekturen schlank und die Teams skalierbar halten. Das bedeutet, dass wir die Tools sorgfältig auswählen, die Aktualität der Daten mit dem tatsächlichen Bedarf in Einklang bringen und Setups erstellen, die ohne ständige Nacharbeit wachsen können. Mit kontinuierlichem Support, SLA-gestütztem Engagement und 24/7-Verfügbarkeit bleiben wir auch lange nach der Einführung involviert, um sicherzustellen, dass die Systeme mit der Entwicklung des Unternehmens Schritt halten können.

Wenn Sie Analyse- und Entwicklungsteams brauchen, die sich reibungslos integrieren und verantwortungsvoll skalieren lassen, sind wir bereit, Ihnen zu helfen.

Warum die Kosten für Big Data Analytics so stark variieren

Die Kostenschätzungen für Analysen können um Hunderttausende von Dollar voneinander abweichen, selbst bei Unternehmen, die in derselben Branche tätig sind. Dies ist keine Übertreibung oder Verkaufsargumentation. Es spiegelt reale Unterschiede in Umfang, Verantwortung und Risiko wider.

Auf den ersten Blick können zwei Analyse-Setups ähnlich aussehen. Beide zeigen vielleicht Dashboards, Diagramme und KPIs. Doch was hinter den Kulissen geschieht, erzählt oft eine ganz andere Geschichte. Die größten Kostentreiber liegen in der Regel unter der Oberfläche, in Bereichen, die bei der frühen Planung leicht unterschätzt werden können.

Die Kosten für Big Data-Analysen werden von mehreren Schlüsselfaktoren beeinflusst:

- Die Anzahl und Zuverlässigkeit der Datenquellen. Jede Datenquelle erhöht die Komplexität. Saubere, gut dokumentierte Systeme sind kostengünstiger zu integrieren und zu warten als instabile oder schlecht strukturierte Systeme. Unzuverlässige Quellen erfordern Überwachung, erneute Versuche und manuelle Korrekturen, was die laufenden Kosten erhöht.

- Datenvolumen und Wachstumsrate. Die Analysekosten steigen mit den Daten. Mit wachsendem Volumen steigen auch die Kosten für Speicherung, Verarbeitung und Abfrage. Ein schnelles Wachstum kann auch dazu führen, dass die Architektur früher als erwartet geändert werden muss, was zu zusätzlichen Investitionen führt.

- Anforderungen an die Aktualität der Daten. Tägliche oder wöchentliche Aktualisierungen sind weitaus kostengünstiger zu unterstützen als Analysen nahezu in Echtzeit. Schnellere Daten bedeuten eine höhere Rechennutzung, engere SLAs und ein höheres Betriebsrisiko, wenn Pipelines ausfallen.

- Die Komplexität der Geschäftslogik. Einfache Metriken sind leicht zu berechnen. Komplexe Metriken, die mehrere Systeme, Randfälle und Geschäftsregeln kombinieren, erfordern mehr Entwicklung, Tests und laufende Wartung.

- Die Anzahl der Zielgruppen, die Einblicke konsumieren. Die Unterstützung eines internen Teams unterscheidet sich von der Unterstützung von Führungskräften, Betriebsabläufen, Marketing und externen Benutzern. Jede Zielgruppe benötigt oft ihre eigenen Definitionen, Ansichten und Zugriffskontrollen, was zusätzliche Kosten verursacht.

- Unabhängig davon, ob es sich um interne oder kundenorientierte Analysen handelt. Interne Analysen können gelegentliche Verzögerungen oder Unzulänglichkeiten verkraften. Kundenorientierte Analysen können dies in der Regel nicht. Höhere Genauigkeit, stärkere Sicherheit und bessere Leistung erhöhen sowohl die Entwicklungs- als auch die Betriebskosten.

Zwei Analyse-Setups können in einer Demo fast identisch aussehen, sich aber in der Produktion sehr unterschiedlich verhalten. Die eine kann mit minimaler Wartung in aller Ruhe Entscheidungen unterstützen, während die andere ständige Aufmerksamkeit erfordert, um genau, schnell und zuverlässig zu bleiben. Dieser Unterschied ist der Grund für die meisten Kostenunterschiede.

Die drei wichtigsten Kostenblöcke in der Analytik

Die meisten Analysebudgets lassen sich in drei große Kategorien einteilen. Wenn Teams die Analysekosten unterschätzen, liegt das meist daran, dass einer dieser Bereiche übersehen oder als zweitrangig behandelt wird. In Wirklichkeit arbeiten alle drei Bereiche zusammen, und das Ignorieren eines dieser Bereiche führt zu einer unvollständigen Planung.

Menschen

Der größte und beständigste Kostenfaktor bei der Analyse ist der Mensch. Selbst in hoch automatisierten Umgebungen läuft die Analyse nicht allein über Tools. Es werden qualifizierte Fachleute benötigt, um Pipelines zu entwerfen, Metriken zu definieren, Ergebnisse zu interpretieren und Systeme am Laufen zu halten, wenn sich Daten und Geschäftsanforderungen ändern.

Dazu gehören Dateningenieure, die Datenpipelines aufbauen und pflegen, Analysten, die Metriken definieren und Geschäftsfragen beantworten, Datenwissenschaftler, die Modelle entwickeln, Plattform- oder DevOps-Ingenieure, die die Infrastruktur unterstützen, und Produkt- oder Analysemanager, die die Prioritäten koordinieren. Selbst kleine Teams werden teuer, wenn Gehälter, Sozialleistungen, Einarbeitungszeit und Mitarbeiterbindung berücksichtigt werden.

Technologie

Die Technologiekosten sind sichtbarer als die Personalkosten, aber sie sind auch variabler. Diese Ausgaben umfassen in der Regel Data Warehouses und Speicher, Tools für die Datenaufnahme und -umwandlung, Business Intelligence und Visualisierungsplattformen, Infrastruktur für maschinelles Lernen sowie Überwachungs- und Sicherheitstools.

Viele moderne Analyseplattformen verwenden verbrauchsabhängige Preise. Anstatt pro Benutzer zu bezahlen, zahlen Unternehmen auf der Grundlage der Datenmenge, die sie speichern, verarbeiten oder abfragen. Das macht die Kosten flexibel, aber auch schwieriger vorhersehbar, wenn die Nutzung schneller als erwartet zunimmt.

Operative Gemeinkosten

Die Betriebskosten sind der Bereich, in dem sich die Analysekosten unbemerkt ansammeln. Diese Ausgaben tauchen selten als klarer Einzelposten auf, aber sie verschlingen langfristig Zeit, Aufmerksamkeit und Budget.

Dazu gehören laufende Korrekturen der Datenqualität, Pipeline-Ausfälle und Fehlerbehebung, die Pflege redundanter oder ungenutzter Dashboards, die Schulung interner Teams und die Durchführung von Compliance- oder Sicherheitsüberprüfungen. Diese Kosten sind zwar real, werden aber bei der Planung oft unterschätzt, weil sie nicht auf einmal, sondern schrittweise anfallen.

Die wahren Kosten der Big Data-Analytik werden durch die Kombination von Mitarbeitern, Technologie und Betriebskosten bestimmt. Um realistische Budgets zu erstellen und spätere Überraschungen zu vermeiden, ist es wichtig zu verstehen, wie sie zusammenwirken.

Wie sich Datenvolumen und Aktualität auf die Kosten auswirken

Mehr Daten bedeuten nicht nur mehr Speicherplatz. Es bedeutet auch mehr Verarbeitung, mehr Überwachung und mehr Risiko, wenn etwas schief geht.

Hochfrequente Daten erhöhen die Kosten, da sie erforderlich sind:

- Robustere Pipelines

- Höhere Computernutzung

- Schnellere Fehlererkennung

- Strengere SLAs

Viele Unternehmen verwenden standardmäßig Analysen nahezu in Echtzeit, ohne zu prüfen, ob dies wirklich erforderlich ist. In vielen Fällen liefern tägliche oder stündliche Aktualisierungen denselben geschäftlichen Nutzen zu wesentlich geringeren Kosten.

Eigene vs. externe Analyseteams

Die Art und Weise, wie Analyseaufgaben besetzt werden, hat direkte Auswirkungen auf die Kostenstruktur und die Flexibilität. Bei der Entscheidung geht es selten um richtig oder falsch. Es geht um Kompromisse.

| Aspekt | Hausinterne Analyse-Teams | Externe Partner oder Managed Services |

| Geschäftliche Kenntnisse | Tiefes Verständnis der internen Systeme, Prozesse und Zusammenhänge | Fachwissen entwickelt sich mit der Zeit und hängt von der Qualität der Einarbeitung ab |

| Kostenstruktur | Hohe Fixkosten durch Gehälter, Sozialleistungen und Gemeinkosten | Flexiblere Kosten, die mit Nutzung und Umfang skalieren |

| Kontinuität | Starke langfristige Kontinuität und Eigentümerschaft | Abhängig von der Vertragsstruktur und der Stabilität des Partners |

| Zugang zu Kompetenzen | Begrenzt durch den Einstellungsmarkt und interne Kapazitäten | Schnellerer Zugang zu spezialisiertem oder schwer zu findendem Fachwissen |

| Skalierbarkeit | Langsameres Hoch- und Runterskalieren | Leichtere Anpassung der Teamgröße an den Bedarf |

| Kontrolle | Volle Kontrolle über Prioritäten und Ausführung | Gemeinsame Kontrolle, die Abstimmung und Kommunikation erfordert |

| Einstellung und Bindung von Mitarbeitern | Die Anwerbung und Bindung von Talenten kann eine Herausforderung sein | Verwaltet durch den Dienstanbieter |

| Am besten geeignet für | Organisationen mit stabilem, langfristigem Analysebedarf | Organisationen, die Flexibilität oder schnellen Zugang zu Fachwissen benötigen |

Viele Unternehmen setzen auf hybride Modelle, bei denen die strategische Verantwortung und das Fachwissen im eigenen Haus verbleiben, während externe Partner bei Bedarf die Ausführung skalieren oder Kompetenzlücken schließen.

Praktische Wege zur Kontrolle der Analysekosten

Kostenkontrolle bedeutet nicht, dass man die Analytik einschränkt oder die Gewinnung von Erkenntnissen verlangsamt. Es bedeutet eine bewusste Gestaltung der Analytik, mit klaren Prioritäten und realistischen Grenzen. Die meisten Kostenüberschreitungen entstehen durch unkontrolliertes Wachstum, nicht durch die Analysearbeit selbst.

Zu den wirksamen Praktiken gehören:

- Vorrang von Geschäftsergebnissen vor der Datenverfügbarkeit. Nur weil Daten vorhanden sind, heißt das nicht, dass sie auch analysiert werden müssen. Beginnen Sie mit den Entscheidungen, die am wichtigsten sind, und arbeiten Sie sich zurück zu den Daten, die zur Unterstützung dieser Entscheidungen erforderlich sind. So bleibt der Umfang überschaubar und unnötige Datenerfassung und -verarbeitung wird vermieden.

- Beschränkung auf die entscheidungsrelevanten Metriken. Große Metrikkataloge sehen zwar beeindruckend aus, sind aber teuer in der Pflege. Ein kleinerer Satz gut definierter Metriken reduziert die Entwicklungszeit, vermeidet Verwirrung und senkt die laufenden Supportkosten.

- Regelmäßige Überprüfung der Dashboards. Dashboards sammeln sich mit der Zeit an. Einige werden nicht mehr verwendet, andere sind veraltet. Regelmäßige Überprüfungen helfen dabei festzustellen, was noch nützlich ist und was ausgemustert werden kann, um den Wartungsaufwand und die Unübersichtlichkeit zu verringern.

- Anpassung der Aktualität der Daten an den tatsächlichen Bedarf. Echtzeit-Analysen sind kostspielig und oft unnötig. Viele Geschäftsfragen können mit stündlichen oder täglichen Aktualisierungen beantwortet werden. Die Anpassung der Aktualitätsanforderungen an die tatsächlichen Entscheidungsfristen kann die Infrastruktur- und Rechenkosten erheblich senken.

- Reduzierung der Werkzeugüberlappung. Jedes zusätzliche Analysetool verursacht zusätzliche Lizenzgebühren, Integrationsaufwand und Schulungskosten. Die Konsolidierung von Tools, wo immer möglich, vereinfacht den Stack und senkt sowohl die direkten als auch die indirekten Kosten.

- Frühzeitig in die Datenqualität investieren. Saubere, gut strukturierte Daten verringern spätere Nacharbeiten und Nachbesserungen. Die Bemühungen um die Datenqualität erhöhen zwar die Anfangskosten, senken aber langfristig die Ausgaben, da die Analysen schneller, zuverlässiger und einfacher zu skalieren sind.

- Aufbau von analytischen Kenntnissen in allen Teams. Wenn Geschäftsanwender Daten und Metriken verstehen, sind sie weniger auf Ad-hoc-Anfragen und manuelle Erklärungen angewiesen. Dies verringert den Druck auf die Analyseteams und verbessert die Gesamteffizienz.

Diese Schritte erfordern Disziplin und Anpassung, keine neue Software oder komplexe Rahmenwerke. In vielen Fällen ergibt sich eine bessere Kostenkontrolle aus einem klareren Denken und nicht aus größeren Budgets.

Abschließende Überlegungen

Die Kosten für Big Data-Analysen werden durch Verantwortung und nicht durch Ehrgeiz bestimmt. Je mehr die Analytik Entscheidungen, Produkte oder Kunden beeinflusst, desto mehr Sorgfalt und Struktur erfordert sie.

Unternehmen, die realistisch planen, geben im Vorfeld oft mehr aus, aber im Laufe der Zeit weniger. Diejenigen, die die niedrigsten Anfangszahlen anstreben, zahlen dafür in der Regel später durch Nacharbeit, Frustration und verpasste Chancen.

Die eigentliche Frage ist nicht, wie billig Analytik sein kann, sondern wie zuverlässig sie das Geschäft unterstützt, dem sie dienen soll.

Häufig gestellte Fragen

- Wie viel kostet die Big-Data-Analyse in der Regel?

Die Kosten für Big-Data-Analysen variieren je nach Umfang und Komplexität stark. Grundlegende Analyseprogramme beginnen bei etwa $30.000 bis $80.000 pro Jahr. Mittelgroße Analyseprogramme liegen oft zwischen $100.000 und $250.000 pro Jahr. Fortgeschrittene oder geschäftskritische Analyseumgebungen können $500.000 pro Jahr überschreiten, insbesondere wenn große Datenmengen, Automatisierung oder Vorhersagemodelle involviert sind.

- Warum variieren die Kosten für Big Data-Analysen so stark zwischen den Unternehmen?

Die Kosten sind unterschiedlich, da die Anforderungen an die Analyse selten identisch sind. Faktoren wie die Anzahl der Datenquellen, das Datenvolumen, die Anforderungen an die Aktualität, die Komplexität der Geschäftslogik und die Frage, ob die Analysen intern oder für den Kunden bestimmt sind, beeinflussen die Preisgestaltung. Zwei Unternehmen in derselben Branche können sehr unterschiedliche Analysekosten haben, je nachdem, wie die Analyse innerhalb des Unternehmens genutzt wird.

- Ist die Big-Data-Analyse teurer als die traditionelle Analyse?

Big-Data-Analysen sind in der Regel teurer, da sie größere Datensätze, komplexere Pipelines und häufig höhere Erwartungen an Geschwindigkeit und Zuverlässigkeit beinhalten. Herkömmliche Analysen können sich auf kleinere Datensätze und einfachere Berichte stützen, während Big Data-Analysen oft Einblicke in Echtzeit, erweiterte Modellierung oder kundenorientierte Funktionen unterstützen.

- Was sind die größten versteckten Kosten bei der Big Data-Analyse?

Zu den versteckten Kosten gehören oft Korrekturen der Datenqualität, Pipeline-Fehler, nicht genutzte Dashboards, interne Schulungen, Prüfungen der Einhaltung von Vorschriften und laufende Wartung. Diese Kosten tauchen selten in den ersten Schätzungen auf, sammeln sich aber mit der Zeit an, wenn Analyseprogramme nicht aktiv verwaltet werden.

- Ist es billiger, ein internes Analyseteam aufzubauen oder auf externe Partner zurückzugreifen?

Das hängt von den Bedürfnissen des Unternehmens ab. Interne Teams bieten fundierte Geschäftskenntnisse und langfristige Kontinuität, sind aber mit hohen Fixkosten verbunden. Externe Partner bieten Flexibilität und schnelleren Zugang zu spezialisierten Fähigkeiten, erfordern aber eine intensive Kommunikation und Einarbeitung. Viele Unternehmen verwenden einen hybriden Ansatz, um Kosten und Kontrolle in Einklang zu bringen.