Kurze Zusammenfassung: Die digitale Transformation im Bergbau integriert fortschrittliche Technologien wie KI, IoT, autonome Systeme und prädiktive Analysen in der gesamten Wertschöpfungskette des Bergbaus, um die betriebliche Effizienz zu steigern, die Sicherheit zu verbessern, die Kosten zu senken und Nachhaltigkeitsziele zu erreichen. Führende Bergbauunternehmen nutzen Industrie-4.0-Lösungen, um sinkende Erzgehalte, Herausforderungen für die Belegschaft und Umweltbelastungen zu bewältigen und gleichzeitig Hunderte von Millionen an ungenutztem Wert zu schaffen.

Die Bergbauindustrie steht an einem technologischen Scheideweg. Der Druck des Klimawandels, sinkende Erzgehalte, strengere Vorschriften und anhaltende Sicherheitsprobleme erfordern einen grundlegenden Wandel in der Arbeitsweise der Bergbauunternehmen.

Die digitale Transformation ist hier nicht nur ein weiteres Schlagwort, sondern wird zu einer betrieblichen Notwendigkeit. Ein leitender Techniker eines großen Bergbauunternehmens meinte kürzlich, dass Initiativen zur digitalen Transformation “Hunderte von Millionen Dollar an ungenutztem Wert pro Jahr” freisetzen könnten.”

Die Sache ist jedoch die: Die Erkenntnis, dass die digitale Transformation wichtig ist, und die tatsächliche Umsetzung sind zwei sehr unterschiedliche Herausforderungen. Nur 25% der Metall- und Bergbauunternehmen nutzen derzeit maßgeschneiderte digitale Lösungen. Die meisten geben sich mit allgemeinen Optionen von der Stange zufrieden, die nicht auf ihre spezifischen betrieblichen Gegebenheiten zugeschnitten sind.

In diesem Leitfaden wird untersucht, was die digitale Transformation für den Bergbau im Jahr 2026 tatsächlich bedeutet, welche Technologien messbare Ergebnisse liefern und wie Bergbauunternehmen von Altsystemen zu integrierten digitalen Ökosystemen übergehen können.

Was die digitale Transformation für den Bergbausektor bedeutet

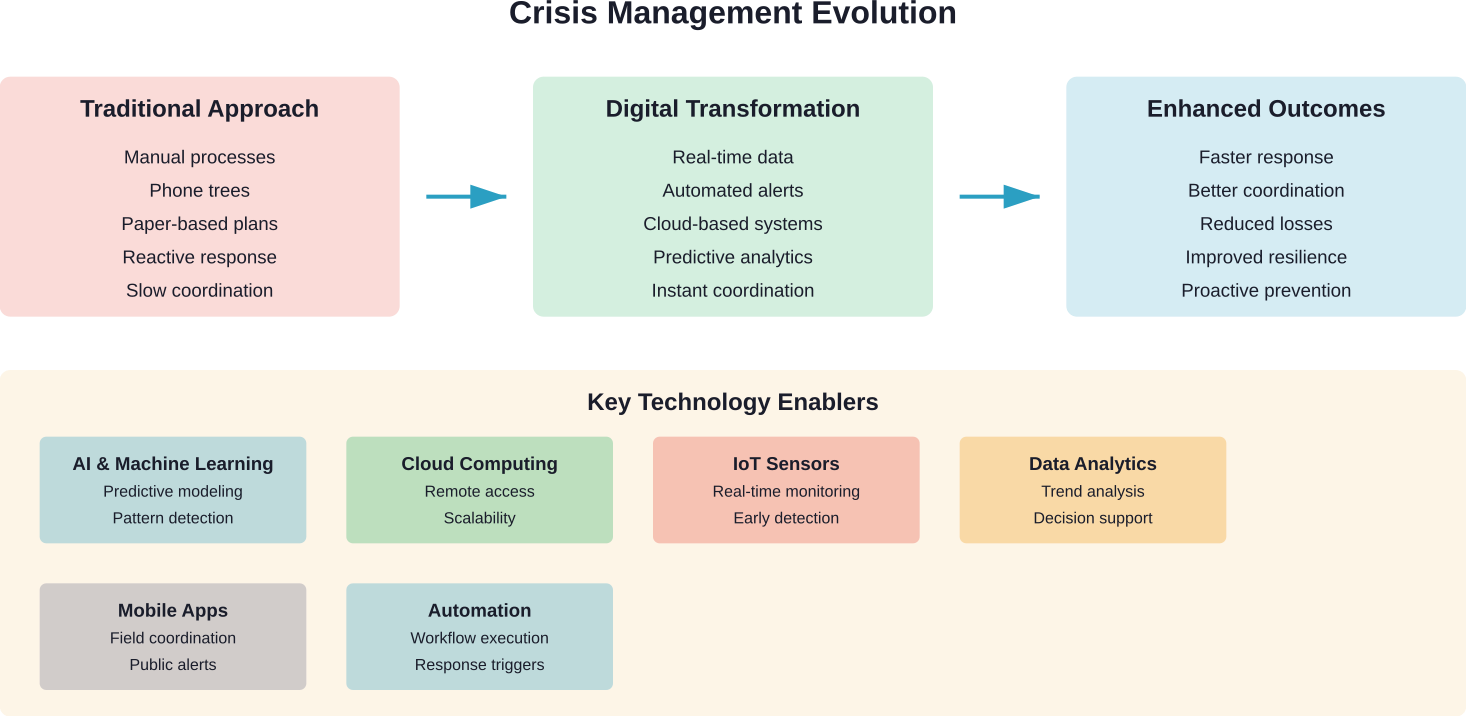

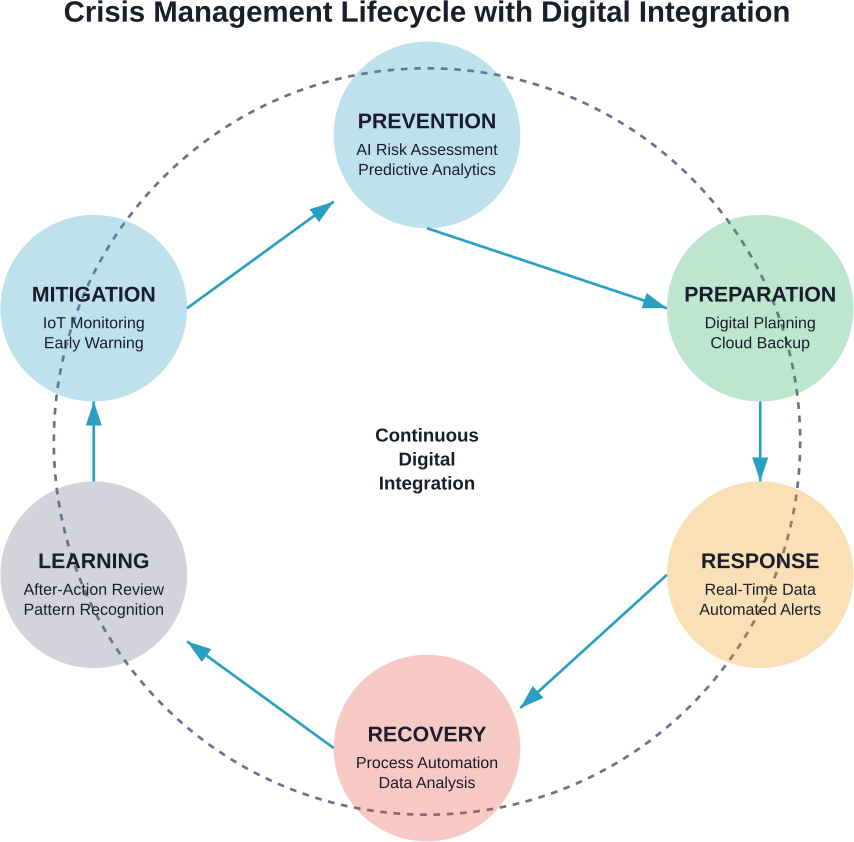

Die digitale Transformation im Bergbau steht für die umfassende Digitalisierung von Daten und Prozessen in der gesamten Wertschöpfungskette des Bergbaus - von der Exploration und Gewinnung über die Verarbeitung und Logistik bis hin zur Rekultivierung.

Es geht nicht einfach darum, neue Software zu installieren oder autonome Lkw zu kaufen. Eine echte Transformation integriert Industrie-4.0-Technologien in einen einheitlichen, funktionsübergreifenden Ansatz, der die Funktionsweise von Bergbaubetrieben grundlegend verändert.

Der Wandel berührt jede Phase:

- Exploration profitiert von fortschrittlicher geologischer Modellierung und KI-gestützter Ressourcenidentifizierung

- Bei der Gewinnung werden autonome Geräte und Echtzeit-Überwachungssysteme eingesetzt

- Verarbeitungsbetriebe führen digitale Zwillinge und vorausschauende Wartungsprotokolle ein

- Lieferketten nutzen IoT-Sensoren und intelligente Logistikplattformen

- Die Einhaltung von Umweltauflagen erfolgt durch kontinuierliche Überwachung und automatische Berichterstattung

Laut ICMM sind Mineralien und Metalle von grundlegender Bedeutung für das moderne Leben und die weltweiten Bemühungen zur Bekämpfung des Klimawandels. Bergbauunternehmen haben die Verantwortung, die natürliche Umwelt zu schützen, wiederherzustellen und zu verbessern und gleichzeitig die steigende Nachfrage nach wichtigen Mineralien zu befriedigen, die für eine saubere Energiewende benötigt werden.

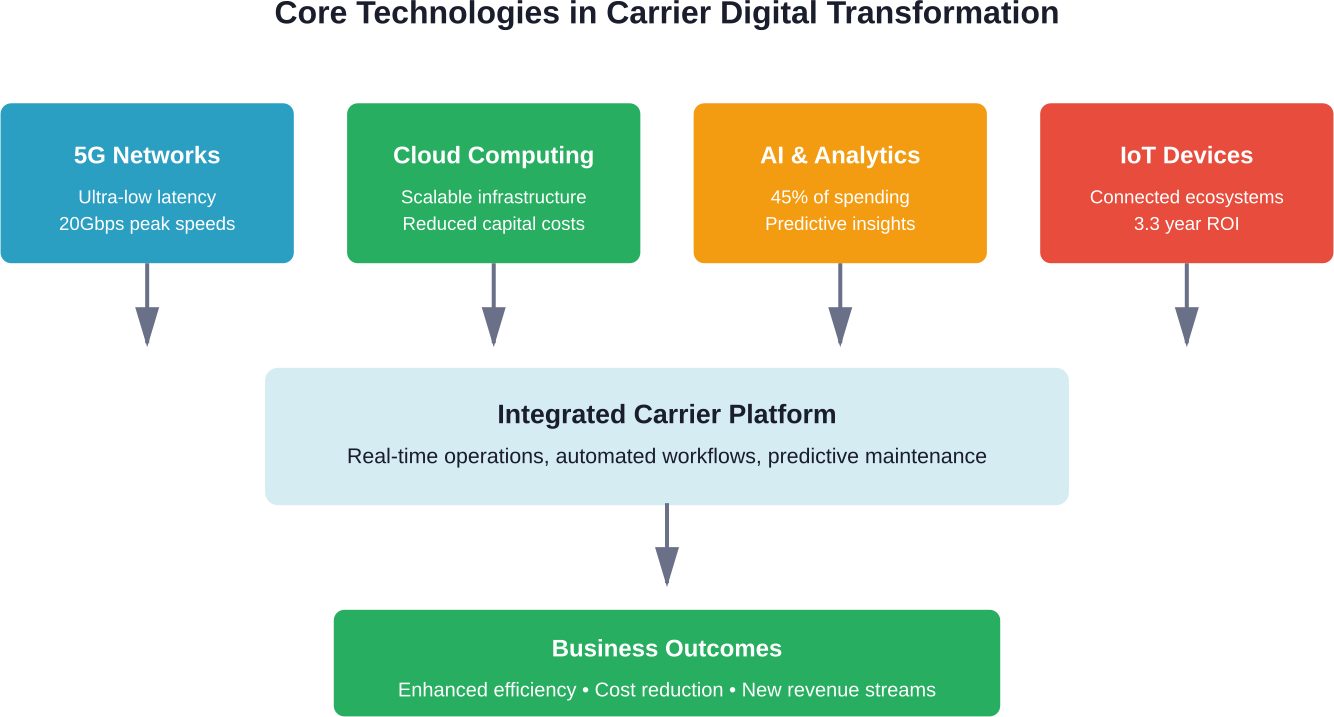

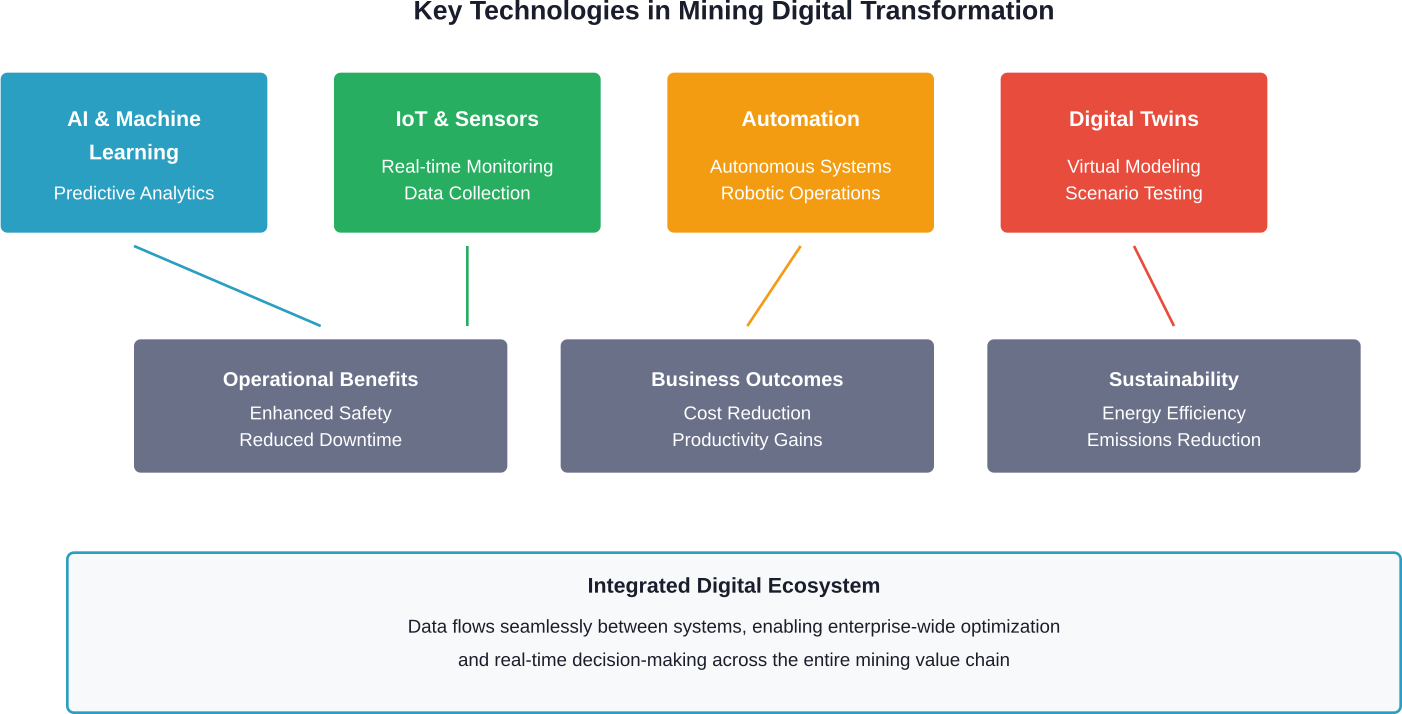

Kerntechnologien für die digitale Transformation im Bergbau

Mehrere Technologiekategorien bilden die Grundlage für Initiativen zur digitalen Transformation in der Bergbauindustrie.

Künstliche Intelligenz und maschinelles Lernen

KI-Anwendungen im Bergbau sind über Pilotprojekte hinaus in den Produktionseinsatz übergegangen. Algorithmen des maschinellen Lernens analysieren jetzt Millionen von Sensordaten, um Leistungsschwankungen der Anlagen zu erkennen, bevor es zu Ausfällen kommt.

Das Asset Health Centre von Rio Tinto nutzt prädiktive Analysen, um Probleme zu erkennen, bevor sie zu einem Ausfall führen, was Berichten zufolge die Wartungsproduktivität erhöht und die Kosten senkt.

Autonome Transportfahrzeuge sind eine weitere wichtige KI-Anwendung. Sie ermöglichen eine Senkung des Kraftstoffverbrauchs um etwa 10-15% und eine durchschnittliche Produktivitätssteigerung von etwa 20%.

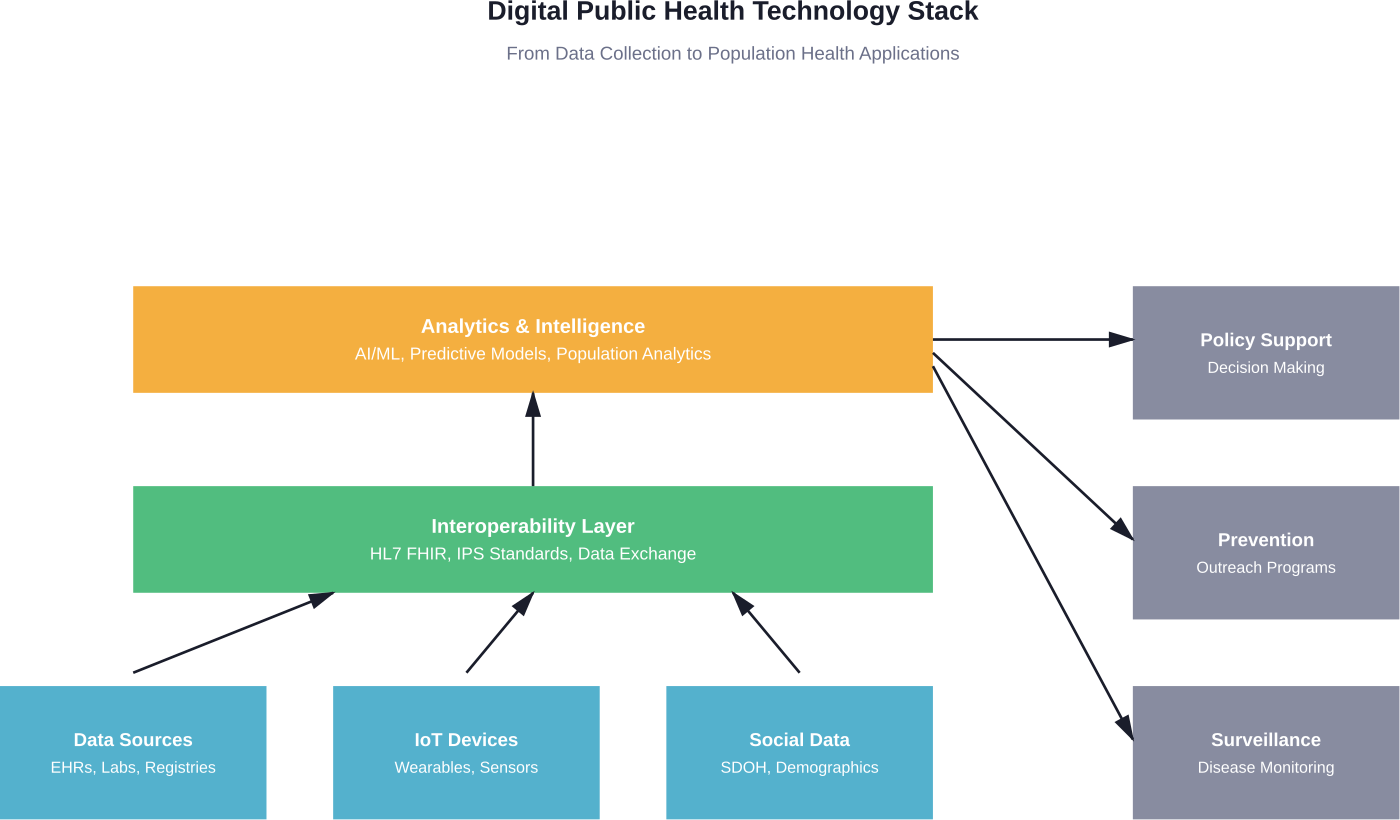

Internet der Dinge und industrielle Sensoren

Die IoT-Infrastruktur schafft die Datengrundlage, die andere digitale Technologien erst möglich macht. Im gesamten Bergbaubetrieb verteilte Industriesensoren überwachen kontinuierlich:

- Gerätezustand und Leistungskennzahlen

- Umweltbedingungen, einschließlich Luftqualität und Bodenstabilität

- Materialflussraten und Qualitätsparameter

- Energieverbrauchsmuster

- Standort und Sicherheitsbedingungen der Arbeitnehmer

Die IEEE-Forschung zur Nutzung der industriellen IoT-Infrastruktur für Fernerkundung und Edge Computing im Bergbausektor zeigt, wie vernetzte Geräte die Entscheidungsfindung in Echtzeit am Betriebsrand ermöglichen und dabei Latenzzeiten und Bandbreitenanforderungen reduzieren.

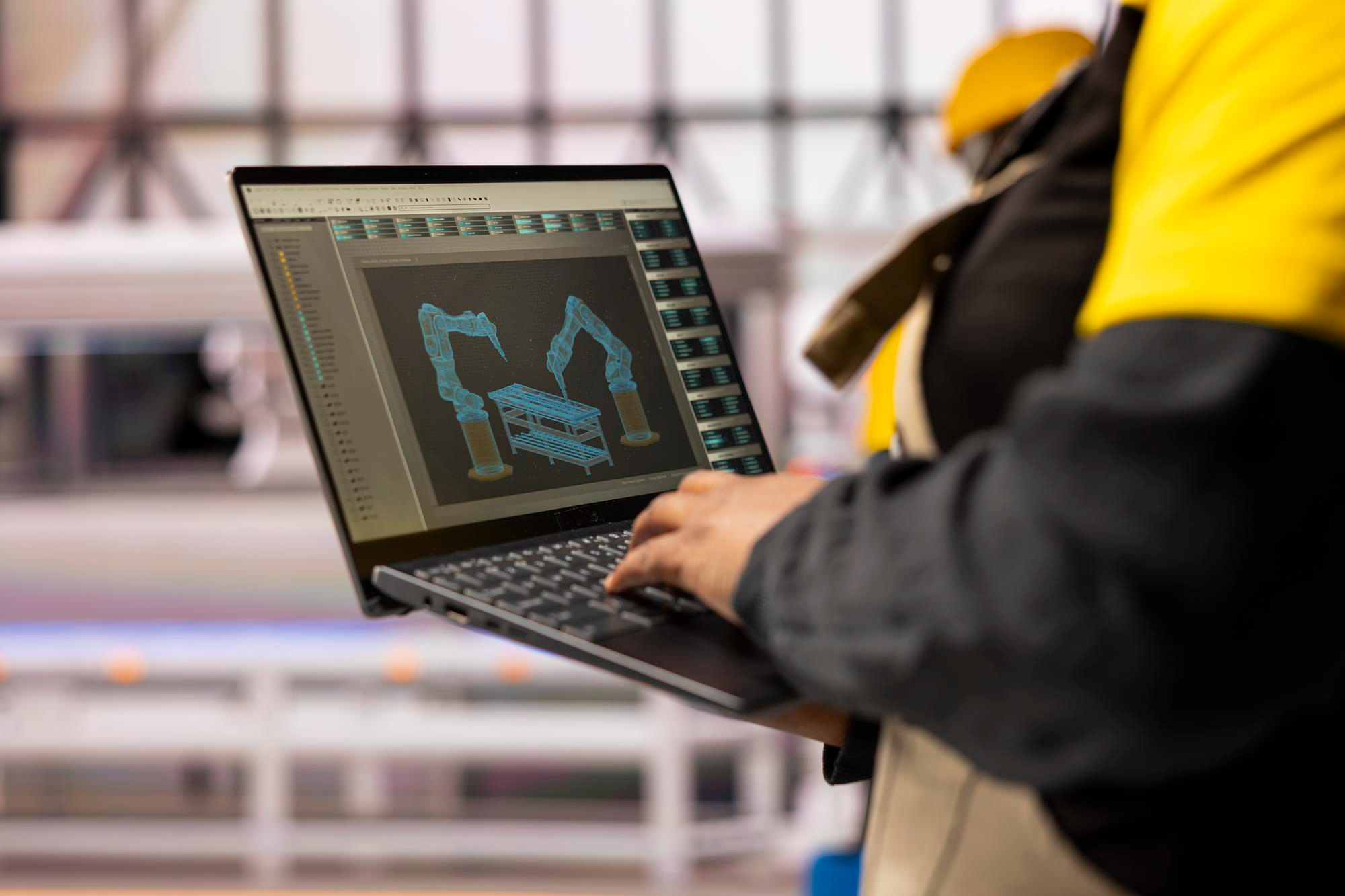

Automatisierung und autonome Systeme

Der weltweite Markt für Bergbauautomatisierung wird voraussichtlich von fast $5 Mrd. USD im Jahr 2024 auf etwa $8-9 Mrd. USD im Jahr 2032 wachsen, mit einer CAGR von etwa 7-8%.

Die Automatisierung erstreckt sich nicht nur auf den Transport von Lastwagen:

- Autonome Bohrsysteme, die das Sprengmuster optimieren

- Robotische Inspektionssysteme für gefährliche Umgebungen

- Automatisierte Materialsortierung und -verarbeitung

- Intelligente Fördersysteme mit adaptiver Geschwindigkeitssteuerung

Die Partnerschaft von CharIN mit ICMM zur Gründung einer Bergbau-Taskforce befasst sich mit technischen Engpässen bei der Interoperabilität von batterieelektrischen Ladesystemen für emissionsfreie Bergbaufahrzeuge, deren Einsatz noch in diesem Jahrzehnt beginnen soll.

Digitale Zwillinge und virtuelle Modellierung

Digitale Zwillinge erstellen virtuelle Nachbildungen von physischen Anlagen, Prozessen oder ganzen Abläufen. Diese Modelle verwenden Echtzeitdaten von IoT-Sensoren, um die tatsächlichen Bedingungen widerzuspiegeln und Szenariotests ohne Betriebsrisiko zu ermöglichen.

In mineralverarbeitenden Betrieben ermöglichen digitale Zwillinge den Betreibern, Prozessänderungen zu testen, die Dosierung von Reagenzien zu optimieren und das Verhalten der Anlagen unter verschiedenen Bedingungen vorherzusagen - und das alles, bevor Änderungen an der physischen Umgebung vorgenommen werden.

Die Technologie erweist sich als besonders wertvoll für die Optimierung komplexer Prozesse, bei denen mehrere Variablen zusammenwirken. Ein Kupferkonzentrator, der die digitale Zwillingstechnologie einsetzt, kann modellieren, wie sich Änderungen der Erzeigenschaften gleichzeitig auf den Reagenzienverbrauch, die Gewinnungsraten und den Verschleiß der Anlagen auswirken.

Praktische Anwendungen in der gesamten Wertschöpfungskette des Bergbaus

Die digitale Transformation liefert einen messbaren Wert, wenn sie auf spezifische betriebliche Herausforderungen angewendet wird.

Optimierung der Mineralienverarbeitung

Verarbeitungsbetriebe sind ein kritisches Segment, in dem digitale Lösungen einen unmittelbaren ROI liefern. Implementierungen in der realen Welt zeigen greifbare Vorteile:

Ein Goldproduktionsbetrieb implementierte eine speziell entwickelte digitale Lösung zur Optimierung der Goldberechnungen, was zu einer zuverlässigeren und genaueren Produktionsberichterstattung führte. Das System integrierte Analysedaten, Durchflussmessungen und metallurgische Bilanzen in eine einheitliche Plattform, die manuelle Abstimmungsfehler eliminierte.

Ein anderer Kupferkonzentrator erstellte ein Modell für die Nettorendite der Schmelze, das die Konzentratqualität gegen die Transportkosten und die Schmelzabzüge optimiert. Das Modell passt die Verarbeitungsparameter kontinuierlich an, um den wirtschaftlichen Ertrag zu maximieren, anstatt einfach nur die Gewinnungsraten zu maximieren.

Vorausschauende Wartung und Vermögensverwaltung

Anlagenausfälle im Bergbau verursachen enorme Kosten - nicht nur für Reparaturen, sondern auch für Produktionsausfälle während der Ausfallzeiten. Mit der vorausschauenden Wartung wird der Ansatz von der planmäßigen oder reaktiven Wartung auf zustandsabhängige Eingriffe verlagert.

Die fortschrittliche Modellierung analysiert Sensordaten, um subtile Muster der Leistungsverschlechterung zu erkennen, die Ausfällen vorausgehen. Temperaturschwankungen, Vibrationsanomalien, Änderungen des Stromverbrauchs und der Schmiermittelqualität liefern bei entsprechender Analyse Frühwarnsignale.

Dieser datengesteuerte Ansatz verlängert die Lebensdauer der Anlagen, senkt die Wartungskosten und verhindert ungeplante Ausfallzeiten, die die Produktionspläne stören.

Umweltverträglichkeit und Nachhaltigkeit

Das ICMM hat kürzlich neue Instrumente veröffentlicht, die Bergbau- und Metallunternehmen dabei helfen sollen, die Kreislaufwirtschaft zu verbessern, d. h. Abfälle zu minimieren und den Wert in jeder Phase des Lebenszyklus zu maximieren, von der Beschaffung über die Produktion bis hin zur Nutzung und Verwertung.

Digitale Systeme ermöglichen:

- Kontinuierliche Emissionsüberwachung mit automatischer Berichterstattung

- Optimierung des Wasserverbrauchs und Verfolgung der Wasserqualität im gesamten Betrieb

- Energieverbrauchsanalyse zur Ermittlung von Effizienzmöglichkeiten

- Charakterisierung von Abfallströmen für das Verwertungspotenzial

- Überwachung der biologischen Vielfalt in der Umgebung von Minenstandorten

Echte Gespräche: Die Umweltleistung beeinflusst zunehmend die soziale Lizenz zum Betrieb. Digitale Systeme, die transparente, überprüfbare Umweltdaten liefern, helfen Bergbauunternehmen, ihr verantwortungsvolles Handeln zu demonstrieren.

Herausforderungen bei der Umsetzung und deren Bewältigung

Die digitale Transformation stößt im Bergbau auf erhebliche Hindernisse. Das Verständnis dieser Herausforderungen hilft Unternehmen bei der Entwicklung realistischer Umsetzungsstrategien.

| Herausforderung | Auswirkungen | Strategie zur Risikominderung |

|---|---|---|

| Integration von Altsystemen | Inkompatible Datenformate und Kommunikationsprotokolle schaffen Silos | Implementierung von Middleware-Plattformen, die zwischen alten und modernen Systemen vermitteln |

| Einschränkungen bei der Konnektivität | Abgelegene Standorte und unterirdische Betriebe haben keine zuverlässige Netzinfrastruktur | Einsatz von Edge-Computing-Lösungen, die Daten lokal mit regelmäßiger Synchronisierung verarbeiten |

| Anpassungslücken | Allgemeine Lösungen gehen nicht auf die bergbauspezifischen betrieblichen Gegebenheiten ein | Partnerschaften mit Anbietern, die branchenspezifische Lösungen anbieten, oder die Entwicklung eigener Fähigkeiten |

| Qualifikationsdefizite | Den Arbeitskräften mangelt es an digitalen Kenntnissen und Datenanalysefähigkeiten | Investieren Sie in Schulungsprogramme und stellen Sie digitale Spezialisten mit Erfahrung im Bergbau ein. |

| Probleme mit der Datenqualität | Inkonsistente, unvollständige oder ungenaue Daten untergraben den analytischen Wert | Einführung eines Rahmens für die Datenverwaltung und Investition in Datenbereinigungsverfahren |

Die Herausforderung der Anpassung verdient besondere Aufmerksamkeit. Nur 25% der Metall- und Bergbauunternehmen nutzen maßgeschneiderte digitale Lösungen, die meisten entscheiden sich für allgemeine Plattformen, die umfangreiche Anpassungen erfordern.

Bergbaubetriebe stehen vor einzigartigen Herausforderungen - extreme Umweltbedingungen, stark variierende Erzeigenschaften, komplexe metallurgische Prozesse und strenge Sicherheitsanforderungen. Lösungen von der Stange erfüllen diese spezifischen Anforderungen nur selten ohne erhebliche Modifikationen.

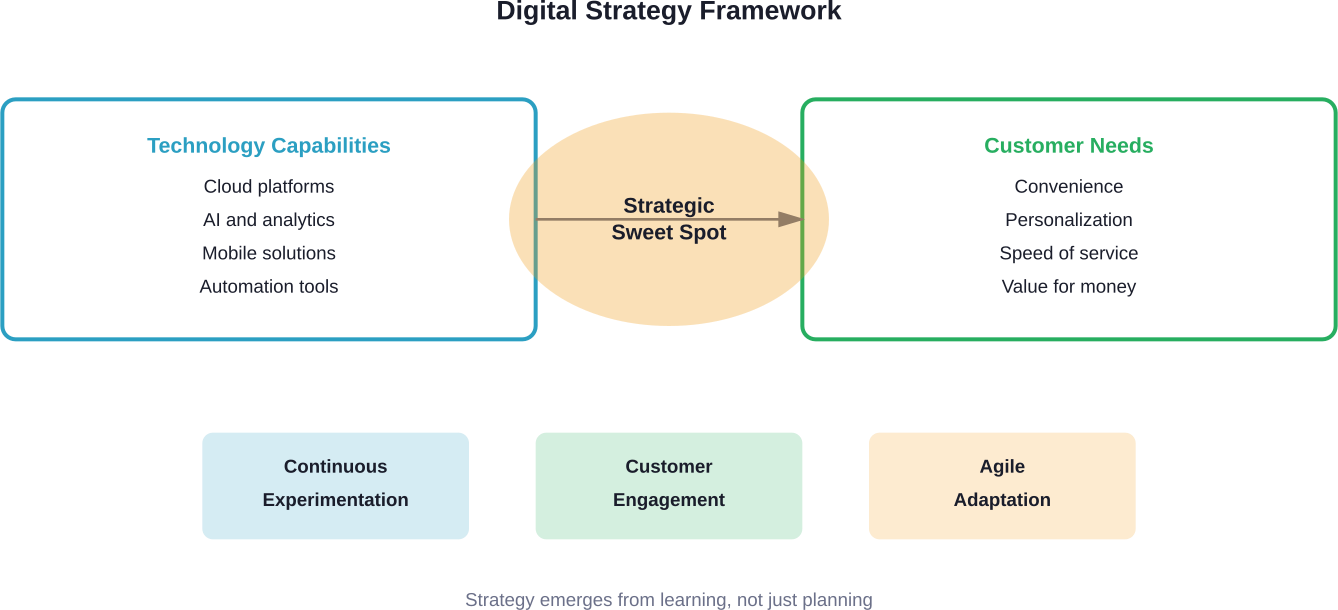

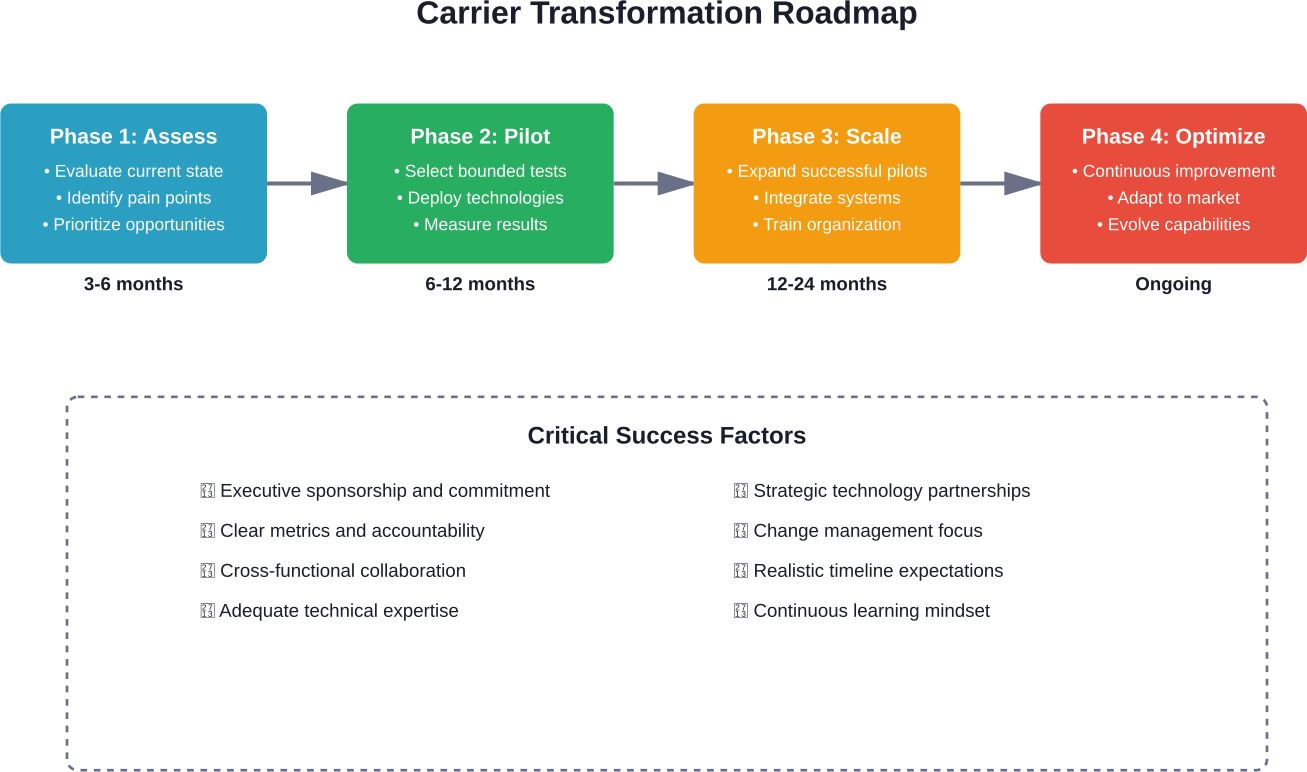

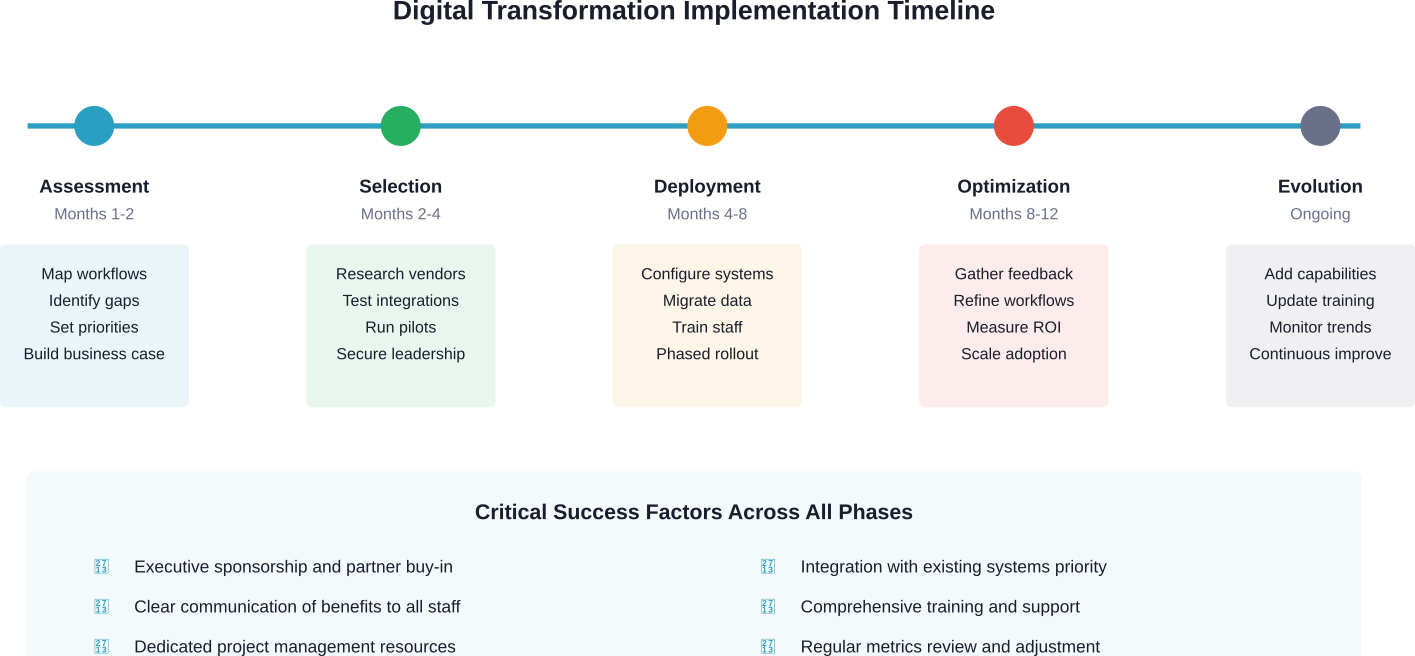

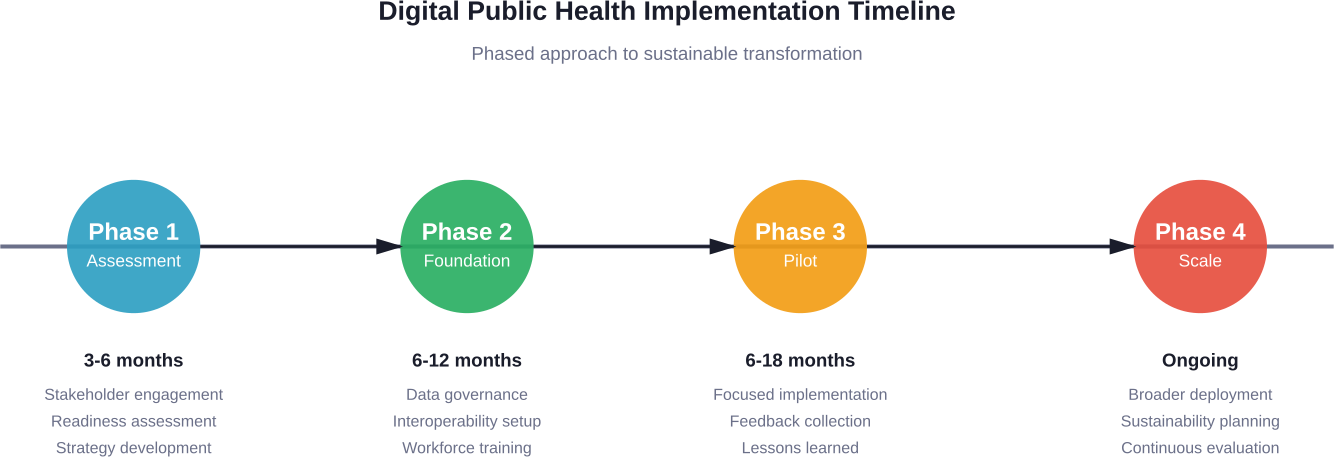

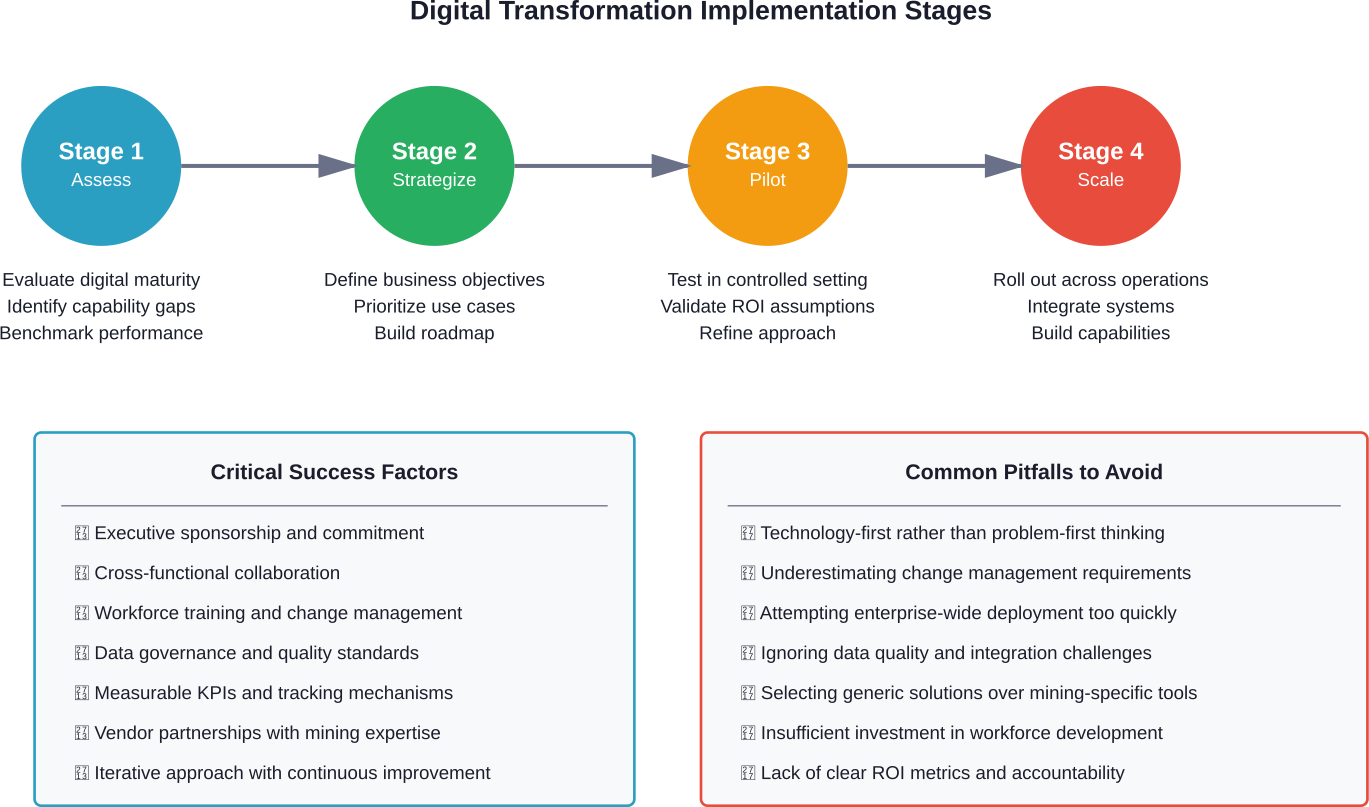

Aufbau einer erfolgreichen Roadmap für die digitale Transformation

Eine wirksame digitale Transformation erfordert einen strukturierten Ansatz und keine Ad-hoc-Einführung von Technologien.

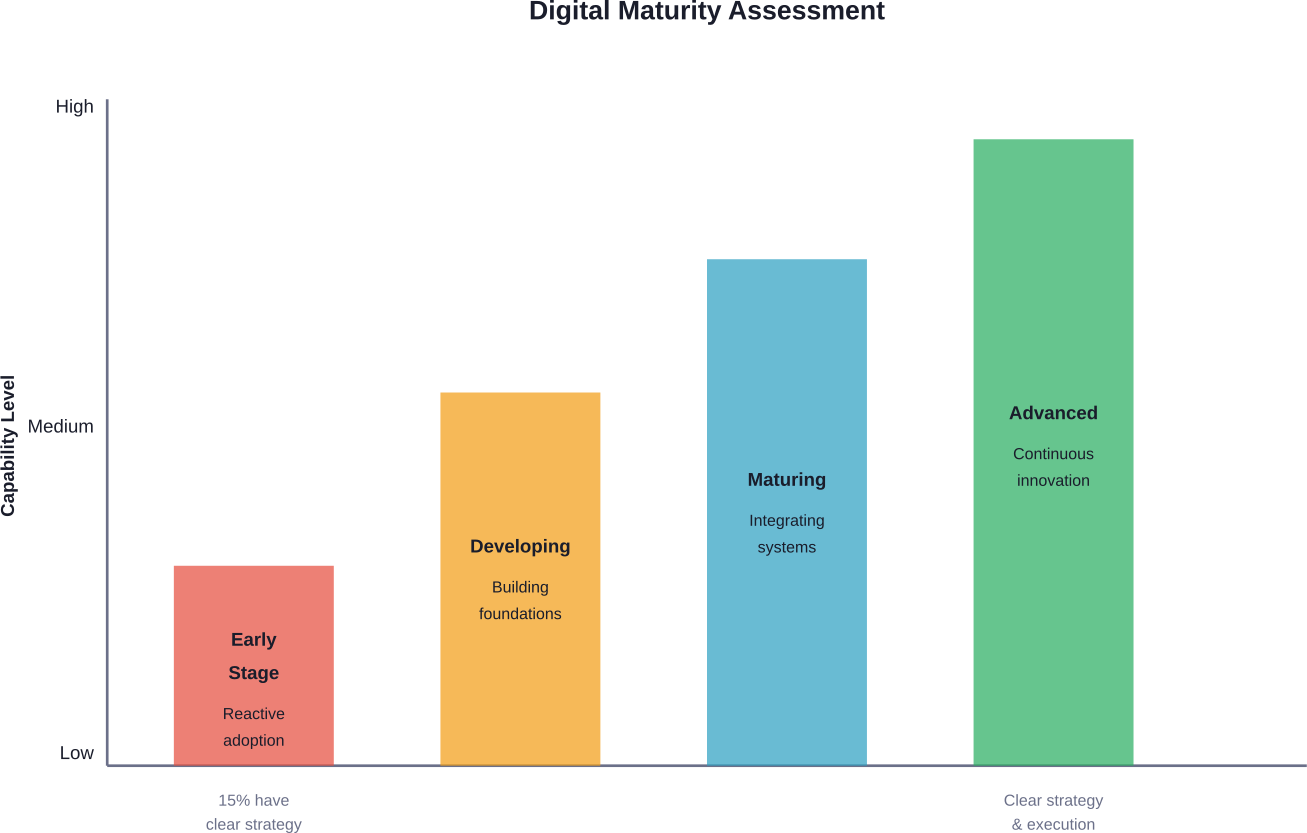

Bewertung des aktuellen digitalen Reifegrads

Unternehmen sollten zunächst eine ehrliche Bewertung ihres derzeitigen Zustands in verschiedenen Bereichen vornehmen:

- Technologische Infrastruktur und Systemintegrationsebenen

- Erfassung, Speicherung und Analyse von Daten

- Digitale Fähigkeiten der Mitarbeiter und Bereitschaft zum Wandel

- Prozessdigitalisierung und Automatisierungsgrad

- Engagement der Führungskräfte und klare digitale Strategie

Bewertungen des digitalen Reifegrads liefern grundlegende Messungen und ermitteln vorrangige Verbesserungsbereiche.

Klare Unternehmensziele definieren

Technologie um der Technologie willen liefert nur begrenzten Wert. Erfolgreiche Transformationen beginnen mit konkreten Geschäftszielen:

- Verringerung ungeplanter Ausfallzeiten um einen bestimmten Prozentsatz

- Verbesserung der Erzgewinnungsraten bei gleichbleibender Konzentratqualität

- Senkung des Energieverbrauchs pro verarbeiteter Tonne

- Verbesserung der Arbeitssicherheit durch Gefahrenerkennungssysteme

- Beschleunigung der Umweltberichterstattung und Überprüfung der Einhaltung der Vorschriften

Jedes Ziel sollte mit messbaren Ergebnissen mit definierten Zeitplänen und Erfolgskriterien verbunden sein.

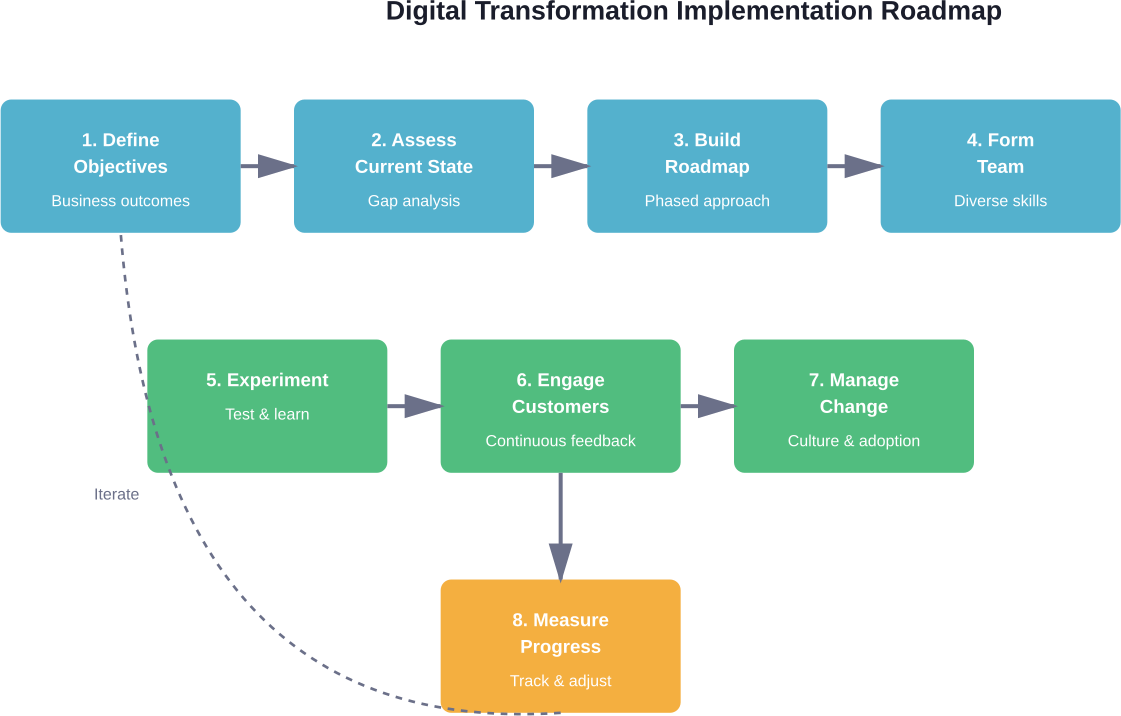

Beginnen Sie mit hochwirksamen Pilotprojekten

Anstatt sofort eine unternehmensweite Umstellung zu versuchen, beginnen erfolgreiche Unternehmen mit gezielten Pilotprojekten:

- Adressieren Sie signifikante Schmerzpunkte mit klarem ROI-Potenzial

- Kann in kontrollierten Umgebungen eingesetzt werden

- Gewinnung von Erkenntnissen für einen breiteren Einsatz

- Aufbau von interner Glaubwürdigkeit und Eigendynamik

- Den Wert für skeptische Interessengruppen aufzeigen

Ein Pilotprojekt könnte sich auf die vorausschauende Wartung für einen bestimmten Anlagentyp, die Prozessoptimierung für eine einzelne Produktionslinie oder den autonomen Betrieb in einem bestimmten Bereich konzentrieren.

Systematische Skalierung auf der Grundlage bewährter Ergebnisse

Sobald die Pilotprojekte den Ansatz validieren und messbare Ergebnisse liefern, können die Organisationen systematisch skalieren. Dies erfordert:

- Standardisierung erfolgreicher Lösungen für einen breiteren Einsatz

- Aufbau von internem Fachwissen zur Unterstützung expandierender Implementierungen

- Integration von Einzellösungen in einheitliche Plattformen

- Einrichtung von Data-Governance-Rahmenwerken

- Entwicklung von Protokollen für das Änderungsmanagement

Skalierung bedeutet auch, dass über die anfänglichen Anwendungsfälle hinaus auch verwandte Anwendungen einbezogen werden, die die vorhandene Infrastruktur und die vorhandenen Funktionen nutzen.

Erstellen Sie einen praktischen Plan für die digitale Transformation im Bergbau

Bergbauunternehmen haben oft mit Altsystemen, fragmentierten Betriebsdaten und Prozessen zu tun, die lange vor der Einführung moderner Analyse- und Automatisierungsverfahren entwickelt wurden. A-listware arbeitet mit Unternehmen zusammen, um die bestehende Infrastruktur zu überprüfen, Ineffizienzen zu identifizieren und einen realistischen Transformationsfahrplan zu erstellen. Die Teams von A-listware kümmern sich um alles, von der Systemanalyse und Strategieentwicklung bis hin zur Implementierung neuer digitaler Lösungen wie Cloud-Infrastrukturen, Datenplattformen und kundenspezifischer Software, die effizientere Abläufe unterstützen.

Für Bergbauunternehmen kann diese Art der Unterstützung bedeuten, betriebliche Systeme zu modernisieren, die Datentransparenz über Standorte hinweg zu verbessern oder Geräte und Berichterstattungswerkzeuge in einer einzigen digitalen Umgebung zu verbinden. A-listware unterstützt in der Regel den gesamten Prozess - beginnend mit der Geschäftsanalyse, über die Entwicklung der Transformationsstrategie und die Implementierung neuer Systeme bis hin zum laufenden technischen Support, sobald die neue Infrastruktur eingerichtet ist.

Wenn Ihr Bergbaubetrieb eine digitale Umstellung plant, sprechen Sie mit dem A-listware und erörtern, wie eine Modernisierung für Ihren Betrieb realistisch aussehen könnte.

Die Rolle von Standards und Interoperabilität

Technische ISO-Normen spielen eine immer wichtigere Rolle bei der digitalen Transformation im Bergbau. ISO/TC 184 konzentriert sich auf die Normung im Bereich der Automatisierungssysteme und deren Integration für Design, Herstellung, Produktion und Support.

Diese Normen befassen sich mit kritischen Interoperabilitätsproblemen, die bei der Integration von Geräten und Systemen verschiedener Anbieter auftreten. Ohne gemeinsame Protokolle und Datenformate sehen sich Bergbauunternehmen mit einer Anbieterbindung und einer komplexen Integration konfrontiert.

Die Partnerschaft zwischen der CharIN Mining Taskforce und dem ICMM befasst sich speziell mit technischen Engpässen im Zusammenhang mit der Interoperabilität von batterieelektrischen Ladesystemen für Bergbaufahrzeuge - ein Beispiel dafür, wie die Zusammenarbeit der Branche bei Normen den Wandel beschleunigt.

Messung des Erfolgs der digitalen Transformation

Was gemessen wird, wird verwaltet. Erfolgreiche Programme zur digitalen Transformation legen klare Messgrößen für verschiedene Kategorien fest:

| Kategorie | Beispiel Metriken | Warum es wichtig ist |

|---|---|---|

| Operative Effizienz | Auslastung der Anlagen, Durchsatz pro Schicht, Zykluszeiten | Quantifizierung der Produktivitätssteigerung durch digitale Systeme |

| Wertentwicklung | Ungeplante Ausfallstunden, mittlere Zeit zwischen Ausfällen, Wartungskosten | Demonstriert den Wert von vorausschauender Wartung und Optimierung |

| Sicherheitsergebnisse | Unfallraten, Häufigkeit von Beinaheunfällen, Geschwindigkeit der Gefahrenerkennung | Zeigt, wie Technologie den Arbeitnehmerschutz verbessert |

| Auswirkungen auf die Umwelt | Energie pro verarbeitete Tonne, Wasserverbrauch, Emissionsintensität | Validierung von Nachhaltigkeitsverbesserungen durch digitale Lösungen |

| Finanzielle Erträge | Kosteneinsparungen, Umsatzsteigerungen, ROI, Amortisationszeit | Rechtfertigt kontinuierliche Investitionen und Expansion |

Das Wichtigste ist jedoch, dass diese Kennzahlen direkt mit den bei der Strategieentwicklung festgelegten Unternehmenszielen verknüpft sind. Verfolgen Sie keine Kennzahlen, nur weil sie verfügbar sind - konzentrieren Sie sich auf Messungen, die die tatsächliche Wertschöpfung widerspiegeln.

Blick in die Zukunft: Die Zukunft der digitalen Transformation im Bergbau

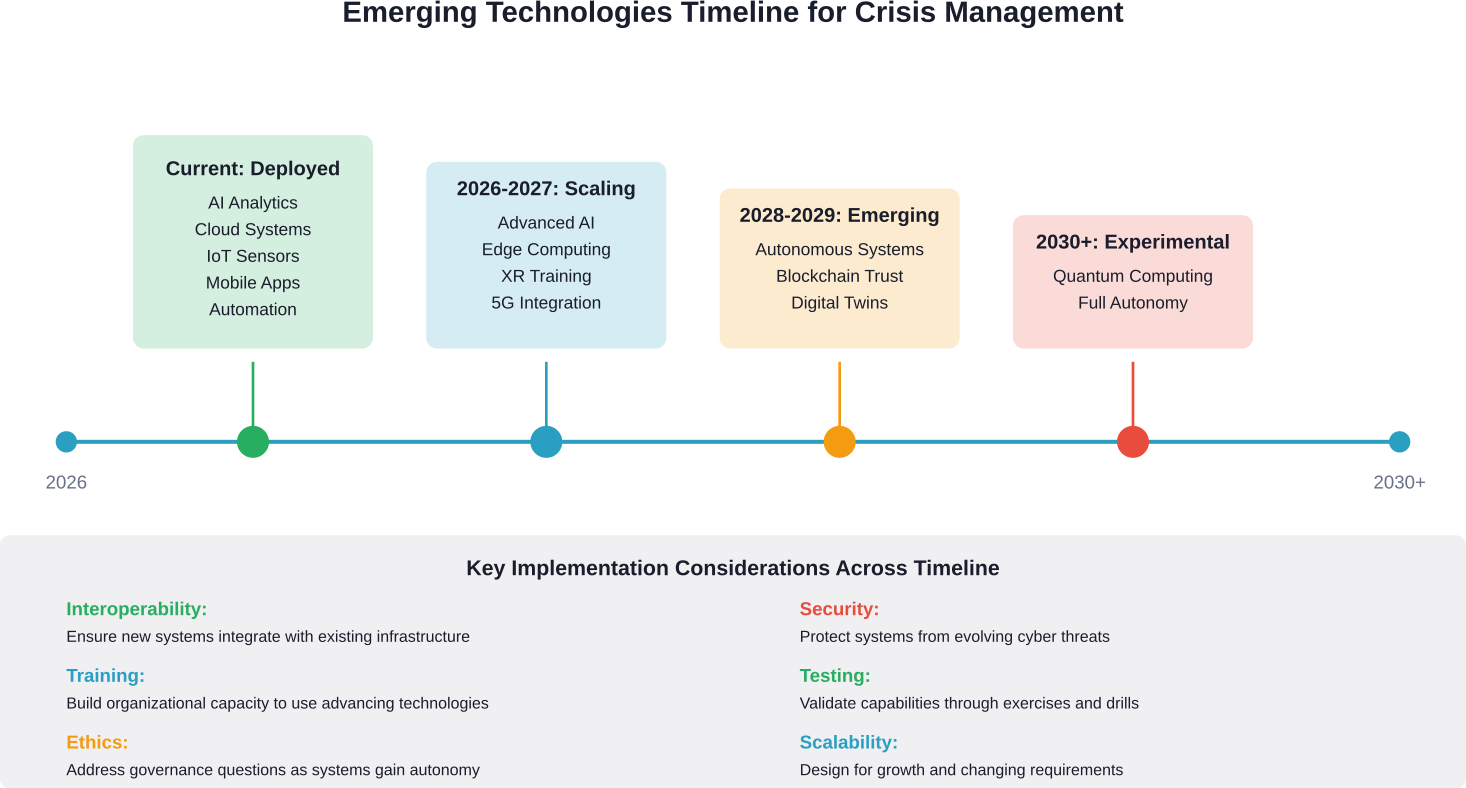

Mehrere Trends werden den digitalen Wandel im Bergbau in den kommenden Jahren prägen.

Der autonome Betrieb wird sich über Transportfahrzeuge hinaus auf Bohren, Sprengen, Verladen und Materialumschlag erstrecken. Völlig autonome Minen, die mit minimalen menschlichen Eingriffen arbeiten, werden sich von Pilotprojekten zur kommerziellen Realität entwickeln.

Edge-Computing wird in Bergbauumgebungen zum Standard werden, in denen aufgrund von Konnektivitätsbeschränkungen Cloud-abhängige Lösungen nicht praktikabel sind. Die Verarbeitung von Daten am Betriebsrand reduziert Latenzzeiten, Bandbreitenanforderungen und die Abhängigkeit von der Netzwerkzuverlässigkeit.

Die Integration digitaler Zwillinge mit KI wird zu selbstoptimierenden Prozessen führen, die ihre Parameter kontinuierlich an veränderte Bedingungen anpassen. Diese Systeme werden über die Optimierung durch den Menschen hinausgehen und zu einer autonomen Prozesssteuerung führen.

Kreislaufwirtschaft und Ressourceneffizienz werden die digitale Innovation vorantreiben. Der Schwerpunkt des ICMM auf der Minimierung von Abfällen und der Maximierung des Werts während des gesamten Lebenszyklus des Bergbaus wird die Entwicklung von Technologien beschleunigen, die die Ressourcenrückgewinnung optimieren und geschlossene Materialkreisläufe ermöglichen.

Der Wandel in der Belegschaft wird sich fortsetzen, da sich der Bergbau von manueller Arbeit hin zu Datenanalyse, Systemmanagement und Fernbetrieb entwickelt. Die Branche muss diesen Qualifikationswandel durch Schulung, Rekrutierung und Zusammenarbeit mit Bildungseinrichtungen bewältigen.

Häufig gestellte Fragen

- Was bedeutet digitale Transformation im Bergbau?

Die digitale Transformation im Bergbau steht für die umfassende Integration von Industrie-4.0-Technologien - einschließlich KI, IoT, autonomer Systeme und digitaler Zwillinge - über die gesamte Wertschöpfungskette im Bergbau. Sie verändert die Funktionsweise von Bergbaubetrieben grundlegend, indem sie von manuellen Prozessen und isolierten Systemen zu integrierten digitalen Ökosystemen übergeht, die datengesteuerte Entscheidungsfindung, vorausschauenden Betrieb und kontinuierliche Optimierung ermöglichen.

- Wie viel Wert kann die digitale Transformation für Bergbauunternehmen schaffen?

Ein leitender Technologieexperte eines großen Bergbauunternehmens gab an, dass Initiativen zur digitalen Transformation “Hunderte von Millionen Dollar an ungenutztem Wert pro Jahr” freisetzen könnten. Konkrete Anwendungen zeigen messbare Erträge: Autonome Transportfahrzeuge sorgen für eine Produktivitätssteigerung von 20% bei einer Verringerung des Kraftstoffverbrauchs um 10-15%, während vorausschauende Wartungssysteme kostspielige Geräteausfälle verhindern und ungeplante Ausfallzeiten reduzieren.

- Was sind die größten Herausforderungen für Bergbauunternehmen bei der digitalen Transformation?

Bergbauunternehmen stoßen auf mehrere große Hindernisse: die Integration neuer Technologien in bestehende Systeme, die Bewältigung von Konnektivitätseinschränkungen an abgelegenen und unterirdischen Standorten, die Suche nach maßgeschneiderten Lösungen für bergbauspezifische Anforderungen, die Entwicklung digitaler Kompetenzen der Belegschaft und die Gewährleistung der Datenqualität. Nur 25% der Bergbauunternehmen nutzen derzeit maßgeschneiderte digitale Lösungen. Die meisten verlassen sich auf generische Plattformen, die umfangreiche Anpassungen erfordern.

- Welche Bergbauprozesse profitieren am meisten von der digitalen Transformation?

Mineralverarbeitungsanlagen profitieren besonders stark von digitalen Lösungen durch Prozessoptimierung, vorausschauende Wartung und digitale Zwillingsmodellierung. Autonome Ausrüstungen in der Gewinnung sorgen für Produktivitäts- und Sicherheitsverbesserungen. Die Optimierung der Lieferkette durch IoT-Sensoren steigert die Effizienz der Logistik. Umweltüberwachungs- und Berichterstattungssysteme verbessern die Einhaltung von Vorschriften und die Nachhaltigkeitsleistung in allen Betrieben.

- Wie sollten Bergbauunternehmen ihren Weg der digitalen Transformation beginnen?

Unternehmen sollten zunächst den aktuellen digitalen Reifegrad bewerten, klare Geschäftsziele definieren, die an messbare Ergebnisse geknüpft sind, und hochwirksame Anwendungsfälle für Pilotprojekte identifizieren. Indem sie mit gezielten Pilotprojekten in kontrollierten Umgebungen beginnen, können Unternehmen ihre Ansätze validieren, den ROI nachweisen und interne Fähigkeiten aufbauen, bevor sie sie systematisch auf breitere Bereiche ausdehnen.

- Welche Rolle spielen Normen bei der digitalen Transformation des Bergbaus?

Technische Normen von Organisationen wie der ISO bilden einen wichtigen Rahmen für die Interoperabilität, der sicherstellt, dass Geräte und Systeme verschiedener Hersteller effektiv miteinander kommunizieren können. Die Partnerschaft zwischen der CharIN Mining Taskforce und dem ICMM befasst sich mit der Interoperabilität von batterieelektrischen Ladesystemen und zeigt, wie die Zusammenarbeit der Industrie bei Normen technische Engpässe beseitigt und den Wandel beschleunigt.

- Wie unterstützt die digitale Transformation die Nachhaltigkeitsziele des Bergbaus?

Digitale Technologien ermöglichen eine kontinuierliche Umweltüberwachung, die Optimierung des Energieverbrauchs, die Minimierung von Abfällen und die Überwachung des Wasserverbrauchs. Das ICMM betont, dass Bergbauunternehmen die Verantwortung haben, die natürliche Umwelt zu schützen, wiederherzustellen und zu verbessern. Digitale Systeme liefern die transparenten, überprüfbaren Daten, die erforderlich sind, um Umweltverantwortung zu demonstrieren und Initiativen zur Kreislaufwirtschaft zu unterstützen, die Abfälle während des gesamten Lebenszyklus des Bergbaus minimieren.

Schlussfolgerung: Zeit für Veränderungen

Die digitale Transformation ist für zukunftsorientierte Bergbauunternehmen kein Luxus, sondern wird durch sinkende Erzgehalte, Umweltbelastungen, Sicherheitsanforderungen und Wettbewerbsdynamik zu einem operativen Muss.

Die Technologien existieren. Reale Implementierungen zeigen einen messbaren Wert. Branchenstandards unterstützen zunehmend die Interoperabilität. Die Frage ist nicht, ob Bergbauunternehmen die digitale Transformation verfolgen sollten, sondern wie schnell sie diese effektiv umsetzen können.

Um erfolgreich zu sein, muss man sich von generischen Lösungen lösen und zu bergbauspezifischen Anwendungen übergehen, mit gezielten Pilotprojekten beginnen, bevor man systematisch skaliert, neben der Technologieeinführung auch in die Entwicklung der Arbeitskräfte investieren und sich weiterhin klar auf die Geschäftsergebnisse und nicht auf die Technologie um ihrer selbst willen konzentrieren.

Bergbauunternehmen, die eine umfassende digitale Transformation in Angriff nehmen, werden die betriebliche Effizienz steigern, die Sicherheit verbessern, die Umweltbelastung verringern und nachhaltige Wettbewerbsvorteile schaffen. Diejenigen, die zögern, laufen Gefahr, ins Hintertreffen zu geraten, da Industrie 4.0 zur grundlegenden Erwartung und nicht zum Unterscheidungsmerkmal wird.

Der Weg der Transformation beginnt mit einer ehrlichen Bewertung, einer klaren Strategie und der Verpflichtung zu nachhaltigen Investitionen in Technologie und Mitarbeiter. Was ist Ihr nächster Schritt?