Le traitement des données en temps réel a la réputation d'être coûteux, et cette réputation est parfois méritée. Mais le coût n'est pas seulement lié à des pipelines plus rapides ou à des factures de cloud plus élevées. Il s'agit du travail permanent nécessaire pour que les données circulent de manière fiable, correcte et en temps voulu.

De nombreuses équipes établissent un budget pour l'infrastructure et l'outillage, puis découvrent plus tard que le temps d'ingénierie, les frais généraux d'exploitation et les décisions de conception déterminent discrètement les dépenses réelles. D'autres s'empressent de tout diffuser en continu, avant de se rendre compte que tous les flux de données n'ont pas besoin d'être en temps réel.

Cet article examine de manière pratique ce que coûte réellement le traitement des données en temps réel, pourquoi les estimations manquent souvent leur cible et comment envisager les dépenses d'une manière qui reflète le comportement de ces systèmes dans le monde réel, et pas seulement sur les diagrammes d'architecture.

Quel est donc le coût réel du traitement des données en temps réel ?

Pour la plupart des équipes, le traitement des données en temps réel n'est pas un prix unique, mais une fourchette mensuelle qui dépend de l'échelle, de l'urgence et de la complexité. En 2025-2026, les coûts réalistes de bout en bout se situent généralement dans les fourchettes suivantes :

- Petites installations ciblées (1-2 flux critiques, services gérés) : $3 000 à $8 000 par mois

- Systèmes de production de taille moyenne (pipelines multiples, accords de niveau de service, couverture sur appel) : $10 000 à $30 000 par mois

- Plates-formes de grande taille ou critiques pour l'entreprise (volume élevé, latence stricte, gouvernance) : $40.000 à $80.000+ par mois

Ce qui importe le plus n'est pas le chiffre exact, mais de savoir si le coût correspond à la valeur de l'action en temps réel. Lorsque la rapidité permet d'éviter des pertes, de réduire les risques ou de débloquer des recettes, ces chiffres ont souvent un sens. Dans le cas contraire, les mêmes dépenses semblent rapidement excessives.

Les cinq niveaux de coût du traitement des données en temps réel (avec des fourchettes de prix réelles)

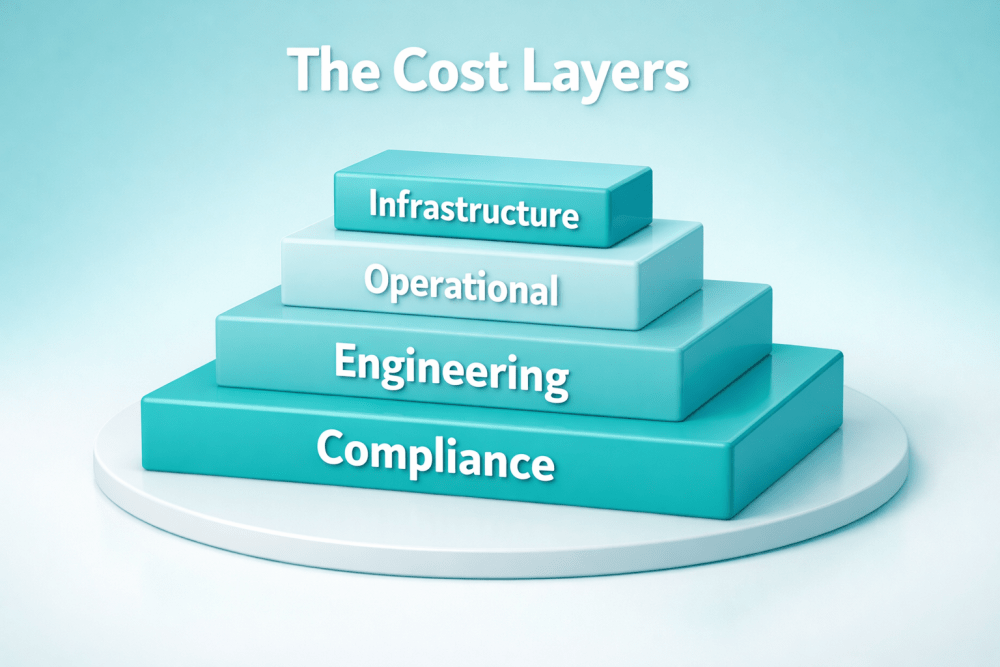

Une manière utile de comprendre le coût du traitement des données en temps réel est de le diviser en couches. L'infrastructure est la plus visible, mais elle est rarement le principal facteur de coût à long terme. Les dépenses réelles apparaissent lorsque les cinq couches sont considérées ensemble.

Coûts d'infrastructure

C'est la partie par laquelle la plupart des équipes commencent, car elle est facile à mesurer.

Les coûts d'infrastructure comprennent le calcul, le stockage, le trafic réseau et le transfert de données. Dans les configurations autogérées, il s'agit généralement de machines virtuelles, de disques, d'équilibreurs de charge, de sauvegardes et de réplications. Dans les plateformes gérées, les mêmes coûts sont regroupés dans des unités basées sur l'utilisation, des prix de débit ou des niveaux d'abonnement.

Fourchettes mensuelles types (orientation approximative)

- Petites charges de travail (jusqu'à 100 Go par jour) : $300 à $1 500 par mois

- Charges de travail moyennes (500 Go à 1 To par jour) : $2 000 à $8 000 par mois

- Charges de travail importantes ou irrégulières (plusieurs To par jour) : $10 000 à $40 000+ par mois

La partie la plus délicate est le dimensionnement. Les systèmes en temps réel sont généralement conçus pour les pics, et non pour les moyennes. Si le trafic triple pendant quelques heures, le système doit quand même suivre. Les équipes qui provisionnent en fonction des pires scénarios paient souvent pour une capacité inactive la plupart du temps. Les équipes qui ne provisionnent pas suffisamment en font les frais plus tard sous forme de pannes, d'étranglement ou de mise à l'échelle d'urgence.

Les plateformes gérées réduisent le surapprovisionnement, mais une conception inefficace du pipeline peut encore faire grimper rapidement les coûts d'infrastructure.

Coûts opérationnels

L'exploitation de systèmes en temps réel n'est pas un travail passif, même lorsque la plateforme est gérée.

Les grappes ont besoin de mises à niveau. Les pipelines doivent être surveillés. Les alertes doivent être réglées. Les événements de mise à l'échelle nécessitent une surveillance. Quelqu'un doit réagir lorsque la latence augmente ou que les consommateurs prennent du retard.

Les coûts opérationnels comprennent les outils d'observabilité, la réponse aux incidents, les rotations d'astreinte et les efforts continus pour maintenir les systèmes stables.

Fourchettes mensuelles types

- Installations légères avec plateformes gérées : $1,000 à $3,000

- Systèmes de production de taille moyenne : $4 000 à $12 000

- Systèmes critiques ou multirégionaux : de $15 000 à $30 000+

Dans les environnements autogérés, cela se traduit souvent par au moins un ingénieur DevOps ou plateforme dédié. Dans les environnements gérés, il s'agit généralement d'une responsabilité partagée entre plusieurs équipes.

Une erreur fréquente consiste à supposer que les plateformes gérées suppriment entièrement les coûts opérationnels. Elles les réduisent, mais ne les éliminent pas. Les questions d'observabilité, de fiabilité et d'intégration requièrent toujours du temps humain réel.

Coûts d'ingénierie

C'est là que de nombreux budgets s'effondrent discrètement.

Les pipelines en temps réel ne sont pas des systèmes prêts à l'emploi. Les schémas évoluent. Les producteurs changent de comportement. Les consommateurs ajoutent de nouvelles attentes. Les connecteurs se brisent. Les cas limites n'apparaissent qu'en cas de trafic réel.

Les ingénieurs consacrent du temps à la construction de pipelines, à leur maintenance, au débogage des défaillances et à l'amélioration des performances. L'expertise en matière de flux est spécialisée et coûteuse.

Fourchettes mensuelles types (temps d'ingénierie uniquement)

- Cas d'utilisation simples avec un champ d'application limité : $3.000 à $8.000

- Systèmes en croissance avec plusieurs pipelines : $10 000 à $25 000

- Plates-formes complexes avec de nombreux consommateurs et accords de niveau de service : $30.000 à $60.000+.

Dans de nombreuses organisations, un petit groupe de spécialistes finit par prendre en charge des dizaines de pipelines. Cette concentration de connaissances devient à la fois un risque pour la livraison et un facteur de coût à long terme. Même lorsque l'infrastructure est bon marché, le temps consacré à l'ingénierie l'est rarement.

Coûts de gouvernance et de conformité

Les données en continu comprennent souvent des informations sensibles ou réglementées : données personnelles, événements financiers, journaux opérationnels ou télémétrie liée aux utilisateurs ou aux appareils.

Garantir un contrôle d'accès, un cryptage, un audit, des politiques de conservation et une conformité appropriés ajoute à la fois des outils et des processus. Les révisions ralentissent les changements. Les incidents de sécurité déclenchent des audits, un travail de documentation et des mesures correctives.

Fourchettes mensuelles types

- Sécurité de base et contrôles d'accès : $500 à $2,000

- Environnements réglementés (finance, santé, SaaS d'entreprise) : $3 000 à $10 000

- Systèmes fortement réglementés ou audités : $15 000+

Ces coûts apparaissent rarement dans les premières estimations car ils augmentent progressivement. Mais une fois qu'un système devient critique pour l'entreprise, la gouvernance n'est plus optionnelle. Elle fait partie des coûts de base constants.

Coûts d'opportunité

C'est la couche la moins visible et souvent la plus chère.

Lorsque les pipelines en temps réel échouent, les produits sont bloqués. Lorsque la latence augmente, les utilisateurs le remarquent. Lorsque les ingénieurs passent des journées entières à résoudre des problèmes de streaming, ils ne sont pas en train de développer des fonctionnalités ou d'améliorer des produits.

Il existe également un coût d'opportunité dans le "over-streaming". Les équipes qui introduisent tout dans les pipelines en temps réel réalisent souvent plus tard qu'une grande partie de ces données n'avait pas besoin d'être traitée immédiatement. Elles paient des coûts permanents pour une vitesse qui n'apporte aucune valeur ajoutée à l'entreprise.

Impact typique

- Des lancements manqués ou des fonctionnalités retardées valant des dizaines de milliers d'euros par mois

- pannes ou problèmes de qualité des données entraînant une perte de revenus ou une désaffection de la clientèle

- Capacité d'ingénierie immobilisée dans la maintenance au lieu de l'innovation

Le coût d'opportunité n'apparaît pas sur les factures de l'informatique dématérialisée, mais il se manifeste dans les feuilles de route, la vitesse de livraison et la position concurrentielle.

Comment nous aidons les équipes à créer des systèmes de données en temps réel rentables

Au Logiciel de liste A, Nous travaillons avec des équipes qui veulent des données en temps réel sans perdre le contrôle des coûts ou de la complexité. Nous avons vu de nos propres yeux comment les systèmes de streaming peuvent tranquillement se transformer en quelque chose de plus lourd que prévu, non pas parce que la technologie est mauvaise, mais parce que la mise en place a été précipitée ou surconstruite. Notre rôle est d'aider nos clients à concevoir des pipelines en temps réel qui correspondent à l'urgence réelle de l'entreprise, et non à une ambition technique abstraite.

Nous agissons comme une extension de votre équipe, en apportant des ingénieurs expérimentés qui comprennent le streaming, les plateformes de données et l'infrastructure cloud, mais qui savent aussi quand le temps réel n'est pas la bonne réponse. Cet équilibre est important. Nous aidons à définir le périmètre dès le début, à choisir des architectures qui évoluent de manière prévisible et à éviter les pièges courants qui augmentent les frais généraux d'ingénierie et d'exploitation au fil du temps.

Parce que nous travaillons dans tous les secteurs et pour toutes les tailles de systèmes, nous nous concentrons sur la mise en œuvre pratique. Qu'il s'agisse de construire et de soutenir des pipelines en temps réel ou de les intégrer dans des plateformes existantes, nous restons proches du travail et des résultats. L'objectif est simple : des systèmes qui fonctionnent quand il le faut, qui restent fiables sous pression et qui sont financièrement rentables à mesure qu'ils se développent.

Les véritables inducteurs de coûts que les équipes négligent le plus souvent

Après avoir examiné de nombreux systèmes en temps réel, quelques schémas reviennent sans cesse.

La diffusion en continu (overstreaming)

Tous les événements n'ont pas besoin d'être traités immédiatement. Les équipes procèdent souvent à une diffusion en continu de toutes les données parce qu'elles se sentent à l'abri de l'avenir. Plus tard, elles se rendent compte que seul un petit sous-ensemble de données permet de prendre des décisions urgentes.

Le filtrage plus tôt dans le pipeline permet d'économiser de l'espace de calcul, de l'espace de stockage et des efforts opérationnels.

Rétention sans objectif

Conserver des mois de données dans un système de stockage à chaud est coûteux. Si les données plus anciennes sont rarement consultées, le fait de les déplacer vers un système de stockage moins coûteux permet de réduire les coûts sans perdre de valeur.

La rétention doit être une décision d'entreprise et non un paramètre par défaut.

Ignorer la charge d'ingénierie

Les pipelines de streaming ne se maintiennent pas d'eux-mêmes. Chaque nouvelle intégration ajoute un coût de maintenance à long terme. Concevoir moins de pipelines de meilleure qualité coûte souvent moins cher que d'en gérer plusieurs fragiles.

Traiter le coût comme un élément statique

Les systèmes en temps réel évoluent. De nouveaux consommateurs apparaissent. Le volume de données augmente. Les modèles de tarification changent. Les estimations de coûts doivent être révisées régulièrement, et non approuvées une seule fois.

Une méthode pratique pour estimer les coûts des données en temps réel

Plutôt que de commencer par les outils ou les fournisseurs, commencez par poser des questions qui lient directement la vitesse des données à l'impact sur l'entreprise. L'objectif est de comprendre où le temps réel est réellement important avant de mettre des chiffres sur l'infrastructure ou les plates-formes.

Utilisez cette liste de contrôle comme point de départ :

- Quelles sont les décisions qui dépendent réellement des données en temps réel ? Identifiez les actions qui perdent de la valeur si elles sont retardées de quelques minutes ou heures, et pas seulement celles qui sont agréables à réaliser.

- Quel est le coût du retard ? Estimer la perte financière, l'exposition au risque, l'impact sur les utilisateurs ou l'interruption des activités causée par un retard dans la prise de conscience.

- Quelle quantité de données doit être traitée immédiatement ? Séparer les flux d'événements critiques des données qui peuvent être traitées par lots sans affecter les résultats.

- Quel est le volume de données prévu et le débit maximal ? Modéliser non seulement la charge moyenne, mais aussi les pics réalistes que le système doit gérer sans s'effondrer.

- Pendant combien de temps les données doivent-elles rester facilement accessibles ? Définir la conservation dans les entrepôts chauds, tièdes et froids en fonction de l'utilisation réelle et non des paramètres par défaut.

- Quel effort d'ingénierie et d'exploitation cela nécessitera-t-il ? Inclure le temps de construction, la maintenance continue, la couverture sur appel, la surveillance et l'intervention en cas d'incident.

Une fois ces éléments en place, additionnez les coûts d'infrastructure, d'ingénierie et d'exploitation pour obtenir une base de référence réaliste. Si ce total vous semble inconfortable, il s'agit là d'une information précieuse. Cela peut indiquer qu'il faut réduire la portée initiale, assouplir les exigences en matière de latence ou adopter une architecture qui mélange plus délibérément le traitement en temps réel et le traitement par lots.

Quand le traitement en temps réel vaut le coût

Le traitement des données en temps réel se justifie lorsque les retards ont un coût mesurable. Si agir quelques minutes ou même quelques secondes plus tard entraîne une perte de revenus, un risque plus élevé ou un impact visible sur l'utilisateur, le streaming justifie rapidement son coût. La détection des fraudes est l'exemple le plus évident, mais il s'applique également à la surveillance des systèmes, aux alertes opérationnelles, à la tarification dynamique et aux expériences utilisateur personnalisées qui dépendent de ce qui se passe à l'instant même. Dans ces cas, les systèmes en temps réel réduisent les pertes, préviennent les pannes ou débloquent des recettes que le traitement par lots ne peut tout simplement pas atteindre à temps.

L'équation change lorsque la vitesse n'affecte pas matériellement les résultats. Les rapports périodiques, les flux de travail de conformité, les analyses historiques et les mesures peu urgentes bénéficient rarement de mises à jour à la seconde près. La diffusion de ces charges de travail ajoute souvent de la complexité et des coûts permanents sans apporter de valeur ajoutée. Pour ces scénarios, le traitement par lots reste plus simple, moins coûteux et plus facile à maintenir. La règle pratique est simple : si le fait d'agir sur les données ultérieurement ne modifie pas la décision, le traitement en temps réel ne vaut généralement pas la peine d'être payé.

Conclusion : Faire du coût une contrainte de conception et non une surprise

Les équipes les plus performantes traitent les coûts comme une partie intégrante de la conception du système, et non comme un problème de facturation à résoudre ultérieurement.

Ils choisissent délibérément la latence. Ils surveillent l'utilisation. Ils simplifient les pipelines. Ils réexaminent les hypothèses au fur et à mesure que les systèmes se développent.

Le traitement des données en temps réel n'est pas bon marché, mais il est rarement aussi coûteux qu'un traitement en temps réel mal planifié. La différence consiste à comprendre d'où viennent les chiffres réels et à les aligner sur la valeur réelle de l'entreprise.

En fin de compte, la question n'est pas de savoir si les données en temps réel sont coûteuses. Il s'agit de savoir si le coût correspond à ce que vous gagnez en agissant plus rapidement.

Questions fréquemment posées

- Le traitement des données en temps réel est-il toujours plus coûteux que le traitement par lots ?

Ce n'est pas toujours le cas, mais le coût de fonctionnement mensuel est généralement plus élevé. La différence essentielle réside dans l'endroit où la valeur se manifeste. Le traitement par lots est moins coûteux et plus simple pour les charges de travail peu urgentes. Le traitement en temps réel devient rentable lorsque le retard entraîne une perte de revenus, un risque plus élevé ou une perturbation opérationnelle. Dans ces cas-là, le coût commercial du retard dépasse souvent le coût technique de la diffusion en continu.

- Quel est le principal facteur de coût des systèmes de données en temps réel ?

Pour la plupart des équipes, les efforts d'ingénierie et d'exploitation l'emportent sur les coûts d'infrastructure pure au fil du temps. Les factures du cloud sont visibles et prévisibles, mais la maintenance continue, le débogage, la surveillance et l'assistance sur appel déterminent tranquillement les dépenses à long terme, en particulier à mesure que le nombre de pipelines augmente.

- Les plateformes gérées de diffusion en continu peuvent-elles réduire les coûts de manière significative ?

Les plateformes gérées réduisent généralement les frais généraux et rendent les coûts plus prévisibles, mais elles ne les éliminent pas complètement. Des pipelines mal conçus, une rétention excessive ou la diffusion en continu de données de faible valeur peuvent encore faire grimper les dépenses. Le plus grand avantage des services gérés est la clarté et la réduction du risque opérationnel, mais pas le coût zéro.

- Comment savoir quelles données ont réellement besoin d'un traitement en temps réel ?

Un test simple consiste à se demander si le fait d'agir sur les données plus tard modifierait la décision. Si la réponse est négative, le traitement en temps réel n'est probablement pas nécessaire. Les données liées à la prévention de la fraude, aux pannes, aux interactions avec les clients ou aux stocks à rotation rapide bénéficient généralement de l'immédiateté. Ce n'est généralement pas le cas des rapports périodiques et des analyses historiques.

- Le micro-batching est-il une alternative moins coûteuse à la diffusion en continu en temps réel ?

Parfois, mais cela introduit souvent ses propres coûts. Le micro-batching réduit la pression sur l'infrastructure par rapport à la diffusion en continu, mais il ajoute de la complexité au niveau de l'ordonnancement, de la gestion des états et du traitement des erreurs. Dans la pratique, il peut s'avérer plus difficile à exploiter que le traitement par lots et plus lent que la véritable diffusion en continu.