Résumé rapide : La transformation numérique en santé publique tire parti de technologies telles que l'IA, l'IdO et l'analyse de données pour améliorer la surveillance des maladies, l'équité en matière de santé et les résultats pour la population. L'OMS l'identifie comme vitale pour atteindre la couverture sanitaire universelle, les mises en œuvre réussies montrant une efficacité accrue et des coûts réduits. Cependant, les défis autour de la gouvernance des données, de l'équité et de l'infrastructure durable doivent être relevés pour éviter d'élargir les disparités en matière de santé.

Les systèmes de santé publique du monde entier sont confrontés à des défis sans précédent. Le vieillissement des populations, le fardeau des maladies chroniques et les menaces infectieuses émergentes exigent de nouvelles approches. La transformation numérique offre une voie à suivre.

Mais voilà, la transformation numérique ne se limite pas à l'adoption de nouvelles technologies. Il s'agit de repenser fondamentalement la manière dont les fonctions de santé publique fonctionnent, dont les données circulent entre les systèmes et dont les populations accèdent aux soins préventifs.

Selon l'Organisation mondiale de la santé, la transformation numérique est essentielle pour parvenir à une couverture sanitaire universelle. Les technologies numériques constituent un élément essentiel et un catalyseur pour améliorer les systèmes de santé durables. L'Initiative mondiale sur la santé numérique de l'Organisation aide les pays à mettre en place des bases solides pour une transformation numérique de la santé qui renforce équitablement les systèmes de santé.

Les enjeux sont considérables. Rien qu'aux États-Unis, 75% des hôpitaux utilisent désormais des systèmes de santé électroniques. Cette infrastructure permet d'obtenir des informations au niveau de la population, ce qui était impossible il y a dix ans.

Comprendre la transformation numérique de la santé publique

La santé publique numérique représente l'application des technologies numériques aux fonctions essentielles de la santé publique : l'évaluation, l'élaboration des politiques, l'allocation des ressources, l'assurance et l'accès. Contrairement à la santé numérique clinique, qui se concentre sur les soins aux patients individuels, la santé publique numérique opère au niveau de la population.

La distinction est importante. Selon une étude publiée dans la revue Health Promotion and Chronic Disease Prevention in Canada, les stratégies actuelles en matière de santé numérique au Canada et ailleurs sont principalement axées sur la santé clinique. Cet oubli signifie que les implications des technologies numériques pour les fonctions de santé publique ne sont pas suffisamment prises en compte.

Dans ce contexte, la transformation numérique ne se limite pas à la numérisation des processus existants. Elle nécessite de repenser l'ensemble des flux de travail, des architectures de données et des modèles de prestation de services.

Composantes essentielles des systèmes numériques de santé publique

Le guide d'investissement pour la mise en œuvre du numérique de l'OMS établit un cadre pour l'intégration des interventions numériques dans les programmes de santé. Ce cadre met l'accent sur les catalogues de produits nationaux normalisés et les processus de gestion des données de référence.

Il ne s'agit pas de concepts abstraits. Ils se traduisent par des capacités pratiques :

- Systèmes de surveillance des maladies en temps réel qui détectent les épidémies quelques heures ou quelques jours plus tôt que les méthodes traditionnelles.

- Des systèmes d'information sur la santé interopérables qui partagent les données entre les juridictions sans réconciliation manuelle

- Plateformes d'analyse prédictive permettant d'identifier les populations à risque avant l'apparition de crises sanitaires

- Des architectures de chaîne d'approvisionnement numérique qui garantissent que les vaccins et les médicaments parviennent efficacement aux communautés.

- Registres de santé de la population permettant des interventions ciblées pour la gestion des maladies chroniques

L'OMS fournit des conseils par étapes pour développer une architecture de chaîne d'approvisionnement en santé numérique évolutive et durable. Cette approche s'adapte aux contextes nationaux spécifiques tout en s'alignant sur les normes internationales telles que les lignes directrices SMART.

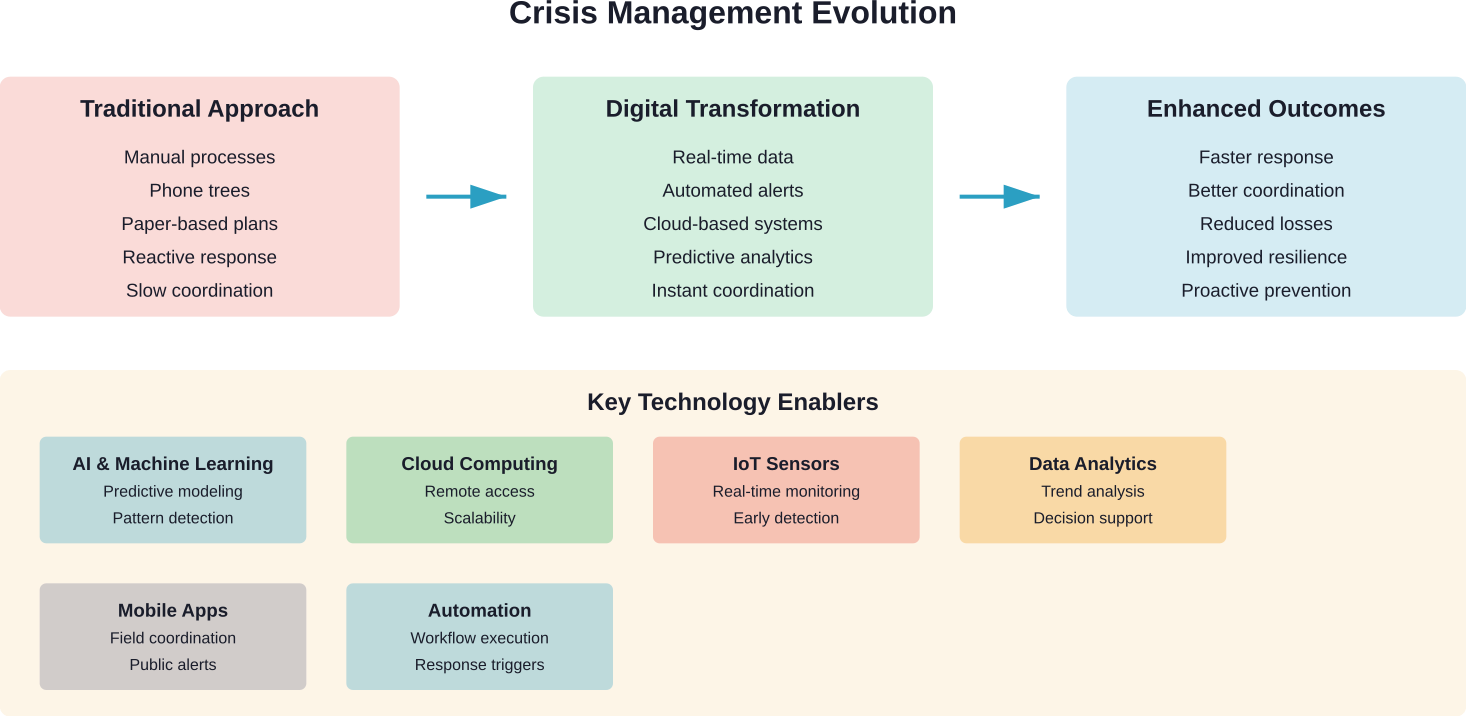

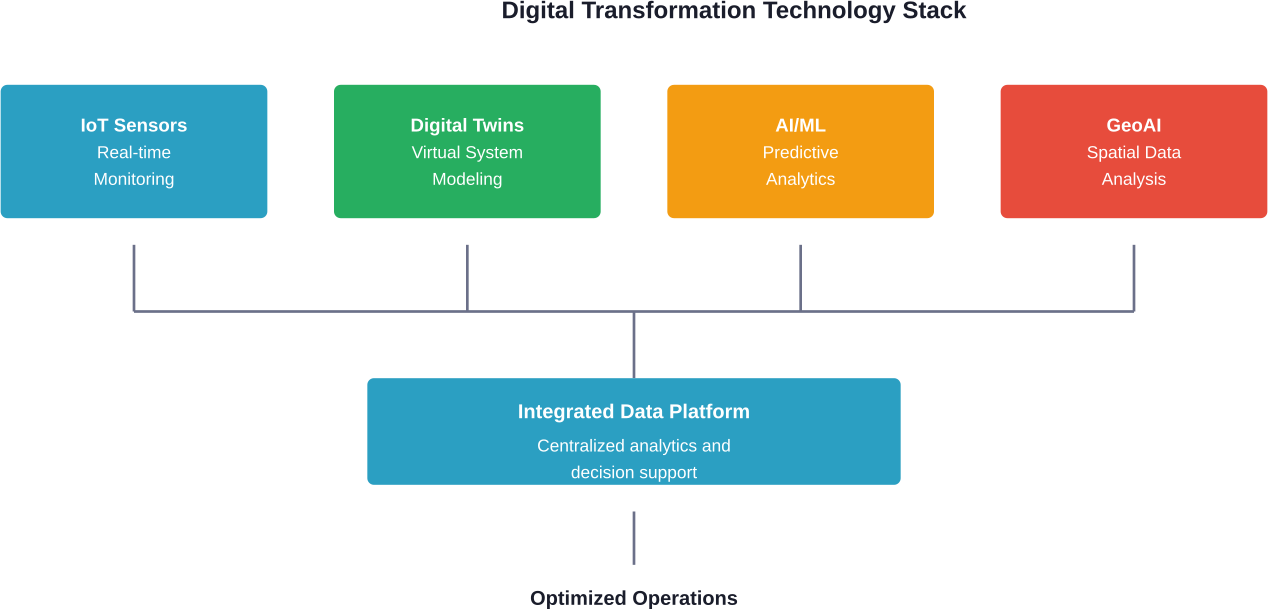

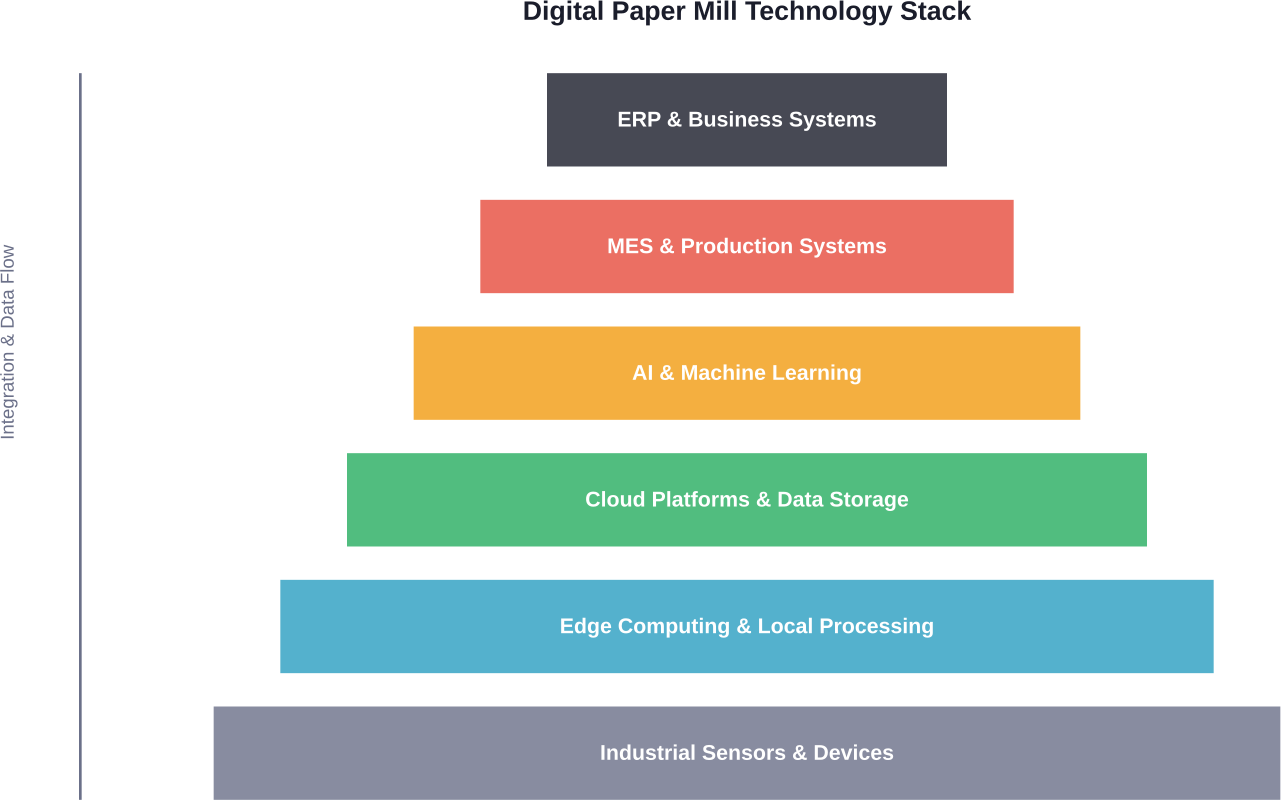

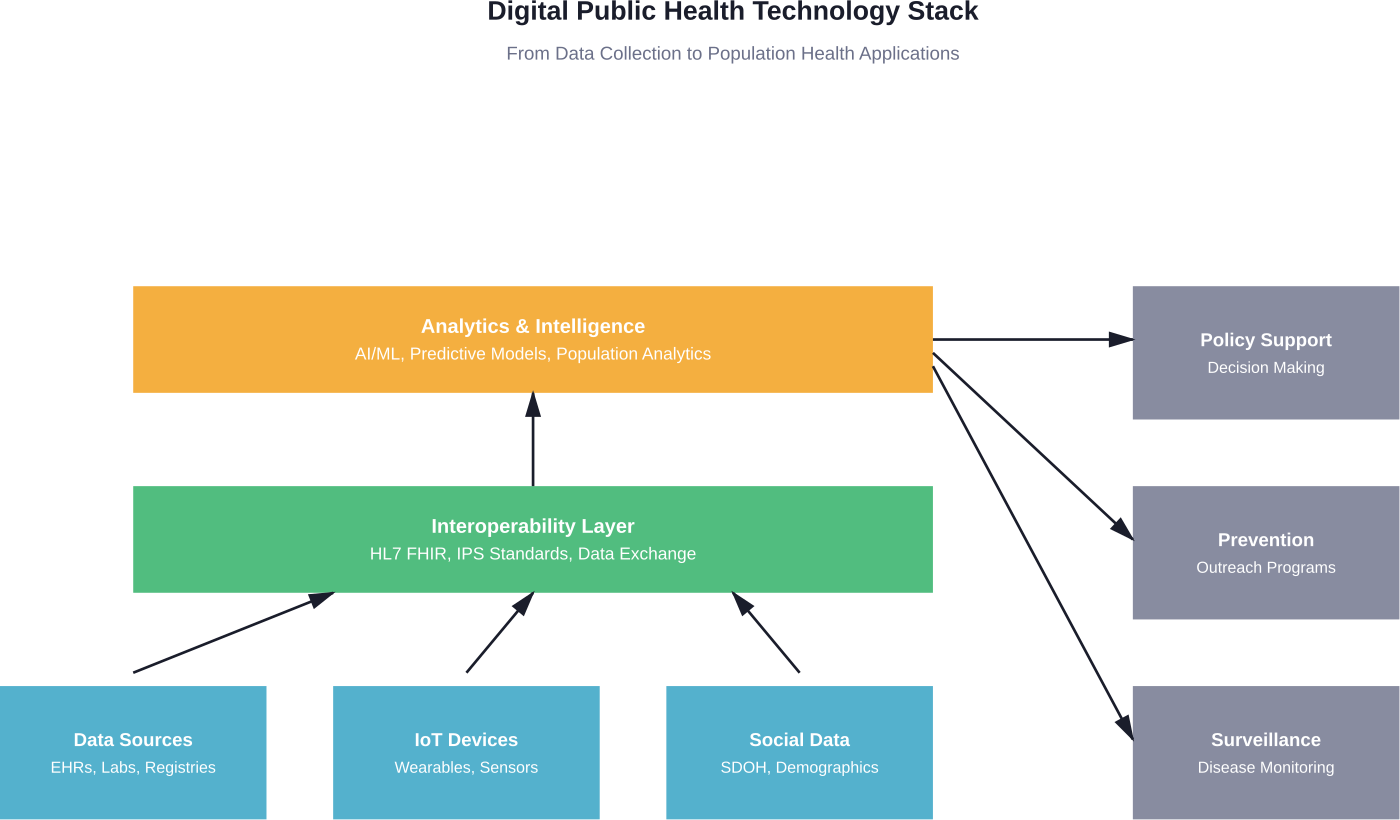

La pile technologique

La santé publique numérique moderne repose sur plusieurs couches technologiques interconnectées. À la base se trouve l'infrastructure de données, c'est-à-dire les systèmes qui collectent, stockent et gèrent les informations sur la santé provenant de diverses sources.

Les normes d'interopérabilité telles que HL7 FHIR (Fast Healthcare Interoperability Resources) permettent à différents systèmes de communiquer. La norme International Patient Summary crée une base commune pour l'échange de données sur les patients au-delà des frontières et des systèmes.

Au-dessus de cette infrastructure, des outils analytiques traitent les données au niveau de la population. Les algorithmes d'apprentissage automatique identifient des modèles. Les systèmes d'information géographique cartographient la répartition des maladies. Le traitement du langage naturel permet d'extraire des informations de notes cliniques non structurées.

Soutien au développement de logiciels pour les projets de santé publique

Les organismes de santé publique ont souvent besoin de meilleurs systèmes internes, d'un meilleur traitement des données et d'une infrastructure plus fiable. Logiciel de liste A propose des services de développement de logiciels, de conseil en informatique, d'analyse de données, de cybersécurité et d'infrastructure, ainsi que des équipes de développement spécialisées. L'entreprise peut soutenir les projets de santé publique avec des logiciels personnalisés, la modernisation des systèmes existants et une capacité d'ingénierie supplémentaire.

Vous avez besoin d'une équipe pour créer ou soutenir un logiciel de santé publique ?

Discutez avec A-listware pour :

- créer des logiciels personnalisés pour les opérations internes

- moderniser les anciens systèmes difficiles à entretenir

- ajouter des développeurs, des ingénieurs de données ou des spécialistes de la sécurité

Commencez par demander une consultation avec A-listware.

Intelligence artificielle et applications en matière de santé publique

Le rôle de l'IA dans la transformation de la santé publique va bien au-delà de l'aide à la décision clinique. Le CDC a publié un commentaire sur l'équité en matière de santé et les considérations éthiques liées à l'utilisation de l'intelligence artificielle en santé publique et en médecine, soulignant à la fois les opportunités et les risques.

La technologie est particulièrement prometteuse dans plusieurs domaines. Les systèmes de surveillance des maladies améliorés par l'IA peuvent détecter des schémas inhabituels dans les visites aux urgences, les ventes de médicaments sur ordonnance ou les mentions dans les médias sociaux qui signalent des épidémies émergentes.

Une recherche publiée dans BMC Public Health a analysé l'impact de la transformation numérique régionale sur la santé publique dans 31 provinces chinoises. L'étude a introduit l'innovation technologique comme variable médiatrice et a constaté des effets positifs significatifs sur les résultats en matière de santé de la population.

Applications pratiques de l'IA

La transformation de la santé numérique grâce aux technologies de l'IA et de l'internet des objets remodèle la prestation des soins de santé à l'échelle mondiale. Une étude de 2025 dans Digital Health a examiné les soins de santé durables grâce à diverses applications technologiques de l'AIoT.

Les mises en œuvre dans le monde réel démontrent des avantages concrets :

- Dépistage automatisé de la tuberculose à partir de radiographies du thorax dans des environnements à ressources limitées, augmentant la capacité de diagnostic sans augmentation proportionnelle du nombre de radiologues.

- Modèles prédictifs identifiant les personnes à haut risque de complications du diabète, permettant des programmes de prévention ciblés

- Systèmes de traitement du langage naturel extrayant les déterminants sociaux de la santé des notes cliniques, révélant les facteurs en amont affectant la santé de la population

- Algorithmes de vision par ordinateur analysant l'imagerie satellitaire pour identifier les zones où les infrastructures sanitaires sont insuffisantes ou les sites de reproduction des vecteurs.

Mais attendez. La mise en œuvre de l'IA dans le domaine de la santé publique est confrontée à des défis distincts de ceux des applications cliniques. Les interventions au niveau de la population nécessitent l'accord de la société. Les politiques fondées sur l'IA - qu'elles concernent l'affectation des ressources, les dépistages ciblés ou les restrictions en matière de santé publique - touchent des personnes qui peuvent ne pas en bénéficier directement.

Le CDC souligne que toutes les parties prenantes, des décideurs politiques au public, ont besoin de perspectives équilibrées sur les avantages, les risques et les coûts des changements numériques. Des repères et des critères transparents deviennent essentiels pour garantir un maximum d'avantages sans marginaliser les minorités ou les groupes vulnérables.

Considérations sur les fonds propres

L'évolution numérique pose de sérieux problèmes d'équité. Les populations vulnérables se heurtent à des obstacles liés aux contraintes économiques, à l'isolement géographique ou à l'analphabétisme numérique. Sans une conception intentionnelle, la transformation numérique risque d'amplifier les disparités existantes en matière de santé au lieu de les éliminer.

Une recherche analysant les stratégies organisationnelles de santé publique numérique dans les programmes provinciaux canadiens a révélé que la confidentialité et les sensibilités organisationnelles créent des obstacles au partage des données et à l'innovation collaborative. Ces problèmes structurels affectent de manière disproportionnée les communautés mal desservies qui pourraient bénéficier le plus des interventions en matière de santé de la population.

En réalité, l'équité ne se limite pas à garantir l'égalité d'accès à la technologie. Elle exige de comprendre comment les systèmes numériques peuvent perpétuer les préjugés à travers les données de formation, la conception des algorithmes ou les choix de mise en œuvre.

Architecture et interopérabilité des données

Une santé publique numérique efficace dépend d'une infrastructure de données robuste. Le manuel de l'OMS sur la transformation numérique pour l'architecture de la chaîne d'approvisionnement de la santé fournit des conseils par étapes pour développer des systèmes évolutifs.

Cette approche met l'accent sur plusieurs principes clés. Tout d'abord, la normalisation. Sans définitions et formats de données communs, les systèmes ne peuvent pas communiquer efficacement. Deuxièmement, la modularité. Les composants doivent pouvoir être remplacés et mis à niveau sans qu'il soit nécessaire de reconstruire des systèmes entiers. Troisièmement, la durabilité. Les solutions doivent fonctionner avec les ressources et l'expertise disponibles.

Le défi de l'interopérabilité

Les données de santé existent en silos. Les systèmes hospitaliers ne communiquent pas avec les registres de santé publique. Les systèmes d'information des laboratoires utilisent des schémas de codage différents de ceux des bases de données sur les vaccinations. Les organismes de services sociaux suivent les déterminants de la santé séparément des prestataires médicaux.

Des normes telles que HL7 FHIR relèvent ces défis en définissant la manière dont les informations de santé sont échangées par voie électronique. Le résumé international du patient fournit un ensemble minimal d'éléments de données pour l'échange transfrontalier et intersystème d'informations sur les patients.

Selon HL7, les DSE et les fournisseurs de technologies de l'information dans le domaine de la santé accélèrent l'adoption de l'IPS. La norme crée une base commune pour l'échange de résumés de patients au-delà des frontières et des systèmes de santé. En août 2024, de nombreux fournisseurs de DSE avaient mis en place la prise en charge de l'IPS, permettant ainsi une véritable interopérabilité des dossiers médicaux.

Les implications pratiques sont importantes. Un réfugié arrivant dans un nouveau pays pourrait avoir son historique de vaccination, ses maladies chroniques et ses allergies médicamenteuses immédiatement à la disposition des prestataires de soins de santé. Une enquête sur une épidémie pourrait rapidement rassembler des données sur l'exposition provenant de plusieurs juridictions.

L'approche modulaire

Le guide d'investissement pour la mise en œuvre numérique de l'OMS préconise une méthodologie modulaire. Plutôt que des systèmes monolithiques, l'infrastructure de santé numérique comprend des éléments modulaires qui fonctionnent ensemble.

Ces éléments constitutifs sont les suivants

| Bloc de construction | Fonction | Exemples |

|---|---|---|

| Registre des clients | Identification unique des personnes dans tous les systèmes | Index général des patients, intégration de l'identification nationale |

| Registre des installations | Liste normalisée des lieux de prestation de services de santé | Annuaires des hôpitaux, bases de données de géolocalisation des cliniques |

| Service de terminologie | Vocabulaires médicaux communs et correspondances de codes | Mise en œuvre de la SNOMED CT, de la CIM-10 et de la LOINC |

| Dossier médical partagé | Données longitudinales sur les patients accessibles à tous les prestataires | Échanges régionaux d'informations sur la santé |

| Registre du personnel de santé | Titres de compétences et déploiement du personnel de santé | Répertoires de prestataires, bases de données sur les autorisations d'exercer |

Cette approche modulaire permet aux pays de mettre en œuvre les composants de manière progressive en fonction des priorités et des ressources. Un pays peut commencer par un registre des établissements pour améliorer la logistique de la chaîne d'approvisionnement, puis ajouter un registre des clients pour permettre un suivi longitudinal des patients.

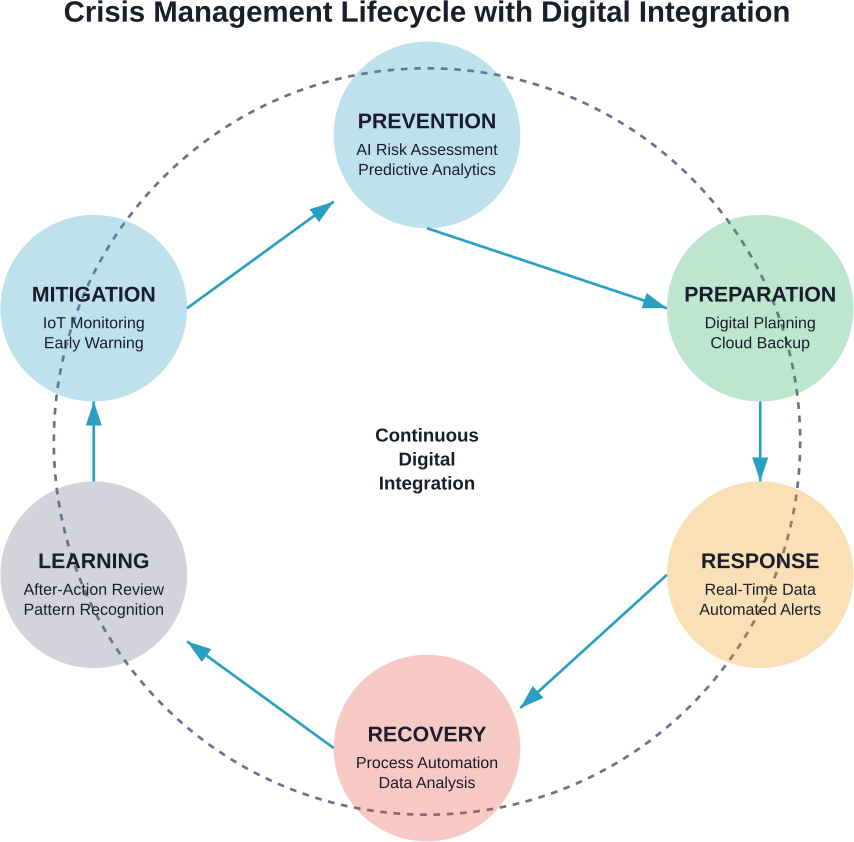

Transformation numérique pour les maladies non transmissibles

La pandémie de SRAS-CoV-2 a démontré l'efficacité d'un déploiement numérique rapide en matière de santé publique. Des applications numériques de traçage de proximité ont exploité les capacités Bluetooth pour tracer et notifier les utilisateurs en cas d'exposition potentielle. Soutenus par des organisations telles que l'OMS et l'Union européenne, ces outils ont démontré les promesses de la santé publique numérique.

Aujourd'hui, l'attention se déplace. Les maladies non transmissibles sont responsables de la grande majorité des dépenses de santé et des années de vie prématurées corrigées de l'incapacité perdues. Une recherche publiée dans JMIR Public Health and Surveillance a examiné la transformation numérique de la santé publique pour les maladies non transmissibles.

La description des MNT diffère de celle des maladies infectieuses. Les maladies chroniques se développent au fil des ans. Les facteurs de risque englobent les comportements individuels, les déterminants sociaux, les expositions environnementales et les prédispositions génétiques. Les interventions nécessitent un engagement durable plutôt que des réponses aiguës.

Interventions numériques pour la prévention des maladies chroniques

Les technologies numériques permettent des approches au niveau de la population qui étaient auparavant irréalisables. Les applications de santé mobile favorisent le changement de comportement grâce à un retour d'information personnalisé et à un soutien social. Les dispositifs portables permettent de suivre en permanence l'activité physique, les habitudes de sommeil et les marqueurs physiologiques.

Mais les outils individuels ne représentent qu'une partie de l'opportunité. Les plateformes de gestion de la santé de la population analysent les données agrégées pour identifier les communautés présentant un risque élevé de maladies cardiovasculaires. Les systèmes d'information géographique cartographient les déserts alimentaires et l'accès aux installations de loisirs. Les modèles prédictifs prévoient quels patients sont susceptibles de développer des complications en l'absence d'intervention.

Ces capacités soutiennent les fonctions essentielles de la santé publique différemment des approches traditionnelles. Pour l'évaluation, les systèmes numériques fournissent des mesures de la santé de la population en temps quasi réel plutôt que des enquêtes périodiques. Pour l'élaboration des politiques, les modèles de simulation permettent d'estimer l'impact des interventions avant leur mise en œuvre. Pour l'assurance, le contrôle automatisé permet de vérifier si les services de prévention atteignent les populations visées.

L'élément humain

Cependant, l'intelligence artificielle et les outils numériques ne peuvent pas remplacer le contact humain dans la promotion de la santé. Le soutien émotionnel, la sensibilité culturelle et l'instauration d'un climat de confiance restent des activités fondamentalement humaines.

L'IA est plus efficace en tant que compagnon guidant les personnes dans le paysage des soins de santé. Elle automatise les tâches répétitives, libérant ainsi les prestataires pour qu'ils donnent la priorité aux interactions personnelles qui ne peuvent pas être numérisées. Elle fournit aux individus des outils leur permettant d'être proactifs dans la gestion de leur santé. Mais elle ne remplace pas l'empathie ou le jugement clinique.

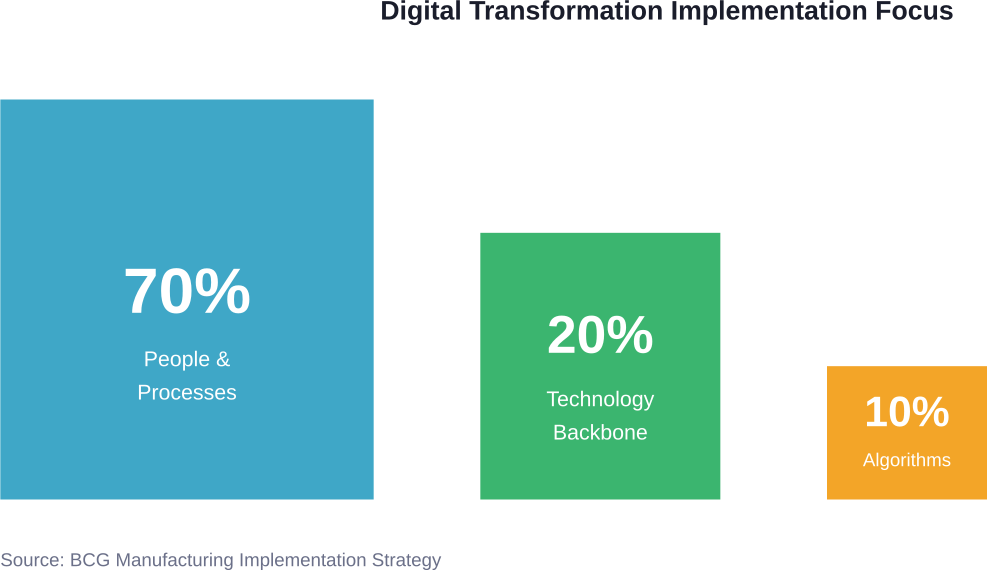

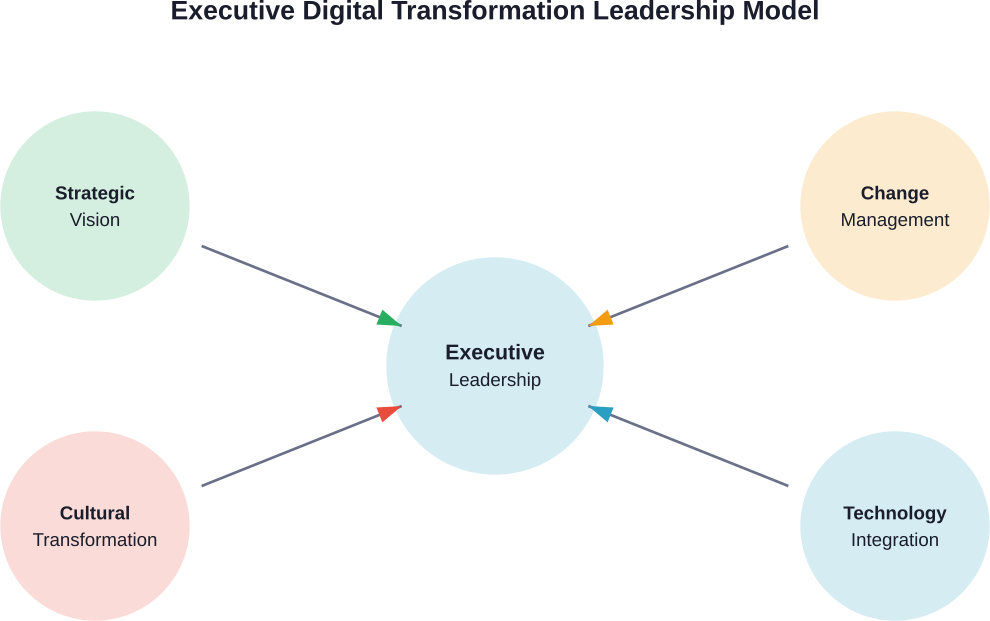

Une recherche sur la transformation numérique de la santé publiée dans le Journal of Healthcare Leadership a examiné les facteurs organisationnels qui déterminent la réalisation des avantages. L'étude a révélé que les changements dans les capacités du système et la culture organisationnelle comptent autant que le choix de la technologie.

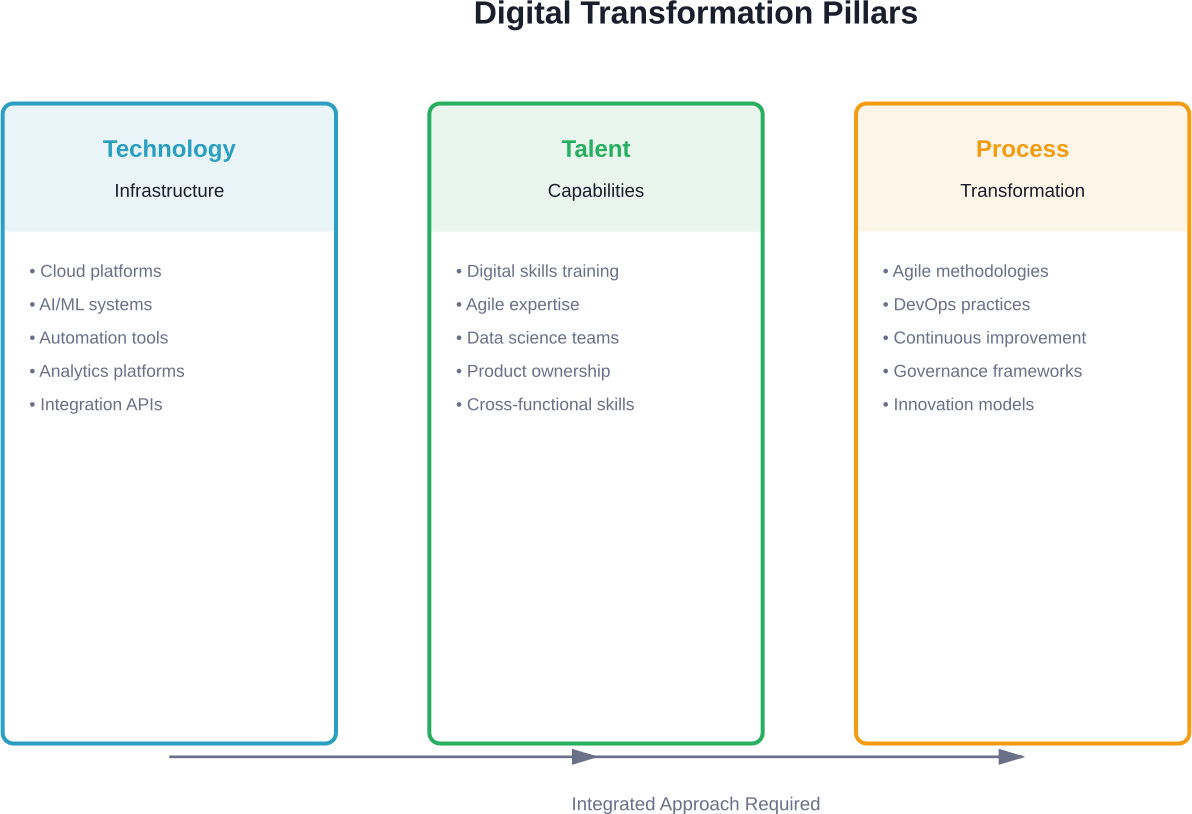

Stratégies de mise en œuvre et gouvernance

La technologie seule ne suffit pas à créer la transformation. La réussite de la santé publique numérique nécessite une planification stratégique, une gestion du changement et des structures de gouvernance qui concilient l'innovation et la responsabilité.

L'Organisation panaméricaine de la santé a publié huit principes directeurs pour la transformation numérique de la santé publique. Ces principes traitent des changements culturels tant pour le personnel de santé que pour les populations, et visent à soutenir la prise de décision éclairée et l'élaboration de politiques publiques durables.

Huit principes fondamentaux

Le cadre de l'OPS souligne que la numérisation implique d'importants changements culturels.

Ces principes guident les pays dans l'élaboration d'objectifs à court et à long terme, tout en veillant à ce que personne ne soit laissé pour compte :

- Accès universel et équité dans les services de santé numériques

- Une conception centrée sur la personne qui place les individus et les communautés au centre des préoccupations

- La protection des données et de la vie privée : des exigences fondamentales

- Interopérabilité et normalisation des systèmes

- Prise de décision fondée sur des données fiables

- Durabilité grâce à des choix technologiques appropriés

- Collaboration multisectorielle au-delà des ministères de la santé

- Évaluation continue et apprentissage à partir de la mise en œuvre

Il ne s'agit pas d'idéaux abstraits. Ils se traduisent par des choix de mise en œuvre concrets. La conception centrée sur la personne implique d'impliquer les membres de la communauté dans le développement du système, et pas seulement de déployer des solutions conçues par des technologues. La protection des données nécessite des cadres de gouvernance avant de collecter des informations sensibles sur la santé. La durabilité implique de choisir des plateformes à code source ouvert plutôt que des systèmes propriétaires dans des contextes où les ressources sont limitées.

Préparation organisationnelle

La recherche sur les facteurs organisationnels qui favorisent la réalisation des bénéfices de la transformation numérique de la santé a identifié des capacités critiques au-delà de la mise en œuvre de la technologie. Les gestionnaires des services de santé ont besoin de nouvelles compétences en matière de maîtrise des données, de gestion du changement et de stratégie numérique.

Une étude qualitative publiée dans le Journal of Healthcare Leadership a montré que des améliorations organisationnelles et des changements dans les capacités du système sont nécessaires pour obtenir les avantages de la transformation. Les solutions techniques échouent en l'absence de changements correspondants dans les flux de travail, la culture et la gouvernance.

L'évaluation des progrès numériques nécessite des cadres complets. Une revue narrative de 2024 dans JMIR Public Health and Surveillance a examiné les indicateurs permettant d'évaluer la maturité des systèmes de santé publique numérique. L'étude a identifié 286 indicateurs pertinents à partir de 90 références, 46,5% ayant une pertinence juridique liée au big data, à la réglementation de l'IA, à la cybersécurité, aux stratégies nationales ou à la gouvernance des données de santé.

Investissement et durabilité

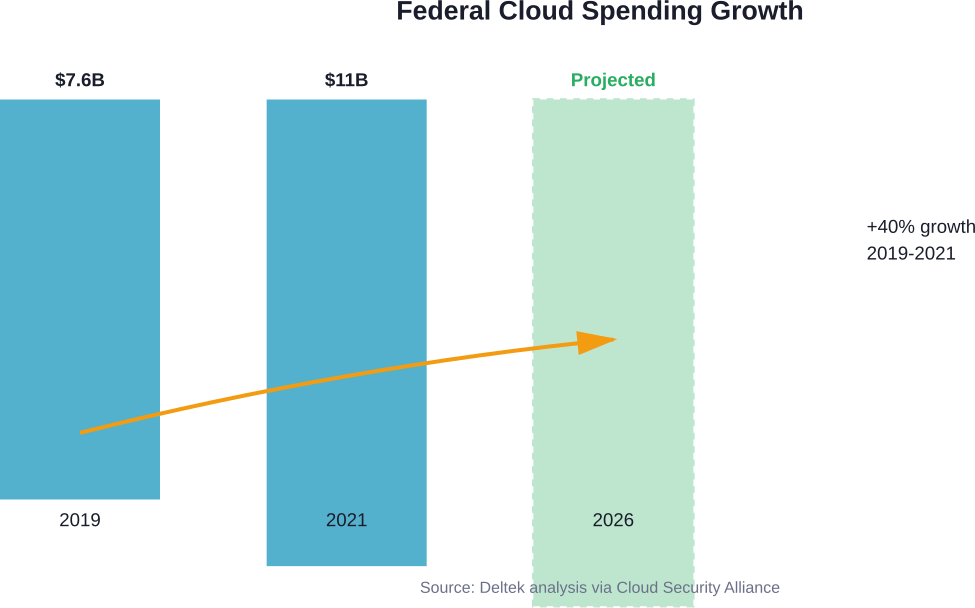

La transformation numérique nécessite des investissements soutenus. En 2018, plus de $9 milliards ont été investis dans des startups de santé numérique par le capital-risque et le capital-investissement, selon la recherche sur les défis actuels et les solutions aux technologies de santé numérique dans la production de preuves.

Mais le fait de financer des entreprises de santé numérique ne renforce pas automatiquement l'infrastructure de santé publique. Les investissements du secteur public doivent se concentrer sur des plateformes durables et évolutives qui répondent aux besoins de santé de la population plutôt que sur des applications individuelles destinées aux consommateurs.

Le document de discussion de l'Académie nationale de médecine sur une architecture nationale de données et de technologies numériques pour la santé affirme que le secteur de la santé est à la traîne dans le développement d'une infrastructure numérique robuste nécessaire à la pleine réalisation des innovations. Cela limite les gains potentiels en termes d'efficacité, d'accès, de prévention, de diagnostic, de traitement, de découverte et de résultats en matière de santé publique.

Défis et obstacles actuels

La transformation numérique se heurte à des obstacles importants. Comprendre ces obstacles aide les organisations à élaborer des stratégies de mise en œuvre réalistes et à éviter les pièges les plus courants.

Défis techniques

Les systèmes existants présentent des obstacles majeurs. De nombreux organismes de santé publique utilisent des plateformes technologiques construites il y a plusieurs dizaines d'années. Ces systèmes ne peuvent pas s'intégrer facilement aux applications modernes basées sur le cloud ou prendre en charge l'échange de données en temps réel.

Les problèmes de qualité des données nuisent à l'analyse. Les enregistrements incomplets, les codages incohérents et les entrées en double créent un bruit qui obscurcit les signaux significatifs. Le nettoyage et la normalisation des données nécessitent des efforts considérables avant que des analyses avancées ne soient possibles.

Les préoccupations en matière de cybersécurité augmentent à mesure que les systèmes s'interconnectent. Les données de santé représentent une cible précieuse pour les acteurs malveillants. La protection de la vie privée tout en permettant un partage approprié des données nécessite des architectures de sécurité et une gouvernance sophistiquées.

Lacunes en matière de main-d'œuvre et de capacités

Les capacités des effectifs de santé publique en matière de transformation numérique restent limitées. Un protocole 2023 publié dans JMIR Research Protocols décrit une école nationale multidisciplinaire de recherche sur l'innovation en santé conçue pour renforcer les capacités de transformation numérique dans le système de santé.

Les doctorants de ces écoles de recherche obtiennent généralement leur doctorat en cinq ans, en consacrant environ 80% aux études et 20% à des tâches spécifiques à l'organisation. Ce modèle reconnaît que le renforcement des capacités en matière de santé publique numérique nécessite des programmes de formation formels, et pas seulement un apprentissage sur le tas.

Le personnel à tous les niveaux a besoin de nouvelles compétences. Les épidémiologistes doivent comprendre les bases de l'apprentissage automatique pour interpréter les informations générées par l'IA. Les analystes de données ont besoin de connaissances dans le domaine de la santé publique pour poser des questions pertinentes. Les gestionnaires de programmes ont besoin de connaissances numériques pour prendre des décisions technologiques éclairées.

Obstacles à l'équité et à l'accès

La fracture numérique menace d'aggraver les disparités en matière de santé. Les communautés rurales manquent souvent de l'infrastructure à large bande nécessaire à la télémédecine ou aux systèmes de surveillance en temps réel. Les populations à faible revenu se heurtent à des obstacles pour accéder aux smartphones ou aux ordinateurs nécessaires à l'utilisation des outils de santé numériques.

La langue et l'alphabétisation créent des obstacles supplémentaires. Les systèmes d'information sur la santé conçus pour des utilisateurs anglophones ayant fait des études supérieures excluent des pans entiers de nombreuses communautés. Une santé publique numérique réellement inclusive nécessite des interfaces multilingues, des options audio et une navigation simplifiée.

Les lacunes en matière de culture numérique liées à l'âge touchent à la fois les populations âgées et les professionnels de la santé proches de la retraite. Les systèmes de formation et de soutien doivent tenir compte des différents niveaux de confort technologique.

Gouvernance et défis politiques

Les cadres de gouvernance des données sont à la traîne par rapport aux capacités techniques. La question de savoir à qui appartiennent les données de santé, qui peut y accéder et à quelles fins reste controversée. Les réglementations varient d'une juridiction à l'autre, ce qui complique les collaborations multiétatiques ou internationales.

Les réglementations en matière de protection de la vie privée conçues pour les soins de santé traditionnels ne tiennent pas toujours compte des nouveaux scénarios numériques. Les organismes de santé publique peuvent-ils utiliser les données de localisation des smartphones pour suivre la transmission des maladies ? Les algorithmes d'IA doivent-ils avoir accès à l'intégralité des dossiers médicaux pour identifier les populations à risque ? Ces questions n'ont pas de réponses claires dans de nombreuses juridictions.

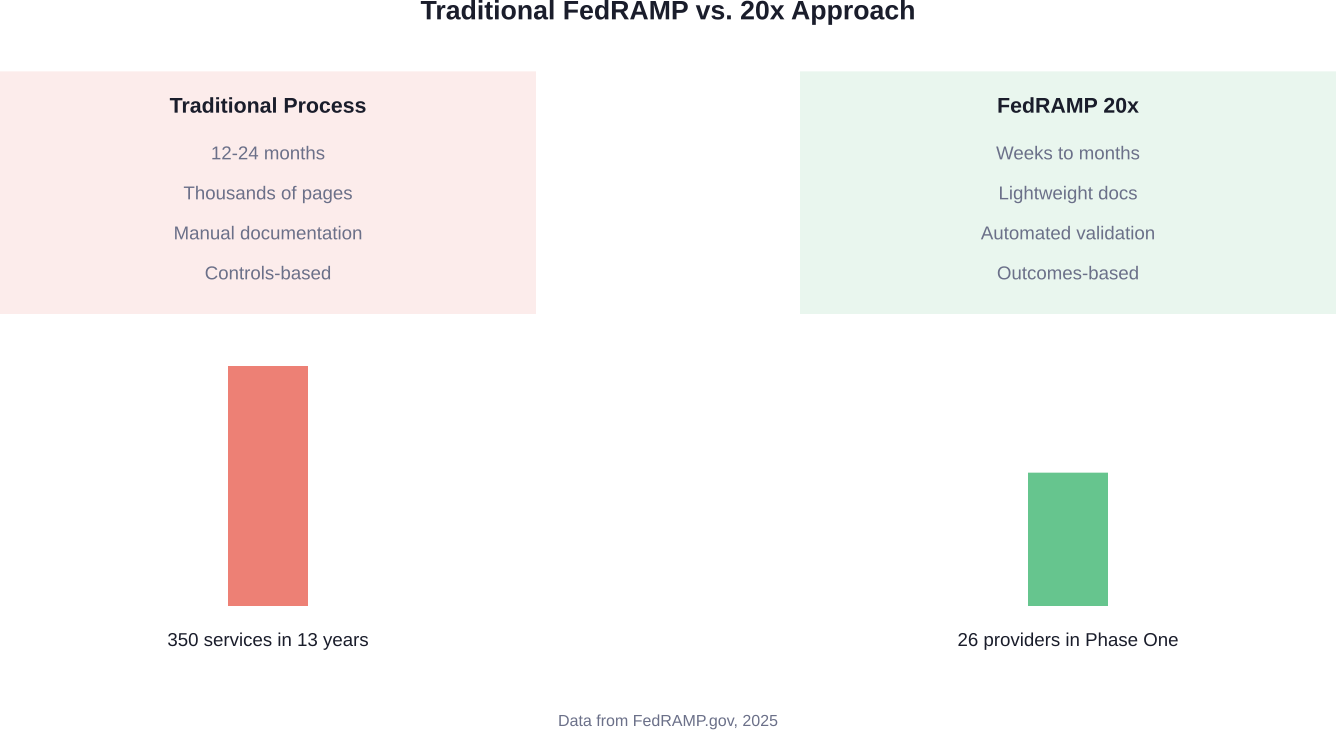

Les processus de passation de marchés conçus pour les biens matériels ne sont pas adaptés aux logiciels et aux services en nuage. La longueur des cycles d'approbation empêche les agences d'adopter des technologies qui évoluent rapidement. Les règles d'achat peu enclines au risque favorisent les fournisseurs établis au détriment des jeunes entreprises innovantes.

Mesurer l'impact et les résultats

Démontrer la valeur des investissements dans la transformation numérique nécessite des mesures et des cadres d'évaluation clairs. Mais la mesure des résultats en matière de santé de la population présente des défis distincts de l'évaluation de l'efficacité clinique.

Indicateurs clés de performance

La recherche sur la transformation numérique dans les soins de santé a révélé que les avantages typiques comprennent l'augmentation de la productivité des employés, l'amélioration de l'efficacité et de l'efficience des opérations des unités de santé, et la réduction des coûts d'exploitation.

Pour la santé publique en particulier, les mesures pertinentes couvrent de multiples domaines :

| Domaine | Exemples de mesures | Approche de la mesure |

|---|---|---|

| Efficacité | Temps écoulé entre la détection de l'épidémie et la réaction ; réduction de la charge de travail liée à la saisie des données | Traitement des études de temps ; suivi du temps de travail du personnel |

| Efficacité | Taux de couverture vaccinale ; portée du programme de dépistage ; rapidité de la lutte contre les épidémies | Données sur la participation au programme ; surveillance de l'incidence des maladies |

| Fonds propres | Disparités dans l'accès aux services ; utilisation d'outils numériques dans toutes les catégories démographiques | Analyse stratifiée de l'utilisation ; enquêtes communautaires |

| Expérience de l'utilisateur | Satisfaction des prestataires ; niveaux d'engagement du public ; scores de convivialité du système | Enquêtes auprès des utilisateurs ; tests de convivialité ; analyse de l'engagement |

| Économique | Coût par intervention ; retour sur investissement ; efficacité de l'allocation des ressources | Analyse coût-efficacité ; modélisation de l'impact budgétaire |

Le défi réside dans l'attribution. La santé des populations s'améliore grâce à de multiples facteurs. Pour isoler la contribution spécifique des systèmes numériques, il faut des modèles d'évaluation rigoureux.

Défis liés à la production de preuves

Les technologies numériques de santé peuvent potentiellement améliorer les résultats en matière de santé en augmentant la participation des patients à l'autogestion des soins, en améliorant la communication et en adaptant les services aux besoins individuels. Toutefois, la production de données fiables sur les effets au niveau de la population se heurte à des difficultés méthodologiques.

Les essais contrôlés randomisés - l'étalon-or de la recherche clinique - s'avèrent souvent peu pratiques pour les interventions en matière de santé des populations. L'affectation aléatoire de communautés à des approches numériques par rapport à des approches traditionnelles soulève des questions éthiques et logistiques.

D'autres approches incluent des conceptions quasi-expérimentales comparant des juridictions similaires avec des calendriers de mise en œuvre différents. Les analyses de séries chronologiques permettent d'identifier les changements de tendances après le déploiement d'un système numérique. Les expériences naturelles tirent parti des variations de politiques entre les régions.

Les données provenant des systèmes numériques eux-mêmes permettent de nouvelles approches d'évaluation. Le suivi continu remplace les enquêtes périodiques. Les données granulaires permettent des analyses de sous-groupes impossibles à réaliser avec les méthodes traditionnelles. Mais ces possibilités exigent une attention particulière aux biais et aux confusions.

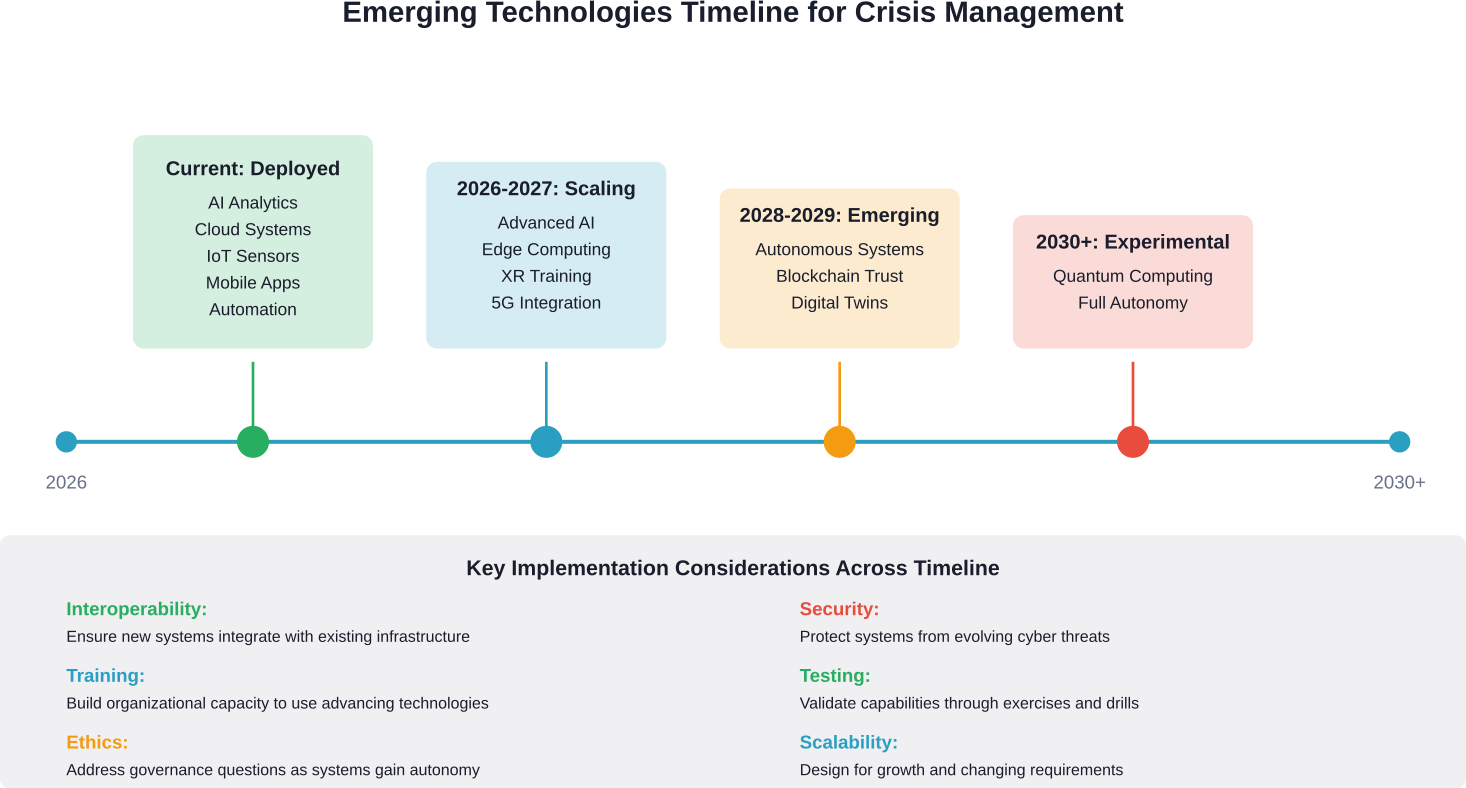

Orientations futures et tendances émergentes

La santé publique numérique continue d'évoluer rapidement. Plusieurs tendances façonneront la trajectoire du domaine dans les années à venir.

Intégration de l'IA et grands modèles linguistiques

Les modèles de langage à grande échelle représentent un développement important pour les applications de santé publique. Ces systèmes d'IA peuvent traiter des textes non structurés à grande échelle, en extrayant des informations des notes cliniques, des messages sur les médias sociaux ou de la littérature scientifique.

Selon les réflexions de novembre 2025 de HL7 sur l'élaboration d'une infrastructure de normes pour l'IA dans le secteur de la santé, l'adoption rapide de l'IA crée un nouveau moment charnière après des décennies d'efforts en faveur d'une interopérabilité transparente des données de santé. L'élaboration des normes doit suivre le rythme des capacités technologiques.

Les applications potentielles comprennent des analyses documentaires automatisées pour identifier les menaces sanitaires émergentes, des chatbots fournissant une éducation à la santé culturellement appropriée et des systèmes extrayant des données sur les déterminants sociaux à partir de diverses sources. Cependant, garantir l'exactitude, prévenir les biais et maintenir une surveillance humaine restent des défis essentiels.

Blockchain et systèmes distribués

La technologie blockchain offre des possibilités d'échange sécurisé et décentralisé de données de santé. Les individus pourraient contrôler l'accès à leurs informations de santé tout en permettant un partage approprié à des fins de santé publique. Les applications de la chaîne d'approvisionnement pourraient suivre les produits pharmaceutiques de la fabrication à l'administration, réduisant ainsi les risques de contrefaçon.

Mais la blockchain n'est pas une panacée. La consommation d'énergie, les limites de l'évolutivité et les incertitudes réglementaires tempèrent l'enthousiasme. Les applications pratiques en matière de santé publique restent limitées par rapport au battage médiatique.

Santé publique de précision

L'intégration des données génomiques avec les expositions environnementales, les déterminants sociaux et les facteurs comportementaux permet des interventions de plus en plus ciblées. Plutôt que des programmes uniques, la santé publique de précision adapte les approches à des segments spécifiques de la population.

Cette évolution reflète le passage de la médecine de précision des moyennes de la population aux caractéristiques individuelles. Les systèmes numériques rendent la santé publique de précision pratique en traitant les données complexes nécessaires pour identifier des sous-groupes significatifs et personnaliser les interventions.

Plateformes de collaboration mondiale

L'initiative mondiale de l'OMS sur la santé numérique favorise un meilleur alignement dans le secteur de la santé numérique. L'initiative fournit aux gouvernements et aux partenaires les outils, les éléments constitutifs et les plateformes nécessaires à une numérisation durable des systèmes de santé.

La collaboration internationale accélère les progrès. Les pays peuvent tirer des enseignements des succès et des échecs de leurs pairs. L'harmonisation des normes permet l'échange transfrontalier de données essentielles pour le suivi des pandémies et des problèmes de santé liés aux migrations. Les plateformes partagées réduisent les coûts de développement en double.

La vision : des pays soutenus durablement pour planifier, financer et développer des bases solides pour la transformation numérique de la santé qui renforce équitablement les systèmes de santé dans le monde entier.

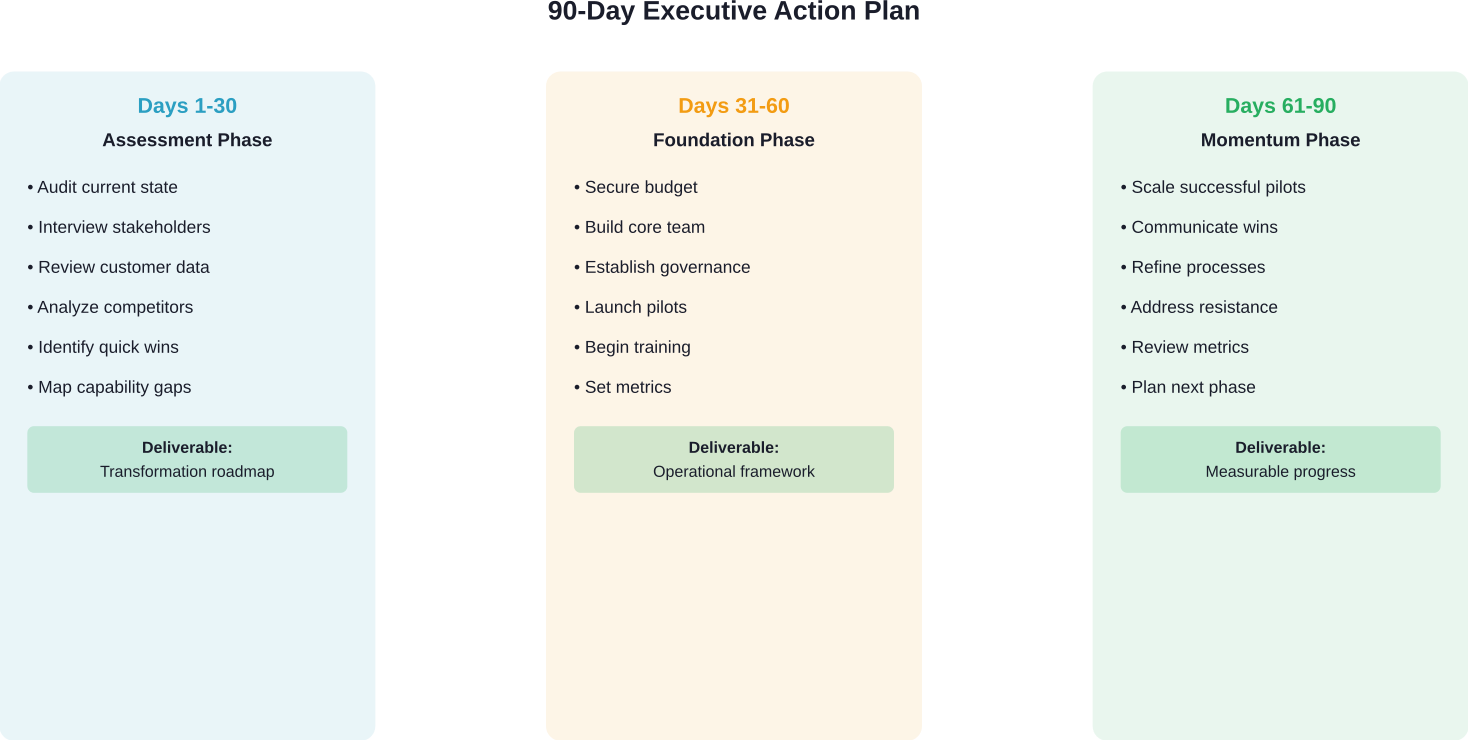

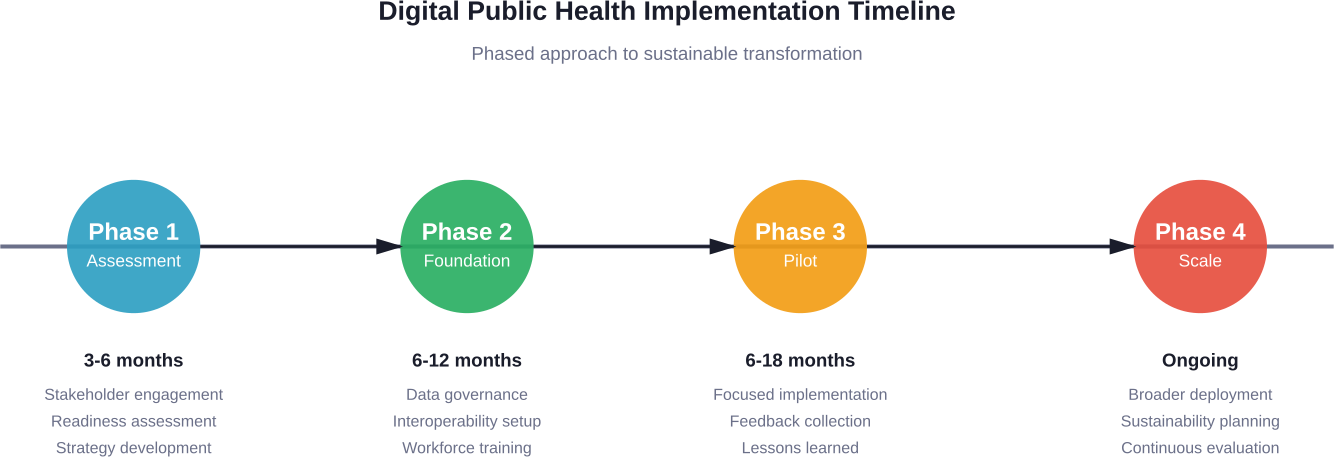

Feuille de route pratique pour la mise en œuvre

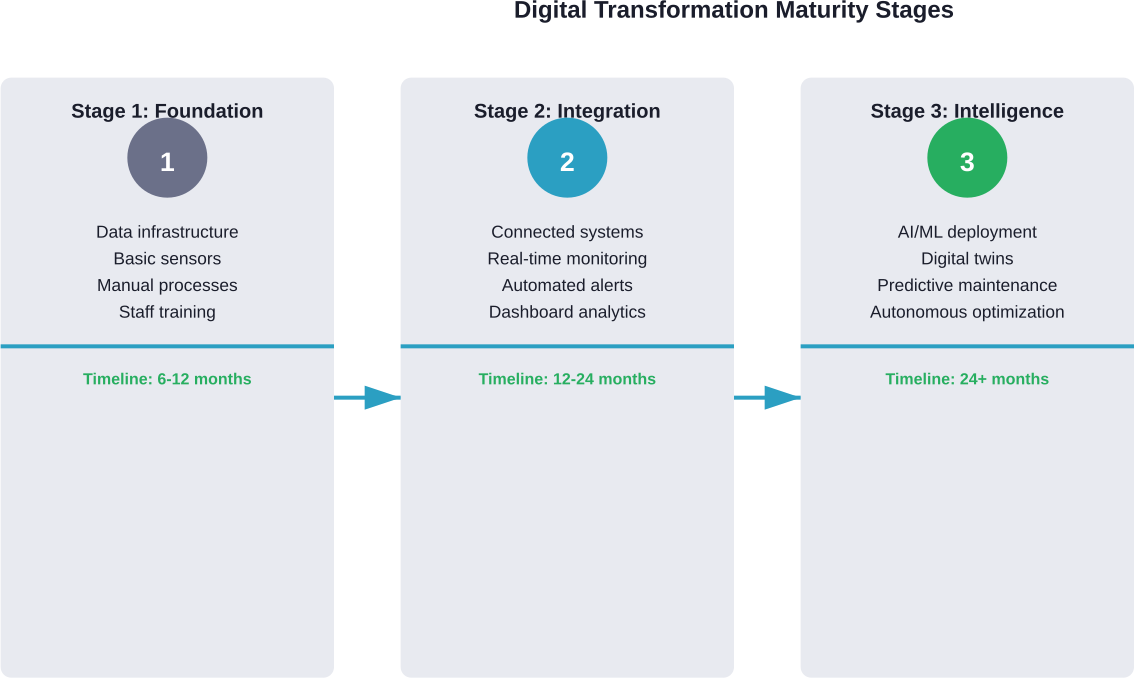

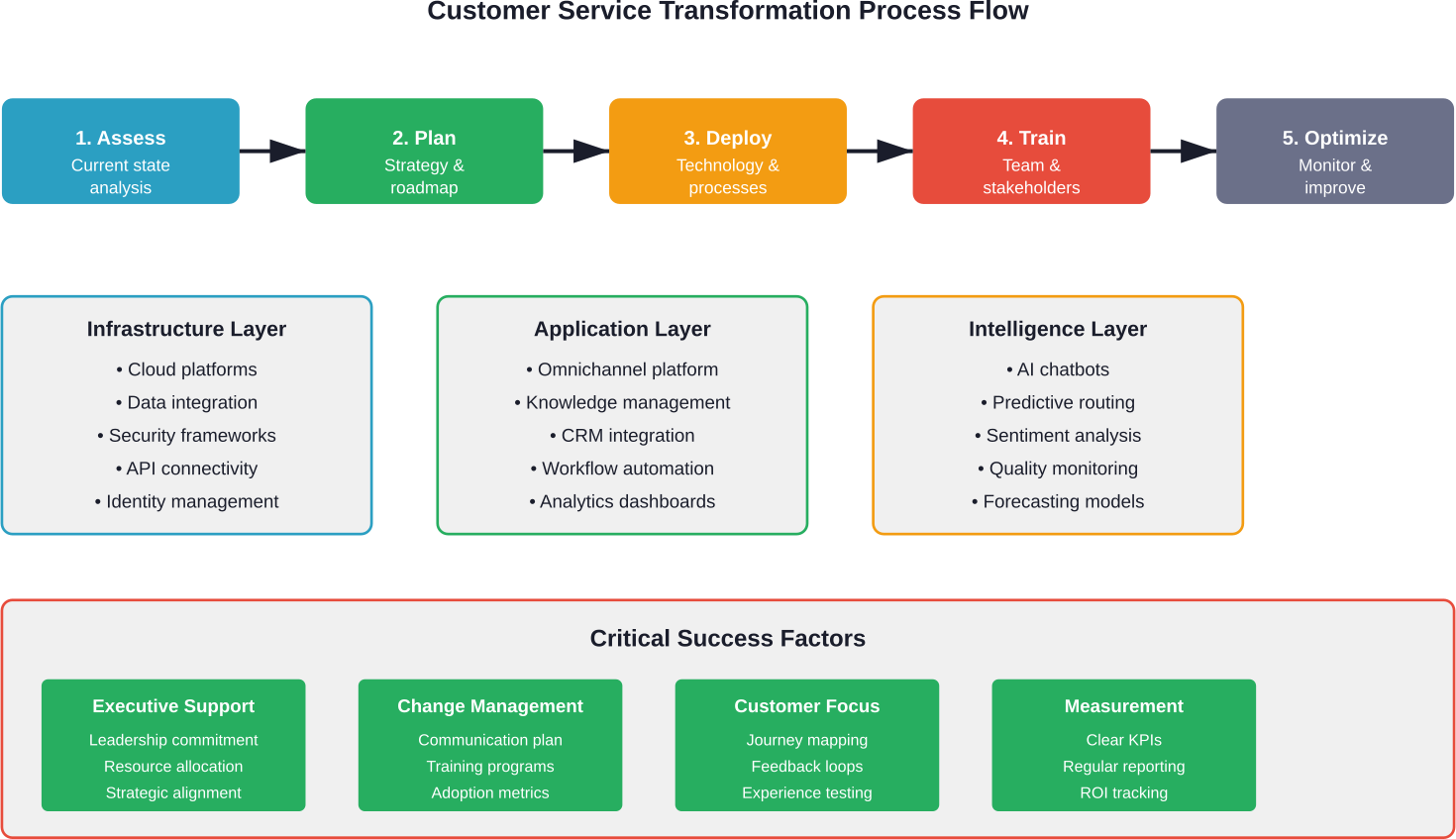

Les organisations qui se lancent dans la transformation numérique ont besoin d'approches structurées équilibrant l'ambition et le réalisme. La feuille de route suivante synthétise les conseils de l'OMS, de l'OPS et de la recherche sur la mise en œuvre.

Phase 1 : Évaluation et planification

Commencez par une évaluation honnête de la situation actuelle. Quelles sont les capacités numériques existantes ? Où se situent les lacunes ? Quels sont les facteurs de l'état de préparation de l'organisation qui nécessitent une attention particulière ?

L'engagement des parties prenantes commence ici, et non après la prise de décision. Inclure le personnel de première ligne qui utilisera les systèmes quotidiennement. Impliquer les membres de la communauté qui reçoivent les services. Consulter les professionnels de l'informatique, les experts en protection de la vie privée et les décideurs politiques.

Élaborer une stratégie de santé numérique alignée sur les priorités de santé publique. La technologie est au service de la mission, et non l'inverse. Si la prévention de l'obésité infantile est une priorité, les investissements numériques devraient soutenir la surveillance de la nutrition, la promotion de l'activité physique ou des fonctions connexes.

Phase 2 : Construction de la fondation

Établir des cadres de gouvernance des données avant de collecter des informations sensibles. Définir les rôles, les responsabilités et les droits de décision. Élaborer des politiques d'accès, de partage et de conservation des données. Assurer la conformité légale et éthique.

Investir dans l'infrastructure d'interopérabilité. Mettre en œuvre des normes telles que HL7 FHIR pour l'échange de données. Construire ou acquérir des registres de base (clients, établissements, prestataires). Mettre en place des services de terminologie avec des ensembles de codes standard.

Renforcer les capacités de la main-d'œuvre par des programmes de formation. Développer la culture numérique à tous les niveaux du personnel. Recruter des spécialistes de la science des données, de l'informatique de santé et de la gestion de projets numériques.

Phase 3 : Mise en œuvre pilote

Commencez par des projets pilotes ciblés plutôt que par des déploiements à l'échelle de l'entreprise. Choisissez des projets dont les paramètres de réussite sont clairs, dont la portée est gérable et qui bénéficient d'un soutien solide de la part des dirigeants. Tirer des enseignements des premières mises en œuvre avant de passer à l'échelle supérieure.

Intégrer des boucles de retour d'information dans les projets pilotes. Recueillir en permanence des données sur l'expérience des utilisateurs. Contrôler les performances techniques et identifier rapidement les problèmes. Ajuster les approches en fonction de l'utilisation réelle et non des conceptions théoriques.

Documenter systématiquement les enseignements tirés. Qu'est-ce qui a fonctionné ? Qu'est-ce qui n'a pas fonctionné ? Pourquoi ? Ces informations permettent d'éclairer les phases suivantes et d'aider d'autres organisations à éviter les mêmes écueils.

Phase 4 : étendre et pérenniser l'action

Des projets pilotes réussis permettent un déploiement plus large. Mais l'élargissement ne se limite pas à la reproduction de la technologie. La gestion du changement, la formation et le soutien doivent s'étendre proportionnellement.

Prévoir la durabilité dès le départ. Les budgets doivent couvrir les coûts permanents - maintenance, mises à niveau, assistance - et pas seulement la mise en œuvre initiale. Renforcer l'expertise interne plutôt que de dépendre entièrement de fournisseurs externes.

L'évaluation continue permet de vérifier si les investissements produisent les bénéfices escomptés. Utiliser les données générées par les systèmes numériques pour évaluer leurs propres performances. Corriger le tir lorsque les résultats ne sont pas à la hauteur des objectifs.

Études de cas et applications concrètes

L'examen des mises en œuvre concrètes montre comment les principes se traduisent dans la pratique et quels sont les résultats obtenus par les organisations.

Transformation numérique régionale en Chine

Une étude analysant 31 provinces chinoises a révélé que la transformation numérique régionale a un impact significatif sur les résultats en matière de santé publique. L'étude a utilisé l'innovation technologique comme variable médiatrice, démontrant que les capacités numériques permettent des innovations qui améliorent ensuite la santé de la population.

L'analyse a révélé que les provinces dotées d'une infrastructure numérique plus avancée affichaient de meilleures performances sur de multiples indicateurs de santé publique. Toutefois, les avantages n'étaient pas automatiques : ils nécessitaient des investissements parallèles dans le développement du personnel et la refonte des processus.

Programmes provinciaux canadiens de santé publique

Une étude qualitative a examiné la stratégie organisationnelle de santé publique numérique dans le cadre d'un programme provincial en Colombie-Britannique, au Canada. Entre février et avril 2023, les chercheurs ont organisé des groupes de discussion avec des praticiens pour comprendre les opportunités et les défis.

Les participants ont identifié plusieurs obstacles à une transformation numérique efficace. Les préoccupations en matière de protection de la vie privée ont limité le partage des données entre les programmes. Les silos organisationnels ont empêché l'adoption d'approches intégrées. Les connaissances numériques limitées du personnel ont ralenti l'adoption de nouveaux outils.

L'étude a également révélé des opportunités. Les praticiens ont reconnu que les systèmes numériques pouvaient réduire la charge administrative et permettre de consacrer plus de temps aux activités directes de santé publique. L'amélioration de l'accès aux données permettrait des interventions plus ciblées. L'automatisation pourrait normaliser les processus de routine, réduisant ainsi la variabilité.

Accélération de la réponse à la pandémie

La pandémie de COVID-19 a accéléré de manière spectaculaire l'adoption de la santé publique numérique. Les applications de recherche des contacts, les registres de vaccination et les tableaux de bord en temps réel ont été déployés en quelques mois plutôt qu'en quelques années.

Ce développement rapide est le fruit d'une collaboration internationale réussie et du soutien d'organisations telles que l'OMS et l'Union européenne. L'expérience a démontré ce qui est possible lorsque l'urgence, les ressources et la volonté politique se rejoignent.

Cependant, les mises en œuvre axées sur la pandémie ont souvent sacrifié la durabilité à la rapidité. De nombreux systèmes reposaient sur des financements temporaires, des consultants externes ou des plateformes propriétaires. Pour maintenir l'élan, il faut passer à des modèles durables.

Questions fréquemment posées

- Qu'est-ce que la transformation numérique dans le domaine de la santé publique ?

La transformation numérique dans le domaine de la santé publique consiste à repenser fondamentalement le fonctionnement des fonctions de santé publique à l'aide des technologies numériques. Elle va au-delà de la simple numérisation des dossiers papier ou de l'ajout de sites web. Une véritable transformation implique de repenser les processus, d'intégrer les systèmes de données, de déployer l'analyse pour mieux connaître la population et de permettre de nouvelles approches d'intervention qui n'étaient pas réalisables auparavant. L'objectif est d'améliorer les résultats sanitaires de la population grâce à une meilleure surveillance, à des programmes de prévention plus efficaces et à une prestation de services équitable.

- En quoi la santé publique numérique diffère-t-elle de la santé numérique en général ?

La santé numérique se concentre généralement sur les soins aux patients individuels - télémédecine, dossiers médicaux électroniques, portails pour les patients et aide à la décision clinique. La santé publique numérique opère au niveau de la population, en soutenant des fonctions telles que la surveillance des maladies, la promotion de la santé, le contrôle de la santé environnementale et l'élaboration de politiques. Alors que la santé numérique clinique s'adresse à des patients individuels, la santé publique numérique s'adresse à des communautés et des populations entières. Les technologies se chevauchent, mais les applications et les paramètres de réussite diffèrent considérablement.

- Quels sont les principaux obstacles à la mise en œuvre de la transformation numérique dans les agences de santé publique ?

Les principaux obstacles sont les suivants : des systèmes technologiques hérités qui ne peuvent pas s'intégrer facilement aux plateformes modernes, une capacité limitée de la main-d'œuvre en science des données et en informatique de la santé, un financement inadéquat pour la mise en œuvre initiale et la maintenance continue, des défis de gouvernance des données concernant la confidentialité et le partage, des silos organisationnels qui empêchent les approches coordonnées, et des préoccupations d'équité concernant les fractures numériques. En outre, les processus de passation de marchés conçus pour les biens matériels ne sont pas adaptés à l'acquisition de logiciels, et les cultures peu enclines à prendre des risques résistent à l'innovation.

- Comment la transformation numérique peut-elle aborder l'équité en matière de santé plutôt que d'aggraver les disparités ?

La transformation numérique axée sur l'équité nécessite des choix de conception intentionnels. Il s'agit notamment de s'assurer que les outils numériques fonctionnent pour les populations ayant un accès limité à l'internet ou des appareils plus anciens, de fournir des interfaces multilingues et peu alphabétisées, d'impliquer les membres de la communauté dans la conception du système, de suivre les mesures d'utilisation stratifiées par groupes démographiques pour identifier les disparités, d'investir dans des programmes d'alphabétisation numérique pour les populations mal desservies et de maintenir des options de services non numériques. Les CDC soulignent que l'IA et les outils numériques dans le domaine de la santé publique doivent éviter les préjugés et veiller à ce que les avantages atteignent les groupes vulnérables, et pas seulement les populations privilégiées.

- Quelles normes permettent l'interopérabilité des systèmes numériques de santé publique ?

Les principales normes d'interopérabilité comprennent HL7 FHIR pour l'échange de données sur la santé, l'International Patient Summary pour le partage transfrontalier d'informations sur les patients, SNOMED CT et LOINC pour la terminologie médicale normalisée, la CIM-10 pour la classification des maladies et les lignes directrices SMART de l'OMS pour les interventions numériques en matière de santé. Ces normes permettent à différents systèmes - DSE d'hôpitaux, registres de santé publique, systèmes d'information de laboratoire - de communiquer efficacement sans avoir à procéder à des intégrations personnalisées pour chaque connexion. Le respect des normes réduit les coûts et permet l'évolutivité.

- Quel rôle joue l'intelligence artificielle dans la santé publique numérique ?

L'IA améliore les capacités de santé publique de plusieurs manières : surveillance automatisée des maladies détectant plus tôt les signaux d'épidémie, modèles prédictifs identifiant les populations à haut risque pour une prévention ciblée, traitement du langage naturel extrayant des informations de textes non structurés, vision par ordinateur analysant l'imagerie pour la surveillance de la santé environnementale, et chatbots fournissant une éducation à la santé à grande échelle. Toutefois, le CDC souligne que les applications de l'IA doivent tenir compte de l'équité en matière de santé et des implications éthiques. L'IA doit renforcer les capacités humaines, et non remplacer l'établissement de relations et la sensibilité culturelle, qui restent des activités fondamentalement humaines.

- Comment les organisations mesurent-elles le succès des initiatives de transformation numérique ?

Les mesures de réussite couvrent plusieurs domaines. Les mesures d'efficacité comprennent la réduction du délai entre la détection de la maladie et la réaction, ainsi que la diminution de la charge administrative. Les mesures d'efficacité permettent de suivre la couverture vaccinale, la portée du dépistage et la rapidité de la lutte contre les épidémies. Les indicateurs d'équité examinent si les services atteignent les populations mal desservies. Les évaluations de l'expérience des utilisateurs mesurent la satisfaction des prestataires et la facilité d'utilisation du système. Les évaluations économiques calculent la rentabilité et le retour sur investissement. La difficulté consiste à attribuer les améliorations de la santé de la population spécifiquement aux systèmes numériques par rapport à d'autres facteurs, ce qui nécessite des modèles d'évaluation rigoureux tels que des comparaisons quasi-expérimentales ou des analyses de séries chronologiques.

Conclusion : Construire l'avenir de la santé publique

La transformation numérique représente plus qu'une mise à niveau technologique pour la santé publique. C'est l'occasion d'améliorer fondamentalement la façon dont nous protégeons et promouvons la santé de la population.

Les faits sont clairs. L'OMS considère que la transformation numérique est essentielle à la couverture sanitaire universelle. La recherche démontre des impacts positifs sur les résultats de santé de la population. Les mises en œuvre pratiques révèlent des gains d'efficacité et des capacités accrues.

Mais la technologie seule ne résout rien. Une transformation réussie nécessite une planification stratégique, un investissement soutenu, le développement de la main-d'œuvre, une conception axée sur l'équité, une gouvernance solide et une évaluation continue. Les organisations qui considèrent la transformation numérique comme un projet essentiellement technologique auront du mal à s'en sortir. Celles qui la considèrent comme un changement organisationnel rendu possible par la technologie ont plus de chances de réussir.

La pandémie a démontré ce qu'il est possible de faire lorsque l'urgence stimule l'innovation. Les systèmes de recherche des contacts, les registres de vaccination et les tableaux de bord en temps réel ont été déployés à une vitesse sans précédent. Cet élan ne devrait pas se dissiper lorsque les crises aiguës s'estompent.

Les maladies non transmissibles, les menaces pour la santé environnementale et les inégalités persistantes exigent une attention soutenue. Les outils numériques offrent de nouvelles approches pour relever ces défis de longue date, à condition qu'ils soient mis en œuvre de manière réfléchie.

La voie à suivre passe par la collaboration. Les organisations internationales de normalisation telles que HL7 et l'OMS fournissent des cadres et des orientations. Les établissements universitaires établissent des preuves et forment la prochaine génération de professionnels de la santé publique numérique. Les fournisseurs de technologies développent des plateformes et des outils. Mais en fin de compte, ce sont les organismes de santé publique eux-mêmes qui doivent mener les efforts de transformation.

Vous vous sentez dépassé ? Commencez modestement. Évaluer honnêtement les capacités actuelles. Impliquer largement les parties prenantes. Piloter des applications ciblées. Tirer les leçons des succès et des échecs. Développer ce qui fonctionne. Pérenniser par un investissement et une évaluation continus.

L'objectif n'est pas la perfection. Il s'agit de progresser vers des systèmes de santé qui tirent parti des capacités numériques pour servir équitablement toutes les populations. Des systèmes qui détectent les menaces plus rapidement, qui préviennent les maladies plus efficacement et qui allouent les ressources de manière plus efficiente. Des systèmes qui ne laissent personne de côté.

La transformation numérique offre à la santé publique une chance de remplir sa promesse fondamentale : améliorer les conditions dans lesquelles les gens peuvent être en bonne santé. Cette opportunité exige une action - une action stratégique, équitable et durable.

L'avenir de la santé publique est numérique. Mais surtout, il est centré sur l'humain, fondé sur des données probantes et axé sur l'équité en matière de santé. La technologie est au service de ces valeurs, et non l'inverse.

Prêt à entamer la transformation de votre organisme de santé publique ? Commencez par une évaluation, engagez vos parties prenantes et faites le premier pas vers un avenir numérique au service de l'ensemble de votre communauté.