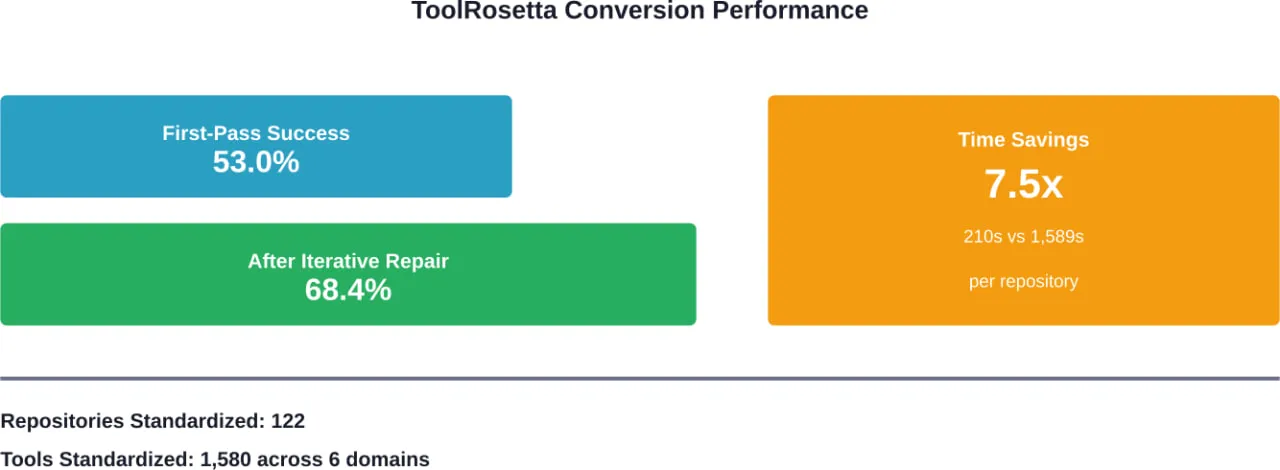

Résumé rapide : Les agents d'IA sont des systèmes autonomes qui combinent des modèles de base avec le raisonnement, la planification et l'utilisation d'outils pour exécuter des tâches complexes avec une intervention humaine minimale. Contrairement aux chatbots traditionnels, ils peuvent opérer dans de multiples domaines - du support client et des ventes à la finance, aux soins de santé et à la logistique - offrant des gains de productivité de 2 à 10 fois dans les premiers déploiements en entreprise. D'ici 2026, les organisations déploieront des agents pour tout, de la détection automatisée des fraudes à l'optimisation de la chaîne d'approvisionnement, avec des normes gouvernementales et industrielles émergeant pour assurer une adoption sûre et interopérable.

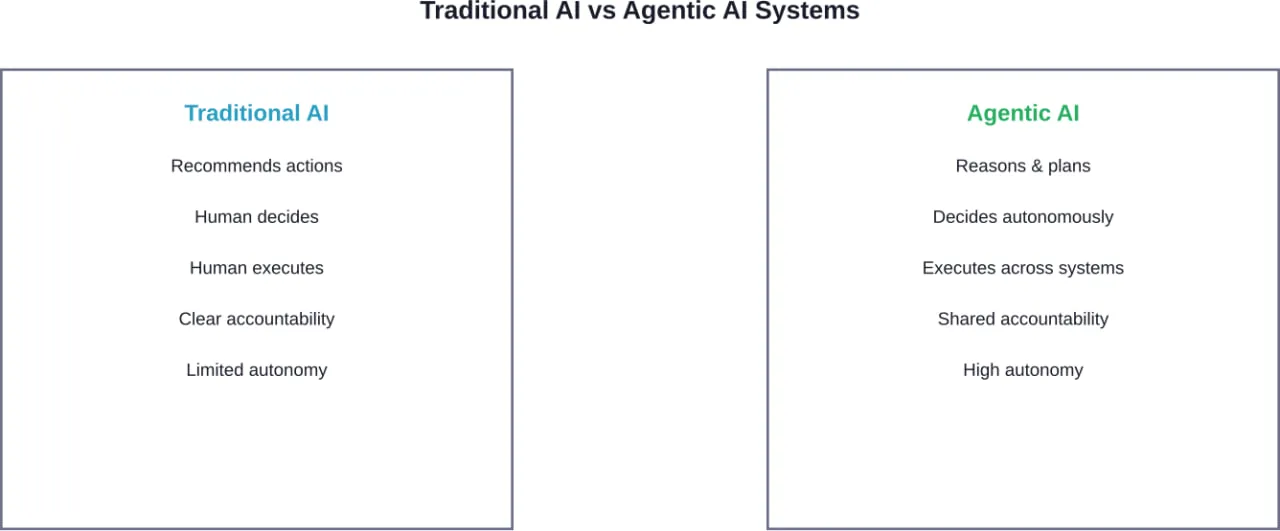

Les agents d'IA ne sont pas simplement un autre mot à la mode dans le cycle technologique. Ils représentent un changement fondamental dans la manière dont les entreprises automatisent le travail, prennent des décisions et interagissent avec les clients.

Contrairement aux chatbots à tâche unique du passé, les agents d'IA modernes peuvent planifier de manière autonome des flux de travail à plusieurs étapes, raisonner à travers des scénarios complexes et exécuter des actions à travers des douzaines d'outils intégrés. Ils ne se contentent pas de répondre à des questions, ils exécutent des processus métier entiers, du début à la fin.

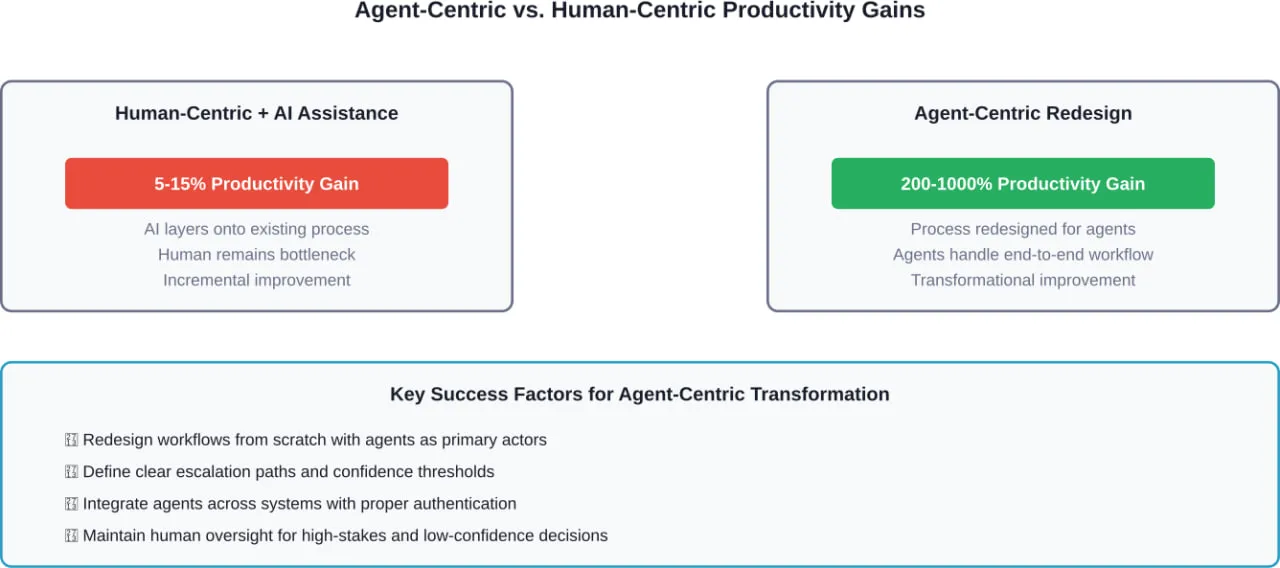

Mais voilà : l'écart entre le battage médiatique et la réalité reste important. Selon l'enquête mondiale de McKinsey sur l'IA, si 78% des entreprises déclarent utiliser l'IA générative dans au moins une fonction, plus de 80% ne signalent aucune contribution matérielle aux bénéfices. La différence ? Les organisations qui déploient de véritables systèmes agentiques - et pas seulement des couches d'IA sur des flux de travail existants centrés sur l'homme.

Ce guide examine plus de 40 cas d'utilisation d'agents d'IA dans le monde réel, qui fonctionnent déjà en production dans différents secteurs. Il ne s'agit pas d'applications théoriques. Il s'agit de déploiements éprouvés que les entreprises utilisent dès à présent pour réduire les coûts, accélérer les processus et mettre à l'échelle des opérations qui étaient auparavant limitées par les capacités humaines.

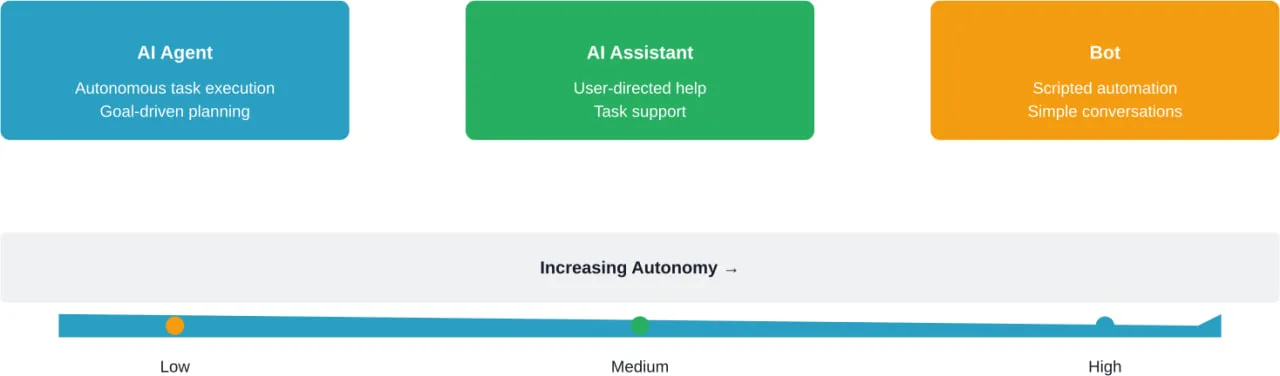

Ce qui différencie les agents d'IA de l'automatisation traditionnelle

L'automatisation traditionnelle suit des règles rigides de type "si-alors". Les agents d'IA fonctionnent de manière autonome, adaptent leur approche en fonction du contexte, apprennent des interactions et prennent des décisions sans scripts préprogrammés pour chaque scénario.

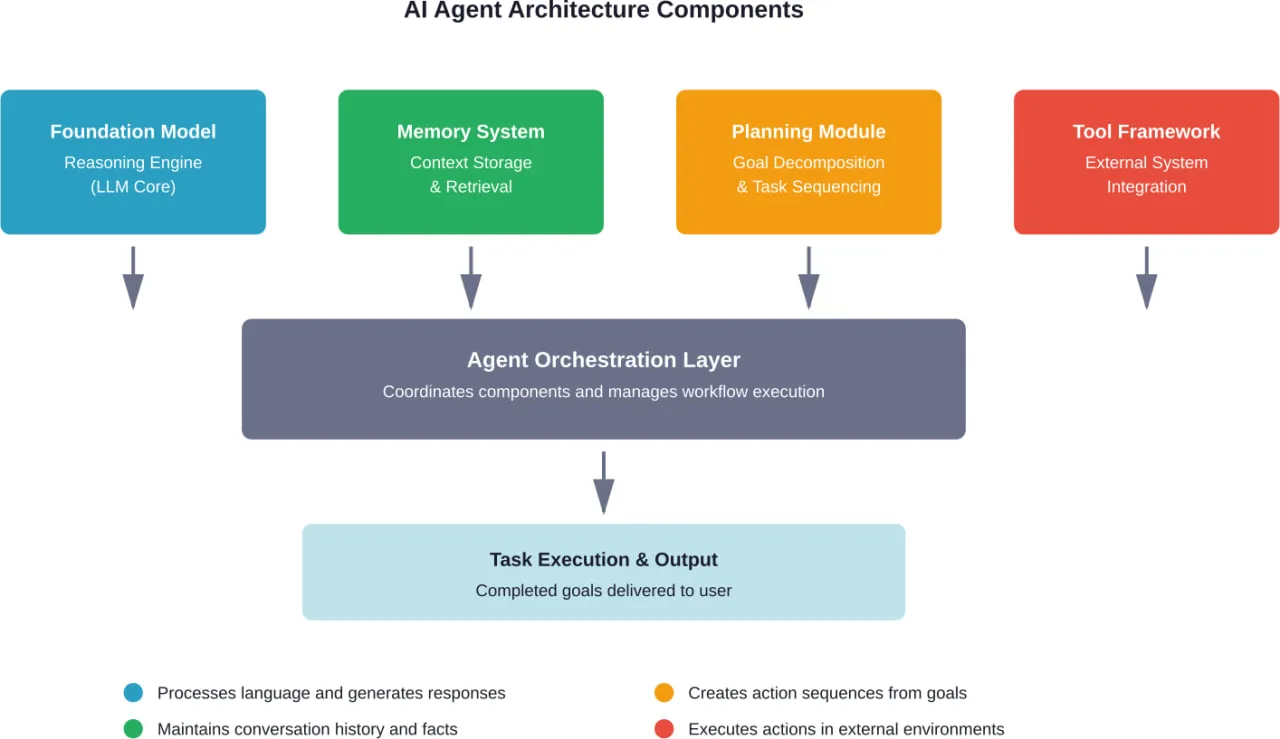

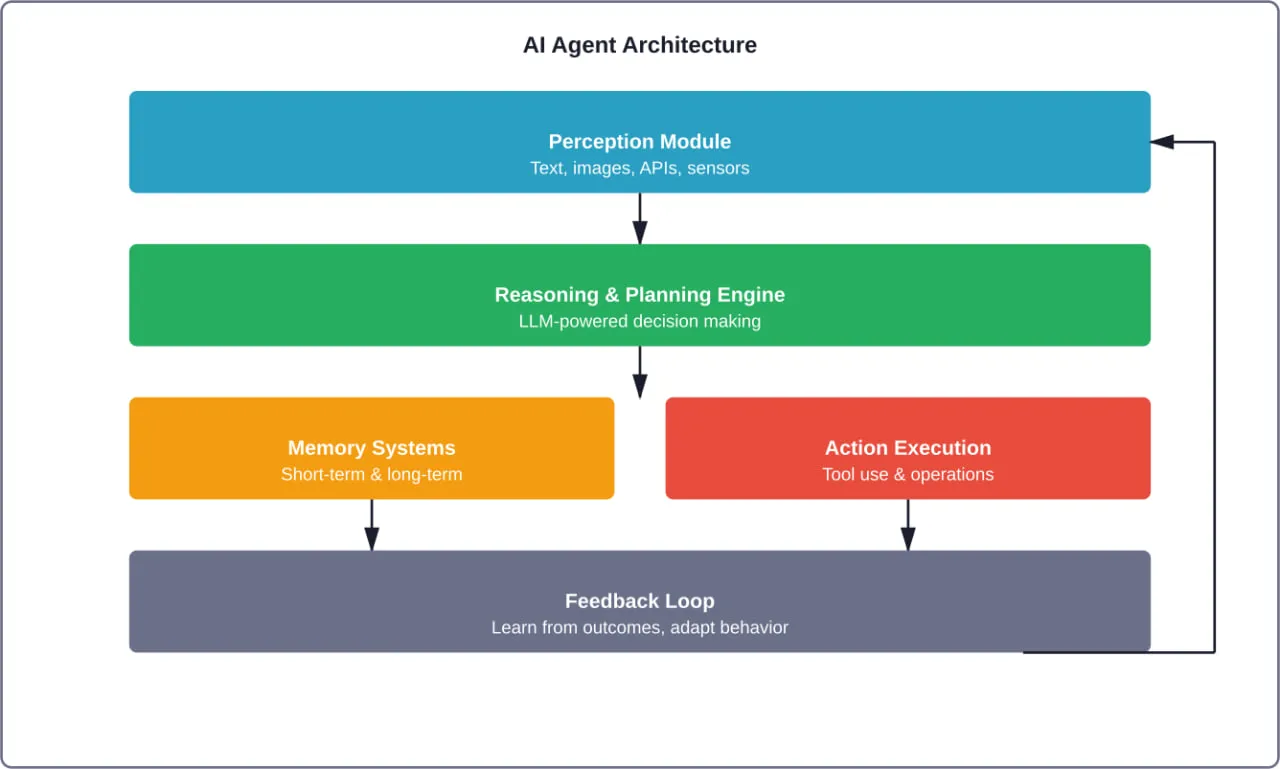

Un agent d'intelligence artificielle combine plusieurs capacités essentielles :

- Des modèles de base qui comprennent le langage naturel et le contexte

- Les moteurs de raisonnement qui décomposent les objectifs complexes en étapes séquentielles

- Systèmes de mémoire qui suivent l'historique des conversations et les préférences de l'utilisateur

- Intégration d'outils permettant l'accès aux bases de données, aux API et aux logiciels externes

- Mécanismes de planification qui déterminent le chemin optimal pour accomplir une tâche

Lorsque ces composants fonctionnent ensemble, les agents peuvent gérer des flux de travail sophistiqués qui nécessiteraient traditionnellement un jugement humain à de multiples points de décision.

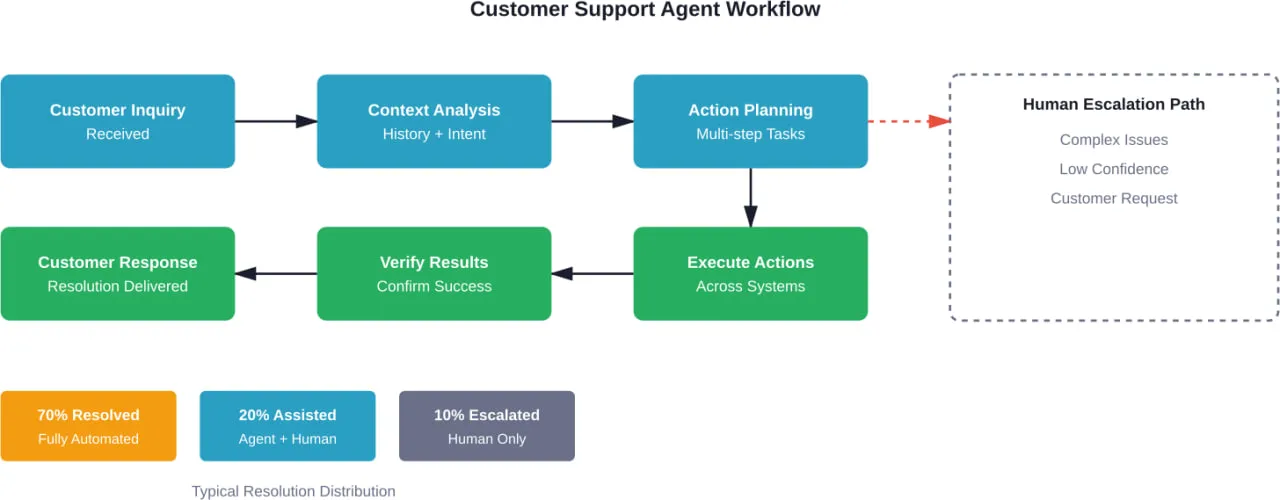

Prenons l'exemple du support client. Un chatbot traditionnel peut répondre à des FAQ à partir d'une base de connaissances. Un agent d'IA peut diagnostiquer un problème technique, vérifier l'historique des commandes dans plusieurs systèmes, procéder à un remboursement, programmer un suivi et mettre à jour le CRM, le tout en une seule interaction sans transfert humain.

Ce niveau d'autonomie modifie l'économie de l'automatisation. Au lieu d'automatiser 20% de tickets d'assistance, les agents peuvent traiter 70% ou plus, comme l'a démontré Vodafone en mettant en œuvre un système d'assistance basé sur des agents IA qui traite plus de 70% de demandes de renseignements de clients sans intervention humaine.

Cas d'utilisation pour le service à la clientèle et l'assistance

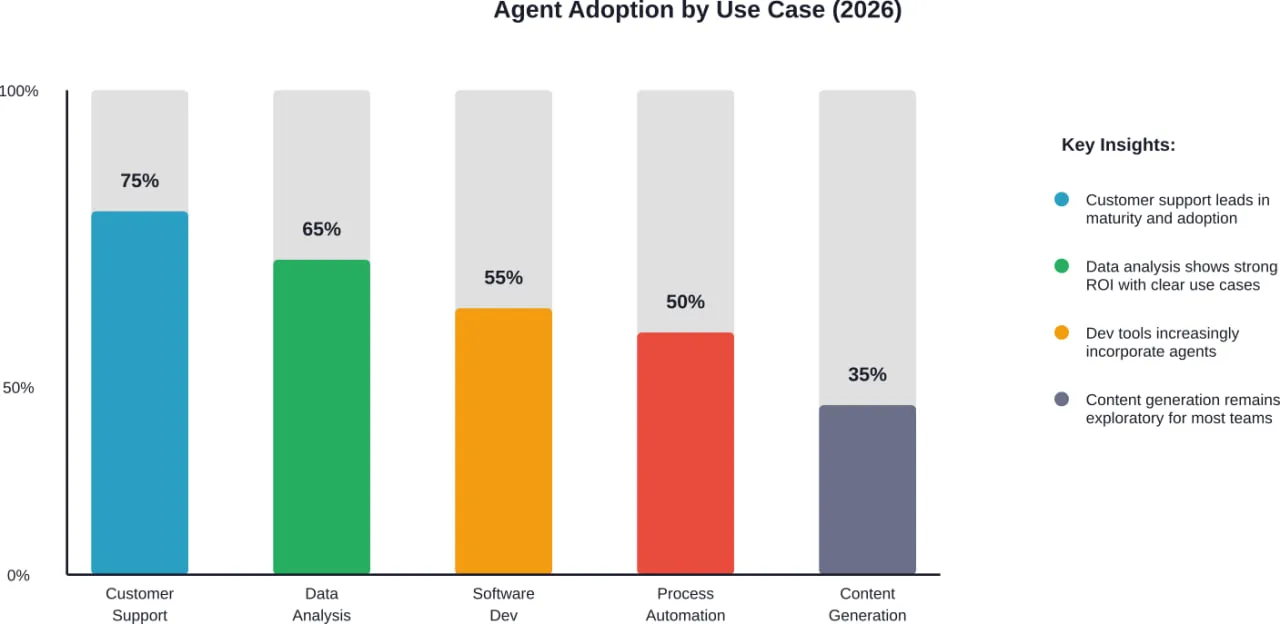

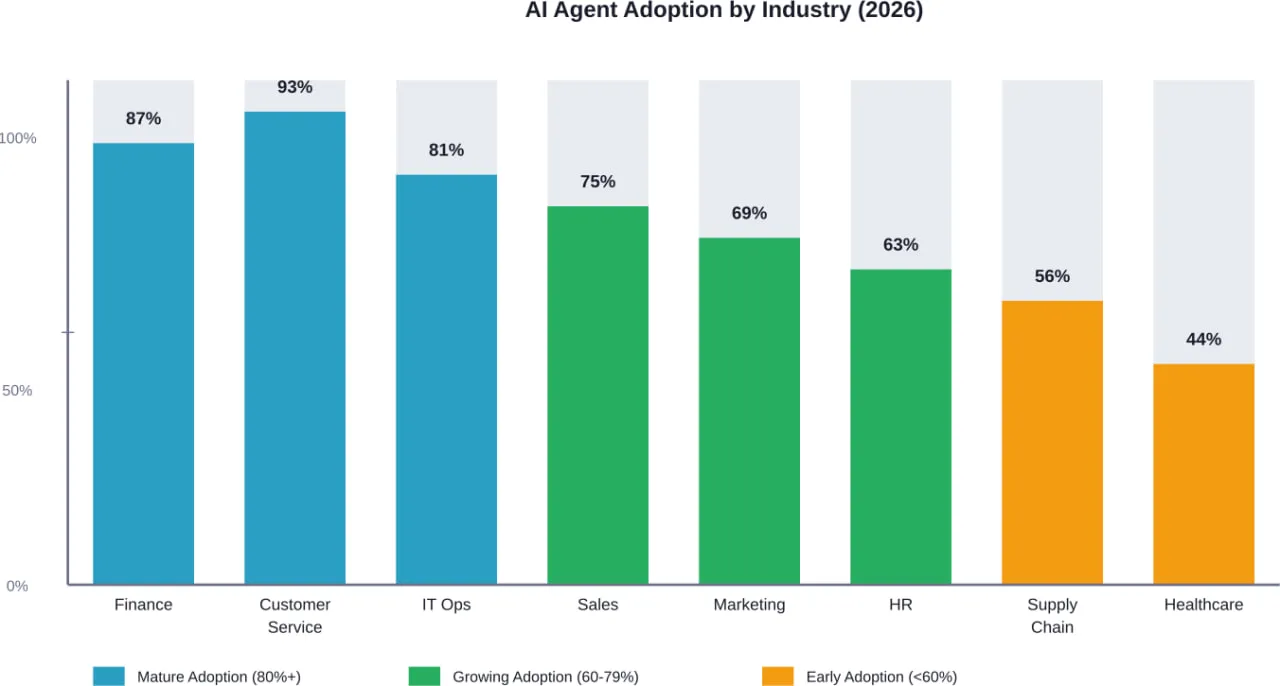

Le service à la clientèle reste le domaine de déploiement le plus mature pour les agents d'IA, avec des systèmes de production fonctionnant déjà à grande échelle dans les télécommunications, le commerce de détail et les services financiers.

Résolution automatisée des tickets

Les agents d'IA peuvent résoudre les demandes d'assistance courantes de bout en bout sans intervention humaine. Ils accèdent aux bases de données des commandes, vérifient les informations du compte, traitent les remboursements, mettent à jour les adresses de livraison et confirment la résolution avec le client.

La principale différence avec les anciens chatbots ? Les agents ne se contentent pas de chercher des réponses, ils exécutent des actions dans plusieurs systèmes. Lorsqu'un client signale un produit défectueux, l'agent peut vérifier l'achat, contrôler l'état de la garantie, créer une étiquette de retour, traiter le remboursement et mettre à jour les systèmes d'inventaire dans un flux de travail continu.

Acheminement intelligent des billets

Lorsque les problèmes nécessitent une expertise humaine, les agents analysent le contexte de la demande, l'historique du client et la complexité technique afin d'acheminer les tickets vers le spécialiste le plus approprié. Cela permet de réduire le temps de traitement moyen en associant les problèmes à l'expertise adéquate dès le premier contact.

Les agents rédigent également des propositions de résolution initiales pour les agents humains, en fournissant des résumés du contexte et en suggérant des solutions basées sur des cas antérieurs similaires. Cela permet de réduire le temps de recherche et d'accélérer la résolution des problèmes.

Soutien proactif

Les agents surveillent la santé du système, les modèles d'utilisation et les signaux d'alerte précoce pour contacter les clients avant que les problèmes ne s'aggravent. Lorsqu'une méthode de paiement est sur le point d'expirer ou qu'une interruption de service affecte des comptes spécifiques, les agents prennent contact avec les clients pour leur proposer des solutions personnalisées.

L'assistance passe ainsi d'une lutte réactive contre les incendies à une gestion préventive des relations, ce qui permet de réduire le taux de désabonnement et d'améliorer le taux de satisfaction de la clientèle.

Soutien multilingue à grande échelle

Les agents d'IA fournissent une assistance de qualité native dans des dizaines de langues simultanément, ce qui évite d'avoir à constituer des équipes d'assistance multilingues sur plusieurs fuseaux horaires. Ils maintiennent une qualité de service constante, qu'ils répondent en anglais, en espagnol, en mandarin ou en arabe.

Pour les entreprises internationales, cette capacité peut à elle seule justifier l'adoption d'un agent - permettant une assistance mondiale 24 heures sur 24 et 7 jours sur 7 sans augmentation proportionnelle des effectifs.

Candidatures d'agents de vente et de marketing

Les équipes de vente et de marketing déploient des agents pour gérer la prospection répétitive, la qualification des prospects, la personnalisation du contenu et l'optimisation des campagnes, libérant ainsi le talent humain pour l'établissement de relations stratégiques.

Qualification et évaluation des prospects

Les agents d'IA analysent les leads entrants à travers de multiples sources de données, évaluant la taille de l'entreprise, la pile technologique, les signaux d'engagement et l'intention d'achat. Ils notent les leads en fonction de leur adéquation et de leur état de préparation, acheminant automatiquement les prospects de grande valeur vers les ventes, tout en nourrissant les autres avec des séquences de contenu personnalisées.

Cela élimine la recherche manuelle qui consomme généralement 30 à 40% du temps de développement des ventes, ce qui permet aux équipes de se concentrer exclusivement sur des conversations qualifiées.

Sensibilisation personnalisée à grande échelle

Les agents conçoivent des messages de sensibilisation personnalisés en analysant les antécédents des prospects, l'actualité récente de l'entreprise, l'activité des médias sociaux et les habitudes de consommation de contenu. Chaque message est le fruit d'une véritable recherche et non d'un envoi massif d'e-mails.

Le système détermine également les heures d'envoi optimales, les séquences de suivi et la sélection des canaux (courriel, LinkedIn, téléphone) sur la base de modèles de réponse historiques pour des prospects similaires.

Programmation et préparation des réunions

Lorsqu'un prospect exprime son intérêt, les agents s'occupent de la planification des échanges, envoient des invitations au calendrier et préparent des documents d'information à l'intention des représentants commerciaux, avec l'historique du prospect, ses points faibles, des informations sur la concurrence et des suggestions de sujets à aborder.

Ce travail de coordination, qui nécessite traditionnellement plusieurs courriels et des recherches manuelles, s'effectue automatiquement, ce qui permet aux commerciaux d'entamer chaque conversation en étant parfaitement préparés.

Génération et optimisation du contenu

Les agents marketing génèrent des articles de blog, du contenu pour les médias sociaux, des campagnes d'e-mailing et des variantes de textes publicitaires en fonction des données de performance et de la segmentation de l'audience. Ils testent les titres, les appels à l'action et les angles de message, en optimisant continuellement sur la base des mesures d'engagement.

Certains systèmes peuvent produire des centaines de variantes de contenu pour les tests A/B et identifier les formules gagnantes plus rapidement que les équipes composées uniquement de personnes.

Analyse des performances de la campagne

Les agents surveillent les mesures de la campagne en temps réel, identifient les segments peu performants et ajustent automatiquement les budgets, le ciblage et les éléments créatifs. Lorsqu'une variante de la campagne est plus performante, l'agent réaffecte les dépenses et adapte l'approche gagnante à l'ensemble des canaux.

Cette optimisation continue s'effectue à une vitesse impossible pour les spécialistes du marketing qui surveillent des dizaines de campagnes simultanées.

Automatisation de la finance et de la comptabilité

Les opérations financières constatent des gains d'efficacité considérables grâce au déploiement d'agents, en particulier dans les domaines nécessitant une grande précision, une conformité réglementaire et un rapprochement des données entre les systèmes.

Traitement et rapprochement des factures

Les agents d'IA extraient les données des factures entrantes, quel que soit leur format, les comparent aux bons de commande, signalent les divergences, transmettent les approbations aux responsables concernés et déclenchent le traitement du paiement une fois l'approbation obtenue.

Selon une étude publiée dans la Harvard Data Science Review, une entreprise industrielle internationale a réduit de 92% le temps nécessaire à l'établissement des rapports d'audit en déployant des agents pour les flux de travail de rapprochement financier.

Gestion des notes de frais

Les agents examinent les notes de frais des employés, vérifient les reçus par rapport aux directives, signalent les éléments non conformes à la politique avec des explications spécifiques et approuvent automatiquement les notes de frais conformes. Ils apprennent au fil du temps à interpréter les politiques spécifiques à l'entreprise, ce qui réduit la charge de travail liée à l'examen manuel.

Les employés reçoivent un retour d'information instantané sur les violations de la politique plutôt que d'attendre des jours d'approbation, ce qui améliore à la fois la rapidité et la conformité.

Détection et prévention de la fraude

Les agents financiers surveillent les schémas de transaction en temps réel, identifiant les anomalies qui suggèrent une fraude, un blanchiment d'argent ou une violation de la politique. Ils évaluent les transactions par rapport à des lignes de base comportementales, signalant les activités suspectes pour enquête tout en approuvant automatiquement les paiements de routine.

Les entreprises signalent que les agents fonctionnent activement dans le secteur financier pour la détection des fraudes et l'évaluation du risque de crédit, avec des mises en œuvre dans les secteurs de la banque, de l'assurance et des opérations financières des entreprises.

Prévisions et rapports financiers

Les agents compilent des rapports financiers en extrayant des données de plusieurs systèmes, en appliquant des règles comptables, en générant des analyses de variance et en rédigeant des résumés exécutifs. Ils produisent automatiquement des rapports mensuels du conseil d'administration, des analyses trimestrielles des bénéfices et des comparaisons budget/réalité.

Cela élimine le processus manuel de plusieurs jours de consolidation des feuilles de calcul et de rédaction de commentaires, et permet de fournir des rapports dans les heures qui suivent la clôture du mois.

Contrôle de la conformité réglementaire

Les institutions financières déploient des agents pour contrôler la conformité des transactions à la réglementation, en remplissant automatiquement les rapports requis, en signalant les violations potentielles et en conservant des pistes d'audit. Les agents se tiennent au courant des changements de réglementation et adaptent les règles de surveillance en fonction de l'évolution des exigences.

Ce contrôle continu de la conformité réduit le risque réglementaire tout en permettant aux équipes chargées de la conformité de se concentrer sur des interprétations complexes plutôt que sur des contrôles de routine.

| Cas d'utilisation en finance | Temps traditionnel | Avec l'agent AI | Temps gagné |

|---|

| Traitement des factures (100 factures) | 8 heures | 45 minutes | 91% |

| Rapport financier mensuel | 3 jours | 4 heures | 83% |

| Examen des notes de frais (50 rapports) | 6 heures | 30 minutes | 92% |

| Préparation du rapport d'audit | 5 jours | 8 heures | 84% |

| Suivi des transactions (quotidien) | 4 heures | Continu/automatique | 100% |

Cas d'utilisation dans le domaine des soins de santé et de la médecine

Les organismes de santé déploient des agents avec prudence, en se concentrant sur les flux de travail administratifs et l'aide à la décision clinique, tout en maintenant une surveillance humaine stricte pour les décisions en rapport avec les patients.

Accueil des patients et programmation

Les agents médicaux s'occupent de la prise de rendez-vous, de la vérification des assurances, de la collecte des antécédents médicaux et des formalités administratives préalables à la visite. Ils posent des questions sur les symptômes, déterminent les types de rendez-vous appropriés et acheminent les cas urgents pour une prise en charge immédiate.

Cela permet de réduire les temps d'attente téléphonique et la charge administrative tout en garantissant que les patients atteignent le bon spécialiste avec des informations complètes.

Assistance à la documentation clinique

Les agents écoutent les consultations des patients, génèrent des notes cliniques, codent les diagnostics et les procédures et rédigent des lettres d'orientation. Les médecins examinent et approuvent la documentation, mais le travail initial de rédaction se fait automatiquement.

Les médecins peuvent ainsi gagner 1 à 2 heures par jour sur la documentation, temps qui peut être réorienté vers les soins aux patients.

Analyse des dossiers médicaux

Les agents examinent les dossiers des patients pour identifier les interactions médicamenteuses potentielles, signalent les dépistages manquants en fonction de l'âge et des facteurs de risque, et font remonter les antécédents médicaux pertinents pendant les consultations. Ils agissent comme des assistants intelligents qui font remonter les informations dont les cliniciens ont besoin au moment précis où ils en ont besoin.

Autorisation d'assurance

L'autorisation préalable reste une charge administrative importante. Les agents rassemblent les documents requis, soumettent les demandes d'autorisation, suivent les dossiers en cours et alertent le personnel en cas de refus nécessitant un recours.

Cette automatisation peut réduire le temps de traitement des autorisations préalables de quelques jours à quelques heures, ce qui accélère le début des traitements.

Contrôle de l'observance des médicaments

Les agents envoient des rappels de médicaments, vérifient les effets secondaires, répondent aux questions sur l'utilisation correcte et alertent les équipes cliniques lorsque les patients oublient des doses ou signalent des symptômes inquiétants. Cette surveillance continue améliore les taux d'observance sans que le personnel n'ait à y consacrer du temps.

Opérations informatiques et DevOps

Les équipes de développement et d'exploitation déploient des agents pour la gestion de l'infrastructure, la réponse aux incidents, l'examen du code et la surveillance du système - des domaines où l'automatisation existe depuis des années, mais qui nécessitaient une configuration manuelle importante.

Détection et réponse aux incidents

Les agents informatiques surveillent les paramètres de santé du système, détectent les anomalies, diagnostiquent les causes profondes et exécutent automatiquement les étapes de remédiation. Lorsqu'un service se dégrade, l'agent vérifie les journaux, identifie le composant défaillant, tente d'appliquer les correctifs standard et fait appel aux ingénieurs de garde si la résolution automatique échoue.

Cela permet de réduire le temps moyen de résolution de plusieurs heures à quelques minutes pour les types d'incidents les plus courants.

Examen du code et assurance de la qualité

Les agents de développement examinent les demandes de téléchargement à la recherche de failles de sécurité, de problèmes de performance, de violations de style et d'erreurs logiques. Ils suggèrent des améliorations, signalent les bogues potentiels et vérifient la couverture des tests avant l'examen humain.

Les problèmes de routine sont ainsi détectés automatiquement, ce qui permet aux réviseurs humains de se concentrer sur l'architecture et la logique d'entreprise.

Provisionnement de l'infrastructure

Les agents interprètent les demandes en langage naturel pour approvisionner les ressources en nuage, configurer le réseau, mettre en place une surveillance et appliquer des politiques de sécurité. Un développeur peut demander “un environnement de production pour le nouveau service API” et l'agent gère automatiquement la vingtaine d'étapes de configuration.

Réponse aux menaces de sécurité

Les agents de sécurité surveillent les indicateurs de compromission, enquêtent sur les activités suspectes, isolent les systèmes affectés et lancent des protocoles de réponse aux incidents. Ils fonctionnent à la vitesse d'une machine, contenant les menaces en quelques secondes au lieu des heures typiques d'une réponse manuelle.

Génération de documents

Les agents analysent les bases de code pour générer de la documentation sur les API, mettre à jour les fichiers README, créer des diagrammes d'architecture et rédiger des manuels d'exécution pour les procédures courantes. Ils synchronisent automatiquement la documentation avec les modifications du code.

Applications en matière de ressources humaines

Les services RH utilisent des agents pour rationaliser le recrutement, l'intégration, l'assistance aux employés et la gestion des performances, améliorant ainsi l'expérience des employés tout en réduisant les frais administratifs.

Recherche et sélection des candidats

Les agents de recrutement consultent les sites d'emploi, LinkedIn et les bases de données internes pour identifier les candidats qualifiés. Ils examinent les CV en fonction des exigences du poste, notent les candidats en fonction de leur aptitude, planifient les premières présélections et fournissent aux responsables du recrutement des listes de candidats présélectionnés.

Cela élargit considérablement le vivier de talents que les recruteurs peuvent évaluer efficacement, améliorant ainsi la qualité des embauches tout en réduisant les délais de recrutement.

Coordination des entretiens

Les agents organisent des groupes d'entretien sur plusieurs calendriers, envoient des documents de préparation aux intervieweurs, recueillent des formulaires de retour d'information et compilent des résumés d'évaluation pour les décisions d'embauche. Le travail de coordination, qui nécessite généralement 5 à 10 courriels par candidat, se fait automatiquement.

Embarquement des employés

Les agents de recrutement guident les employés à l'aide de listes de contrôle, leur donnent accès aux systèmes, leur attribuent des modules de formation, organisent des réunions d'orientation et répondent aux questions les plus courantes sur les avantages, les politiques et les outils.

Les nouveaux employés reçoivent des conseils personnalisés sans que le personnel des RH ait à y consacrer du temps, tandis que le système veille à ce qu'aucune étape critique de l'intégration ne soit manquée.

Service d'assistance RH

Les agents d'assistance aux employés répondent aux questions concernant les avantages sociaux, les politiques de congés, les procédures de dépenses et les systèmes internes. Ils traitent automatiquement les demandes de routine telles que les changements d'adresse, les mises à jour des formulaires fiscaux et les soumissions de PTO.

Cela permet de soutenir les employés 24 heures sur 24, 7 jours sur 7, tout en libérant le personnel des ressources humaines pour les cas complexes nécessitant un jugement humain et de l'empathie.

Coordination de l'évaluation des performances

Les agents gèrent les cycles d'évaluation des performances, en envoyant des rappels, en recueillant les commentaires de plusieurs évaluateurs, en compilant des évaluations à 360 degrés et en signalant les soumissions incomplètes à l'approche des échéances.

Fabrication et chaîne d'approvisionnement

Les opérations industrielles déploient des agents pour la maintenance prédictive, le contrôle de la qualité, l'optimisation des stocks et la coordination logistique - des domaines où la prise de décision en temps réel permet de réaliser d'importantes économies.

Maintenance prédictive

Les agents de fabrication surveillent les données des capteurs de l'équipement, prévoient les défaillances des composants avant qu'elles ne se produisent, programment automatiquement la maintenance pendant les temps d'arrêt prévus et commandent des pièces de rechange de manière proactive.

Cela permet d'éviter les pannes imprévues qui interrompent la production, d'améliorer l'efficacité globale de l'équipement tout en réduisant les coûts de maintenance d'urgence.

Inspection du contrôle de la qualité

Les agents basés sur la vision inspectent les produits sur les lignes de production, identifient les défauts, mesurent les tolérances et rejettent automatiquement les articles hors spécifications. Ils atteignent une cohérence impossible à obtenir par des inspecteurs humains tout en fonctionnant en continu à la vitesse de la ligne.

Optimisation des stocks

Les agents de la chaîne d'approvisionnement analysent les modèles de demande, les délais d'approvisionnement des fournisseurs et les coûts de possession afin d'optimiser les niveaux de stock. Ils déclenchent automatiquement des commandes lorsque les stocks atteignent les points de commande calculés et ajustent les stocks de sécurité en fonction de la volatilité de la demande.

Cela permet d'équilibrer les objectifs concurrents consistant à éviter les ruptures de stock tout en minimisant le fonds de roulement immobilisé dans les stocks.

Suivi des envois et gestion des exceptions

Les agents logistiques surveillent les expéditions en transit, identifient les retards, informent les clients de manière proactive, organisent des itinéraires alternatifs en cas de problème et mettent à jour les estimations de livraison dans tous les systèmes.

Lorsqu'une expédition est retardée, l'agent contacte les transporteurs, étudie les possibilités d'accélération et communique les délais révisés, le tout sans intervention humaine, sauf si des seuils d'escalade sont atteints.

Prévision de la demande

Les agents de planification analysent les données historiques des ventes, les tendances du marché, les calendriers promotionnels et les facteurs externes pour générer des prévisions de la demande. Ils mettent continuellement à jour les prévisions au fur et à mesure de l'arrivée de nouvelles données, ce qui permet une planification plus réactive de la production et de l'approvisionnement.

Juridique et conformité

Les services juridiques déploient des agents pour l'analyse des contrats, la recherche juridique, le contrôle de la conformité et la recherche de preuves, en se concentrant sur les tâches de reconnaissance de modèles à haut volume tout en maintenant la supervision des avocats pour les décisions stratégiques.

Examen et analyse des contrats

Les agents juridiques examinent les contrats afin d'identifier les clauses non standard, de signaler les termes à risque, d'extraire les dispositions clés et de comparer les accords aux modèles approuvés. Ils traitent les contrats de vente, les accords de confidentialité et les contrats de travail à grande échelle.

Cela permet aux équipes juridiques d'examiner 10 fois plus de contrats en même temps, en détectant des problèmes qui pourraient passer inaperçus lors de l'examen manuel de volumes importants.

Recherche juridique

Les agents de recherche effectuent des recherches dans la jurisprudence, les lois et les règlements pour trouver les précédents pertinents, résumer les résultats et identifier les arguments à l'appui des positions juridiques. Ils rédigent des mémos de recherche avec des citations d'affaires pour examen par les avocats.

Examen des documents de découverte

Dans le cadre d'un litige, les agents examinent des milliers de documents pour en vérifier la pertinence, les privilèges et les informations clés. Ils classent les documents par catégories, signalent les documents sensibles et mettent en évidence les éléments nécessitant un examen approfondi de la part de l'avocat.

Cela peut réduire les coûts de découverte de 60-80% tout en améliorant la cohérence par rapport aux équipes chargées de l'examen manuel des documents.

Suivi des modifications réglementaires

Les agents de conformité surveillent les sources réglementaires pour détecter les changements affectant l'entreprise, évaluent l'impact, rédigent des mises à jour de la politique et informent les parties prenantes concernées lorsqu'une action est nécessaire.

Cela permet aux organisations de rester en phase avec l'évolution des réglementations sans avoir à consacrer du personnel à un contrôle manuel permanent.

Éducation et formation

Les établissements d'enseignement et les programmes de formation en entreprise déploient des agents pour l'apprentissage personnalisé, l'assistance administrative et les services aux étudiants, afin d'améliorer les résultats tout en gérant les contraintes de ressources.

Tutorat personnalisé

Les agents éducatifs dispensent des cours particuliers, adaptent les explications au style d'apprentissage de l'élève, identifient les lacunes et ajustent le niveau de difficulté en fonction de la maîtrise de l'élève. Ils sont disponibles 24 heures sur 24 et 7 jours sur 7 pour l'aide aux devoirs et la révision des concepts.

Soutien administratif

Les agents de service aux étudiants répondent aux questions concernant l'inscription, l'aide financière, les exigences des cours et les ressources du campus. Ils guident les étudiants dans les procédures administratives, réduisant ainsi la charge de travail du personnel tout en améliorant l'expérience des étudiants.

Évaluation et notation

Les agents notent les devoirs objectifs, fournissent des commentaires détaillés sur les travaux écrits, identifient le plagiat et suivent les progrès de l'apprentissage. Les enseignants révisent et approuvent les notes, mais l'évaluation initiale se fait automatiquement.

Formation en entreprise

Les agents d'apprentissage sur le lieu de travail fournissent un contenu de formation personnalisé, répondent aux questions sur les procédures et les politiques, interrogent les employés sur les sujets de conformité et suivent l'achèvement des exigences de certification.

Énergie et services publics

Les entreprises du secteur de l'énergie déploient des agents pour la gestion du réseau, la prévision de la demande, les interventions en cas de panne et le service à la clientèle, ce qui est d'autant plus important que les énergies renouvelables et la production décentralisée augmentent la complexité du réseau.

Commerce et optimisation de l'énergie

Les agents d'intelligence artificielle participent aux marchés transactifs de l'énergie, achetant et vendant automatiquement de l'électricité en fonction des signaux de prix, des prévisions météorologiques et des habitudes de consommation. La recherche sur les agents d'intelligence artificielle dans les marchés de l'énergie montre comment ces systèmes modifient la prise de décision, passant de la cognition humaine à des processus algorithmiques.

Surveillance et équilibrage du réseau

Les agents surveillent les conditions du réseau en temps réel, équilibrant l'offre et la demande, répartissant les ressources de stockage et ajustant la production distribuée pour maintenir la stabilité lorsque la production renouvelable fluctue.

Détection et réponse aux pannes

Les agents des services publics détectent les pannes à partir des données des compteurs intelligents, envoient des équipes de réparation, réacheminent le courant par d'autres voies et communiquent automatiquement aux clients concernés les délais de rétablissement estimés.

Recommandations en matière d'efficacité énergétique

Les agents en contact avec les clients analysent les schémas d'utilisation pour recommander des améliorations de l'efficacité, comparent les plans tarifaires pour optimiser les coûts et identifient les mises à niveau de l'équipement avec les périodes de retour sur investissement les plus rapides.

Opérations d'assurance

Les compagnies d'assurance déploient des agents pour le traitement des sinistres, la souscription, la détection des fraudes et le service à la clientèle, rationalisant ainsi des processus qui nécessitaient traditionnellement un examen manuel approfondi.

Réception et traitement des demandes d'indemnisation

Les agents d'indemnisation guident les assurés dans leur déclaration, recueillent les documents nécessaires, vérifient la couverture, évaluent les dommages à partir de photos et approuvent automatiquement les demandes d'indemnisation simples dans les limites de la police d'assurance.

Les demandes simples peuvent être traitées et payées en quelques heures au lieu de quelques jours, ce qui améliore la satisfaction des clients tout en réduisant les coûts de traitement.

Évaluation du risque de souscription

Les agents de souscription évaluent les demandes en fonction des critères de risque, consultent les rapports de solvabilité et les sources de données externes, calculent les primes appropriées et signalent les demandes à haut risque pour qu'elles soient examinées par un souscripteur humain.

Administration des politiques

Les agents de service gèrent automatiquement les modifications, les avenants, les renouvellements et les annulations de police. Ils répondent aux questions relatives à la couverture, fournissent des devis pour les changements de couverture et traitent les opérations courantes sans l'intervention d'un agent.

Enquête sur la fraude

Les agents chargés de la détection des fraudes analysent les demandes pour y déceler des schémas suspects, les comparent à des indicateurs de fraude connus, examinent l'historique des demandeurs dans les bases de données et classent les cas par ordre de priorité en vue d'une enquête approfondie.

Commerce de détail et commerce électronique

Les détaillants déploient des agents pour des expériences d'achat personnalisées, la gestion des stocks, l'optimisation des prix et le service à la clientèle, améliorant ainsi la conversion tout en gérant la complexité opérationnelle.

Recommandations sur les produits

Les agents d'achat analysent le comportement de navigation, l'historique des achats et les habitudes de clients similaires pour recommander des produits. Ils personnalisent l'ensemble de l'expérience d'achat, de la présentation de la page d'accueil aux campagnes d'e-mailing.

Recherche et découverte visuelles

Les agents permettent aux clients d'effectuer des recherches en téléchargeant des photos, en trouvant des produits similaires, en suggérant des articles complémentaires et en filtrant par attributs visuels tels que la couleur, le style et le motif.

Tarification dynamique

Les agents de tarification surveillent les prix des concurrents, les niveaux de stocks, les signaux de la demande et les marges bénéficiaires afin d'optimiser les prix en temps réel. Ils testent l'élasticité des prix et adaptent les stratégies en fonction des données de conversion.

Allocation des stocks

Les agents optimisent la distribution des stocks dans les magasins et les entrepôts, en prévoyant la demande locale, en déclenchant des transferts vers les sites à forte demande et en minimisant le risque de démarque dans les situations de surstockage.

Immobilier

Les agents immobiliers (du type IA) aident à la recherche de biens, à l'évaluation, à la programmation et à la coordination des transactions, complétant ainsi les agents humains par une assistance automatisée pour les tâches fastidieuses.

Recherche de biens immobiliers

Les agents d'IA apprennent les préférences des acheteurs, recherchent des annonces dans plusieurs sources, programment des visites, fournissent des données sur le voisinage et alertent les acheteurs lorsque des biens correspondant à leurs critères sont disponibles.

Évaluation automatisée

Les agents d'évaluation analysent les ventes comparables, les caractéristiques des biens, les tendances du marché et les facteurs locaux afin d'estimer la valeur des biens pour les inscriptions, les achats et les refinancements.

Coordination des transactions

Les agents de gestion des transactions suivent les échéances contractuelles, coordonnent les inspections et les évaluations, rassemblent les documents requis et veillent à ce que toutes les parties accomplissent les étapes nécessaires dans les délais impartis.

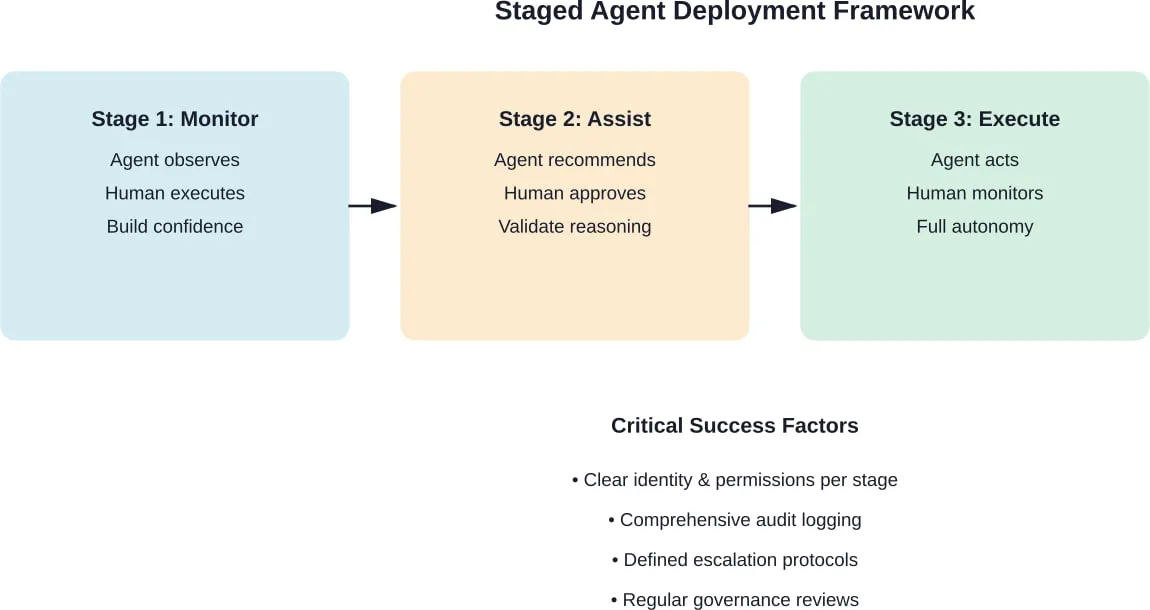

Garder les humains dans le coup

Même les agents d'IA les plus sophistiqués nécessitent une supervision humaine. Les meilleures mises en œuvre n'éliminent pas l'implication humaine, elles la renforcent.

Les organisations intègrent la supervision humaine dans les flux de travail des agents par le biais de plusieurs mécanismes :

Seuils de confiance

Les agents attribuent des notes de confiance à leurs décisions. Les actions dépassant un certain seuil (par exemple, 95% de confiance) sont exécutées automatiquement. Les décisions inférieures au seuil sont transmises aux humains pour examen.

Par exemple, les agents du service clientèle peuvent traiter automatiquement les remboursements dans le cadre du programme $50 avec un degré de confiance élevé, mais confier les montants plus importants ou les cas incertains à des agents humains.

Prévisualisation et approbation des flux de travail

Au lieu d'agir directement, les agents rédigent des propositions d'actions pour approbation humaine. Un agent de recherche juridique génère un mémo avec des citations de cas, mais un avocat le révise et l'approuve avant de l'envoyer au client.

Les équipes disposent ainsi d'un filet de sécurité tout en gagnant du temps sur le travail de préparation.

Recours à l'escalade en cas d'exception

Les agents traitent les affaires courantes de manière autonome, mais font remonter les situations inhabituelles. Lorsqu'une demande d'indemnisation sort des paramètres habituels, l'agent recueille toutes les informations pertinentes et les transmet à un expert humain qui a déjà préparé le contexte.

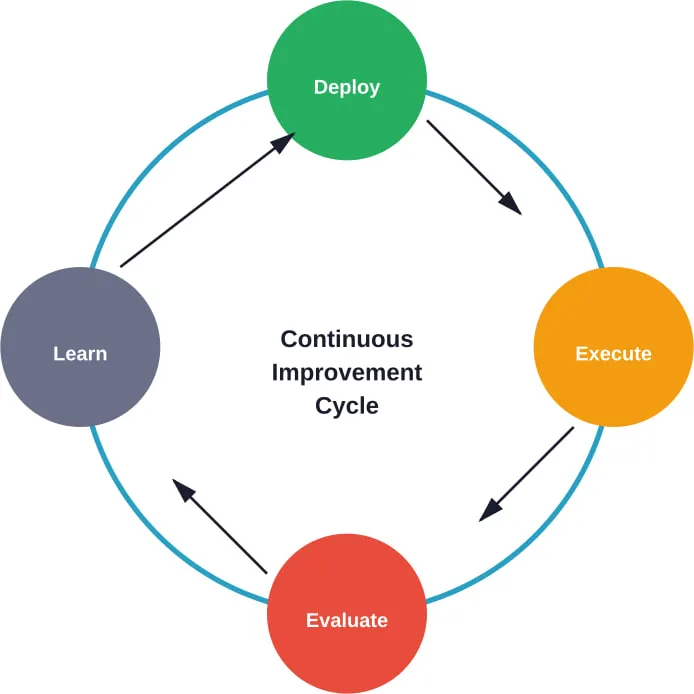

Audit et suivi

Les organisations échantillonnent régulièrement les décisions des agents pour en vérifier la qualité. Si la précision tombe en dessous des niveaux acceptables, les systèmes déclenchent une formation supplémentaire ou renforcent les seuils de confiance jusqu'à ce que les performances se rétablissent.

Capacités d'annulation

Les humains doivent être en mesure d'annuler les décisions de l'agent et de fournir un retour d'information. Lorsqu'un agent commet une erreur, la correction devient une donnée d'entraînement qui permet d'améliorer les performances futures.

L'objectif n'est pas d'éliminer complètement les humains des processus. Il s'agit de laisser les humains se concentrer sur les cas nécessitant de l'empathie, de la créativité, de la réflexion stratégique et un jugement complexe, tandis que les agents gèrent à grande échelle les gros volumes de travail basés sur des modèles.

Normes gouvernementales et initiatives en matière de sécurité

Alors que les agents d'intelligence artificielle passent du stade de l'expérimentation à celui de la production à grande échelle, les agences gouvernementales et les organismes de normalisation établissent des cadres pour garantir un déploiement sûr, sécurisé et interopérable.

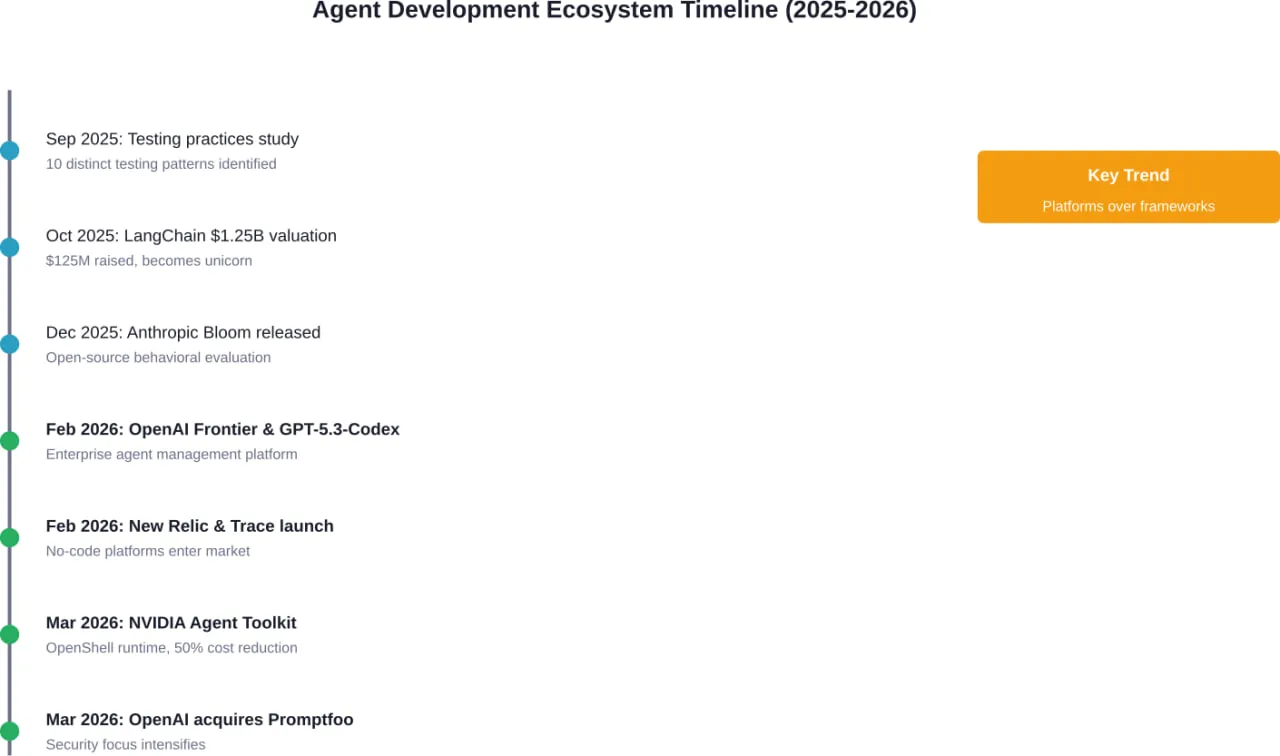

En février 2026, le NIST a annoncé l'initiative de normalisation des agents d'IA, conçue pour garantir que la prochaine génération d'IA puisse être largement adoptée en toute confiance, fonctionner en toute sécurité au nom des utilisateurs et interopérer sans heurts dans l'écosystème numérique.

Cette initiative vise à combler les lacunes critiques dans les déploiements actuels d'agents :

- Normes de sécurité pour les agents accédant aux données et systèmes sensibles

- Protocoles d'interopérabilité permettant aux agents de différents fournisseurs de travailler ensemble

- Mécanismes d'authentification prouvant l'identité et l'autorisation de l'agent

- Cadres d'audit pour le suivi des décisions et des actions des agents

- Critères de sécurité permettant d'évaluer l'état de préparation des agents en vue de leur déploiement dans les entreprises

Une évaluation comparative de la sécurité et de l'efficacité des agents d'intelligence artificielle a été publiée en janvier 2026, en mettant l'accent sur la préparation à des applications commerciales dans des tâches réelles plutôt que sur de simples démonstrations de capacités.

L'IEEE développe de nombreuses normes pour les systèmes autonomes et intelligents, y compris des cadres pour les agents d'intelligence artificielle proactifs basés sur l'interaction multimodale homme-ordinateur et des normes pour les intentions humaines et l'alignement de l'intelligence artificielle dans les systèmes autonomes.

Ces efforts de normalisation sont le reflet d'un écosystème en pleine maturation. Les premiers déploiements d'agents ont souvent fonctionné comme des solutions ponctuelles isolées. L'adoption future par les entreprises nécessite des agents capables de s'authentifier auprès de différents systèmes, de déléguer à d'autres agents et de fonctionner dans des cadres de sécurité et de gouvernance cohérents.

| Organisme de normalisation | Initiative | Domaine d'intervention | Statut (2026) |

|---|

| NIST | Initiative de normalisation des agents d'intelligence artificielle | Sécurité, interopérabilité, confiance | Développement actif |

| NIST | SP 800-53 Recouvrement des contrôles | Contrôles de sécurité du système d'IA | Publié |

| IEEE | P3833 | Cadre pour les agents d'IA proactifs | Projet de norme |

| IEEE | P3474 | Alignement entre l'homme et l'IA | Projet de norme |

| Sortie en janvier 2026 | Évaluation comparative des agents d'intelligence artificielle | Tests de sécurité et d'efficacité | Publié |

La réalité de la productivité

Pour tous les cas d'utilisation décrits ci-dessus, une question essentielle demeure : les organisations constatent-elles réellement les gains de productivité promis ?

Les données montrent un clivage très net.

La plupart des entreprises qui déploient l'IA générative ne constatent qu'un impact minime. McKinsey a constaté que plus de 80% ne signalent aucune contribution matérielle aux bénéfices, bien que 78% utilisent l'IA générative dans au moins une fonction.

Mais les organisations qui mettent en place de véritables opérations centrées sur l'agent - et ne se contentent pas de superposer l'IA aux flux de travail existants - font état de multiplications de la productivité de 2 à 10 fois. La Harvard Data Science Review a documenté des cas comme celui d'une entreprise industrielle mondiale qui a réduit le temps de rapport d'audit de 92% et des opérations de vente B2B qui ont réalisé des améliorations spectaculaires de l'efficacité grâce à une refonte centrée sur l'agent.

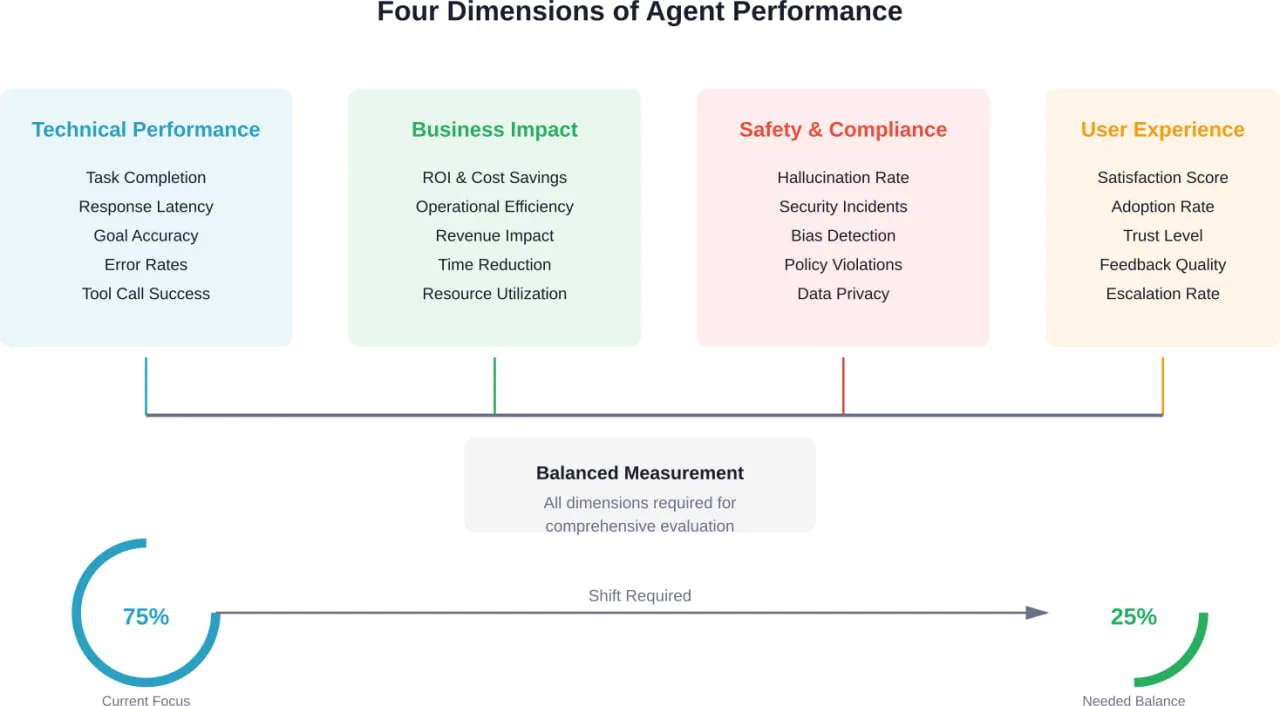

Qu'est-ce qui distingue ces résultats ?

Les mises en œuvre réussies ne posent pas la question de savoir “comment l'IA peut aider notre processus actuel”. Elles posent la question suivante : “Si nous concevions ce processus aujourd'hui avec des agents d'IA en tant que participants de premier ordre, à quoi ressemblerait-il ?”

Cette refonte fondamentale - construire des flux de travail centrés sur l'agent plutôt que sur l'homme avec l'aide de l'IA - entraîne des gains de productivité mesurables qui justifient l'investissement.

Défis et limites

Parlons franchement : Les agents d'intelligence artificielle ne sont pas magiques, et leur déploiement n'est pas sans poser des problèmes importants.

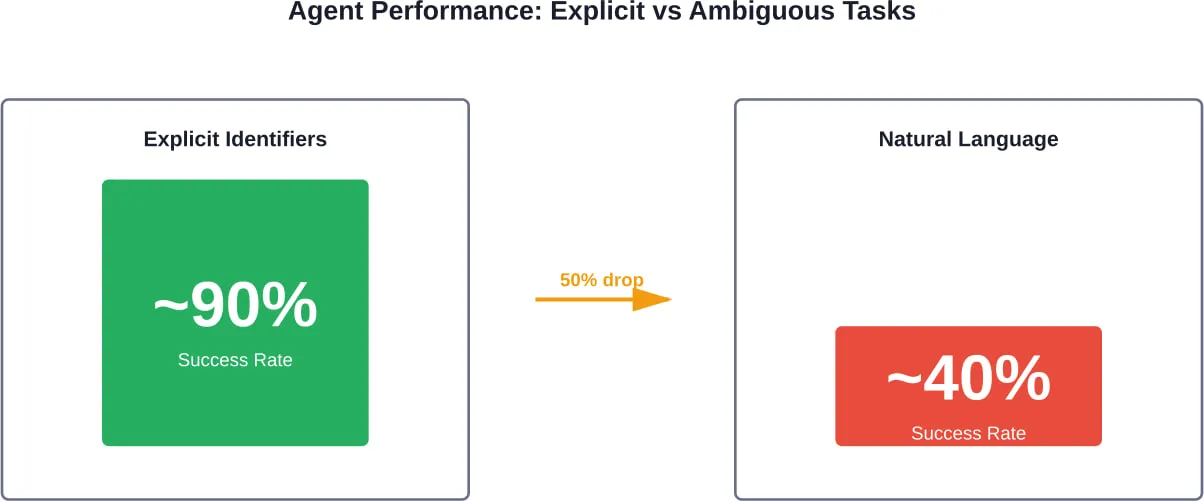

Précision et fiabilité

Les agents commettent des erreurs. Les modèles de fondation hallucinent les faits, interprètent mal le contexte et produisent des résultats qui ont l'air sûrs d'eux mais qui sont incorrects. Dans des domaines à fort enjeu comme les soins de santé, la finance et le droit, les erreurs peuvent avoir de graves conséquences.

C'est pourquoi les seuils de confiance et la supervision humaine restent essentiels. Les organisations doivent accepter qu'une précision de 100% n'est pas réaliste et concevoir des flux de travail en conséquence.

Complexité de l'intégration

Les agents tirent profit de l'accès à de multiples systèmes. Mais l'intégration avec l'infrastructure existante, la gestion de l'authentification entre les plateformes et le maintien de la cohérence des données sont des tâches complexes et coûteuses.

De nombreuses entreprises sous-estiment le travail d'intégration nécessaire pour passer de la validation du concept à la production.

Sécurité et vie privée

Les agents ont besoin d'accéder à des données et à des systèmes sensibles. Pour s'assurer qu'ils respectent les contrôles d'accès, qu'ils préservent la confidentialité des données et qu'ils fonctionnent en toute sécurité contre les attaques adverses, il faut une architecture soignée.

Les normes de sécurité du NIST pour les systèmes d'intelligence artificielle comblent cette lacune, mais leur mise en œuvre nécessite des efforts considérables en matière d'ingénierie de la sécurité.

Explicabilité et confiance

Lorsqu'un agent prend une décision, peut-il expliquer pourquoi ? Pour la conformité réglementaire et la confiance des utilisateurs, l'explicabilité est importante. Mais de nombreuses architectures d'agents fonctionnent comme des boîtes noires, ce qui rend difficile l'audit des décisions ou la confiance des utilisateurs.

Ce défi épistémologique - faire confiance aux processus algorithmiques malgré l'opacité - reste un domaine de recherche actif.

Gestion du changement

Le déploiement d'agents implique de modifier les méthodes de travail. Les employés peuvent résister à l'automatisation qui menace la sécurité de l'emploi, se méfier des décisions des agents ou avoir du mal à s'adapter aux nouveaux flux de travail.

Les mises en œuvre réussies investissent fortement dans la gestion du changement, la formation et la communication sur la manière dont les agents augmentent les capacités humaines plutôt qu'ils ne les remplacent.

Passer des exemples d'IA à la mise en œuvre réelle

Les cas d'utilisation montrent comment les agents d'IA peuvent être appliqués dans différents secteurs, mais la transformation de ces exemples en quelque chose d'utilisable dépend généralement du système qui les entoure - les services, le traitement des données et la façon dont tout est connecté dans la pratique.

A-listware apporte son aide à ce stade en mettant à disposition des équipes de développement qui travaillent sur les systèmes dorsaux, les intégrations et l'infrastructure. L'accent est mis sur le soutien à la mise en œuvre et sur la stabilité des systèmes au fur et à mesure de leur utilisation réelle, et non sur la création des agents eux-mêmes. Contact Logiciel de liste A pour mettre en production vos cas d'utilisation de l'IA avec le soutien technique adéquat.

Orientations futures : Les prochaines étapes pour les agents d'intelligence artificielle

Quelle est l'orientation de la technologie des agents ? Plusieurs tendances se dessinent clairement à mesure que les organisations passent des projets pilotes à la production à grande échelle.

Collaboration multi-agents

Les futurs systèmes feront appel à de multiples agents spécialisés qui collaboreront à des tâches complexes. Un processus de vente pourrait impliquer des agents distincts pour la recherche, la sensibilisation, la programmation de réunions et l'élaboration de propositions, chacun étant expert dans son domaine et se coordonnant pour mener à bien le flux de travail de bout en bout.

Cela nécessite des normes pour la communication entre les agents, la délégation des tâches et la résolution des conflits en cas de désaccord entre les agents.

Entreprises Agentic

Certaines organisations s'orientent vers ce que les chercheurs appellent “l'entreprise centrée sur l'agent”, dans laquelle les agents ne sont pas des outils utilisés par les humains, mais des participants autonomes aux processus d'entreprise auxquels on délègue le pouvoir de prendre des décisions et d'entreprendre des actions.

Cela représente un changement fondamental dans la conception de l'organisation, avec des implications pour la gouvernance, la gestion des risques et même la responsabilité juridique.

Agents personnels d'IA

On assiste à l'émergence d'agents en contact avec les consommateurs qui agissent au nom des individus, gérant les horaires, négociant les achats, surveillant les finances et s'occupant des tâches de routine. Ces agents personnels devront authentifier leur autorité, protéger la vie privée des utilisateurs et fonctionner sur plusieurs plateformes.

Agents spécifiques à l'industrie

Les agents génériques cèdent la place à des systèmes spécialisés, formés à partir de données spécifiques à un domaine et intégrant des flux de travail sectoriels. Les agents de santé, les agents juridiques et les agents de fabrication sont préconfigurés avec les connaissances et les processus appropriés.

Cadres réglementaires

La réglementation gouvernementale des agents d'IA s'accélère. Il faut s'attendre à des exigences en matière de transparence, de responsabilité, de tests de sécurité et de surveillance humaine, en particulier pour les applications à haut risque dans les domaines de la santé, de la finance et des infrastructures critiques.

Les organisations qui déploient des agents aujourd'hui doivent anticiper des exigences plus strictes en matière de conformité et concevoir des systèmes vérifiables et explicables dès le départ.

Questions fréquemment posées

- Quelle est la différence entre un agent d'IA et un chatbot ?

Les chatbots répondent aux questions des utilisateurs au cours d'une seule conversation, en puisant généralement les réponses dans une base de connaissances. Les agents d'IA exécutent de manière autonome des tâches à plusieurs étapes, accèdent à plusieurs systèmes, prennent des décisions en fonction du contexte et agissent au nom des utilisateurs. Un agent peut utiliser une interface de chatbot pour communiquer, mais ses capacités vont bien au-delà de la réponse à des questions - il complète des flux de travail entiers, de la planification à l'exécution.

- Quel est le coût de mise en œuvre des agents d'intelligence artificielle ?

Les coûts de mise en œuvre varient considérablement en fonction de la complexité, des exigences d'intégration et de l'échelle de déploiement. Des agents simples utilisant des plates-formes commerciales peuvent coûter entre 10 000 et 50 000 euros pour la mise en place initiale. Les systèmes de niveau entreprise avec des intégrations étendues, un développement personnalisé et des exigences de conformité peuvent dépasser $500 000. Les coûts permanents comprennent l'utilisation de l'API, l'infrastructure, la maintenance et la formation continue. Les entreprises devraient évaluer le coût total de possession sur 3 à 5 ans plutôt que de se limiter à la mise en œuvre initiale.

- Les agents d'intelligence artificielle peuvent-ils fonctionner avec nos systèmes existants ?

La plupart des agents modernes peuvent s'intégrer aux systèmes existants par le biais d'API, de connexions aux bases de données ou d'une automatisation des interfaces de type RPA. Le défi n'est pas la possibilité technique mais la complexité de la mise en œuvre. Les systèmes existants dépourvus d'API nécessitent plus de travail. Les organisations dotées d'architectures modernes, qui privilégient les API, trouvent l'intégration nettement plus facile. Évaluez l'environnement de votre système avant de vous engager dans le déploiement d'un agent - l'effort d'intégration dépasse souvent le développement de l'agent lui-même.

- Comment s'assurer que les agents d'IA ne commettent pas d'erreurs coûteuses ?

Mettre en place des seuils de confiance afin que les agents n'agissent automatiquement qu'en cas de certitude élevée. Acheminer les cas incertains vers un examen humain. Commencez par des flux de travail de prévisualisation et d'approbation dans lesquels les agents rédigent des actions à soumettre à l'approbation humaine. Surveillez en permanence les décisions des agents et ajustez les seuils en cas de perte de précision. Limitez l'autorité des agents pour les actions à haut risque - exigez l'approbation humaine pour les remboursements dépassant certains montants, les modifications de contrat ou l'accès à des données sensibles. Effectuez des tests et des validations approfondis avant le déploiement de la production.

- Quelles sont les fonctions les plus menacées par l'automatisation des agents d'IA ?

Les rôles impliquant des tâches répétitives et de grand volume, avec des règles claires, présentent le plus grand risque d'automatisation. Il s'agit notamment de la saisie de données, du service à la clientèle de base, de la planification de routine, de l'examen de documents simples et de l'assistance technique de premier niveau. Les recherches de Brookings suggèrent que plus de 30% de travailleurs pourraient être affectés de manière significative, avec les effets les plus importants sur les professions moyennement et hautement rémunérées et sur les fonctions de bureau. Cependant, la plupart des mises en œuvre augmentent plutôt qu'elles ne remplacent les travailleurs, en leur permettant de traiter des cas complexes nécessitant du jugement et de l'empathie.

- Combien de temps faut-il pour déployer un agent d'IA en production ?

Les délais varient considérablement en fonction de la complexité des cas d'utilisation. De simples agents de service à la clientèle sur des plateformes commerciales peuvent être mis en production en 4 à 8 semaines. Les agents d'entreprise complexes, avec des intégrations étendues, des exigences de conformité et un développement personnalisé, prennent généralement de 4 à 6 mois entre le lancement et la production. Ajoutez 2 à 3 mois supplémentaires pour la gestion du changement et l'adoption par les utilisateurs. Les organisations sous-estiment souvent le travail d'intégration et les exigences en matière de tests - planifiez de manière prudente et menez des projets pilotes étendus avant le déploiement complet.

- Faut-il des compétences techniques particulières pour créer et entretenir des agents d'intelligence artificielle ?

Les plateformes d'agents à code bas permettent aux équipes non techniques de créer des agents simples avec un minimum de programmation. Mais les agents d'entreprise de niveau de production nécessitent généralement des développeurs de logiciels familiarisés avec les API, les modèles d'intégration et l'architecture de la plateforme d'agents. La maintenance continue nécessite des compétences techniques similaires, ainsi qu'une expertise dans le domaine pour former les agents aux processus spécifiques à l'entreprise. De nombreuses organisations s'associent à des consultants spécialisés pour la mise en œuvre initiale, puis développent des capacités internes pour la gestion et l'expansion continues.

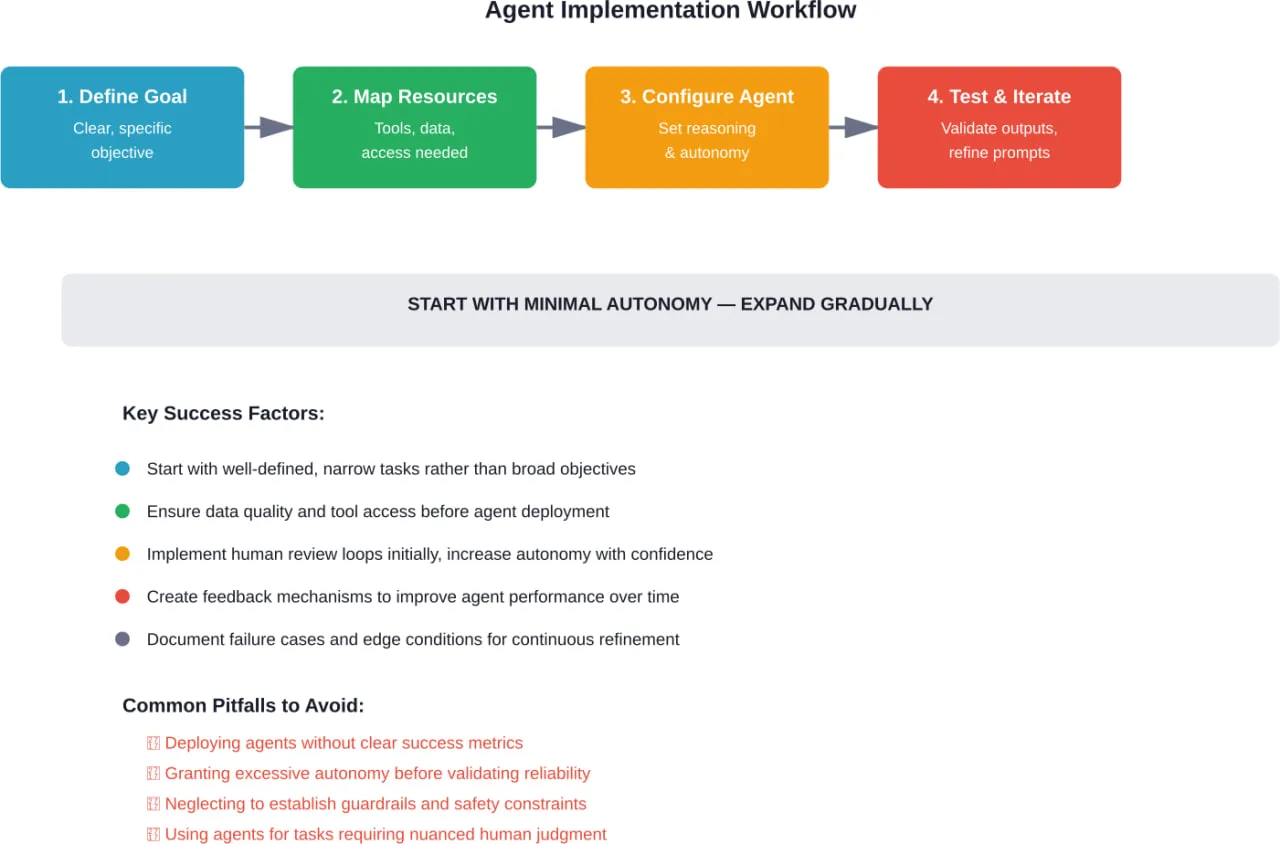

Passer du pilote à la production

Lire des articles sur les cas d'utilisation des agents d'IA est une chose. Les déployer avec succès en est une autre.

Les organisations qui obtiennent des résultats significatifs suivent un schéma cohérent :

- Commencez par les processus à haut volume et à faible risque : Ne commencez pas par les flux de travail critiques. Ciblez les tâches répétitives avec des critères de réussite clairs où les erreurs ont des conséquences limitées. Les FAQ clients, le traitement des factures et la planification des réunions constituent de meilleurs points de départ que des négociations complexes ou des diagnostics médicaux.

- Définir d'emblée les critères de réussite : A quoi ressemble le succès ? Réduction du temps de traitement ? Une réduction des coûts ? Amélioration de la satisfaction des clients ? Une plus grande précision ? Établissez des bases de référence avant le déploiement et suivez les mesures en continu. De nombreux projets pilotes échouent parce que les organisations ne peuvent pas démontrer un retour sur investissement clair.

- Planifier le travail d'intégration : La valeur de l'agent provient de l'accès aux systèmes existants. Il faut prévoir un budget de 50-70% pour l'intégration, l'authentification, le mappage des données et les essais. Ce travail dépasse systématiquement les estimations initiales.

- Investir dans la gestion du changement : Les gens doivent faire confiance aux agents et comprendre comment travailler avec eux. Former les utilisateurs pour qu'ils sachent quand s'en remettre aux agents plutôt que de faire appel à des humains. Communiquer de manière transparente sur l'impact de l'automatisation sur les rôles. Les organisations qui sautent cette étape sont confrontées à une résistance à l'adoption, quelle que soit la réussite technique.

- Itérer sur la base d'une utilisation réelle : Les agents s'améliorent en étant exposés à des cas réels. Prévoyez un perfectionnement continu basé sur l'analyse des erreurs, le retour d'information des utilisateurs et l'évolution des besoins. Le déploiement initial n'est que le point de départ.

- Mettre en place des cadres de gouvernance dès le début : Établir des politiques claires concernant l'autorité des agents, l'accès aux données, les procédures d'escalade et la supervision humaine avant de passer à l'échelle supérieure. Ces cadres deviennent plus difficiles à mettre en œuvre rétroactivement une fois que les agents sont intégrés dans les opérations.

Conclusion : L'avenir du travail alimenté par des agents

Les agents d'IA représentent bien plus qu'une automatisation progressive. Ils sont en train de remodeler la façon dont le travail est effectué dans tous les secteurs d'activité.

Les cas d'utilisation décrits ici - de l'assistance à la clientèle et des ventes à la finance, aux soins de santé et aux opérations de la chaîne d'approvisionnement - montrent que les agents fonctionnent déjà en production et fournissent des résultats mesurables aux organisations désireuses de repenser leurs processus plutôt que de simplement superposer l'IA aux flux de travail existants.

Mais nous n'en sommes qu'au début. La plupart des entreprises ont à peine effleuré la surface de ce qui est possible. L'écart entre les projets pilotes et le déploiement transformationnel reste important, plus de 80% des organisations ne constatant qu'un impact commercial minime malgré les investissements dans l'IA.

Qu'est-ce qui distingue les leaders ? Ils mettent en place des opérations centrées sur les agents à partir de la base, établissent des cadres de gouvernance appropriés, investissent dans l'intégration et la gestion du changement, et maintiennent une surveillance humaine appropriée.

Avec la maturation des normes, l'amélioration des plateformes et l'émergence des meilleures pratiques, l'adoption des agents va s'accélérer. Les organisations qui développent dès maintenant des capacités d'agent auront des avantages significatifs par rapport à celles qui attendent que la technologie “mûrisse”.”

La question n'est pas de savoir si les agents d'IA vont transformer votre secteur. Ils le font déjà. La question est de savoir si vous serez le moteur de cette transformation ou si vous y réagirez.

Prêt à explorer les agents d'IA pour votre organisation ? Commencez par identifier les processus répétitifs et à fort volume pour lesquels l'automatisation pourrait apporter une valeur immédiate. Définissez les exigences en matière d'intégration des systèmes. Définissez des paramètres de réussite clairs. Et commencez à développer les capacités qui définiront l'avantage concurrentiel dans l'avenir du travail alimenté par les agents.

![]()

![]()