Kurze Zusammenfassung: Digitale Transformation und Nachhaltigkeit konvergieren und schaffen leistungsstarke Lösungen für ökologische Herausforderungen. Unternehmen, die KI, IoT, Blockchain und Cloud Computing nutzen, können ihren CO2-Fußabdruck reduzieren, die Ressourcennutzung optimieren und messbare Auswirkungen auf die Umwelt erzielen, während sie gleichzeitig ihr Geschäftswachstum aufrechterhalten. Die Integration digitaler Technologien mit Nachhaltigkeitszielen ist ein entscheidender Weg, um die globalen Klimaziele zu erreichen und langfristige Resilienz zu erzielen.

Die Überschneidung von digitaler Innovation und Umweltverantwortung ist nicht mehr zu übersehen. Angesichts des sich beschleunigenden Klimawandels und des zunehmenden regulatorischen Drucks stehen Unternehmen vor einer doppelten Herausforderung: Sie müssen ihre Abläufe modernisieren und gleichzeitig die Umweltbelastung reduzieren.

Aber die Sache ist die: Bei der digitalen Transformation geht es nicht mehr nur um Effizienz. Sie wird zum Rückgrat dafür, wie Unternehmen ihre Nachhaltigkeitsverpflichtungen wahrnehmen. Von intelligenten Energienetzen bis hin zu KI-gestützter Abfallreduzierung - die Technologie verändert die Möglichkeiten des Umweltmanagements.

Nach Angaben des Weltwirtschaftsforums könnten digitale Technologien dazu beitragen, bis zum Jahr 2050 bis zu 20 Prozent der weltweiten Treibhausgasemissionen zu reduzieren. Das ist keine geringe Zahl. Dennoch behandeln viele Unternehmen digitale Initiativen und Nachhaltigkeitsbemühungen immer noch als getrennte Bereiche und verpassen die enormen Synergien zwischen ihnen.

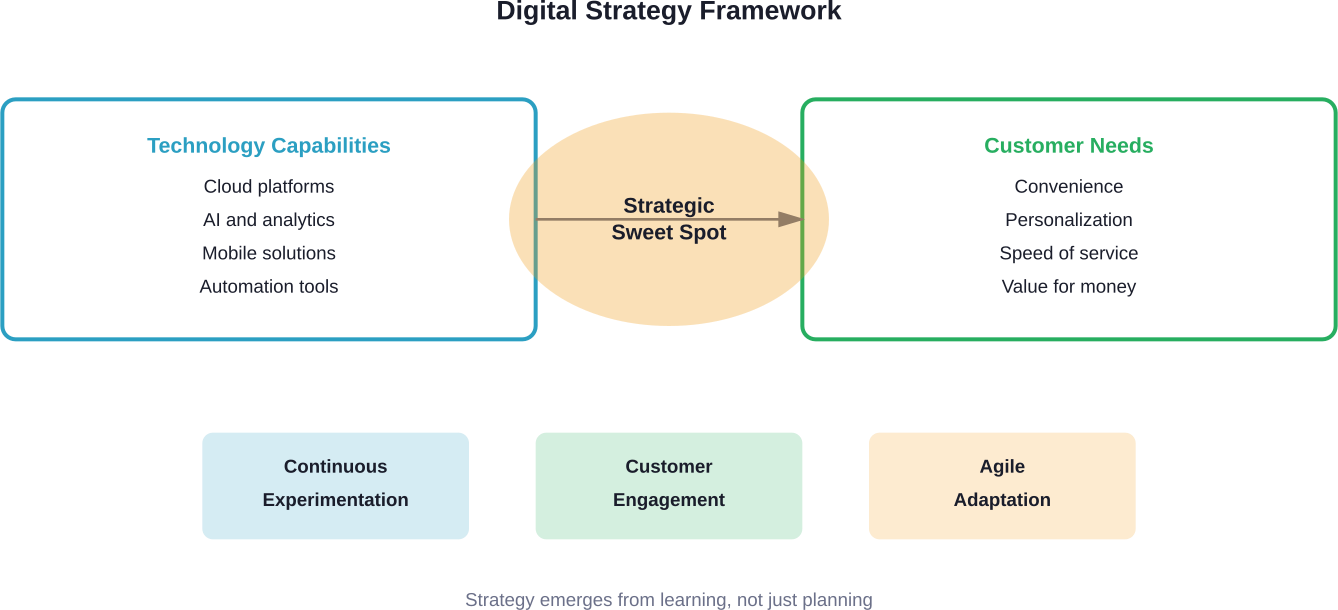

Die Frage ist nicht, ob man die digitale Transformation oder die Nachhaltigkeit verfolgen soll. Es geht darum, wie beide Strategien in einen einheitlichen Ansatz integriert werden können, der gleichzeitig ökologische und geschäftliche Ergebnisse liefert.

Die Konvergenz zwischen digitaler und nachhaltiger Entwicklung verstehen

Die digitale Transformation verändert grundlegend, wie Unternehmen arbeiten, Entscheidungen treffen und Werte schaffen. Die nachhaltige Transformation befasst sich damit, wie Unternehmen die Umwelt und die Gesellschaft beeinflussen. Wenn diese beiden Kräfte zusammenkommen, entsteht etwas Gewaltiges.

Die US-Umweltschutzbehörde EPA stellt fest, dass die durch den Bau, die Instandhaltung und den Abriss von Gebäuden verursachten Kohlenstoffemissionen für 11 Prozent der weltweiten Treibhausgasemissionen verantwortlich sind. Die Materialrückgewinnung durch verbesserte Recyclingtechnologien ist ein Weg zur Verringerung dieser Auswirkungen, weshalb die EPA die Technologieentwicklung durch Programme unterstützt, die sich auf Lösungen für die Kreislaufwirtschaft konzentrieren.

Im Klartext: Die Beziehung funktioniert in beide Richtungen. Digitale Technologien ermöglichen bessere Nachhaltigkeitsergebnisse durch Überwachung, Optimierung und Transparenz. Gleichzeitig treiben Nachhaltigkeitsziele die Innovation bei digitalen Lösungen voran, indem sie die Entwickler dazu bringen, energiebewusste Computer und saubere KI-Systeme zu entwickeln.

In einer in Frontiers in Environmental Science veröffentlichten Studie wurde untersucht, wie sich die digitale Transformation bei börsennotierten chinesischen Unternehmen auf die Nachhaltigkeit auswirkt. Die Analyse ergab positive Korrelationen zwischen Digitalisierungsinitiativen und Umweltleistung, was darauf hindeutet, dass die Einführung strategischer Technologien einen messbaren Beitrag zu Nachhaltigkeitsergebnissen leistet.

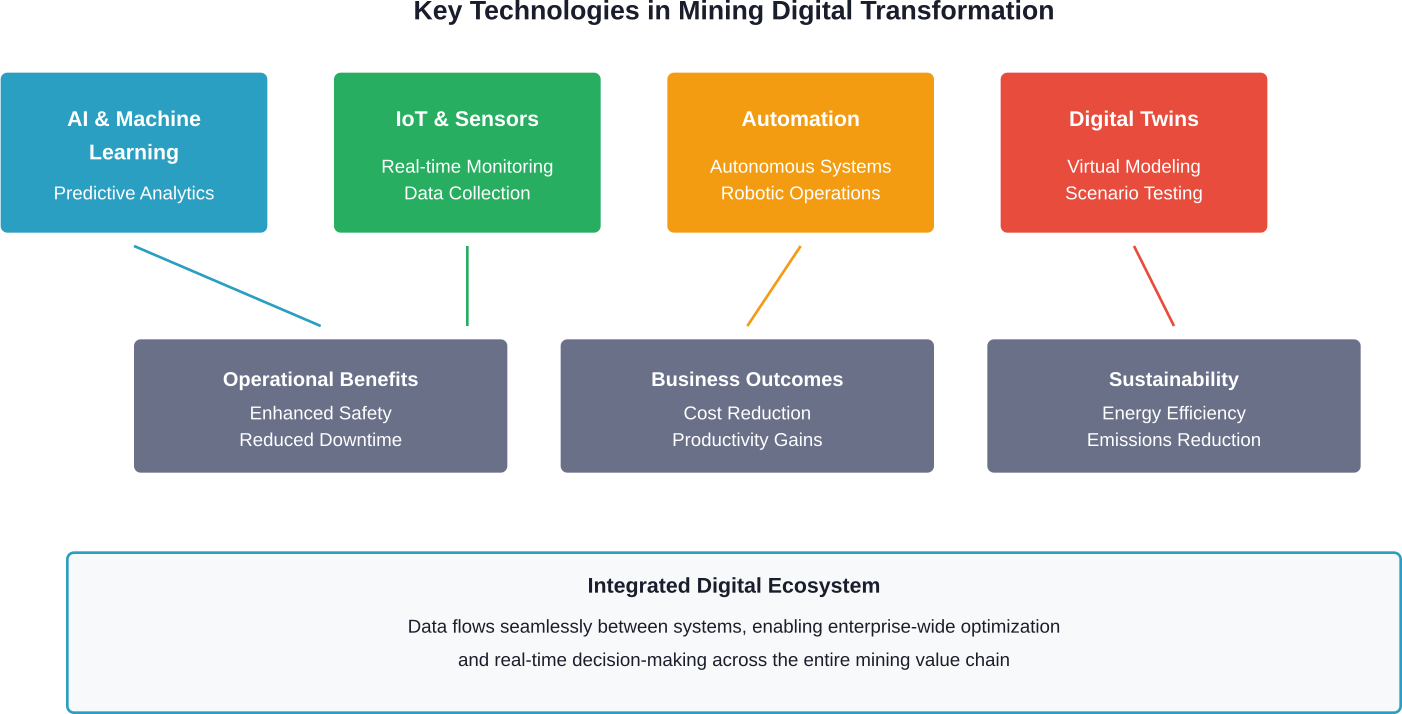

Kerntechnologien für eine nachhaltige digitale Transformation

Einige digitale Technologien sind für Nachhaltigkeitsbemühungen von besonderer Bedeutung. Das Verständnis ihrer spezifischen Anwendungen hilft Organisationen, Prioritäten für Investitionen zu setzen und effektive Strategien zu entwickeln.

Künstliche Intelligenz und maschinelles Lernen

KI-gesteuerte Systeme eignen sich hervorragend zur Optimierung komplexer Prozesse, bei denen die menschliche Entscheidungsfindung nicht mit dem Datenvolumen Schritt halten kann. Das Energiemanagement ist einer der deutlichsten Anwendungsfälle.

Intelligente Gebäudesysteme nutzen Algorithmen des maschinellen Lernens, um den Heiz-, Kühl- und Beleuchtungsbedarf auf der Grundlage von Belegungsmustern, Wettervorhersagen und historischer Nutzung vorherzusagen. Diese Systeme passen sich in Echtzeit an und senken den Energieverbrauch ohne Einbußen bei Komfort oder Produktivität.

Fertigungsbetriebe setzen KI ein, um Verschwendung zu minimieren, indem sie Anlagenausfälle vorhersagen, Produktionspläne optimieren und Qualitätsprobleme erkennen, bevor defekte Produkte zusätzliche Ressourcen verbrauchen. Die Kombination aus vorausschauender Wartung und Qualitätsoptimierung senkt sowohl die Betriebskosten als auch die Umweltbelastung.

Allerdings verursacht die KI selbst auch Umweltkosten. Die für das Training großer Modelle erforderliche Rechenleistung verursacht erhebliche Kohlenstoffemissionen. Unternehmen, die eine nachhaltige KI anstreben, müssen die Modelleffizienz, erneuerbare Energiequellen für Rechenzentren und den Netto-Umweltnutzen jeder Anwendung berücksichtigen.

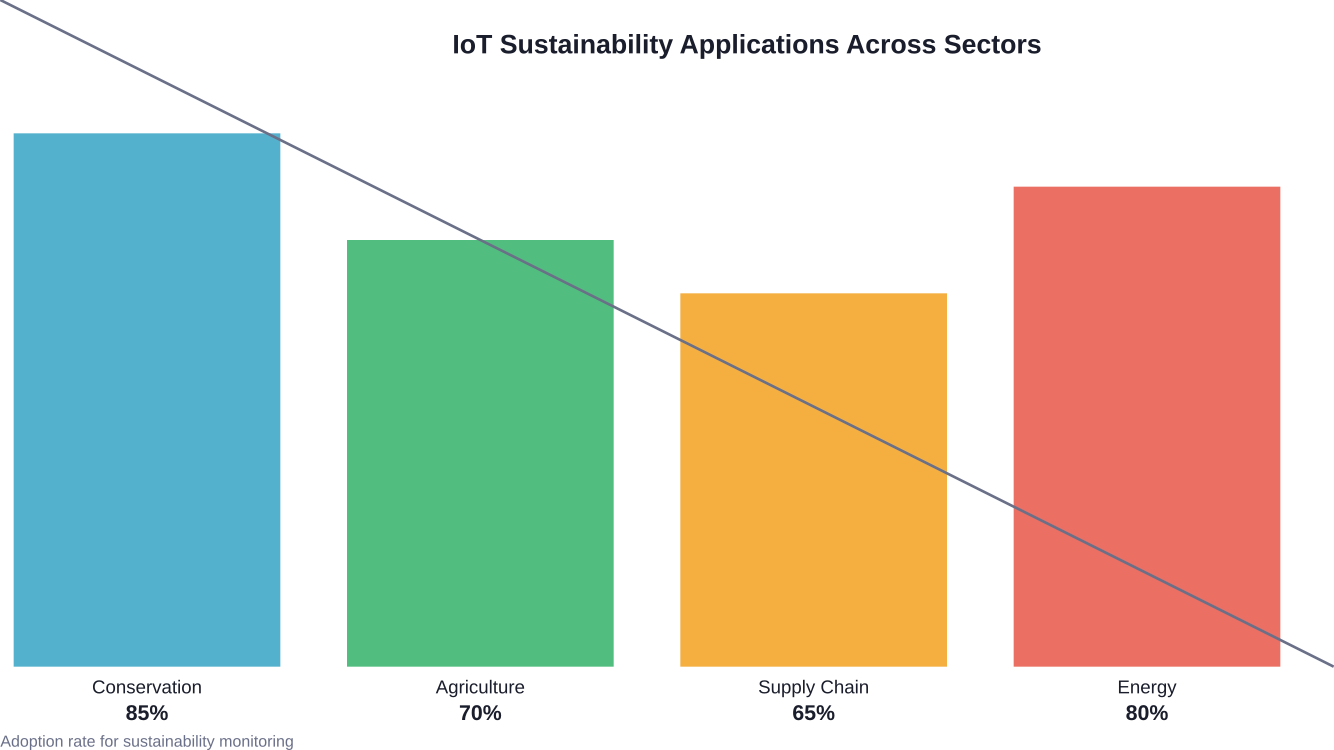

Internet der Dinge (IoT) für die Umweltüberwachung

IoT-Sensoren liefern die Echtzeit-Datengrundlage für viele Nachhaltigkeitsinitiativen. Diese Geräte werden in natürlichen Ökosystemen eingesetzt und überwachen die Luftqualität, den Wasserstand, den Zustand des Bodens und die Bewegungen von Wildtieren mit einer noch nie dagewesenen Detailgenauigkeit.

Die Naturschutzbemühungen profitieren enorm von dieser kontinuierlichen Überwachungsmöglichkeit. Parkverwalter erkennen illegale Abholzung oder Wilderei schneller. Manager von Wasserressourcen erkennen Verunreinigungen, bevor sie sich ausbreiten. Landwirtschaftliche Betriebe optimieren die Bewässerung auf der Grundlage der tatsächlichen Bodenfeuchtigkeit und nicht auf der Grundlage von Zeitplänen.

IoT-Anwendungen in der Lieferkette ermöglichen die Verfolgung von Produkten während ihres gesamten Lebenszyklus und die Überwachung von Bedingungen wie Temperatur und Feuchtigkeit, die sich auf die Produktqualität und den Abfall auswirken. Einzelhändler reduzieren den Verderb von verderblichen Waren. Hersteller gewährleisten die ordnungsgemäße Handhabung empfindlicher Materialien.

Blockchain für Transparenz in der Lieferkette

Nachhaltigkeitsaussagen sind ohne Überprüfung bedeutungslos. Die Blockchain-Technologie erstellt unveränderliche Aufzeichnungen über den Weg eines Produkts, was Greenwashing erheblich erschwert.

Modemarken nutzen Blockchain, um Kleidungsstücke von der Rohstoffbeschaffung über die Herstellung bis zum Vertrieb zu verfolgen. Verbraucher scannen QR-Codes, um Angaben über Bio-Baumwolle, faire Arbeitsbedingungen oder klimaneutralen Versand zu überprüfen.

Lebensmittelversorgungsketten setzen ähnliche Systeme ein, um Bio-Zertifizierungen, nachhaltige Fischereipraktiken und die humane Behandlung von Tieren zu verfolgen. Die Transparenz schafft auf jeder Stufe Verantwortlichkeit, belohnt wirklich nachhaltige Praktiken und deckt problematische Praktiken auf.

Auch die Märkte für Emissionsgutschriften profitieren von den Verifizierungsmöglichkeiten der Blockchain. Handelsplattformen zeichnen Emissionsreduzierungen und Kreditübertragungen mit hoher Transparenz auf, was Betrug reduziert und das Vertrauen in Ausgleichsprogramme erhöht.

Cloud Computing und Rechenzentren

Die Cloud-Infrastruktur ermöglicht die Skalierbarkeit und Datenverarbeitung, die andere Nachhaltigkeitstechnologien antreiben. Aber Rechenzentren selbst verbrauchen enorme Mengen an Energie.

Große Cloud-Anbieter haben darauf reagiert, indem sie sich für erneuerbare Energien und mehr Effizienz einsetzen. Die Konsolidierung von Arbeitslasten in Hyperscale-Einrichtungen verbraucht in der Regel weniger Gesamtenergie als eine verteilte Infrastruktur vor Ort, obwohl der Nettonutzen von den jeweiligen Umständen abhängt.

Unternehmen, die auf Cloud-Plattformen umsteigen, sollten die Anbieter nach ihren Verpflichtungen in Bezug auf erneuerbare Energien, die Effektivität des Stromverbrauchs und den Standort des Rechenzentrums bewerten. Die Wahl des Standorts wirkt sich sowohl auf die Kohlenstoffintensität des Stroms als auch auf den Kühlungsbedarf aus. Bei der Auswahl von Anbietern sollten spezifische Bewertungen der Stromverbrauchseffizienz berücksichtigt werden.

Praktische Anwendungen in verschiedenen Branchen

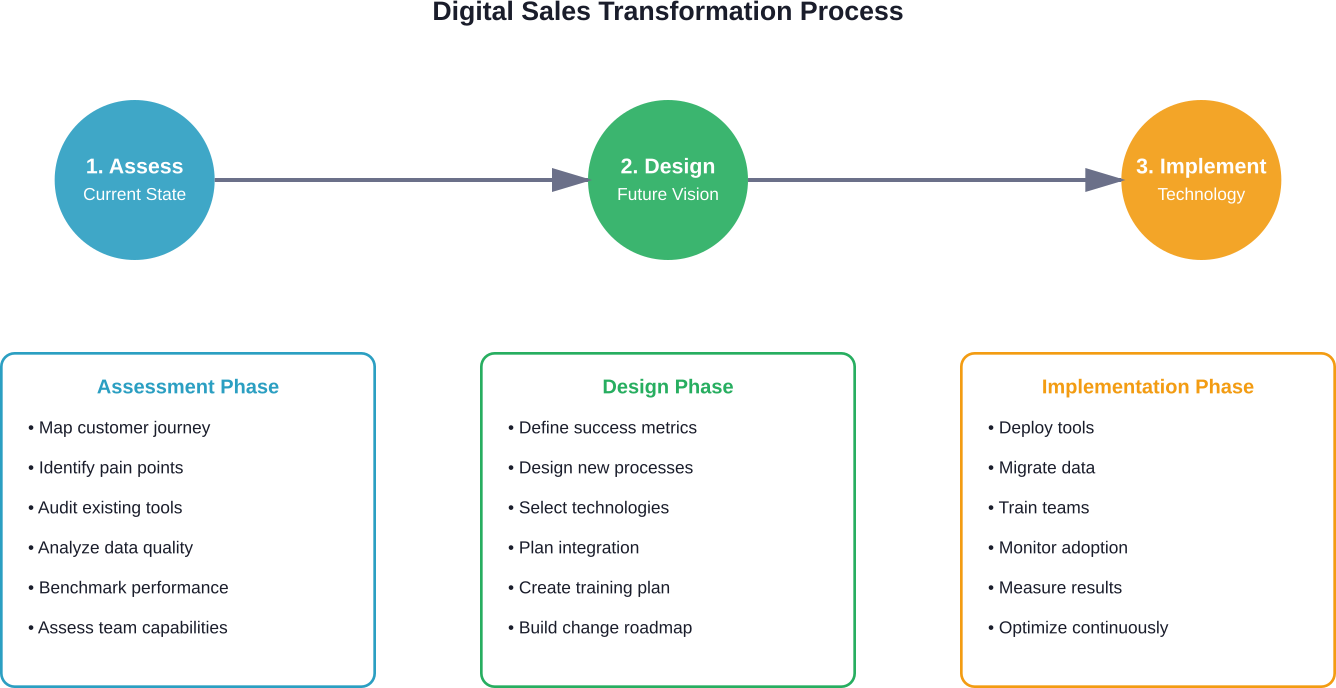

Verschiedene Sektoren stehen vor einzigartigen Herausforderungen in Bezug auf die Nachhaltigkeit, denen die digitale Transformation auf sektorspezifische Weise begegnet.

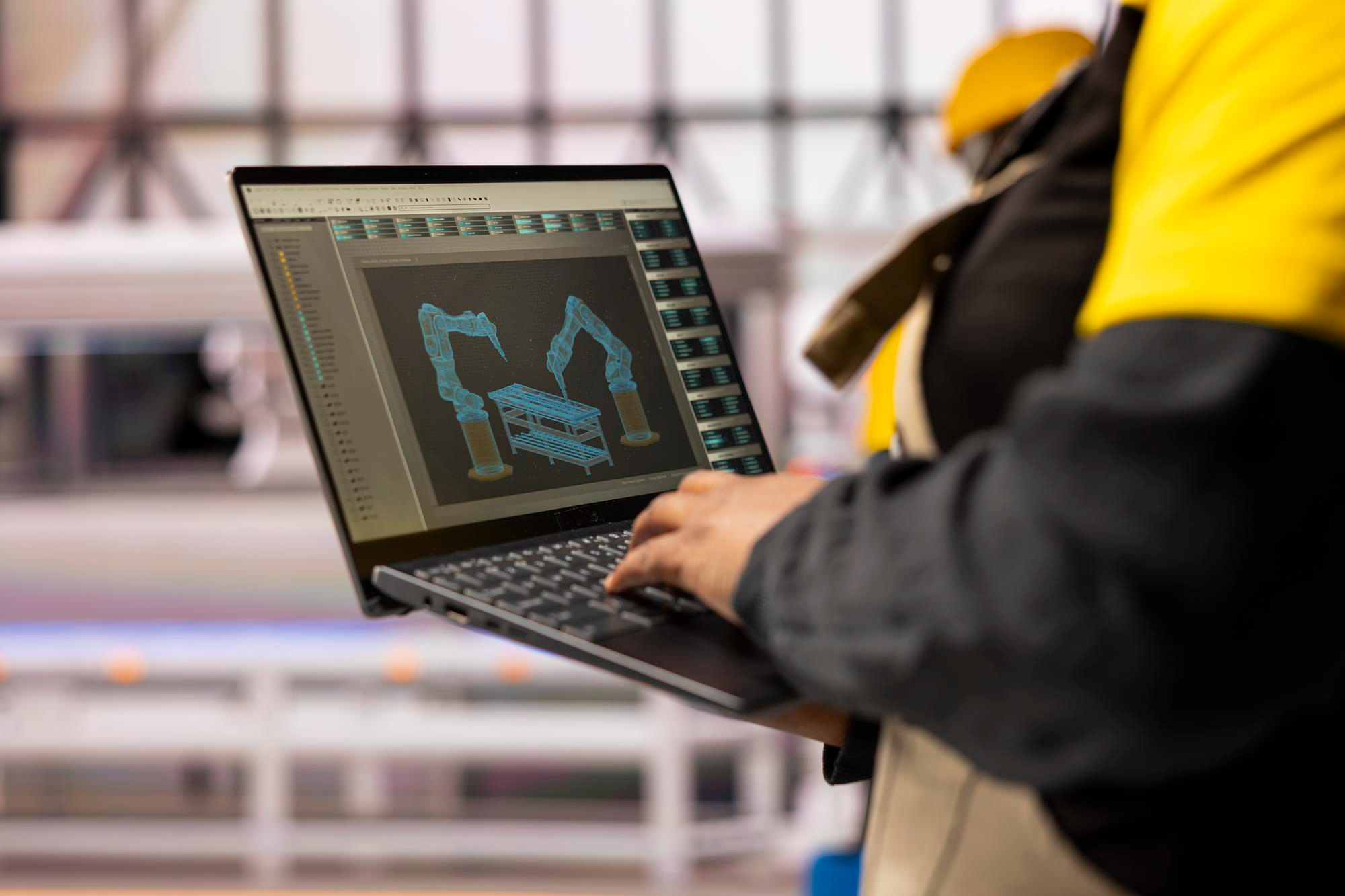

Herstellung und Produktion

Die nachhaltige Fertigung nutzt digitale Zwillinge - virtuelle Nachbildungen physischer Produktionssysteme, die Tests und Optimierungen ohne Ressourcenverbrauch ermöglichen. Ingenieure simulieren Prozessänderungen, identifizieren Engpässe und prognostizieren Ergebnisse, bevor sie die Änderungen in der Fabrikhalle umsetzen.

Bei der additiven Fertigung (3D-Druck) wird der Materialabfall verringert, da die Produkte schichtweise aufgebaut werden, anstatt überschüssiges Material wegzuschneiden. Komplexe Geometrien, die das Gewicht minimieren und gleichzeitig die Festigkeit erhalten, werden machbar, was gleichzeitig den Materialverbrauch und die Transportemissionen reduziert.

Vorausschauende Wartungssysteme überwachen den Zustand der Anlagen und planen Reparaturen, bevor es zu Ausfällen kommt. Dies verhindert sowohl ungeplante Ausfallzeiten als auch die Umweltbelastung durch katastrophale Anlagenausfälle, bei denen Gefahrstoffe freigesetzt werden oder energieintensive Notfallmaßnahmen erforderlich sind.

Energie und Versorgungsunternehmen

Intelligente Stromnetze sind vielleicht die transformativste Anwendung digitaler Technologie für die Nachhaltigkeit. Diese Systeme gleichen Angebot und Nachfrage in Echtzeit aus und integrieren variable erneuerbare Energiequellen wie Sonne und Wind effektiver als herkömmliche Infrastrukturen.

Verteilte Energieressourcen - Solaranlagen auf dem Dach, Batteriespeicher, Elektrofahrzeuge - erzeugen bidirektionale Energieflüsse, die ein ausgeklügeltes digitales Management erfordern. KI-Algorithmen sagen Erzeugungs- und Verbrauchsmuster voraus, optimieren die Ladezyklen der Speicher und sorgen für Netzstabilität.

Das Tool Energy Access Explorer des World Resources Institute zeigt, wie Geodaten und digitale Plattformen die Planung des Energiezugangs beschleunigen. Als erstes digitales öffentliches Gut im Energiebereich analysiert es hochauflösende Informationen, um faktenbasierte Infrastrukturentscheidungen zu unterstützen.

Transport und Logistik

Algorithmen zur Routenoptimierung senken den Kraftstoffverbrauch durch die Analyse von Verkehrsmustern, Lieferfenstern und Fahrzeugkapazitäten. Flottenmanagementsysteme verfolgen das Fahrerverhalten und erkennen ineffiziente Praktiken wie übermäßigen Leerlauf oder aggressives Beschleunigen.

Die Einführung von Elektrofahrzeugen wird beschleunigt, wenn die Ladeinfrastruktur intelligenter wird. Demand-Response-Programme laden Fahrzeuge auf, wenn die Stromerzeugung aus erneuerbaren Energien Spitzenwerte erreicht, um die Elektrifizierung des Verkehrs mit der Verfügbarkeit sauberer Energie in Einklang zu bringen.

Gemeinsame Mobilitätsplattformen reduzieren die Gesamtanzahl der gefahrenen Kilometer, indem sie die Fahrgäste aufeinander abstimmen und die Fahrzeugnutzung optimieren. Der Nutzen für die Nachhaltigkeit hängt davon ab, dass Fahrten mit dem privaten Pkw durch Fahrten mit dem öffentlichen Nahverkehr ersetzt werden, weshalb die Einzelheiten der Umsetzung von entscheidender Bedeutung sind.

Landwirtschaft und Lebensmittelsysteme

Die Präzisionslandwirtschaft nutzt GPS, Sensoren und Datenanalyse, um Wasser, Dünger und Pestizide nur dort auszubringen, wo sie benötigt werden. Dieser gezielte Ansatz reduziert den Abfluss von Chemikalien, spart Wasser und senkt die Kosten für Betriebsmittel, während die Erträge erhalten bleiben oder verbessert werden.

Vertikale Anbausysteme nutzen IoT-Sensoren und automatische Steuerungen, um Pflanzen in einer kontrollierten Umgebung mit drastisch reduziertem Wasserverbrauch und ohne Pestizidbedarf anzubauen. Die mit erneuerbaren Energien betriebenen Anlagen sind zwar energieintensiv, können aber Lebensmittel mit einer geringeren Gesamtumweltbelastung als die herkömmliche Landwirtschaft erzeugen.

Die Digitalisierung der Lieferkette verringert die Lebensmittelverschwendung, indem sie die Nachfrageprognose verbessert, die Lagerbestände optimiert und die Ernte mit dem Marktbedarf koordiniert. Angesichts der Tatsache, dass Lebensmittelabfälle erheblich zu den globalen Emissionen beitragen, sind diese Verbesserungen von großer Bedeutung für die Umwelt.

Messung und Berichterstattung über Umweltauswirkungen

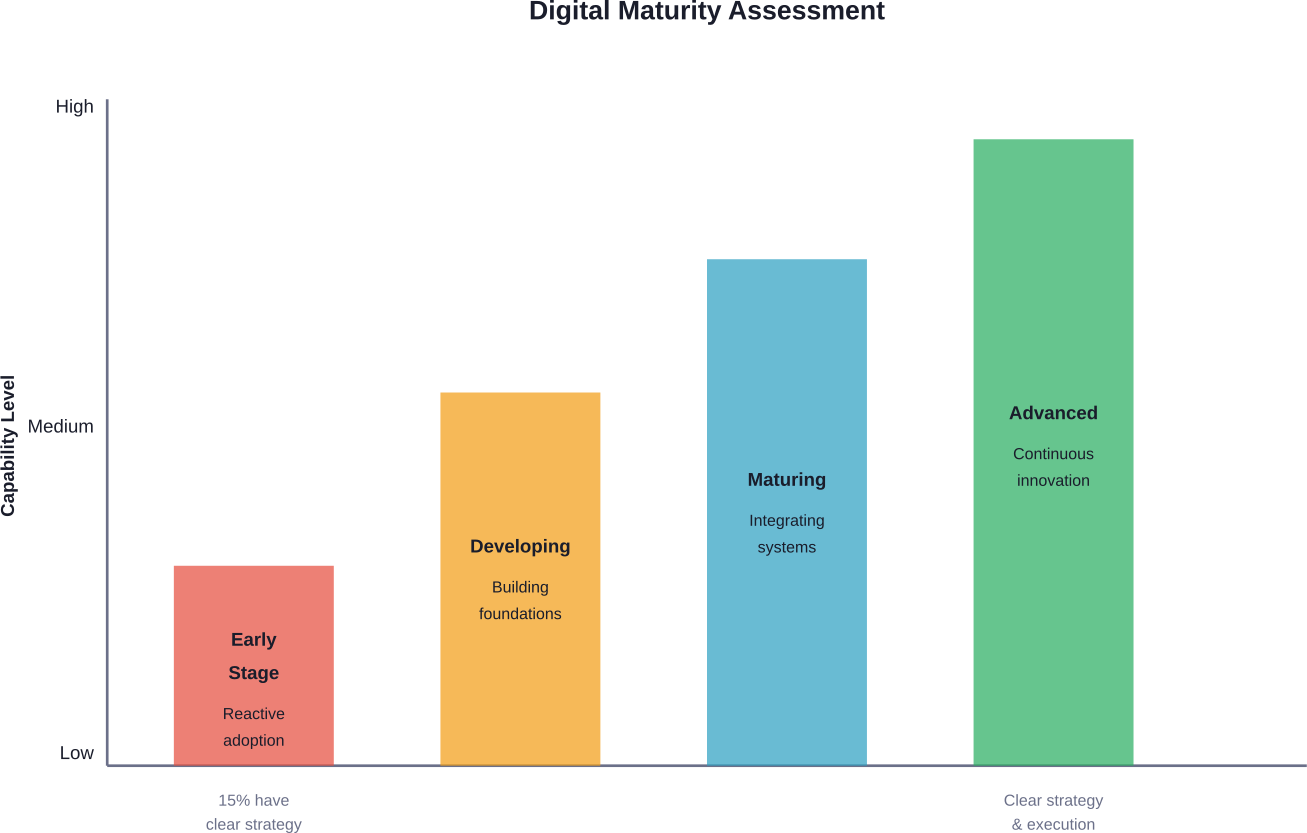

Eine wirksame Nachhaltigkeitstransformation erfordert rigorose Messungen. Digitale Tools machen dies zunehmend möglich und standardisiert.

Die Norm ISO 14019-4:2026 befasst sich mit den Grundsätzen und Anforderungen an Stellen, die Nachhaltigkeitsinformationen validieren und überprüfen. Dieser Rahmen unterstützt eine glaubwürdige Umweltberichterstattung, da die Forderungen der Interessengruppen nach Transparenz zunehmen.

Softwareplattformen automatisieren heute die Kohlenstoffbilanzierung, indem sie Daten aus Versorgungsrechnungen, Reiseaufzeichnungen, Beschaffungssystemen und Produktionsprotokollen abrufen. Diese Tools berechnen die Scope-1-, -2- und -3-Emissionen nach etablierten Protokollen und reduzieren so den manuellen Aufwand, der früher eine umfassende Buchführung für viele Unternehmen unpraktisch machte.

Echtzeit-Dashboards verfolgen Nachhaltigkeitsmetriken neben den herkömmlichen Geschäftskennzahlen und machen die Umweltleistung für Entscheidungsträger sichtbar. Diese Integration trägt dazu bei, dass Nachhaltigkeitsaspekte in betriebliche Entscheidungen einfließen und nicht in speziellen Abteilungen isoliert bleiben.

Initiativen für offene Daten spielen eine entscheidende Rolle bei Klimaschutzmaßnahmen. Laut dem World Resources Institute sind gemeinsam genutzte Daten und Informationen von grundlegender Bedeutung für das Mainstreaming von Klimaschutzmaßnahmen in Regierung und Gesellschaft. Die Veröffentlichung offener Daten ermöglicht eine zivilgesellschaftliche Kontrolle und gibt Entwicklern die Möglichkeit, Instrumente zu entwickeln, die eine breitere Wirkung entfalten und neue Zielgruppen ansprechen.

| Kategorie Messung | Digitale Werkzeuge | Wichtige Metriken | Häufigkeit der Berichterstattung |

|---|---|---|---|

| Kohlenstoff-Emissionen | Automatisierte Buchhaltungsplattformen | Scope 1, 2, 3 Emissionen (tCO2e) | Monatlich/Quartalsweise |

| Energieverbrauch | IoT-Sensoren, Gebäudemanagementsysteme | kWh gesamt, kWh pro Leistungseinheit | Echtzeit/Täglich |

| Verbrauch von Wasser | Intelligente Zähler, Durchflusssensoren | Gallonen insgesamt, Wasserintensitätsquoten | Täglich/Wöchentlich |

| Abfallerzeugung | Software zur Abfallverfolgung, Wiegesysteme | Gesamtabfall, Diversifizierungsrate, Recycling % | Wöchentlich/Monatlich |

| Auswirkungen auf die Lieferkette | Blockchain-Plattformen, Lieferantenportale | Emissionen der Lieferanten, Zertifizierungen | Vierteljährlich/jährlich |

Überwindung von Implementierungsherausforderungen

Digitale Transformation für Nachhaltigkeit klingt in der Theorie überzeugend. Die Umsetzung bringt echte Herausforderungen mit sich, die Unternehmen meistern müssen.

Datenqualität und Integration

Nachhaltigkeitsinitiativen erfordern häufig die Integration von Daten aus unterschiedlichen Quellen, die nie für die Zusammenarbeit konzipiert wurden. Ältere Produktionsanlagen, Abrechnungssysteme von Versorgungsunternehmen, Transportmanagement-Plattformen und Beschaffungsdatenbanken speichern relevante Informationen in inkompatiblen Formaten.

Die Lösung dieses Problems erfordert Investitionen in die Dateninfrastruktur (APIs, Data Lakes, Integrationsplattformen), bevor Analysen Erkenntnisse liefern können. Unternehmen unterschätzen sowohl die technische Komplexität als auch das organisatorische Änderungsmanagement, das für die Einrichtung hochwertiger Datenflüsse erforderlich ist.

Fertigkeiten und Fähigkeiten

Eine wirksame, nachhaltige digitale Transformation erfordert hybrides Fachwissen: Fachleute, die sich sowohl mit Technologie als auch mit Umweltwissenschaften auskennen. Diese Personen sind nach wie vor rar.

Der Aufbau interner Fähigkeiten durch Schulungen braucht Zeit. Die Zusammenarbeit mit Beratern ermöglicht einen schnelleren Start, birgt aber die Gefahr, dass nach Beendigung der Zusammenarbeit Wissenslücken entstehen. Die meisten Unternehmen benötigen einen ausgewogenen Ansatz, bei dem externes Fachwissen für die Erstimplementierung mit einer gezielten internen Kompetenzentwicklung kombiniert wird.

Rechtfertigung der Investition

Bei Nachhaltigkeitsinvestitionen werden die finanziellen Erträge genau geprüft. Während einige Initiativen klare Kosteneinsparungen bringen - Energieeffizienz, Abfallreduzierung -, bringen andere vor allem Vorteile für die Umwelt und den Ruf.

Der Rahmen ist von enormer Bedeutung. Investitionen, die als reine Nachhaltigkeitsausgaben positioniert sind, haben es schwerer, genehmigt zu werden als solche, die neben dem Umweltnutzen auch die betriebliche Stabilität, die Einhaltung von Vorschriften, Kundenanforderungen und die Positionierung im Wettbewerb in den Vordergrund stellen.

Technologieauswahl und Anbieterbindung

Die Landschaft der Nachhaltigkeitstechnologien entwickelt sich schnell weiter. Lösungen, die heute modern erscheinen, können schnell veraltet sein, und die Konsolidierung von Anbietern birgt die Gefahr, dass man sich an sie bindet.

Unternehmen sollten Plattformen mit offenen APIs und Standarddatenformaten den Vorzug geben. Der Aufbau auf proprietären Systemen schafft Abhängigkeiten, deren Auflösung teuer wird, wenn sich die Anforderungen ändern oder bessere Alternativen auftauchen.

Aufkommende Standards und Rahmenwerke

Standardisierung hilft Organisationen, die Komplexität zu bewältigen und Glaubwürdigkeit zu gewährleisten. Mehrere neue Rahmenwerke befassen sich speziell mit der digitalen Nachhaltigkeit.

ISO/IEC TS 20125-1:2026 legt Ökopraktiken für digitale Dienstleistungen in allen Lebenszyklusphasen fest. Diese Technische Spezifikation bietet eine Anleitung zu Ökodesign-Prinzipien, die speziell auf Dienstleistungen der Informationstechnologie zugeschnitten sind, und behandelt, wie digitale Angebote die Umweltauswirkungen von der Konzeption bis zur Außerbetriebnahme minimieren können.

Diese Normen sind wichtig, weil sie gemeinsame Sprachen und Erwartungen schaffen. Lieferanten und Kunden können sich an den Nachhaltigkeitsanforderungen orientieren, ohne Definitionen von Grund auf auszuhandeln. Prüfer können die Leistung anhand festgelegter Kriterien und nicht anhand subjektiver Behauptungen bewerten.

Die Einführung ist in den meisten Ländern nach wie vor freiwillig, aber die Trends bei den Rechtsvorschriften deuten darauf hin, dass die Pflicht zur Nachhaltigkeitsberichterstattung zunehmen wird. Unternehmen, die jetzt Kapazitäten aufbauen, positionieren sich vorteilhaft für zukünftige Compliance-Anforderungen.

Bewährte Praktiken für den Erfolg

Organisationen, die aussagekräftige Ergebnisse erzielen, haben gemeinsame Ansätze, die erfolgreiche Implementierungen von gescheiterten Initiativen unterscheiden.

Beginnen Sie mit geschäftsspezifischen Anwendungsfällen

Die erfolgreichsten digitalen Nachhaltigkeitsinitiativen lösen echte Unternehmensprobleme und bieten gleichzeitig Vorteile für die Umwelt. Energieoptimierung senkt Kosten. Vorausschauende Wartung verhindert Ausfallzeiten. Transparenz in der Lieferkette verringert das Reputationsrisiko.

Wenn man mit diesen Doppelnutzen-Möglichkeiten beginnt, wird eine Dynamik aufgebaut und eine kontinuierliche Unterstützung sichergestellt. Reine Nachhaltigkeit hat einen schweren Stand, wenn der Druck auf das Budget zunimmt, es sei denn, sie ist in die Kerntätigkeit eingebettet.

Frühzeitig in die Dateninfrastruktur investieren

Unternehmen, die Investitionen in die Dateninfrastruktur zu Gunsten einer schnellen Anwendungsbereitstellung aufschieben, bereuen dies oft. Fragmentierte Einzellösungen verursachen Integrationsalpträume, und der Wiederaufbau der Grundlagen bei gleichzeitiger Aufrechterhaltung der operativen Systeme erweist sich als schwierig.

Vorabinvestitionen in Sensoren, Datenplattformen und Integrationsfunktionen ermöglichen eine schnellere Iteration von Analysen und Anwendungen. Die Infrastruktur wird zu einem Vermögenswert, der im Laufe der Zeit mehrere Anwendungsfälle unterstützt.

Kombinieren Sie internes Fachwissen mit externen Partnerschaften

Keine Organisation verfügt intern über alle erforderlichen Fähigkeiten. Technologieanbieter, Nachhaltigkeitsberater, Industriekonsortien und akademische Forscher bringen alle wertvolle Perspektiven ein.

Der Schlüssel liegt darin, die strategische Ausrichtung intern beizubehalten und gleichzeitig externes Fachwissen taktisch zu nutzen. Unternehmen, die strategisches Denken auslagern, verlieren die Kontrolle über ihre Nachhaltigkeitstransformation.

Transparente Kommunikation von Fortschritten und Rückschlägen

Die Stakeholder schätzen eine ehrliche Nachhaltigkeitsberichterstattung zunehmend mehr als ausgefeiltes Marketing. Unternehmen, die Herausforderungen anerkennen und Erkenntnisse weitergeben, schaffen eine Glaubwürdigkeit, die reine Werbekommunikation nicht erreichen kann.

Transparenz schafft auch Verantwortlichkeit, die zu Ergebnissen führt. Öffentliche Verpflichtungen mit regelmäßiger Fortschrittsberichterstattung erschweren Rückschritte und sorgen dafür, dass Initiativen bei konkurrierendem Druck weiterhin Vorrang haben.

Aufbau nachhaltiger digitaler Systeme mit A-listware

Nachhaltigkeitsinitiativen scheitern oft, weil die Technologie dahinter fragmentiert oder veraltet ist. Die digitale Transformation hilft dabei, dies zu ändern, indem sie Daten verbindet, die betriebliche Transparenz verbessert und Ineffizienzen im gesamten Unternehmen reduziert. Die Dienstleistungen von A-listware zur digitalen Transformation konzentrieren sich auf die Analyse bestehender Systeme, die Identifizierung von Prozesslücken und die Implementierung praktischer technologischer Verbesserungen, die langfristige betriebliche Veränderungen unterstützen.

A-listware arbeitet mit Unternehmen zusammen, die ihre Infrastruktur modernisieren, ihre Arbeitsabläufe digitalisieren und Softwaresysteme entwickeln müssen, die den tatsächlichen Geschäftsbetrieb unterstützen. Die Teams von A-listware kümmern sich um die Strategie, die Implementierung und den laufenden Support. Sie helfen Unternehmen, sich von veralteten Tools zu lösen und skalierbare digitale Plattformen einzuführen, die die Effizienz verbessern und betriebliche Verschwendung reduzieren.

Gespräch mit A-listware über Ihr digitales Transformationsprojekt und sehen Sie, wo die Modernisierung messbare Ergebnisse liefern kann.

Die Rolle der Digitalisierung bei der Verwirklichung der Entwicklungsziele

Nachhaltige Entwicklung geht über Umweltbelange hinaus und umfasst auch soziale Gerechtigkeit, wirtschaftliche Chancen und Governance. Der digitale Wandel beeinflusst all diese Dimensionen.

Durch den Zugang zu Informationen werden marginalisierte Gemeinschaften in die Lage versetzt, sich an Entscheidungen zu beteiligen, die sie betreffen. Das World Resources Institute betont, dass eine lokal geführte Anpassung - bei der lokale Akteure die Entscheidungsgewalt haben - eine wesentliche Rolle für eine erfolgreiche und nachhaltige Anpassung spielt. Digitale Werkzeuge erleichtern die Beteiligung und den Wissensaustausch, die lokal geführte Ansätze möglich machen.

Die wirtschaftliche Entwicklung hängt in zunehmendem Maße von der digitalen Infrastruktur und dem Bildungsstand ab. Die digitale Kluft ist nicht nur eine technologische Lücke, sondern ein Hindernis für wirtschaftliche Chancen, das die Ungleichheit aufrechterhält. Ein nachhaltiger digitaler Wandel muss neben Umweltaspekten auch Zugänglichkeit und Integration berücksichtigen.

Im Allgemeinen berücksichtigen die wirkungsvollsten Initiativen die ökologische, soziale und wirtschaftliche Nachhaltigkeit gemeinsam, anstatt eine Dimension auf Kosten der anderen zu optimieren.

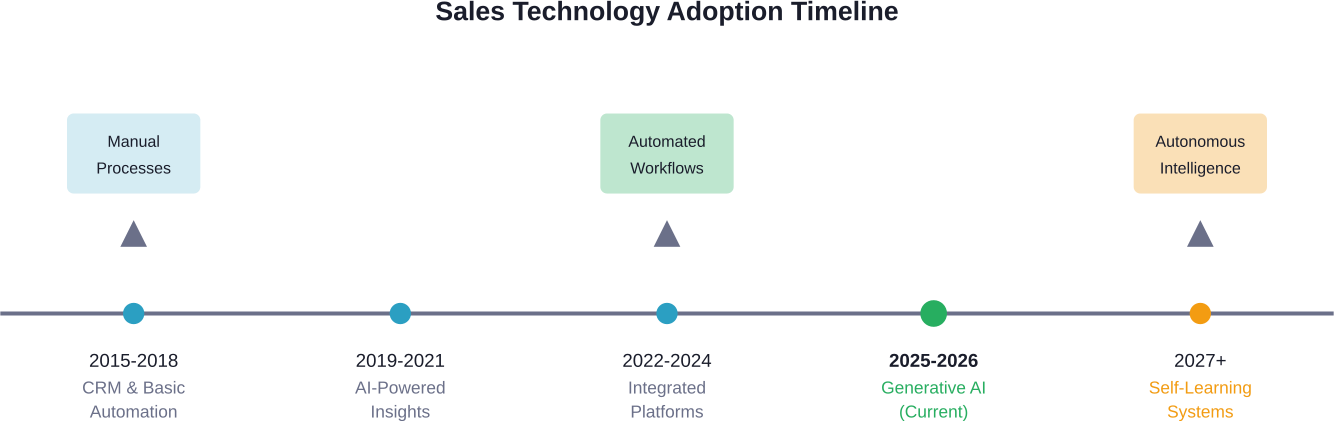

Blick in die Zukunft: Trends, die die Zukunft prägen

Mehrere sich abzeichnende Trends werden bestimmen, wie sich die digitale Transformation und die Nachhaltigkeit in den kommenden Jahren gemeinsam weiterentwickeln werden.

Regulatorischer Druck und obligatorische Offenlegung

Die freiwillige Nachhaltigkeitsberichterstattung weicht auf den wichtigsten Märkten den obligatorischen Offenlegungspflichten. Diese Vorschriften verlangen verifizierte Daten, was die Einführung von Mess- und Berichtstechnologien fördert.

Unternehmen, die jetzt robuste Nachhaltigkeitsdatenkapazitäten aufbauen, können sich leichter anpassen, wenn die Anforderungen steigen. Diejenigen, die die Berichterstattung als eine Art "Checkbox" für die Einhaltung der Vorschriften betrachten, werden mit einer genaueren Prüfung zu kämpfen haben.

KI-Ethik und nachhaltige Datenverarbeitung

Den ökologischen und sozialen Kosten der KI wird immer mehr Aufmerksamkeit geschenkt. Nachhaltige Computing-Praktiken - die Optimierung von Algorithmen auf Effizienz, die Nutzung erneuerbarer Energien, die Berücksichtigung der Notwendigkeit von Modellen - werden eher zu Standarderwartungen als zu "Nice-to-haves".

Rahmenwerke zur Bewertung der Auswirkungen von KI auf die Nachhaltigkeit sind im Entstehen begriffen. Unternehmen, die KI zu Nachhaltigkeitszwecken einsetzen, müssen sicherstellen, dass die Lösungen selbst Nachhaltigkeitsstandards erfüllen.

Geschäftsmodelle der Kreislaufwirtschaft

Digitale Technologien ermöglichen neue zirkuläre Geschäftsmodelle, bei denen Unternehmen das Eigentum an Produkten und Materialien behalten und Dienstleistungen anbieten, anstatt Waren zu verkaufen. Diese Modelle erfordern eine ausgeklügelte Rückverfolgung, Rückwärtslogistik und Lebenszyklusverwaltung, die durch digitale Plattformen erleichtert werden.

Produkt-as-a-Service-Angebote richten die Anreize der Anbieter auf Langlebigkeit und Wiederverwertbarkeit statt auf geplante Obsoleszenz aus. Digitale Konnektivität und IoT-Sensoren machen die Überwachung und Wartung verteilter Anlagen wirtschaftlich machbar.

Plattformen für die Zusammenarbeit im Ökosystem

Komplexe Nachhaltigkeitsherausforderungen überschreiten die Grenzen einzelner Organisationen. Digitale Plattformen, die die Zusammenarbeit über Lieferketten, Branchen und Sektoren hinweg erleichtern, werden zunehmend an Bedeutung gewinnen.

Gemeinsame Datenstandards, interoperable Systeme und kooperative Governance-Modelle ermöglichen eine Koordinierung, die mit fragmentierten Ansätzen nicht erreicht werden kann. Erfolg erfordert die Bereitschaft, sich an Ökosystemen zu beteiligen, anstatt proprietäre Lösungen zu kontrollieren.

| Trend | Zeitleiste | Ebene der Auswirkungen | Erforderliche Maßnahmen |

|---|---|---|---|

| Obligatorische ESG-Offenlegung | 2026-2028 | Hoch | Einführung überprüfter Datenerfassungssysteme |

| Ausweitung der Kohlenstoffpreise | 2026-2030 | Hoch | Einsatz von Tools zur Kohlenstoffbilanzierung und -optimierung |

| Nachhaltige AI-Standards | 2027-2029 | Mittel | Einführung energiebewusster Datenverarbeitungspraktiken |

| Modelle der Kreislaufwirtschaft | 2026-2032 | Mittel | Entwicklung von Produktverfolgungs- und Rücknahmesystemen |

| Ökosystem-Plattformen | 2028-2035 | Mittel | Teilnahme an Initiativen zur Zusammenarbeit mit der Industrie |

Häufig gestellte Fragen

- Wie reduziert die digitale Transformation die Kohlenstoffemissionen?

Digitale Technologien reduzieren Emissionen durch verschiedene Mechanismen: Optimierung des Energieverbrauchs mit KI und IoT-Sensoren, Ermöglichung von Fernarbeit, die Pendeln überflüssig macht, Verbesserung der Logistikeffizienz zur Verringerung des Kraftstoffverbrauchs im Transportwesen und Erleichterung der Integration erneuerbarer Energien durch intelligente Netze. Die Fertigung profitiert von digitalen Zwillingen, die Verschwendung reduzieren, und von vorausschauender Wartung, die ressourcenintensive Ausfälle verhindert. Das Weltwirtschaftsforum schätzt, dass diese Technologien die globalen Emissionen bis 2050 um bis zu 20 Prozent reduzieren könnten.

- Was sind die Umweltkosten der digitalen Transformation selbst?

Digitale Technologien haben ihren eigenen ökologischen Fußabdruck. Rechenzentren verbrauchen viel Strom, wobei die Kohlenstoffintensität von den Energiequellen abhängt. Die Herstellung von Hardware erfordert die Gewinnung und Verarbeitung von Rohstoffen. Der Kohlenstoff-Fußabdruck des digitalen Sektors übersteigt bereits den des Luftverkehrs. Die Entsorgung von Elektronikschrott stellt eine Herausforderung dar. Unternehmen müssen die Netto-Umweltauswirkungen bewerten und sicherstellen, dass die Vorteile von Nachhaltigkeitslösungen ihre eigenen Kosten übersteigen. Nachhaltige Computing-Praktiken, Verpflichtungen zu erneuerbaren Energien und zirkuläre Hardware-Modelle tragen dazu bei, diese Probleme zu lösen.

- Welche Branchen profitieren am meisten von digitalen Nachhaltigkeitsinitiativen?

Energieintensive Branchen profitieren besonders stark davon: Fertigung, Transport, Landwirtschaft und Gebäudebetrieb. Diese Sektoren verbrauchen erhebliche Ressourcen, deren Optimierung messbare Auswirkungen hat. Jede Branche steht jedoch unter dem Druck der Nachhaltigkeit. Einzelhandels- und Konsumgüterunternehmen nutzen digitale Tools für die Transparenz der Lieferkette. Finanzdienstleister setzen sie für die ESG-Risikobewertung ein. Das Gesundheitswesen nutzt die Telemedizin, um den Energieverbrauch von Einrichtungen zu senken. Die spezifischen Anwendungen variieren, aber in allen Sektoren gibt es Möglichkeiten.

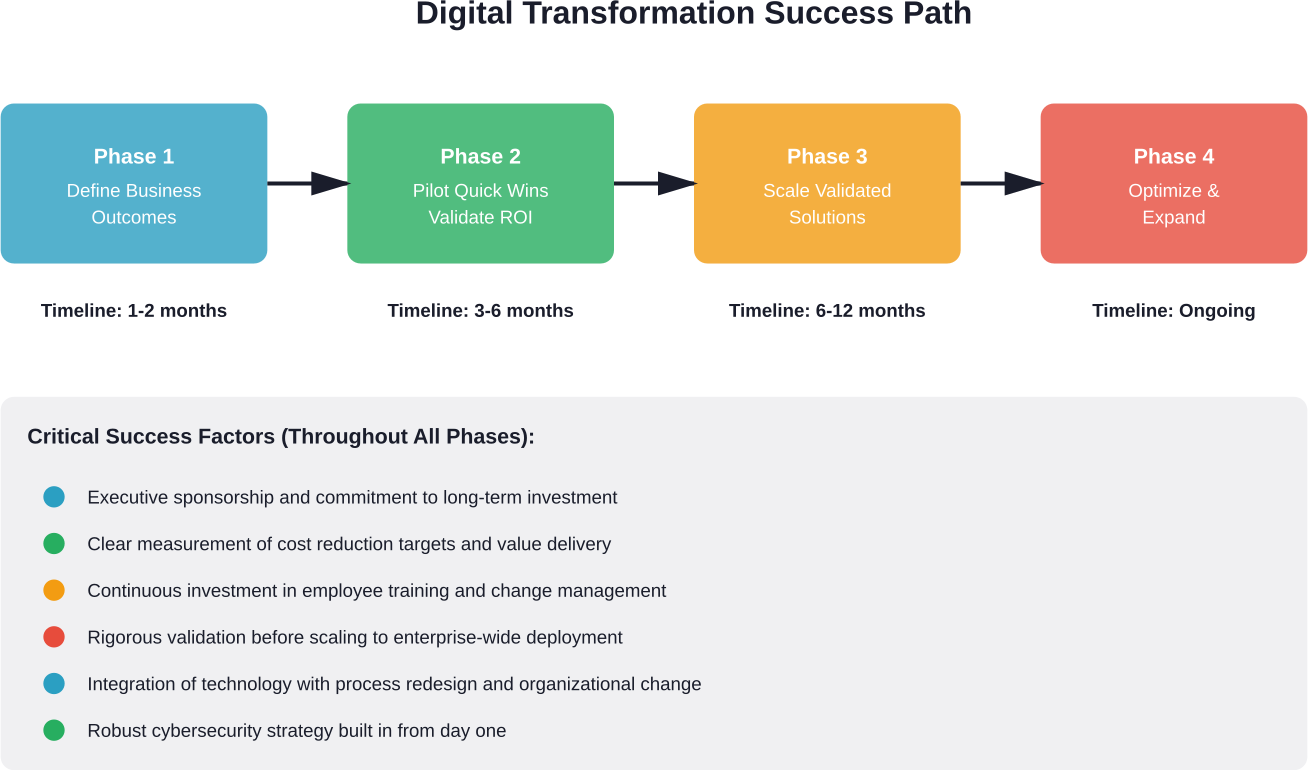

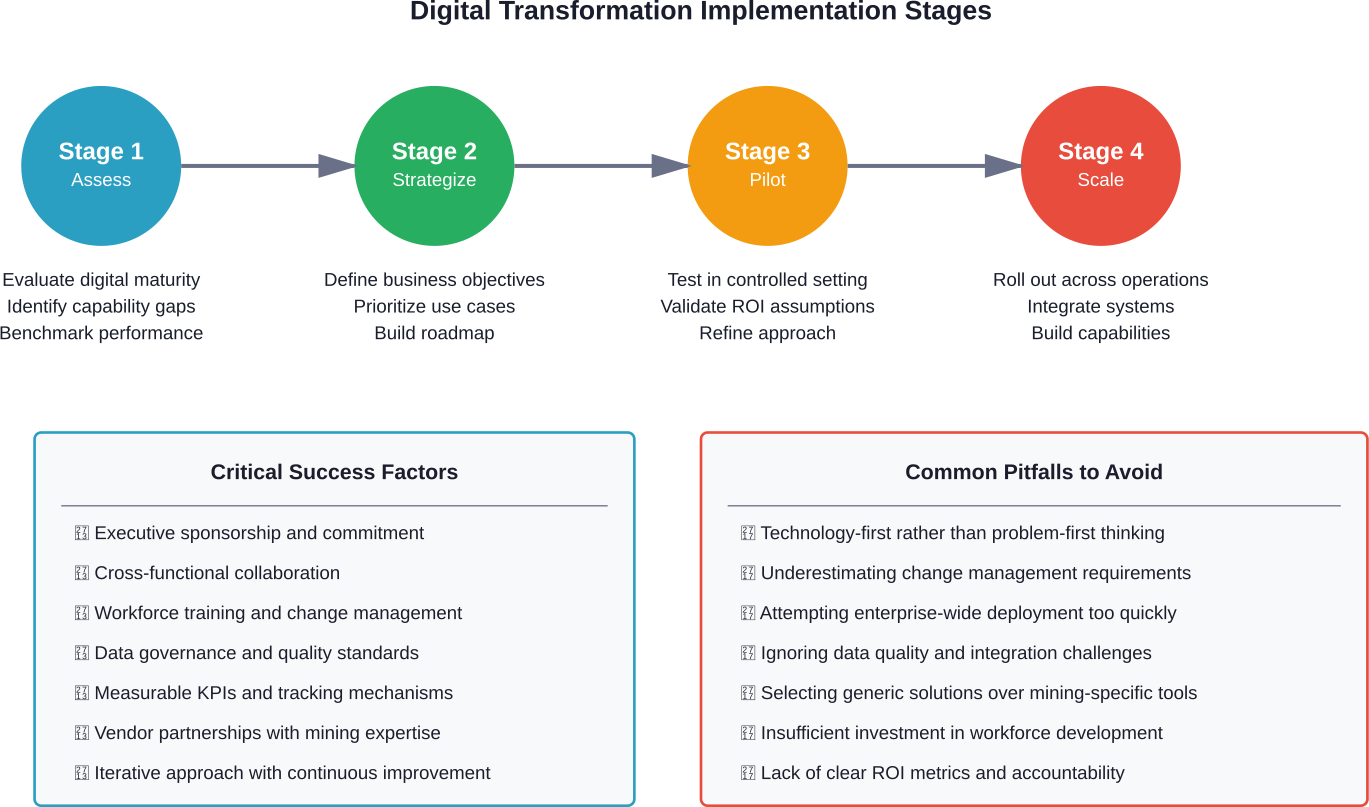

- Wie lange dauert die Umsetzung der digitalen Transformation der Nachhaltigkeit?

Der Zeitplan hängt vom Umfang und der Ausgangssituation ab. Erste Bewertungen und Pilotprojekte benötigen in der Regel 6-12 Monate. Der Aufbau von Dateninfrastrukturen und -kapazitäten dauert 12-24 Monate. Die unternehmensweite Umgestaltung erstreckt sich über 3-5 Jahre. Unternehmen sollten eher mit einer schrittweisen Umsetzung als mit sofortigen Ergebnissen rechnen. Schnelle Erfolge im Energiemanagement oder bei der Abfallreduzierung können innerhalb weniger Monate einen Mehrwert schaffen, während umfassende Transparenz in der Lieferkette oder kreislauforientierte Geschäftsmodelle mehrjährige Verpflichtungen erfordern. Es erweist sich als erfolgreicher, mit gezielten Initiativen zu beginnen, die im Laufe der Zeit erweitert werden, als alles gleichzeitig zu versuchen.

- Welche Fähigkeiten brauchen Teams für eine nachhaltige digitale Transformation?

Erfolg erfordert hybride Fähigkeiten, die Technologie- und Nachhaltigkeitsbereiche umfassen. Datenwissenschaftler, die sich mit Umweltmetriken auskennen, Nachhaltigkeitsexperten, die mit digitalen Tools vertraut sind, und Führungskräfte, die beide Perspektiven in ihre Strategie integrieren. Zu den spezifischen technischen Fähigkeiten gehören IoT-Einsatz, Datenanalyse, Software für die Kohlenstoffbilanzierung und Integrationsplattformen. Viele Unternehmen haben Schwierigkeiten, Mitarbeiter mit umfassenden Fähigkeiten zu finden, weshalb Schulungsprogramme und funktionsübergreifende Zusammenarbeit unerlässlich sind. Partnerschaften mit spezialisierten Beratern und Technologieanbietern können die internen Fähigkeiten bei der Kompetenzentwicklung ergänzen.

- Wie messen Unternehmen den ROI von Investitionen in Nachhaltigkeitstechnologie?

Die Messung der Rendite erfordert einen breiteren Rahmen als nur die traditionellen Finanzkennzahlen. Direkte Kosteneinsparungen durch weniger Energie, Material und Abfall liefern quantifizierbare Erträge. Der Wert der Risikominderung ergibt sich aus der Einhaltung von Vorschriften, der Widerstandsfähigkeit der Lieferkette und dem Schutz des guten Rufs. Umsatzchancen ergeben sich aus einer nachhaltigen Produktdifferenzierung und einem neuen Marktzugang. Die Vorteile bei der Gewinnung und Bindung von Mitarbeitern haben messbare finanzielle Auswirkungen. Führende Unternehmen verwenden Balanced Scorecards, die neben finanziellen Kennzahlen auch Umwelt-KPIs enthalten, da sie erkannt haben, dass einige Nachhaltigkeitsinvestitionen einen strategischen Wert generieren, der in kurzfristigen ROI-Berechnungen nicht erfasst wird.

- Welche Standards sollten Organisationen bei der Nachhaltigkeitsberichterstattung befolgen?

Für die Offenlegung von Nachhaltigkeitsinformationen gibt es mehrere Rahmenwerke. ISO 14019-4:2026 befasst sich mit der Validierung und Überprüfung von Nachhaltigkeitsinformationen. Das GHG-Protokoll bietet Standards für die Kohlenstoffbilanzierung, die weithin für die Emissionsberichterstattung verwendet werden. TCFD-Empfehlungen strukturieren klimabezogene Finanzinformationen. SASB-Standards konzentrieren sich auf finanziell wichtige Nachhaltigkeitsthemen nach Branchen. Organisationen übernehmen zunehmend mehrere Rahmenwerke, da die Interessengruppen auf verschiedene Standards verweisen. Die technische Spezifikation ISO/IEC TS 20125-1:2026 befasst sich speziell mit dem Ökodesign für digitale Dienstleistungen. Gesetzliche Vorschriften in bestimmten Ländern können bestimmte Rahmenwerke vorschreiben, so dass eine Bewertung der Compliance-Landschaft wichtig ist.

Schlussfolgerung

Digitale Transformation und Nachhaltigkeit sind keine getrennten Initiativen, die um Ressourcen und Aufmerksamkeit konkurrieren. Sie sind komplementäre Kräfte, die Unternehmen integrieren müssen, um wettbewerbsfähig und verantwortungsvoll zu bleiben.

Die Technologien, die den digitalen Wandel ermöglichen - KI, IoT, Blockchain, Cloud Computing -, bieten die notwendigen Fähigkeiten, um die Umweltauswirkungen in einem bisher unmöglichen Ausmaß zu messen, zu verwalten und zu reduzieren. Gleichzeitig treiben die Erfordernisse der Nachhaltigkeit die Innovation bei digitalen Lösungen voran und fördern die Entwicklung energieeffizienter Computer, transparenter Lieferketten und zirkulärer Geschäftsmodelle.

Unternehmen, die dies als einheitliche Strategie behandeln, sind langfristig erfolgreich. Unternehmen, die die digitale Transformation ohne Berücksichtigung von Nachhaltigkeitsaspekten verfolgen, häufen Umweltschulden und regulatorische Risiken an. Denjenigen, die Nachhaltigkeit ohne digitales Enablement verfolgen, fehlen die Daten, die Automatisierung und die Optimierungsmöglichkeiten, mit denen ehrgeizige Ziele erreicht werden können.

Der Weg in die Zukunft erfordert eine ehrliche Bewertung der aktuellen Fähigkeiten, strategische Investitionen in die Dateninfrastruktur, zielgerichtete Pilotprojekte, die einen geschäftlichen und ökologischen Nutzen bringen, und ein nachhaltiges Engagement bei unvermeidlichen Herausforderungen. Normen wie ISO 14019-4:2026 und ISO/IEC TS 20125-1:2026 bieten einen Rahmen für eine glaubwürdige Umsetzung und Berichterstattung.

Beginnen Sie damit, herauszufinden, wo digitale Technologien echte Geschäftsprobleme lösen und gleichzeitig Nachhaltigkeitsziele vorantreiben können. Schaffen Sie die Datengrundlage, die Messung und Optimierung ermöglicht. Gehen Sie strategische Partnerschaften ein, um auf Fähigkeiten zuzugreifen, die über das interne Fachwissen hinausgehen. Kommunizieren Sie den Fortschritt transparent, um das Vertrauen der Stakeholder zu gewinnen.

Die Konvergenz von digitaler Transformation und Nachhaltigkeit stellt eine der entscheidenden geschäftlichen Herausforderungen und Chancen dieses Jahrzehnts dar. Unternehmen, die entschlossen handeln, werden die Antworten ihrer Branche prägen und gleichzeitig widerstandsfähige, verantwortungsvolle Betriebe aufbauen, die langfristig erfolgreich sind.

Sind Sie bereit, Ihre Reise zur nachhaltigen digitalen Transformation zu beginnen? Beginnen Sie mit einer grundlegenden Bewertung Ihrer derzeitigen Umweltauswirkungen und ermitteln Sie die wertvollsten Möglichkeiten, bei denen digitale Technologien zu messbaren Verbesserungen führen können.