L'analyse financière a la réputation d'être coûteuse, et dans de nombreux cas, cette réputation est méritée. Mais le coût réel provient rarement d'un seul outil, d'une seule licence ou d'un seul tableau de bord. Il s'accumule à travers l'intégration des données, les choix de conception du système, les exigences de conformité et l'effort continu nécessaire pour maintenir la précision des informations au fur et à mesure de l'évolution de l'entreprise.

De nombreuses entreprises considèrent l'analyse financière comme une mise en œuvre ponctuelle avec un prix fixe. En réalité, il s'agit d'une capacité opérationnelle. Les coûts évoluent dans le temps en fonction du volume de données, de la complexité des rapports, de la pression réglementaire et du degré d'intégration de l'analyse dans la prise de décision financière quotidienne.

Cet article explique ce que l'analyse financière coûte réellement dans la pratique, pourquoi les prix varient autant et où les équipes se trompent le plus souvent sur l'investissement réel avant de s'engager.

Ce que comprend réellement l'analyse financière

Avant de parler des chiffres en détail, il est utile de clarifier ce que signifie réellement l'analyse financière dans un contexte commercial. Le terme est utilisé de manière vague, ce qui est l'une des principales raisons pour lesquelles les attentes en matière de coûts sont souvent mal alignées.

L'analyse financière ne se limite pas à l'établissement de rapports. Il s'agit de la capacité à collecter des données financières à partir de sources multiples, à les normaliser, à les analyser et à les transformer en informations utiles à la prise de décision. Il peut s'agir d'une analyse historique, d'un suivi en temps réel, de prévisions, d'une modélisation de scénarios, voire de recommandations automatisées.

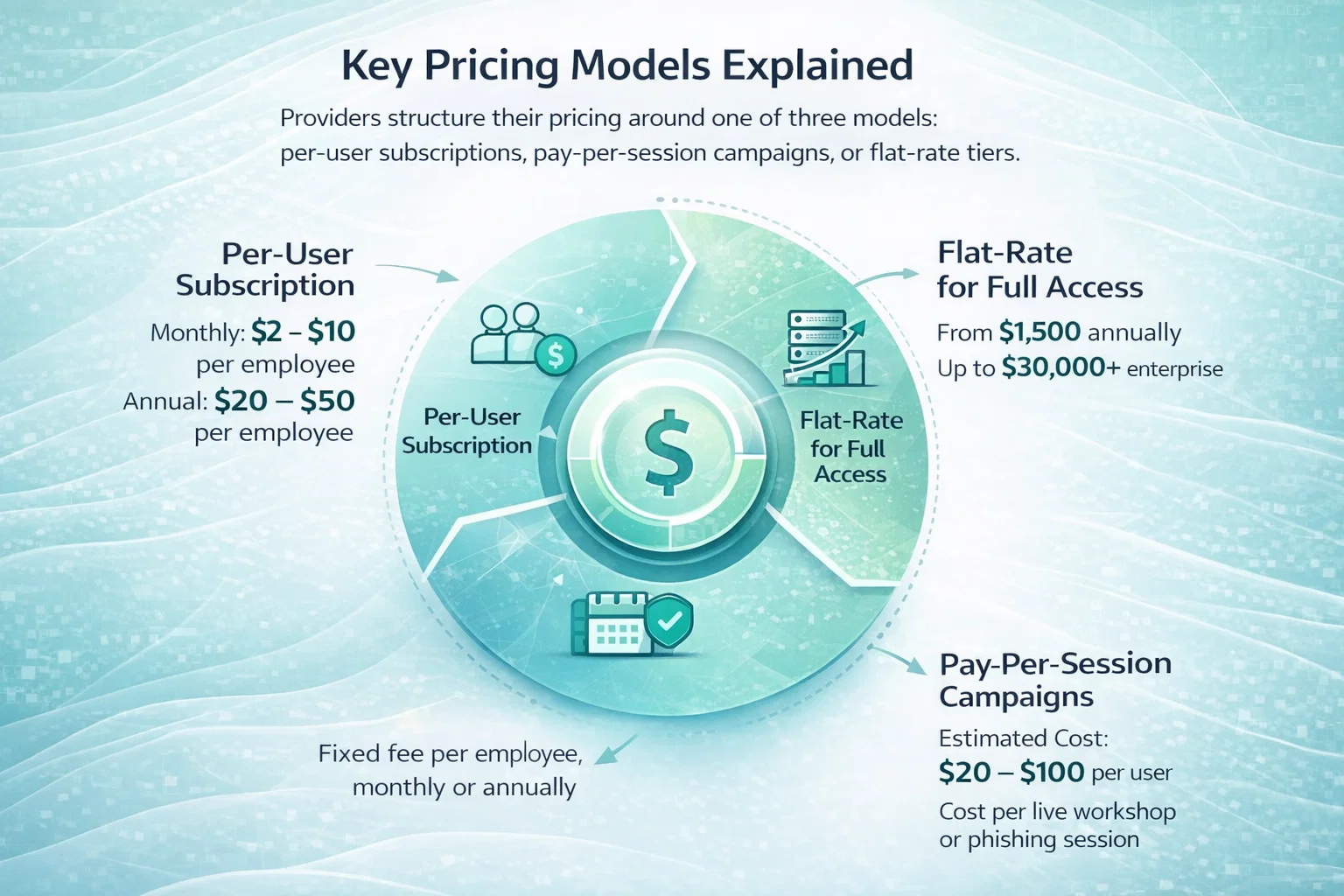

Du point de vue des coûts, la plupart des initiatives d'analyse financière se répartissent en trois grandes catégories :

- $20.000 à $100.000 pour des analyses ciblées couvrant les principaux indicateurs de performance clés avec des intégrations limitées

- $150.000 à $400.000 pour des analyses multi-départementales ou multi-entités avec une logique de prévision et de validation

- $400.000 à $600.000+ pour les plateformes d'entreprise avec analyse avancée, conformité et traitement en temps réel

Une configuration typique d'analyse financière comprend

- l'ingestion de données provenant de l'ERP, de la comptabilité, du CRM, de la trésorerie, de la tarification et des sources de données du marché.

- Traitement et stockage des données, généralement dans un entrepôt ou un lac centralisé

- Logique analytique pour les indicateurs clés de performance, les ratios, les prévisions et les scénarios

- Rapports et visualisation pour différents rôles d'utilisateurs

- Contrôles de la qualité, de la sécurité et de la conformité des données

Chacune de ces couches entraîne des coûts supplémentaires. En sauter une peut réduire le budget initial, mais cela augmente généralement les frictions opérationnelles par la suite, soit par le travail manuel, soit par des informations peu fiables, soit par des retouches coûteuses au fur et à mesure de l'évolution des besoins.

Fourchettes de coûts typiques de l'analyse financière

Il n'existe pas de prix correct unique pour l'analyse financière, mais des fourchettes réalistes qui reviennent régulièrement dans les différents secteurs d'activité. Le coût dépend en grande partie de la portée, de la complexité des données et du degré d'intégration de l'analyse dans les activités de l'entreprise.

Des mises en œuvre réduites et ciblées

Pour les petites organisations ou les cas d'utilisation restreints, les projets d'analyse financière commencent souvent entre $20.000 et $100.000.

Ce que ces mises en œuvre couvrent habituellement

- Les principaux indicateurs de performance financière (KPI), tels que les recettes, les coûts et les flux de trésorerie

- Intégrations limitées, souvent un seul système ERP et un seul système comptable

- Mise à jour des données par lots plutôt qu'en temps réel

- Tableaux de bord standard pour les équipes financières

Ils sont utiles, mais fragiles. Dès que les besoins en matière de rapports augmentent ou que des systèmes supplémentaires sont ajoutés, les coûts augmentent rapidement.

Analyse des entreprises de taille moyenne et des entités multiples

Pour les entreprises disposant de plusieurs départements, régions ou lignes de produits, les coûts se situent généralement entre $150 000 et $400 000.

Capacités accrues à ce niveau

- Analyse granulaire des performances par unité, région ou groupe de clients

- Logique de rapprochement et de validation automatisée

- Prévisions et scénarios de simulation

- Tableaux de bord basés sur les rôles pour la finance, la gestion et les dirigeants

C'est là que l'analyse financière commence à se comporter comme un système d'exploitation plutôt que comme une simple couche de reporting.

Plateformes d'analyse de niveau entreprise

Les grandes entreprises investissent souvent entre 1 400 000 et 600 000 euros dans l'analyse financière, parfois beaucoup plus.

Caractéristiques de l'analyse à l'échelle de l'entreprise

- Des dizaines de sources de données et des intégrations complexes

- Traitement des données en temps réel ou quasi réel

- Prévisions avancées et analyses prescriptives

- Exigences strictes en matière de réglementation et d'audit

- Haute disponibilité, sécurité et contrôles d'accès

À cette échelle, la plateforme d'analyse devient critique pour l'entreprise. Les temps d'arrêt, les erreurs ou les retards dans l'obtention d'informations peuvent avoir un impact financier direct.

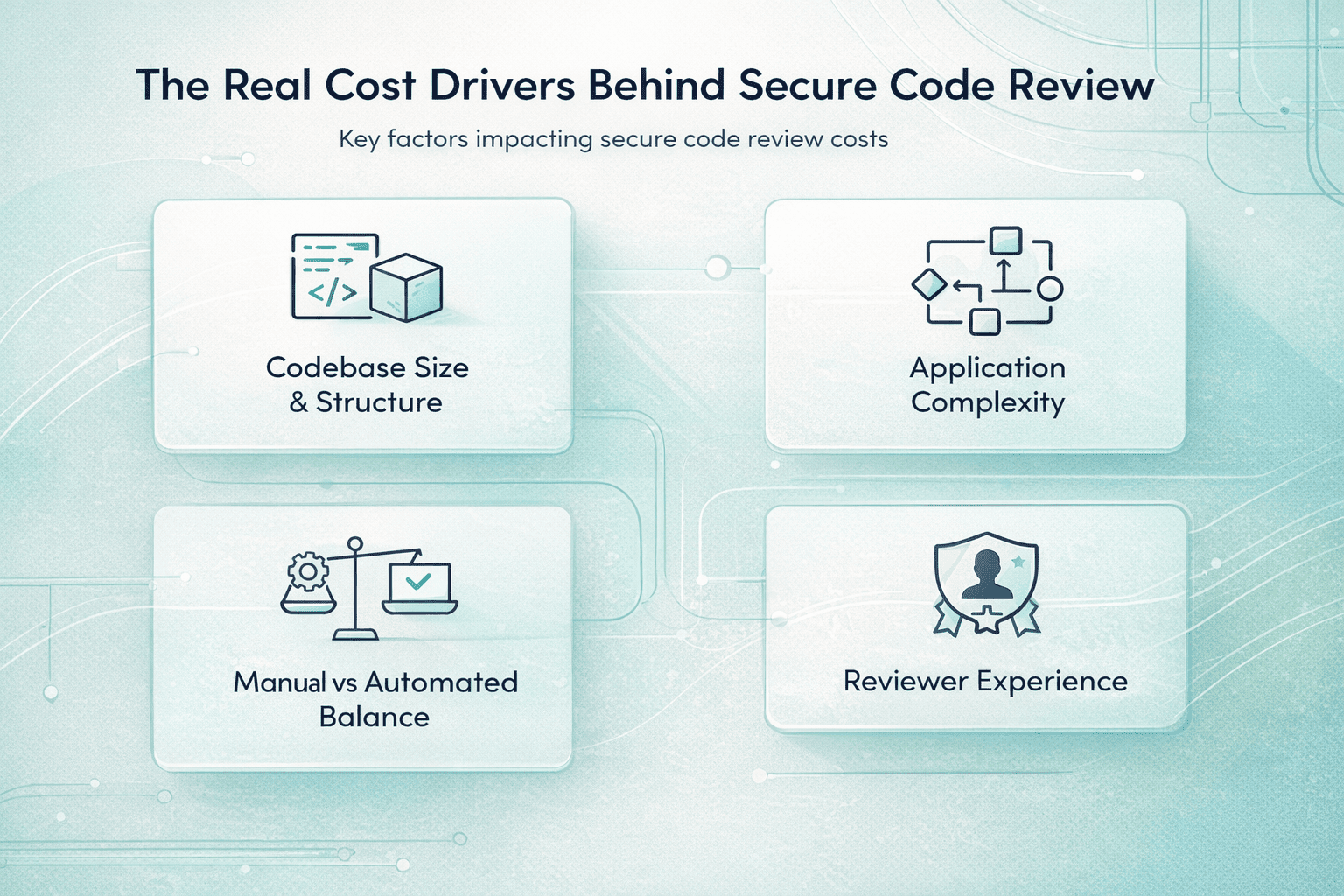

Des facteurs de coûts plus importants que les outils

L'une des erreurs budgétaires les plus courantes consiste à supposer que les coûts de l'analyse financière sont principalement liés aux licences de logiciels. En réalité, les outils constituent souvent la plus petite dépense à long terme.

Complexité de l'intégration des données

Chaque source de données supplémentaire augmente les coûts. Non pas de façon linéaire, mais de façon exponentielle.

Les systèmes ERP, les outils comptables, les plateformes CRM et les fournisseurs de données de marché sont rarement parfaitement alignés. La mise en correspondance des champs, le rapprochement des définitions et le traitement des cas particuliers nécessitent du temps et des efforts constants. Plus le paysage des données est fragmenté, plus les coûts sont élevés.

Volume et granularité des données

Les résumés mensuels de haut niveau sont relativement peu coûteux. L'analyse des transactions sur plusieurs années de données historiques ne l'est pas.

L'augmentation du volume des données s'accompagne d'une augmentation des coûts de stockage, des exigences de traitement et des efforts d'optimisation des performances. Cela est particulièrement vrai pour les organisations qui souhaitent avoir une visibilité en temps quasi réel de leurs performances financières.

Conformité et réglementation

L'analyse financière existe rarement en dehors des cadres réglementaires.

La prise en charge de normes telles que GAAP, IFRS, SOX, ASC 606 ou de règles spécifiques à un secteur d'activité entraîne des coûts supplémentaires :

- Logique de validation des données

- Pistes d'audit et documentation

- Contrôles d'accès et séparation des tâches

- Politiques de stockage et de conservation sécurisées

La conformité n'est pas facultative et elle entraîne systématiquement des dépenses de mise en œuvre et d'exploitation.

Analyse avancée et IA

L'analyse descriptive de base est relativement abordable. L'analyse prédictive et prescriptive ne l'est pas.

Les facteurs qui déterminent les coûts liés à l'IA

Les capacités d'apprentissage automatique sont nécessaires :

- Des données historiques propres et bien structurées

- Surveillance continue du modèle et réentraînement

- Explicabilité pour les régulateurs et les auditeurs

Ces caractéristiques peuvent ajouter $50.000 à $200.000+ au dessus d'une plateforme d'analyse financière de base.

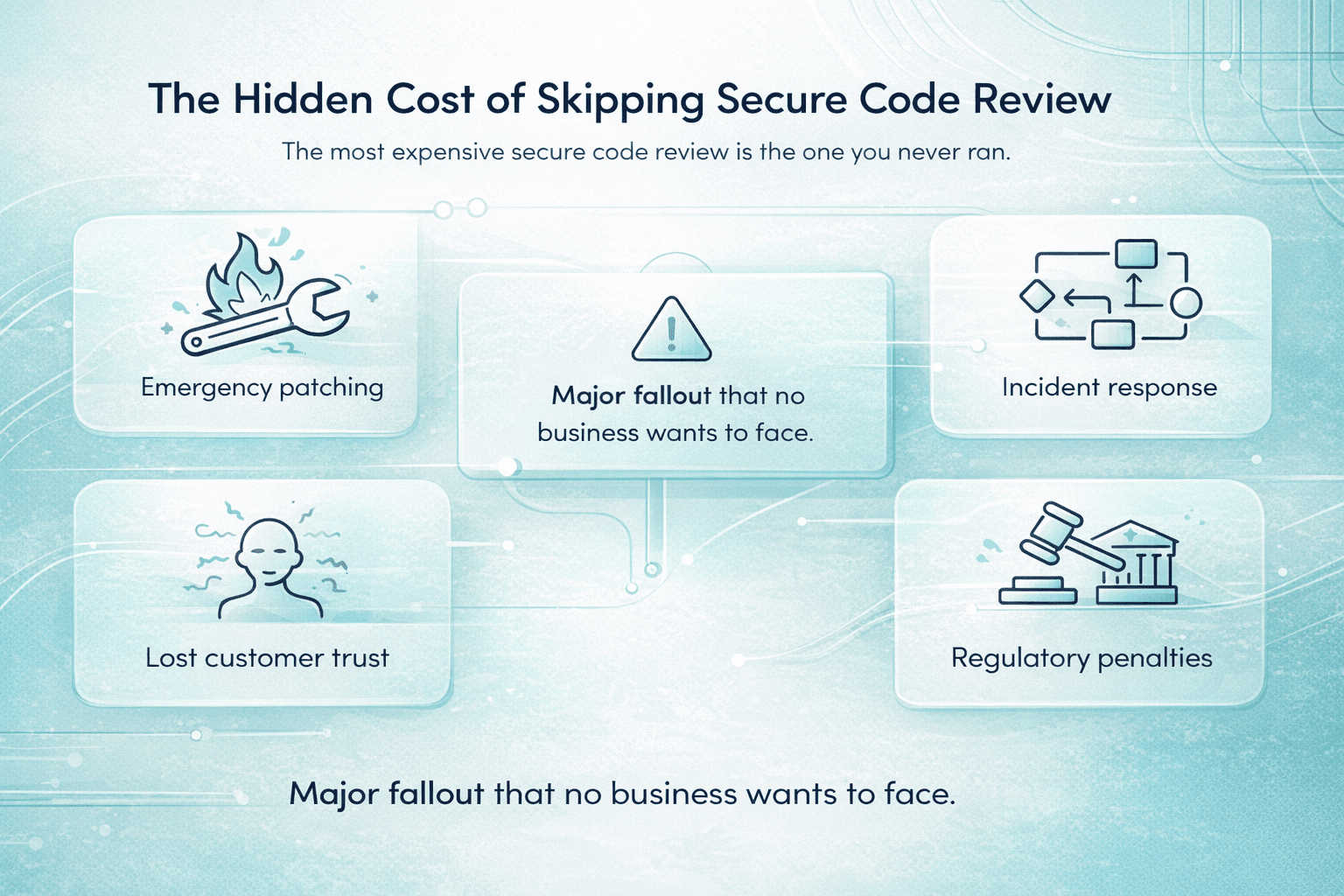

Coûts ponctuels et coûts permanents

Une autre idée reçue consiste à considérer l'analyse financière comme un projet ponctuel. Dans la pratique, il s'agit plutôt d'un abonnement.

Coûts uniques

- Conception et planification de l'architecture

- Intégrations initiales et modélisation des données

- Développement de tableaux de bord et de rapports

- Formation des utilisateurs et déploiement

Ces coûts sont visibles et généralement approuvés à l'avance.

Coûts permanents

- Maintenance du pipeline de données

- Nouvelles intégrations en fonction de l'évolution des systèmes

- Mise à jour et recalibrage des modèles

- Optimisation des performances

- Assistance et réponse aux incidents

Sur une période de trois à cinq ans, les coûts permanents dépassent souvent le budget initial de mise en œuvre. Les équipes qui ignorent cette réalité ont tendance à sous-investir dans la maintenance et à le payer plus tard par des informations peu fiables.

Comment nous aidons les équipes à développer l'analyse financière sans surpayer

Au Logiciel de liste A, Dans le cadre de l'analyse financière, nous considérons l'analyse financière comme une capacité opérationnelle, et non comme une construction ponctuelle. Notre objectif est d'aider les équipes à créer des systèmes d'analyse qui répondent à leurs besoins réels aujourd'hui et qui évoluent raisonnablement dans le temps, sans coûts ni complexité inutiles.

Nous travaillons comme une extension des équipes de nos clients, en assumant la responsabilité de la livraison, de la communication et de la stabilité à long terme. Avec plus de 25 ans d'expérience dans la gestion du développement de logiciels et des relations avec les clients, nous savons où les projets d'analyse ont tendance à se heurter à des difficultés. La prolifération des intégrations, le manque de clarté quant à la propriété et la sous-estimation des coûts de maintenance sont des problèmes courants, et nous les prenons en compte dès le départ.

Nos équipes peuvent être constituées en deux à quatre semaines à partir d'un vivier de plus de 100 000 spécialistes. Nous fournissons des ingénieurs expérimentés et des experts en données qui ont l'habitude de travailler avec des données financières sensibles, des exigences de sécurité strictes et des systèmes complexes. Le contrôle de la qualité, la protection de la propriété intellectuelle et les pratiques de développement sécurisé font partie intégrante de nos méthodes de travail.

Nous restons également impliqués après le lancement. Au fur et à mesure que les besoins en matière de reporting évoluent et que les volumes de données augmentent, nous aidons les équipes à adapter leurs analyses sans perturber les opérations. Il en résulte des informations financières fiables, des coûts prévisibles et un partenariat qui perdure dans le temps.

Attentes en matière de retour sur investissement et réalité du retour sur investissement

L'analyse financière est souvent justifiée par des projections de retour sur investissement. Certaines sont réalistes. D'autres sont ambitieuses.

Dans la pratique, de nombreuses organisations voient :

- Gains de productivité dans les équipes chargées des finances et de l'établissement des rapports

- Prise de décision plus rapide grâce à des données actualisées

- Réduction des risques grâce à la détection précoce des problèmes

- Amélioration de la précision des budgets et des prévisions

Les programmes d'analyse financière bien exécutés atteignent souvent un retour sur investissement de l'ordre de 100 à 120 % au cours de la première année, avec des périodes de récupération inférieures à 12 mois. Cependant, cela dépend fortement de l'adoption.

Les tableaux de bord auxquels personne ne fait confiance ou que personne n'utilise ne génèrent pas de retour sur investissement, quel que soit le degré d'avancement de la technologie.

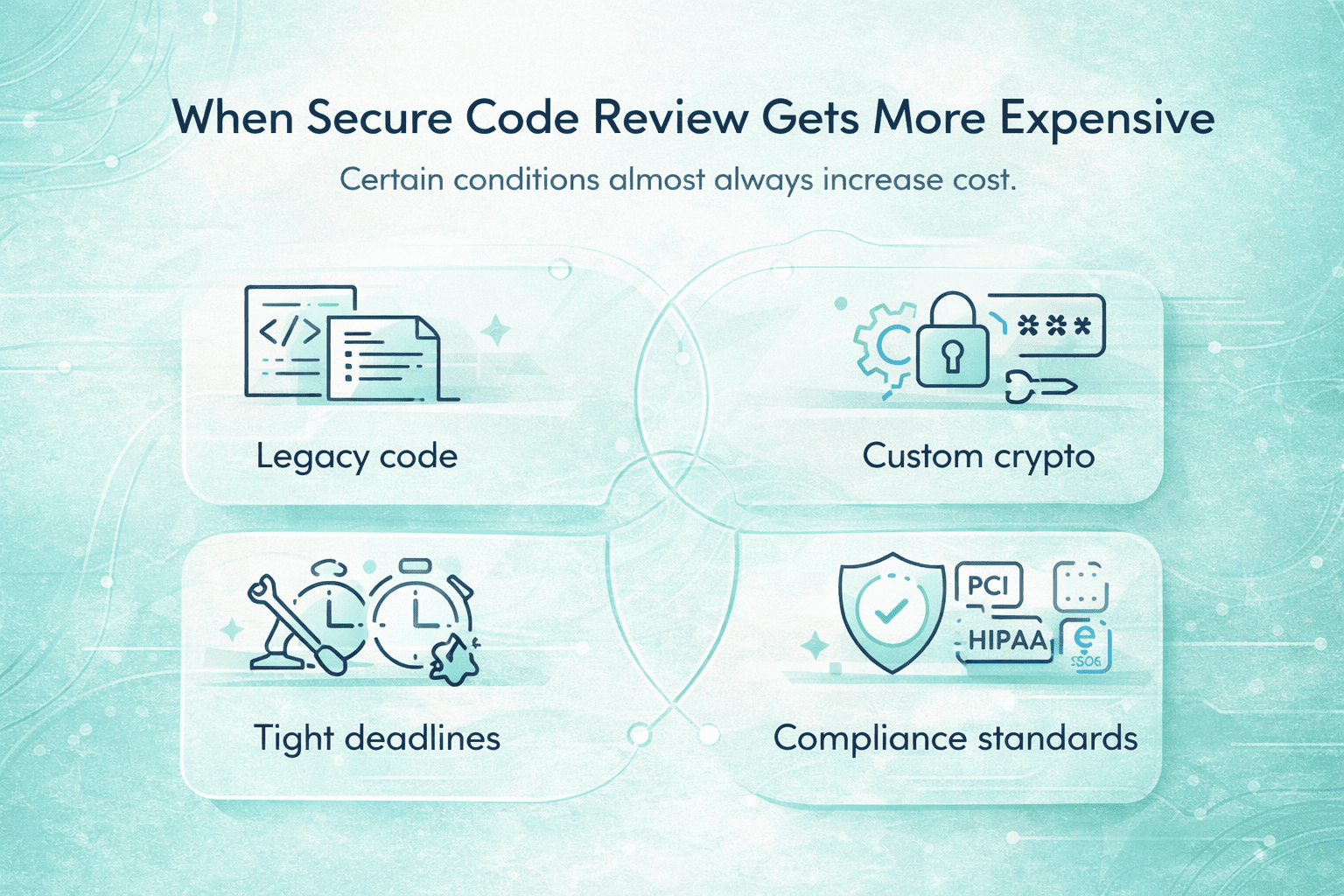

Les domaines dans lesquels les entreprises sous-estiment les coûts

Après avoir examiné des dizaines de mises en œuvre d'outils d'analyse financière, quelques points aveugles en matière de coûts reviennent régulièrement. Ils sont rarement évidents lors de la planification, mais tendent à faire surface une fois que le système est déjà utilisé.

- Adoption par les utilisateurs. Lorsque les tableaux de bord ne correspondent pas à la façon dont les gens travaillent réellement, l'adoption chute rapidement. Pour y remédier, il faut souvent revoir la conception des rapports, former à nouveau les utilisateurs et reconstruire certaines parties de la logique, ce qui entraîne des coûts imprévus.

- Travail sur la qualité des données. Le nettoyage et la validation des données sont presque toujours sous-estimés. En réalité, ils absorbent une part importante des efforts, en particulier au cours de la première année, lorsque les incohérences entre les systèmes deviennent visibles.

- Gestion du changement. L'analyse financière modifie la manière dont les décisions sont prises. Ce changement peut susciter la résistance d'équipes habituées à des processus manuels ou à des rapports informels. La gestion de cette situation nécessite du temps, de la communication et l'implication des dirigeants, et pas seulement de la technologie.

- Évolutivité. Ce qui fonctionne bien pour 10 utilisateurs peut s'avérer difficile pour 100. Au fur et à mesure que l'utilisation augmente, les problèmes de performance, les contrôles d'accès et le volume de données obligent souvent à une réorganisation partielle, ce qui augmente à la fois les coûts et la complexité.

Le fait de s'attaquer à ces domaines dès le début n'élimine pas les coûts, mais rend les dépenses beaucoup plus prévisibles et évite des corrections coûteuses par la suite.

Considérations sur les coûts de construction ou d'achat

Le choix entre des outils d'analyse financière standard et des solutions personnalisées a un impact direct sur le coût initial et les dépenses à long terme. La différence n'est pas seulement technique. Elle concerne la flexibilité, l'évolutivité et l'adéquation de l'analyse avec le mode de fonctionnement réel de l'entreprise.

Outils d'analyse financière standard

Les plateformes d'analyse prédéfinies peuvent réduire les coûts initiaux, en particulier pour les petites équipes ou les organisations qui se lancent dans l'analyse financière. Elles offrent généralement un déploiement plus rapide et des tableaux de bord standardisés qui couvrent les indicateurs clés de performance financiers courants.

Le compromis apparaît avec le temps. Ces outils reposent souvent sur des mesures génériques qui ne reflètent pas entièrement les processus internes ou les exigences propres à l'industrie. La flexibilité est limitée et il peut être difficile de dépasser le cas d'utilisation initial. Au fur et à mesure que les besoins en matière de rapports augmentent ou que les systèmes changent, les équipes peuvent se retrouver à travailler autour des limites de l'outil plutôt qu'à résoudre les problèmes de l'entreprise.

Solutions personnalisées d'analyse financière

Les systèmes d'analyse personnalisés nécessitent généralement un investissement initial plus important, mais ils sont conçus en fonction du fonctionnement réel de l'entreprise. Les modèles de données, les indicateurs clés de performance et les flux de travail peuvent être alignés sur les processus internes au lieu d'obliger les équipes à s'adapter à des structures prédéfinies.

L'intégration est souvent plus fluide dans les environnements complexes, et le système peut évoluer en fonction des nouvelles sources de données, des réglementations ou des besoins d'analyse. Sur le long terme, cette flexibilité permet de réduire les travaux et d'éviter les reconstructions coûteuses au fur et à mesure de la croissance de l'organisation.

Faire le bon choix

Il n'y a pas de réponse universelle à la question "construire ou acheter". La bonne décision dépend de la maturité de l'organisation, de la complexité des données, des exigences réglementaires et des objectifs à long terme. Les équipes qui planifient la croissance et le changement ont tendance à bénéficier de la flexibilité, tandis que les équipes dont les besoins sont stables et limités peuvent estimer que les outils prêts à l'emploi sont suffisants pour une plus longue période.

Comment budgétiser l'analyse financière avec plus de précision

Pour établir un budget réaliste en matière d'analyse financière, il faut d'abord poser les bonnes questions. La plupart des dépassements de coûts ne sont pas dus à des dépenses technologiques imprévues, mais à un champ d'application flou et à des hypothèses qui n'ont jamais été validées.

Les questions clés à aborder d'emblée sont les suivantes :

- Combien de systèmes doivent être intégrés aujourd'hui et plus tard ?. Il est important de planifier non seulement les sources de données actuelles, mais aussi les systèmes susceptibles d'être ajoutés dans les un à trois ans à venir. Chaque nouvelle intégration augmente les coûts et la complexité, en particulier dans les environnements réglementés.

- Quelle doit être la granularité des rapports ?. Les résumés de haut niveau sont nettement moins coûteux que les analyses au niveau des transactions ou en temps réel. Les équipes doivent savoir clairement si elles ont besoin de récapitulatifs mensuels ou de vues détaillées et approfondies sur plusieurs dimensions.

- Quelles sont les exigences en matière de conformité et de réglementation ?. Les normes telles que les GAAP, les IFRS, la loi SOX ou les règles spécifiques à l'industrie affectent la validation des données, les formats de rapport, les pistes d'audit et les politiques de conservation. Ces exigences doivent être prises en compte dans le budget dès le départ, et non pas être traitées comme des suppléments.

- Qui utilisera réellement les données analytiques et comment. Les équipes financières, les gestionnaires et les dirigeants consomment tous les données différemment. Les tableaux de bord spécifiques à chaque rôle, les contrôles d'accès et les besoins de formation influencent à la fois les coûts de mise en œuvre et les coûts permanents.

Plutôt que de tenter une mise en œuvre unique et de grande envergure, de nombreuses organisations obtiennent de meilleurs résultats en développant l'analyse financière par étapes. Une feuille de route par étapes permet aux équipes de fournir de la valeur plus tôt, de contrôler les dépenses plus efficacement et d'ajuster les priorités en fonction de l'utilisation réelle et du retour d'information.

Réflexions finales

Le coût de l'analyse financière se résume rarement à un seul chiffre. Il s'agit de compromis entre la précision, la vitesse, l'échelle et le risque.

Les organisations qui considèrent l'analyse comme une capacité vivante plutôt que comme un projet statique ont tendance à dépenser plus judicieusement au fil du temps. Elles investissent là où c'est important, réduisent les coûts là où ce n'est pas le cas et évitent le cycle de reconstruction des systèmes tous les deux ans.

La vraie question n'est pas de savoir à quel point l'analyse financière peut être bon marché. Il s'agit de savoir quel degré de clarté, de confiance et de contrôle elle apporte par rapport aux besoins réels de l'entreprise.

Questions fréquemment posées

- Quel est le coût de l'analyse financière ?

Les coûts de l'analyse financière sont généralement compris entre 120 000 et 100 000 euros pour les petites mises en œuvre ciblées et peuvent dépasser 600 000 euros pour les plates-formes d'entreprise. Le coût final dépend de la complexité des données, du nombre d'intégrations, de la granularité des rapports et des exigences de conformité, plutôt que des seuls outils d'analyse.

- Pourquoi les coûts de l'analyse financière varient-ils autant ?

Les coûts varient parce qu'il n'y a pas deux organisations qui ont le même paysage de données ou les mêmes besoins en matière de reporting. Des facteurs tels que le nombre de systèmes concernés, la qualité des données, les obligations réglementaires et la nécessité de recourir à des prévisions avancées ou à l'IA ont tous un impact majeur sur les dépenses totales.

- L'analyse financière est-elle une dépense unique ?

Non. Bien qu'il y ait des coûts initiaux de mise en œuvre, l'analyse financière nécessite un investissement continu. Les pipelines de données doivent être entretenus, les systèmes évoluent, les modèles doivent être mis à jour et les performances doivent être optimisées à mesure que les volumes de données augmentent. Au fil du temps, les coûts permanents dépassent souvent les coûts de construction initiaux.

- Qu'est-ce qui fait que les coûts de l'analyse financière sont généralement plus élevés que prévu ?

Les facteurs les plus courants sont la sous-estimation du travail d'intégration, la mauvaise qualité des données, les exigences supplémentaires en matière de conformité et la faible adoption par les utilisateurs, qui oblige à retravailler. Les équipes prévoient souvent un budget pour les tableaux de bord, mais négligent les efforts nécessaires pour garantir l'exactitude et la fiabilité des données.

- Les petites et moyennes entreprises peuvent-elles tirer profit de l'analyse financière ?

Oui. Les petites entreprises peuvent commencer par des analyses ciblées portant sur des indicateurs clés de performance tels que les recettes, les coûts et les flux de trésorerie. L'essentiel est de concevoir le système en tenant compte de la croissance future, afin qu'il puisse évoluer sans nécessiter de remaniement majeur.