L'analyse des big data a la réputation d'être coûteuse, et cette réputation est parfois méritée. Mais le coût réel est rarement lié aux outils, aux plateformes en nuage ou aux tableaux de bord. Il s'agit de tout ce qui se trouve en dessous : les pipelines de données, le personnel, les décisions d'infrastructure et l'effort continu pour maintenir la précision des informations au fur et à mesure que l'entreprise évolue.

De nombreuses entreprises sous-estiment l'analyse des big data parce qu'elles pensent qu'il s'agit d'une installation ponctuelle. En réalité, il s'agit d'une capacité opérationnelle. Les coûts augmentent ou diminuent en fonction de la quantité de données que vous traitez, de la rapidité avec laquelle vous avez besoin de réponses et de la discipline dont vous faites preuve en ce qui concerne le champ d'application.

Cet article explique ce que coûte réellement l'analyse des big data, pourquoi les prix varient autant et ce que les entreprises oublient souvent lorsqu'elles planifient leur budget.

Quel est le coût de l'analyse des Big Data ?

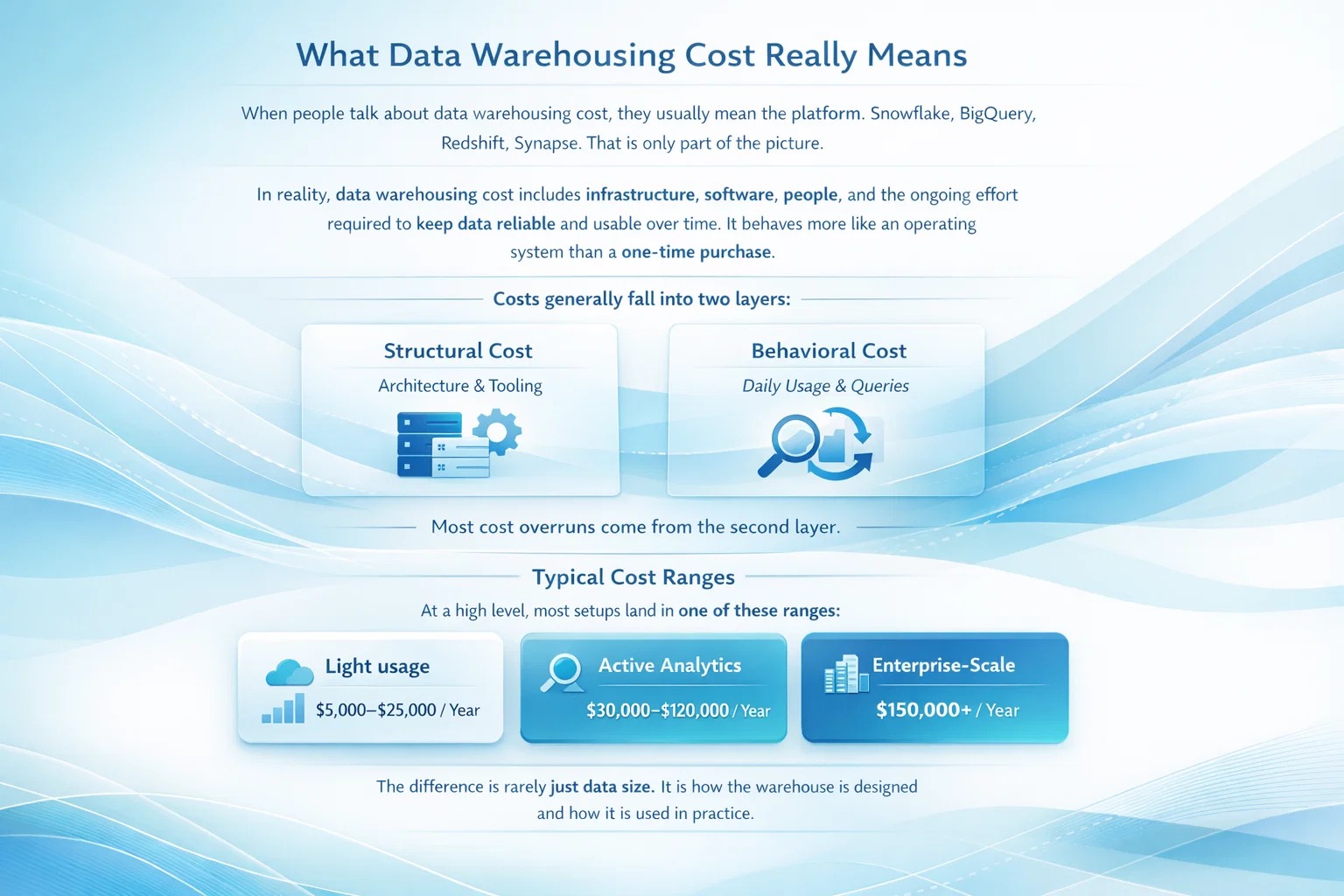

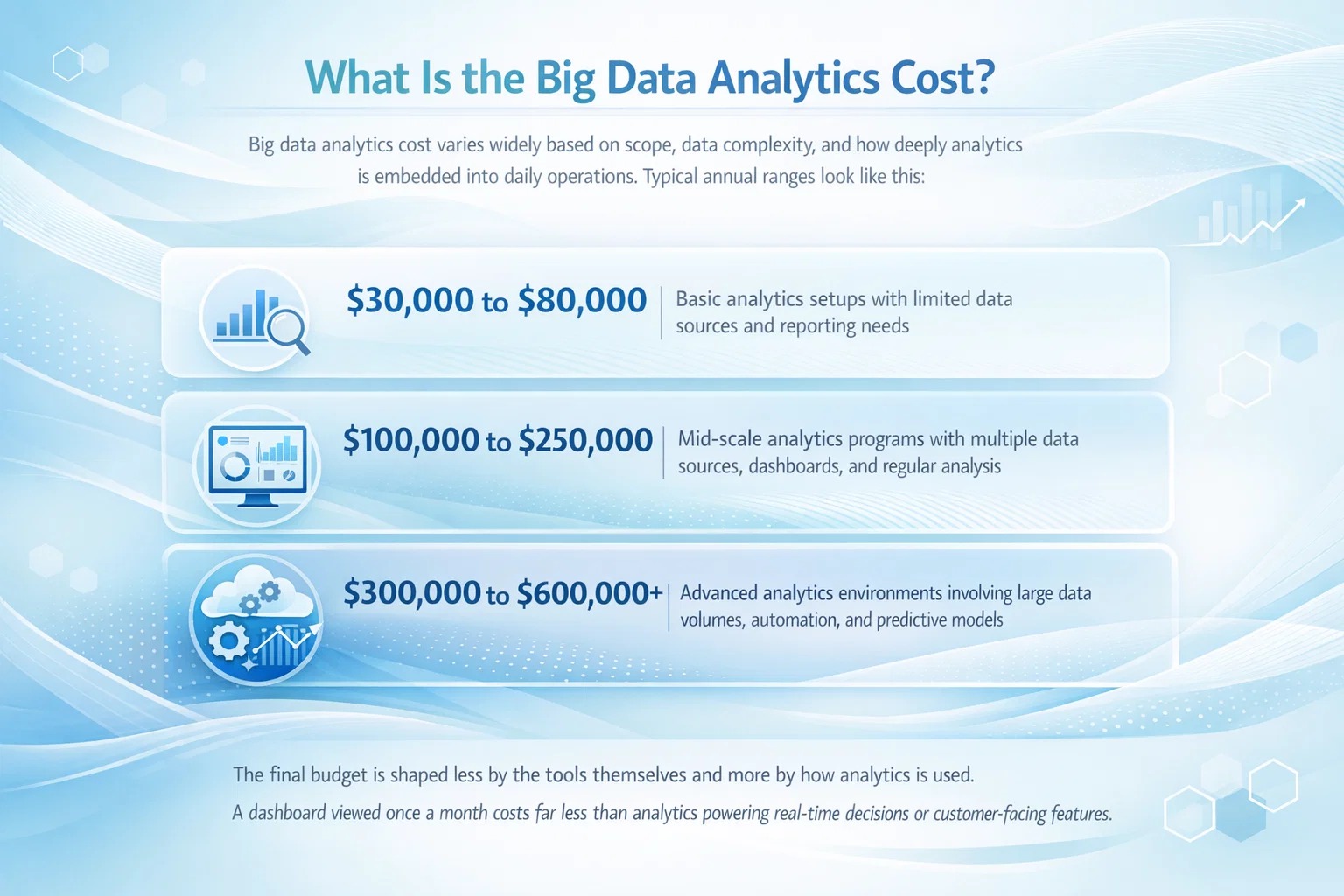

Le coût de l'analyse des big data varie considérablement en fonction de la portée, de la complexité des données et de l'intégration de l'analyse dans les opérations quotidiennes. Les fourchettes annuelles typiques sont les suivantes :

- $30.000 à $80.000 pour des configurations analytiques de base avec des sources de données et des besoins de reporting limités

- $100 000 à $250 000 pour les programmes d'analyse de taille moyenne avec plusieurs sources de données, des tableaux de bord et des analyses régulières.

- $300 000 à $600 000+ pour les environnements analytiques avancés impliquant de grands volumes de données, l'automatisation et des modèles prédictifs.

Le budget final dépend moins des outils eux-mêmes que de la manière dont l'analyse est utilisée. Un tableau de bord consulté une fois par mois coûte beaucoup moins cher que des analyses permettant de prendre des décisions en temps réel ou de mettre en place des fonctionnalités orientées vers le client.

Fourchettes de coûts selon l'étendue de l'analyse

Plutôt que de considérer l'analyse comme un poste unique, il est utile de répartir les coûts en fonction de la portée et de la responsabilité.

Fondements de l'analyse de base

Ces configurations mettent l'accent sur la visibilité plutôt que sur la prédiction. Elles sont souvent utilisées pour rassembler des données dispersées en un seul endroit et créer des rapports cohérents.

Les cas d'utilisation typiques sont les tableaux de bord exécutifs, les rapports opérationnels ou le suivi des performances de base.

Fourchette de coûts

$30 000 à $80 000 par an

Ces projets impliquent généralement

- Un petit nombre de sources de données

- Mises à jour programmées des données

- Transformations de base

- Tableaux de bord et rapports standard

Elles constituent souvent la première étape vers des analyses plus approfondies.

Programmes d'analyse à moyenne échelle

C'est là que se situent de nombreuses entreprises en pleine croissance. L'analyse est de plus en plus intégrée aux opérations et les parties prenantes attendent des réponses plutôt que de simples chiffres.

Fourchette de coûts

$100 000 à $250 000 par an

On voit souvent :

- Multiples sources de données internes et externes

- Mesures et indicateurs de performance personnalisés

- Tableaux de bord basés sur les rôles

- Analyses et réflexions régulières

- Personnel ou partenaires dédiés à l'analyse

Les coûts augmentent parce que la fiabilité, la précision et la rapidité deviennent plus importantes.

Analyse avancée et prédictive

À ce niveau, l'analyse va au-delà de la description de ce qui s'est passé et commence à influencer ce qui devrait se passer ensuite.

Fourchette de coûts

$250.000 à $600.000+ par an

Ces programmes comprennent généralement

- Ensembles de données volumineux ou à croissance rapide

- Pipelines automatisés

- Apprentissage automatique ou modèles prédictifs

- Suivi et contrôle de la qualité des données

- Intégration dans les produits ou les expériences des clients

Dans ce cas, les décisions en matière d'architecture ont un impact à long terme sur les coûts et la flexibilité.

Plates-formes d'analyse critiques pour les entreprises

Ces environnements soutiennent les recettes, la conformité ou les processus d'entreprise fondamentaux. Les temps d'arrêt ou les données incorrectes ont des conséquences réelles.

Fourchette de coûts

$600 000 à $1M+ par an

Ils exigent généralement :

- Haute disponibilité et redondance

- Contrôle d'accès et audit stricts

- Fraîcheur des données en temps quasi réel

- Une gouvernance et une documentation solides

- Optimisation continue

À ce stade, l'analyse est une infrastructure et non un projet secondaire.

A-listware : Construire des équipes d'analyse et d'ingénierie qui fonctionnent vraiment

Au Logiciel de liste A, Nous aidons les entreprises à transformer l'analyse et les logiciels en quelque chose de pratique et de durable. Nous avons constaté que les coûts augmentent facilement lorsque les équipes sont mal alignées, que les outils se chevauchent ou que l'analyse est élaborée de manière isolée. Nous nous concentrons sur la création d'équipes et de systèmes adaptés au fonctionnement réel des entreprises.

Nous intégrons des ingénieurs expérimentés, des spécialistes des données et des responsables techniques directement dans les flux de travail des clients, agissant comme une extension de l'équipe interne. Qu'il s'agisse d'un seul expert ou d'une unité interfonctionnelle complète, nous donnons la priorité à une collaboration harmonieuse, à une appropriation claire et à une livraison fiable dès le premier jour.

La rapidité est importante, mais la stabilité l'est tout autant. Nous constituons généralement des équipes prêtes à produire dans un délai de 2 à 4 semaines, en puisant dans un vivier de plus de 100 000 professionnels. Chaque spécialiste est sélectionné pour son expertise technique et ses compétences en matière de communication, car l'analyse n'apporte de la valeur que lorsque les équipes peuvent lui faire confiance et l'utiliser.

Nous aidons également nos clients à maîtriser les coûts à long terme en veillant à ce que les architectures soient légères et les équipes évolutives. Cela signifie qu'il faut choisir les outils avec soin, aligner la fraîcheur des données sur les besoins réels et construire des configurations qui peuvent évoluer sans être constamment remaniées. Avec un support continu, un engagement SLA et une disponibilité 24/7, nous restons impliqués longtemps après le lancement pour garantir que les systèmes continuent à fonctionner au fur et à mesure de l'évolution de l'entreprise.

Si vous avez besoin d'équipes d'analyse et d'ingénierie qui s'intègrent en douceur et évoluent de manière responsable, nous sommes prêts à vous aider.

Pourquoi les coûts de l'analyse des Big Data varient-ils autant ?

Les estimations des coûts de l'analyse peuvent varier de plusieurs centaines de milliers de dollars, même pour des entreprises opérant dans le même secteur. Il ne s'agit pas d'une exagération ou d'un discours commercial. Il s'agit de différences réelles en termes de portée, de responsabilité et de risque.

À première vue, deux configurations analytiques peuvent se ressembler. Elles peuvent toutes deux présenter des tableaux de bord, des graphiques et des indicateurs de performance clés. Mais ce qui se passe en coulisses raconte souvent une histoire très différente. Les facteurs de coûts les plus importants se trouvent généralement sous la surface, dans des domaines qu'il est facile de sous-estimer lors de la planification initiale.

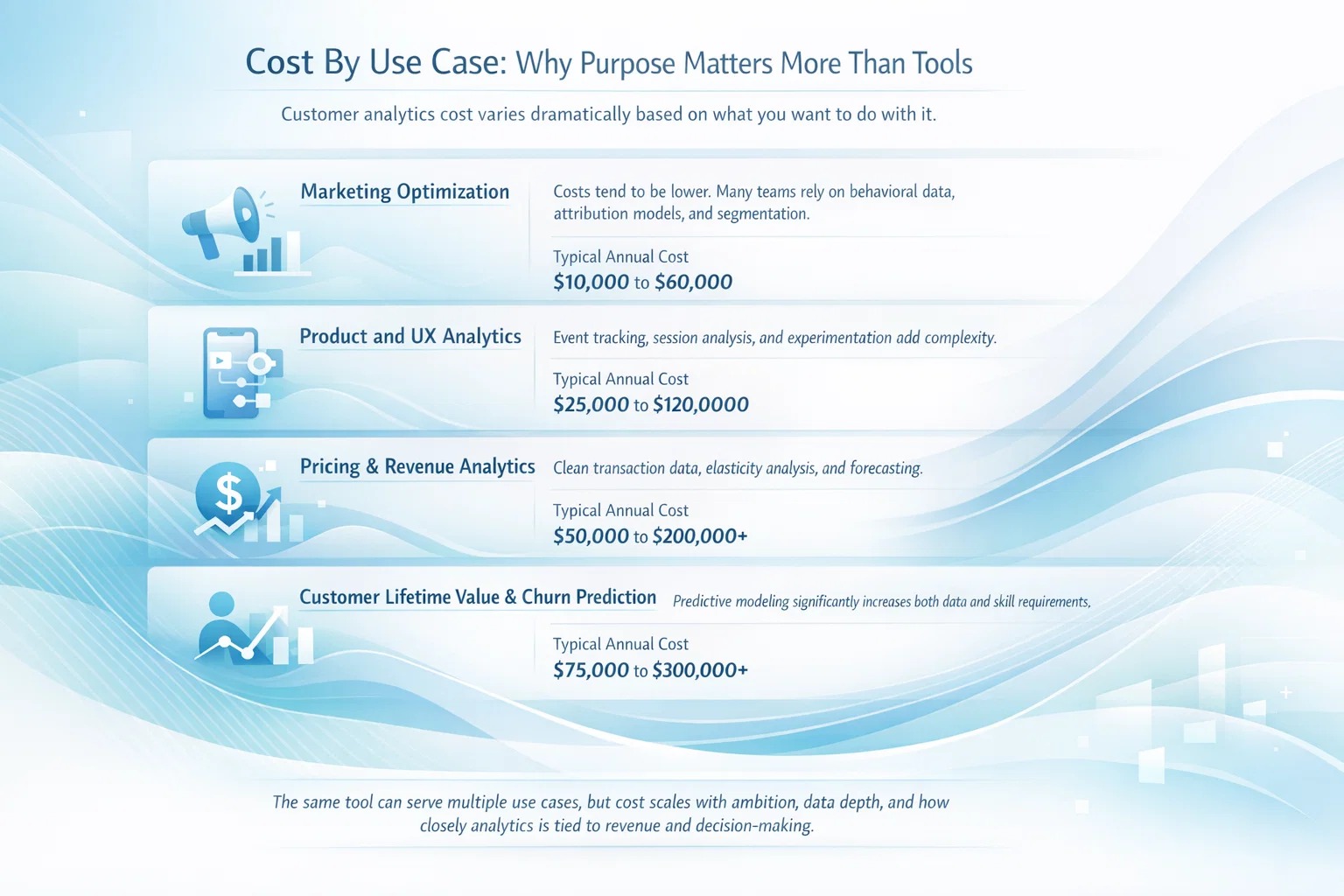

Le coût de l'analyse des big data est influencé par plusieurs facteurs clés :

- Le nombre et la fiabilité des sources de données. Chaque source de données ajoute de la complexité. Les systèmes propres et bien documentés sont moins coûteux à intégrer et à maintenir que les systèmes instables ou mal structurés. Les sources peu fiables nécessitent une surveillance, des tentatives et des corrections manuelles, ce qui augmente les coûts permanents.

- Volume de données et taux de croissance. Les coûts de l'analyse évoluent avec les données. Les coûts de stockage, de traitement et d'interrogation augmentent avec les volumes. Une croissance rapide peut également obliger à modifier l'architecture plus tôt que prévu, ce qui entraîne des investissements supplémentaires.

- Exigences en matière de fraîcheur des données. Les mises à jour quotidiennes ou hebdomadaires sont beaucoup moins coûteuses à prendre en charge que les analyses en temps quasi réel. Des données plus rapides signifient une plus grande utilisation de l'informatique, des accords de niveau de service plus stricts et un risque opérationnel plus élevé en cas de défaillance des pipelines.

- La complexité de la logique d'entreprise. Les mesures simples sont faciles à calculer. Les mesures complexes qui combinent plusieurs systèmes, cas de figure et règles de gestion nécessitent davantage de développement, de tests et de maintenance continue.

- Le nombre de personnes qui consomment des informations. Soutenir une équipe interne n'est pas la même chose que soutenir les cadres, les opérations, le marketing et les utilisateurs externes. Chaque public a souvent besoin de ses propres définitions, vues et contrôles d'accès, ce qui augmente les coûts.

- Que l'analyse soit interne ou orientée vers le client. Les analyses internes peuvent tolérer des retards ou des imperfections occasionnels. Ce n'est généralement pas le cas des analyses orientées vers le client. Une plus grande précision, une sécurité renforcée et de meilleures performances augmentent les coûts de développement et d'exploitation.

Deux configurations analytiques peuvent sembler presque identiques dans une démo, mais se comporter très différemment en production. L'une peut tranquillement soutenir les décisions avec un minimum d'entretien, tandis que l'autre exige une attention constante pour rester précise, rapide et fiable. C'est de cette différence que proviennent la plupart des écarts de coûts.

Les trois principales catégories de coûts dans le domaine de l'analyse

La plupart des budgets d'analyse se répartissent en trois grandes catégories. Lorsque les équipes sous-estiment les coûts de l'analyse, c'est généralement parce que l'un de ces domaines est négligé ou considéré comme secondaire. En réalité, ces trois domaines fonctionnent ensemble et le fait d'ignorer l'un d'entre eux conduit à une planification incomplète.

Les personnes

Le personnel représente généralement la dépense la plus importante et la plus constante en matière d'analyse. Même dans les environnements hautement automatisés, l'analyse ne fonctionne pas uniquement avec des outils. Des professionnels qualifiés sont nécessaires pour concevoir des pipelines, définir des mesures, interpréter les résultats et assurer le fonctionnement des systèmes en fonction de l'évolution des données et des besoins de l'entreprise.

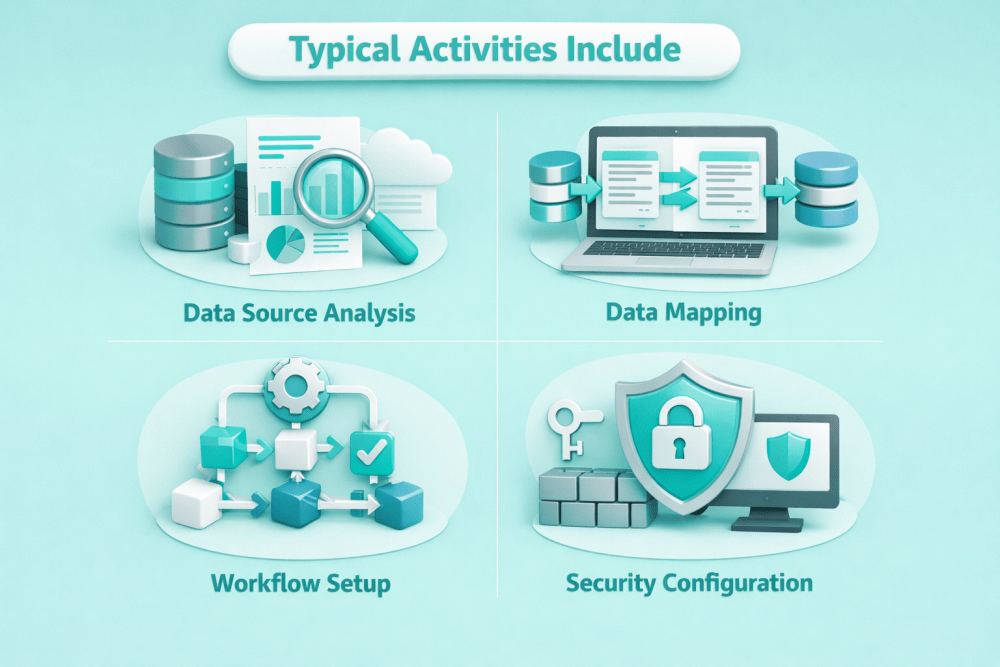

Il s'agit notamment des ingénieurs de données qui construisent et maintiennent les pipelines de données, des analystes qui définissent les mesures et répondent aux questions commerciales, des scientifiques de données qui développent des modèles, des ingénieurs de plateforme ou DevOps qui soutiennent l'infrastructure, et des gestionnaires de produits ou d'analyse qui coordonnent les priorités. Même les petites équipes deviennent coûteuses une fois que les salaires, les avantages sociaux, le temps d'intégration et la fidélisation sont pris en compte.

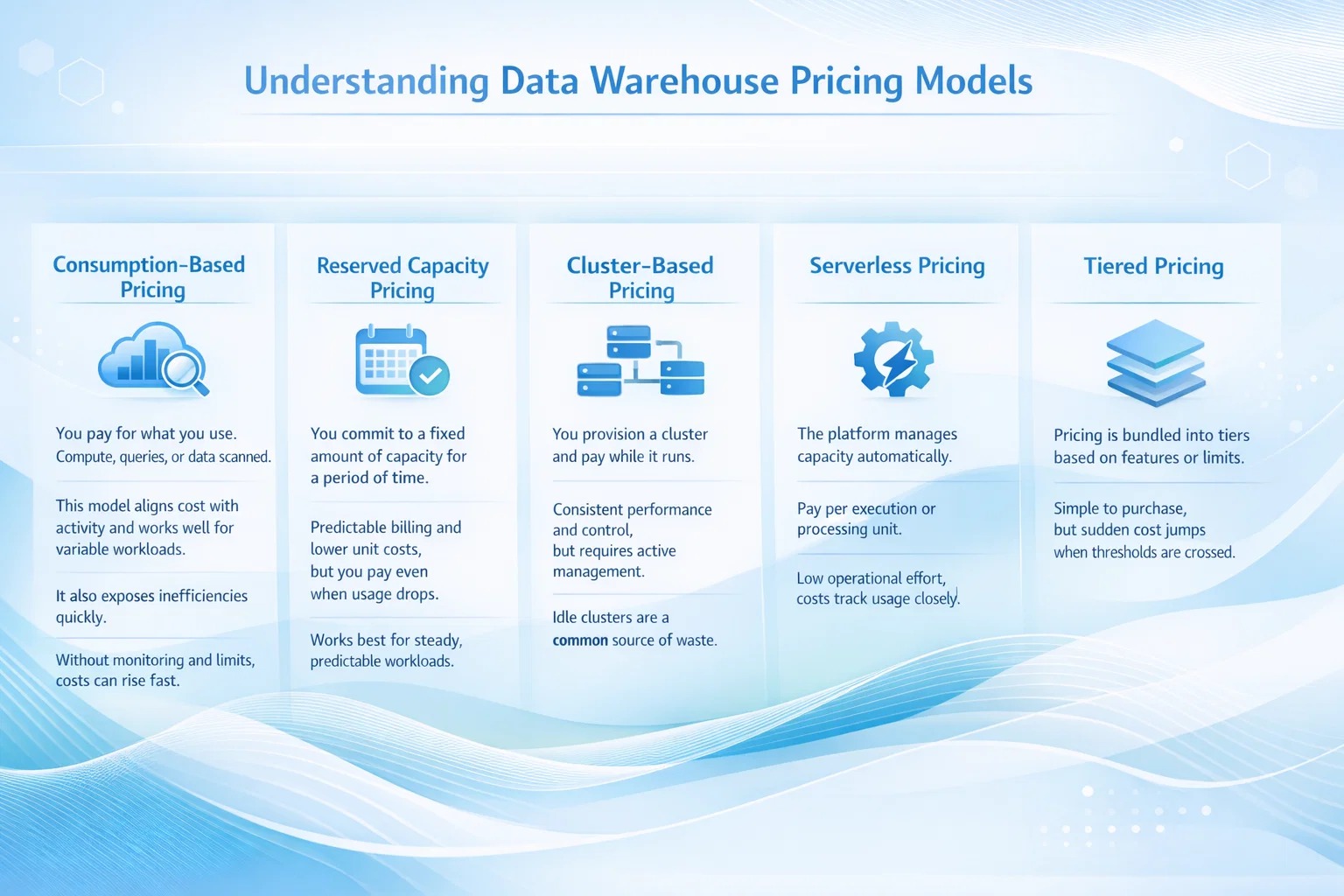

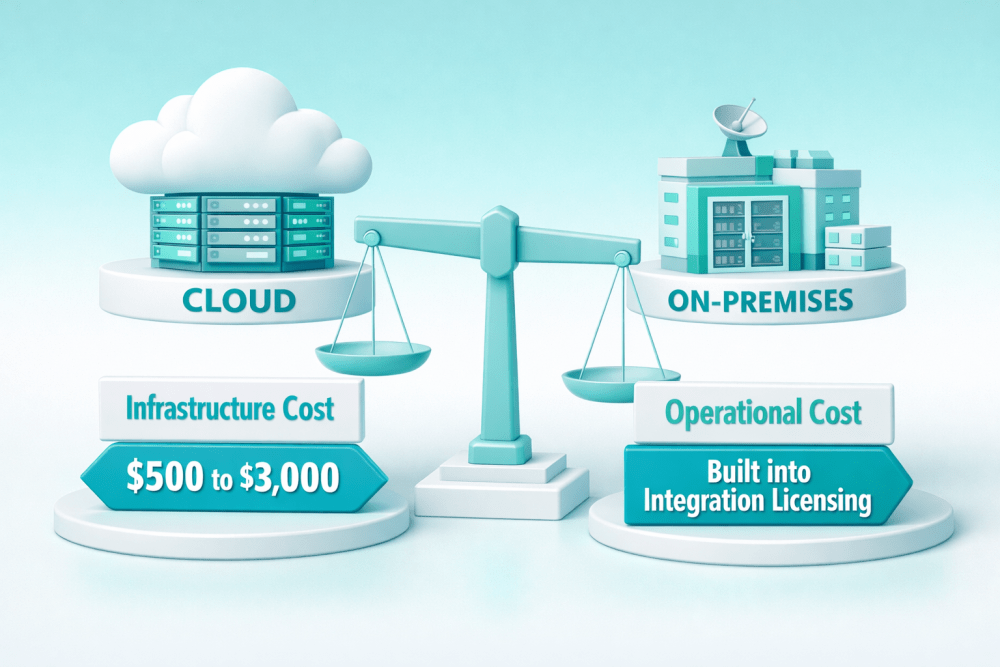

Technologie

Les coûts technologiques sont plus visibles que les coûts humains, mais ils sont aussi plus variables. Ces dépenses couvrent généralement les entrepôts de données et le stockage, les outils d'ingestion et de transformation des données, les plateformes de veille stratégique et de visualisation, l'infrastructure d'apprentissage automatique et les outils de surveillance ou de sécurité.

De nombreuses plateformes analytiques modernes utilisent une tarification basée sur la consommation. Au lieu de payer par utilisateur, les entreprises paient en fonction de la quantité de données qu'elles stockent, traitent ou interrogent. Cela rend les coûts plus flexibles, mais aussi plus difficiles à prévoir si l'utilisation augmente plus rapidement que prévu.

Frais généraux opérationnels

Les frais généraux opérationnels sont l'endroit où les coûts d'analyse s'accumulent discrètement. Ces dépenses apparaissent rarement comme un poste clair, mais elles consomment du temps, de l'attention et du budget sur le long terme.

Il s'agit notamment des corrections de la qualité des données, des pannes de pipeline et du dépannage, de la maintenance des tableaux de bord redondants ou inutilisés, de la formation des équipes internes et de la gestion des examens de conformité ou de sécurité. Bien que ces coûts soient réels, ils sont souvent sous-estimés lors de la planification parce qu'ils apparaissent progressivement plutôt que d'un seul coup.

Ensemble, le personnel, la technologie et les frais généraux opérationnels déterminent le coût réel de l'analyse des big data. Il est essentiel de comprendre leur interaction pour établir des budgets réalistes et éviter les surprises ultérieures.

L'impact du volume et de la fraîcheur des données sur les coûts

Plus de données ne signifie pas seulement plus de stockage. Cela signifie plus de traitement, plus de surveillance et plus de risques lorsque les choses tournent mal.

Les données à haute fréquence augmentent les coûts parce qu'elles nécessitent :

- Des pipelines plus robustes

- Utilisation accrue de la puissance de calcul

- Détection plus rapide des erreurs

- Des accords de niveau de service plus stricts

De nombreuses organisations optent par défaut pour des analyses en temps quasi réel sans vérifier si elles sont réellement nécessaires. Dans de nombreux cas, des mises à jour quotidiennes ou horaires permettent d'obtenir la même valeur commerciale à un coût bien moindre.

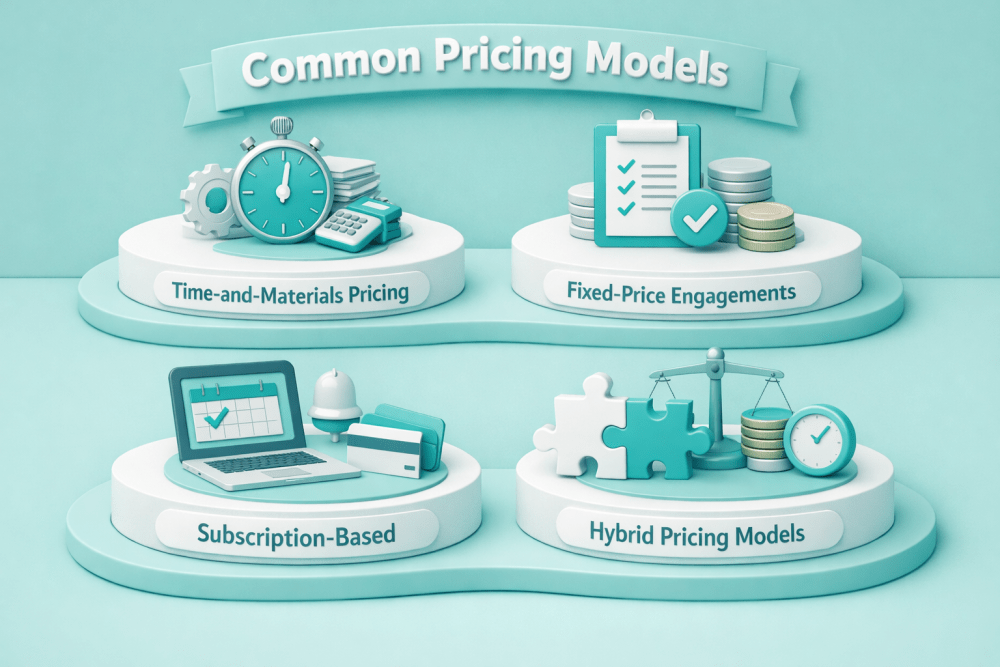

Équipes d'analystes internes ou externes

La manière dont le travail d'analyse est effectué a un impact direct sur la structure des coûts et la flexibilité. Le choix est rarement une question de bien ou de mal. Il s'agit de faire des compromis.

| Aspect | Équipes internes d'analyse | Partenaires externes ou services gérés |

| Connaissance de l'entreprise | Compréhension approfondie des systèmes, des processus et du contexte internes | La connaissance du domaine se développe au fil du temps et dépend de la qualité de l'intégration. |

| Structure des coûts | Coûts fixes élevés liés aux salaires, aux avantages sociaux et aux frais généraux | Des coûts plus flexibles qui s'adaptent à l'utilisation et à la portée |

| Continuité | Forte continuité et propriété à long terme | Dépend de la structure du contrat et de la stabilité du partenaire |

| Accès aux compétences | Limitée par le marché de l'emploi et les capacités internes | Accès plus rapide à une expertise spécialisée ou difficile à trouver |

| Évolutivité | Plus lent à augmenter ou à diminuer l'échelle | Il est plus facile d'ajuster la taille de l'équipe en fonction des besoins |

| Contrôle | Contrôle total des priorités et de l'exécution | Un contrôle partagé qui nécessite un alignement et une communication |

| Embauche et rétention | Recruter et conserver les talents peut s'avérer difficile | Géré par le prestataire de services |

| Convient le mieux à | Organisations ayant des besoins stables et à long terme en matière d'analyse | Organisations ayant besoin de flexibilité ou d'un accès rapide à l'expertise |

De nombreuses entreprises adoptent des modèles hybrides, conservant la propriété stratégique et la connaissance du domaine en interne, tout en faisant appel à des partenaires externes pour étendre l'exécution ou combler les lacunes en matière de compétences, le cas échéant.

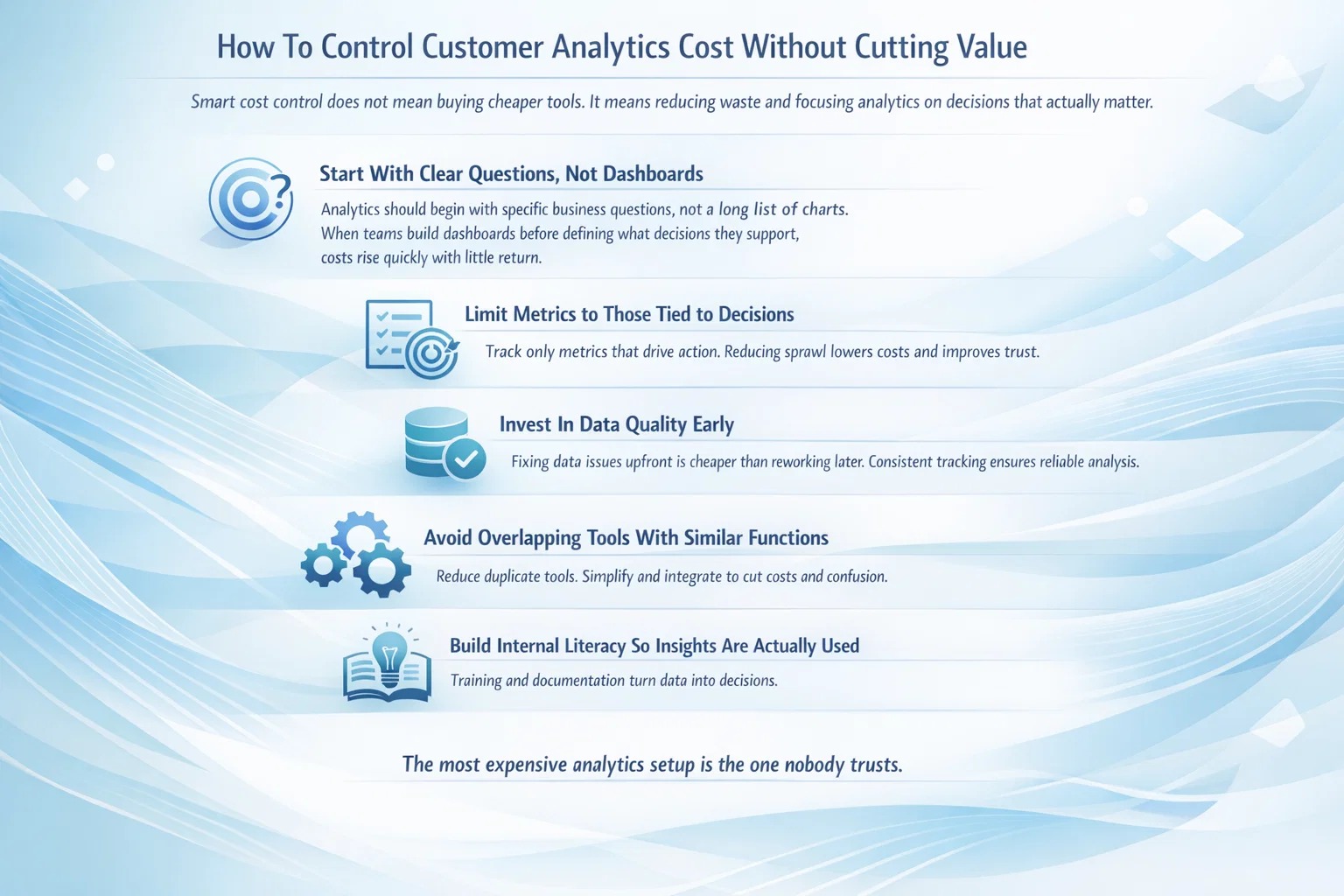

Moyens pratiques de contrôler les coûts d'analyse

La maîtrise des coûts ne signifie pas qu'il faille réduire l'analyse ou ralentir la production d'informations. Il s'agit de façonner l'analyse de manière délibérée, avec des priorités claires et des limites réalistes. La plupart des dépassements de coûts sont dus à une croissance non gérée, et non au travail d'analyse lui-même.

Les pratiques efficaces sont les suivantes :

- Privilégier les résultats commerciaux à la disponibilité des données. Ce n'est pas parce que des données existent qu'elles doivent être analysées. Commencez par les décisions les plus importantes et remontez jusqu'aux données nécessaires pour les étayer. Cela permet de rester concentré sur le champ d'application et d'éviter l'ingestion et le traitement de données inutiles.

- Limiter les mesures à celles qui permettent de prendre des décisions. Les grands catalogues de mesures sont impressionnants, mais leur maintenance est coûteuse. Un ensemble plus restreint de mesures bien définies permet de réduire le temps de développement, d'éviter la confusion et de diminuer les coûts d'assistance.

- Examiner régulièrement les tableaux de bord. Les tableaux de bord ont tendance à s'accumuler au fil du temps. Certains cessent d'être utilisés, d'autres deviennent obsolètes. Des examens réguliers permettent d'identifier ce qui est encore utile et ce qui peut être supprimé, réduisant ainsi la maintenance et l'encombrement.

- Adapter la fraîcheur des données aux besoins réels. L'analyse en temps réel est coûteuse et souvent inutile. De nombreuses questions commerciales peuvent trouver une réponse avec des mises à jour horaires ou quotidiennes. L'alignement des exigences de fraîcheur sur les délais de décision réels peut réduire de manière significative les coûts d'infrastructure et de calcul.

- Réduction du chevauchement des outils. Chaque outil d'analyse supplémentaire ajoute des frais de licence, des efforts d'intégration et des frais généraux de formation. La consolidation des outils, lorsqu'elle est possible, simplifie la pile et réduit les coûts directs et indirects.

- Investir tôt dans la qualité des données. Des données propres et bien structurées réduisent le travail à refaire et la lutte contre les incendies. Si les efforts en matière de qualité des données augmentent les coûts initiaux, ils réduisent les dépenses à long terme en rendant les analyses plus rapides, plus fiables et plus faciles à mettre à l'échelle.

- Développer la culture de l'analyse au sein des équipes. Lorsque les utilisateurs professionnels comprennent les données et les indicateurs, ils ont moins recours à des demandes ad hoc et à des explications manuelles. Cela réduit la pression sur les équipes d'analyse et améliore l'efficacité globale.

Ces étapes requièrent de la discipline et de l'alignement, et non de nouveaux logiciels ou des cadres complexes. Dans de nombreux cas, un meilleur contrôle des coûts résulte d'une pensée plus claire plutôt que de budgets plus importants.

Réflexions finales

Le coût de l'analyse des big data est déterminé par la responsabilité et non par l'ambition. Plus l'analyse influence les décisions, les produits ou les clients, plus elle nécessite d'attention et de structure.

Les organisations qui planifient de manière réaliste dépensent souvent plus au départ, mais moins au fil du temps. Celles qui recherchent le chiffre initial le plus bas le paient généralement plus tard par des retouches, des frustrations et des occasions manquées.

La vraie question n'est pas de savoir à quel point l'analyse peut être bon marché, mais de savoir dans quelle mesure elle soutient de manière fiable l'activité qu'elle est censée servir.

Questions fréquemment posées

- Quel est le coût habituel de l'analyse des big data ?

Le coût de l'analyse des big data varie considérablement en fonction de la portée et de la complexité. Les installations analytiques de base peuvent commencer aux alentours de 130 000 à 80 000 TTP par an. Les programmes d'analyse de taille moyenne se situent souvent entre 100 000 et 250 000 euros par an. Les environnements analytiques avancés ou critiques pour l'entreprise peuvent dépasser $500 000 par an, en particulier lorsque des volumes de données importants, l'automatisation ou des modèles prédictifs sont impliqués.

- Pourquoi les coûts de l'analyse des big data varient-ils autant d'une entreprise à l'autre ?

Les coûts diffèrent parce que les exigences en matière d'analyse sont rarement identiques. Des facteurs tels que le nombre de sources de données, le volume de données, les exigences en matière de fraîcheur, la complexité de la logique d'entreprise et le fait que l'analyse soit interne ou orientée vers le client influencent tous la tarification. Deux entreprises du même secteur peuvent avoir des coûts d'analyse très différents en fonction de la manière dont l'analyse est utilisée au sein de l'entreprise.

- L'analyse des big data est-elle plus coûteuse que l'analyse traditionnelle ?

L'analyse des big data est généralement plus coûteuse car elle implique des ensembles de données plus importants, des pipelines plus complexes et des attentes souvent plus élevées en matière de rapidité et de fiabilité. L'analyse traditionnelle peut s'appuyer sur des ensembles de données plus petits et des rapports plus simples, tandis que l'analyse des big data prend souvent en charge des informations en temps réel, une modélisation avancée ou des fonctions orientées vers le client.

- Quels sont les coûts cachés les plus importants dans l'analyse des big data ?

Les coûts cachés comprennent souvent les corrections de la qualité des données, les défaillances du pipeline, les tableaux de bord inutilisés, la formation interne, les examens de conformité et la maintenance continue. Ces coûts apparaissent rarement dans les estimations initiales mais s'accumulent au fil du temps si les programmes d'analyse ne sont pas gérés activement.

- Est-il plus économique de constituer une équipe d'analyse interne ou de faire appel à des partenaires externes ?

Cela dépend des besoins de l'organisation. Les équipes internes apportent une connaissance approfondie de l'entreprise et une continuité à long terme, mais elles s'accompagnent de coûts fixes élevés. Les partenaires externes offrent une certaine flexibilité et un accès plus rapide à des compétences spécialisées, mais nécessitent une communication et une intégration solides. De nombreuses entreprises utilisent une approche hybride pour équilibrer les coûts et le contrôle.