Résumé rapide : La transformation numérique et le développement durable convergent pour créer de puissantes solutions aux défis environnementaux. Les organisations qui tirent parti de l'IA, de l'IdO, de la blockchain et du cloud computing peuvent réduire leur empreinte carbone, optimiser l'utilisation des ressources et générer un impact environnemental mesurable tout en maintenant la croissance de l'entreprise. L'intégration des technologies numériques aux objectifs de durabilité représente une voie essentielle pour atteindre les objectifs climatiques mondiaux et parvenir à une résilience à long terme.

Il est devenu impossible d'ignorer l'intersection de l'innovation numérique et de la responsabilité environnementale. Alors que le changement climatique s'accélère et que la pression réglementaire s'intensifie, les entreprises sont confrontées à un double défi : moderniser leurs opérations tout en réduisant leur impact sur l'environnement.

Mais voilà, la transformation numérique n'est plus seulement une question d'efficacité. Elle devient l'épine dorsale de la manière dont les organisations s'acquittent de leurs engagements en matière de développement durable. Des réseaux énergétiques intelligents à la réduction des déchets par l'IA, la technologie redéfinit ce qui est possible en matière de gestion de l'environnement.

Selon le Forum économique mondial, les technologies numériques pourraient contribuer à réduire jusqu'à 20 % des émissions mondiales de gaz à effet de serre (GES) d'ici à 2050. Ce n'est pas rien. Pourtant, de nombreuses organisations traitent encore les initiatives numériques et les efforts de développement durable comme des pistes distinctes, sans tenir compte des synergies considérables qui existent entre elles.

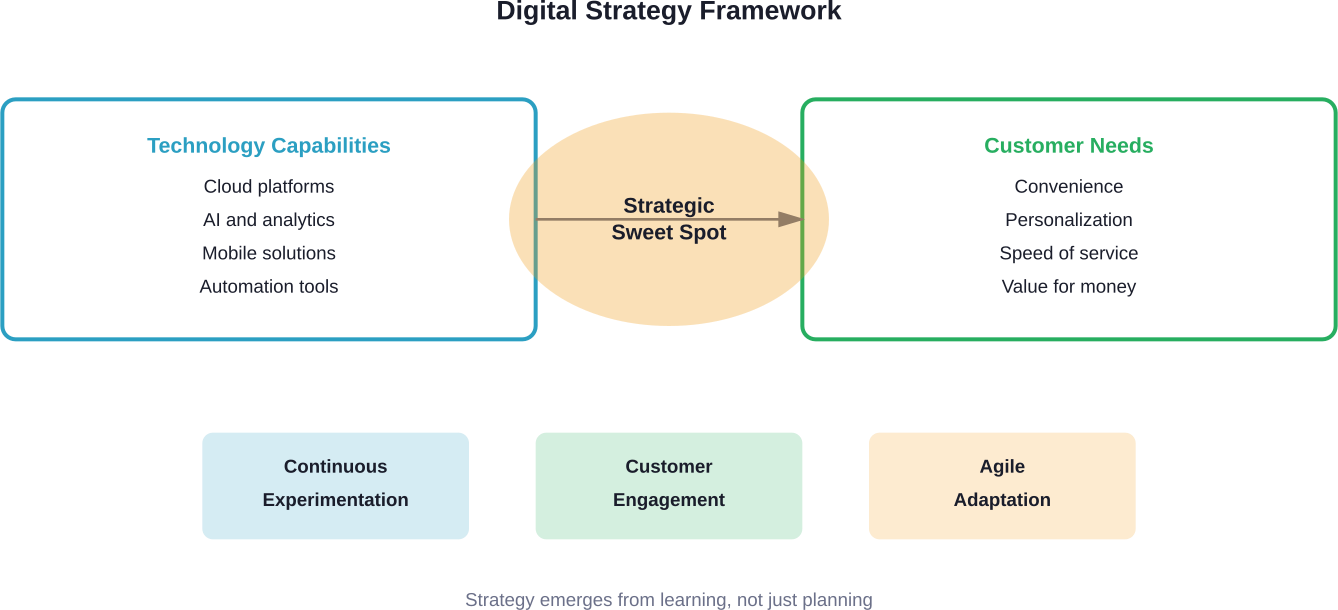

La question n'est pas de savoir s'il faut poursuivre la transformation numérique ou la durabilité. Il s'agit de savoir comment intégrer ces deux stratégies dans une approche unifiée qui permet d'obtenir simultanément des résultats environnementaux et commerciaux.

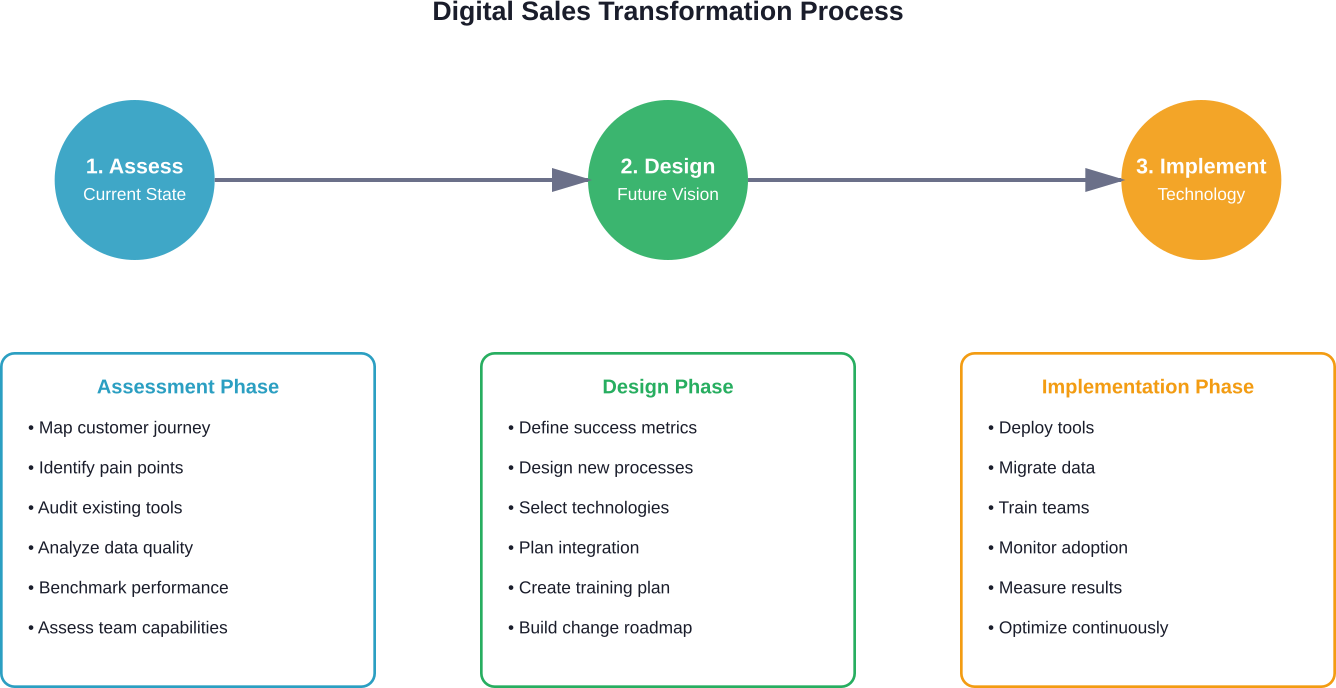

Comprendre la convergence numérique-durabilité

La transformation numérique modifie fondamentalement la façon dont les organisations fonctionnent, prennent des décisions et créent de la valeur. La transformation durable porte sur l'impact des entreprises sur l'environnement et la société. Lorsque ces deux forces se combinent, quelque chose de puissant se produit.

L'Agence américaine pour la protection de l'environnement note que le carbone incorporé, c'est-à-dire les émissions provenant de la construction, de l'entretien et de la démolition des bâtiments, est responsable de 11 % des émissions mondiales de gaz à effet de serre. La récupération des matériaux par le biais de technologies de recyclage améliorées constitue l'une des voies permettant de réduire cet impact. C'est pourquoi l'EPA soutient le développement technologique par le biais de programmes axés sur des solutions d'économie circulaire.

Parlons franchement : la relation fonctionne dans les deux sens. Les technologies numériques permettent d'obtenir de meilleurs résultats en matière de durabilité grâce au suivi, à l'optimisation et à la transparence. Simultanément, les objectifs de durabilité stimulent l'innovation dans les solutions numériques, poussant les développeurs à créer des systèmes informatiques respectueux de l'énergie et des systèmes d'intelligence artificielle propres.

Une recherche publiée dans Frontiers in Environmental Science a examiné l'impact de la transformation numérique sur la durabilité des entreprises chinoises cotées en bourse. L'analyse a révélé des corrélations positives entre les initiatives de numérisation et les performances environnementales, suggérant que l'adoption de technologies stratégiques contribue de manière mesurable aux résultats en matière de durabilité.

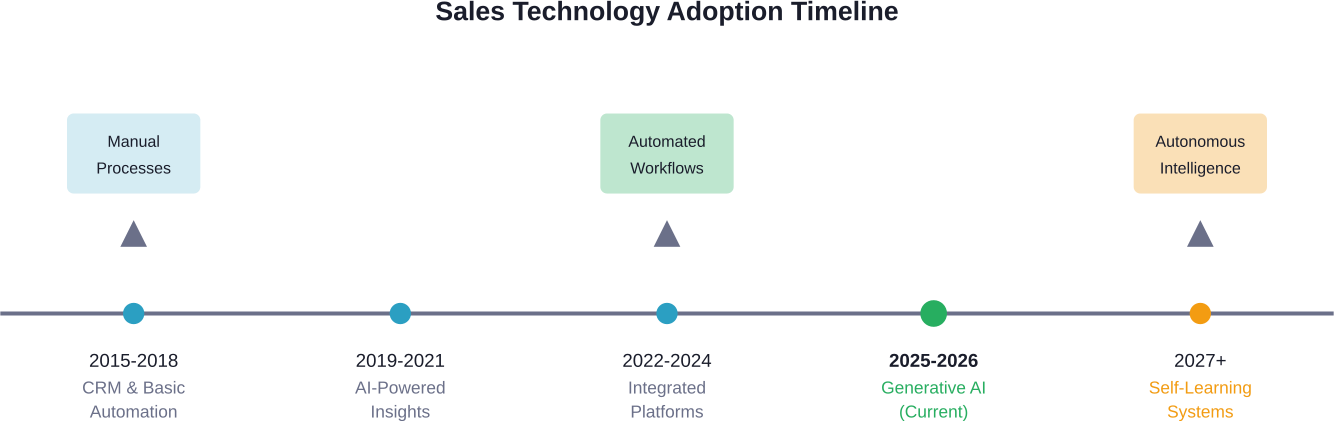

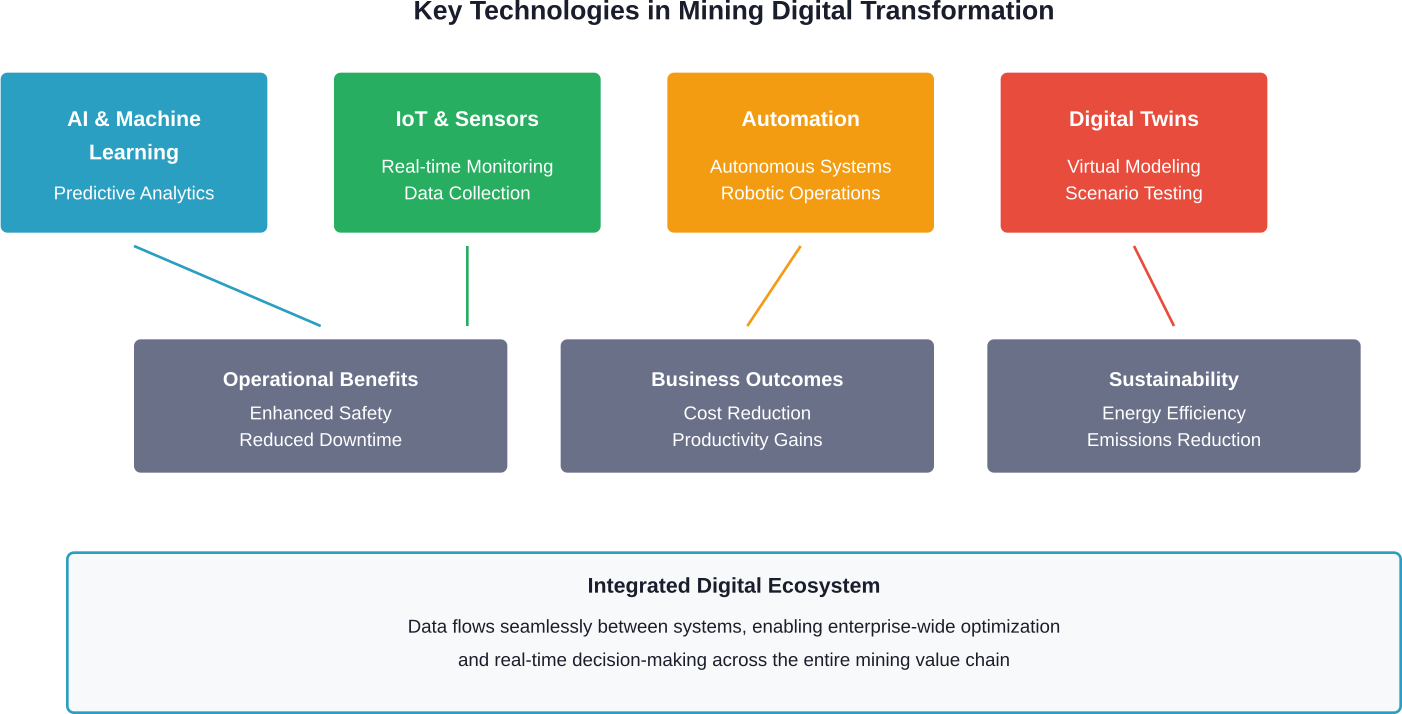

Les technologies de base à l'origine d'une transformation numérique durable

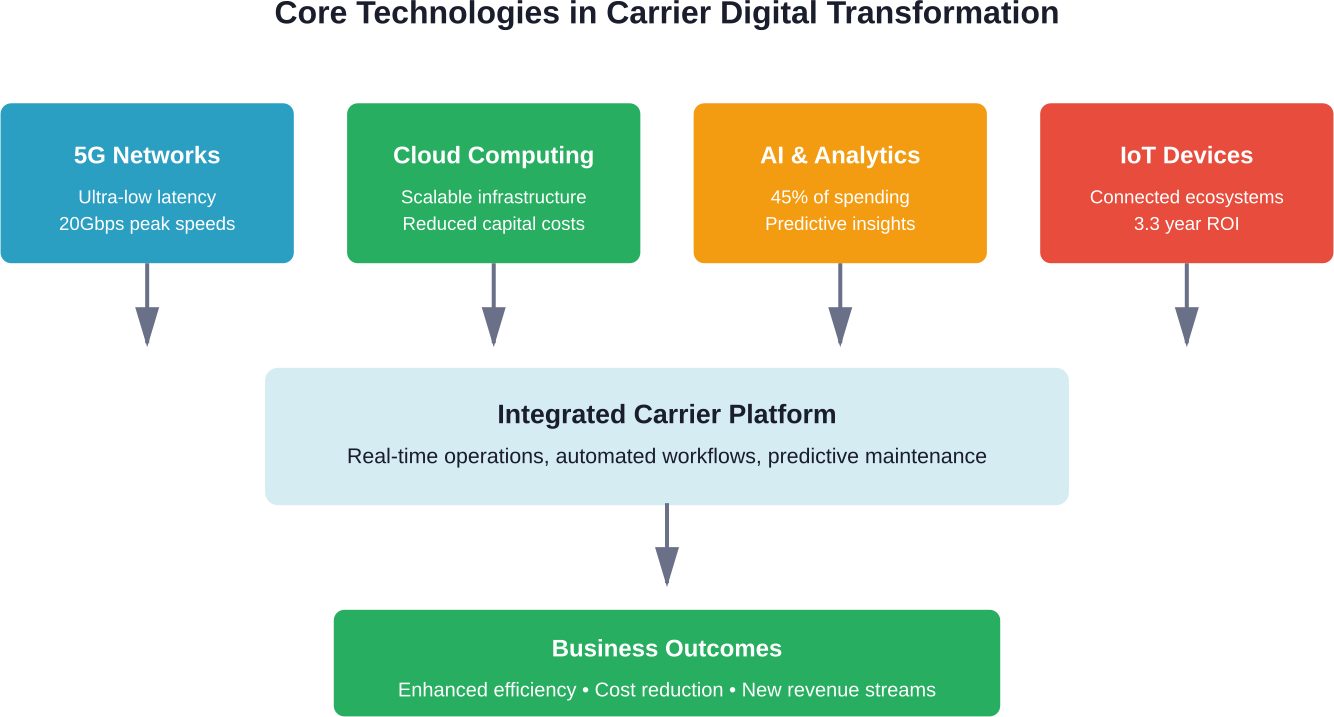

Plusieurs technologies numériques se distinguent par leur impact particulier sur les efforts de développement durable. La compréhension de leurs applications spécifiques aide les organisations à hiérarchiser les investissements et à élaborer des stratégies efficaces.

Intelligence artificielle et apprentissage automatique

Les systèmes pilotés par l'IA excellent dans l'optimisation des processus complexes où la prise de décision humaine ne peut pas suivre le rythme du volume de données. La gestion de l'énergie représente l'un des cas d'utilisation les plus clairs.

Les systèmes de bâtiments intelligents utilisent des algorithmes d'apprentissage automatique pour prévoir les besoins en chauffage, en climatisation et en éclairage en fonction des modèles d'occupation, des prévisions météorologiques et de l'utilisation historique. Ces systèmes s'adaptent en temps réel, réduisant la consommation d'énergie sans sacrifier le confort ou la productivité.

Les opérations de fabrication déploient l'IA pour minimiser les déchets en prévoyant les pannes d'équipement, en optimisant les calendriers de production et en identifiant les problèmes de qualité avant que les produits défectueux ne consomment des ressources supplémentaires. La combinaison de la maintenance prédictive et de l'optimisation de la qualité permet de réduire à la fois les coûts opérationnels et l'impact sur l'environnement.

Cela dit, l'IA elle-même comporte des coûts environnementaux. La puissance de calcul nécessaire à l'apprentissage de grands modèles génère d'importantes émissions de carbone. Les organisations qui recherchent une IA durable doivent prendre en compte l'efficacité des modèles, les sources d'énergie renouvelables pour les centres de données et le bénéfice environnemental net de chaque application.

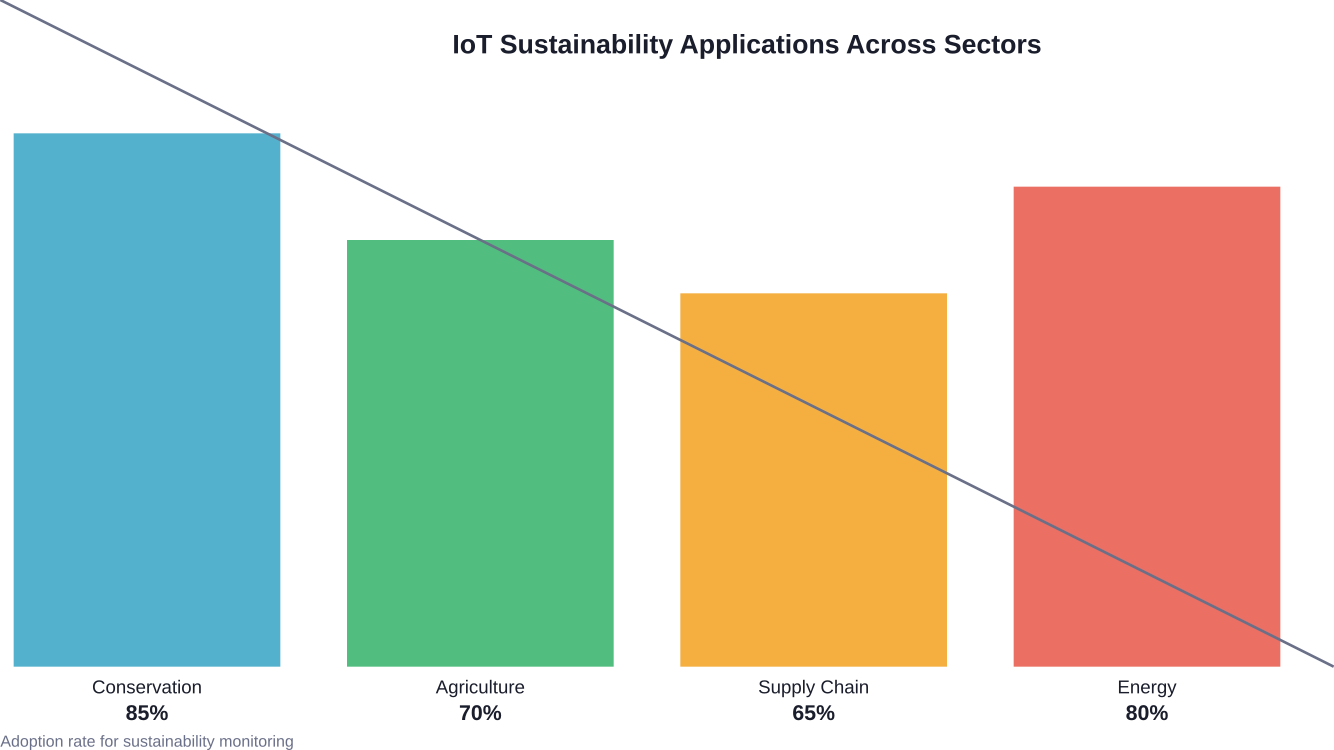

L'internet des objets (IdO) pour la surveillance de l'environnement

Les capteurs IdO fournissent les données en temps réel nécessaires à de nombreuses initiatives en matière de développement durable. Déployés dans les écosystèmes naturels, ces dispositifs surveillent la qualité de l'air, le niveau de l'eau, l'état des sols et les mouvements de la faune avec une granularité sans précédent.

Les efforts de conservation bénéficient énormément de cette capacité de surveillance continue. Les gestionnaires de parcs détectent plus rapidement les activités illégales d'exploitation forestière ou de braconnage. Les gestionnaires des ressources en eau identifient les cas de contamination avant qu'ils ne se propagent. Les exploitations agricoles optimisent l'irrigation en fonction de l'humidité réelle du sol plutôt que des calendriers.

Les applications de l'IdO dans la chaîne d'approvisionnement permettent de suivre les produits tout au long de leur cycle de vie, en contrôlant des conditions telles que la température et l'humidité qui affectent la qualité des produits et les déchets. Les détaillants réduisent la détérioration des denrées périssables. Les fabricants veillent à la bonne manipulation des matériaux sensibles.

La blockchain au service de la transparence de la chaîne d'approvisionnement

Les déclarations de durabilité ne signifient rien sans vérification. La technologie Blockchain crée des enregistrements immuables des parcours des produits, ce qui rend l'écoblanchiment nettement plus difficile.

Les marques de mode utilisent la blockchain pour tracer les vêtements depuis l'approvisionnement en matières premières jusqu'à la fabrication et la distribution. Les consommateurs scannent les codes QR pour vérifier les affirmations concernant le coton biologique, les pratiques de travail équitables ou l'expédition neutre en carbone.

Les chaînes d'approvisionnement alimentaire déploient des systèmes similaires pour suivre les certifications biologiques, les pratiques de pêche durables et le traitement sans cruauté des animaux. La transparence permet de rendre des comptes à chaque étape, de récompenser les pratiques véritablement durables et de mettre en évidence celles qui posent problème.

Les marchés du crédit carbone bénéficient également des capacités de vérification de la blockchain. Les plateformes d'échange enregistrent les réductions d'émissions et les transferts de crédits avec une grande transparence, réduisant ainsi la fraude et augmentant la confiance dans les programmes de compensation.

Informatique en nuage et centres de données

L'infrastructure en nuage permet l'évolutivité et le traitement des données qui alimentent d'autres technologies de développement durable. Mais les centres de données eux-mêmes consomment d'énormes quantités d'énergie.

Les principaux fournisseurs d'informatique en nuage ont réagi en s'engageant à utiliser des énergies renouvelables et à améliorer leur efficacité. La consolidation des charges de travail dans des installations à grande échelle consomme généralement moins d'énergie totale que l'infrastructure distribuée sur site, bien que l'avantage net dépende de circonstances spécifiques.

Les entreprises qui migrent vers des plateformes en nuage devraient évaluer les fournisseurs en fonction de leurs engagements en matière d'énergie renouvelable, de leur efficacité énergétique et de l'emplacement de leurs centres de données. Les choix géographiques influencent à la fois l'intensité carbone de l'électricité et les besoins en refroidissement. Il convient d'évaluer les cotes d'efficacité de l'utilisation de l'énergie lors de la sélection des fournisseurs.

Applications pratiques dans tous les secteurs d'activité

Les différents secteurs sont confrontés à des défis uniques en matière de durabilité, que la transformation numérique aborde de manière spécifique à chaque secteur.

Fabrication et production

La fabrication durable s'appuie sur des jumeaux numériques, c'est-à-dire des répliques virtuelles de systèmes de production physiques qui permettent de tester et d'optimiser sans consommer de ressources. Les ingénieurs simulent les changements de processus, identifient les goulets d'étranglement et prédisent les résultats avant de mettre en œuvre les changements dans les ateliers.

La fabrication additive (impression 3D) réduit le gaspillage de matériaux en construisant des produits couche par couche plutôt qu'en découpant les matériaux excédentaires. Des géométries complexes qui minimisent le poids tout en maintenant la résistance deviennent possibles, ce qui réduit simultanément l'utilisation de matériaux et les émissions dues au transport.

Les systèmes de maintenance prédictive surveillent l'état de l'équipement et programment les réparations avant que les pannes ne se produisent. Cela permet d'éviter les temps d'arrêt non planifiés et l'impact sur l'environnement de pannes d'équipement catastrophiques susceptibles de libérer des matières dangereuses ou de nécessiter des interventions d'urgence gourmandes en énergie.

Énergie et services publics

Les réseaux intelligents représentent peut-être l'application la plus transformatrice de la technologie numérique au développement durable. Ces systèmes équilibrent l'offre et la demande en temps réel, en intégrant les sources renouvelables variables telles que le solaire et l'éolien plus efficacement que les infrastructures traditionnelles.

Les ressources énergétiques distribuées (énergie solaire sur les toits, stockage sur batterie, véhicules électriques) créent des flux d'énergie bidirectionnels qui nécessitent une gestion numérique sophistiquée. Les algorithmes d'IA prédisent les modèles de production et de consommation, optimisent les cycles de charge du stockage et maintiennent la stabilité du réseau.

L'outil Energy Access Explorer du World Resources Institute montre comment les données géospatiales et les plateformes numériques accélèrent la planification de l'accès à l'énergie. Premier bien public numérique dans le domaine de l'énergie, il analyse des informations à haute résolution pour soutenir des décisions d'infrastructure fondées sur des données probantes.

Transport et logistique

Les algorithmes d'optimisation des itinéraires réduisent la consommation de carburant en analysant les schémas de circulation, les fenêtres de livraison et les capacités des véhicules. Les systèmes de gestion de flotte suivent le comportement des conducteurs et identifient les pratiques inefficaces telles que la marche au ralenti excessive ou l'accélération agressive.

L'adoption des véhicules électriques s'accélère à mesure que l'infrastructure de recharge devient plus intelligente. Les programmes de réponse à la demande chargent les véhicules lors des pics de production d'énergie renouvelable, alignant ainsi l'électrification des transports sur la disponibilité des énergies propres.

Les plateformes de mobilité partagée réduisent le nombre total de kilomètres parcourus par les véhicules en mettant en relation les usagers et en optimisant l'utilisation des véhicules. L'avantage en termes de durabilité dépend du déplacement des trajets en voiture particulière plutôt qu'en transport public, ce qui rend les détails de la mise en œuvre essentiels.

Agriculture et systèmes alimentaires

L'agriculture de précision utilise le GPS, des capteurs et l'analyse de données pour appliquer de l'eau, des engrais et des pesticides uniquement là où c'est nécessaire. Cette approche ciblée réduit le ruissellement des produits chimiques, préserve l'eau et réduit les coûts des intrants tout en maintenant ou en améliorant les rendements.

Les systèmes d'agriculture verticale s'appuient sur des capteurs IoT et des contrôles automatisés pour faire pousser des cultures dans des environnements contrôlés, avec une consommation d'eau considérablement réduite et sans besoin de pesticides. Bien qu'elles soient gourmandes en énergie, les installations alimentées par des sources renouvelables peuvent produire des aliments avec un impact environnemental global inférieur à celui de l'agriculture traditionnelle.

La numérisation de la chaîne d'approvisionnement réduit le gaspillage alimentaire en améliorant les prévisions de la demande, en optimisant les niveaux de stock et en coordonnant la récolte avec les besoins du marché. Étant donné que les déchets alimentaires contribuent de manière significative aux émissions mondiales, ces améliorations revêtent une importance considérable pour l'environnement.

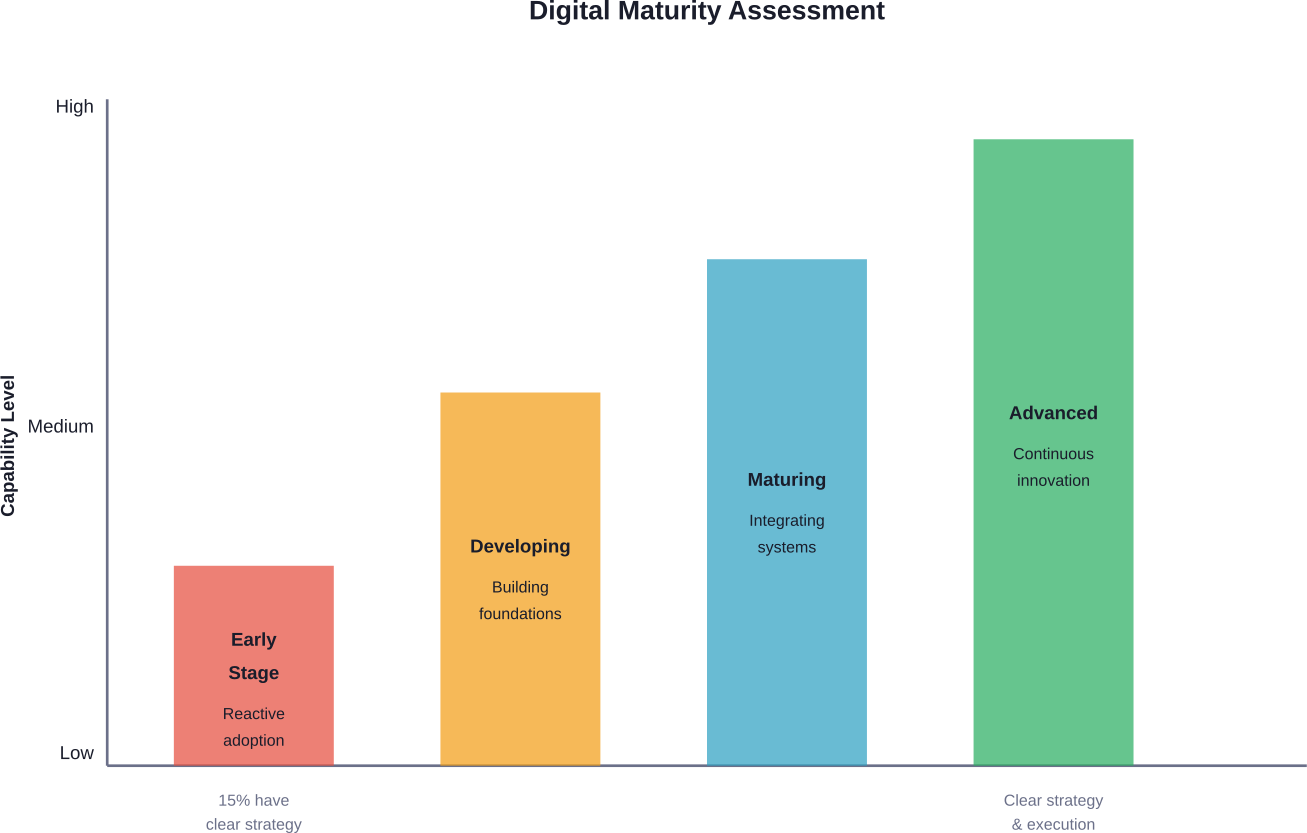

Mesurer et rapporter l'impact sur l'environnement

Une transformation efficace de la durabilité nécessite des mesures rigoureuses. Les outils numériques rendent cette tâche de plus en plus réalisable et normalisée.

La norme ISO 14019-4:2026 traite des principes et des exigences pour les organismes qui valident et vérifient les informations sur le développement durable. Ce cadre soutient la production de rapports environnementaux crédibles alors que les parties prenantes exigent de plus en plus de transparence.

Les plateformes logicielles automatisent désormais la comptabilisation du carbone, en extrayant les données des factures de services publics, des dossiers de voyage, des systèmes d'approvisionnement et des registres de production. Ces outils calculent les émissions des champs d'application 1, 2 et 3 selon des protocoles établis, réduisant ainsi l'effort manuel qui rendait auparavant la comptabilité globale impraticable pour de nombreuses organisations.

Des tableaux de bord en temps réel permettent de suivre les indicateurs de développement durable parallèlement aux indicateurs clés de performance traditionnels, rendant ainsi les performances environnementales visibles pour les décideurs. Cette intégration permet aux considérations de durabilité d'influencer les décisions opérationnelles plutôt que de rester cloisonnées dans des départements spécifiques.

Les initiatives en matière de données ouvertes jouent un rôle crucial dans l'action climatique. Selon l'Institut des ressources mondiales, le partage des données et des informations est essentiel à l'intégration des réponses climatiques au sein des gouvernements et de la société. La publication de données ouvertes permet à la société civile d'exercer un contrôle tout en permettant aux développeurs de créer des outils qui élargissent l'impact et attirent de nouveaux publics.

| Catégorie de mesure | Outils numériques | Principaux indicateurs | Fréquence des rapports |

|---|---|---|---|

| Émissions de carbone | Plateformes comptables automatisées | Émissions des champs d'application 1, 2 et 3 (tCO2e) | Mensuel/trimestriel |

| Consommation d'énergie | Capteurs IoT, systèmes de gestion des bâtiments | kWh total, kWh par unité de production | Temps réel/quotidien |

| Utilisation de l'eau | Compteurs intelligents, capteurs de débit | Gallons totaux, ratios d'intensité de l'eau | Quotidien/hebdomadaire |

| Production de déchets | Logiciel de suivi des déchets, systèmes de pesage | Total des déchets, taux de détournement, recyclage % | Hebdomadaire/mensuel |

| Impact sur la chaîne d'approvisionnement | Plateformes de blockchain, portails de fournisseurs | Émissions et certifications des fournisseurs | Trimestrielle/annuelle |

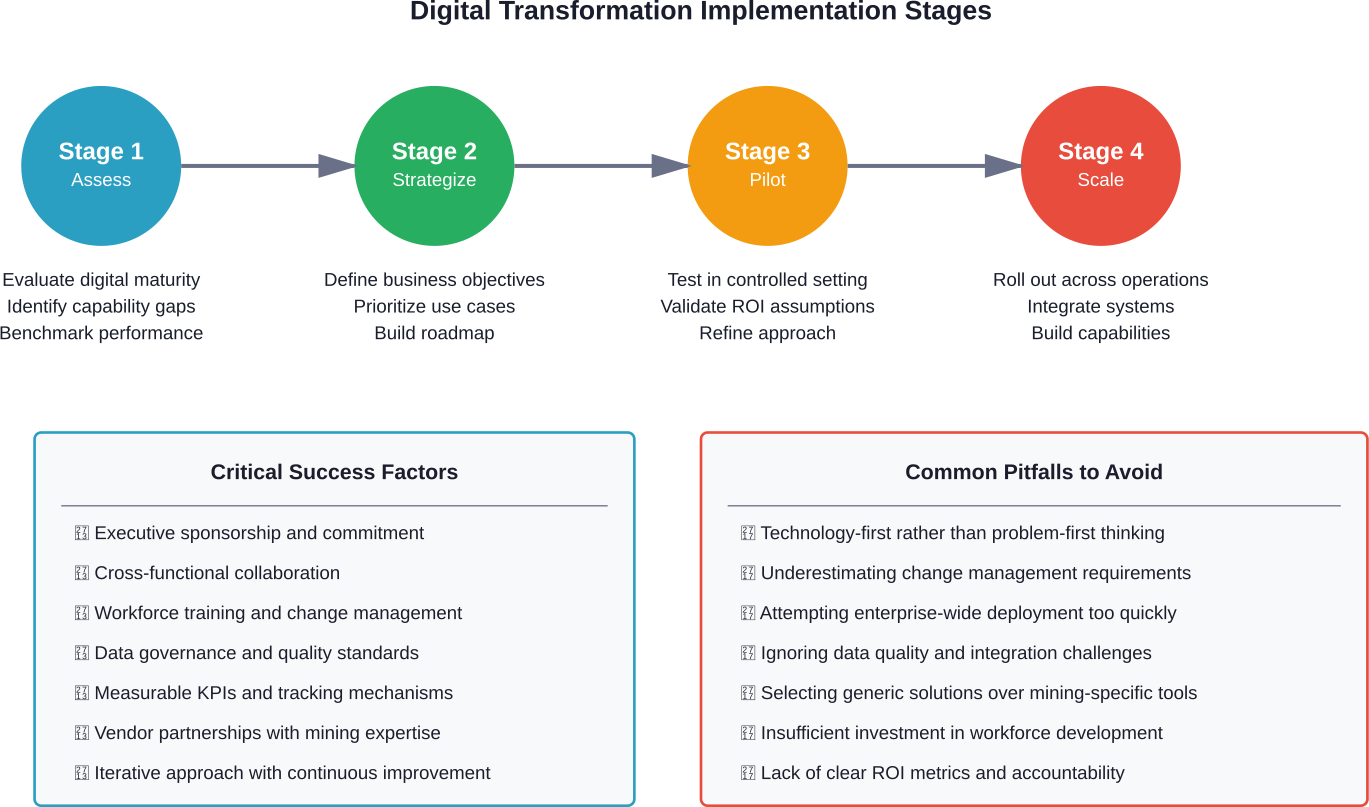

Surmonter les difficultés de mise en œuvre

La transformation numérique pour le développement durable semble convaincante en théorie. Sa mise en œuvre pose de véritables défis que les organisations doivent relever.

Qualité et intégration des données

Les initiatives en matière de développement durable nécessitent souvent l'intégration de données provenant de sources disparates qui n'ont jamais été conçues pour fonctionner ensemble. Les anciens équipements de fabrication, les systèmes de facturation des services publics, les plateformes de gestion des transports et les bases de données d'approvisionnement stockent tous des informations pertinentes dans des formats incompatibles.

Pour résoudre ce problème, il faut investir dans l'infrastructure de données - API, lacs de données, plateformes d'intégration - avant que l'analyse puisse fournir des informations. Les entreprises sous-estiment à la fois la complexité technique et la gestion des changements organisationnels nécessaires pour établir des flux de données de qualité.

Compétences et aptitudes

Une transformation numérique durable et efficace nécessite une expertise hybride : des professionnels qui comprennent à la fois la technologie et la science de l'environnement. Ces personnes restent rares.

Le renforcement des capacités internes par la formation prend du temps. Le partenariat avec des consultants permet de démarrer plus rapidement, mais risque de laisser des lacunes dans les connaissances à la fin de la mission. La plupart des organisations ont besoin d'approches équilibrées combinant une expertise externe pour les mises en œuvre initiales et un développement délibéré des compétences internes.

Justification de l'investissement

Les investissements en faveur du développement durable sont soumis à un examen minutieux en ce qui concerne les rendements financiers. Si certaines initiatives permettent de réaliser des économies évidentes (efficacité énergétique, réduction des déchets), d'autres génèrent surtout des avantages sur le plan de l'environnement et de la réputation.

Le cadrage a une grande importance. Les investissements purement axés sur le développement durable sont soumis à une approbation plus difficile que ceux qui mettent en avant la résilience opérationnelle, la conformité réglementaire, les exigences des clients et le positionnement concurrentiel en même temps que les avantages environnementaux.

Sélection des technologies et verrouillage des fournisseurs

Le paysage technologique du développement durable évolue rapidement. Les solutions qui semblent aujourd'hui à la pointe du progrès peuvent devenir rapidement obsolètes, et la consolidation des fournisseurs crée des risques d'enfermement.

Les organisations devraient privilégier les plateformes dotées d'API ouvertes et de formats de données standard. L'utilisation de systèmes propriétaires crée des dépendances dont il devient coûteux de se défaire au fur et à mesure que les besoins évoluent ou que de meilleures solutions apparaissent.

Normes et cadres émergents

La normalisation aide les organisations à faire face à la complexité et à garantir leur crédibilité. Plusieurs nouveaux cadres traitent spécifiquement de la durabilité numérique.

L'ISO/CEI TS 20125-1:2026 établit des écopratiques pour les services numériques à tous les stades du cycle de vie. Cette spécification technique fournit des lignes directrices sur les principes d'écoconception spécifiquement adaptés aux services de technologies de l'information, en abordant la manière dont les offres numériques peuvent minimiser l'impact sur l'environnement, de la conception à la mise au rebut.

Ces normes sont importantes parce qu'elles créent des langages et des attentes communs. Les fournisseurs et les clients peuvent s'aligner sur les exigences de durabilité sans avoir à négocier des définitions à partir de zéro. Les auditeurs peuvent évaluer les performances en fonction de critères établis plutôt que d'affirmations subjectives.

L'adoption reste volontaire dans la plupart des juridictions, mais les tendances réglementaires suggèrent que l'obligation d'établir des rapports sur le développement durable va se développer. Les organisations qui se dotent aujourd'hui de capacités se positionnent avantageusement pour répondre aux futures exigences de conformité.

Les meilleures pratiques pour réussir

Les organisations qui obtiennent des résultats significatifs partagent des approches communes qui distinguent les mises en œuvre réussies des initiatives ratées.

Commencer par des cas d'utilisation alignés sur l'activité de l'entreprise

Les initiatives numériques les plus réussies en matière de développement durable résolvent des problèmes commerciaux réels tout en apportant des avantages environnementaux. L'optimisation énergétique réduit les coûts. La maintenance prédictive permet d'éviter les temps d'arrêt. La transparence de la chaîne d'approvisionnement permet de gérer le risque de réputation.

En commençant par ces opportunités à double avantage, on crée une dynamique et on s'assure d'un soutien continu. La durabilité pure est difficile à mettre en œuvre lorsque les pressions budgétaires s'accentuent, à moins qu'elle ne soit intégrée dans les opérations de base.

Investir tôt dans l'infrastructure de données

Les organisations qui reportent les investissements dans l'infrastructure de données au profit de déploiements rapides d'applications le regrettent souvent. Les solutions ponctuelles fragmentées créent des cauchemars en matière d'intégration, et il s'avère difficile de reconstruire les fondations tout en maintenant les systèmes opérationnels.

L'investissement initial dans les capteurs, les plateformes de données et les capacités d'intégration permet d'accélérer l'itération des analyses et des applications. L'infrastructure devient un actif qui prend en charge de multiples cas d'utilisation au fil du temps.

Combiner l'expertise interne avec des partenariats externes

Aucune organisation ne possède en interne toutes les capacités nécessaires. Les fournisseurs de technologies, les consultants en développement durable, les consortiums industriels et les chercheurs universitaires apportent tous des perspectives précieuses.

La clé consiste à maintenir une orientation stratégique en interne tout en tirant parti de l'expertise externe sur le plan tactique. Les organisations qui externalisent la réflexion stratégique perdent le contrôle de leurs transformations en matière de durabilité.

Communiquer de manière transparente les progrès et les échecs

Les parties prenantes accordent de plus en plus d'importance à des rapports honnêtes sur le développement durable plutôt qu'à un marketing léché. Les organisations qui reconnaissent les défis et partagent les enseignements tirés de l'expérience acquièrent une crédibilité que les communications purement promotionnelles n'atteignent pas.

La transparence crée également une obligation de rendre compte qui favorise l'obtention de résultats. Les engagements publics assortis de rapports d'avancement réguliers rendent les retours en arrière plus difficiles et permettent de maintenir la priorité des initiatives en cas de pressions concurrentes.

Construire des systèmes numériques durables avec A-listware

Les initiatives en matière de développement durable échouent souvent parce que la technologie qui les sous-tend est fragmentée ou obsolète. La transformation numérique permet d'y remédier en connectant les données, en améliorant la visibilité opérationnelle et en réduisant les inefficacités dans l'ensemble de l'organisation. Les services de transformation numérique d'A-listware se concentrent sur l'analyse des systèmes existants, l'identification des lacunes dans les processus et la mise en œuvre d'améliorations technologiques pratiques qui soutiennent les changements opérationnels à long terme.

A-listware travaille avec des entreprises qui ont besoin de moderniser leur infrastructure, de numériser leurs flux de travail et de construire des systèmes logiciels qui soutiennent les opérations commerciales réelles. Leurs équipes s'occupent de la stratégie, de la mise en œuvre et de l'assistance continue, aidant les organisations à s'éloigner des outils existants et à adopter des plates-formes numériques évolutives qui améliorent l'efficacité et réduisent le gaspillage opérationnel.

Parler à Logiciel de liste A sur votre projet de transformation numérique et voyez où la modernisation peut commencer à produire des résultats mesurables.

Le rôle du numérique dans la réalisation des objectifs de développement

Le développement durable va au-delà des préoccupations environnementales et englobe l'équité sociale, les opportunités économiques et la gouvernance. La transformation numérique influence toutes ces dimensions.

L'accès à l'information permet aux communautés marginalisées de participer aux décisions qui les concernent. Le World Resources Institute souligne que l'adaptation menée localement - où les acteurs locaux détiennent le pouvoir de décision - joue un rôle essentiel dans la réalisation d'une adaptation réussie et durable. Les outils numériques facilitent la participation et le partage des connaissances qui rendent possibles les approches locales.

Le développement économique dépend de plus en plus de l'infrastructure numérique et de l'alphabétisation. La fracture numérique ne représente pas seulement un fossé technologique, mais un obstacle aux opportunités économiques qui perpétue l'inégalité. La transformation numérique durable doit tenir compte de l'accessibilité et de l'inclusion, ainsi que des préoccupations environnementales.

D'une manière générale, les initiatives les plus efficaces tiennent compte à la fois de la durabilité environnementale, sociale et économique, plutôt que d'optimiser une dimension au détriment des autres.

Regarder vers l'avenir : Les tendances qui façonnent l'avenir

Plusieurs tendances émergentes façonneront la manière dont la transformation numérique et la durabilité évolueront ensemble au cours des prochaines années.

Pression réglementaire et divulgation obligatoire

Les rapports volontaires sur le développement durable cèdent la place à des obligations d'information sur les principaux marchés. Ces réglementations exigent des données vérifiées, ce qui favorise l'adoption de technologies de mesure et d'établissement de rapports.

Les organisations qui se dotent aujourd'hui de solides capacités en matière de données sur le développement durable s'adapteront plus facilement à l'élargissement des exigences. Celles qui considèrent les rapports comme des cases à cocher pour se conformer aux exigences auront du mal à faire face à un examen plus approfondi.

Éthique de l'IA et informatique durable

Les coûts environnementaux et sociaux de l'IA font l'objet d'une attention croissante. Les pratiques informatiques durables (optimisation de l'efficacité des algorithmes, utilisation d'énergies renouvelables, prise en compte de la nécessité des modèles) deviendront des attentes standard plutôt que des avantages.

Des cadres d'évaluation de l'impact de l'IA sur le développement durable sont en train de voir le jour. Les organisations qui déploient l'IA à des fins de durabilité doivent s'assurer que les solutions elles-mêmes répondent aux normes de durabilité.

Modèles d'entreprise de l'économie circulaire

Les technologies numériques permettent de nouveaux modèles commerciaux circulaires dans lesquels les entreprises conservent la propriété des produits et des matériaux, en fournissant des services plutôt qu'en vendant des biens. Ces modèles nécessitent un suivi sophistiqué, une logistique inversée et une gestion du cycle de vie que les plateformes numériques facilitent.

Les offres de produits en tant que service alignent les incitations des fournisseurs sur la durabilité et la recyclabilité plutôt que sur l'obsolescence planifiée. La connectivité numérique et les capteurs IoT rendent la surveillance et la maintenance des actifs distribués économiquement réalisables.

Plateformes de collaboration de l'écosystème

Les défis complexes en matière de développement durable dépassent les frontières des organisations individuelles. Les plateformes numériques qui facilitent la collaboration entre les chaînes d'approvisionnement, les industries et les secteurs deviendront de plus en plus importantes.

Les normes de données partagées, les systèmes interopérables et les modèles de gouvernance collaboratifs permettent une coordination que les approches fragmentées ne peuvent pas atteindre. Pour réussir, il faut être prêt à participer à des écosystèmes plutôt qu'à contrôler des solutions propriétaires.

| Tendance | Chronologie | Niveau d'impact | Actions requises |

|---|---|---|---|

| Divulgation obligatoire d'informations ESG | 2026-2028 | Haut | Mettre en œuvre des systèmes de collecte de données vérifiés |

| Expansion de la tarification du carbone | 2026-2030 | Haut | Déployer des outils de comptabilisation et d'optimisation du carbone |

| Normes durables en matière d'intelligence artificielle | 2027-2029 | Moyen | Adopter des pratiques informatiques respectueuses de l'énergie |

| Modèles d'économie circulaire | 2026-2032 | Moyen | Développer des systèmes de suivi et de reprise des produits |

| Plates-formes écosystémiques | 2028-2035 | Moyen | Participer à des initiatives de collaboration avec l'industrie |

Questions fréquemment posées

- Comment la transformation numérique permet-elle de réduire les émissions de carbone ?

Les technologies numériques réduisent les émissions par de multiples mécanismes : optimisation de la consommation d'énergie grâce à l'IA et aux capteurs IoT, possibilité de travail à distance qui élimine les trajets domicile-travail, amélioration de l'efficacité logistique pour réduire la consommation de carburant des transports, et facilitation de l'intégration des énergies renouvelables grâce aux réseaux intelligents. Le secteur manufacturier bénéficie des jumeaux numériques qui réduisent le gaspillage et de la maintenance prédictive qui prévient les pannes consommatrices de ressources. Le Forum économique mondial estime que ces technologies pourraient réduire les émissions mondiales de 20 % d'ici à 2050.

- Quels sont les coûts environnementaux de la transformation numérique elle-même ?

Les technologies numériques ont leur propre empreinte environnementale. Les centres de données consomment beaucoup d'électricité, l'intensité en carbone dépendant des sources d'énergie. La fabrication de matériel informatique nécessite l'extraction et la transformation de matières premières. L'empreinte carbone du secteur numérique dépasse déjà celle de l'aviation. Les déchets électroniques posent des problèmes d'élimination. Les organisations doivent évaluer l'impact net sur l'environnement, en veillant à ce que les solutions de développement durable offrent des avantages supérieurs à leurs propres coûts. Les pratiques informatiques durables, les engagements en matière d'énergie renouvelable et les modèles de matériel circulaire contribuent à répondre à ces préoccupations.

- Quels sont les secteurs qui bénéficient le plus des initiatives numériques en matière de durabilité ?

Les industries à forte consommation d'énergie bénéficient de retombées particulièrement importantes : l'industrie manufacturière, les transports, l'agriculture et l'exploitation des bâtiments. Ces secteurs consomment des ressources considérables et leur optimisation a un impact mesurable. Cependant, toutes les industries sont confrontées à des pressions en matière de développement durable. Les entreprises de vente au détail et de biens de consommation utilisent des outils numériques pour la transparence de la chaîne d'approvisionnement. Les services financiers les appliquent à l'évaluation des risques ESG. Le secteur de la santé tire parti de la télésanté pour réduire la consommation d'énergie des installations. Les applications spécifiques varient, mais des opportunités existent dans tous les secteurs.

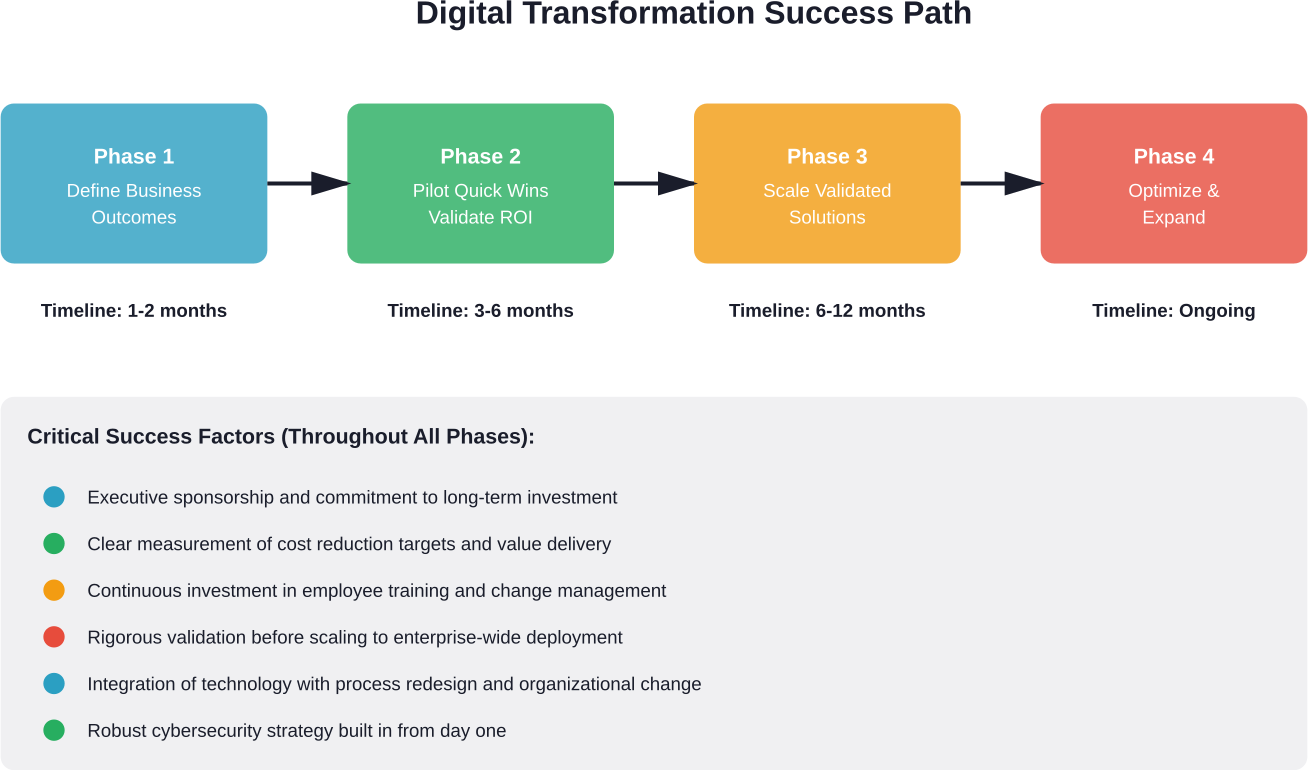

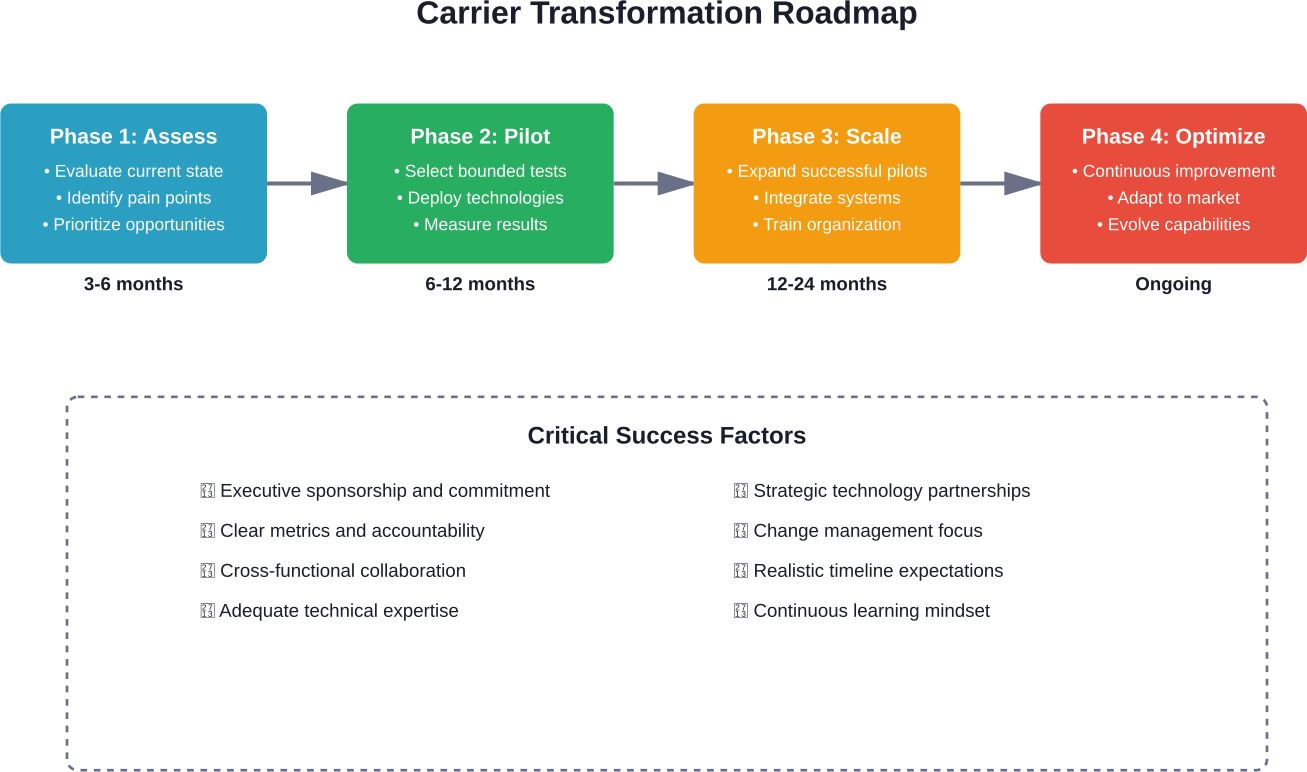

- Combien de temps faut-il pour mettre en œuvre la transformation numérique de la durabilité ?

Le calendrier dépend de la portée et du point de départ. Les évaluations initiales et les projets pilotes nécessitent généralement 6 à 12 mois. La mise en place d'une infrastructure de données et de capacités s'étend sur 12 à 24 mois. La transformation à l'échelle de l'entreprise s'étend sur 3 à 5 ans. Les organisations doivent s'attendre à une mise en œuvre progressive plutôt qu'à des résultats instantanés. Les gains rapides en matière de gestion de l'énergie ou de réduction des déchets peuvent apporter de la valeur en quelques mois, tandis que la transparence globale de la chaîne d'approvisionnement ou les modèles d'entreprise circulaires nécessitent des engagements sur plusieurs années. Commencer par des initiatives ciblées qui s'étendent au fil du temps s'avère plus fructueux que de tout tenter simultanément.

- Quelles sont les compétences dont les équipes ont besoin pour une transformation numérique durable ?

Pour réussir, il faut des capacités hybrides couvrant les domaines de la technologie et du développement durable. Les scientifiques des données qui comprennent les mesures environnementales, les professionnels du développement durable à l'aise avec les outils numériques et les chefs d'entreprise qui intègrent les deux perspectives dans la stratégie. Les compétences techniques spécifiques comprennent le déploiement de l'IdO, l'analyse des données, les logiciels de comptabilisation du carbone et les plateformes d'intégration. De nombreuses organisations peinent à trouver des personnes possédant des ensembles de compétences complets, ce qui rend les programmes de formation et la collaboration interfonctionnelle essentiels. Les partenariats avec des consultants spécialisés et des fournisseurs de technologies peuvent compléter les capacités internes pendant le développement des compétences.

- Comment les organisations mesurent-elles le retour sur investissement des technologies de développement durable ?

La mesure du rendement nécessite des cadres plus larges que les seuls indicateurs financiers traditionnels. Les économies directes réalisées grâce à la réduction de l'énergie, des matériaux et des déchets constituent un rendement quantifiable. La valeur de l'atténuation des risques provient de la conformité réglementaire, de la résilience de la chaîne d'approvisionnement et de la protection de la réputation. Les opportunités de revenus émergent de la différenciation durable des produits et de l'accès à de nouveaux marchés. Les avantages liés à l'attraction et à la fidélisation des employés ont des répercussions financières mesurables. Les organisations les plus performantes utilisent des tableaux de bord équilibrés qui intègrent des indicateurs de performance environnementale parallèlement à des mesures financières, reconnaissant que certains investissements dans le développement durable génèrent une valeur stratégique qui n'est pas prise en compte dans les calculs de retour sur investissement à court terme.

- Quelles normes les organisations doivent-elles respecter pour établir leurs rapports sur le développement durable ?

De nombreux cadres guident la divulgation d'informations sur le développement durable. La norme ISO 14019-4:2026 traite de la validation et de la vérification des informations relatives au développement durable. Le protocole GHG fournit des normes de comptabilisation du carbone largement utilisées pour la déclaration des émissions. Les recommandations de la TCFD structurent les informations financières liées au climat. Les normes de la SASB se concentrent sur les sujets de durabilité financièrement significatifs par secteur d'activité. Les organisations adoptent de plus en plus souvent des cadres multiples, car les parties prenantes font référence à des normes différentes. La spécification technique ISO/IEC TS 20125-1:2026 traite spécifiquement de l'écoconception des services numériques. Les exigences réglementaires dans certaines juridictions peuvent imposer des cadres particuliers, d'où l'importance de l'évaluation du paysage de la conformité.

Conclusion

La transformation numérique et la durabilité ne sont pas des initiatives distinctes qui se disputent les ressources et l'attention. Ce sont des forces complémentaires que les organisations doivent intégrer pour rester compétitives et responsables.

Les technologies permettant la transformation numérique - IA, IoT, blockchain, informatique en nuage - fournissent les capacités nécessaires pour mesurer, gérer et réduire l'impact environnemental à des échelles auparavant impossibles. Parallèlement, les impératifs de durabilité stimulent l'innovation dans les solutions numériques, poussant au développement d'une informatique économe en énergie, de chaînes d'approvisionnement transparentes et de modèles commerciaux circulaires.

Les organisations qui traitent ces questions comme des stratégies unifiées se positionnent pour une réussite à long terme. Celles qui poursuivent la transformation numérique sans tenir compte de la durabilité accumulent une dette environnementale et un risque réglementaire. Celles qui poursuivent le développement durable sans passer par le numérique ne disposent pas des données, de l'automatisation et des capacités d'optimisation qui permettent d'atteindre des objectifs ambitieux.

La voie à suivre exige une évaluation honnête des capacités actuelles, un investissement stratégique dans l'infrastructure de données, des projets pilotes ciblés qui apportent une valeur commerciale et environnementale, et un engagement soutenu face aux défis inévitables. Des normes comme ISO 14019-4:2026 et ISO/IEC TS 20125-1:2026 fournissent des cadres pour une mise en œuvre et des rapports crédibles.

Commencez par identifier les domaines dans lesquels les technologies numériques peuvent résoudre les problèmes réels de l'entreprise tout en faisant progresser les objectifs de durabilité. Construire la base de données qui permet la mesure et l'optimisation. Établir des partenariats stratégiques pour accéder à des capacités dépassant l'expertise interne. Communiquer les progrès de manière transparente afin de renforcer la confiance des parties prenantes.

La convergence de la transformation numérique et de la durabilité représente l'un des défis et l'une des opportunités commerciales déterminants de cette décennie. Les organisations qui agissent de manière décisive façonneront les réponses de leurs industries tout en construisant des opérations résilientes et responsables positionnées pour un succès à long terme.

Prêt à entamer votre parcours de transformation numérique durable ? Commencez par une évaluation de base de votre impact environnemental actuel et identifiez les opportunités à plus forte valeur ajoutée pour lesquelles les technologies numériques peuvent apporter des améliorations mesurables.