Résumé rapide : Digital transformation in construction involves integrating advanced technologies like BIM, IoT, AI, and digital twins to modernize traditionally manual processes. The $12 trillion construction industry is undergoing a major shift, with $50 billion in software investments driving improvements in productivity, safety, and project efficiency, despite facing a 40% productivity decline over the past 50 years and persistent labor shortages.

The construction industry stands at a crossroads. While most sectors have embraced digital innovation over the past two decades, construction has remained stubbornly analog. But that’s changing fast.

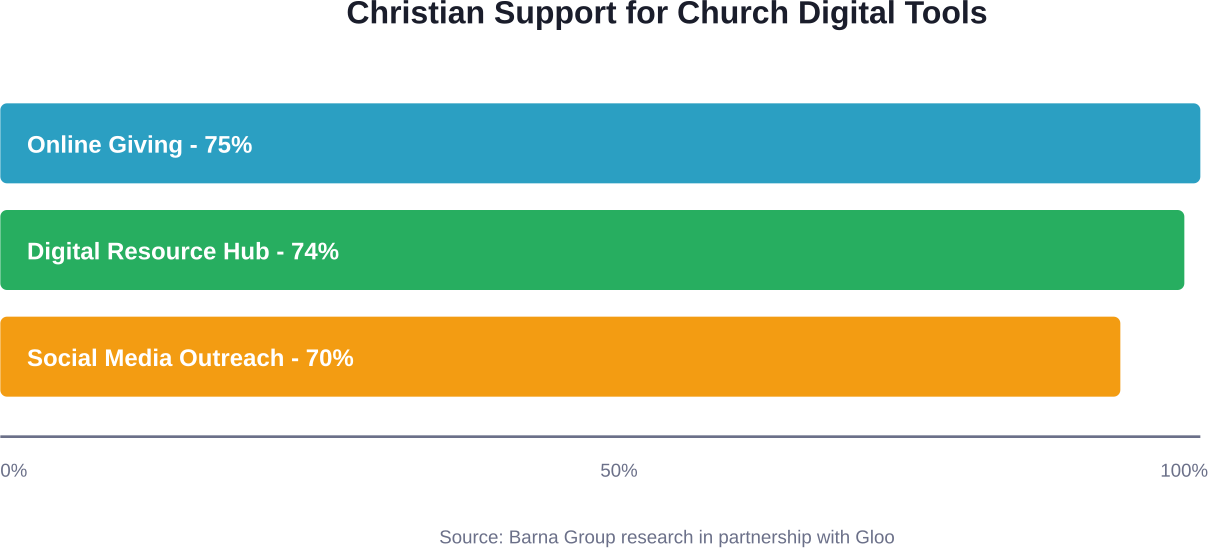

According to McKinsey, the construction sector represents roughly $12 trillion globally and ranks among the least digitized industries. Yet a $50 billion wave of investment in construction technology is now reshaping how projects are planned, managed, and executed.

Here’s the thing though—this transformation isn’t optional anymore. The numbers tell a stark story: while productivity across the U.S. economy has doubled over the past 50 years, construction productivity has actually declined by 40%, according to a 2023 University of Chicago study. That’s not a typo. Construction is getting less efficient while everything else speeds up.

Why Construction Has Resisted Digital Transformation

Construction’s slow technology adoption isn’t accidental. The industry faces unique challenges that make digitization harder than in other sectors.

Project-based work creates fragmented systems. Every construction project involves different teams, locations, and requirements. Building a standardized digital infrastructure across this variability proves difficult.

The workforce issue compounds the problem. According to the Associated General Contractors of America (AGC), 88 percent of construction firms report difficulty filling open positions. When companies struggle to find workers, investing in digital training becomes a secondary concern.

Legacy systems create another barrier. Many construction firms still rely on paper-based processes and disconnected software tools. The National Institute of Standards and Technology (NIST) highlights that supporting digital transformation while maintaining legacy components requires careful planning around cybersecurity and operational technology environments.

But the construction industry can’t afford to wait anymore.

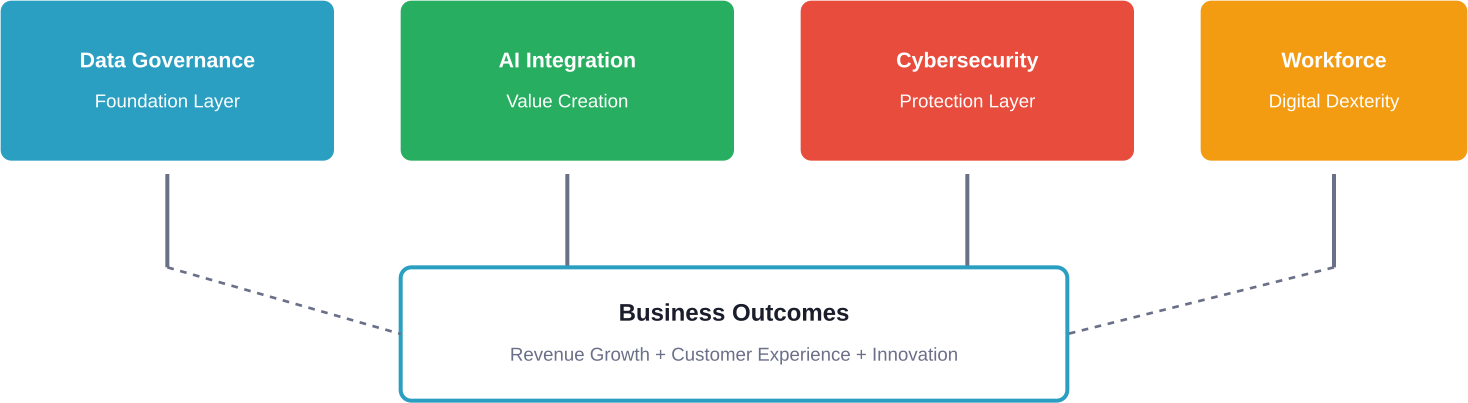

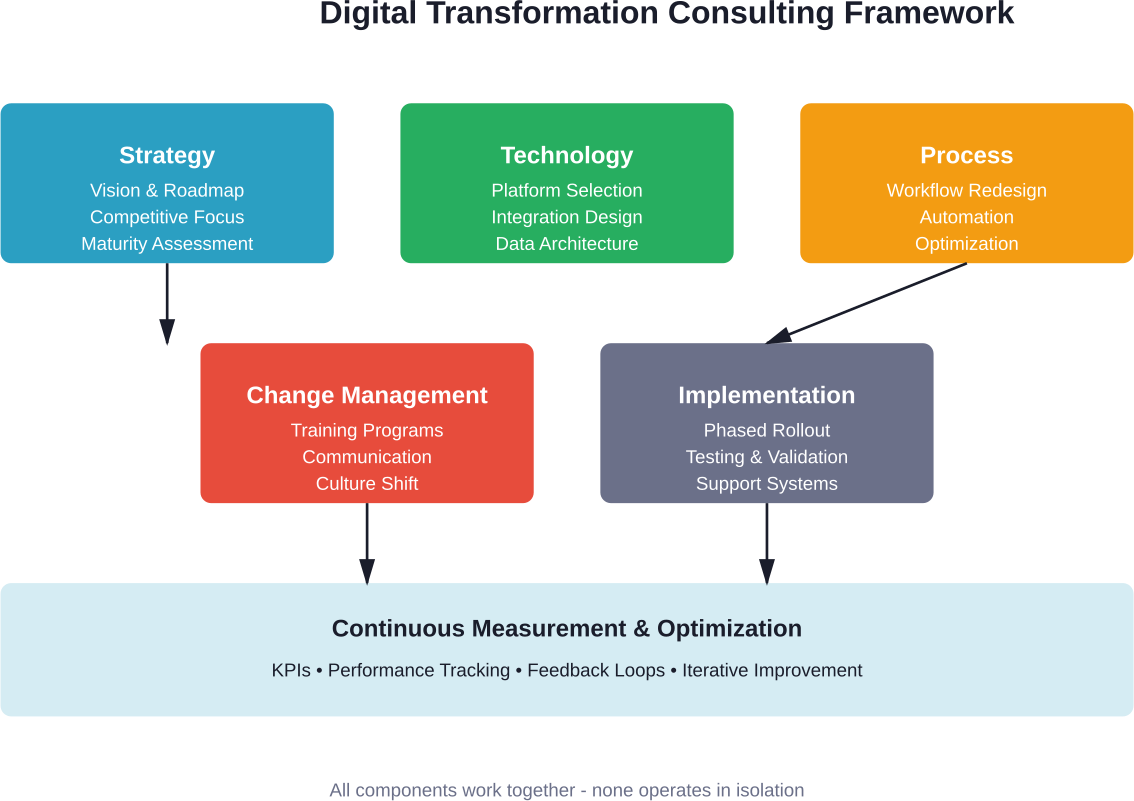

What Digital Transformation Means for Construction

Digital transformation in construction goes beyond simply buying new software. It represents a fundamental shift in how projects are conceived, planned, executed, and maintained.

At its core, construction digital transformation involves integrating data, processes, and technologies across the entire project lifecycle. This means connecting design, procurement, construction, and facility management through digital platforms.

According to NIST research on digital twins, these technologies serve as a foundation for achieving smart manufacturing and construction. Digital twins create virtual replicas of physical assets, allowing teams to simulate, predict, and optimize performance before breaking ground.

The transformation touches every aspect of construction operations:

- Design and planning shift from 2D drawings to 3D Building Information Modeling (BIM)

- Project management moves from spreadsheets to integrated digital platforms

- Communication evolves from emails and phone calls to real-time collaboration tools

- Quality control transitions from manual inspections to sensor-based monitoring

- Safety protocols incorporate wearable technology and IoT devices

Real talk: this isn’t just about efficiency. It’s about survival in an increasingly competitive market where margins are tight and client expectations keep rising.

Key Technologies Driving Construction Digitization

Several core technologies are pushing construction into the digital age. Each plays a distinct role in modernizing operations.

Modélisation des données du bâtiment (BIM)

BIM creates intelligent 3D models that contain more than just geometry. These models include data about materials, costs, schedules, and performance characteristics.

Teams can detect clashes between different building systems before construction begins. This prevents costly rework and delays on site.

Internet of Things (IoT) and Sensors

Connected sensors now monitor everything from concrete curing conditions to equipment utilization rates. Wearable devices track worker location and vital signs to improve safety.

These devices generate massive amounts of data that inform real-time decision-making. Temperature sensors ensure materials are installed in optimal conditions. GPS trackers prevent equipment theft and optimize fleet management.

Intelligence artificielle et apprentissage automatique

AI applications in construction range from predictive maintenance to autonomous equipment operation. NIST’s AI for Building Systems Innovation (AIBSI) Program focuses on developing measurement science to improve building operations through AI-enabled systems while ensuring cyber-security and reliability.

Machine learning algorithms analyze historical project data to predict delays, cost overruns, and safety incidents. This allows proactive intervention before problems escalate.

Jumeaux numériques

According to NIST’s 2024 research on Manufacturing Digital Twin Standards, digital twins are critical for achieving smart manufacturing and construction. These virtual replicas sync with physical assets throughout their lifecycle.

Construction companies use digital twins to test different construction sequences, identify bottlenecks, and optimize resource allocation. After project completion, facility managers use these twins for predictive maintenance and energy optimization.

Cloud-Based Collaboration Platforms

Cloud technology enables distributed teams to access project information from anywhere. Architects, engineers, contractors, and owners work from a single source of truth rather than passing files back and forth.

Version control problems disappear. Communication becomes transparent. Decision-making accelerates.

Modernize Construction Systems With A-listware

Construction companies often need better software for planning, coordination, reporting, and daily operations. Logiciel de liste A provides software development, IT consulting, infrastructure services, cybersecurity, data analytics, and dedicated development teams. The company can help construction businesses build custom software, update legacy systems, and add engineering support for digital projects.

Need Development Support for Construction Software?

Discutez avec A-listware pour :

- build custom tools for internal and operational workflows

- modernize outdated systems that slow teams down

- ajouter des développeurs, des spécialistes DevOps, des données ou de la sécurité.

Commencez par demander une consultation avec A-listware.

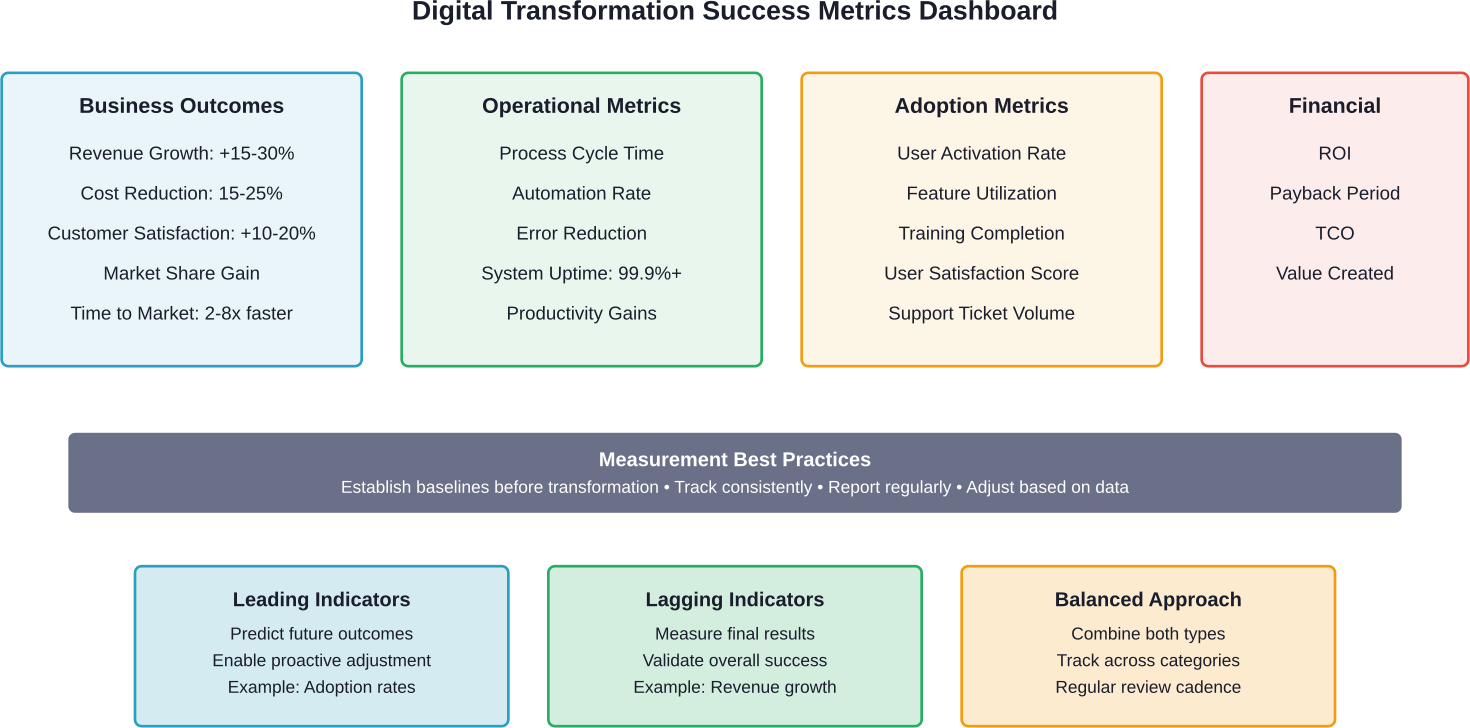

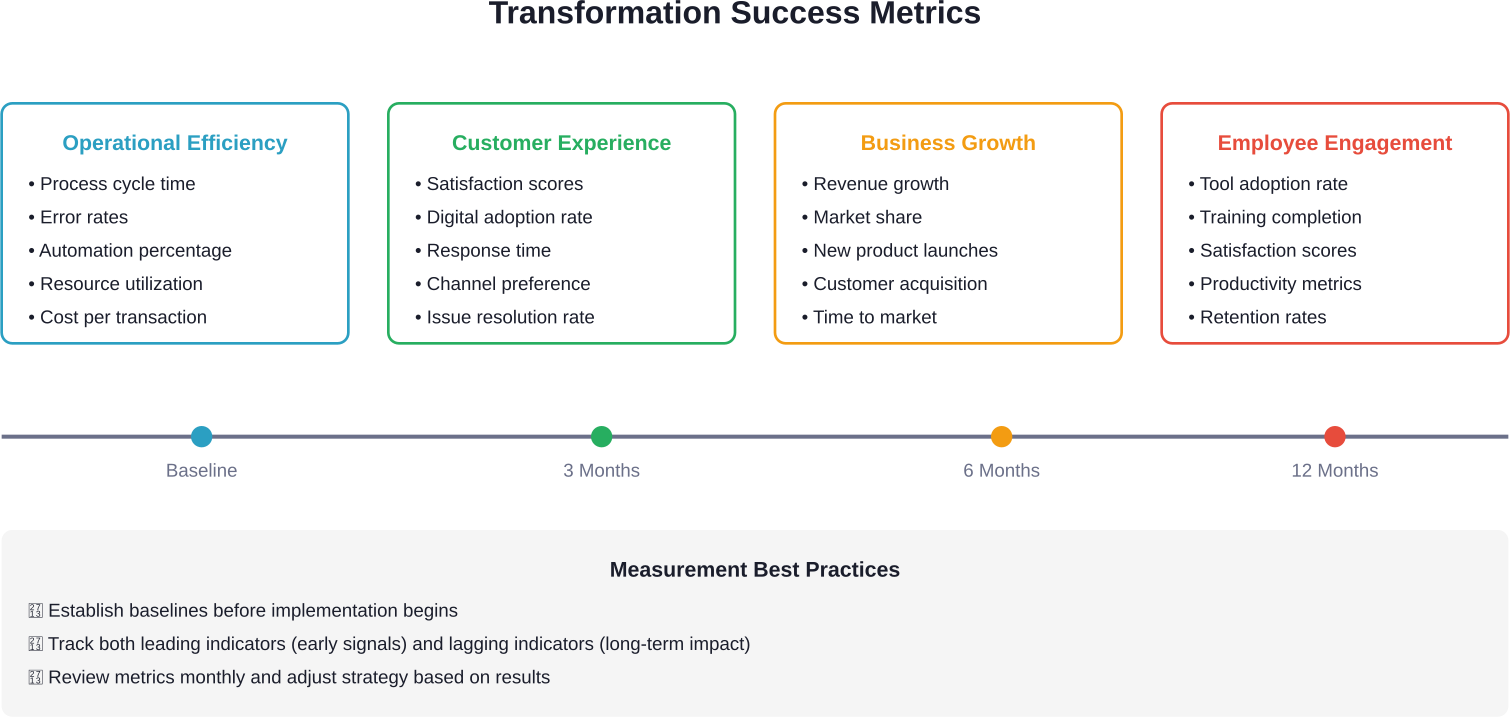

Measurable Benefits of Digital Transformation

The business case for construction digitization rests on concrete improvements across multiple dimensions.

Productivité accrue

Research indicates that companies adopting digital tools experience a 34% improvement in productivity. Automation eliminates repetitive manual tasks. Digital workflows reduce time spent searching for information or waiting for approvals.

But wait. How does this translate to actual project outcomes?

Projects completed with integrated digital tools typically finish faster. Teams identify and resolve issues during planning rather than during construction when changes cost exponentially more.

Improved Safety Performance

Construction remains one of the most dangerous industries. Digital technologies are changing that equation.

Wearable sensors detect fatigue, heat stress, and proximity to hazards. Virtual reality training allows workers to practice dangerous tasks in safe environments. Drones inspect high-risk areas without putting people in harm’s way.

The data captured by these systems also helps identify patterns that lead to incidents, enabling proactive safety improvements.

Better Customer Experience

Digital adoption drives a 33% improvement in customer experience, according to recent research. Clients gain visibility into project progress through dashboards and virtual walkthroughs.

Communication becomes more transparent. Issues get addressed faster. The final product aligns more closely with client expectations because digital models eliminate ambiguity about design intent.

Cost Control and Predictability

Digital tools provide real-time visibility into project costs. Teams can track spending against budgets continuously rather than discovering overruns months later.

Predictive analytics identify cost risks early. Automated quantity takeoffs from BIM models reduce estimation errors. Digital procurement platforms expand vendor options and improve pricing transparency.

| Benefit Category | Impact typique | Technologies clés |

|---|---|---|

| Productivity Enhancement | 34% improvement | BIM, Cloud Platforms, Automation |

| Expérience client | Amélioration 33% | Visualization Tools, Dashboards, Mobile Apps |

| Safety Performance | Significant reduction in incidents | IoT Wearables, Drones, VR Training |

| Cost Predictability | Reduced overruns | Digital Twins, Predictive Analytics, BIM |

| Schedule Adherence | Faster completion times | Project Management Software, AI Planning |

Major Challenges Blocking Digital Adoption

Despite clear benefits, construction companies face significant obstacles when implementing digital transformation.

Workforce Skill Gaps

The AGC survey revealing that 88 percent of firms struggle to fill positions highlights a fundamental problem. Companies can’t find enough workers with traditional skills, let alone digital expertise.

Training existing workers takes time and money. Many experienced tradespeople resist learning new tools, preferring methods they’ve used for decades.

Complexité de l'intégration

Construction projects involve dozens of different software systems. Getting these tools to communicate requires significant technical effort.

NIST research on the Digital Thread for Manufacturing emphasizes the importance of product-definition standardization and conformance testing. Without common data standards, integration becomes a custom engineering project for every connection.

Risques liés à la cybersécurité

As construction systems become more connected, they become more vulnerable. NIST’s work on cybersecurity for industrial control systems and operational technology environments highlights the risks.

La construction

Many construction firms lack dedicated cybersecurity expertise, making them attractive targets for attacks.

High Initial Investment

Digital transformation requires capital. Software licenses, hardware, training, and implementation support all cost money.

For smaller contractors operating on thin margins, finding the budget for digital investment proves difficult. The return on investment, while real, takes time to materialize.

Résistance culturelle

Construction culture values hands-on experience and proven methods. Proposing radical changes to workflows meets skepticism.

Project managers who’ve successfully delivered projects for years question why they should change. Without executive-level commitment, digital initiatives stall in the face of this resistance.

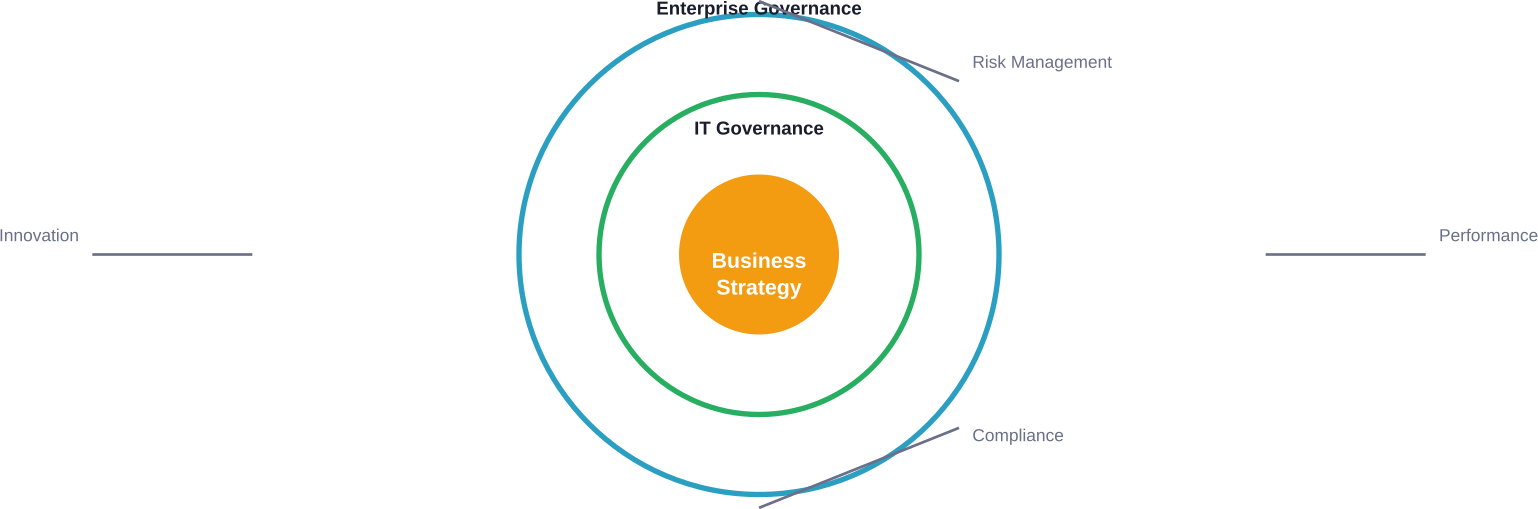

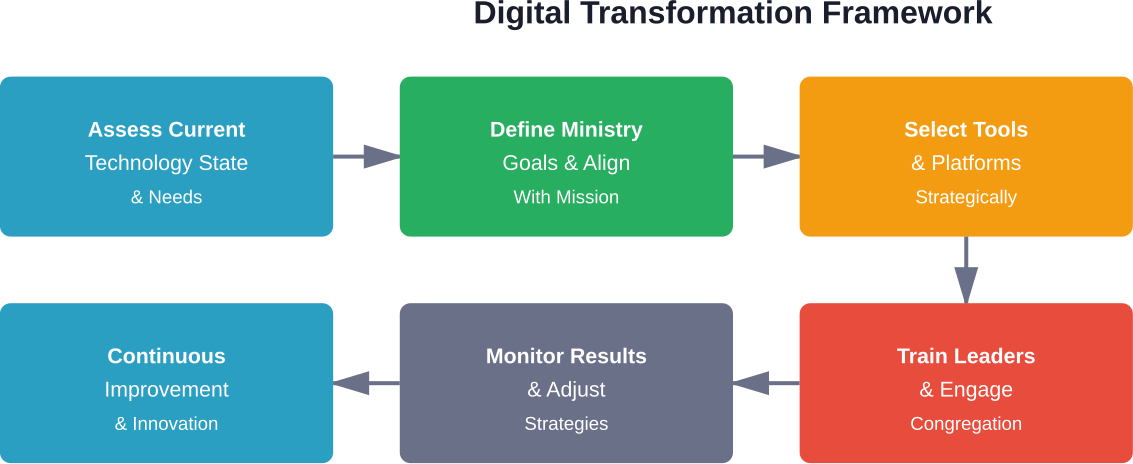

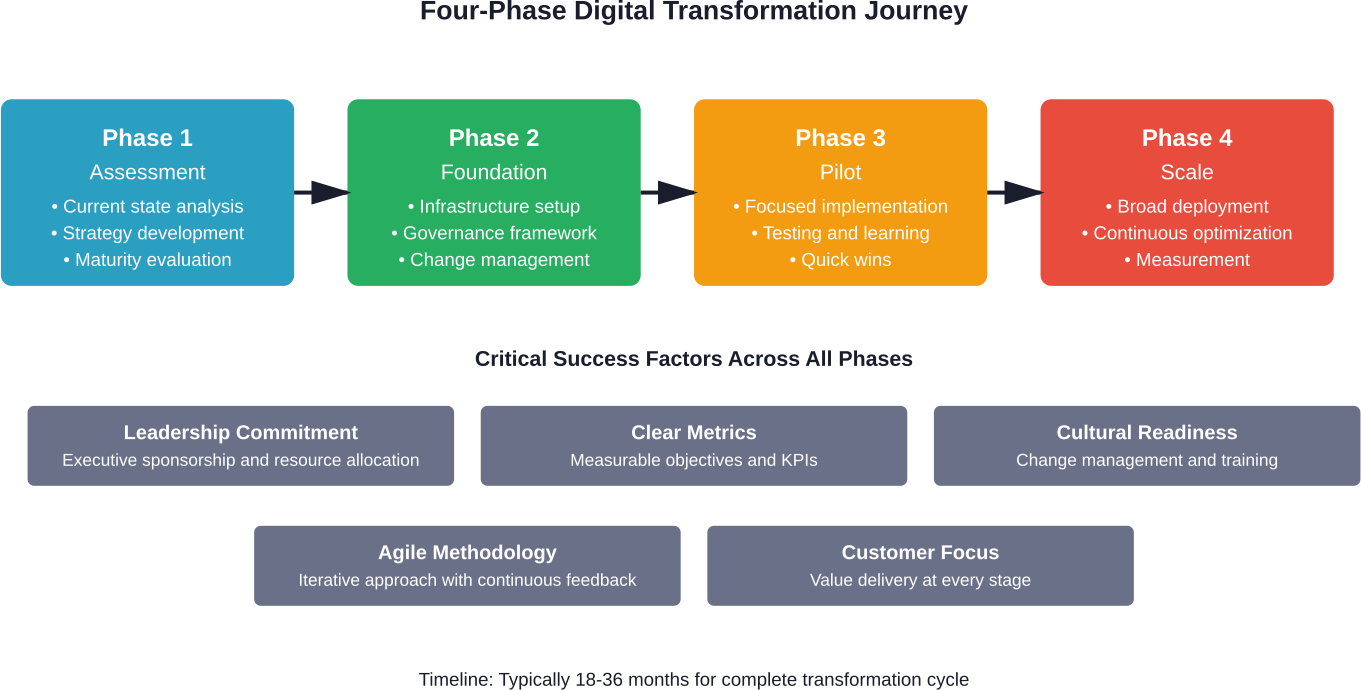

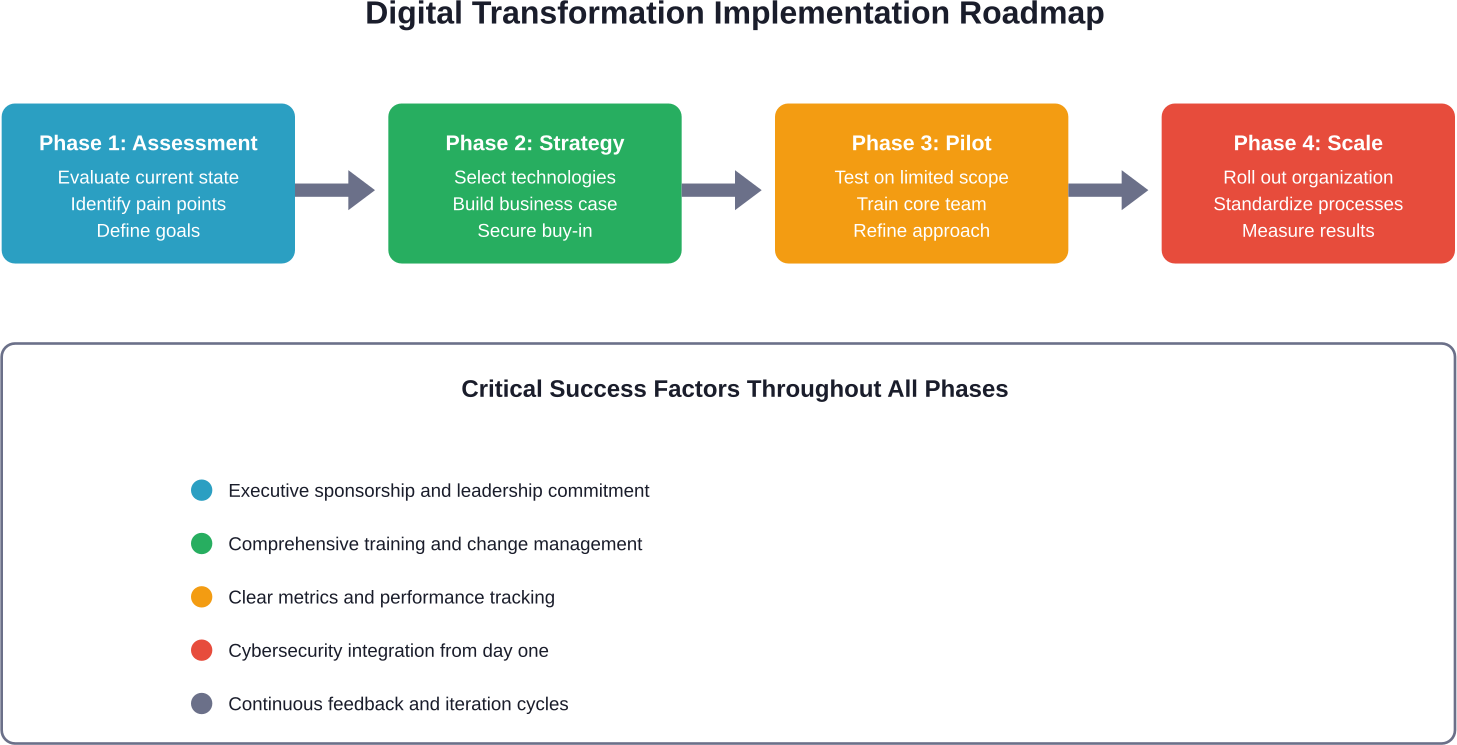

Strategies for Successful Implementation

Construction firms that successfully navigate digital transformation follow common patterns.

Start With Clear Business Objectives

Digital transformation should solve specific business problems, not chase technology trends. The most successful implementations begin by identifying concrete goals.

Is the primary concern project delays? Cost overruns? Safety incidents? Quality defects? Different problems require different technological solutions.

Pilot Before Scaling

Testing new technologies on a single project limits risk. Teams can learn, make mistakes, and refine processes before company-wide rollout.

Select a pilot project that’s important enough to get attention but not so critical that failure creates catastrophic consequences. Document lessons learned systematically.

Investir dans la formation et la gestion du changement

Technology alone doesn’t transform anything. People transform how work gets done.

Comprehensive training programs must accompany new tool deployments. This includes not just technical training on software features, but also education on why changes matter and how they benefit individuals.

Change management addresses the cultural and behavioral shifts required. This means communicating vision, celebrating early wins, and addressing concerns transparently.

Prioritize Data Standards and Interoperability

Following NIST guidance on digital threads and standardization prevents future integration headaches. Establishing data standards upfront enables tools to communicate.

When evaluating software, prioritize solutions with open APIs and support for industry standards like IFC for BIM data exchange.

Build Cybersecurity In, Not On

Security can’t be an afterthought. NIST’s emphasis on cybersecurity for operational technology environments applies directly to construction.

Implement security controls during initial deployment. This includes access management, encryption, network segmentation, and incident response planning.

The Evolving Role of Construction Professionals

Digital transformation fundamentally changes what construction managers and workers do daily.

Construction managers increasingly need data analysis skills. Reading dashboards, interpreting predictive models, and making data-driven decisions become core competencies.

Field workers interact with tablets and sensors rather than just tools and materials. Understanding digital workflows and contributing data back into systems becomes part of the job.

New roles emerge. BIM managers coordinate digital models across disciplines. Data analysts identify patterns in project performance. Digital transformation specialists guide technology adoption.

The AGC findings about labor shortages create urgency around these transitions. Technology can partially offset workforce gaps by making remaining workers more productive.

Looking Ahead: The Future of Construction Technology

Current trends point toward even more radical changes ahead.

Autonomous Construction Equipment

Self-driving excavators, automated bricklaying robots, and drone surveys are moving from experiments to operational deployment. These technologies address labor shortages while improving precision and safety.

Advanced Materials and 3D Printing

3D-printed buildings shift construction from assembly to manufacturing. This enables complex geometries impossible with traditional methods while reducing material waste.

Augmented Reality for Field Work

AR headsets overlay digital information onto physical environments. Workers see exactly where components should be installed, identify conflicts in real-time, and access documentation hands-free.

Blockchain for Contract Management

Distributed ledger technology promises to streamline payment processing, verify material provenance, and create tamper-proof project records.

Generative Design

AI systems explore thousands of design alternatives based on project constraints and goals. Architects and engineers guide the process rather than creating every element manually.

Sound familiar? These weren’t realistic five years ago. The pace of change continues accelerating.

Questions fréquemment posées

- What is digital transformation in construction?

Digital transformation in construction refers to integrating digital technologies across all aspects of construction operations—from design and planning through execution and facility management. This includes adopting tools like BIM, IoT sensors, AI, cloud platforms, and digital twins to modernize traditionally manual processes and improve project outcomes.

- Why has construction been slow to adopt digital technologies?

Construction faces unique challenges including project-based fragmentation, workforce skill gaps with 88% of firms reporting hiring difficulties, reliance on legacy systems, high upfront technology costs, and cultural resistance to change. The industry’s complex supply chains and thin profit margins make large technology investments risky.

- What are the main benefits of digital transformation for construction companies?

Companies adopting digital tools report 34% productivity improvements and 33% better customer experience. Additional benefits include enhanced safety through wearable technology and monitoring systems, improved cost predictability via real-time tracking, faster project completion through better planning, and reduced rework from clash detection in digital models.

- How much does digital transformation cost for a construction company?

Costs vary widely based on company size, chosen technologies, and implementation scope. Investment includes software licenses, hardware, training, consulting support, and integration work. Many companies start with pilot projects on single initiatives to limit initial spend while demonstrating value before larger investments.

- What role do digital twins play in construction?

According to NIST research, digital twins serve as a foundation for smart construction by creating virtual replicas of physical assets. Construction teams use these models to simulate construction sequences, identify bottlenecks, optimize resource allocation, and test scenarios before implementation. After completion, facility managers use digital twins for predictive maintenance and performance optimization.

- How does digital transformation improve construction safety?

Digital technologies enhance safety through multiple mechanisms: wearable sensors detect fatigue, heat stress, and proximity to hazards; VR training allows practice of dangerous tasks in safe environments; drones inspect high-risk areas without human exposure; and data analytics identify incident patterns enabling proactive interventions.

- What skills do construction workers need for digital transformation?

Modern construction professionals need a blend of traditional trade skills and digital competencies. This includes basic software literacy, ability to work with tablets and mobile devices, understanding of digital workflows, data entry and quality practices, and willingness to adapt to new tools. Construction managers additionally need data analysis and interpretation skills.

Passer à l'étape suivante

The construction industry stands at an inflection point. Digital transformation isn’t coming—it’s here.

Companies that embrace this shift gain competitive advantages in productivity, safety, quality, and customer satisfaction. Those that resist face mounting challenges as project complexity increases and skilled labor becomes scarcer.

But digital transformation doesn’t happen overnight. It requires strategic planning, committed leadership, substantial investment, and cultural change. The key is starting somewhere.

Begin with assessment. Where do current processes create the most pain? What problems cost the most money or time? Which challenges threaten project success most often?

Then prioritize solutions that address those specific issues. Test on limited scope. Learn. Iterate. Scale what works.

The $12 trillion construction industry will look radically different in five years than it does now. Technology adoption is accelerating. Companies making the transition now will shape the industry’s future. Those waiting risk becoming obsolete.

The choice is clear. The question is simply how fast you’ll move.