Короткий виклад: Цифрова трансформація у сфері охорони здоров'я використовує такі технології, як штучний інтелект, інтернет речей та аналіз даних, для покращення епіднагляду за захворюваннями, забезпечення рівності у сфері охорони здоров'я та покращення показників здоров'я населення. ВООЗ визначає її як життєво важливу для досягнення загального охоплення послугами охорони здоров'я, а успішні впровадження демонструють підвищення ефективності та зниження витрат. Однак, щоб уникнути збільшення нерівності у сфері охорони здоров'я, необхідно вирішити проблеми, пов'язані з управлінням даними, справедливістю та стійкою інфраструктурою.

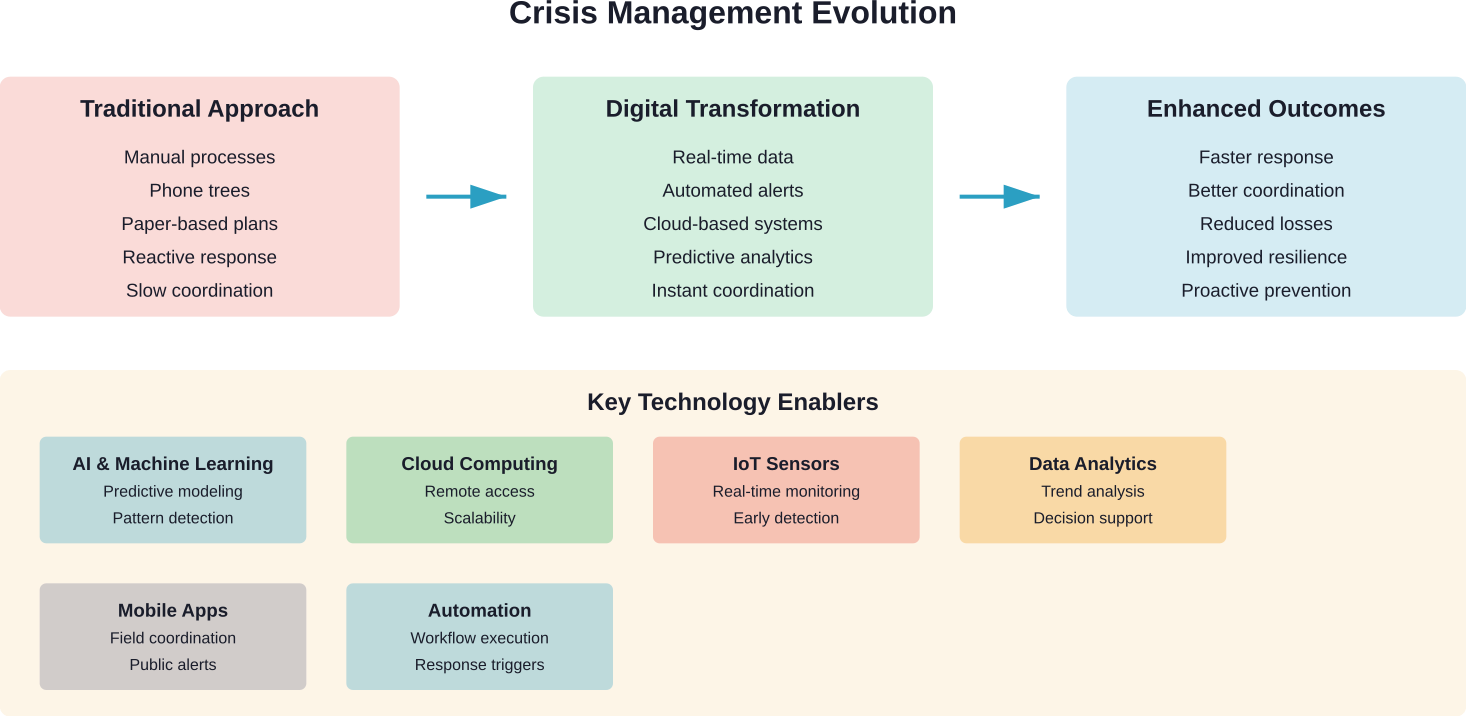

Системи громадського здоров'я в усьому світі стикаються з безпрецедентними викликами. Старіння населення, тягар хронічних захворювань та нові інфекційні загрози вимагають нових підходів. Цифрова трансформація пропонує шлях вперед.

Але ось у чому річ - цифрова трансформація - це не просто впровадження нових технологій. Це фундаментальне переосмислення того, як функціонують системи охорони здоров'я, як відбувається обмін даними між системами і як населення отримує доступ до профілактичної допомоги.

За даними Всесвітньої організації охорони здоров'я, цифрова трансформація є життєво важливою для досягнення загального охоплення послугами охорони здоров'я. Цифрові технології слугують важливим компонентом і каталізатором для зміцнення стійких систем охорони здоров'я. Глобальна ініціатива організації з цифрової охорони здоров'я підтримує країни в розробці надійної основи для цифрової трансформації охорони здоров'я, яка справедливо зміцнює системи охорони здоров'я.

Ставки високі. Лише у Сполучених Штатах 75% лікарень зараз використовують електронні системи охорони здоров'я. Ця інфраструктура створює можливості для аналізу стану здоров'я населення, які були неможливими ще десять років тому.

Розуміння цифрової трансформації системи охорони здоров'я

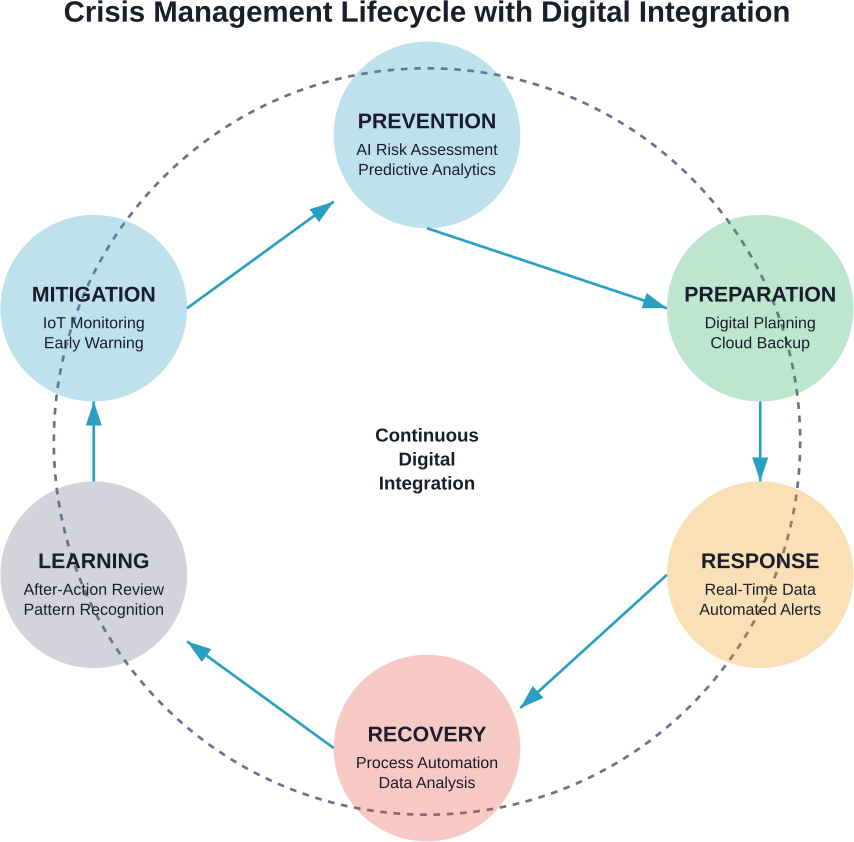

Цифрова громадська охорона здоров'я - це застосування цифрових технологій до основних функцій громадської охорони здоров'я: оцінка, розробка політики, розподіл ресурсів, забезпечення та доступ. На відміну від клінічної цифрової охорони здоров'я, яка фокусується на індивідуальній допомозі пацієнтам, цифрова громадська охорона здоров'я працює на рівні населення.

Різниця має значення. Згідно з дослідженням, опублікованим у виданні Health Promotion and Chronic Disease Prevention in Canada, сучасні стратегії цифрової охорони здоров'я в Канаді та інших країнах мають переважно клінічний фокус. Такий недогляд означає, що вплив цифрових технологій на функції охорони здоров'я не отримує належної уваги.

Цифрова трансформація в цьому контексті означає більше, ніж оцифрування існуючих процесів. Вона вимагає переосмислення всіх робочих процесів, архітектури даних і моделей надання послуг.

Основні компоненти цифрових систем громадського здоров'я

Посібник ВООЗ з інвестицій у цифрове впровадження встановлює рамки для інтеграції цифрових втручань у програми охорони здоров'я. У ньому особлива увага приділяється стандартизованим національним каталогам продуктів і процесам управління основними даними.

Це не абстрактні поняття. Вони перетворюються на практичні можливості:

- Системи спостереження за хворобами в режимі реального часу, які виявляють спалахи на кілька годин або днів раніше, ніж традиційні методи

- Інтероперабельні інформаційні системи охорони здоров'я, які обмінюються даними між юрисдикціями без ручного узгодження

- Платформи предиктивної аналітики, які виявляють групи ризику до виникнення кризових ситуацій у сфері охорони здоров'я

- Архітектури цифрових ланцюгів постачання, які забезпечують ефективне постачання вакцин та ліків до громад

- Реєстри здоров'я населення, які уможливлюють цілеспрямовані втручання для управління хронічними захворюваннями

ВООЗ надає покрокове керівництво для розробки масштабованої та стійкої архітектури цифрового ланцюга постачання послуг у сфері охорони здоров'я. Цей підхід адаптується до контексту конкретної країни, зберігаючи при цьому відповідність міжнародним стандартам, таким як SMART Guidelines.

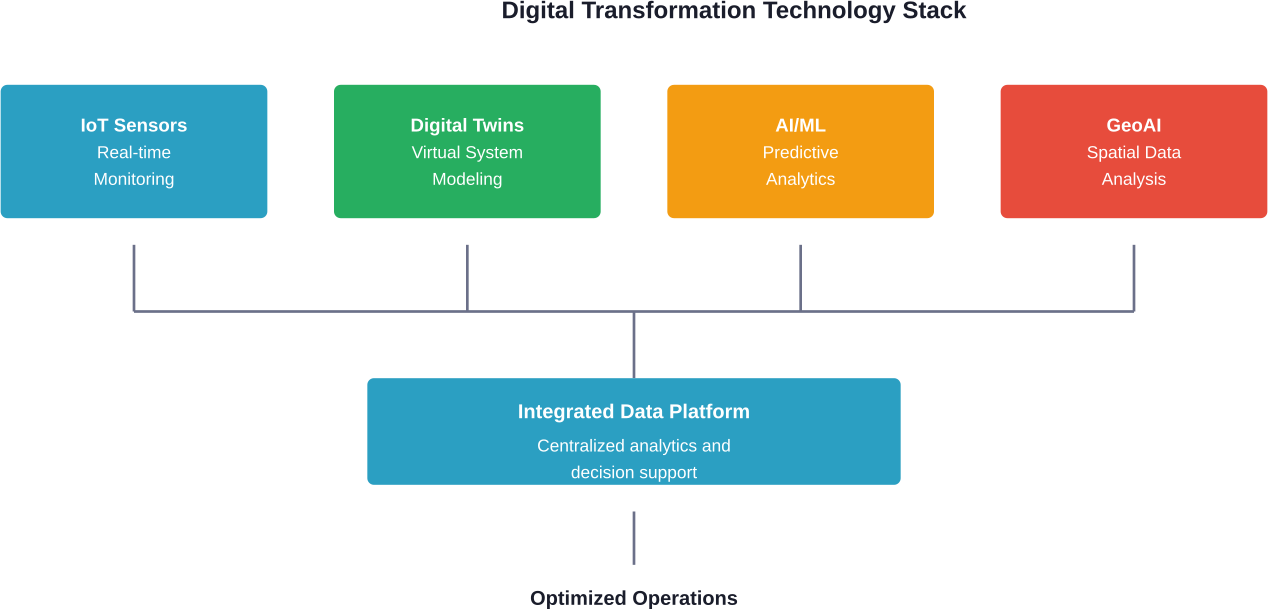

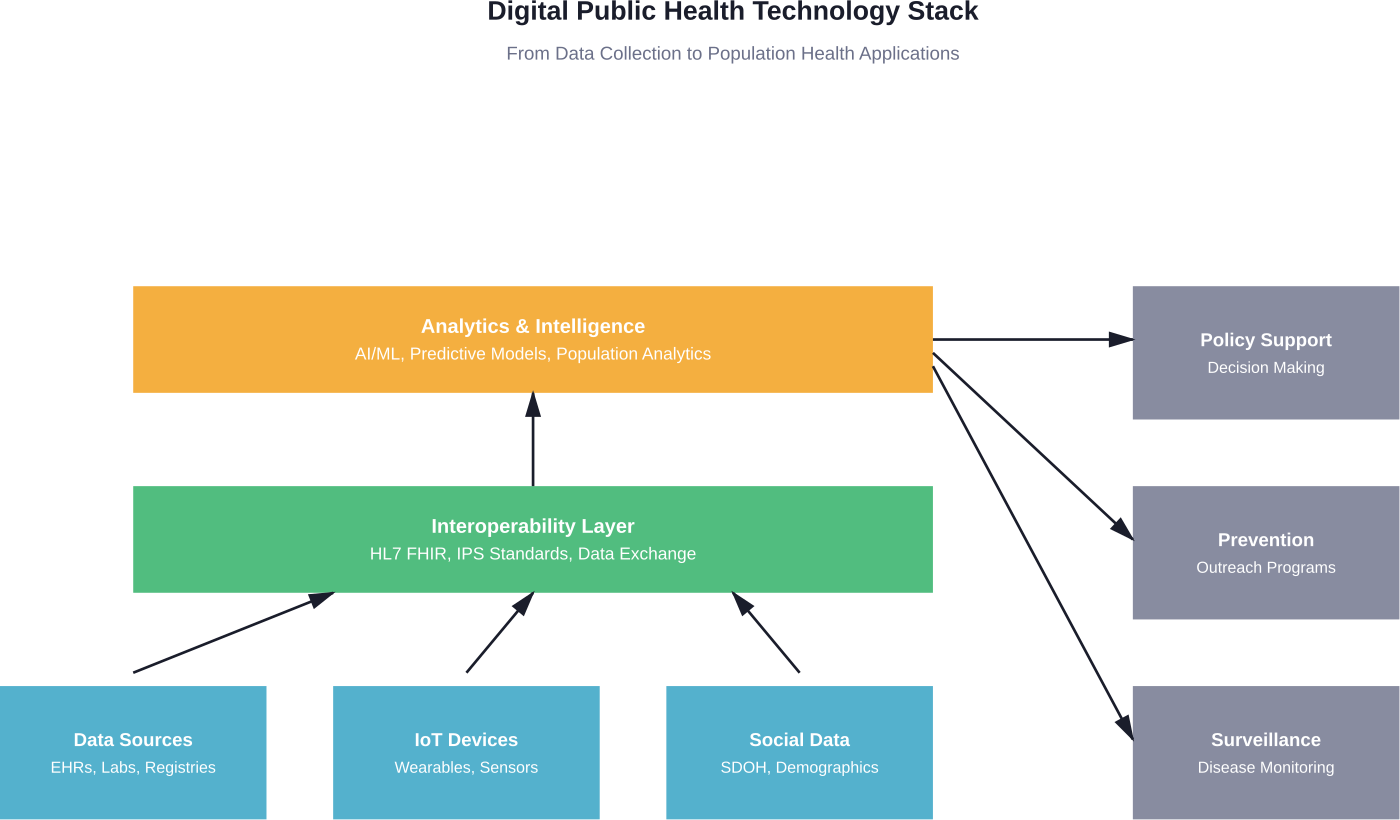

Технологічний стек

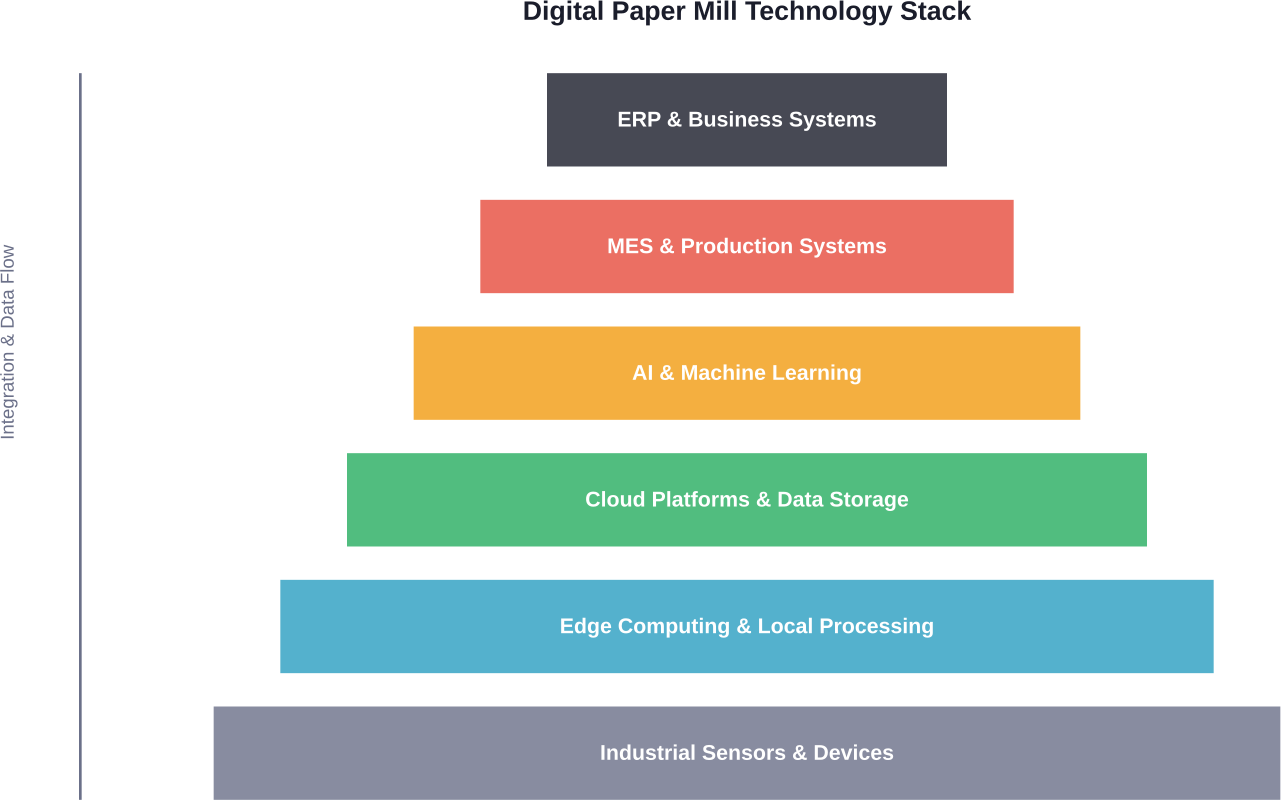

Сучасна цифрова система охорони здоров'я спирається на кілька взаємопов'язаних технологічних рівнів. В основі лежить інфраструктура даних - системи, які збирають, зберігають і керують медичною інформацією з різних джерел.

Стандарти інтероперабельності, такі як HL7 FHIR (Fast Healthcare Interoperability Resources), дозволяють різним системам взаємодіяти. Стандарт International Patient Summary створює загальну основу для обміну даними про пацієнтів через кордони та системи.

На вершині цієї інфраструктури аналітичні інструменти обробляють дані на рівні популяції. Алгоритми машинного навчання виявляють закономірності. Географічні інформаційні системи наносять на карту поширення хвороб. Обробка природної мови витягує інформацію з неструктурованих клінічних записів.

Додати підтримку розробки програмного забезпечення для проектів у сфері громадського здоров'я

Організації громадського здоров'я часто потребують кращих внутрішніх систем, більш ефективної обробки даних та надійнішої інфраструктури. Програмне забезпечення списку А надає послуги з розробки програмного забезпечення, ІТ-консалтингу, аналізу даних, кібербезпеки, інфраструктурних послуг та виділених команд розробників. Компанія може підтримувати проекти у сфері охорони здоров'я за допомогою спеціального програмного забезпечення, модернізації застарілих систем та додаткових інженерних потужностей.

Потрібна команда для створення або підтримки програмного забезпечення для громадського здоров'я?

Поговоріть з програмним забезпеченням A-list для:

- створювати власне програмне забезпечення для внутрішніх операцій

- модернізувати старі системи, які важко обслуговувати

- додайте розробників, інженерів з обробки даних або спеціалістів з безпеки

Почніть із запиту на консультацію з A-listware.

Застосування штучного інтелекту в охороні здоров'я

Роль штучного інтелекту в трансформації системи охорони здоров'я виходить далеко за межі підтримки клінічних рішень. CDC опублікував коментар щодо справедливості у сфері охорони здоров'я та етичних аспектів використання штучного інтелекту в громадській охороні здоров'я та медицині, висвітливши як можливості, так і ризики.

Ця технологія має особливі перспективи в кількох сферах. Системи спостереження за захворюваннями, вдосконалені за допомогою ШІ, можуть виявляти незвичайні закономірності у відвідуванні відділень невідкладної допомоги, продажах рецептурних ліків або згадках у соціальних мережах, які сигналізують про нові спалахи.

У дослідженні, опублікованому в BMC Public Health, проаналізовано вплив регіональної цифрової трансформації на громадське здоров'я в 31 провінції Китаю. У дослідженні технологічні інновації розглядалися як посередницька змінна, і було виявлено значний позитивний вплив на результати здоров'я населення.

Практичне застосування штучного інтелекту

Цифрова трансформація охорони здоров'я за допомогою технологій штучного інтелекту та Інтернету речей змінює систему надання медичних послуг у всьому світі. У дослідженні "Цифрова охорона здоров'я 2025" розглядається сталий розвиток охорони здоров'я за допомогою різних застосувань технологій AIoT.

Реальні впровадження демонструють конкретні переваги:

- Автоматизований скринінг рентгенівських знімків органів грудної клітки на туберкульоз в умовах обмежених ресурсів, що розширює діагностичні можливості без пропорційного збільшення штату рентгенологів

- Прогностичні моделі, що визначають осіб з високим ризиком розвитку ускладнень діабету, що уможливлює проведення цільових профілактичних програм

- Системи обробки природної мови, що витягують соціальні детермінанти здоров'я з клінічних записів, виявляючи фактори, що впливають на здоров'я населення на висхідному рівні

- Алгоритми комп'ютерного зору, що аналізують супутникові знімки для виявлення ділянок з поганою санітарною інфраструктурою або місць розмноження переносників інфекцій

Але зачекайте. Впровадження ШІ в охорону здоров'я стикається з окремими проблемами порівняно з клінічним застосуванням. Втручання на рівні населення потребують суспільної згоди. Політика, що ґрунтується на даних ШІ, - чи то розподіл ресурсів, цільові скринінги, чи обмеження у сфері охорони здоров'я - впливає на людей, які можуть не отримати від цього безпосередньої вигоди.

CDC підкреслює, що всі зацікавлені сторони, від політиків до громадськості, потребують збалансованого погляду на переваги, ризики та витрати, пов'язані з цифровими змінами. Прозорі показники та критерії стають важливими для забезпечення максимальних переваг без маргіналізації меншин або вразливих груп.

Міркування щодо справедливості

Цифрова еволюція ставить серйозні виклики у сфері рівності. Вразливі групи населення стикаються з бар'єрами, зумовленими економічними обмеженнями, географічною ізоляцією або цифровою неграмотністю. Без цілеспрямованого планування цифрова трансформація ризикує посилити існуючі диспропорції у сфері охорони здоров'я, а не усунути їх.

Дослідження, що аналізувало організаційні цифрові стратегії громадського здоров'я в канадських провінційних програмах, показало, що конфіденційність та організаційна чутливість створюють бар'єри для обміну даними та спільних інновацій. Ці структурні проблеми непропорційно впливають на недостатньо охоплені послугами громади, які могли б отримати найбільшу користь від втручань у сферу охорони здоров'я населення.

Реальна розмова: справедливість вимагає більше, ніж забезпечення рівного доступу до технологій. Вона вимагає розуміння того, як цифрові системи можуть увічнити упередженість через навчальні дані, дизайн алгоритмів або вибір способу реалізації.

Архітектура даних та інтероперабельність

Ефективна цифрова система охорони здоров'я залежить від надійної інфраструктури даних. Посібник ВООЗ з цифрової трансформації архітектури ланцюга постачання послуг охорони здоров'я містить покрокові рекомендації щодо розробки масштабованих систем.

Підхід наголошує на кількох ключових принципах. По-перше, стандартизація. Без єдиних форматів даних та визначень системи не можуть ефективно взаємодіяти. По-друге, модульність. Компоненти повинні бути замінними та модернізованими без перебудови всієї системи. По-третє, стійкість. Рішення повинні функціонувати з наявними ресурсами та досвідом.

Виклик інтероперабельності

Дані про стан здоров'я існують розрізнено. Лікарняні системи не спілкуються з реєстрами громадського здоров'я. Лабораторні інформаційні системи використовують інші схеми кодування, ніж бази даних імунізації. Соціальні служби відстежують детермінанти здоров'я окремо від медичних установ.

Такі стандарти, як HL7 FHIR, вирішують ці проблеми, визначаючи, як відбувається обмін медичною інформацією в електронному вигляді. Міжнародне резюме пацієнта містить мінімальний набір елементів даних для транскордонного та міжсистемного обміну інформацією про пацієнта.

За даними HL7, медичні заклади та постачальники ІТ-технологій у сфері охорони здоров'я прискорюють впровадження IPS. Стандарт створює спільну основу для обміну даними про пацієнтів через кордони та системи охорони здоров'я. Станом на серпень 2024 року багато постачальників ЕМК впровадили підтримку IPS, що дозволило створити справді інтероперабельну медичну документацію.

Практичні наслідки є значними. Біженець, який прибуває в нову країну, може мати доступ до своєї історії щеплень, хронічних захворювань і алергії на ліки, які одразу ж стають доступними для медичних працівників. Розслідування спалаху хвороби може швидко зібрати воєдино дані про вплив з різних юрисдикцій.

Підхід "будівельних блоків

Посібник ВООЗ з інвестицій у цифрове впровадження відстоює методологію "будівельних блоків". На відміну від монолітних систем, цифрова інфраструктура охорони здоров'я складається з модульних компонентів, які працюють разом.

Ці будівельні блоки включають в себе

| Будівельний блок | Функція | Приклади |

|---|---|---|

| Реєстр клієнтів | Унікальна ідентифікація осіб у різних системах | Основний індекс пацієнта, інтеграція національної ідентифікації |

| Реєстр об'єктів | Стандартизований перелік місць надання медичних послуг | Довідники лікарень, бази даних геолокації клінік |

| Термінологічна служба | Загальноприйняті медичні словники та кодові позначення | Впровадження SNOMED CT, МКХ-10, LOINC |

| Спільна медична картка | Подовжені дані про пацієнтів, доступні для всіх постачальників послуг | Регіональні обміни медичною інформацією |

| Реєстр медичних працівників | Облікові дані та розподіл медичних працівників | Каталоги постачальників, бази даних ліцензій |

Такий модульний підхід дозволяє країнам впроваджувати компоненти поступово, виходячи з пріоритетів та ресурсів. Країна може почати з реєстру закладів, щоб покращити логістику ланцюга постачання, а потім додати реєстр клієнтів, щоб уможливити довготривале відстеження пацієнтів.

Цифрова трансформація для неінфекційних захворювань

Пандемія SARS-CoV-2 продемонструвала ефективність швидкого розгортання цифрових технологій у сфері охорони здоров'я. Цифрові додатки для відстеження близькості використовували можливості Bluetooth для відстеження та сповіщення користувачів про потенційний контакт з вірусом. Підтримувані такими організаціями, як ВООЗ і Європейський Союз, ці інструменти продемонстрували перспективність цифрової охорони здоров'я.

Зараз фокус зміщується. На неінфекційні захворювання припадає переважна більшість витрат на охорону здоров'я та передчасних втрат років життя з поправкою на інвалідність. У дослідженні, опублікованому в журналі JMIR Public Health and Surveillance, розглядається цифрова трансформація системи охорони здоров'я у сфері неінфекційних захворювань.

Наратив про неінфекційні захворювання відрізняється від наративу про інфекційні захворювання. Хронічні захворювання розвиваються роками. Фактори ризику охоплюють індивідуальну поведінку, соціальні детермінанти, вплив навколишнього середовища та генетичну схильність. Втручання вимагають тривалої участі, а не гострого реагування.

Цифрові втручання для профілактики хронічних захворювань

Цифрові технології уможливлюють підходи на рівні населення, які раніше були непрактичними. Мобільні додатки для здоров'я сприяють зміні поведінки завдяки персоналізованому зворотному зв'язку та соціальній підтримці. Носимі пристрої постійно відстежують фізичну активність, режим сну та фізіологічні маркери.

Але інструменти індивідуального рівня - це лише частина можливостей. Платформи управління здоров'ям населення аналізують агреговані дані, щоб виявити громади з підвищеним ризиком серцево-судинних захворювань. Географічні інформаційні системи наносять на карту харчові пустелі та доступ до рекреаційних об'єктів. Прогностичні моделі передбачають, у яких пацієнтів найімовірніше розвинуться ускладнення без втручання.

Ці можливості підтримують основні функції громадського здоров'я інакше, ніж традиційні підходи. Для оцінки цифрові системи надають показники здоров'я населення в режимі, близькому до реального часу, замість періодичних опитувань. Для розробки політики імітаційні моделі можуть оцінити вплив втручань ще до їх впровадження. Для впевненості автоматизований моніторинг відстежує, чи охоплені профілактичними послугами цільові групи населення.

Людський фактор

Але ось у чому річ: штучний інтелект і цифрові інструменти не можуть замінити людські стосунки у зміцненні здоров'я. Емоційна підтримка, культурна чутливість і побудова довіри залишаються в основі своїй людською діяльністю.

Штучний інтелект найкраще слугує в якості компаньйона, який допомагає людям орієнтуватися в медичному ландшафті. Він автоматизує повторювані завдання, звільняючи провайдерів для пріоритетних особистих взаємодій, які не можуть бути оцифровані. Вона надає людям інструменти для проактивного управління своїм здоров'ям. Але вона не замінює емпатію чи клінічне судження.

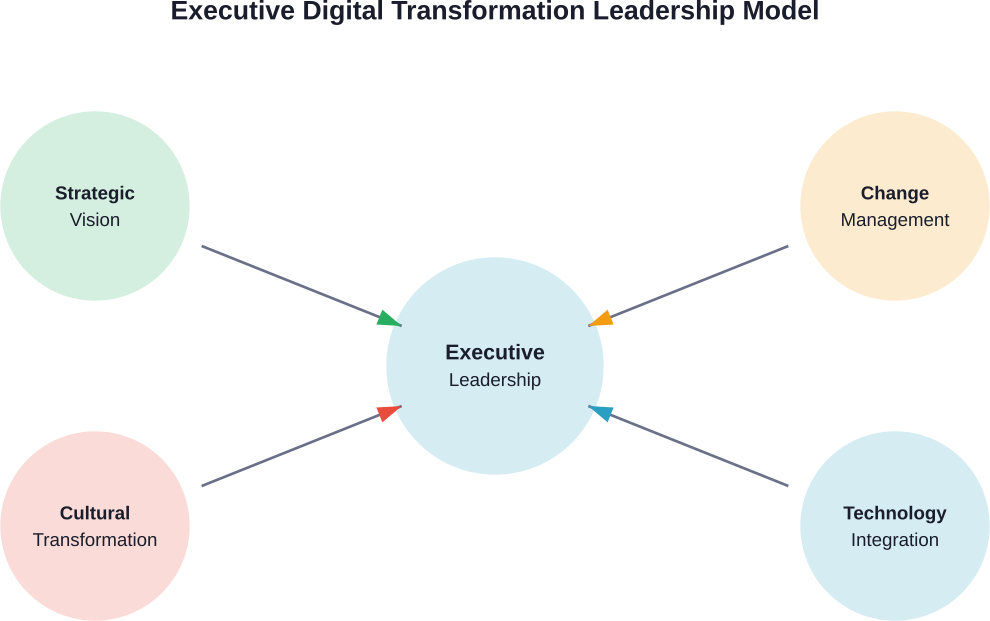

Дослідження цифрової трансформації охорони здоров'я, опубліковане в Journal of Healthcare Leadership, вивчало організаційні фактори, що впливають на реалізацію переваг. Дослідження показало, що зміни в можливостях системи та організаційній культурі мають не менше значення, ніж вибір технології.

Стратегії впровадження та управління

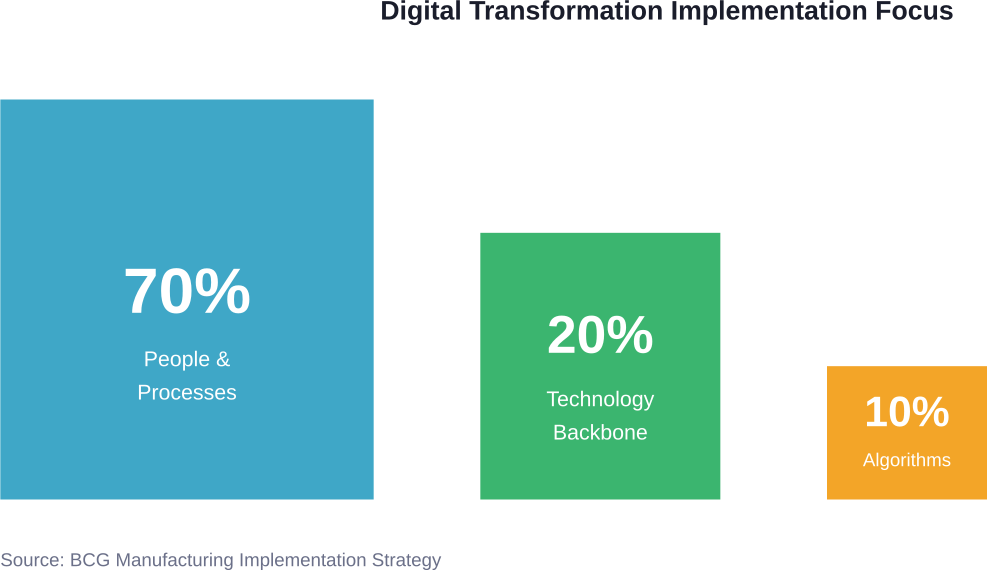

Технології самі по собі не створюють трансформацію. Успішне цифрове громадське здоров'я вимагає стратегічного планування, управління змінами та структур управління, які збалансовують інновації з підзвітністю.

Панамериканська організація охорони здоров'я опублікувала вісім керівних принципів цифрової трансформації системи охорони здоров'я. Ці принципи стосуються культурних змін як для медичного персоналу, так і для населення, і спрямовані на підтримку прийняття обґрунтованих рішень та сталого розвитку державної політики.

Вісім основних принципів

Концепція ПАОЗ підкреслює, що оцифрування передбачає важливі культурні зміни.

Ці принципи орієнтують країни на розробку короткострокових і довгострокових цілей, гарантуючи, що ніхто не залишиться поза увагою:

- Універсальний доступ та рівність у цифрових послугах охорони здоров'я

- Особистісно-орієнтований дизайн, який ставить людей та громади в центр

- Захист даних та конфіденційність як основні вимоги

- Інтероперабельність та стандартизація між системами

- Прийняття рішень на основі доказів з використанням надійних даних

- Сталий розвиток завдяки правильному вибору технологій

- Міжсекторальна співпраця за межами міністерств охорони здоров'я

- Постійне оцінювання та навчання в процесі впровадження

Це не абстрактні ідеали. Вони перетворюються на конкретні варіанти реалізації. Особистісно-орієнтований дизайн означає залучення членів спільноти до розробки системи, а не просто впровадження рішень, розроблених технологами. Захист даних вимагає створення системи управління перед тим, як збирати конфіденційну медичну інформацію. Сталість означає вибір платформ з відкритим вихідним кодом замість пропрієтарних систем в умовах обмежених ресурсів.

Організаційна готовність

Дослідження організаційних факторів, що сприяють реалізації переваг цифрової трансформації охорони здоров'я, виявило критичні можливості, які не обмежуються впровадженням технологій. Керівники медичних служб потребують нових компетенцій у сфері інформаційної грамотності, управління змінами та цифрової стратегії.

Якісне дослідження, опубліковане в Journal of Healthcare Leadership, показало, що для реалізації переваг трансформації необхідні організаційні вдосконалення та зміни в можливостях системи. Технічні рішення не спрацьовують без відповідних змін у робочих процесах, культурі та управлінні.

Оцінка цифрового прогресу вимагає комплексних рамок. У наративному огляді 2024 року в JMIR Public Health and Surveillance були розглянуті показники для оцінки зрілості цифрової системи громадського здоров'я. Дослідження визначило 286 відповідних показників з 90 посилань, причому 46.5% мають юридичне значення, пов'язане з великими даними, регулюванням ШІ, кібербезпекою, національними стратегіями або управлінням даними в галузі охорони здоров'я.

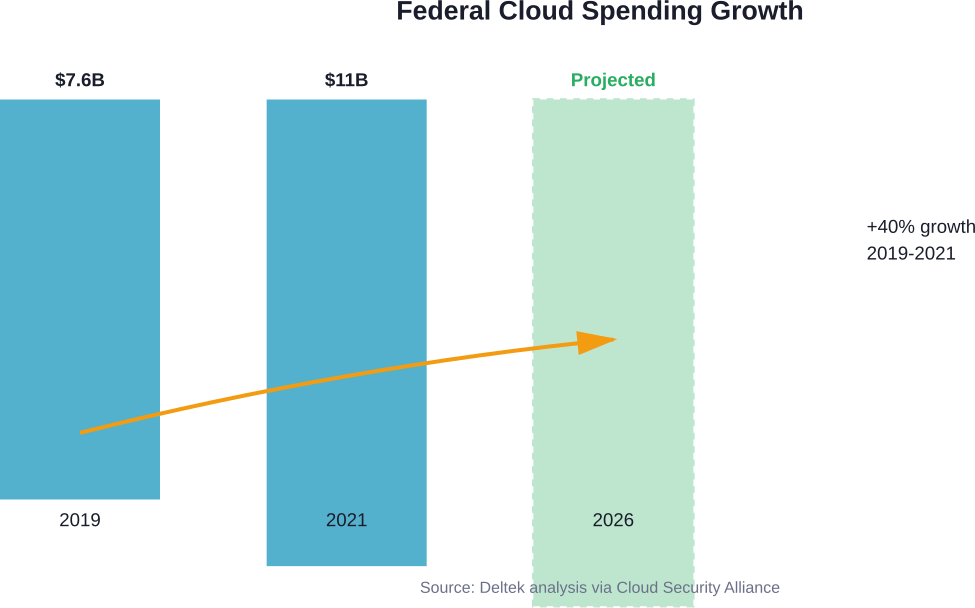

Інвестиції та сталий розвиток

Цифрова трансформація вимагає постійних інвестицій. У 2018 році понад 1 трлн 4 трлн 9 млрд доларів США було інвестовано у стартапи в галузі цифрової охорони здоров'я венчурним та приватним капіталом, згідно з дослідженням поточних викликів та рішень для цифрових технологій у сфері охорони здоров'я у формуванні доказової бази.

Але фінансування цифрових компаній у сфері охорони здоров'я не означає автоматичного зміцнення інфраструктури громадського здоров'я. Інвестиції державного сектору повинні бути спрямовані на створення стійких, масштабованих платформ, які задовольняють потреби населення в охороні здоров'я, а не на індивідуальні споживчі додатки.

У дискусійному документі Національної академії медицини про національну цифрову архітектуру та архітектуру даних у сфері охорони здоров'я стверджується, що сектор охорони здоров'я відстає у розвитку надійної цифрової інфраструктури, необхідної для повного впровадження інновацій. Це обмежує потенційне зростання ефективності, доступу, профілактики, діагностики, лікування, відкриттів та результатів у сфері охорони здоров'я.

Поточні виклики та бар'єри

Цифрова трансформація стикається зі значними перешкодами. Розуміння цих бар'єрів допомагає організаціям розробити реалістичні стратегії впровадження та уникнути поширених помилок.

Технічні виклики

Застарілі системи створюють серйозні перешкоди. Багато закладів охорони здоров'я працюють на технологічних платформах, створених десятиліття тому. Ці системи не можуть легко інтегруватися з сучасними хмарними додатками або підтримувати обмін даними в режимі реального часу.

Проблеми з якістю даних підривають аналітику. Неповні записи, непослідовне кодування та дублікати створюють шум, який приховує значущі сигнали. Очищення та стандартизація даних вимагає значних зусиль, перш ніж просунута аналітика стане можливою.

Проблеми кібербезпеки зростають у міру того, як системи взаємопов'язані. Дані про здоров'я є цінною мішенню для зловмисників. Захист приватності при забезпеченні належного обміну даними вимагає складних архітектур безпеки та управління.

Прогалини у трудових ресурсах та спроможності

Кадровий потенціал системи охорони здоров'я для цифрової трансформації залишається обмеженим. Протокол 2023 року, опублікований в JMIR Research Protocols, описує мультидисциплінарну національну дослідницьку школу інновацій в охороні здоров'я, покликану посилити можливості цифрової трансформації в системі охорони здоров'я.

Докторанти в таких дослідницьких школах зазвичай здобувають ступінь доктора філософії протягом 5 років, з яких приблизно 80% витрачається на навчання, а 20% - на виконання робочих завдань у конкретній організації. Ця модель визнає, що розбудова цифрового потенціалу громадського здоров'я вимагає формальних навчальних програм, а не лише навчання на робочому місці.

Персонал на всіх рівнях потребує нових навичок. Епідеміологи повинні розуміти основи машинного навчання, щоб інтерпретувати дані, отримані за допомогою штучного інтелекту. Аналітики даних потребують знань у сфері громадського здоров'я, щоб ставити релевантні питання. Керівники програм потребують цифрової грамотності, щоб приймати обґрунтовані технологічні рішення.

Бар'єри рівності та доступу

Цифровий розрив загрожує поглибленням нерівності у сфері охорони здоров'я. Сільські громади часто не мають широкосмугової інфраструктури, необхідної для телемедицини або систем спостереження в режимі реального часу. Малозабезпечені верстви населення стикаються з перешкодами у доступі до смартфонів або комп'ютерів, необхідних для використання цифрових інструментів охорони здоров'я.

Мова і грамотність створюють додаткові бар'єри. Інформаційні системи охорони здоров'я, розроблені для англомовних користувачів з вищою освітою, виключають значну частину багатьох громад. По-справжньому інклюзивна цифрова система охорони здоров'я вимагає багатомовних інтерфейсів, звукового супроводу та спрощеної навігації.

Вікові прогалини в цифровій грамотності зачіпають як людей похилого віку, так і медичних працівників, які наближаються до пенсії. Системи навчання та підтримки повинні враховувати різні рівні технологічного комфорту.

Виклики в управлінні та політиці

Системи управління даними відстають від технічних можливостей. Питання про те, хто володіє даними про стан здоров'я, хто може отримати до них доступ і з якою метою, залишаються спірними. Нормативно-правові акти різняться в різних юрисдикціях, що ускладнює міждержавну або міжнародну співпрацю.

Положення про конфіденційність, розроблені для традиційної охорони здоров'я, не завжди враховують нові цифрові сценарії. Чи можуть органи охорони здоров'я використовувати дані про місцезнаходження смартфонів для відстеження передачі захворювань? Чи повинні алгоритми штучного інтелекту мати доступ до повних медичних записів для виявлення груп ризику? Ці питання не мають чітких відповідей у багатьох юрисдикціях.

Процеси закупівель, розроблені для фізичних товарів, борються з програмним забезпеченням та хмарними сервісами. Тривалі цикли затвердження заважають установам впроваджувати технології, що швидко розвиваються. Правила закупівель, що не передбачають ризиків, надають перевагу усталеним постачальникам, а не інноваційним стартапам.

Вимірювання впливу та результатів

Демонстрація цінності інвестицій у цифрову трансформацію вимагає чітких показників та системи оцінювання. Але вимірювання результатів у сфері охорони здоров'я населення пов'язане з певними проблемами, відмінними від оцінки клінічної ефективності.

Ключові показники ефективності

Дослідження цифрової трансформації в охороні здоров'я показало, що типовими перевагами є підвищення продуктивності праці працівників, покращення ефективності та результативності роботи медичних закладів, а також зниження операційних витрат.

У сфері громадського здоров'я відповідні показники охоплюють кілька сфер:

| Домен | Приклад метрик | Підхід до вимірювання |

|---|---|---|

| Ефективність | Час від виявлення спалаху до реагування; зменшення навантаження на введення даних | Дослідження часу процесів; відстеження робочого часу персоналу |

| Ефективність | Рівень охоплення вакцинацією; охоплення скринінгових програм; швидкість контролю спалахів | Дані про участь у програмі; моніторинг захворюваності на хвороби |

| Справедливість | Нерівність у доступі до послуг; використання цифрових інструментів у різних демографічних групах | Стратифікований аналіз використання; опитування громад |

| Користувацький досвід | Задоволеність постачальників; рівень залучення громадськості; оцінка зручності використання системи | Опитування користувачів; юзабіліті-тестування; аналітика залученості |

| Економічний | Вартість одного втручання; рентабельність інвестицій; ефективність розподілу ресурсів | Аналіз економічної ефективності; моделювання впливу на бюджет |

Проблема полягає в тому, як це пояснити. Здоров'я населення покращується завдяки багатьом факторам. Виокремлення конкретного внеску цифрових систем вимагає ретельної оцінки.

Проблеми зі збором доказів

Цифрові технології в охороні здоров'я мають потенціал для покращення результатів охорони здоров'я завдяки залученню пацієнтів до самообслуговування, покращенню комунікації та пристосуванню послуг до індивідуальних потреб. Однак отримання достовірних даних про вплив на рівні населення стикається з методологічними проблемами.

Рандомізовані контрольовані дослідження - золотий стандарт клінічних досліджень - часто виявляються непрактичними для втручань у здоров'я населення. Випадковий розподіл громад між цифровими та традиційними підходами викликає етичні та логістичні проблеми.

Альтернативні підходи включають квазіекспериментальні проекти, що порівнюють подібні юрисдикції з різними термінами впровадження. Аналіз часових рядів може виявити зміни в тенденціях після розгортання цифрової системи. Натуральні експерименти використовують варіації політики в різних регіонах.

Дані з цифрових систем самі по собі уможливлюють нові підходи до оцінювання. Безперервний моніторинг замінює періодичні опитування. Деталізовані дані дозволяють проводити підгруповий аналіз, неможливий за допомогою традиційних методів. Але ці можливості вимагають ретельної уваги до упередженості та плутанини.

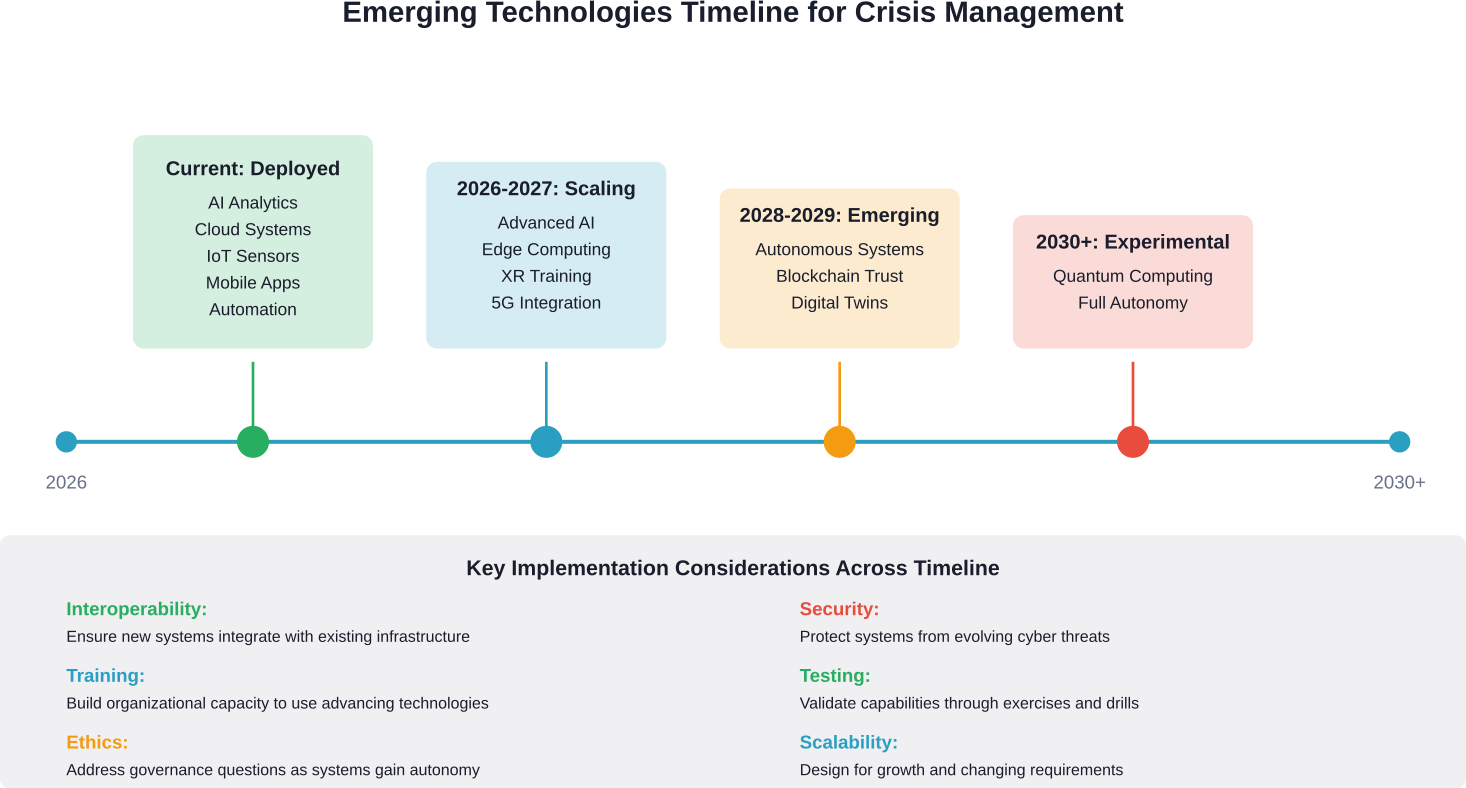

Майбутні напрямки та нові тенденції

Цифрова охорона здоров'я продовжує стрімко розвиватися. Кілька тенденцій визначатимуть траєкторію розвитку галузі в найближчі роки.

Інтеграція ШІ та великі мовні моделі

Великі мовні моделі представляють собою значний розвиток для додатків у сфері охорони здоров'я. Ці системи штучного інтелекту можуть обробляти неструктурований текст у великих масштабах, витягуючи інформацію з клінічних записів, постів у соціальних мережах або наукової літератури.

Згідно з роздумами HL7 щодо створення інфраструктури стандартів для ШІ в охороні здоров'я, опублікованими в листопаді 2025 року, швидке впровадження ШІ створює ще один ключовий момент після десятиліть роботи над забезпеченням безперебійної сумісності даних у сфері охорони здоров'я. Розробка стандартів повинна йти в ногу з технологічними можливостями.

Потенційні застосування включають автоматизовані огляди літератури для виявлення нових загроз для здоров'я, чат-боти, що забезпечують культурно-прийнятну медичну освіту, та системи, що витягують дані про соціальні детермінанти з різних джерел. Однак забезпечення точності, запобігання упередженості та збереження людського нагляду залишаються критично важливими проблемами.

Блокчейн та розподілені системи

Технологія блокчейн пропонує можливості для безпечного, децентралізованого обміну медичними даними. Люди можуть контролювати доступ до своєї медичної інформації, забезпечуючи при цьому належний обмін для цілей охорони здоров'я. Додатки для ланцюгів поставок можуть відстежувати фармацевтичні препарати від виробництва до застосування, зменшуючи ризики підробок.

Але блокчейн не є панацеєю. Енергоспоживання, обмеження масштабування та регуляторна невизначеність стримують ентузіазм. Практичне застосування у сфері охорони здоров'я залишається обмеженим порівняно з хайпом.

Точна охорона здоров'я

Інтеграція геномних даних із впливом навколишнього середовища, соціальними детермінантами та поведінковими факторами дає змогу здійснювати все більш цілеспрямовані втручання. На відміну від універсальних програм, точне громадське здоров'я адаптує підходи до конкретних сегментів населення.

Ця еволюція відображає перехід точної медицини від середніх популяційних показників до індивідуальних характеристик. Цифрові системи роблять точну охорону здоров'я практичною, обробляючи складні дані, необхідні для визначення значущих підгруп і персоналізації втручань.

Глобальні платформи співпраці

Глобальна ініціатива ВООЗ з цифрової охорони здоров'я сприяє покращенню узгодженості в секторі цифрової охорони здоров'я. Ініціатива надає урядам і партнерам інструменти, будівельні блоки і платформи, необхідні для стійкої цифровізації системи охорони здоров'я.

Міжнародна співпраця прискорює прогрес. Країни можуть вчитися на успіхах і невдачах своїх колег. Гармонізація стандартів уможливлює транскордонний обмін даними, критично важливими для відстеження пандемій та проблем охорони здоров'я, пов'язаних з міграцією. Спільні платформи зменшують дублюючі витрати на розробку.

Бачення: стабільна підтримка країн у плануванні, забезпеченні ресурсами та розробці надійних основ для цифрової трансформації охорони здоров'я, яка справедливо зміцнює системи охорони здоров'я в усьому світі.

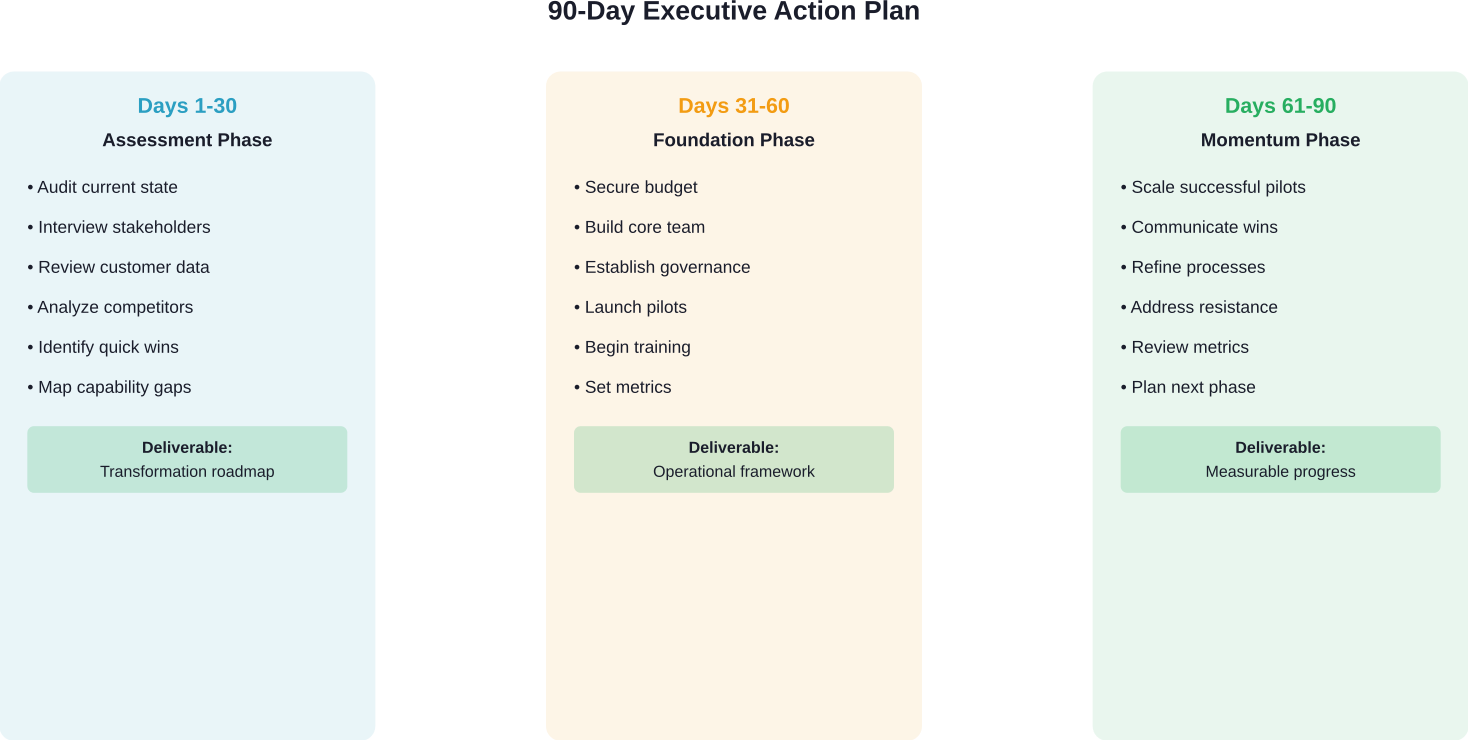

Дорожня карта практичної реалізації

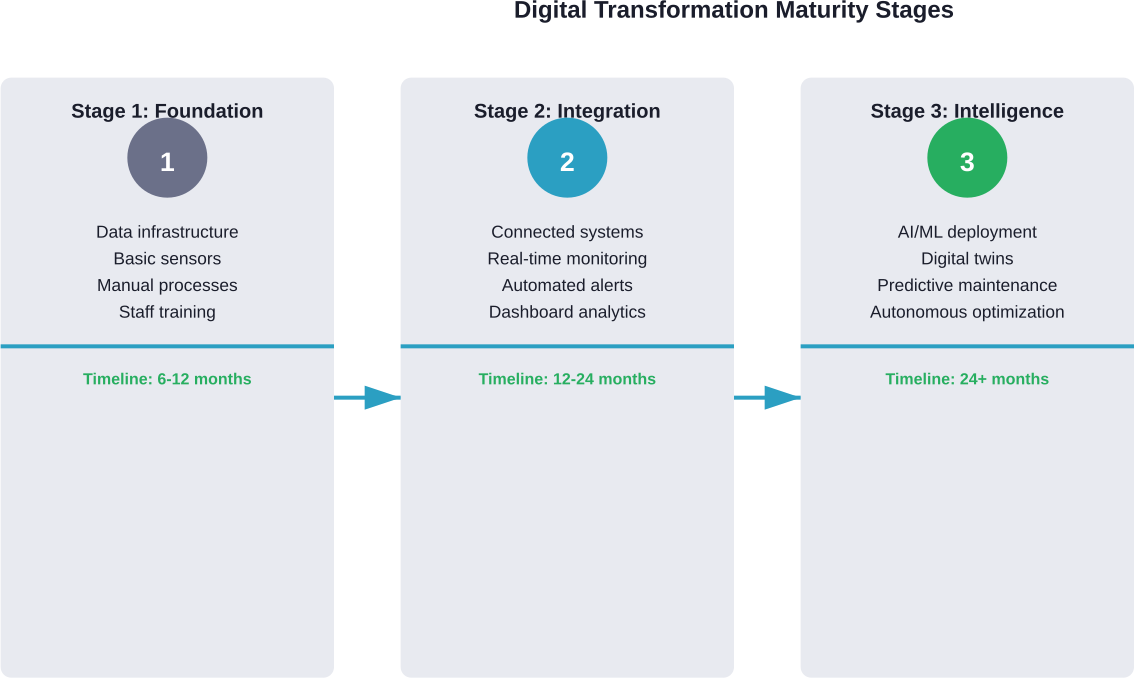

Організації, які розпочинають цифрову трансформацію, потребують структурованих підходів, що поєднують амбіції з реалізмом. Наведена нижче дорожня карта синтезує рекомендації ВООЗ, ПАОЗ та дослідження з впровадження.

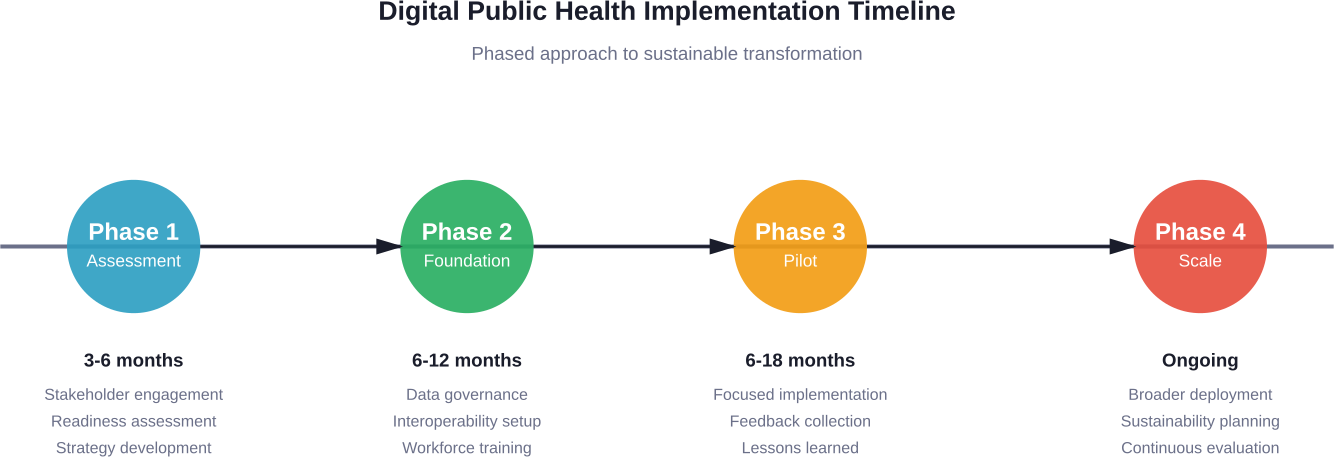

Етап 1: Оцінка та планування

Почніть з чесної оцінки поточного стану. Які цифрові можливості існують? Де є прогалини? Які фактори організаційної готовності потребують уваги?

Залучення зацікавлених сторін починається тут, а не після прийняття рішень. Залучайте персонал, який щодня користується системами. Залучайте членів громади, які отримують послуги. Консультуйтеся з ІТ-фахівцями, експертами з питань конфіденційності та політиками.

Розробити стратегію цифрової охорони здоров'я, узгоджену з пріоритетами громадського здоров'я. Технології служать місії, а не навпаки. Якщо пріоритетом є профілактика дитячого ожиріння, цифрові інвестиції повинні підтримувати нагляд за харчуванням, популяризацію фізичної активності або пов'язані з цим функції.

Етап 2: Будівництво фундаменту

Створіть систему управління даними перед тим, як збирати конфіденційну інформацію. Визначте ролі, обов'язки та права на прийняття рішень. Створіть політику доступу до даних, обміну ними та їх зберігання. Забезпечте дотримання правових та етичних норм.

Інвестувати в інфраструктуру інтероперабельності. Впровадити стандарти, такі як HL7 FHIR для обміну даними. Створити або придбати основні реєстри (клієнтів, закладів, постачальників). Створити термінологічні служби зі стандартними наборами кодів.

Підвищуйте кваліфікацію персоналу за допомогою навчальних програм. Розвивати цифрову грамотність на всіх рівнях персоналу. Залучати спеціалістів з науки про дані, медичної інформатики та управління цифровими проєктами.

Етап 3: Пілотне впровадження

Почніть з фокусованих пілотних проектів, а не з розгортання в масштабах всієї компанії. Обирайте проекти з чіткими показниками успіху, керованим обсягом і сильною підтримкою керівництва. Вчіться на перших впровадженнях, перш ніж масштабувати.

Вбудовуйте петлі зворотного зв'язку в пілотні проекти. Постійно збирайте дані про користувацький досвід. Відстежуйте технічну продуктивність і виявляйте проблеми на ранніх стадіях. Коригуйте підходи на основі реального використання, а не теоретичних розробок.

Систематично документуйте отримані уроки. Що спрацювало? Що не спрацювало? Чому? Ці знання допоможуть на наступних етапах і допоможуть іншим організаціям уникнути подібних пасток.

Етап 4: Масштабування та підтримка

Успішні пілотні проекти дають змогу ширшого розгортання. Але масштабування вимагає більшого, ніж просто реплікація технології. Управління змінами, навчання та підтримка повинні розширюватися пропорційно.

Плануйте сталий розвиток від самого початку. Бюджет повинен покривати поточні витрати - обслуговування, модернізацію, підтримку, а не лише початкове впровадження. Розвивайте внутрішню експертизу, а не покладайтеся повністю на зовнішніх постачальників.

Постійне оцінювання відстежує, чи приносять інвестиції очікувані вигоди. Використовуйте дані, згенеровані цифровими системами, для оцінки власної ефективності. Коригуйте курс, коли результати не відповідають поставленим цілям.

Тематичні дослідження та реальні застосування

Вивчення конкретних імплементацій ілюструє, як принципи втілюються на практиці та яких результатів досягають організації.

Регіональна цифрова трансформація в Китаї

Дослідження, в якому проаналізовано 31 провінцію Китаю, показало, що регіональна цифрова трансформація суттєво впливає на результати громадського здоров'я. Дослідження використовувало технологічні інновації як проміжну змінну, демонструючи, що цифрові можливості уможливлюють інновації, які згодом покращують здоров'я населення.

Аналіз показав, що провінції з більш розвиненою цифровою інфраструктурою демонструють кращі результати за багатьма показниками громадського здоров'я. Однак переваги не були автоматичними - вони вимагали паралельних інвестицій у розвиток робочої сили та реорганізацію процесів.

Канадські провінційні програми громадського здоров'я

Якісне дослідження вивчало організаційну цифрову стратегію громадського здоров'я в рамках провінційної програми в Британській Колумбії, Канада. З лютого по квітень 2023 року дослідники провели фокус-групи з практиками, щоб зрозуміти можливості та виклики.

Учасники визначили кілька бар'єрів на шляху до ефективної цифрової трансформації. Конфіденційність стосується обмеженого обміну даними між програмами. Організаційна відокремленість перешкоджала інтегрованим підходам. Обмежений рівень цифрової грамотності серед персоналу сповільнював впровадження нових інструментів.

Дослідження також виявило можливості. Практикуючі лікарі визнали, що цифрові системи можуть зменшити адміністративний тягар, що дасть більше часу для безпосередньої роботи в сфері охорони здоров'я. Покращений доступ до даних уможливить більш цілеспрямоване втручання. Автоматизація може стандартизувати рутинні процеси, зменшуючи їхню варіативність.

Прискорення реагування на пандемію

Пандемія COVID-19 значно прискорила впровадження цифрових технологій у сфері охорони здоров'я. Додатки для відстеження контактів, реєстри щеплень та інформаційні панелі в режимі реального часу розгортаються за місяці, а не роки.

Такий швидкий розвиток подій став можливим завдяки успішній міжнародній співпраці та підтримці з боку таких організацій, як ВООЗ та Європейський Союз. Цей досвід продемонстрував, чого можна досягти, коли нагальність, ресурси та політична воля збігаються.

Однак під час впровадження, спричиненого пандемією, стійкість часто приносилася в жертву швидкості. Багато систем покладалися на тимчасове фінансування, зовнішніх консультантів або власні платформи. Збереження динаміки вимагає переходу до сталих моделей.

Поширені запитання

- Що таке цифрова трансформація в охороні здоров'я?

Цифрова трансформація в охороні здоров'я означає фундаментальне переосмислення того, як функціонують системи охорони здоров'я з використанням цифрових технологій. Це виходить за рамки простого оцифрування паперових записів або додавання веб-сайтів. Справжня трансформація передбачає перепроектування процесів, інтеграцію систем даних, розгортання аналітики для отримання інформації про стан здоров'я населення та впровадження нових підходів до втручань, які раніше були неможливими. Метою є покращення показників здоров'я населення завдяки кращому нагляду, ефективнішим профілактичним програмам та справедливому наданню послуг.

- Чим цифрова громадська охорона здоров'я відрізняється від цифрової охорони здоров'я загалом?

Цифрова охорона здоров'я зазвичай зосереджена на індивідуальному обслуговуванні пацієнтів - телемедицині, електронних медичних картах, порталах для пацієнтів і підтримці прийняття клінічних рішень. Цифрова громадська охорона здоров'я працює на рівні населення, підтримуючи такі функції, як спостереження за захворюваннями, зміцнення здоров'я, моніторинг стану навколишнього середовища та розробка політики. У той час як клінічна цифрова охорона здоров'я обслуговує окремих пацієнтів, цифрова громадська охорона здоров'я обслуговує цілі громади і групи населення. Технології перетинаються, але застосування і показники успіху суттєво відрізняються.

- Які основні бар'єри на шляху впровадження цифрової трансформації в органах охорони здоров'я?

Основні перешкоди включають застарілі технологічні системи, які важко інтегрувати з сучасними платформами, обмежений кадровий потенціал у сфері науки про дані та медичної інформатики, недостатнє фінансування як для початкового впровадження, так і для поточного обслуговування, проблеми з управлінням даними, пов'язані з конфіденційністю та спільним використанням, організаційну відокремленість, що перешкоджає скоординованим підходам, а також занепокоєння з приводу цифрових розривів у сфері рівності. Крім того, процеси закупівель, розроблені для фізичних товарів, вступають у протиріччя з придбанням програмного забезпечення, а культури, що не схильні до ризику, чинять опір інноваціям.

- Як цифрова трансформація може сприяти забезпеченню справедливості у сфері охорони здоров'я, а не поглиблювати диспропорції?

Цифрова трансформація, орієнтована на рівність та справедливість, вимагає цілеспрямованого вибору дизайну. Це включає забезпечення роботи цифрових інструментів для населення з обмеженим доступом до Інтернету або старими пристроями, надання багатомовних інтерфейсів для малограмотних, залучення членів громади до розробки системи, відстеження показників використання, стратифікованих за демографічними групами, для виявлення диспропорцій, інвестування в програми цифрової грамотності для недостатньо охоплених послугами груп населення, а також підтримку нецифрових варіантів обслуговування. CDC підкреслює, що штучний інтелект і цифрові інструменти в охороні здоров'я повинні уникати упередженості та гарантувати, що переваги отримають вразливі групи, а не лише привілейовані верстви населення.

- Які стандарти забезпечують інтероперабельність цифрових систем охорони здоров'я?

Ключові стандарти інтероперабельності включають HL7 FHIR для обміну медичними даними, International Patient Summary для транскордонного обміну інформацією про пацієнтів, SNOMED CT і LOINC для стандартизованої медичної термінології, МКХ-10 для класифікації хвороб і SMART Guidelines ВООЗ для цифрових медичних втручань. Ці стандарти дозволяють різним системам - лікарняним електронним системам охорони здоров'я, реєстрам громадського здоров'я, лабораторним інформаційним системам - ефективно взаємодіяти без необхідності індивідуальної інтеграції для кожного з'єднання. Дотримання стандартів знижує витрати і забезпечує масштабованість.

- Яку роль відіграє штучний інтелект у цифровій охороні здоров'я?

ШІ розширює можливості громадської охорони здоров'я кількома способами: автоматизований нагляд за захворюваннями, що виявляє сигнали про спалахи на більш ранній стадії, прогностичні моделі, що визначають групи підвищеного ризику для цілеспрямованої профілактики, обробка природної мови, що витягує інформацію з неструктурованого тексту, комп'ютерний зір, що аналізує зображення для моніторингу стану навколишнього середовища, і чат-боти, що забезпечують медичну освіту в широких масштабах. Однак CDC підкреслює, що застосування ШІ повинно враховувати справедливість у сфері охорони здоров'я та етичні наслідки. ШІ повинен розширювати людські можливості, а не замінювати побудову відносин і культурну чутливість, які залишаються суто людською діяльністю.

- Як організації вимірюють успіх ініціатив з цифрової трансформації?

Показники успіху охоплюють кілька сфер. Показники ефективності включають скорочення часу від виявлення хвороби до реагування та зменшення адміністративного тягаря. Показники результативності відстежують охоплення вакцинацією, охоплення скринінгом і швидкість контролю спалахів. Показники рівності визначають, чи охоплені послугами ті групи населення, які не отримують достатньої кількості послуг. Оцінки досвіду користувачів вимірюють задоволеність постачальників послуг і зручність використання системи. Економічні оцінки визначають економічну ефективність і рентабельність інвестицій. Складність полягає в тому, щоб пояснити поліпшення здоров'я населення саме цифровими системами, а не іншими факторами, що вимагає суворих методів оцінки, таких як квазіекспериментальні порівняння або аналіз часових рядів.

Висновок: Побудова майбутнього громадського здоров'я

Цифрова трансформація - це більше, ніж технологічне оновлення системи охорони здоров'я. Це можливість докорінно покращити те, як ми захищаємо та зміцнюємо здоров'я населення.

Докази очевидні. ВООЗ визначає цифрову трансформацію як життєво важливу для загального охоплення послугами охорони здоров'я. Дослідження демонструють позитивний вплив на стан здоров'я населення. Практичні впровадження демонструють підвищення ефективності та розширення можливостей.

Але технологія сама по собі нічого не вирішує. Успішна трансформація вимагає стратегічного планування, постійних інвестицій, розвитку персоналу, проектування, орієнтованого на справедливість, надійного управління та постійної оцінки. Організації, які розглядають цифрову трансформацію як передусім технологічний проєкт, зазнають труднощів. Ті ж, хто визнає її як організаційну зміну, підтриману технологіями, мають більше шансів на успіх.

Пандемія продемонструвала, що стає можливим, коли нагальність спонукає до інновацій. Системи відстеження контактів, реєстри вакцинації та інформаційні панелі в режимі реального часу розгортаються з безпрецедентною швидкістю. Цей імпульс не повинен згаснути, коли гостра криза піде на спад.

Неінфекційні захворювання, екологічні загрози здоров'ю та стійка нерівність вимагають постійної уваги. Цифрові інструменти пропонують нові підходи до вирішення цих давніх проблем - за умови їхнього вдумливого застосування.

Шлях вперед вимагає співпраці. Міжнародні організації зі стандартизації, такі як HL7 та ВООЗ, надають рамки та рекомендації. Академічні установи збирають докази і готують наступне покоління фахівців у сфері цифрової охорони здоров'я. Постачальники технологій розробляють платформи та інструменти. Але, зрештою, самі установи громадського здоров'я повинні очолити зусилля з трансформації.

Звучить занадто складно? Почніть з малого. Чесно оцініть поточні можливості. Широко залучайте зацікавлені сторони. Пілотуйте сфокусовані додатки. Вчіться як на успіхах, так і на невдачах. Масштабуйте те, що працює. Підтримуйте шляхом постійних інвестицій та оцінювання.

Мета - не досконалість. Це прогрес на шляху до систем охорони здоров'я, які використовують цифрові можливості для справедливого обслуговування всіх верств населення. Системи, які швидше виявляють загрози, ефективніше запобігають хворобам і раціональніше розподіляють ресурси. Системи, які нікого не залишають позаду.

Цифрова трансформація дає охороні здоров'я шанс виконати свою основну обіцянку: покращити умови, в яких люди можуть бути здоровими. Ця можливість вимагає дій - стратегічних, справедливих і послідовних.

Майбутнє охорони здоров'я - цифрове. Але ще важливіше те, що воно орієнтоване на людину, базується на доказах і прагне до справедливості у сфері охорони здоров'я. Технології слугують цим цінностям, а не навпаки.

Готові розпочати трансформацію своєї організації громадського здоров'я? Почніть з оцінки, залучіть зацікавлені сторони та зробіть перший крок до цифрового майбутнього, яке слугуватиме всій вашій громаді.